Игры десятилетиями использовались как один из главных способов тестирования и оценки успешности систем искусственного интеллекта. По мере того как росли возможности, исследователи искали игры с постоянно возрастающей сложностью, которые бы отражали различные элементы мышления, необходимые для решения научных или прикладных проблем реального мира. В последние годы StarCraft считается одной из самых многогранных и сложных стратегий реального времени и одной из самых популярных на сцене киберспорта за всю историю, а сейчас StarCraft стал еще и главным вызовом для исследований ИИ.

AlphaStar — первая система искусственного интеллекта, способная победить лучших профессиональных игроков. В серии матчей, которые состоялись 19 декабря, AlphaStar одержала уверенную победу над Grzegorz Komincz (MaNa) из команды Liquid, одного из сильнейших игроков в мире, со счетом 5:0. Перед этим также был сыгран успешный показательный матч против его товарища по команде Dario Wunsch (TLO). Матчи прошли по всем профессиональным правилам на специальной турнирной карте и без каких-либо ограничений.

Несмотря на значительные успехи в таких играх как Atari, Mario, Quake III Arena и Dota 2, техники ИИ безуспешно боролись со сложностью StarCraft'а. Лучшие результаты достигались путем ручного конструирования основных элементов системы, наложением разных ограничений на правила игры, предоставлением системе сверхчеловеческих способностей или игрой на упрощенных картах. Но даже эти нюансы не дали возможности приблизиться к уровню профессиональных игроков. В разрез этого, AlphaStar играет в полноценную игру, используя глубокие нейронные сети, которые обучаются на основе необработанных игровых данных, с помощью методов обучения с учителем и обучения с подкреплением.

Главный вызов

StarCraft II — это выдуманная фантастическая вселенная с богатым, многоуровневым геймплеем. Наряду с оригинальным изданием, это самая большая и успешная игра всех времен, в которую сражаются в турнирах уже больше 20 лет.

Существует множество способов игры, но самый распространенный в киберспорте — это турниры «один-на-один», состоящие из 5 матчей. Для начала игрок должен выбрать одну из трех рас — зергов, протоссов или терранов, каждая из которых имеет свои особенности и возможности. Поэтому профессиональные игроки чаще всего специализируются на одной расе. Каждый игрок начинает с нескольких рабочих юнитов, которые добывают ресурсы для постройки зданий, других юнитов или развития технологий. Это позволяет игроку захватывать другие ресурсы, строить все более изощренные базы и развивать новые способности, чтобы перехитрить оппонента. Для победы игрок должен очень изящно балансировать картину общей экономики, называемую «макро», и низкоуровневый контроль отдельных юнитов, называемый «микро».

Необходимость балансирования краткосрочных и долгосрочных целей и адаптация к непредвиденным ситуациям ставит большой вызов перед системами, которые на поверку часто оказываются совершенно негибкими. Решение этой проблемы требует прорыва в нескольких областях ИИ:

Теория игр: StarCraft — это игра, где как в «Камень, ножницы, бумага» нет единой победной стратегии. Поэтому в процесс обучения ИИ должен постоянно исследовать и расширять горизонты своих стратегических знаний.

Неполная информация: В отличие от шахмат или го, где игроки видят всё происходящее, в StarCraft'е важная информация часто скрыта и должна активно добываться путем разведки.

Долгосрочное планирование: Как и в реальных задачах, причинно-следственные связи могут не быть мгновенными. Игра также может длиться часа и больше, поэтому действия, совершенные в начале игры, могут не иметь в том числе абсолютно никакого значения в долгосрочной перспективе.

Реальное время: В разрез с традиционными настольными играми, где участники делают ходы по очереди, в StarCraft'е игроки совершают действия непрерывно, наряду с ходом времени.

Огромное пространство действий: Сотни различных юнитов и зданий должны контролироваться одновременно, в реальном времени, что дает поистине огромное комбинаторное пространство возможностей. В дополнение к этому, многие действия являются иерархическими и могут изменяться и дополняться по ходу. Наша параметризация игры дает в среднем примерно от 10 до 26 действий в единицу времени.

Ввиду этих задач, StarCraft превратился в большой вызов для исследователей ИИ. Текущие соревнования StarCraft и StarCraft II берут свое начало с момента запуска BroodWar API в 2009 году. Среди них — AIIDE StarCraft AI Competition, CIG StarCraft Competition, Student StarCraft AI Tournament и Starcraft II AI Ladder.

Примечание: В 2017 году PatientZero публиковал на Хабре отличный перевод «История соревнований ИИ по Starcraft».

Чтобы помочь сообществу исследовать эти проблемы в дальнейшем, мы, работая совместно с компанией Blizzard в 2016 и 2017 году, опубликовали набор инструментов PySC2, включающий самый большой из когда-либо изданных массив анонимизированных реплеев. Опираясь на эту работу, мы объединили наши инженерные и алгоритмические достижения, чтобы создать AlphaStar.

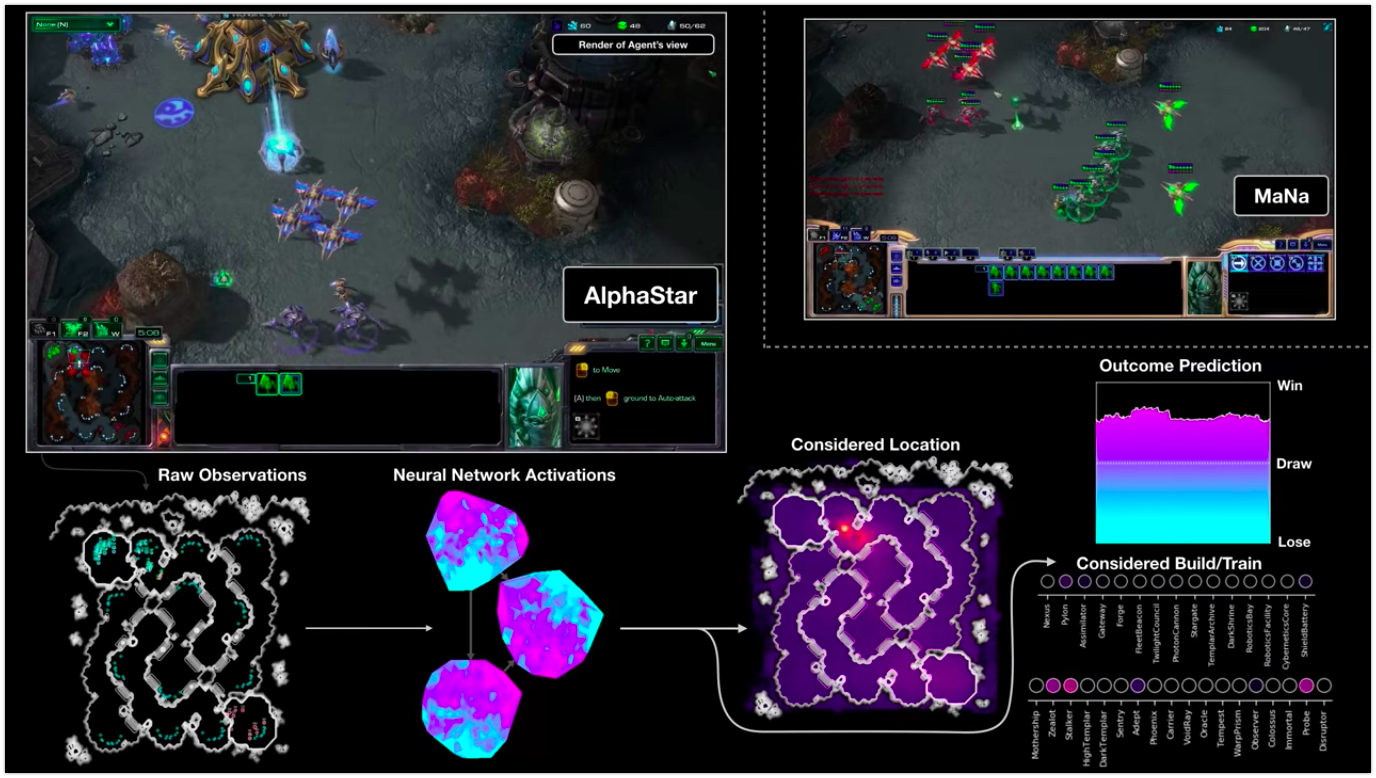

Визуализация AlphaStar во время поединка против MaNa, демонстрирует игру от лица агента — исходные наблюдаемые данные, активность нейронной сети, некоторые из предполагаемых действий и требуемых координат, а также предполагаемый исход матча. Также показан вид игрока MaNa, но он, разумеется, недоступен для агента.

Как происходит обучение

Поведение AlphaStar генерируется нейронной сетью глубокого обучения, которая получает через интерфейс сырые данные (список юнитов и их свойств) и дает на выходе последовательность инструкций, которые являются действиями в игре. Если говорить точнее, архитектура нейронной сети применяет подход «transformer torso to the units, combined with a deep LSTM core, an auto-regressive policy head with a pointer network, and a centralised value baseline» (для точности терминов оставлено без перевода). Мы верим, что эти модели в дальнейшем помогут справиться с другими важными задачами машинного обучения, включающие моделирование долгосрочных последовательностей и большие выходные пространства, такие как перевод, моделирование языков и визуальные представления.

AlphaStar также использует новый мультиагентный алгоритм обучения. Эта нейронная сеть была изначально обучена с помощью метода обучения с учителем на основе анонимизированных реплеев, которые доступны благодаря компании Blizzard. Это позволило AlphaStar изучать и имитировать основные микро- и макро-стратегии, используемые игроками в турнирах. Данный агент победил встроенного ИИ уровня «Elite», что эквивалентно уровню игрока золотой лиги, в 95% тестовых игр.

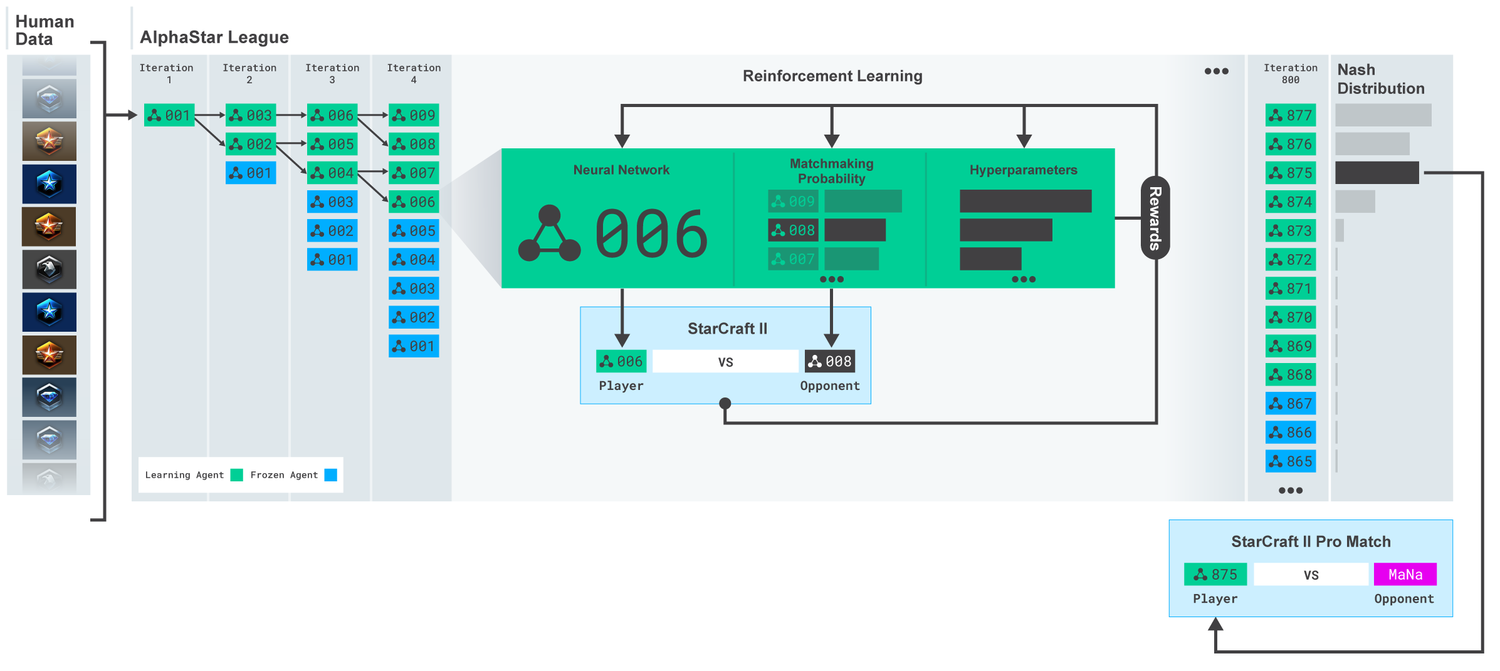

Лига AlphaStar. Агенты изначально обученные на основе реплеев человеческих матчей, а затем на основе соревновательных матчей между собой. На каждой итерации, новые соперники разветвляются, а первоначальные замораживаются. Вероятности встречи с другими оппонентами и гиперпараметры определяют цели обучения для каждого агента, что повышает сложность, которая сохраняет разнообразие. Параметры агента обновляются методом обучения с подкреплением, основываясь на исходе игры против соперников. Конечный агент отбирается (без замены) на основе распределения Нэша.

Эти результаты затем используются, чтобы начать мультиагентный процесс обучения с подкреплением. Для этого была создана лига, где агенты-оппоненты играют против друг друга, подобно тому как люди получают опыт, играя в турниры. Новые соперники добавлялись путем в лигу, путем дублирования текущих агентов. Такая новая форма обучения, заимствуя некоторые идеи из метода обучения с подкреплением с элементами генетических (population-based) алгоритмов, позволяет создать непрерывный процесс исследования огромного стратегического пространства геймплея StarCraft'а, и быть уверенным, что агенты в силах противостоять наиболее сильным стратегиям, не забывая при этом старые.

Оценка MMR (Match Making Rating) — примерный показатель мастерства игрока. Для соперников в лиге AlphaStar в ходе обучения, в сравнении с онлайн-лигами Blizzard'а.

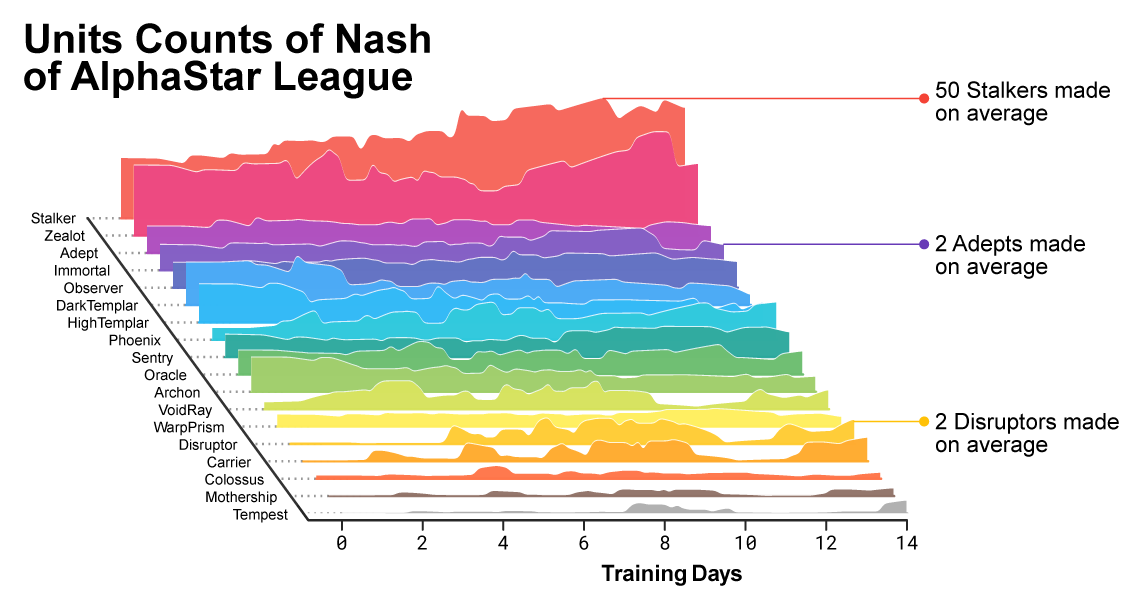

По мере развития лиги и создания новых агентов, появлялись контр-стратегии, которые были способны победить предыдущие. В то время как некоторые агенты лишь усовершенствовали стратегии, которые встречались ранее, другие агенты создавали абсолютно новые, включающие в себя новые необычные билд-ордеры, состав юнитов и макро-менеджмент. К примеру, на ранней стадии процветали «чизы» — быстрые раши с помощью фотонных (Photon Cannons) пушек или темных тамплиеров (Dark Templars). Но по мере того как процесс обучения продвигался вперед, эти рискованные стратегии были отброшены, уступив место другим. Например, производство избыточного количества рабочих для получения дополнительного притока ресурсов или пожертвование двух оракулов (Oracles) для удара по рабочим противника и подрыва его экономики. Этот процесс подобен тому как обычные игроки открывали новые стратегии и побеждали старые популярные подходы, в ходе многих лет с момента выпуска StarCraft'а.

По мере того как обучение продвигалось, было заметно как изменяется состав юнитов, которым пользуются агенты.

Для обеспечения разнообразия, каждый агент наделялся собственной целью обучения. К примеру, каких оппонентов должен победить этот агент, или любая другая внутренняя мотивация, определяющая игру агента. Определенный агент может иметь цель победить одного конкретного противника, а другой — целую выборку оппонентов, но сделать это только конкретными юнитами. Эти цели менялись по ходу процесса обучения.

Интерактивная визуализация (интерактивные функции доступны в оригинале статьи), которая показывает соперников с лиге AlphaStar. Агент, который играл против TLO и MaNa отдельно отмечен.

Коэффициенты (веса) нейронной сети каждого агента обновлялись с помощью обучения с подкреплением на основе игр с оппонентами, чтобы оптимизировать их конкретные цели обучения. Правило обновления веса — это новый эффективный алгоритм обучения «off-policy actor-critic reinforcement learning algorithm with experience replay, self-imitation learning and policy distillation» (для точности терминов оставлено без перевода).

Изображение показывает как один агент (черная точка), который был выбран в итоге для игры против MaNa, развивал свою стратегию в сравнении с оппонентами (цветные точки) в процессе обучения. Каждая точка представляет соперника в лиге. Положение точки показывает стратегию, а размер — частоту, с которой она выбирается в качестве соперника для агента MaNa в процессе обучения.

Для обучения AlphaStar мы создали масштабируемую распределенную систему на основе Google TPU 3, которая обеспечивает процесс параллельного обучения целой популяции агентов с тысячами запущенных копий StarCraft II. Лига AlphaStar проработала 14 дней, используя 16 TPU для каждого агента. В ходе обучения каждый агент испытал до 200 лет опыта игры в StarCraft в реальном времени. Финальная версия агента AlphaStar содержит компоненты распределения Нэша всей лиги. Другими словами, самую эффективную смесь стратегий, которые были обнаружены в ходе игр. И эта конфигурация может быть запущена на одном стандартном настольном GPU. Полное техническое описание сейчас готовится к публикации в рецензируемом научном журнале.

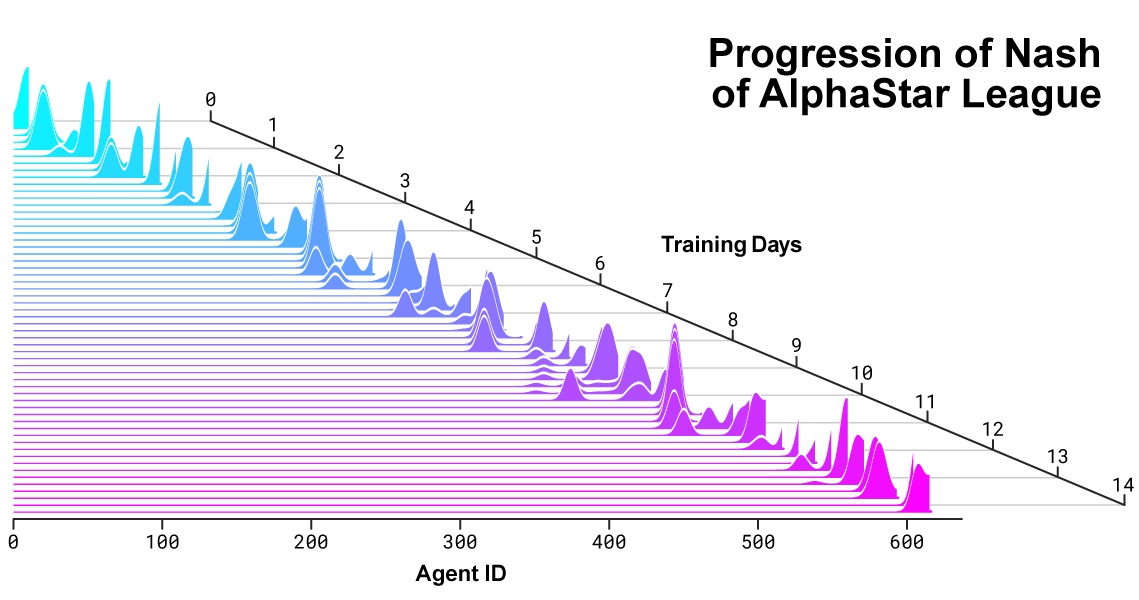

Распределение Нэша между соперниками в ходе развития лиги и создания новых оппонентов. Распределение Нэша, which is the least exploitable set of complementary competitors, высоко оценивает новых игроков, демонстрируя таким образом постоянный прогресс по сравнению со всеми прошлыми конкурентами.

Как AlphaStar действует и видит игру

Профессиональные игроки, как TLO или MaNa, способны совершать сотни действий в минуту (APM). Но это намного меньше, чем у большинства существующих ботов, которые независимо контролируют каждого юнита и генерируют тысячи, если не десятки тысяч действий.

В наших играх против TLO и MaNa, AlphaStar держал APM в среднем на уровне 280, что намного меньше чем у профессиональных игроков, хотя его действия при этом могут быть более точными. Такой низкий APM объясняется в частности тем, что AlphaStar начинал учится на основе реплеев обычных игроков и пытался подражать манере человеческой игры. В дополнение к этому, AlphaStar реагирует с задержкой между наблюдением и действием в среднем около 350 мс.

Распределение APM AlphaStar в матчах против MaNa и TLO, и общая задержка между наблюдением и действием.

В ходе матчей против TLO и MaNa, AlphaStar взаимодействовал с игровым движком StarCraft'а через базовый (raw) интерфейс, то есть он мог видеть атрибуты своих и видимых вражеских юнитов на карте напрямую, без необходимости двигать камеру — эффективно играть с уменьшенным видом всей территории. В разрез с этим, живые люди должны явно управлять «экономикой внимания», чтобы постоянно решать, где сфокусировать камеру. Тем не менее, анализ игр AlphaStar показывает, что он неявно управляет фокусом внимания. В среднем агент переключает свой контекст внимания примерно 30 раз в минуту, подобно MaNa и TLO.

В дополнение мы разработали вторую версию AlphaStar. Как игроки-люди, эта версия AlphaStar явно выбирает, когда и куда двигать камеру. В этом варианте его восприятие ограничено информацией на экране, а действия также допустимы только на видимой области экрана.

Производительность AlphaStar при использовании базового интерфейса и интерфейса с камерой. График показывает, что новый агент, работающий с камерой, быстро достигает сопоставимой производительности агента, использующего базовый интерфейс.

Мы обучили двух новых агентов, одного с использованием базового интерфейса и одного, который должен был научиться управлять камерой, играя против лиги AlphaStar. Каждый агент в начале был обучен с учителем на основе человеческих матчей, с последующим обучением с подкреплением, описанным выше. Версия AlphaStar, использующая интерфейс с камерой, достигла почти таких же результатов, что и версия с базовым интерфейсом, превысив отметку в 7000 MMR на нашей внутренней таблице лидеров. В показательном матче, MaNa победил прототип AlphaStar, использующий камеру. Эту версию мы обучали только 7 дней. Мы надеемся, что сможем оценить полностью обученную версию с камерой в ближайшем будущем.

Эти результаты показывают, что успех AlphaStar в матчах против MaNa и TLO в первую очередь является следствием хорошего макро- и микро-менеджмента, а не просто большого клик-рейта, быстрой реакции или доступа к информации базового интерфейса.

Итоги игры AlphaStar против профессиональных игроков

StarCraft позволяет выбирать игрокам одну из трех рас — терранов, зергов или протоссов. Мы приняли решение, что AlphaStar на данный момент будет специализироваться на одной конкретной расе — протоссах, чтобы снизить время обучения и вариации в оценке результатов нашей внутренней лиги. Но следует отметить, что аналогичный процесс обучения может быть применен для любой расы. Наши агенты были обучены играть в StarCraft II версии 4.6.2 в режиме протосс против протосса, на карте CatalystLE. Для оценки производительности AlphaStar, мы изначально тестировали наших агентов в матчах против TLO — профессионального игрока за зергов и игрока за протоссов уровня «GrandMaster». AlphaStar выиграл матчи со счетом 5:0, используя широкий диапазон юнитов и билд-ордеров. «Я был удивлен, насколько сильным был агент», сказал он. «AlphaStar берет известные стратегии и переворачивает их с ног на голову. Агент показал такие стратегии, о которых я даже никогда не думал. И это показывает, что по-прежнему могут быть способы игры, которые до сих пор не изучены в полной мере».

После дополнительного недельного обучения, мы сыграли против MaNa, одного из самых сильных игроков StarCraft II в мире, и входящего в 10 сильнейших игроков за протоссов. AlphaStar и в этот раз победил со счетом 5:0, продемонстрировав сильные навыки микро-управления и макро-стратегии. «Я был поражен, увидев как AlphaStar использует самые передовые подходы и разные стратегии в каждой игре, показывая очень человеческий стиль игры, который я никак не ожидал увидеть», сказал он. «Я осознал, насколько сильной мой стиль игры зависит от использования ошибок, основанных на человеческих реакциях. И это ставит игру на совершенно новый уровень. Мы все восторженно ожидаем увидеть, что же будет дальше».

AlphaStar и другие сложные проблемы

Несмотря на то что StarCraft — это лишь игра, пусть даже и очень сложная, мы думаем, что техники, лежащие в основе AlphaStar, могут быть полезны в решении других задач. К примеру, такой тип архитектуры нейронной сети способен моделировать очень длинные последовательности вероятных действий, в играх зачастую длящихся до целого часа и содержащих десятки тысяч действий, основанных при этом на неполной информации. Каждый фрейм в StarCraft'е используется как один шаг ввода. При этом нейронная сеть каждый такой шаг предсказывает ожидаемую последовательность действий для всей оставшейся игры. Фундаментальная задача составления сложных прогнозов для очень длинных последовательностей данных встречается во многих задачах реального мира, таких как прогноз погоды, моделирование климата, понимание языка и др. Мы очень рады осознавать огромный потенциал, который может быть применен в этих областях, использую наработки которые мы получили в проекте AlphaStar.

Мы также думаем, что некоторые из наших методов обучения могут оказаться полезными в изучении безопасности и надежности ИИ. Одна из самых сложных проблем в области ИИ — это количество вариантов, при которых система может ошибаться. И профессиональные игроки в прошлом быстро находили способы обойти ИИ, оригинально используя его ошибки. Инновационный подход AlphaStar, основанный на обучении в лиге, находит такие подходы и делает общий процесс более надежным и защищенным от подобных ошибок. Мы рады, что потенциал такого подхода может помочь в улучшении безопасности и надежности ИИ-систем в целом. В особенности, в таких критичных областях, как энергетика, где крайне важно правильно реагировать в сложных ситуациях.

Достижение такого высокого уровня игры в StarCraft представляет собой большой прорыв в одной из самых сложных когда-либо созданных видеоигр. Мы верим, что эти достижения, наряду с успехами в других проектах, будь то AlphaZero или AlphaFold, представляют собой шаг вперед в осуществлении нашей миссии по созданию интеллектуальных систем, которые однажды помогут нам найти решения для самых сложных и фундаментальных научных вопросов.

11 реплеев всех матчей

Видео показательного матча против MaNa

Видео с визуализацией AlphaStar полного второго матча против MaNa

Комментарии (35)

Slavik_Kenny

26.01.2019 09:55мы изначально тестировали наших агентов в матчах против TLO

Я правильно понял, что ИИ специально затачивали под конкретного противника?

phantom-code

26.01.2019 12:02+1Смотрел трансляцию и мне показалось, что AlphaStar побеждает во многом за счет более точного и быстрого микроменеджмента. Один раз он вообще зажал MaNa с трех сторон одновременно. Было бы интересно увидеть AI, который распознает изображение с экрана и управляет с помощью некоей эмуляции устройств ввода (задержки при перемещении курсора мыши, пропорциональные расстоянию, и т.п.). Основной интерес представляют, стратегия и «человечность» AI. A то, что он намного быстрее и точнее человека, известно и так.

pavel_smolnikov Автор

26.01.2019 12:59То что ИИ будет обыгрывать даже самых продвинутых корейцев, по моему мнению, лишь вопрос времени. На мой взгляд, самое интересное поле битвы, которое нас ждет — это турниры ИИ против ИИ. Они во многих видах существуют и сейчас (в том числе упомянуты в статье), но это пока была только разминка. Во-первых, боты до этого имели довольно простую архитектуру. Во-вторых, уровень самих соревнований ограничивался в основном небольшими мероприятиями при университетах, организованными узким комьюнити.

А теперь представьте, когда другая сильная команда выдвинет своего бота против AlphaStar. Вот тут и начнется настоящая битва умов с большой репутацией на кону. Ведь как это так, если вдруг какая-то малоизвестная команда вдруг обойдет DeepMind? Это что значит, что их базовые алгоритмы и архитектуры оказались эффективнее? Они там в небольшой команде нащупали что-то более крутое, чем несколько десятков PhD?

А вот то что стратегия игры AlphaStar действительно довольно примитивной остается — тут полностью согласен. Учитывая, что он проходил обучение на большом массиве реплеев — это наводит на два предположения. Либо такие микро-стратегии действительно оказываются более эффективными при их точном выполнении. Либо просто сам фундамент «глубокого обучения» не позволяет разворачивать во времени более сложные зависимости.

IllUseItOnce

26.01.2019 23:21Отвечу на последний абзац: не ясно. Протоссы просто не самая удачная раса для такого шоу.

Отточив раннюю игру на протоссах через уничтожение экономики Oracle'ами и добивание Stalker'ами забраться достаточно далеко в ладдере старкрафта может даже очень средний игрок: мой приятель так покорил платиновую лигу, мне стало скучно намного раньше, максимальный АПМ у обоих не превышает 200, а эффективный и того меньше.

Сталкер сбалансирован с учётом человеческого уровня контроля, а вот в руках ИИ почти все остальные юниты становятся просто не нужны. Какие-то долбанутые стратегии использовало только 2 агента, да и то из тех, кто играл против TLO (Carrier'ы и Disruptor'ы), но ещё одна неделя тренировок эту дурь всю выбила — по чарту частоты использования разных юнитов в тренировке с вариантами себя всё видно.

У остальных рас просто нет юнитов с подобной (ограниченной только точностью и скоростью контроля) эффективностью, так что интересно как АльфаСтар сыграет на тех же терранах, например. Жду с нетерпением, потому что даже минувшие шоу-матчи было довольно-таки интересно смотреть.

pavel_smolnikov Автор

28.01.2019 00:22+1Кстати, да. Вы подняли очень интересный вопрос. Ведь Blizzard действительно годами (если не сказать десятилетиями уже) оттачивал баланс как отдельных юнитов, так рас в целом, оптимизируя его именно под человеческий стиль игры и его возможности. Хороший тому пример — блинк сталкеров. Или еще один — развод пехоты (при ударе бейлингов, допустим). Руками ты все равно упираешься в какой-то предел. А вот ИИ может доводить такие техники до совершенства.

Баланс всей игры под ИИ, конечно, переделывать не будут. Но как я писал выше уже, игра против людей и не так интересна, т.к. априори рано или поздно алгоритмы будут на порядок сильнее. StarCraft — это хоть и не детерминированное поле 8 на 8, но все равно вполне ограниченная цифровая среда. Поэтому по-настоящему интересны именно бои самых передовых ИИ-архитектур. И тут уж можно и на APM никакого ограничения не накладывать и камеру вообще убрать.

mg12

26.01.2019 12:59Сегодня пообщался с опытными геймерами: говорят, что команды MaNa и TLO играли значительно хуже обычного. Есть подозрение, что в данном конкретном случае Google придумал для них дополнительное поощрение :). Разумеется, я не отрицаю, что ИИ способен выигрывать в компьютерные игры. Просто у DeepMind уже давно не было пиара и соблазн с финансовыми возможностями Google слишком велик.

pavel_smolnikov Автор

26.01.2019 13:09Очень вряд ли, на мой взгляд. Искать причину в том, что «как обычно проплатили» нет смысла. В первую очередь нужно учесть, что для них это был реально новый опыт. И они реально еще не понимали, чего ждать и как вообще в таком режиме может складываться игра. То есть это, в некотором смысле, и психологическое давление. MaNa так и сказал в интервью, что многих вещей не ожидал увидеть. И что осознал, насколько его стиль игры опирался именно на игру против живого соперника, используя именно человеческие слабости.

Плюс нужно учесть, что в западном сообществе репутация — это всё. И если коллеги заметят какое-то неадекватное поведение нетипичное, то это может очень сильно подмочить репутацию и даже разрушить карьеру в киберспорте.

mapron

26.01.2019 18:47-1" TLO играли значительно хуже обычного"

«TLO — зерг»

Я вообще первый раз его оффрейс увидел, вы о чем?

Люди в оффрейсе бывает вообще на элементарных вещах сыпятся.

MaNa — другое дело. В первых матчах были совершенно тупые косяки, позволить сопернику по рампе подняться, например.

Но в целом не было ощущения игры в поддавки все равно.

onum

26.01.2019 13:00Интересно, что случилось в последнем матче. Новый агент с движимой камерой, по метрикам был не сильно хуже, чем предыдущие, тем не менее проиграл. Мана нашел слабое место агента и эксплуатировал ее: отвлекал армию и наносил ущерб 2:39:31. Хотя один из предыдущих агентов умел разбивать армию и держать защиту от похожих атак 2:05:37. Мне кажеться AlphaStart не был знаком с Warp Prism микро и критическую роль сыграло уменее человека обучаться по ходу дела и не повторять или эксплуатировать ошибки.

DragonFire

26.01.2019 13:30В статье толком не указано что MaNa в итоговом 6 матче победил как раз нового агента, который видел мир «камерой». И действовал при этом агент очень глупо, посмотрите видео с профессиональными комментариями, например Alex007SC2…

kibergus

26.01.2019 22:43Потому что статья — это пресс релиз который выложили обновременно с конференцией на которой был 6ой матч. Она написана до этого матча.

dmitryredkin

28.01.2019 00:35Вы, видимо, невнимательно читали и слушали. До самого того фатального косяка ИИ вел игру лучше, имел перевес и все шансы на победу.

Но Мана каким-то образом сумел поставить его в тупик. ИИ просто не знал, как реагировать на такую тактику и продолжал топтаться на месте.

Что и решило матч.

DragonFire

28.01.2019 01:17Именно — ИИ просто не знал как реагировать на такую ситуацию и начал повторять одни и те же бессмысленные действия =)

ssh24

26.01.2019 13:35техники, лежащие в основе AlphaStar, могут быть полезны в решении других задач.

Конечно. Военная например.

hddn

26.01.2019 15:22+1Интересно, можно ли создать в принципе игру, в которой у ИИ не будет преимущества?

Под игрой я не имею в виду подбрасывание монеты и т.п., разумеется.

Вероятно, это должна быть игра, в которой меняются правила.

WinPooh73

26.01.2019 17:54Элузис, она же Элевсин.

Возможно, отгадывать закономерности в последовательностях карт ИИ сможет хорошо, но в этой игре надо ещё и придумывать правила выкладывания. Причём они не должны быть ни слишком простыми, ни слишком сложными — это учитывается системой подсчёта очков.

hddn

26.01.2019 18:10Вот еще: ru.wikipedia.org/wiki/Nomic

И еще: ru.wikipedia.org/wiki/Fluxx

Думаю, с ними ИИ будет гораздо сложнее справиться.

Druu

27.01.2019 09:53Интересно, можно ли создать в принципе игру, в которой у ИИ не будет преимущества?

Это любая игра при балансе которой не учитываются человеческие ограничения. С-но, те же шахматы или го — у ИИ в этих играх нет никаких преимуществ по сравнению с человеком.

Hardcoin

27.01.2019 22:26Если у человека есть что-то такое, что для ИИ невозможно (душа, например), то да. Иначе нет, только временно. В ближайшие годы ИИ обучится чему угодно, если хватит железа.

superstarstas306

26.01.2019 22:04Подскажите, пожалуйста, с помощью какого инструмента делалась визуализация для статьи?

mistergonza

27.01.2019 14:10В статье упоминается что ИИ подготавливали к игре на конкретной карте, интересно было бы посмотреть как ИИ мог справиться с человеком на незнакомой ему карте (незнакомой в том числе и человеку).

Zmiy666

а есть ли у ИИ какое-то ограничение на количество изменений в секунду? Просто у человека оно есть и весьма существенное, выделить, кликнуть мышкой, выбрать в меню, снова выделить, кликнуть… у ИИ это выходит на 1-2 порядка быстрее и количество операций на единицу времени сильно выше. Игрок тупо не успевает реагировать, особенно это актуально в бою.

Afterk

DX168B

Если не ошибаюсь, в APM входят даже такие действия, как указание точки отправки юнита на карте. Многие игроки кликают много раз в одну зону, что тоже входит в APM. Так как кликать в одну область можно очень быстро, то это приводит к большим значениям APM, большая часть которых просто бесполезна. ИИ может сделать каждое действие полезным и эффективным, а по сему его 280 APM может быть равным 500 APM игрока.

pavel_smolnikov Автор

Да, они сами это тоже отметили в статье:

Но алгоритм расчета APM учитывает не все нажатия, а только «эффективные». То есть просто повторные клики в одной точке в APM не входят. Кроме того, алгоритм расчета APM немного меняется от патча к патчу, как раз учитывая, что именно считать действиями.

mitasamodel

Всё ещё интересней. «Среднее» APM, конечно, очень важный показатель, но пиковый стоит тоже смотреть.

На видео хорошо видно, что во время сражений контроль юнитами со стороны AI осуществлялся с APM вплоть до 1500, в то время, как соперник выдавал «всего» около 400.

В других сражениях примерно также: APM в полтора раза выше, лучше микроконтроль юнитов.

При просмотре мне даже вспомнилось видео с читерами. Там тоже всю игру был «нормальный» APM, а во время боя начинался таакой микроконтроль, что прямо ах.

dmitryredkin

А посмотреть на графики APM на диаграмме не судьба? Там ведь ясно видно, что хвост распределения у AlphaStar намного ниже т короче, чем у профессионалов.

pavel_smolnikov Автор

В обзоре на канале Alex007SC2 есть хороший момент, когда APM AlphaStar во время битвы достигает и полутора тысяч действий:

Hardcoin

Это не очень существенно. Просто обгонять бесполезно, если действия глупы. Вот если действия умны — тогда скорость поможет. Существенно то, что действия умны. То есть идея алгоритма позволяет обучить на умные действия.

Да и при решении задач никто не придирается к APM. Если робомобиль с бешеным APM будет водить лучше людей — никто на этот APM жаловаться не будет. Или если робот будет посылки доставлять, реагируя быстрее человека — не проблема. Главное что б действия были не тупы.