В июле исследователи Google из команды Brain Team поделились своими достижениями в области масштабирования изображений. Результаты своих исследований они опубликовали в блоге Google AI, посвящённом исследованиям и разработкам в области машинного обучения и искусственного интеллекта.

В статье под названием «Создание высокоточных изображений с использованием диффузионных моделей» (High Fidelity Image Generation Using Diffusion Models) продемонстрирована технология масштабирования изображений на базе диффузионных моделей.

Говоря простыми словами, Image Super-Resolution — это технология «умного» увеличения изображений. Она заключается в обучении модели превращать изображение с низким разрешением в изображение с высоким разрешением (технология RAISR была описана в блоге Google AI в 2016 году).

Если быть точным, в свежей публикации описан подход, основанный на комбинации двух алгоритмов — SR3 и CDM. Он позволяет создавать изображения высокого разрешения без заметной потери качества.

SR3 - Super-Resolution via Repeated Refinements - масштабирование через повторное уточнение.

CDM - Cascaded Diffusion Models - каскадные диффузионные модели.

Super-Resolution via Repeated Refinements

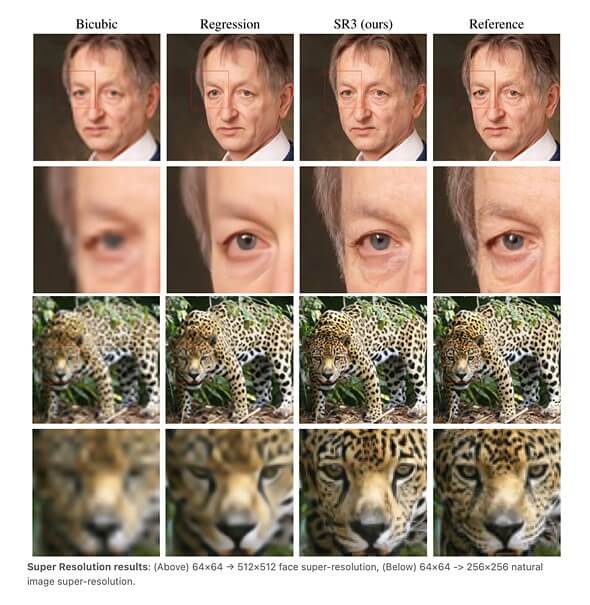

SR3 принимает на вход изображение в низком разрешении и пытается построить изображение с более высоким разрешением, добавляя в него гауссовский шум и размытие на каждом повторе. Итоговое изображение по сути содержит чистый шум. Затем идёт обратный процесс - модель постепенно удаляет шум для достижения нужного результата.

Обученная на огромном массиве данных, модель SR3 показывает хорошие результаты в задачах масштабирования в 4-8 раз изображений лиц и изображений объектов живой природы: 64x64 → 256x256 (в 4 раза) и 256x256 → 1024x1024 (в 4 раза). Объединив модели в каскад, можно масштабировать изображения до 16 раз: 64x64 → 1024x1024.

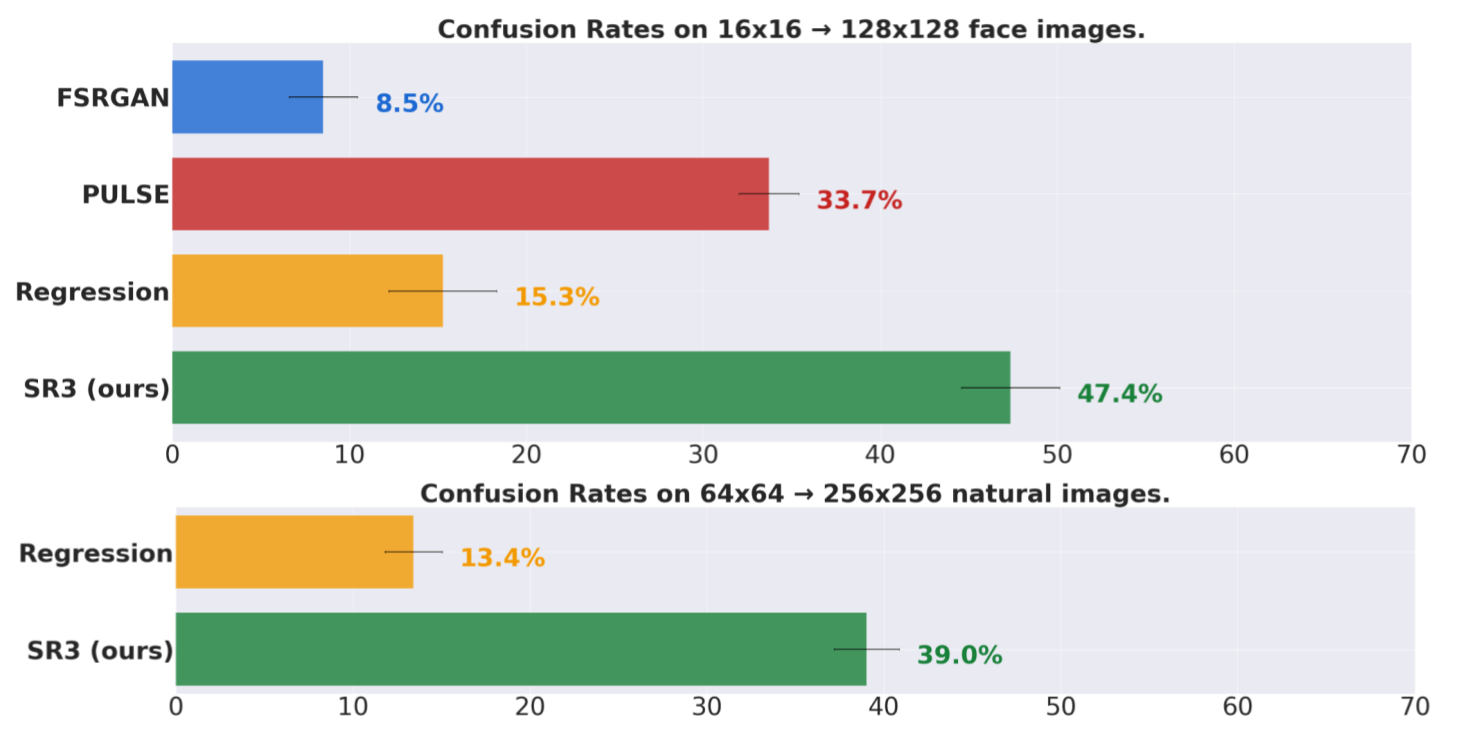

Как оценить качество работы SR3? Результаты работы модели сравнивают с результатами работы других моделей. Участвующих в эксперименте людей просят выбрать изображение, которое, по их мнению, сделано на фотокамеру (так ставится вопрос).

Участники выбирают между изображением, которое создала модель, и оригинальным изображением с камеры.

Эффективность модели измеряется с помощью коэффициента путаницы (confusion rate): какой процент времени участники эксперимента выбирают результат работы модели, а не эталонное изображения (а идеальный алгоритм как раз и даёт "50-процентный коэффициент путаницы").

Результаты этого исследования показаны ниже:

Cascaded Diffusion Models

CDM обучена на огромном количестве изображений из базы ImageNet, которые представляют собой достаточно сложный набор данных. Именно по этой причине CDM построена как каскад нескольких моделей.

Каскадный подход представляет собой цепочку нескольких генеративных моделей, каждая из которых создаёт изображение с разным разрешением: одна диффузионная модель генерирует изображение с низким разрешением, которое обрабатывает SR3, постепенно повышая разрешение до максимально доступного.

GIF на 4,5 МБ

Масштабирование изображения с 32x32 до 256x256

О реальном внедрении или коммерческом применении информации пока что нет.

Дополнительные материалы:

Комментарии (72)

tbl

04.09.2021 16:45+68Кхм

GerrAlt

04.09.2021 17:31+16А куда делся белый воротничок рубашки? Не верится что сетка могла вот так взять и сильно выделяющийся фрагмент картинки выкинуть :)

Moretti2020

04.09.2021 20:15+4Насчёт воротничка не знаю, но глаза она лео/гепарду очень сильно исказила.

Vsevo10d

04.09.2021 20:47+1*Режим пяти копеек*: Есть простой способ. У гепарда крапинки только сплошные, круглые, по минимуму на голове. У леопарда они неровные и образуют кластеры, как бы колечки вокруг желтого, которые при уменьшении диаметра на брюхе и голове сливаются в просто черные точки.

thatsme

04.09.2021 22:21+5"Макса Мустермана" из Франкфурта ... Как-то так ...

На эту модель и гугл можно теперь в суд подавать...

anonymous

00.00.0000 00:00

ximik666

04.09.2021 21:04+2А где можно попробовать или посмотреть реализацию?

AlekseyKidis

04.09.2021 21:19+2Topaz Gigapixel пытается по принципу нейросети улучшить качество картинки. обещают в 6 раз. Не так революционно как в статье но для ознакомления наверное пойдет

taberu

05.09.2021 22:14+1По своему опыту могу сказать, что алгоритмы Topaz почему-то как раз с лицами работают очень неважно, хоть там есть даже настройка их детектить, а с формой глаз так между сносно и отвратительно, закрытые же глаза может вообще превращать в жуткие отверстия. Возможно с HD изображения дела обстоят получше, с разрешением пониже и 4x увеличение требует правок руками

ИИ бровь

Baigildin

06.09.2021 05:42+2Довольно любопытно. Как бы наш мозг дорисовал человека, если бы не знал что это Барак Обама и если вообще этого человека не существовало бы.

mSnus

04.09.2021 17:21+32Не повышает она разрешение, неправда это. Гугл и то честнее -- называет это "генерирование изображений...". Но по сути это угадывание.

dipsy

04.09.2021 19:55+4Или узнавание. Для известных лиц сможет практически реальные лица восстанавливать, для малоизвестных, если будет способна дообучаться, сможет на базе ваших же хороших фото дорисовывать ваши же селфи из крайне неудачных условий съемки в темноте и расфокусе.

serafims

04.09.2021 21:58+25Ничего, для видеопродукции японской индустрии сойдет. Плюс-минус все одинаковое, что они там заблюрили.

wataru

06.09.2021 11:29+1Видел несколько проектов для этого самого. Правда для рисованного. Есть и такие, что и раскрашивали. Вот только не помню, как оно называлось, а гуглить такое с работы не хочется.

v1000

04.09.2021 22:26+12Честно говоря, потенциал технологии немного пугает. В том смысле, что вместо совершенствования сенсоров и оптики, все ринулись в технологию дорисовывания того, чего нет.

Stesh

04.09.2021 23:09+16все ринулись в технологию дорисовывания того, чего нет.

Дорисовать — это еще полбеды. Беда придет, когда начнут такими «улучшенными» фото размахивать где нибудь в суде.

Dr_Faksov

05.09.2021 06:42+4Беда придет, когда начнут такими «улучшенными» фото размахивать где нибудь в суде.

«улучшенными» будут махать в «суде». А в Суде на каждое фото\видео приводится экспертное заключение что фото не подвергалось редактированию.

MechanicZelenyy

05.09.2021 11:54+3Только вот в Судах зачастую приводится "экспертное заключение", так что ваш Суд "суда" сильно отличается.

VitalKoshalew

06.09.2021 07:59+2В судах некоторых стран антинаучный «детектор лжи» принимают; выводы AI-системы определения выстрелов по звукам ShotSpotter до недавнего времени моги быть основным доказательством в суде, пока не оказалось, что операторы кол-центра ShotSpotter по просьбе «органов» вписывают в базу нужные выводы о типе звука и правят геолокацию, а сама AI-система никакой научно-обоснованной проверки не проходила.

BugM

05.09.2021 04:54+5Оптика давно уже вся на физических пределах работает. Только платите.

Такая оптика на самом деле дорого стоит. Её сложно изготавливать.

DistortNeo

05.09.2021 11:40+2С другой стороны, КПД сенсоров всё ещё очень далёк от идеала. Дикие шумы, токи утечек, в итоге КПД составляет порядка 1%.

А что касается оптики: всё упирается в светосилу. Чем больше размер линзы, тем больше света она может собрать и тем выше качество снимка. Проблема исключительно в габаритах: большую линзу в смартфон не засунуть.

pvsur

06.09.2021 18:51+1Бедные орлы и соколы.... Как они там со своими глазками размером чуть больше объектива смартфона мышей видят с птичьего полета..

DistortNeo

06.09.2021 21:51+2Очень просто:

- Выше чувствительность.

- Больше плотность пикселей.

- Глаз у орлов таки большой, в разы больше, чем булавочное горлышко смартфонов.

thatsme

05.09.2021 08:59+13Почему пугает? это очень прикольные базовые элементы "очень сжатой памяти". Т.е. храним в памяти картинку в 16х меньше оригинала, при необходимости восстанавливаем в нужном разрешении, ну подумаешь с оригиналом уже не совпадает, - перезапишем из сгенеророванного ... Моя память так примерно и работает, поэтому Билл Мюррей в любой момент мог стать Джеймсом Белуши и наоборот, пока я их имена не запомнил и с картинками не связал. 20 лет назад я был свято уверен, что это один и тотже чел и судя по всему на них двоих у меня один сжатый портрет был. Потом сетка перетренеровалась, под воздействием окружающих, - жена надо мной постоянно ржала.

lunacyrcus

05.09.2021 23:33+1Ну не знаю чего тут пугаться. Это вообще-то похоже на то как человеческий мозг хранит информацию. Мозг тоже не хранит все 1:1 и с точностью до пикселя (если уж к этому пиксели применить, образно), хранит какие-то ключевые моменты, а многое "дорисовывает".

Да и вообще эта штука конечно не слишком удивляет, давно уже существовали алгоритмы делающие upscaling с более-менее похожим результатом и применялись коммерчески. Гугл видимо решил свой трехколесный велосипед сделать чтобы бороться с низкокачественными картинками в собственном поиске по картинкам, или не знаю зачем еще.

Но вообще даже если просто интереса ради то тоже интересная темка.

Dr_Faksov

09.09.2021 01:49+4Мозг тоже не хранит все 1:1 и с точностью до пикселя (если уж к этому пиксели применить, образно), хранит какие-то ключевые моменты, а многое "дорисовывает".

У мозга, как считают на данный момент, есть два режима построения изображения.

Первый- подгон готовой картинки из памяти по некоторым ключевым деталям полученным с сетчатки. Картинка в памяти может быть ранее увиденной на рисунке (или даже быть представленной по детальному описанию) и не иметь никакого отношения к реальности. А может и иметь.

Второй - построение по-пиксельного изображения с сетчатки глаза.

Чаще всего используется первый режим как наименее ресурсоёмкий и более быстрый. Отсюда черти, летающие тарелки и прочие интересности. Причём человек их реально видит, как он думает. Они даже двоятся при нажимании на глаз.

Для перехода во второй режим достаточно отвести взгляд и засомневаться.

slonopotamus

05.09.2021 00:55+17Технология Google повышает разрешение изображений до 16 раз без потери качества

Надо очень постараться, чтобы в процессе увеличения разрешения сделать качество хуже чем было изначально.

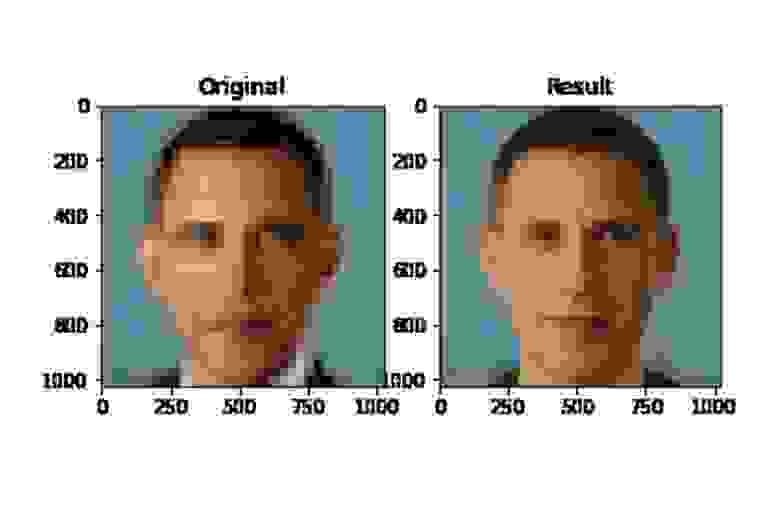

mapron

05.09.2021 08:17+2Надо постараться, но они смогли. выше уже кидали где просто пропадают детали изображения которые были в оригинале (фото с Обамой)

3Dvideo

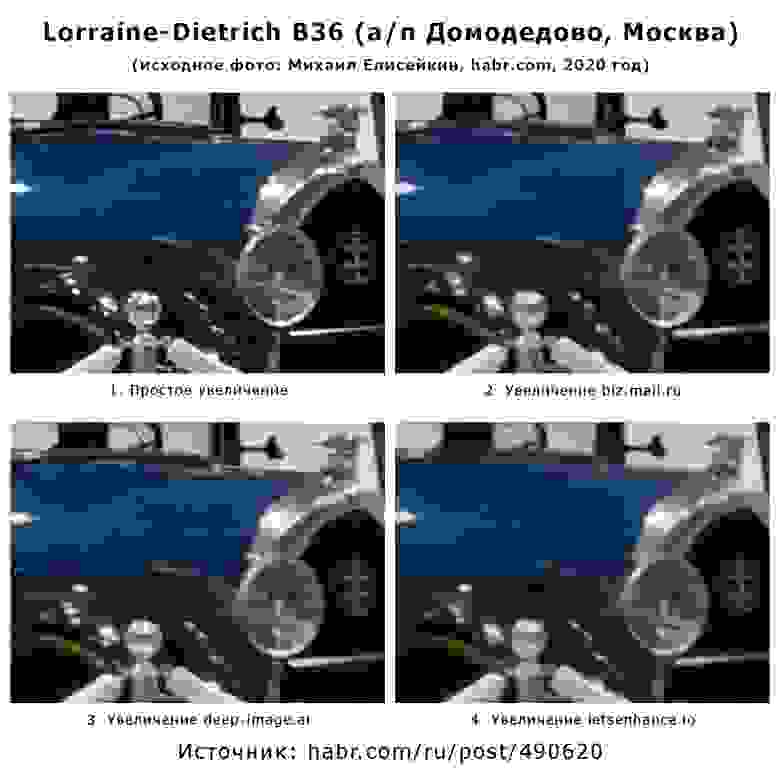

05.09.2021 11:40+13Пару лет назад я тут делал пост "Увеличь это! Современное увеличение разрешения", который набрал +376 и 168 тысяч прочтений - как раз про разницу между реальным восстановлением и "сделай мне красиво, детка".

А этой весной мы зарелизили бенчмарк методов SR для видео https://videoprocessing.ai/benchmarks/video-super-resolution.html, где есть возможность на потоке генерировать такие сравнения:

Заметим - самый правый (топ номинации "самые ужасные зубы") - это самый модный в этом сезоне метод Super-Resolution Real-ESRGAN, прямо сейчас он висит на 4 месте (!) в трендах на первой странице https://paperswithcode.com/ (а два дня назад был вторым!) и вообще он в топе среди 600+ методов SR, доступных сегодня на гитхабе.

Как пользоваться:

Выбираете характер движения (для методов, которые реально восстанавливают - это важно) тип контента и модели - и наслаждаетесь реальным (а не рекламным) качеством.

Иногда оно очень приличное, заметим! Но контраст к рекламой сложно не заметить.

Этот бенчмарк мы активно пополняем разными модными SR. Еще два наших бенчмарка по SR (один - для картинок, второй - для пары SR+видеокодек) на подходе.

Пост про самые прикольные моменты бенчмарка (а также о том, как корректно интерпретировать графики, что творится в метриках SR - а то мне заголовок "без потери качества" в этой статье понравился))), ну и что творится в методах SR) планирую, а пока можете сами экспериментировать. В т.ч. можно туда залить интересующий вас метод (взяв код с гитхаба) и посмотреть, как он ляжет относительно других на графиках (заметим, что по умолчанию топ бенчмарка отсортирован по усредненной оценке нескольких сотен людей, которым мы показали результаты на яндекс.толоке). Это замедляет добавление, но зато позволяет оценить, насколько оно хорошо на большом количестве разнородных примеров контента.

Enjoy! )

3Dvideo

05.09.2021 12:10+5

Вот вам еще для вдохновения - лицо, на котором "все умерли" )

А так оно на номерах (iSeeBetter прям красавцы, а что творит текущий самый модный на гитхабе видите сами):

Что-то подсказывает, что и у гуглового есть погонять - не все так волшебно будет), никакого "без потери качества в 16 раз" там заведомо нет, конечно)

smirnoffserhiy80

05.09.2021 22:33+1Я думаю если исходник был в плохом качестве, то его уже никакая технология не улучшит, темболее бесплатный продукт от гугла.

DIMooo

06.09.2021 09:03+3Я помню что в 90-х баловался программкой фрактального сжатия и увеличения. Загонял в неё картинку размером 32х32 и на голой математике без всяких ИИ и нейросетей минут через 10 получал увеличенный в 30 раз результат, который было просто интересно разглядывать, потому, что он получался "магически" естественным, только на гладких глянцевых поверхностях появлялись сколы и трещинки или грязь какая то налипала.

Galperin_Mark

06.09.2021 11:15+1Возможно технологию удастся применить для снижения объема передаваемого трафика. Если в определенных случаях (не утверждаю что во всех) изображение можно будет передавать в искусственно заниженном разрешении, а затем восстановить почти без потери качества, то это должно значительно снизить объем передаваемого видео, фото и иных графический файлов.

3Dvideo

06.09.2021 13:51+1Там все не так волшебно) Мы прогнали пачку наиболее успешных алгоритмов Super-Resolution с разными кодеками на разных разрешениях. Ключевые выводы:

* Как только со сжатием уходят высокие частоты - эффективность подавляющего большинства методов SR сильно падает (ниже битрейт - ниже выигрыш от SR).

* С новыми кодеками (типа AV1) эффективность применения SR ниже, чем со старыми (типа H.264).

С другой стороны - сейчас включение нейросетевых методов SR прямо внутрь кодека - это тренд + есть LCEVC

Статья на английском точно будет. Возможно и пост тоже)

muxa_ru

06.09.2021 18:33+2А можно ли им как-нибудь скормить вот эту картинку и увеличить?

Интересно, что будет в фаре

steff Автор

Tomasina

А еще год назад где-то на хабре утверждали что такое как в фильмах - математически невозможно.

andreishe

Оно все ещё невозможно. Нельзя из картинки низкого разрешения извлечь информацию, которой там нет. Но можно додумать свою.

thatsme

Но ведь нейросеть именно это и делает. Ну подумаешь не существующий номер на zoom-in будет ...

DistortNeo

Она не извлекает информацию, а дорисовывает её, делая изображение визуально правдоподобным.

thatsme

Спасибо кэп. 3-м будешь.

dcoder_mm

Цифры и текст неплохо восстанавливаются из пары пикселей

muxa_ru

Если знать язык и шрифт, то да - можно восстановить. Количество символов и цифр очень небольшое.

Но рисунок состоящий из произвольных пикселей, это совсем другое дело.

dcoder_mm

Выше был коммент про "не существующий номер на zoom-in будет", я отвечал на него. А на что отвечали вы?

muxa_ru

Хм.

Я не воспринял работу с упорядоченным набором пикселей как ответ на картинку на которой этого набора нет.

Номер ведь реально НЕСУЩЕСТУВУЮЩИЙ, а не УМЕНЬШЕННЫЙ.

TheShock

Ну так в номере известен шрифт, язык и подмножество возможных символов. Вся ветка о том, что компьютеры учаться восстанавливать реальный текст из пары символов и номер автомобиля - идеально подходит под ограничения.

muxa_ru

Метод восстановления букв и цифр является реальным методом ВОССТАНОВЛЕНИЯ, и как всякий реальный метод, он имеет множество ограничений и может быть использован далеко не везде.

Хотя, возможно я не прав и данный метод может быть использован при любом уменьшении.

Попробуйте восстановить вот это

Исходный текст был вот таким

saboteur_kiev

Цифры и текст в любом положении? (фото в полутьме номеров, расположенных под уголом?)

brom_portret

я бы уточнил, что не просто додумать, а додумать наиболее вероятную

AllexIn

"В прошлом году вы совершили преступление. Было совершено еще одно. Наиболее вероятно это вы. 10 лет колонии. Следующий!"

Baigildin

Суд не совсем так работает. Есть прямые и косвенные улики. И улик должно достаточное количество.

semennikov

Не совсем так. Смотря на картинки мне кажется что это не низкое разрешение, а размазанное из-за плохого фокуса изображение.

А размазанное изображение теоретически возможно сделать сколь угодно четким(правда для этого в идеальном случае нужно отсутствие шума в том числе шума квантования, и бесконечный размер)

Refridgerator

Далеко не каждую свёртку можно обратить — из-за наличия нулей в спектре. Гауссиану — в идеале можно. Motion blur — уже нет.

semennikov

Вы разумеется правы. Мне казалось, что в расфокусированной фотографии как раз гаусс. Но настаивать не буду, я этим интересовался лет 30 назад, сейчас уже все забыл. Тогда появились более - менее мощные компы и мне казалось что за две три недели рассчетов можно восстановить черно-белую фотографию

DistortNeo

Как раз таки нет. В расфокусированной фотографии ядро размытия — не Гаусс, а что-то близкое к круговому размытию с резкими краями.

DistortNeo

Та ситуация, когда догадался, что под спойлером, не заглядывая в него.