Основные понятия

Энкодер в машинном обучении - это часть модели, которая преобразует входные данные в другое представление.

Декодер в машинном обучении - это компонент модели, который принимает скрытое представление данных (например, полученное от энкодера) и преобразует его обратно в исходные данные.

Латентное пространство - скрытое пространство, также известное как пространство скрытых объектов или пространство встраивания, представляет собой вложение набора элементов в многообразие, в котором элементы, похожие друг на друга, расположены ближе друг к другу.

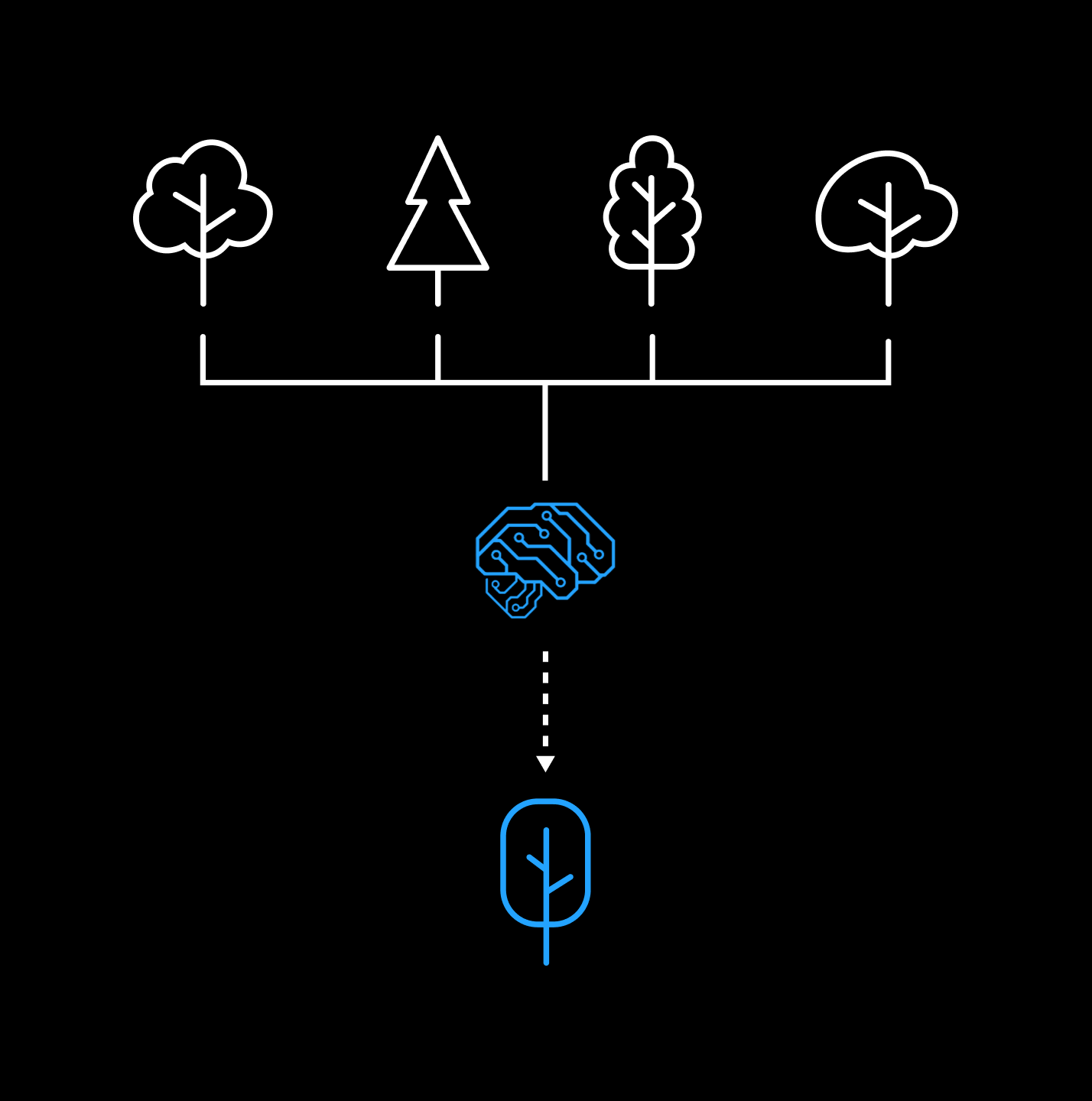

Для лучшего понимания этой идеи, сравним ее с тем, как люди воспринимают мир вокруг себя.

К примеру, когда мы гуляем по лесу и видим дерево вместо того, чтобы запоминать каждую мельчайшую деталь данного растения, мы сохраняем лишь общее представление о его форме, типе и размере. Это позволяет нам быстро идентифицировать дерево, не загружаясь излишними подробностями.

Точно так же латентное пространство пытается предоставить компьютеру сжатое понимание дерева. Оно выделяет ключевые признаки дерева, такие как форма кроны, структура ствола, наличие ветвей, без явного указания на каждый из них.

То есть, это просто представление сжатых данных, в которых похожие точки данных расположены ближе друг к другу в пространстве.

Мы можем понять закономерности или структурное сходство между точками данных, анализируя данные в латентном пространстве, будь то с помощью многообразий, кластеризации и т. д.

Работа с латентными пространствами

Латентное пространство полезно для изучения функций данных и поиска более простых представлений данных для анализа.

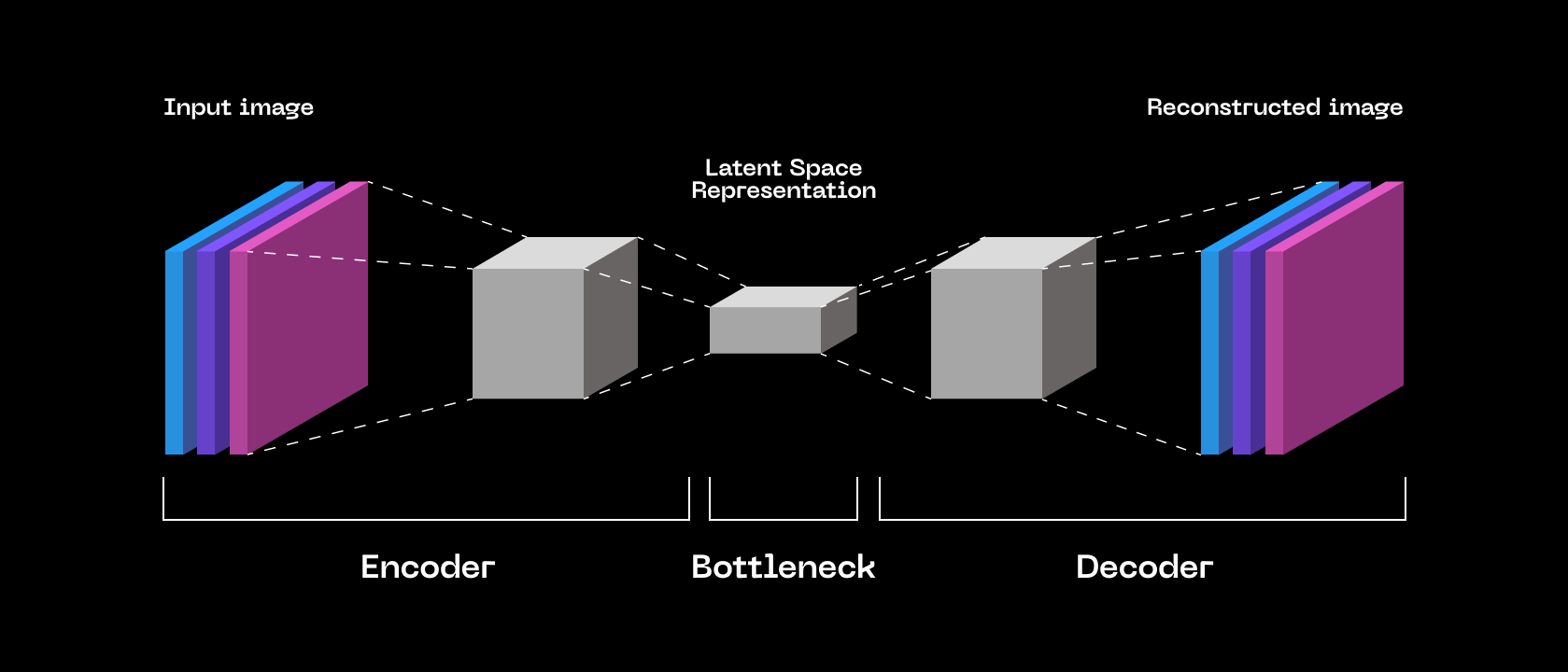

Как мы видим на картинке, затрагиваются такие понятия как энкодер и декодер. Но как они работают?

Энкодер формирует векторы в латентном пространстве таким образом, что похожие объекты располагаются близко друг к другу, что помогает создавать кластеры, тогда как различные объекты размещаются дальше друг от друга.

Предположим, у нас есть хорошо обученный энкодер, работающий с изображениями деревьев. Если мы подадим ему изображение ели, он разместит вектор этого изображения близко к векторам, соответствующим хвойным деревьям, в то время как вектор изображения дуба он разместит в другой части латентного пространства, рядом с векторами лиственных деревьв.

После прохождения обучения, декодер способен восстанавливать исходные объекты из латентного вектора с высокой размерностью. Важно отметить, что помимо восстановления исходных объектов, декодер также может использоваться для создания полностью новых данных. Для этого достаточно предоставить ему латентное представление объектов, которых не было в обучающем наборе данных.

Как используются латентные пространства в библиотеке eXplain-NNs?

Визуализация латентных пространств: Этот метод позволяет отобразить скрытые признаки или паттерны, выученные нейронной сетью, в этих латентных пространствах. Это может быть полезно для понимания, как модель организует данные и какие внутренние представления она использует для принятия решений.

Анализ гомологии латентных пространств: Еще один метод, предоставляемый библиотекой eXplain-NNs, это анализ гомологии латентных пространств. Анализ гомологии используется для изучения структуры и связей между этих латентных представлений. Это помогает понять, каким образом информация организована внутри модели и влияет на ее способность принимать решения.