Всем привет!

Меня зовут Илья и я являюсь одним из разработчиков в команде in3D - мы делаем технологию по созданию 3D модели человека с помощью телефона. Мы начали еще в далеком 2019 году и с тех пор мы сильно продвинулись вперед. Давайте вместе посмотрим на прогресс нашей технологии и на основные шаги улучшения.

Спойлер для самых нетерпеливых, тут можно посмотреть как выглядит наше приложение и результат, а так же сравнение с некоторыми другими приложениями для сканирования:

2019

Сначала был взрыв.

Совсем первые эксперименты от основателя in3d были сделаны на основе пары облаков точек, сделанных с помощью Kinect. Дальше через они совмещались и делалась попытка симуляции пары кусков ткани. Было принято стратегическое решение - сделать продукт, который позволит каждому человеку сделать свою фотореалистичную 3D модель. Так сказать, начало Metaverse.

Одна из основных проблем, с которой мы столкнулись в самом начале была связана с качеством датчика глубины на телефоне, он был слишком шумным. Для создания хорошей модели нужно уметь соединять облака точек с разных кадров, убирать шум и оставлять максимально много деталей, что оказалось не очень-то и просто. Первые аватары были без текстуры и основная работа была по созданию правильной формы.

2020

Потом появилась форма.

Нам удалось побороть шум и склеить много кадров во что-то похожее на тело человека, дальше началось большое количество итеративных улучшений, решений технологических проблем и создания расширяемой инфраструктуры для приложения. Так как наша технология действительно сложная, на всем протяжении обработки данных используются видеокарты, и часть команды сфокусировалась на ускорении, другая продолжала улучшать качество моделей.

Удалось пробить большую технологическую преграду - мы смогли очень хорошо и консистентно понимать все про форму человека из данных. Дело осталось за малым - убедить мир, что мы делаем это лучше всех на таких шумных данных.

Основной майлстоун в 2020 году это запуск приложения, нам удалось довести все до финального продукта, попасть в App Store и начать тестировать технологию на разных юзерах. Выходило все лучше и лучше, но все еще были разные случаи, когда алгоритм не справлялся и модель не собиралась. Мы набирались данных и опыта решения множества граничных случаев. Так же из основного - у нас выделился в отдельный этап процесс сканирования головы и визуальный результат сильно улучшился.

В этом же году начались первые реальные применения нашей технологии - аватары стали насколько точными (ошибка до 1 см), что стартап unspun начал с помощью наших моделей считать мерки людей для пошива джинсов, ведь началась пандемия - сложно приехать в офис в Калифорнии, особенно если ты не в Калифорнии.

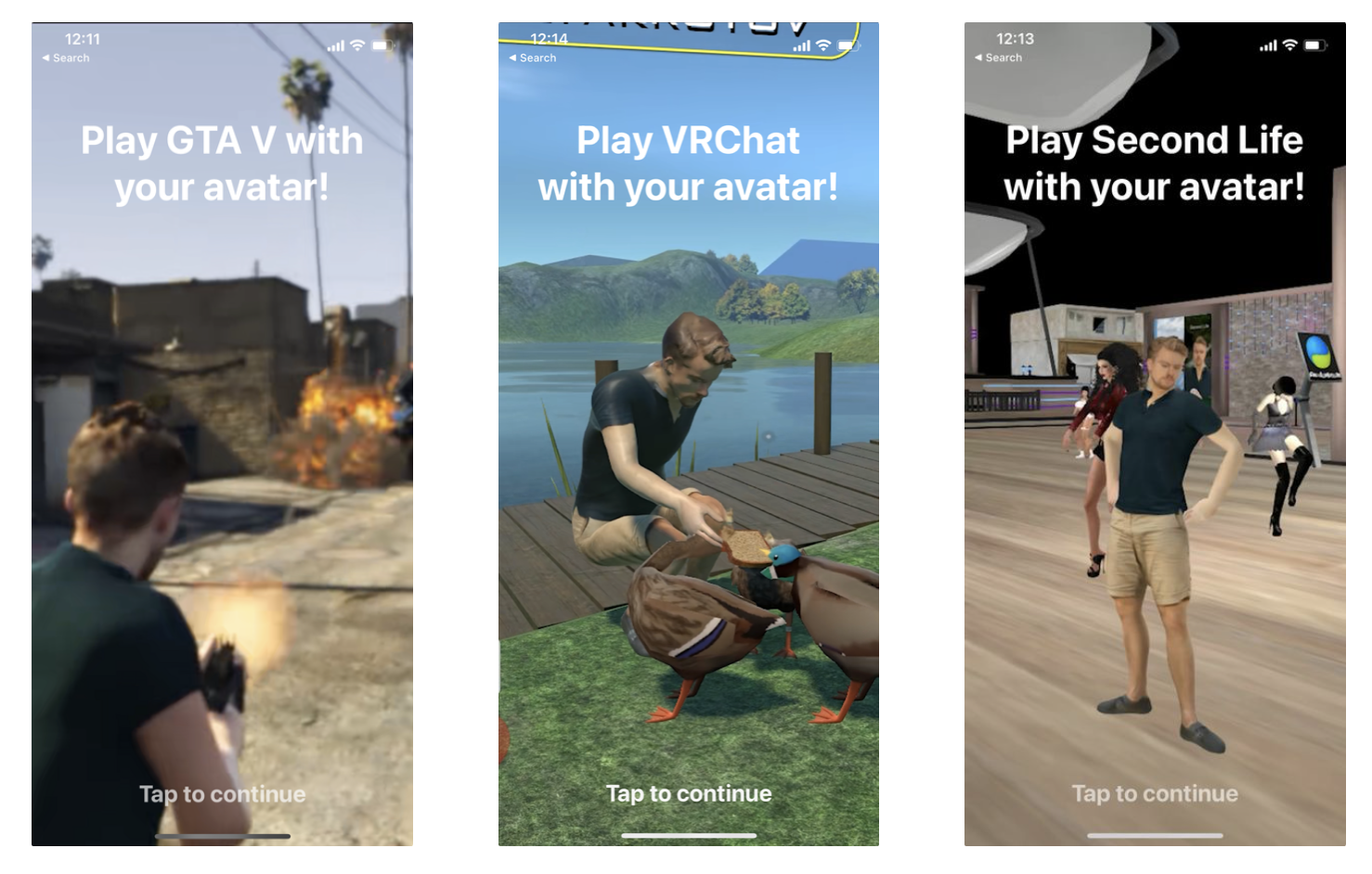

Так же мы старались найти другие интересные применения, экспорт в игры (Second Life, VRChar, GTA V).

2021

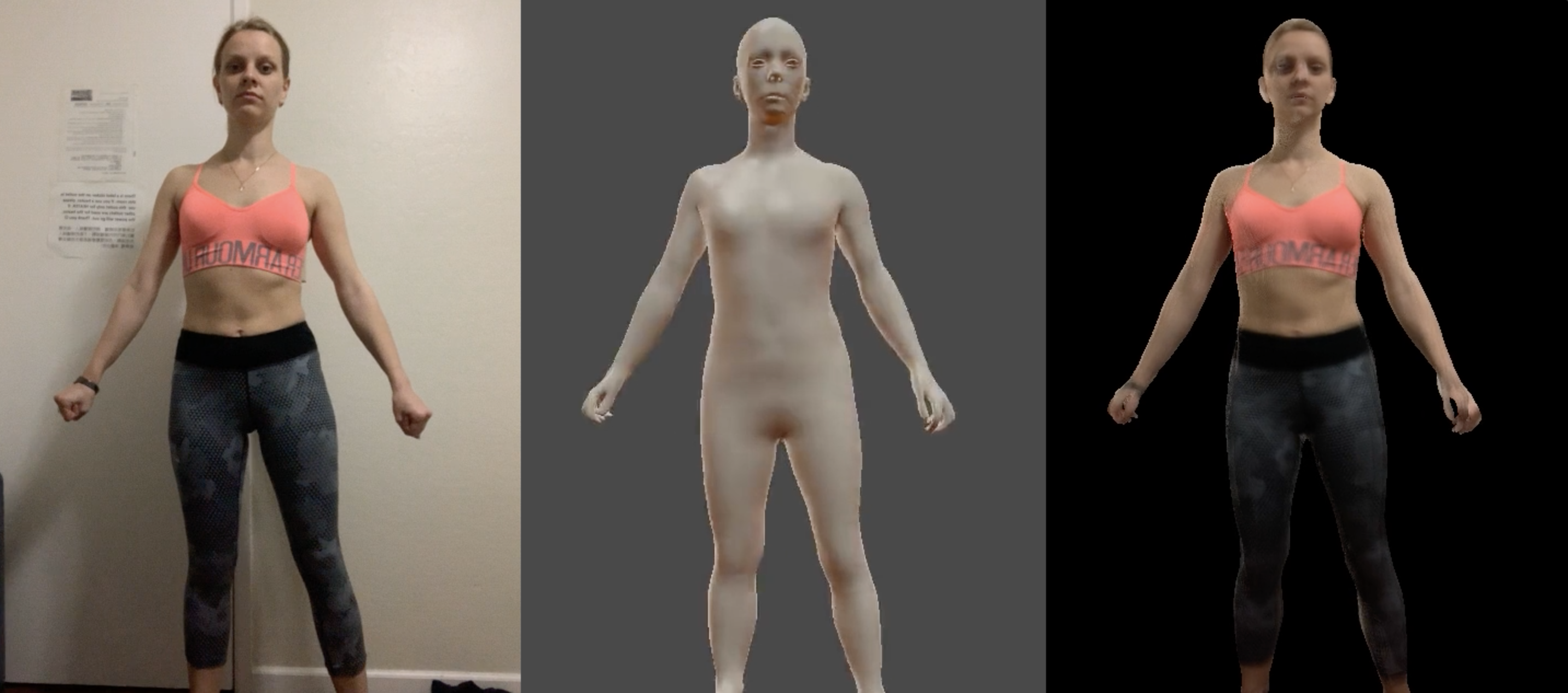

И пришел текстурированный фотореалистичный аватар.

У наших аватаров теперь есть отличная форма, сильно улучшенная за предыдущий год - с это формы можно снимать мерки тела, много работы проводилось над визуальным улучшением аватаров и их текстуры.

Основной вехой прогресса в 2021 году на данный момент стало создание виртуальной примерочной - как по мне, так это что-то вроде проекта, о котором сотни стартапов говорило, но ни у кого не получилось распространенного продукта. Сделали мы это вместе с командой digital дизайнеров Replicant.

Нам удалось реализовать автоматизированную примерку одежды на персональные аватары и оформить это в весьма приятный опыт для пользователя (тут я предлагаю взять и оценить самому).

Ну и напоследок, видео про все фичи, которые есть в приложении на сегодняшний день:

Комментарии (9)

le2

31.08.2021 20:59Как вы думаете, почему Интел хоронит свой RealSense?

cnx-software.ru/2021/08/24/okonchanie-sroka-sluzhby-realsense-intel-postepenno-otkazyvaetsya-ot-svoih-kamer-glubiny-realsense-3d

ilyakrotov Автор

31.08.2021 23:28Идеи ответа внизу :)

israeld

01.09.2021 12:20очень низкие продажы

уволили начальника

глобальные проблемы в Интел

в Интел все что меньше +-1 млрд $ дохода то в расход

israeld

31.08.2021 23:27начальника уволили вот и закурили отдел

ilyakrotov Автор

31.08.2021 23:28Возможно, либо хотят выжать из капитала компании максимальную отдачу, чего RealSense не выдавал

JKot

01.09.2021 14:13У вас действительно хорошие результаты, но насколько же у вас неприятно рекламная статья получилась. Почему на техническом ресурсе не рассказать о технологиях, о железе на котором это считается, о подходах, о том почему у вас результаты сильно лучше чем у остальных и т.д вместо рассказа как вы пытаетесь продаться хоть куда-то?

DmitrySolomennikov

02.09.2021 08:28Очень интересные результаты!

Несколько вопросов:

Можно ли не вращать пользователя, если поставить 4-6 стационарных камеры?

Можно ли вообще комбинировать съёмки с нескольких камер?

Какое расстояние требует RealSence? Kinect?

Выходная модель пользователя размечена (выступающая точка живота, линия бёдер, колено, локоть и т. д.) или набор метрики вшит в SDK?

Считаете на устройстве или в облаке?

Существует вариант SDK на десктопе?

Maslukhin

Размеры то совпадают с одеждой? :)

ilyakrotov Автор

Размеры в примерочной подгоняются под каждого отдельного аватара для лучшей точности, а мерки снятые с аватаров совпадают с реальными мерками человека с ошибкой до 1 см :)