В рамках решения своих задач мне понадобилось перевести несколько статей по сегментации спутниковых снимков. Некоторые из них я решил выложить сюда. Возможно, их перевод поможет вам в решении своих задач.

Положение нескольких иллюстрацийи и таблиц и описаний к ним было немного изменено ради лучшей удобочитаемости. Перевод также имеет свои специальные обозначения:

курсивом выделены переведенные наименования архитектур нейросетей, метрик и т. п. (напр. Fully Convolutional Network → Полная сверточная сеть);

подчеркиванием выделены вольно переведенные слова или словосочетания, точного перевода которых мне не удалось определить.

Аннотация

В данной работе представлено использование Полной сверточной сети (FCN-8) для семантической сегментации спутниковых изображений земной поверхности высокого разрешения в формате RGB на категории землепользования (в ориг. — land use land cover, LULC). В частности, мы предлагаем подход на основе сетки для обучения Полной сверточной сети (FCN-8) с весами VGG-16 для сегментации спутниковых изображений на четыре класса (лес, застройка, сельхозугодья и вода). FCN-8 семантически проецирует дискриминационные признаки в более низком разрешении, полученные кодером, на пространство пикселей в более высоком разрешении для получения плотной классификации. Мы проверили предложенную систему на датасете изображений Gaofen-2, который содержит 150 изображений более 60 различных городов Китая. Для сравнения мы использовали соответствующие им истинные бинарные маски (в ориг. — ground truth), а также изображения, сегментированные с помощью широко используемого коммерческого программного обеспечения ГИС под названием eCognition. С помощью предложенного подхода, основанного на сетке, FCN-8 достигает значительно более высокой производительности, чем eCognition. Наша модель достигает средней точности 91,0% и среднего показателя пересечения над объединением (IoU) 0,84. В отличие от этого, средняя точность eCognition составляет 74,0%, а IoU — 0,60. В данной работе также приводится подробный анализ ошибок, возникающих на границах LULC.

Ключевые слова: датасет изображений Gaofen-2 (GID), землепользование (LULC), сегментация, глубокая нейросеть, FCN-8.

1. Введение

Эффективное решение задач управления земельными ресурсами, таких как обнаружение изменений, городское планирование, мониторинг возобновляемых ресурсов, охрана окружающей среды, сельское хозяйство, создание дорожных карт, планирование социально‑экономического развития и т. д. [4], [3], [2], [6] зависит от правильной идентификации LULC. Обычно классификация LULC выполняется вручную на картографических изображениях с использованием программного обеспечения географической информационной системы (ГИС) (например, eCognition [13]), что является трудоемким и неэффективным подходом. Некоторые исследователи предлагают методы машинного обучения для автоматической классификации LULC на различные семантические классы (т. е. лес, сельхозугодья, вода, застроенная территория, луга) по спутниковым изображениям. Спутниковые изображения имеют ряд каналов, т. е. R, G, B, ближний инфракрасный (NIR), инфракрасный (IR) и др.

Из этих каналов географические исследователи пытаются рассчитать нормализованный разностный индекс растительности (NDVI) и нормализованный разностный индекс влажности (NDMI) для сегментации лесов и сельхозугодий. Они также вывели индекс реактивности (RI), индекс яркости (BI) и некоторые другие индексы для идентификации других классов. Эти индексы рассчитываются по специальным формулам, выведенным для каждого класса/индекса для различных комбинаций растровых каналов. Диапазоны, представляющие NIR (ближний инфракрасный) и RED, варьируются от спутника к спутнику. Часто спутник может давать только те диапазоны, которые необходимы для расчетов индекса, а не давать точный спектр. В этом случае для расчетов используется диапазон, наиболее близкий к требуемому. Для автоматической идентификации растительности на спутниковых изображениях Ченг и др. [4] использовали гистограмму ориентированных градиентов (HOG), масштабно‑инвариантное преобразование характеристик (SIFT) и локальный бинарный шаблон (LBP) для извлечения признаков и машину опорных векторов в качестве классификатора. При тестировании на данных изображений дистанционного зондирования, предоставленных консорциумом Multi‑resolution land‑cover characteristics (MRLC) [9], их система показала общую точность 79,6%.

В последних исследованиях для классификации и сегментации почвенного покрова с большим успехом используются различные методы глубокого обучения [5], [10], [7], [12]. Бен Хамида и др. [5] используют DenseNet [14] и SegNet [1] для сегментации и грубой сегментации соответственно на многоспектральных изображениях Sentinel-2. Они сообщают об общей точности 51,4% при использовании DenseNet и 83,9% при использовании SegNet на данных GlobeCover. Пираманаягам и др. [10] представили раннее и позднее объединение признаков в нейронной архитектуре (Полной сверточной сети [8], FCN) для применения в классификации мультисенсорных воздушных/спутниковых изображений. Они достигли общей точности 59,87% и средний балл F1 0,51 на RGB‑изображениях со спутников. Шэнцзе Лю и др. [7] используют объектно‑ориентированный анализ изображений (OBIA) для картографирования землепользования с использованием оптических и радиолокационных изображений с синтезированной апертурой (SAR). Для получения объектно‑ориентированных тематических карт они разработали новый метод, объединяющий объектно‑ориентированное уточнение постклассификации (OBPR) и CNNs для картографирования LULC с использованием оптических и SAR‑данных Sentinel. Они достигли точности 77,64% для набора данных LCZ Zhuhai‑Macau с пространственным разрешением 100 метров. Вышеуказанные показатели не являются удовлетворительными для автоматической классификации LULC из‑за некоторых ограничений. К ограничениям относятся нехватка данных в истинных бинарных масках, неоднозначность граничных пикселей, невозможность моделирования пространственных характеристик классов LULC и т. д.

Чтобы улучшить карту сегментации, Тонг и др. [12] использовали ансамбль классификаторов с иерархическим методом сегментации. Позже они использовали селективный поиск для оценки границ. Однако системы на основе патчей имеют ряд недостатков для спутниковых изображений. Во‑первых, техника на основе патчей ограничивает процесс сегментации объектов, которые могут иметь широкий диапазон формы, размера и плотности. Во‑вторых, ошибка в обнаружении пятен будет распространяться на следующий уровень, где пятна объединяются вместе для создания окончательной сегментации. В‑третьих, системы на основе патчей имеют очень низкую обобщающую способность. Для преодоления вышеупомянутых ограничений мы используем метод семантической сегментации на основе глубокого обучения, который выделяет леса, застройку, сельхозугодья и водные территории непосредственно на спутниковых RGB‑изображениях. Поскольку RGB‑изображения легко объяснимы и наблюдаемы для классов LULC, мы сосредоточили нашу сегментацию только на RGB‑изображении.

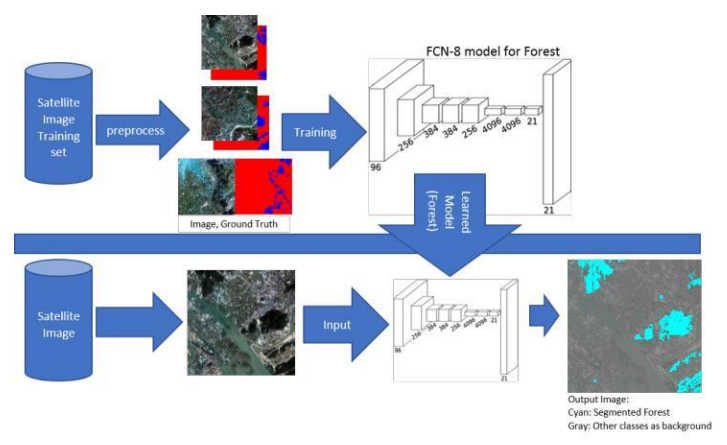

В частности, мы используем предобученную сверточную нейросеть с весами VGG-16 в качестве кодера, чтобы получить Полную сверточную сеть (FCN-8) [8]. На рис. 1 показана блок‑схема сегментации леса, где в верхней части изображен процесс обучения, а в нижней — этап прогнозирования. Во время обучения мы подаем RGB‑изображения с соответствующими им истинными бинарными масками для обучения модели FCN-8 для леса. На этапе предсказания мы сегментируем входное изображение на лесной массив, используя полученную модель. Аналогичный подход применяется и для других классов LULC. В первых экспериментах мы уменьшили размер спутникового изображения 7200×6800 до 224×224. Сильное уменьшение масштаба приводит к неожиданным ошибкам в границах. Чтобы улучшить производительность, мы разделили полноразмерное спутниковое изображение на неперекрывающиеся подизображения размером 224×224. Таким образом, разрешение входного изображения сохраняется при подаче на FCN-8. Этот подход достигает большого успеха со средней точностью 91% и средним значением пересечения над объединением (IoU) 0,84 при сегментировании RGB‑изображений из датасета изображений Gaofen-2 (GID) [12]. Более того, модель FCN-8 превосходит модель eCognition [13]. Подробное сравнение производительности проводится в главе 4. Таким образом, предложенный автоматизированный процесс LULC с использованием FCN-8, описанный в данной статье, может помочь извлечь жизненно важную информацию для лучшего понимания нашей планеты. Однако иногда FCN-8 допускает ошибки в определении границ, особенно для сельхозугодий, которые отличаются большим разнообразием цвета и формы. Мы провели детальный анализ ошибок, в котором описали возможные источники этих ошибок.

2. Датасет и методология

В этом разделе описывается набор данных и часть предварительной обработки. Кроме того, мы описываем подход и методологию, которые мы используем в данной работе.

2.1. Описание датасета

Набор данных GID содержит в общей сложности 150 изображений в формате tif с разрешением 7168×6720. Каждый пиксель охватывает разрешение до 4 метров. GID обеспечивает спектральный диапазон: синий (0,45–0,52 мкм), зеленый (0,52–0,59 мкм), красный (0,63–0,69 мкм) и ближний инфракрасный (0,77–0,89 мкм); и пространственный размер 7168×6720 пикселей, охватывающий географическую область 506 км^2.

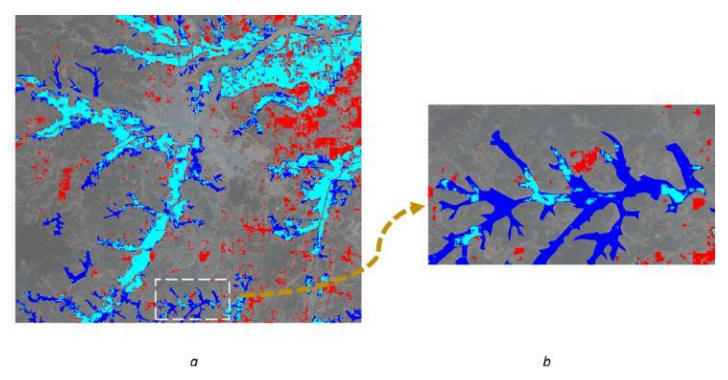

В наборе данных также содержатся метки истинных бинарных масок для этих 150 изображений. Истинные бинарные маски содержат различные цветные пиксели, чтобы показать четыре различных класса LULC. Рис. 2a и 2b являются примерами входного изображения и соответствующих им истинных бинарных масок, предоставленных датасетом GID. Однако черные пиксели представляют собой нераспознанную область по мнению авторов [12]. В наших экспериментах нет никаких нераспознанных областей.

![Рис. 2. Образец входного изображения [a]. Красные пиксели [b] представляют класс застройки, голубые — лес, зеленые — сельхозугодья и, наконец, синие — воду, черные — не распознанное авторами. Изображения [c], [d], [e] и [f] показывают истинные бинарные маски для классов лес, сельхозугодья, застроенная территория и вода. Рис. 2. Образец входного изображения [a]. Красные пиксели [b] представляют класс застройки, голубые — лес, зеленые — сельхозугодья и, наконец, синие — воду, черные — не распознанное авторами. Изображения [c], [d], [e] и [f] показывают истинные бинарные маски для классов лес, сельхозугодья, застроенная территория и вода.](https://habrastorage.org/getpro/habr/upload_files/be1/1ac/b2e/be11acb2e766bb39c53c78da84f4fc4b.png)

Предварительная обработка. Мы предварительно обрабатываем исходные изображения, чтобы получить бинарное изображение для каждого класса. Для каждого класса мы выделяем пиксели в целевом классе синим цветом, а в остальных классах — красным. Таким образом, для каждого входного изображения мы получаем четыре бинарных изображения. Бинарные изображения для классов лес, сельхозугодья, застройка и вода показаны на рис. 2c—2f.

Расширение данных. Для расширения данных мы использовали девять (9) методов расширения. Таким образом, каждое из изображений было увеличено до 10 различных изображений, включая исходное изображение. Мы отразили изображения по вертикали, горизонтали, повернули их против часовой стрелки на 90, 180 и 270 градусов. Затем мы использовали растяжение контраста, гаммы и оттенка.

2.2. LULC с семантической сегментацией

LULC на очень высоком уровне является задачей классификации. Она требует максимально точной классификации. Необходима семантическая сегментация, которая классифицирует изображение на уровне пикселей, то есть каждый пиксель на изображении принадлежит к определенному классу. В парадигме дистанционного зондирования семантическая сегментация означает сегментирование/обнаружение области, состоящей из одного вида почвенно‑растительного покрова. Например, семантическая сегментация для леса даст нам все лесные участки, независимо от их размера, формы и текстуры.

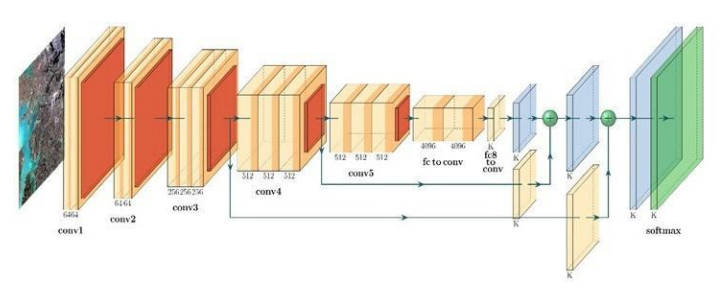

2.3. Архитектура VGG-16 и Полный сверточный слой

Архитектура сети VGG, представляющая собой сверточную нейросеть (CNN), была представлена Симоняном и Зиссерманом с соавторами [11]. Используя сверточный слой в качестве последнего слоя VGG-16, полученная Полная сверточная сеть (FCN-8 [8]) сегментирует изображение вместо того, чтобы классифицировать его. Пикселям, принадлежащим к одному классу, присваивается одинаковая цветовая метка. В целом, CNN представляет собой сеть, состоящую из сверточного слоя и слоя объединения, где сверточные слои используются для кодирования более низкого уровня признаков в более высокий уровень семантической абстракции. Слои пула используются для уменьшения размерности более высоких уровней. Уменьшение размера объема происходит за счет максимального объединения. Для CNN входным сигналом является изображение X размерности m, n, d (например, 3 цветовых канала (R, G, B). Нейроны также расположены в 3 измерениях. Каждый нейрон подключен к нескольким входам предыдущего слоя.

Полученные признаки проходят через несколько слоев свертки, ReLU и подвыборки или объединения. За этими слоями следует Полный сверточный слой. Это преобразование позволяет сети генерировать грубые карты с пространственной поддержкой. Затем используется слой транспонирования свертки [8] для приведения грубой карты к исходному разрешению изображения.

3. Экспериментальная установка и результаты

В этом разделе мы обсудим нашу экспериментальную установку, разделение на обучающую и тестовую выборки, процессы обучения и тестирования, а также метрики оценки.

3.1. Разделение на обучающую и тестовую выборки

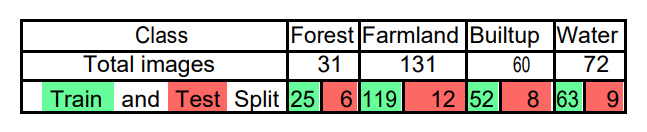

Всего в наборе данных содержится 150 изображений. Все они являются изображениями формата RGB. Однако каждый из классов LULC присутствует не на каждом изображении. Чтобы хорошо представить классы LULC в обучающем и тестовом выборках для наших экспериментов, мы рассматривали изображения, в которых не менее 5% пикселей принадлежат одному классу, для обучения и тестирования бинарной модели для этого конкретного класса. Мы обучили наши бинарные модели FCN-8 отдельно для каждого из классов. В таблице 1 показано, что на 31 изображении лес присутствовал как минимум на 5% площади. Аналогично, сельхозугодья, застройка и вода присутствуют на 131, 60 и 72 изображениях соответственно. Мы разделили наши обучающие и тестовые выборки.

3.2. Обучение и тестирование

Мы обучаем отдельную бинарную модель для каждого из четырех классов LULC, т. е. лес, вода, сельхозугодья, застройка. На этом этапе обучения каждое изображение дополняется для увеличения размера датасета. Датасет был дополнен 9 способами, как описано в подразделе Расширение данных. Затем мы тестируем модели на тестовой выборке.

3.3. Матрица оценки

Вычисление матрицы смешения (в ориг. — diffusion matrix) дает нам представление о производительности нашей модели классификации — правильно ли она работает и какие ошибки допускает. В нашей модели сегментации выходом является бинарное изображение, содержащее целевой или нецелевой класс. Мы сравниваем это выходное изображение с истинной бинарной маской. В этом случае мы используем попиксельную точность, Recall, Precision, F1-score и пересечение над объединением (IoU). Здесь IoU рассчитывается путем деления площади перекрытия на площадь объединения.

Мы измеряем эти показатели для 4 классов: лес, застройка, сельхозугодья и вода.

4. Результаты

В этом разделе мы обсуждаем производительность наших моделей и показываем сравнение с eCognition.

4.1. Процесс обучения

Процесс обучения FCN-8 включает 100 эпох с коэффициентом обучения 0,01. Во время обучения мы уменьшаем размер исходных изображений с 7168×6720×3 до 224×224×3. Мы также выполняем аугментацию уменьшенных изображений, чтобы получить девять версий исходного уменьшенного изображения. Затем мы подаем уменьшенные изображения и их дополненные изображения на предварительно обученный FCN-8. Мы также предоставляем соответствующую истинную бинарную маску размером 224×224×3 для конкретной модели двоичной сегментации FCN-8. В случае обучения без разбиения на сетку, когда мы уменьшаем дискретизацию изображений, аугментация используется для увеличения размера набора данных. Но при обучении с разбиением на сетку увеличение не используется, так как набор данных становится очень большим даже без увеличения. Итак, 25*10 = 250 входных изображений вместе с их истинными бинарными масками пропускаются через сеть для обучения с уменьшенной дискретизацией. Таким образом, при разбиении на сетку мы подаем 960*25 = 24 000 входных изображений вместе с 24 000 соответствующими истинными бинарными масками для модели леса FCN-8.

4.2. Процесс тестирования

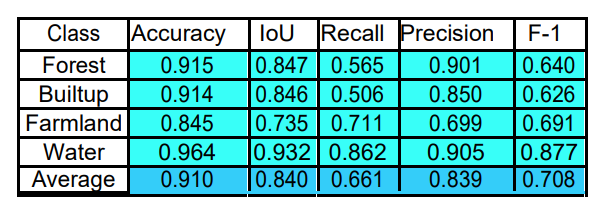

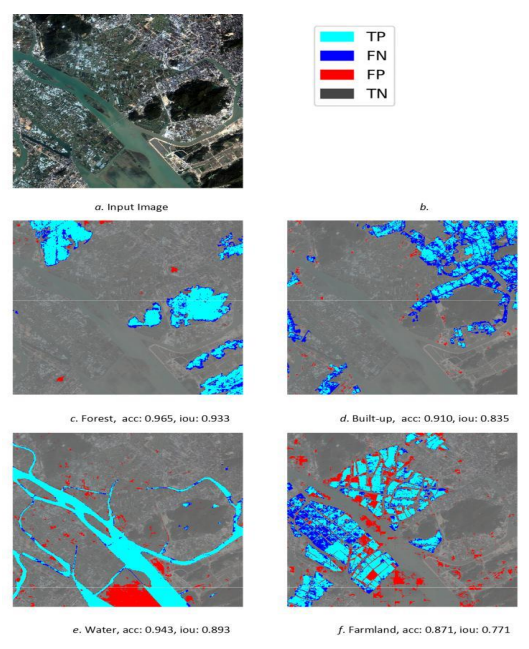

После обучения мы подаем тестовую выборку на ненастроенную индивидуальную модель FCN-8 для каждого бинарного класса. Аналогично процессу обучения, тестовый набор данных проходит через разбиение на сетку, где каждое изображение с исходным разрешением разбивается на 960 изображений с разрешением 224×224. Однако во время тестирования мы не проводили никакого дополнения тестового набора. Следовательно, 6 входных изображений тестируются с моделью Лес FCN-8 для расчета производительности этой модели. Мы подаем 12, 8 и 9 тестовых изображений на модель Сельхозугодья, на модель Застройка и на модель Вода соответственно, как показано в таблице 1. Затем мы сравниваем сегментированный результат с соответствующими бинарными данными, чтобы рассчитать матрицы смешения (в ориг. — diffusion matrix) для каждой из моделей. Показатели эффективности, рассчитанные по матрицам смешения, представлены в таблице 2.

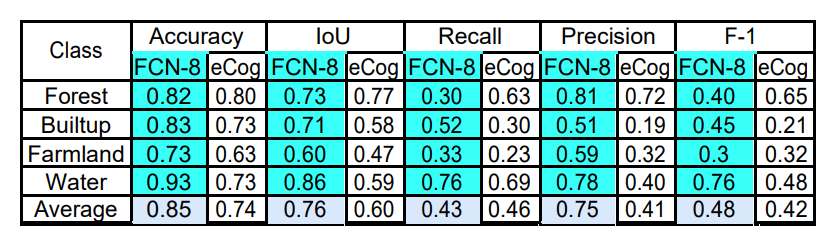

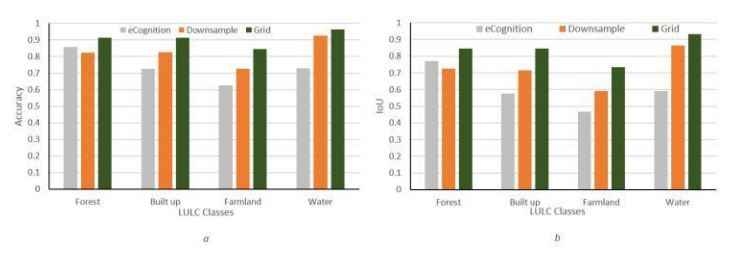

Для тестовой выборки наша модель достигает хорошей точности по всем классам, как видно из таблицы 2. IoU для леса с FCN-8 ниже, чем IoU с eCognition. Тем не менее, показатели отзыва для FCN-8 очень низкие для всех классов, кроме воды. Это означает, что чувствительность модели FCN-8 низкая. Несмотря на то, что показатели точности хороши для классов лес и вода, низкий показатель Recall привел к более низкому результату F1. Метрики производительности для eCognition показаны в правой части таблицы 2. Хотя модели FCN-8 превосходят eCognition, точность, IoU и F1 недостаточно высоки.

4.3. Обучение и тестирование с разбиением на сетку

В этом разделе мы проводим эксперименты со спутниковыми изображениями, сохраняя неизменным пространственное разрешение. Однако размер FCN-8 составляет 224×224, в то время как размер входного изображения составляет 7168×6720. Поэтому, чтобы сохранить текстуру изображения неизменной, мы разделили каждое полноразмерное входное изображение на неперекрывающиеся подизображения. Каждое из подизображений имеет размер 224×224. Подизображения создаются путем деления полного изображения по неперекрывающейся сетке, чтобы мы могли сшить их вместе после сегментации всех подизображений. После сегментации всех этих подизображений мы объединяем их, чтобы получить конечный сегментированный результат размером 7168×6720.

В таблице 3 показана производительность детализации при тестировании изображений с помощью модели FCN-8, которая была обучена с разбиением на сетку. Область воды сегментируется более точно, чем другие классы. По нашим наблюдениям, вода присутствует в более плотной форме с небольшим количеством или полным отсутствием мелких деталей, разбросанных по всему изображению, где вода вообще присутствует. У других классов мелкие детали разбросаны по всему изображению, если они присутствуют, т. е. они не такие плотные, как вода. Это приводит к несколько менее удовлетворительному результату для других классов. Однако сельхозугодья больше всего страдают от этой характеристики пространственного распределения, что приводит к худшим результатам по сравнению с другими классами.

После завершения обучения мы также создаем подизображения из тестовых изображений и затем передаем их в ненастроенный FCN-8. Затем мы сшиваем сегментированный результат.

Точность и IoU для подхода с использованием подизображений сетки значительно улучшились. Среди них показатели точности для лесов, застроек, сельхозугодий и воды увеличились на 26,07%, 34,79% и 31,95% соответственно по сравнению с eCognition.

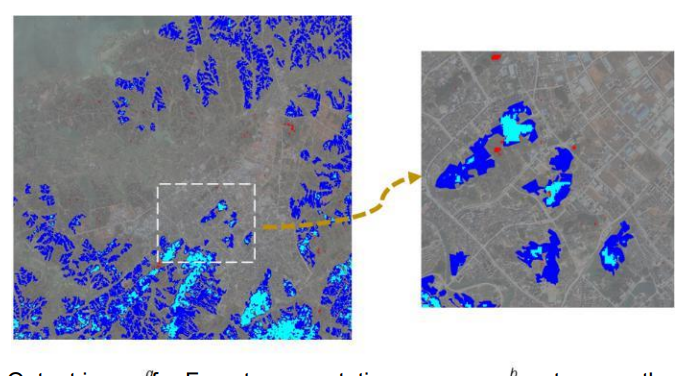

4.4. Анализ ошибок

В этом разделе мы попытаемся исследовать, где CNN не удается сегментировать и почему. На рисунке 6a показан выход модели FCN-8, где голубым цветом показан правильно сегментированный лес, где в качестве входных данных мы используем уменьшенное изображение. Анализируя производительность, мы внимательно смотрим на изображение 6a и увеличенную версию 6b, где сегментация не удалась. Мы сделали несколько наблюдений, чтобы определить, почему предварительно обученный FCN-8 не смог точно сегментировать лес. В прямоугольнике присутствуют очень маленькие области с резкими границами. К сожалению, VGG-16 не может смоделировать их, если только маленькая область не достаточно велика (6b синяя область). Мы также заметили, что если область меньше 10 метров, то FCN-8 не может захватить ее. Мы уменьшаем исходное изображение размером 7168×6720 до 224×224 входных изображений для FCN-8. Таким образом, мы уменьшаем масштаб примерно в 960 раз. В результате маленькие области, содержащие мало пикселей, значительно теряют текстуру. Во‑вторых, они теряют свои пространственные свойства GSD и LULC. Таким образом, этот лесной регион (на входном изображении) уже потерял свою достоверность наземного региона леса. В результате, FCN-8 не распознал его как лес. Более того, при уменьшении масштаба изображения пограничные пиксели имеют менее информативную текстуру. Уменьшение масштаба исходного изображения значительно снижает дискриминационные характеристики пограничных пикселей.

Эти ошибки можно устранить, сохраняя одинаковое разрешение изображений при подаче их в сеть. Однако не все ошибки устраняются при использовании подизображений сетки. Мы видим, что сельхозугодья имеют более низкие показатели точности и IoU по сравнению с другими классами, хотя мы используем подизображения сетки. На рисунках 7a и 7b мы обнаружили сельхозугодья с очень резкими границами. Резкие границы не улавливаются моделью FCN-8. Как правило, FCN8 всегда ищет гладкую периферию. Модель FCN-8 предварительно обучена с помощью ImageNet. А в ImageNet нет объектов с такими четкими границами. Это может быть причиной неудачи FCN-8.

5. Заключение

В данной работе мы предлагаем структуру семантической сегментации с использованием Полной сверточной сети (FCN-8) для сегментации классов земного покрова по спутниковым изображениям в формате RGB. Мы использовали подход на основе неперекрывающейся сетки с FCN-8, который значительно улучшил производительность по сравнению с программным обеспечением ГИС — eCognition. Средняя точность составляет 91,0%, а средний показатель пересечения над объединением (IoU) составляет 0,84. Однако eCognition получает среднюю точность 74,0% и средний IoU 0,60. Наша будущая работа включает разработку новой глубокой архитектуры для лучшей сегментации границ.

Библиография

Badrinarayanan, V., Kendall, A., Cipolla, R.. Segnet. A deep convolutional encoder-decoder architecture for image segmentation. TPAMI 39(12)

Benediktsson, J.A., Palmason, J.A., Sveinsson, J.R.. Classification of hyperspectral data from urban areas based on extended morphological pro les. IEEE Transactions on Geoscience and Remote Sensing 43(3) (2005)

Bioucas-Dias, J.M., Plaza, A., Dobigeon, N., Parente, M., Du, Q., Gader, P., Chanussot, J.. Hyperspectral unmixing overview. Geometrical, statistical, and sparse regression-based approaches. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing 5(2), 354{379 (2012)

Cheng, G., Han, J., Guo, L., Liu, Z., Bu, S., Ren, J.. Effective and efficient midlevel visual elements-oriented land-use classification using vhr remote sensing images. IEEE Transactions on Geoscience and Remote Sensing 53(8), 4238{4249 (2015)

Hamida, A.B., Benoit, A., Lambert, P., Klein, L., Amar, C.B., Audebert, N., Lefevre, S.. Deep learning for semantic segmentation of remote sensing images with rich spectral content. In. 2017 IEEE International Geoscience and Remote Sensing Symposium (IGARSS). pp. 2569{2572. IEEE (2017)

Li, J., Bioucas-Dias, J.M., Plaza, A.. Semisupervised hyperspectral image segmentation using multinomial logistic regression with active learning. IEEE Transactions on Geoscience and Remote Sensing 48(11) (2010)

Liu, S., Qi, Z., Li, X., Yeh, A.G.O.. Integration of convolutional neural networks and object-based post-classification refinement for land use and land cover mapping with optical and sar data. Remote Sensing 11(6)

Long, J., Shelhamer, E., Darrell, T.. Fully convolutional networks for semantic segmentation. In. 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). pp. 3431{3440 (2015)

MRLC. Multi-resolution land cover characteristics consortium. https://www.mrlc.gov/data (May 2019)

Piramanayagam, S., Saber, E., Schwartzkopf, W., Koehler, F.. Supervised classification of multisensor remotely sensed images using a deep learning framework. Remote Sensing 10(9), 1429 (2018)

Simonyan, K., Zisserman, A.. Very deep convolutional networks for largescale image recognition. arXiv preprint arXiv.1409.1556 (2014)

Tong, X.Y., Xia, G.S., Lu, Q., Shen, H., Li, S., You, S., Zhang, L.. Learning transferable deep models for land-use classification with high-resolution remote sensing images (2018)

Trimble. Ecognition developer edition. http://www.ecognition.com/

Volpi, M., Tuia, D.. Dense semantic labeling of sub-decimeter resolution images with convolutional neural networks. IEEE Transactions on Geoscience and Remote Sensing 55(2), 881{893 (2016)

Aldres

Если правильно понял задачу, то необходимо было выделить растительность/водные объекты/застройку? Есть ли какое-нибудь сравнение по точности/результату со случаем, если на тех же данных используются более традиционные методы (без ML), вроде того же NDVI и прочих?