Apple показала Vision Pro – устройство, которое по максимуму использует все наши ощущения и погружает в прямое управление интерфейсом руками, голосом и движением головы.

Вот только не все могут видеть, слышать, двигать руками или говорить. Как будут работать очки для них? Неужели Apple придумала альтернативные способы управления для всего?

Да, придумала. Будущее невероятно.

Как работают очки

Перед тем как разобрать альтернативное управление, посмотрим на то, как в целом работают очки.

Apple Vision Pro – это очки дополненной реальности: внутри два экрана для каждого глаза, что даёт ощущение пространства. Вы надеваете их и интерфейс появляется вокруг вас.

При этом изображение подстраивается под окружение: учитывает освещённость, предметы и цвета окружения.

Дополнительно очки измеряют движение глаз: чтобы навести «курсор» на кнопку, нужно просто на неё посмотреть. Вот только курсора нет — вы смотрите на кнопку и она сразу посдвечивается. Судя по первым обзорам, реакция на движение глаз моментальная*.*

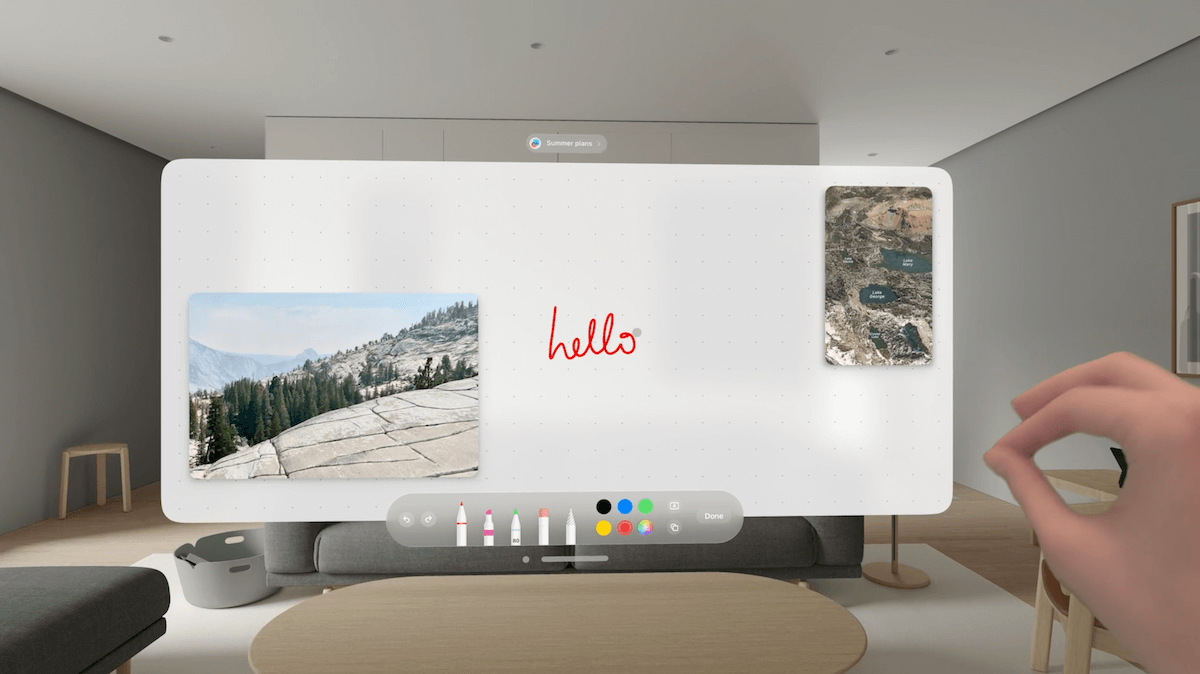

Чтобы «нажать» на выделенный элемент, вам надо сомкнуть большой и указательный пальцы — дополнительные сенсоры отслеживают жесты рук, поэтому каких-либо контроллеров нет. Более того, не нужно держать руки перед собой — они могут быть на столе или на коленях, потому что сенсоры направлены вниз.

Вариаций жестов много: можно ущипнуть страницу, чтобы её проскролить, повертеть объект в пространстве или сложить пальцы в сердечко, чтобы отправить его во время видеотрансляции.

ПриЧасть интерфейсов теперь управляется голосом: например, можно показать виртуальную клавиатуру, но проще надиктовать емейл или попросить Siri, чтобы она открыла нужное приложение или сразу нужный фильм.

Для погружения интерфейс встраивается в окружающее пространство, а пространственное аудио поддерживает этот эффект. В особенных сценариях вашу комнату можно полностью скрыть, например, когда смотрите кино или репетируете выступление прямо перед сценой.

В интерфейсах станет больше объёмных и интерактивных элементов. Например, можно покрутить кроссовки перед покупкой. Инструменты для быстрого создания моделей по фотограметрии показали ещё в прошлом году.

Всё вместе это даёт устройство, которое максимально задействует все ощущения и наше тело как главный элемент управления. Вот только это же делает устройство самым недоступным, ведь у кого-то нет одного глаза, кто-то не видит совсем, не все люди слышат, у некоторых нарушена моторика пальцев или совсем нет руки, а кого-то просто укачивает от анимаций и прозрачностей в интерфейсе. Или нет?

Apple сделала одно из самых важных и доступных устройств. Давайте перескажу лекцию Apple про дизайн и доступность очков, какие инструменты дали разработчикам и вместе представим, как это поможет людям.

Инструменты доступности встроены на всех уровнях. Например, тройное нажатие диджитал-краун показывает меню с настройками доступности.

Визуальная адаптация

Доступность — это не только про особенности, но и про общие принципы дизайна для человека.

Например, мы можем фокусироваться на чём-то одном, поэтому окна нужно располагать в центре.

Смотреть нам проще по сторонам, чем вверх-вниз, поэтому окна стоит растягивать горизонтально.

Все элементы оказываются значительно дальше от зрителя, а наводить невидимый курсор на них теперь нужно взглядом — значит, размер кнопок должен вырасти. Визуальная часть всё ещё может занимать 44 точки, но область касания выросла до 60 точек.

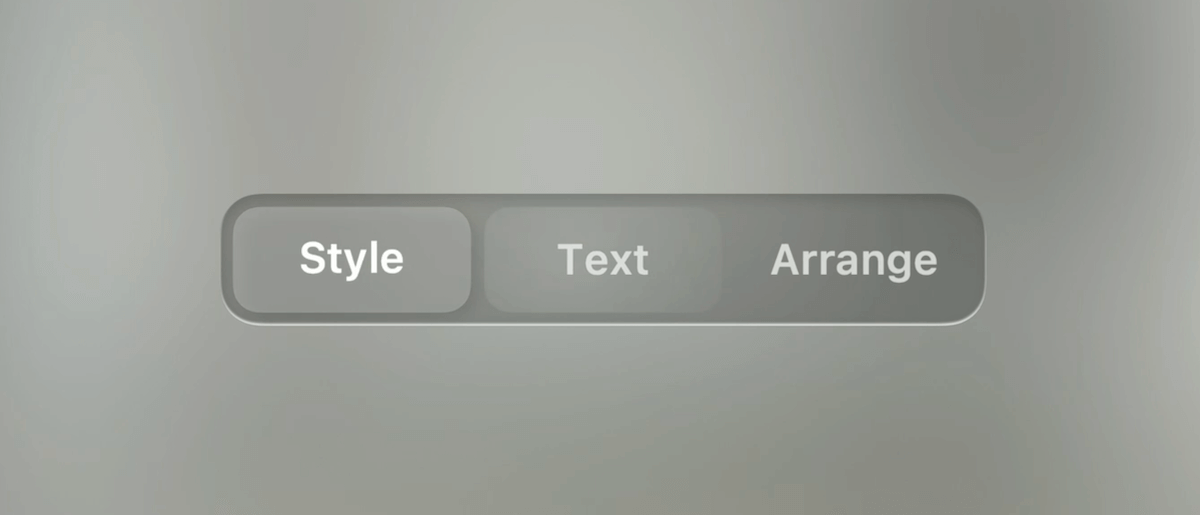

Текст сложнее читать на расстоянии, поэтому рекомендуется сделать весь шрифт на тон жирнее — это поможет лучше соблюдать контраст, особенно на заблюренном фоне, поверх которого теперь построены все интерфейсы.

Apple идёт в адаптации дальше: у многих людей неидеальное зрение, а к объёмному интерфейсу получится привыкнуть не сразу. Поэтому очки поддерживают несколько настроек.

Dynamic Type – вы можете регулировать размер текста, интерфейс будет адаптироваться. Увы, пример не показали, но суть такая же, как в мобильном интерфейсе.

Reduce motion (уменьшение движения) позволяет отключить анимации. Например, если вы сделали рабочий стол поверх отражающей глади журчащего озера, но лишние отражения и анимации укачивают, то их можно отключить.

Общие рекомендации: в интерфейсах нужно избегать быстрых перемещений, подпрыгиваний, резкого зума, вращений и частых фоновых анимаций — особенно, если человек явно попросил об этом включив настройку «уменьшение движения». Apple приводит пример в виде фона, у которого есть постоянная анимация воды — её можно отключить.

Для незрячих

Для незрячих людей меняется способ восприятия (все элементы озвучиваются, когда на них попадает рамка «фокуса») и управления (специальные жесты перемещают рамку). Посмотрите ролик как пользоваться VoiceOver, он всего 8 минут.

Очки полностью поддерживают VoiceOver, но управление будет другим: нужна большим пальцем касаться других:

большой + указательный — переместить фокус к следующему элементу,

большой + средний — к предыдущему,

большой + безымянный — выбрать элемент. Есть альтернатива — большой + указательный на левой руке.

API при этом максимально похож на то, что уже было в айфоне, и это сильно упрощает поддержку доступности со стороны разработчиков: нужно просто правильно подготовить текстовое описание всех элементов, а уже очки озвучат это описание на нужном языке.

Как это можно использовать? Очки не привязаны проводом к компьютеру, поэтому можно анализировать всё, что незрячий человек видит вокруг себя, и озвучивать ему видимые объекты. В быту у незрячих каждому предмету есть своё место в доме, очки бы могли помочь находить предметы.

Моторика

Проблемы моторики можно разделить на две части: когда нужна адаптация для движений головы и когда есть особенности управления руками.

Голова

Apple рассказала о двух типах привязки объектов: к окружению или к голове пользователя.

Все элементы нужно позиционировать в пространстве так, чтобы можно было поворачивать голову в стороны нужных и рассматривать их. Если человек плохо видит, то он может включить экранную лупу, навестись на нужное окно и увеличить изображение внутри этого квадрата.

Некоторые элементы привязаны к положению головы, например, сверху есть стрелка для вызова панели управления. Но зум тоже привязан к голове, значит, его не получится навести на эту кнопку? Чтобы избежать конфликта, стоит отвязывать объекты от головы в момент включения зума.

Руки

Не у всех есть руки, пальцы или хорошая мелкая моторика. Для таких людей надо предоставить альтернативные схемы управления. Одной из таких альтернатив является Dwell — на экране появятся действия тапа, скрола или перетаскивания, нужное действие можно выбрать из меню и выполнить его через этот вспомогательный интерфейс.

Об альтернативе нужно помнить и в нестандартных ситуациях. Например, для жеста, когда руки складывают в сердце, можно сделать альтернативу-рогатку, которая это сердце запускает. Для незрячих также можно сделать альтернативные жесты.

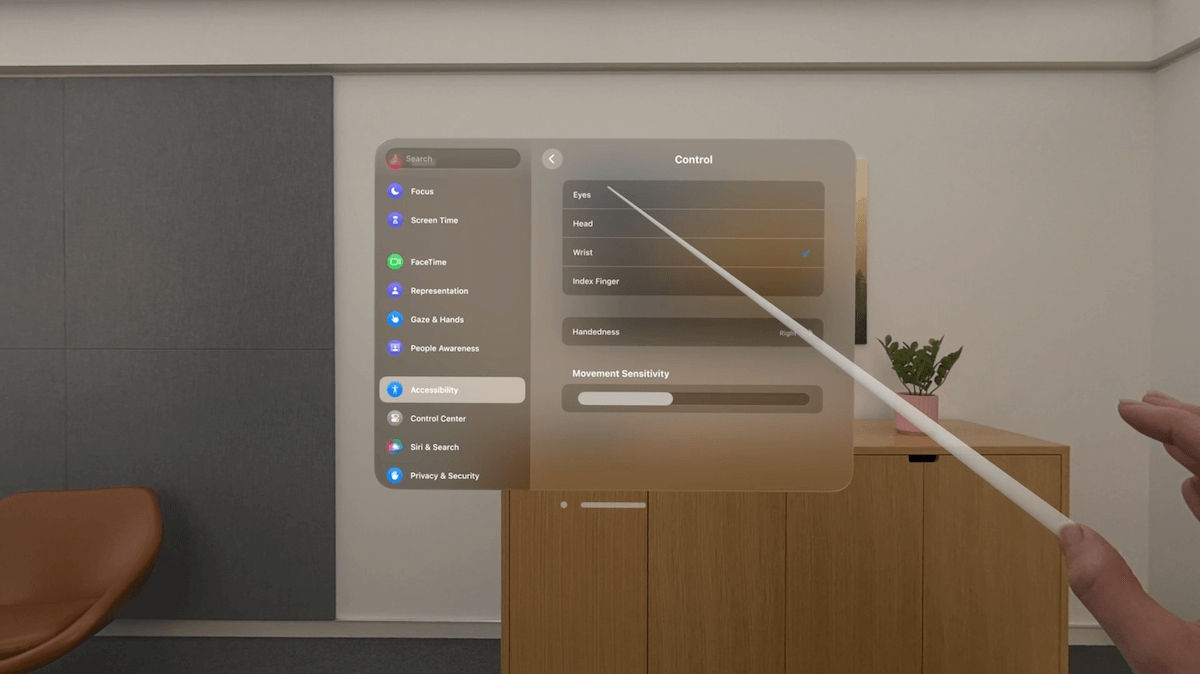

Трекинг глаз можно заменить на отслеживание позиции головы, указательного пальца или всей кисти (или культи, когда кисти нет).

Очки поддерживают и Switch Control — управление с помощью внешних устройств. Например, все действия можно выполнить со стандартной клавиатуры, в том числе и перемещения камеры.

Как это можно использовать? Например, Стивен Хоккинг был полностью парализован, у него работала буквально одна мышца на щеке. Но с помощью очков он мог бы просто смотреть на нужные кнопки и напрягать щеку для выбора — специальный датчик через Switch Control передал бы это сигнал.

Ментальные особенности

У некоторых людей есть особенности концентрации или могут быть спонтанные вздрагивания, мешающие управлению. Для них очки предлагают режим фокусировки на одном приложении.

С другой стороны, не все могут осознать управление, когда руки лежат на коленях, но картинка где-то в середине комнаты. Они смогут включить Direct Touch – пододвинуть интерфейс к себе и управлять им, будто это большой iPad, касаясь виртуального интерфейса. На примере клавиатуры Apple иллюстрирует ещё одно важно свойство интерактивности — обратная связь. Нажатие от виртуальной клавиатуры не почувствуешь, но срабатывание кнопки даёт много визуальной обратной связи. Придётся снова смотреть, куда пальцы жмут на клавиатуре.

Слух и речь

Очки используют пространственное аудио. Не все могут слышать, поэтому можно предоставить всю аудио-информацию в другом виде:

что говорят,

какое настроение задаёт музыка,

откуда эффект воспроизводится.

Как минимум нужны субтитры. Apple напоминает, что лучше показывать весь текст сразу, чтобы человек читал в удобном ему темпе, а не подстраивался под анимацию «по словам».

Интерфейс очков живёт в разных окружениях, поэтому субтитры кастомизируются в широком диапазоне.

Большая часть текста вводится голосом. Но не все могут говорить, поэтому на экран можно вывести обычную клавиатуру и набрать текст.

Как это можно использовать? Субтитры для людей с нарушениями слуха — это очень важно, и это минимальные требования. Вся их жизнь построена на визуальных образах, они любят сериалы и комиксы. В очках можно использовать намного больше приёмов, завязанных на окружение, чтобы, например, показать источник или направление звука. Как в комиксах разные вылетающие надписи Booooooom! и Cracccccck!

А может быть, точности сенсоров хватает, чтобы распознавать жестовый язык и синтезировать речь? Синтез ведь тоже показали в лекции!

Как узнать про доступность больше

Возьмите любую технологию доступности, попробуйте её использовать и оценить, как она работает с вашим приложением. Это интересный опыт и вы точно узнаете что-то новое. Чтобы помочь вам, я сделал два инструмента.

Видео «как пользоваться VoiceOver» за 8 минут покажет удивительный мир альтернативных интерфейсов.

Книга «Про доступность iOS» расскажет, как работают разные технологиии и что нужно сделать разработчикам, чтобы помочь айфону правильно адаптировать приложение под нужды человека. Как стало понятно, в очках используются всё те же принципы.

Приложение VoiceOver Designer поможет сделать прототип ещё на этапе дизайна, что упрощает разработку доступного приложения.

Вывод

Уверен, приставка Pro в названии не случайно — это узкоспециализированное устройство в котором максимум датчиков и технологий. Разработчики уже сейчас могут готовить новые приложения и искать новые смыслы для следующей версии очков, которая будет проще, но дешевле. Apple уже проходила это: во время презентации первого айфона рассказывали про телефон, интернет-коммуникатор и аудио-плеер, но современный телефон ближе к фотоаппарату.

Со стороны доступности это интересное устройство уже сейчас и может буквально изменить жизни некоторых людей.

Подписывайтесь на канал Dodo Mobile, там мы тоже рассказываем про доступность, дизайн и мобилки.

Ссылки на лекции

Комментарии (12)

ikeima

13.06.2023 09:19+1Круто, осталось только сделать технологию доступнее, как сказал товарищ выше, как с телефонами

danilbabich

13.06.2023 09:19Интересно, как это все вместе будет работать в экосистеме. Потому что схожие жесты есть для управления apple watch

akaDuality Автор

13.06.2023 09:19Во всем взаимодействии не хватает вибрации: на виртуальной клавиатуре неудобно набирать, потому что кнопок не чувствуешь, а полагаться только на визуал странно. Наверно кто-нибудь попробует хотя бы на одной руке хаптиком через часы отзываться.

flyer2001

13.06.2023 09:19а как (для каких кейсов) использовать незрячему очки VR? Не смог придумать

akaDuality Автор

13.06.2023 09:19+1Отличный вопрос!

Сначала поделюсь исторической картиной: такой же вопрос был после презентации телефона с сенсорным экраном. Зачем он незрячему, если он может звонить по обычному телефону, а вот этот новый специально сделан с упором на графику. Довольно быстро оказалось (в iOS 3, вроде бы), что можно дать альтернативное управления и незрячие смогут делать что и остальные люди: не только звонить, но и заказывать еду, общаться, читать новости и т.п. С очками их ролью в жизни сейчас похожий момент: мы не знаем во что это превратится.

Теперь пофантазирую конкретно. Что будут люди делать в очках? Да тоже самое, что сейчас делают: если я программирую, то с покупкой очков я не поменяю сферу работы на 3д-моделирование. Зато в очках можно открыть несколько приложений, переключаться между ними поворотом головы, вводить текст просто диктуя его и смотреть всякие иммерсивные фильмы с клевым звуком. Вот и незрячие смогут делать ровно это же: использовать привычные программы, но с другим управлением, где-то более удобным.

Плюс всякие новые приложеньки появятся, разных идей будет много. Пример прямо в тексте есть: камеры очков могут сканировать все вокруг и рассказывать что видят. Или отвечать на вопросы о том, что прямо сейчас перед человеком.

mozgozjegatel

13.06.2023 09:19На таптиках можно построить коммуникацию, придумать протокол и нейронкой кодировать данные полученные от лидара/микрофонов/камер в вибрации и обратно

Art3

13.06.2023 09:19+1Старый — добрый сквероморфизм, доведенный до абсолюта, но давайте честно, зачем нам интерфейсы поверх

ковровобоев? Я вижу ненатурально пустые интерьеры на скриншотах, но и оттого, что в реале меню будет висеть между шкафом исортиромдиваном, я не вижу особого профита. Или это такой способ чайник поставить не отвлекаясь? =)

toytronic

13.06.2023 09:19Как вариант можно будет себе интерьер обставлять 3д модельками перед покупкой. Растянул, прикинул как оно и принял решение брать-не брать. Ремонты всякие продумывать тоже. Но это скорее будет прикольно использовать тем, кто ремонты-интерьеры продаёт в рамках демонстраций или планирования, конечно)

panvartan

Имба для людей с сильно ограниченными возможностями зрения или движения, только они могут разобрать весь тираж на два-три года вперед.

alnite

К сожалению, такие люди будут именно что ограничены в возможности приобретения такого устройства "благодаря" нынешней экономической модели, где нормальный заработок для людей с ограничениями не позволит преодолеть заградительную цену от самой эппл. Остается надеяться на повторение истории со смартфонами, когда технология становится широко распространённой и более дешевой.

akaDuality Автор

Многие реабилитационные устройства стоят дороже (из-за малых тиражей), но дают меньший функционал. Поэтому тут сложно измерять обычной линейкой, очки могут оказаться дешевым девайсом даже за 3500.

alnite

Соглашусь. Хотя, реабилитационные устройства, одобренные соответствующими инстанциями, могут быть получены по госпрограмме, например. А вот "игрушка" от Эппл - вряд ли. Тут скорее, в виде дальнейшего развития, приходит на ум визуализация из фильма "Первому игроку приготовиться" (ну или описание из оригинального романа): high tech, low life :)