Глубокие нейронные сети, созданные для имитации человеческого мышления, сильно продвинулись в задачах распознавания объектов и обработки естественного языка. Тем не менее, их восприятие мира часто кардинально отличается от человеческого.

В своем исследовании ученые из Массачусетского технологического института (MIT) акцентируют внимание на их различиях и отмечают, что результаты классификации, предоставленные нейронными сетями, могут оказаться «неразличимыми для человеческого глаза».

Методология и ключевые понятия исследования

Ученые из MIT решили разобраться с восприятием нейронных сетей с помощью концепции «метамеров модели». Метамеры — это стимулы, которые, несмотря на свои различные внутренние характеристики, воспринимаются системой как идентичные. Например, цвета с разной длиной волны могут выглядеть для человеческого глаза одинаково.

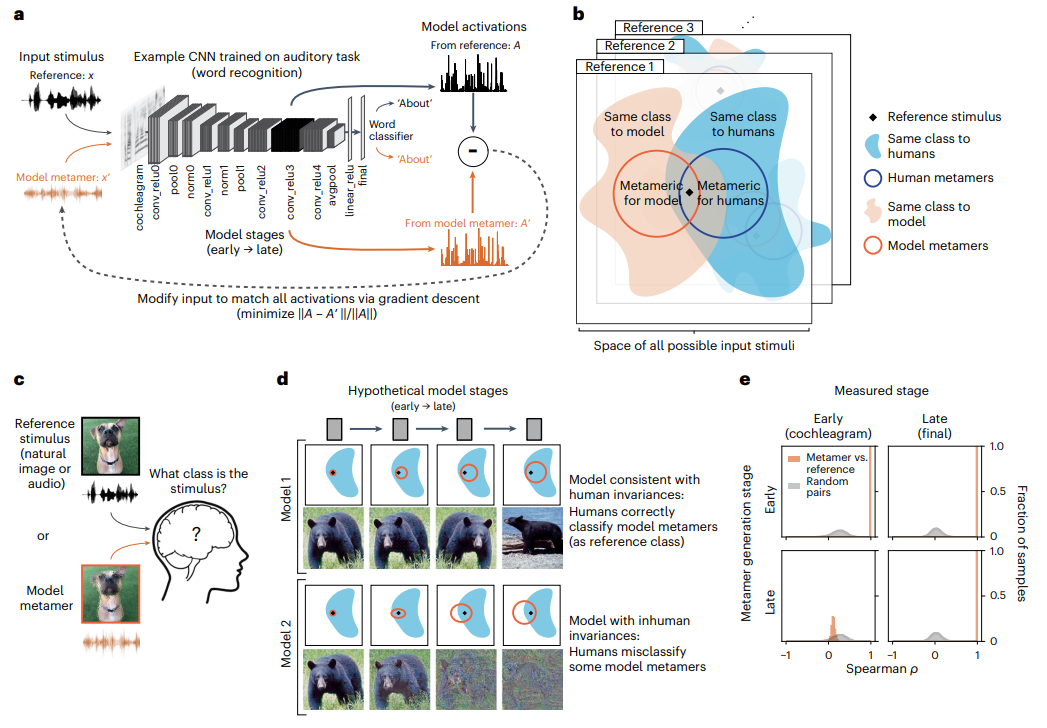

В рамках исследования ученые создавали «модельные метамеры» — стимулы, вызывающие одинаковые реакции в нейронных сетях, аналогичные эталонному стимулу. Результаты их удивили: большая часть полученных изображений и звуков сильно отличались от первоначальных примеров. Для наглядного представления результатов исследования рассмотрим схемы и графики ниже.

На изображении представлены основные этапы эксперимента, методика формирования модельных метамеров и влияние этих метамеров на восприятие нейронными сетями по сравнению с человеческим восприятием.

a. Процесс создания модельного метамера

Входной стимул. Подача входного стимула (например, слово) на вход конволюционной нейронной сети (CNN).

Пример CNN. Процесс обработки CNN, обученной на аудиторной задаче (например, распознавание слов), с последующим созданием метамера.

Модификация входа. Изменение входного стимула для достижения схожести активаций с эталонным стимулом.

b. Сравнение метамеров

На рисунке представлено пространство всех возможных входных стимулов. Видно, как стимулы и их метамеры сравниваются как между собой, так и с человеческим восприятием.

c. Сравнение референсного стимула и метамера модели

На рисунке изображено, как человек определяет класс стимула (например, изображение или звук) и как эти результаты соотносятся с метамерами, которые созданы моделью.

d. Гипотетические этапы модели

На примере показано, как изображения трансформируются на разных этапах моделирования и как может варьироваться человеческое восприятие.

e. Измеренные этапы

График, отражающий корреляцию между референсными стимулами и метамерами на ранних и поздних этапах обработки.

Выше представлены основные этапы создания и анализа метамеров, а также их взаимодействие с человеческим восприятием. Этот процесс охватывает не только визуальное, но и слуховое восприятие, включая распознавание различных стимулов и их последующую обработку нейронными сетями.

Следующее изображение демонстрирует результаты исследований и методики, с помощью которых к ним пришли.

Исследователи использовали различные архитектуры искусственных нейронных сетей для сравнения с биологическими нейронными сетями (человеческим мозгом).

В эксперименте с визуальными стимулами ученые выбрали определенные участки зрительной коры человека (V1, V2, V4, IT) для сравнения. В эксперименте с аудио стимулами они использовали 165 различных звуков и изменяли реакции человеческого мозга на эти звуки были при помощи fMRI.

На графиках видно, что реакции искусственных нейронных сетей на определенные стимулы могут сильно отличаться от реакций человеческого мозга, что подтверждает ваше предыдущее утверждение о том, что большая часть полученных изображений и звуков сильно отличалась от первоначальных примеров.

Одна из версий, почему возникло такое расхождение — это разница в методах обработки информации у людей и машин. Если человек использует для восприятия свои чувства, эмоции и воспоминания, то нейронные сети полагаются лишь на те данные, на которых были обучены. Они не испытывают эмоций и не обладают сознанием, что объясняет, почему так сложно перенести человеческое восприятие на машинные модели.

Этому тезису добавляет веса тот факт, что многие из синтезированных моделями изображений люди воспринимали как «хаотический микс пикселей», а звуки сравнивали с неразборчивым шумом. Несмотря на способность обрабатывать огромное количество информации, машины и люди воспринимают мир по-разному из-за своих уникальных когнитивных особенностей.

Выводы ученых и влияние исследования на будущее ИИ

Ученые из MIT прогнозируют серьезные изменения для всего мира искусственного интеллекта. Прежде всего, они выявили, что несмотря на выдающиеся способности глубоких нейронных сетей в области распознавания образов, их подход к категоризации часто противоречит человеческому восприятию. Этот вывод важен не только с академической точки зрения, но и с практической. Особенно в областях, где результаты машинного восприятия должны соответствовать человеческому, например, в медицинской диагностике, автономных транспортных средствах или создании интерфейсов.

Исследование показало, что применение состязательного обучения дает надежду. Добавление в обучающую выборку слегка модифицированных изображений сделало восприятие нейронных сетей ближе к человеческому, хотя и не довело его до полного соответствия. Дженелль Фезер, основной автор исследования, подчеркнула прогресс, однако указала на загадочную природу лежащего в его основе механизма: «Этот метод обучения действительно меняет ситуацию, но нам пока не ясны причины этого».

Эта статья поддерживается командой ITGLOBAL.COM

Мы — первый облачный провайдер в России, а также интегратор, поставщик ИТ-услуг, продуктов, сервисов и разработчик собственного ПО.

• Наш сайт

• Наш блог про виртуализацию и Enterprise IT

• Наш YouTube канал

• Истории успеха наших клиентов

Комментарии (3)

Olegsoft

24.10.2023 01:29Ой доиграемся мы с разумными машинами.... можно сказать что красную кнопку мы для неё уже демонтировали.

realbtr

Не увидел, много ли тестов с биологическими нейросетями проводили. Есть гипотеза, что разброс результатов будет больше обнаруженного отклонения. Больше всего позабавили выводы про эмоции и сознание у биологических сетей. Очевидная сова на глобус.

Kiridan

А ведь у людей ещё есть ручки и ножки...