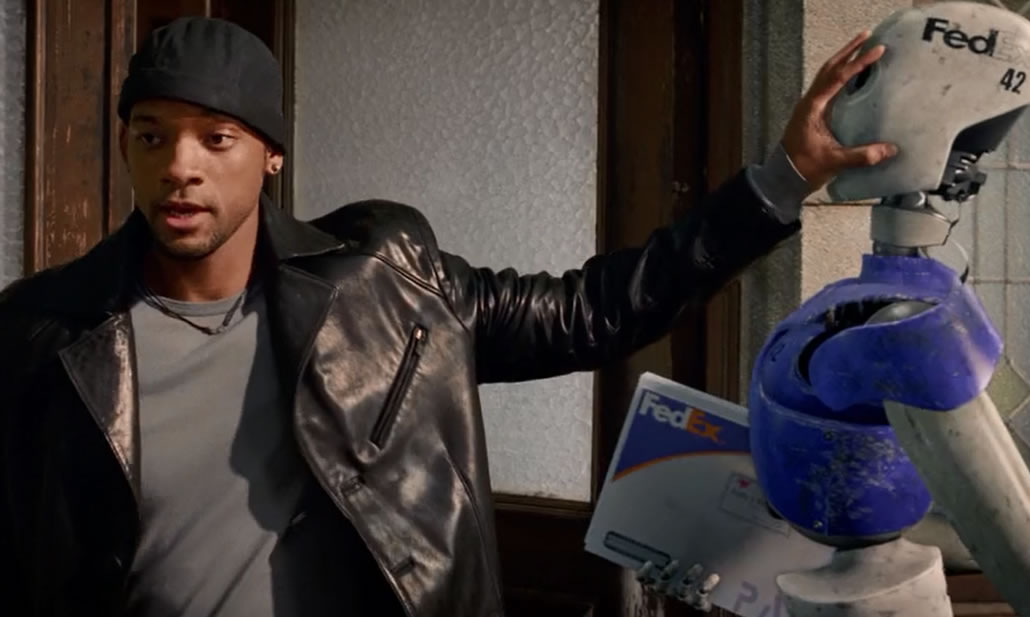

Слова, сказанные Уиллом Смитом в знаменитой сцене из фильма «Я, робот», мол, искусственному интеллекту никогда не достичь человеческого уровня, потому что он «не может написать симфонию или взять чистый холст и превратить его в шедевр», теряют актуальность. Генеративные нейросети демонстрируют прямо-таки волшебные способности: пишут тексты, создают уникальные изображения, видео и звук. Они отгадывают загадки, интерпретируют сложные графики, медицинские снимки и выполняют прочие трюки, которые от человека потребовали бы минимум одного высшего образования.

С одной стороны, новые возможности ИИ способны изменить в лучшую сторону многие области человеческой жизни, от избавления офисных работников от рутины до диагностики сложных заболеваний. С другой — они же угрожают оставить миллионы людей без работы, разъесть привычные социальные нормы и вообще превратить мир в страшную утопию. Самое время, чтобы придумать законы, которые предотвратили бы негативные сценарии. В 2023 году во многих странах всерьез заговорили о регулировании ИИ. Сегодня разбираемся с готовящимися законами: почему их принимают и когда всё началось.

История вопроса

Первое громкое высказывание в отношении ИИ-законов случилось в 2017 году, когда известный техномагнат Илон Маск призвал к регулированию развития искусственного интеллекта. Выступая на встрече с губернаторами США, он заявил, что сам «не в восторге» от того, что предлагает ввести контроль над отраслью, в которой работает, но он считает, что риски полной бесконтрольности ИИ слишком велики.

Свою логику он объяснил так: обычно регулирование наступает после того, как случается череда негативных событий, а законотворческий процесс занимает много времени. В случае с ИИ, по словам Маска, у людей времени недостаточно.

В том же году европейские законодатели выступили с предложением о регулировании искусственного интеллекта и робототехники. В ответ на это, а также на обращение Маска генеральный директор Intel Брайан Кржанич заявил, что искусственный интеллект находится в своем зачаточном состоянии, и регулировать его ещё рано. Вместо попыток регулирования самой технологии некоторые ученые предложили разработать общие нормы, включающие в себя требования к тестированию и прозрачности алгоритмов.

Законы в отношении ИИ решили придумывать не просто так. Существует целый набор конкретных рисков, которые несёт эта технология. Вот основные.

Поводы для опасений

Предвзятость

Искусственный интеллект широко используется в системах распознавания лиц и голоса: в основном, для контроля доступа, но также — в различных скоринговых системах банковской и страховой сфер, в инструментах правоохранителей и так далее. Некоторые из этих систем имеют значительное влияние на бизнес и людей, но и они также подвержены предвзятости и ошибкам, которые могут возникать из-за человеческого фактора. Кроме того, данные, используемые для обучения этих ИИ-систем, могут быть искажены.

В последние годы не раз появлялись новости о том, как алгоритмы распознавания лиц, разработанные Microsoft, IBM Face++ и другими компаниями, демонстрировали «предубеждения» при определении пола людей. При гендерной атрибуции белых мужчин они оказывались точнее. Еще один пример предвзятости ИИ побудил компанию Amazon прекратить использование электронного разума для найма сотрудников. Алгоритм предпочитал кандидатов-мужчин, так как был обучен на данных, полученных именно от мужчин.

Проблемы предвзятости могут возникать по разным причинам, но самая основная — несбалансированный выбор материала для обучения нейросетей. У явления даже появилось название: алгоритмическая несправедливость. И пока что не придумали способа, чтобы гарантировать, что очередной алгоритм будет выносить только справедливые суждения.

Некачественное предоставление услуг

Почти что философский вопрос: кто виноват в ДТП с участием автономных автомобилей — владелец машины или компания, которая её разработала? Владелец, компания или пешеход, нарушивший правила дорожного движения? Автономные автомобили — самый очевидный повод для беспокойства в отношении ИИ, когда речь заходит о качестве предоставления услуг. Но не единственный.

Кто несёт ответственность за ошибочные медицинские советы, сгенерированные некачественно обученной нейросетью, если в результате следования им страдает здоровье человека? Сейчас создатели ИИ часто умывают руки, ссылаясь на суть генеративных нейросетей. Предполагается, что они генерируют именно контент: текст, картинку или видео, которые были бы максимально близки по контексту к запросу пользователя. Ответ таких сетей будет правдоподобным, но фактически верным он окажется ровно настолько, насколько фактически верной была информация, на которой ИИ обучали. Размер наборов данных для обучения нейросетей огромный, и каких-либо общепринятых стандартов по наполнению таких баз данных пока что нет.

Приватность и сохранность корпоративной конфиденциальной информации

Всякий раз, когда пользователь пишет промпт, чтобы решить какую-то свою практическую задачу, он сообщает искусственному интеллекту детали либо о своей частной жизни, либо о компании, для которой он при помощи ИИ делает эту работу. Отсутствие информации о том, что владельцы ИИ-сервиса делают с этими данными — удаляют ли их, сохраняют и анализируют ли и используют ли в дообучении нейросетевой модели — вызывает беспокойство у защитников цифровых прав людей и служб информационной безопасности корпораций.

Решения этой проблемы тоже пока нет, кроме очевидной цифровой гигиены: многие компании в этом году ультимативно запретили своим сотрудникам сообщать ChatGPT и похожим технологиям какую-либо корпоративную информацию.

Авторское право

Недавняя забастовка голливудских сценаристов стала яркой иллюстрацией этой угрозы. Сценаристы не согласились с тем, что кинокомпании использовали генеративные нейросети для создания сценариев к фильмам. Претензии сценаристов едва ли можно назвать несправедливыми: ведь для обучения нейросетей использовались в том числе тексты сценариев за авторством реальных профессионалов. И делалось это не всегда с разрешения авторов.

В результате забастовки сценаристы добились ограничения использования ИИ в творческом процессе, например искусственный интеллект не может создавать или переписывать литературные материалы, а любые материалы, созданные ИИ, не будут считаться исходным материалом. При этом сценаристы могут использовать ИИ для написания текстов. Однако кроме сценаристов есть ещё множество правообладателей в изобразительном искусстве, музыке, литературе и других творческих сферах, где ИИ может отбирать хлеб у создателей контента.

Другими словами, поводы для беспокойства в отношении ИИ не просто существуют в теории — они уже подтвердились реальными событиями. Вот почему правительства разных стран начали законодательно регулировать эту сферу.

География законов

По данным Стэнфордского университета, специалисты которого ведут учёт законотворческой деятельности в области ИИ, за период с 2016 по 2022 год количество принятых ИИ-законов подскочило с одного законодательного акта в 2016-м до 37 штук, принятых в одном только 2022-м. Вот как разные страны подходят к этому вопросу.

Европейский Союз

В июне этого года Европейский парламент проголосовал за принятие так называемого «Закона об ИИ». Он классифицирует ИИ по трем категориям риска: ограниченный, высокий и неприемлемый.

Неприемлемыми считаются системы ИИ, представляющие «угрозу» для общества (в качестве примера Европейский парламент предлагает «игрушки с голосовым управлением, которые поощряют опасное поведение детей»). Такие системы запрещены Законом об искусственном интеллекте.

ИИ с высокой степенью риска должен быть одобрен европейскими чиновниками до выхода на рынок, кроме того, разрешение на его использование должно обновляться на протяжении всего жизненного цикла продукта. К таким алгоритмам относятся различные скоринговые и биометрические системы. В частности, ИИ-продукты, связанные с правоохранительной деятельностью, пограничным контролем, проверкой при приеме на работу.

ИИ из категории ограниченного риска, к которым относятся все продукты, не вошедшие в первые две категории, должны быть соответствующим образом маркированы, чтобы пользователи могли всегда знать, что они взаимодействуют с ИИ или продуктами его деятельности, и принимать информированные решения о своих дальнейших действиях.

Закон еще не вступил в силу, он должен быть одобрен Европейским советом. Впрочем, парламентские законодатели надеются, что этот процесс завершится в конце нынешнего года.

Бразилия

В Бразилии тоже готовят своё ИИ-законодательство, и оно во многом похоже на европейское. Проект бразильского закона написан с прицелом на права пользователей, взаимодействующих с системами ИИ, а также он даёт рекомендации по классификации различных типов ИИ в зависимости от степени риска.

Закон возлагает на поставщиков ИИ обязанность предоставлять пользователям исчерпывающую информацию о своих продуктах. Пользователи имеют право знать, что они взаимодействуют с искусственным интеллектом, а также право на объяснение того, как ИИ принял то или иное решение либо дал ту или иную рекомендацию. Пользователи также могут оспаривать решения «электронного разума» или требовать вмешательства человека, особенно если решение ИИ может оказать существенное влияние на жизнь людей. Например, в системах, связанных с автономными автомобилями, приемом на работу, оценкой кредитоспособности или биометрической идентификацией.

Разработчики ИИ также обязаны проводить оценку рисков перед выводом продукта на рынок. Самыми опасными бразильские законодатели признают ИИ, использующие «сублиминальные» технологии, то есть технологии, воздействие которых на человека (его органы чувств или подсознание) способно нанести вред его здоровью и безопасности.

В проекте также перечислены возможные «высокорисковые» реализации ИИ. К ним, как и в Европе, относят системы, используемые в здравоохранении, биометрической идентификации, кредитном скоринге и т. д. По замыслу авторов законопроекта, оценки рисков для «высокорисковых» продуктов ИИ должны публиковаться в государственной базе данных.

Китай

У Китая есть проект нормативного документа о генеративном искусственном интеллекте. Одно из положений проекта закона звучит так: генеративный ИИ должен отражать «основные ценности социализма», но, кроме того, в нем, как и в бразильском аналоге, есть немало положений об ответственности разработчиков за деятельность ИИ-систем.

Согласно документу, разработчики несут ответственность за результаты, полученные их ИИ. Помимо того, проект закона описывает ограничения на поиск обучающих данных — например, разработчики несут юридическую ответственность, если наборы данных для обучения генеративных сетей, которые они используют, нарушают чужое авторское право. Имеется в регламенте и ещё одно требование: сервисы искусственного интеллекта должны генерировать только «правдивый и точный» контент.

Предлагаемые правила опираются на существующее в стране законодательство о фальсификациях, рекомендательных алгоритмах и безопасности данных. Это дает Китаю определённое преимущество перед другими странами, разрабатывающими новые законы с нуля.

Также в августе китайский регулятор Интернета также объявил о введении ограничений на технологии распознавания лиц. В законопроекте, подготовленном Государственной канцелярией интернет-информации КНР, предлагается ограничить использование технологии только теми случаями, когда она имеет конкретную цель и необходимость. В частности, правила запрещают использование технологии для идентификации расовой и этнической принадлежности, религиозных убеждений или состояния здоровья, кроме случаев, когда человек дал на это своё согласие или если этого требует национальная безопасность.

Израиль

В 2022 году Министерство инноваций, науки и технологий Израиля опубликовало проект политики регулирования искусственного интеллекта. Авторы документа описывают его как «моральный и бизнес-ориентированный компас для любой компании, организации или государственного органа, вовлеченного в сферу искусственного интеллекта», и подчеркивают, что он ориентирован на «ответственные инновации».

В израильском проекте говорится, что при разработке и использовании искусственного интеллекта должны соблюдаться «верховенство закона, основные права и общественные интересы. В частности, должны сохраняться человеческое достоинство и неприкосновенность частной жизни». При этом каких-то конкретных запретов или инструкций политика не содержит. В одном из фрагментов документа довольно расплывчато говорится, что для обеспечения безопасности использования продуктов ИИ «должны применяться разумные меры в соответствии с принятыми профессиональными концепциями», но на этом всё.

В более широком смысле проект политики поощряет саморегулирование и «мягкий» подход к государственному вмешательству в развитие ИИ. Вместо того чтобы предлагать единое общеотраслевое законодательство, документ призывает отраслевые регулирующие органы при необходимости принимать точечные меры.

Италия

Италия выбрала иной подход к регулированию ИИ. Так, в марте местное правительство ненадолго запретило ChatGPT, ссылаясь на опасения по поводу того, как и сколько данных о пользователях собирает чат-бот. Потом технологию вновь разрешили использовать, а кроме того, правительство стало инвестировать деньги в устранение негативных последствий её внедрения. Конкретно — около 33 млн долларов были выделены на поддержку работников, которым грозит отставание в результате цифровой трансформации. Примерно треть этой суммы направлена на обучение работников, чьи рабочие места могут устареть в результате автоматизации процессов, которую позволяют ввести генеративные сети. Остальные средства направят на обучение цифровым навыкам безработных и экономически неактивных граждан в надежде ускорить их выход на рынок труда.

ОАЭ

Далеко не в каждой стране на первом месте в государственной стратегии, касающейся ИИ, стоит его законодательное регулирование.. Например, в Национальной стратегии искусственного интеллекта Объединенных Арабских Эмиратов амбициям страны в области регулирования отведено всего несколько абзацев. В частности, Совет по искусственному интеллекту и блокчейну будет «рассматривать национальные подходы к таким вопросам, как управление данными, этика и кибербезопасность», а также наблюдать и интегрировать лучшие мировые практики в области ИИ.

Остальная часть 46-страничного документа посвящена стимулированию развития искусственного интеллекта в ОАЭ путем привлечения талантливых специалистов в области ИИ и интеграции технологии в такие ключевые отрасли, как энергетика, туризм и здравоохранение. Эта стратегия, как отмечается в резюме документа, соответствует стремлению ОАЭ стать «к 2071 году лучшей страной в мире».

Россия

В России понятие искусственного интеллекта впервые законодательно закрепили в 2020 году. Закон № 123-ФЗ вводит экспериментальное регулирование ИИ в Москве на пять лет. Он предназначен для регулирования разработки и внедрения технологий искусственного интеллекта и для возможного использования результатов работы этих технологий.

Согласно закону, искусственный интеллект — это комплекс технологических решений, которые позволяют имитировать когнитивные функции человека и получать результаты, сравнимые с результатами интеллектуальной деятельности человека, при выполнении конкретных задач.

Чего в законе нет, так это ответов на вопросы о том, что будет, если с ИИ что-то пойдёт не так. О разработке дополнительного закона, который, вероятно, закроет этот вопрос, стало известно летом 2023 года. Однако конкретики пока мало: из публикаций в СМИ известно, что он точно коснётся обезличивания данных, используемых ИИ-системами.

США

Большинство компаний, занимающихся масштабными ИИ-проектами, базируются в США, и в том числе поэтому вопросы регулирования искусственного интеллекта поднимаются местными политиками уже давно. Впервые об этом на государственном уровне там задумались ещё в 2016 году, а в 2019-м в США появилась Комиссия по национальной безопасности по искусственному интеллекту, которая занималась не только вопросами применения ИИ для обеспечения нацбезопасности, но и регулированием этого применения. В регулировании искусственного интеллекта в США участвуют и различные отраслевые ведомства. Например, в компетенции Управления по контролю за продуктами питания и лекарствами входит регулирование использования ИИ в медицинской визуализации.

С июня этого года в Нью-Йорке действует так называемый «Закон о предвзятости», который запрещает компаниям, работающим и нанимающим сотрудников в Нью-Йорке, использовать автоматизированные инструменты для найма кандидатов или продвижения сотрудников, если только эти инструменты не прошли независимую проверку на предмет предвзятости.

Также в июле 2023 года администрация президента США добилась от семи компаний (Open AI, Google, Amazon, Anthropic, Google, Inflection, Meta и Microsoft) принятия добровольных обязательств по управлению рисками, связанными с ИИ. Компании выразили готовность обеспечить проведение внутреннего и внешнего тестирования продуктов ИИ на безопасность до их публичного выпуска.

В сентябре эти же добровольные обязательства подписали еще восемь компаний (Adobe, Cohere, IBM, Nvidia, Palantir, Salesforce, Scale AI и Stability AI). Но добровольные обязательства добровольными обязательствами, а конкретный и общий закон об ИИ в США вот-вот издадут. Ожидается, что до конца осени администрация Байдена издаст указ, который уполномочит федеральное правительство сформировать правила использования ИИ.

Prompt: отрегулируй ИИ

Законы, регулирующие технологии, почти всегда имеют две главных цели: определить способы легитимного применения новшества и обезопасить общество от возможных негативных эффектов. Так было с компьютерами, Интернетом, мобильными телефонами, и ИИ в этом смысле не исключение. Возникновение ИИ-законов — это свидетельство развития технологии до уровня, при котором она оказывает значимое влияние на жизни людей. Для противников регулирования эти законы — способ затормозить развитие технологий, но для всех остальных их появление — новость скорее хорошая. Ведь в итоге законодательство поможет людям избежать проблем, которые способен создать ИИ, и в полной мере воспользоваться его преимуществами.

Earthsea

qw1

После бума генеративного ИИ этот мем получил продолжение:

Да, могу. Ещё вопросы?