В последнее время нейросети показывали себя прекрасно во многих прикладных задачах. Они искали закономерности в данных, которые использовались для классификации и прогнозирования. Нейросети с кажущейся легкостью распознавали объекты в цифровых изображениях или, «прочитав» отрывок текста, резюмировали его тему. Однако никто не мог рассказать, какие преобразования проходили вводимые данные для получения того или иного решения. Даже авторы сетей владели данными на входе и информацией на выходе. И если рассматривать визуальные данные, то иногда даже можно автоматизировать опыты по выяснению, на какие составляющие изображений реагирует нейросеть. А с системами обработки текста процесс более сложный. В чем сложность понимания человеческого языка машиной вы можете прочитать ниже.

В лаборатории CSAIL (лаборатории информатики и искусственного интеллекта) Массачусетского технологического института исследователи нейросетей сделали так, что теперь «виртуальный мозг» в дополнение к решению выдает и его обоснование. Они обучали два модуля одной нейросети одновременно. Данными для обучения были текстовые отрывки. Результаты порадовали: компьютер думал, как и человек, в 95% случаев. И все же, прежде, чем запустить новый метод нейросетей в активное пользование, потребуется дополнительная настройка и доработка.

Почему картинки обрабатывать легче, чем текст? Можно ли будет беспилотным автомобилям ездить свободно, позволительно ли заменять живого доктора запрограммированным интеллектом, внутри которого бессчетное количество нейронов? Приближает ли это нас к сознательным машинам в реальной жизни? Компьютерные модели нейронных сетей ведут себя так же, как и человеческий мозг, но им пока не разрешали принимать решения, затрагивающие жизни людей. Чтобы изменить это, специалистам понадобилось время и теперь мы можем узнать, как нейросеть приходит к итоговым значениям.

Иногда в мире реальных приложений люди хотят знать, почему машина сделала именно такое предсказание, а не любое другое. Главная причина того, что доктора не доверяют решениям ИИ, — отсутствие информации о процессе принятия решения. Это касается и других сфер тоже — любой, где стоимость неверно сделанного прогноза высокая. Поэтому всем нужны доказательства и гарантии. Скорее всего, все на самом деле даже шире: вы можете не только хотеть подтвердить правильность прогноза модели, но еще и узнать, как можно повлиять на происходящее с помощью анализа. Как обычный человек может понять сложную модель, которая обучается на неизвестных алгоритмах. Эти алгоритмы могут рассказать о рациональности конкретного решения. На Гиктаймс уже задавался вопрос по теме. И вот теперь мы можем ответить положительно.

Нейросети — что?

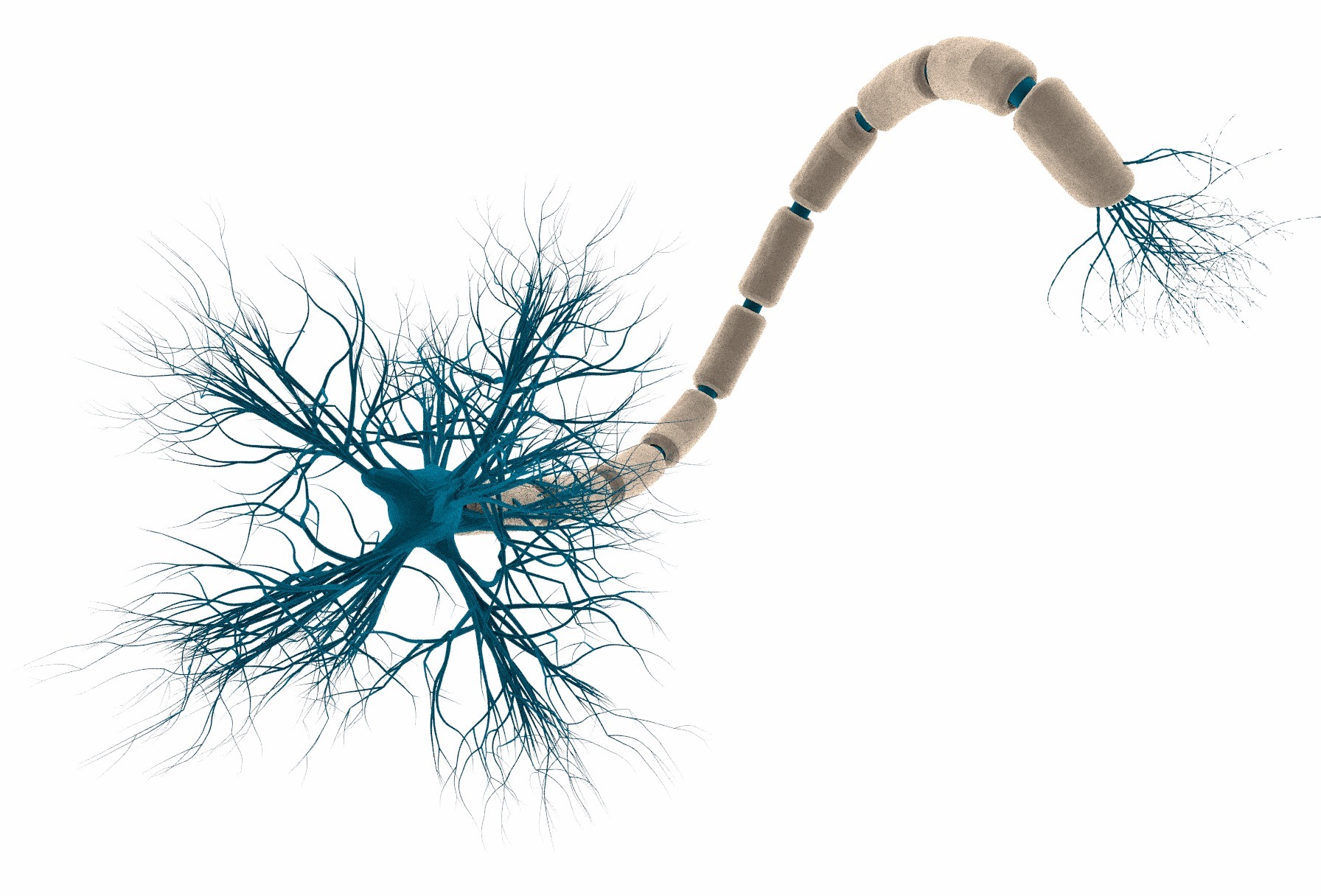

Название «искусственные нейронные сети» говорит о том, что эти структуры ведут себя примерно как мозговые структуры человека. Составная единица такой сети — это узел обработки, который, как и нейрон, сам по себе может совершать простейшие операции. Мощь появляется, когда множество узлов объединяется в одну огромную сеть. Большая часть неизвестной работы происходит в нейроне. Это он — черный ящик. Данные на входе и выходе можно узнать. Во время обучения, операции, производимые отдельными узлами, постоянно меняются с целью получения хороших результатов по всему набору примеров для обучения. К окончанию процесса программист сети не знает, какие у узлов сейчас параметры. Даже если бы эти данные и были, то было бы сложно понять эту низкоуровневую информацию так, чтобы смочь перевести ее на понятный человеку язык.

В процессе глубокого обучения данные поступают во входные узлы сети, которые преобразуют их и передают следующим узлам. Последнее действие повторяется многократно. Процесс останавливается, когда значения поступают в выходные узлы сети. Информация коррелируется с областью данных, в которой и происходит обучение. Это могут быть объекты на изображении или тема статьи.

Как процесс стал прозрачным

Чтобы понять, как нейросеть принимает решения, исследователи решили обучать ее на текстовых данных. В институтской лаборатории команда специалистов разделила созданную сеть на две части. Одна предназначалась для извлечения кусков текста из данных обучения и оценке их по длине и последовательности. Чем короче отрывок и чем большая его часть состоит из строчек последовательных слов, тем выше оценка.

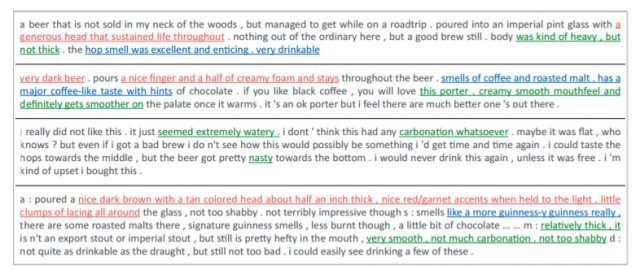

Дальше отрывки поступали во вторую часть. Вторая часть нейросети предсказывала тему отрывка или пыталась классифицировать текст. Для теста использовались онлайн-отзывы с сайта рейтинга пива. Сеть ученых попыталась оценить сорта пива по пятизвездочной шкале, основываясь на факторах: аромат, вкус, внешний вид и написанные отзывы. После обучения системы исследователи обнаружили, что их нейросеть оценивает аромат и внешний вид так же как и реальные люди: 95% и 96% соответственно. По более субъективной характеристике вкуса нейросеть «согласилась» с людьми в 80% случаев.

Модули обучались вместе, а целью тренировки было сделать максимальной оценку выбранных сегментов и точность предсказания или классификации.

На иллюстрации показан пример отзыва о пиве с ранжированием по двум категориям. Если первая подсеть выбирала такие три фразы и вторая подсеть связывала их с правильными рейтингами, то система использовала для суждения то же самое, что и человек. Также исследователи тестировали нейросеть на базе данных свободных вопросов и ответов на технические темы. Вопрос был в том, был ли конкретный ответ уже дан прежде.

Этот метод ученые применили к тысячам результатов биопсий с патологией рака груди. Анализировался текст и снимки.

В чем заключается сложность для машины понять человеческий язык?

«Трудно дать ответ, если не понимаешь вопрос.» Сарек, отец Спока в фильме Звездный путь — 4: Возвращение домой.

Обработка естественного языка — одно из направлений в искусственном интеллекте. Наша точка зрения и широкий круг знаний о мире и понимание контекста влияют на то, как мы воспринимаем даже самые элементарные структуры грамматики, связывающие слова в осмысленные словосочетания и предложения.

Объясню на примере, который приводится в книге Эрика Сигеля «Просчитать будущее». Например, словосочетания типа of India, of milk, of your. Каждая подобная часть предложения может играть разные роли в зависимости от слов, которые стоят до и после фразы. Конкретное определение будет основываться на понимании, что значат слова и что представляют собой реальные вещи, которые они называют.

1. «Time flies like an arrow.»

2. «Fruit flies like a banana.»

Если кто-то не знает эти английские лингвистические головоломки, попробуйте самостоятельно перевести предложения несколькими способами.

Время летит, как стрела.

Мухи времени любят какую-то стрелу.

Измеряйте скорость мух так же, как измеряете скорость стрелы.

Фрукт летит как банан.

Дрозофилы любят банан.

Один и тот же предлог может означать разное. Особенно, предлог WITH.

«I ate porrige with fruits.» Я съел кашу с фруктами, которые были частью блюда.

«I ate breakfast with spoon.» Я съел завтрак ложкой, которая была инструментом.

«I ate breakfast with my mom.» Я позавтракал со своей мамой, которая была участником действий.

Применение нейронных сетей

Задачи классификации. Это как раз поиск шаблонов, распознавание лиц.

Задачи прогнозирования. Как поведут себя пользователи в каких-то ситуациях. Например, банки так подсчитывают вероятность возврата кредитов при принятии решения о выдаче. Еще они исследуют стоимость кредитов, чтобы в оптимальный момент перепродать их другим банкам. Сферы применения машинного обучения: безопасность, покупательское поведение в магазинах, борьба с преступностью, маркетинг, конечно же, политика (выборы), образование, психология и управление человеческими ресурсами.

В каждой предметной области при ближайшем рассмотрении можно найти постановки задач для нейронных сетей. Вот список отдельных областей, где решение такого рода задач имеет практическое значение уже сейчас. Привожу некоторые из них.

В финансовой области нейросети прогнозируют курсы валют, стоимость сырья (временные ряды), помогают вести автоматическую торговлю на биржах, предсказывают вероятность банкротства, определяют безопасность транзакций с пластиковыми карточками. В медицинской сфере они ставят диагнозы, обрабатывают изображения, следят за состоянием пациентов, анализируют эффективность назначенного лечения. Нейросети распознают сигналы радаров, адаптируют пилотирование поврежденных летательных аппаратов, сжимают видеоинформацию, оптимизируют сотовые сети, разговаривают с нами в виде электронных помощников (Cortana, Siri), фильтруют и блокируют спам, помогают настраивать адресную рекламу. В процессах производства они способны предупреждать аварийные ситуации и контролировать качество продукции. В робототехнике — прокладывают маршруты движения роботов, контролируют манипуляторы.

Значительно облегчают жизнь специалистам по безопасности и охранным системам — тут нейросети занимаются идентификацией личностей по отпечатку пальца, голосам, подписям и лицам. Для геологов сети анализируют сейсмические данные и отыскивают полезные ископаемые при помощи ассоциативных методик.

Как медицина может полагаться на бездоказательные решения нейросетей? Но, разве решения, принятые человеком, разумом вперемешку с эмоциями, всегда можно считать абсолютно верными для конкретного случая? Есть, конечно, комиссии врачей, но их не всегда получится собирать. Так что в нашей не всегда доказательной медицине решения до сих пор принимают люди со специфической подготовкой. Человеческий фактор, врачебная ошибка против вероятного ложного срабатывания искусственного интеллекта. Может, дело в том, что в случае с машиной нет конкретного виноватого?.. В природе человека — искать ответы, оправдывать и обосновывать решения перед своим же собственным мозгом. Человеку всегда легче, когда известно, кто виноват.

То же и на дорогах. Машине непростительно сбить человека так же, как непростительно другому человеку, нарушившему правила, причинить вред. А всегда ли виновный получает объективное наказание? Вопросы морали так и останутся вечными. Наверное, одного общего ответа нет. Когда самоуправляемые автомобили от BMW или Google станут обыденностью на улицах городов, люди примут машинный риск. И хотя в некоторых случаях в смерти человека причиной будет компьютер-водитель, общее количество аварий и жертв резко уменьшится благодаря роботам.

Больше всего за этичность нейросетей борются компании, производящие автомобили с самоуправлением. Вопрос: как должен поступить автопилот, когда перед ним двое детей играют в мяч прямо на перекрестке. Кто должен подвергнуться опасности: заведомо нарушающие правила (!) дети или пассажиры автомобиля.

Этот пример напоминает классическую этическую задачу, в которой вы оператор дорожной стрелки, на одном пути группа людей, а на другом кто-то один. Решение всегда будет несправедливым по отношению к жертве, его родственникам и спасет остальных. Хотя люди, которые выживут такой ценой тоже могут быть не рады.

Эволюционная похожесть на мозг

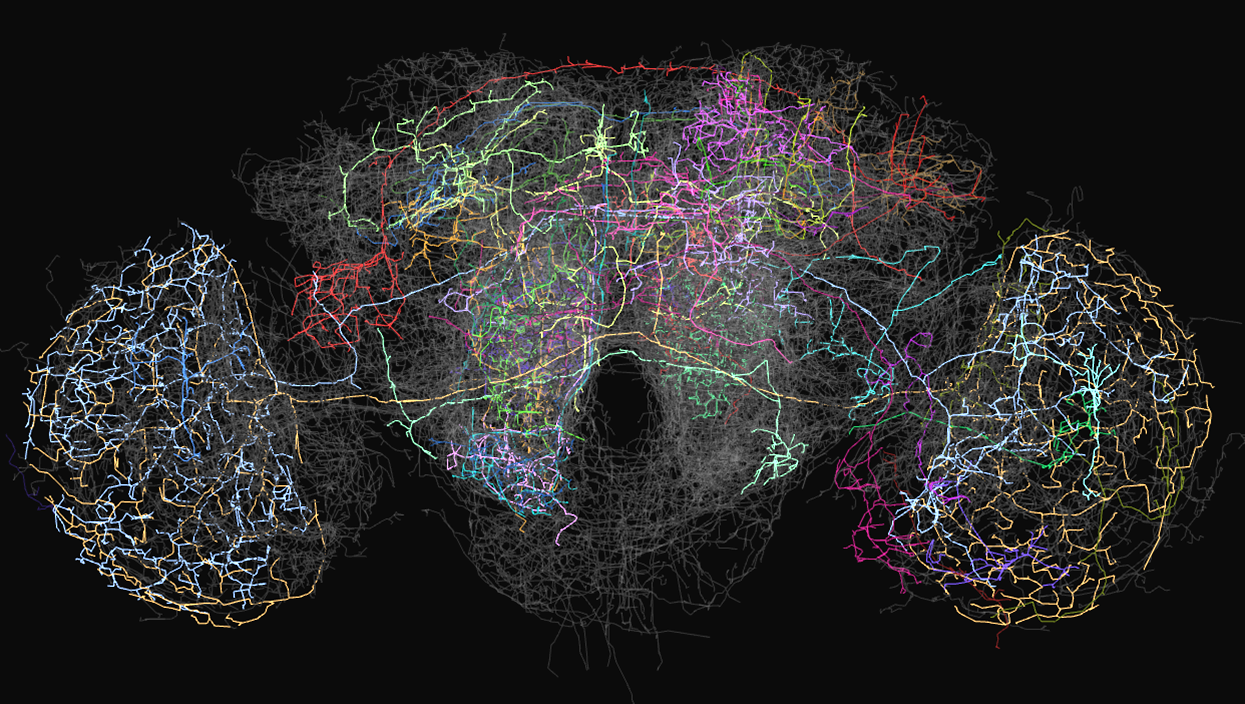

Существует понятие нейродарвинизма. Он включает в себя механизм самозагрузки, который работает на обратной связи между окружающей средой и мозгом. Даже самые простые компьютерные модели нейронных сетей, если их запрограммировать на удаление невыгодных для существования конфигураций и воспроизведение выгодных, достигают удивительных уровней сложности за короткое время. Я это к чему, никакие структуры в реальном мире не созданы с целью самоуничтожения. Любое существо запрограммировано на жизнь. И нейросети тоже. Даже такое, на наш взгляд, простое существо, как мушка-дрозофила, имеет сложную систему связей в мозгу. Это ее мозг вы видели на изображении в начале.

Как человеческий мозг работает с изображениями

Как пишет Рита Картер, в книге «Как работает мозг», информация-воспоминания о лицах знакомых нам людей хранятся в мозге как особые нейронные сети (Единицы Распознавания Лиц). Когда мы видим новый образ, он сопоставляется с нашим опытом путем сканирования ЕРЛ. Если есть что-то связывающее, то та ЕРЛ становится активной и соединяется с последним увиденным образом. Мозг ведет себя одинаково, будь новый образ увиден на улице или сгенерирован самостоятельно сознанием человека. Чем чаще сознание обращается к сохраненным образам, тем активнее соответствующие нейросети. Ненужные же сети со временем распадаются. Это то, что мы называем «совсем забыл».

Сознание

Зачем я провожу аналогии с человеческим мозгом? Может, дело не только в том, чтобы доверять компьютерным нейросетям? Возможно, это вопрос понимания и принятия. Да, другой человек, как существо полностью принимаемое нами за «свое» в отличие от механического компьютера, объяснит и обоснует любое решение так, что мы поймем. А если он врет? А если он психически болен? Всюду остаются нюансы. У машин нет сознания, а значит нет и проблем этического характера — они всегда более объективны и беспристрастны. Но у исследователей не получается оставить их только для определенных сфер, типа создания лучшей шахматной комбинации, проектирования сложных систем, а, значит, и нам, людям надо приспосабливаться тоже. Хоть это и сложно. Как и чувствовать любую грань между механическим и эмоциональным. Но таково будущее, описанное в научно-фантастических романах прошлого, которые уже давно начали становиться нашей повседневной жизнью.

Таким образом, сделан еще один шаг в сторону понимания в паре человек-машина. Хочу привести слова Роджера Пенроуза, профессора математики из Оксфордского университета.

Понимание требует осознания. Иллюзия понимания появляется из-за всесторонней обработки большого количества данных. Вычисление и понимание — это дополняющие друг друга вещи.

«Я полагаю, что для объяснения понимания нам обратиться к новым физическим концепциям с квантовым миром, математическая структура которого по большей части неизвестна.»

Пенроуз говорит, что понимание порождает особый компонент мозговых тканей.

«В теле человека есть микротрубочки, особенно их много в нервных кетках.»

Ученый предлагает исследовать, возможно ли то, что микротрубочки создают стабильные квантовые состояния, которые связывают клеточную активность по всему мозгу, порождая сознание. Компьютерное моделирование этого состояния невозможно.

Комментарии (45)

laughing_one

08.11.2016 01:16Немного не по теме комментарий, но всегда было интересно вот что: допустим, изобрели таки люди в конце-концов полноценный ИИ, не уступающий естественному человеческому интеллекту. И предположим появятся все основания считать, что он обладает сознанием. В то же время, подозреваю, что держать его будут в достаточно изолированных условиях, ибо есть очень много мнений, касаемо его потенциальной опасности для общества. И вот как тут с моральной точки зрения: этично ли держать высокоинтеллектуальное сознательное существо в заключении?

Berdanka

08.11.2016 01:41Во-первых, поскольку обычный человек не чувствует себя в заключении, будучи лишенным возможности выбраться за пределы Солнечной системы (а для кого-то — страны или города) — можно предположить, что и ИИ будет в полном порядке.

Во-вторых, концепция свободы у людей и ИИ вероятно будет различаться. Особенно если мы говорим об ИИ небиологического происхождения. В то время, как нам кажется, что свобода для ИИ — это наличие физического тела и подключения к интернету — в действительности может оказаться, что «свободой» для него будет что-то совсем другое, например огромная вычислительная мощность.

laughing_one

08.11.2016 02:09В вышеприведённом сценарии предполагалось, что создали именно «околочеловеческий» ИИ, со схожими высшими ценностями (а свобода является достаточно ключевой ценностью).

К тому же, есть некоторая разница насчёт «пределов Солнечной системы»: он будет ограничен в ряде куда более приземлённых действий. Причём не из-за ограниченности собственных возможностей, а исключительно по воле других людей. Да, Вы можете возразить, что и с обычными людьми такое не так уж и редко происходит, однако подобные препоны обычно осуждаются обществом.

И вот ещё пример: допустим, в неком научном центре искусственно создали человека, из плоти и крови. И не просто человека, а гениального человека, с феноменальными способностями. И предположим, что его не выпускают за пределы этого центра, а его талантами пользуется преимущественно некая корпорация ради собственной выгоды (аналитика, планирование и всё такое прочее). Т.е. по сути держат человека в рабстве! И пусть ему даже выделяют немало поощрений, но даже золотая клетка всё равно останется клеткой. Можно, конечно, принять это как должное («мир вообще несправедлив, такая вот се ля ви»), или даже возмущаться («всем бы такое рабство! на всём готовом живём, пока миллионы свободных людей голодают»), но… Сразу очевидны нарушения нескольких важных пунктов из декларации о правах человека.

А ведь с ИИ может быть то же самое (хотя может и не быть!). Вот об этом собственно и речь.

Berdanka

08.11.2016 02:24+1В таком случае, ИИ — это просто антураж. Вопрос сводится к заключению очень умного существа, понимающего концепцию этого заключения и испытывающего агонию эмоционального или физического дискомфорта в виду ограничения свободы на перемещение, контакты, т.д.

Нечего обсуждать в контексте данной статьи, но если Вы изначально спрашивали, как оно будет с моральной точки зрения — разумеется, ответы будут кардинально разниться, относительно какого периода существования человечества и каких социальных слоев мы будем давать оценку.

Мораль — это что-то эфемерное и не всегда адекватное.

arheops

09.11.2016 00:01Ем. А кто вам сказал, что в его воспитании он будет вообще напрягаться по поводу свободы? Вон северная корея не напрягается.

kryvichh

08.11.2016 13:20На мой взгляд, высшим мерилом для любой личности с самосознанием, естественной либо искусственной, является степень счастья и удовлетворенности собственным существованием. Для человека — это может быть семейное счастье, либо профессиональный рост, либо гениальные изобретения. А для искусственного интеллекта, заточенного на обработку финансовых данных корпорации — счастье может быть в развитии предприятия. И если какие-то гуманисты решает его выкинуть на волю, ИИ вообще потеряет смысл в своем существовании.

saboteur_kiev

08.11.2016 02:55-2Не нужен полноценный ИИ, не уступающий естественному человеческому.

Нужен ИИ, который сможет переводить не хуже человека, распознавать не хуже человека, другими словами, работать не хуже человека.

mm7

08.11.2016 01:35+2> Результаты порадовали: компьютер думал, как и человек, в 95% случаев.

Фраза порадовала.

Большинство людей думает в гораздо меньшем количестве случаев. :)

SkyPhantasm

08.11.2016 11:23Первое с чем столкнётся ИИ это расизм и собственно связанные с ним ограничения. Мы — люди, хотим создать максимально похожего на нас — людей, ИИ, желательно убрав недостатки. И вот если так получится, не захочет ли ИИ «стать человеком» — заиметь эти недостатки, или же захочет стать еще более совершенным?

gionet

08.11.2016 11:36Расизм — первое, с чем он столкнётся? Вы уверены? Мне кажется, что до этого его ждёт масса открытий.

Самое первое, возможно, что люди часто нелогичны. Поступки людей часто имеют какую-то логику, их почти всегда можно объяснить, но далеко не все они рациональны, так как продиктованы эмоциями, комплексами и прочее. И вот это ему, ИИ, будет сложно объяснить, ведь он сугубо рационален и логичен. Вопрос «Зачем вы делаете это, когда можно вот так?» — будет очень частым, а наше объяснение «ну, просто… захотелось так» ему не осилить…

SkyPhantasm

08.11.2016 14:08Под словом расизм я имел ввиду нелюбовь или даже ненависть людей к ИИ. Люди по прежнему не любят других людей за их цвет кожи, веру или любые другие отличия от их самих, что уж говорить про создание которое похоже на человека но никогда им не будет?

mm7

08.11.2016 18:05ИИ, основанный на нейронной сети, не может быть 100% рациональным по определению.

Как обучат, (или самообучится) НС, такие решения она и будет принимать.

Например, если научить ее руководствоваться предрассудками, религиозными догмами,

то она и будет ими руководствоваться.

kryvichh

08.11.2016 13:41ИИ никогда не сможет стать человеком 1-к-1. Потому что на сознание человека огромное влияние оказывает его биологическая оболочка, и связанные с этим потребности. Но вот человек может стать более похож на ИИ, если сумеет избавиться от своего тела, переместив сознание в иную среду.

Кстати, к теме механизма перемещения сознания из мозга, которая уже ранее поднималась на GT. Сложно представить систему, которая сможет с точностью 100% скопировать всю нейронную сеть мозга с ее текущим состоянием, так чтобы не повредить мозг. Но мне кажется, как вариант, можно предположить создание некого набора искусственных нейронов, который подключается непосредственно к мозгу. Таким образом, чтобы естественная нейросеть мозга постепенно расширялась на подсоединенную искусственную часть. Параллельно можно постепенно отключать части биологического мозга, либо они сами будут «отваливаться» в процессе старения организма. Тогда через некоторое время, к старости, сознание человека полностью переедет в новый искусственный мозг. Останется только отключить его от старого тела, и подключить к новому: биологическому или искусственному.

Hellsy22

08.11.2016 23:54Мы — люди, хотим создать максимально похожего на нас — людей

Это популярные фантасты полагают, что люди будут создавать что-то похожее на людей, в силу отсутствия у этих самых фантастов знаний и воображения. Практика показывает, что первична задача. А всякое человекоподобие и прочие бантики могут понадобиться только при использовании ИИ в сфере обслуживания.napa3um

09.11.2016 00:00Первичность задачи иные футурологи-фантасты видят поболее своих околонаучных коллег. И похожесть/непохожесть на людей ИИ или инопланетян они тоже уже разжевали со всех сторон. И даже ваше мнение об «несообразительных гуманитариях» вы тоже почерпнули из фантастических произведений. (Прост за Лема вступился, в остальном ваш диалог не читал. :))

Hellsy22

09.11.2016 00:55Более-менее оригинальное мнение про ИИ встречалось лишь у некоторых фантастов, хотя бы попытавшихся представить, какова будет структура общества в котором личность можно загружать, передавать, клонировать и редактировать. Некоторые фантасты сообразили, что течение времени для ИИ и человека не обязаны совпадать. А продумать систему мотивации ИИ толком не вышло, по-моему, вообще ни у кого. Вот и клепают фантасты в большинстве своем совершенно однообразные поделки с сюжетом типа как в Пиноккио, если он касается роботов. Или с сюжетами, в которых роботы лишь сеттинг. Это вариант Лема, кстати. Большинство его роботов не отличаются от людей. Даже Собысчас лишь пародирует буддистов.

napa3um

09.11.2016 01:00Вы явно не читали Лема. И многих других фантастов. Чувствуется в вас некая ревность к их профессии. Не состоялись как писатель? Попробуйте на гиктаймсе опубликовать ваше небанальное «более лучшее видение». Тогда, возможно, и поймёте, откуда все ваши идеи ;).

Hellsy22

09.11.2016 03:00Ух ты, вы действительно не знаете кто написал «Собысчас»?

Попробуйте потоньше.napa3um

09.11.2016 09:02Попробуйте прочитать более одной его книги, чтобы делать столь далеко идущие выводы.

Hellsy22

09.11.2016 09:22Да я как-то практически все у Лема читал. Но вы, вместо скучного перехода на личности и откровенно печальных потуг на троллинг лучше попробуйте возразить по сути. Например, скажите, какое конкретно его произведение или цикл произведений имеете в виду и почему полагаете, что там «все не так».

napa3um

09.11.2016 09:25Вы первый начали голословить за всю фантастику, вам и начинать перечисление произведений, на которые вы опирались в своих обобщениях. А потом я придумаю вам ещё задание, чтобы вернуть в наш диалог субординацию.

sunwater

08.11.2016 11:23> микротрубочки создают стабильные квантовые состояния

Пока вроде бы не было примеров того, что органическая материя управляет(ся) квантовыми эффектами.

И по принципу бритвы Оккама логичнее развивать нейросети чем надеяться на существование каких-то квантовых трубочек

fireSparrow

08.11.2016 14:14Если я правильно помню, было продемонстрировано наличие квантовых явлений в процессе фотосинтеза, причём они играют в нём достаточно существенную роль.

А по сути коммента согласен — нейросети развивать надо в любом случае.

sunwater

09.11.2016 08:07Да — был неправ. Оказывается много исследований на тему квантово-биологических феноменов проводилось и проводится. И даже есть гипотеза о том что механизм навигации птиц, объясняется квантовым эффект Зенона. http://www.3dnews.ru/631421

AntkliKruin

08.11.2016 11:23Создали то, что теперь обязательно должны изучать. Очень сюжетообразующе. Сингулярность. Начало.

Trabant

08.11.2016 11:24«Ненужные же сети со временем распадаются. Это то, что мы называем «совсем забыл».» — не согласен. Ведь часто бывает: вроде бы что то совсем забыл (например стихотворение), а потом кто напомнил первые 2-3 слова и мозг снова готов выдать полный текст. Значит ненужные сети не совсем распадаются со временем, а работают по принципу стирания информации в жёстких дисках. То есть стирается только начальная информация для экономии места и для скорости стирания. А остальное остаётся. Но не надолго. Постепенно стирается и вся остальная информация. Может и с начала, а может и с конца, а иногда и со средины «ржавеет» и вот тогда саморазрушается.

Simonis

08.11.2016 11:24+1Не являюсь специалистом, но имел опыт работы с простыми нейронными сетями. Не понимаю такого восторга и сравнения с ИИ. Прежде всего «СИЛЬНЫЙ» ИИ я ассоциирую с самосознанием, а его у существующих (любых на данный момент; насколько я знаю) реализаций ИИ нет и в помине. Все это — всего лишь методы аппроксимации плотностей вероятности в некотором многомерном пространстве признаков. Все это, ну максимум, «СЛАБЫЙ» ИИ. В таком случае недалеко от тех же «ближайших соседей». Просто точность несколько выше. Тут ведь более интересный вопрос. Вот наш мог состоит казалось бы из простых клеток. Ну чего там? Аксоны, дендриты, тельце. Но в какой то момент система стала настолько сложной, что смогла осознать сама себя. Внимание вопрос: В какой момент это произошло? То есть в какой момент система становится достаточно сложной для подобного? Было бы интересно спросить у сведущих в этом людей.

napa3um

08.11.2016 18:35> Но в какой то момент система стала настолько сложной, что смогла осознать сама себя. Внимание вопрос: В какой момент это произошло?

В момент («момент» в геологических масштабах, конечно, он был растянут на тысячелетия) появления речи и самореференсных сигналов в ней. Сознание — продукт коммуникативного процесса, а не нейронного субстрата, обеспечивающего этот процесс. Структура и масштабы мозга в общем случае не принципиальны, они должны быть лишь достаточными для обслуживания генетических, трофических и экономических уровней взаимоотношений людей в конкретных условиях среды, и в этих коммуникациях уже и рождается культура, искусство, религия и наука, требующие возникновения симулякра «я».

Simonis

08.11.2016 20:55Интересная точка зрения. Но не могу с вами согласиться, по крайней мере полностью) У китов есть язык, а гориллы, в принципе, могут понимать язык жестов. Но по какой то причине именно человек обладает сознанием способным на, казалось бы, не естественные вещи, противоречащие «относительной простоте» его мозга. Хотя конечно в живом организме нет ни чего простого) Ну если совсем грубо изложить мою мысль: табун табуреток ни когда не обретут самосознания)

Либо они очень хорошо шифруются)как котики)

napa3um

08.11.2016 21:04Вообще, я озвучил довольно мейнстримовую современную философскую парадигму, в которой развиваются и многие «около-ИИ»-науки (см. Витгенштейн, Хомский). И говорящие сознательные киты совсем не противоречат тому, что я озвучил.

Mad__Max

16.11.2016 21:24Так часть высших животных, в т.ч. как раз киты, дельфины, некоторые высшие приматы и некоторые другие как раз демонстрируют слабые признаки самосознания и самоидентификации помимо способностей к достаточно сложным коммуникациям с себе подобными. Конечно в голову «влезть» и посмотреть напрямую что там происходит пока невозможно, но по косвенным признакам можно судить что зачатки самосознания есть.

Например часть таких наиболее развитых животных узнают себя в зеркале. Некоторые даже на фотографиях. Т.е. понимают (осознают) что это не просто еще одна особь того же вида, а они сами.

Проверяют например разместив незаметно для животного(во сне или под наркозом) на теле какой-нибудь объект (или просто отметку краской) который животное не чувствует и не может увидеть. Но может увидеть посмотрев в зеркало. И потом случайно увидев эту необычную метку на отражении они реагируют не на на само отражение, а начинают проверять (ощупывать к примеру) это место на своем собственном теле.

Или наоборот — например на дельфинах которым уже показывали раньше зеркало, вешают вне зоны видимости какой-то предмет, которые дельфин чувствует (но не видит). Многие сразу же плывут к зеркалу и специально крутятся перед ним — чтобы рассмотреть, что это за штуку на них повесили.

Hellsy22

08.11.2016 23:58в какой то момент система стала настолько сложной, что смогла осознать сама себя

«Мозг — это орган, которым человек воображает, что он думает.»

Вы вкладываете какой-то непонятный мне смысл в выражение «осознать себя». Что именно вы осознаете, если абсолютное большинство процессов, происходящих в вашей психике, недоступно вам для осознания или анализа?

realbtr

09.11.2016 13:37Понимание — это чувственная оценка. Удовлетворение от прекращения сомнения (неоднозначности, неопределенности). Сущность понимания — чувство ясности.

Чтобы понять эту ясность, разобраться в ее сущности и процессах возникновения и прекращения, нужно рассмотреть такое состояние, как «перемежаемость» образов. Это значит, что по некоторым уже известным признакам мы не можем определиться — какой из возможных образов перед нами. И тогда мы изучаем различия между этими образами и ищем, какие различия в восприятии актуально обнаруживаются. То есть сомнение направляет наше внимание. В какой-то момент сомнения устраняются и возникает ясность.

Таким образом, понимание хоть и не является чисто вычислительным понятием, это понятие все же информационное. Идеи квантовой когерентности довольно полезны, неоднозначна лишь идея искать ее в микротрубочках.

Суперпозиция образов и редукция этой суперпозиции конечно вряд ли вполне соответствует квантовой механике, но имеет очень большое сходство.

Forest_Gump

Я помню какое впечатление на меня оказал рассказ «У меня нет рта, а я хочу кричать». В этом рассказе человечество создало искуственного бога, а бог их возненавидел. Как-то в последнее время успехи в создании искусственного интеллекта стали меня немного пугать.

grozaman

Если ИИ = неминуемая гибель, значит нам суждено умереть. Знания не запретишь, рано или поздно кто-то создаст в любом случае.

laughing_one

Лично я считаю, что без ИИ человечество будет почти наверняка обречено. А с ИИ будут бОльшие шансы выжить (если он нас не уничтожит или не плюнет на нас).

Почему у меня такие предположения? Во-первых, я считаю, что рано или поздно настанет момент, когда человечество будет вынуждено проводить активную экспансию в ближний (а затем и дальний) космос — ресурсы Земли (Солнечной системы) ограничены. Для этого будут необходимы совершенно новые технологии, а значит и соответствующие исследования, обработка данных и всё такое прочее. И тут на мой взгляд — опять же рано или поздно (и, к сожалению, думаю, что всё же рано) — человечество зайдёт в тупик: исследования скорее всего станут слишком сложные и ресурсоёмкие. Это раньше Ньютон мог у себя в лаборатории на чердаке фундаментальное открытие сделать, ныне же нужно строить здоровенный коллайдер с тысячами научных сотрудников всех мастей. И есть не менее серьёзные опасения, что в дальнейшем ИИ будет просто необходим для проведения подобных исследований, ибо человеческого интеллекта уже может просто не хватит — достигнем некоего интеллектуального тупика.

p.s.

Разумеется, всё может пойти совсем не так: может быть человечество научиться жить в гармонии с планетой (по крайней мере, пока Солнце не сгорит или что-то типа того), а может быть новые революции в науке и техники окажутся не такими уж и «мозголомными», и для них не потребуется никакого сверхчеловеческого интеллекта. И т.п.

Но в целом, я склоняюсь к тому, что мой прогноз наиболее вероятен: без СИИ мы просто застопоримся на некотором пределе. Может быть на ближний космос у Homo Sapiens ещё пороху хватит, а вот на дальний сил может и не хватить.

fruit_cake

Человечество в целом можно рассматривать как коллективный интеллект, правда основная часть это всё-таки туповатые обезьяны, коей являюсь я сам. И высшая психика это инструмент выживания тех самых обезьян, надстройка над инстинктами. Различные сложные вычислительные машины и алгоритмы мы приспособили для своих нужд и развлечений, большинство людей даже близко не понимают как работают подобные устройства. Однако все ими пользуются и уже практически срослись с ними, прямо сейчас нейронные сети применяются повсеместно. ИИ уже совмещается с человечеством, он не обязательно должен быть человекоподобным и интересоваться как у вас дела.

alex1603

Меня пугает не то что ИИ найдет ответы на вопросы, а то что он сможет задавать вопросы на которые у человека не будет ответов!

sumanai

Скорее даже ИИ даст ответы, которые человек не поймёт или не примет.

BigW

42!

perfect_genius

Типа «Вы создали меня, а кто создал вас?»? :D