Программа FakeApp

12 января 2018 года пользователь Reddit под ником Deepfakes выпустил программу FakeApp — приложение для замены лиц в видеороликах. За прошедшее время вышло несколько новых версий (текущая версия FakeApp 2.1 вышла 4 февраля) — и программа приобрела жуткую популярность. Количество скачиваний давно превысило 100 000. Особенно она понравилась любителям «клубнички», которые давно хотели увидеть в интересном положении свою любимую актрису или какую-нибудь другую целомудренную знаменитость.

Поддельные видеоролики с лицами знаменитостей получили настолько широкое распространение, что популярным видеохостингам пришлось принимать меры. Первым запрет на фейковые видеоролики ввёл известный сайт Pornhub — гигант мирового порно с посещаемостью 75 млн человек в день.

«Пользователи начали помечать такой контент, и мы удаляем его как только появляются жалобы, — сказал вице-президент Pornhub Кори Прайс (Corey Price) в комментарии Mashable. — Мы призываем всех, кто сталкивается с этой проблемой, посетить нашу страницу удаления контента, чтобы официально подать запрос».

Позже представители Pornhub уточнили свою позицию. В комментарии для Motherboard они сказали, что расценивают это как форму порно без согласия актрисы. А на сайте всегда блокировались любые типы видеороликов, когда участник явно не согласен на происходящее. Теперь к такого рода контенту отнесены и сгенерированные ИИ видеоролики с чужими лицами.

Хотя Pornhub формально запретил порно со знаменитостями, но в реальности на сайт ежедневно закачиваются десятки таких видеороликов. А скоро их качество повысится настолько, что станет очень трудно отличить: это реальное видео со знаменитостью или поддельное.

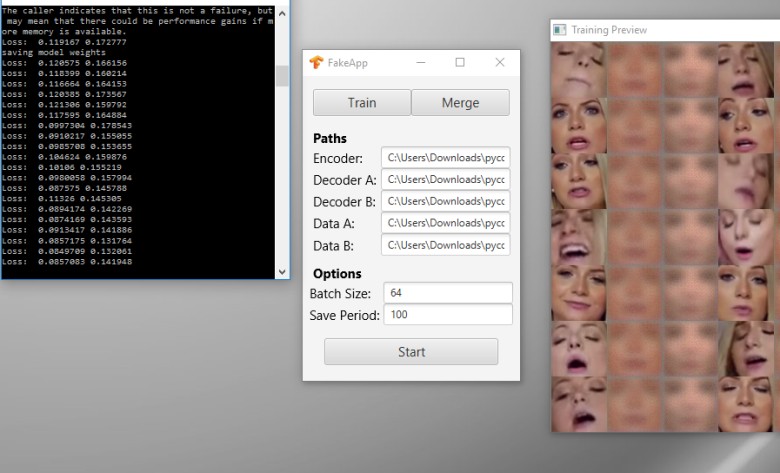

Deepfakes впервые показал результаты работы своей программы в декабре 2017 года. Тогда он ещё не выложил её в открытый доступ. Автор рассказывал, что наложение лиц осуществляется системой на основе нейронной сети, которая разработана с использованием различных свободных библиотек и фреймворков. В основном он сделал программу с помощью библиотеки Keras на бэкенде TensorFlow. Для обучения нейросети и составления подборки лиц знаменитостей достаточно поиска по изображениям Google, стоковых фотографий и видео с YouTube.

Структура нейросети похожа на ту, которая описана в научной работе исследователей из Nvidia. Их алгоритм может, например, в реальном времени менять погоду на видео.

Чтобы подделать лицо конкретной знаменитости, нужно обучать нейросеть конкретно на её видео и на порнороликах. После обучения программа способна подменять лицо на лету. В подреддите /r/deepfakes/ уже опубликованы тысячи таких видеороликов.

На видеокарте потребительского уровня обучение занимает несколько часов, на CPU может продолжаться несколько суток. Для работы нужна установленная среда CUDA 8.0. Обучение нейросетей уже давно стало доступной технологией, поиграться с которой может даже подросток.

Интересно, что кто-то может воспользоваться этой программой, чтобы скомпрометировать знакомую девушку и парня. Программе требуется два набора из нескольких сотен кадров с двумя лицами, которые будут заменяться. Кадры извлекаются из видеороликов командой

ffmpeg -i scene.mp4 -vf fps=[FPS OF VIDEO]. Затем нужно в программе указать путь к папкам с «моделями» — и продолжать обучение до тех пор, пока окно предварительного просмотра не начнёт показывать удовлетворительный результат.Многие люди добровольно выкладывают в социальные сети сотни фотографий и видеоролики со своим лицом. Этого будет достаточно для обучения нейросети.

Известные порнозвёзды отрицательно высказались по поводу использования этой программы и распространения поддельных видеороликов. Например, актриса Грейс Эванджелин (Grace Evangeline) сказала, что в индустрии всегда действует одно важное правило — согласие. А в данном случае осуществляется съёмка со знаменитостями без их согласия, что неправильно. Не говоря уже о том, что одновременно используется тело другой актрисы тоже без её согласия.

Специалисты по машинному зрению и Искусственному Интеллекту, считают, что подделка видео и фотографий поднимает серьёзные этические проблемы — поэтому следует поднять широкое общественное обсуждение на эту тему. Все должны знать, насколько легко подделать видео с чужим лицом. Раньше такое было доступно только профессионалам, обладающих мощными ресурсами. А сейчас это может сделать любой программист-одиночка.

Возможно, в будущем придётся изменить законодательство, чтобы защищать неприкосновенность не только физического тела человека, но и его цифровой личности и виртуального образа. За насильственные действия с виртуальным образом человека без согласия этого человека, возможно, тоже введут ответственность.

FakeApp 2.1 (торрент), 1,6 ГБ

Комментарии (187)

vassabi

07.02.2018 17:00хмм… я вот что подумал — а если с обратного конца подходить?

То есть — генерировать видео по его описанию, и тогда вместо базы данных с фильмами будет seed, с которого пользователь будет генерить себе «мягкое с блондинкой» или «жесткое с негром».

agat000

07.02.2018 17:09Игры такие вроде есть, с глубокой кастомизацией персонажей. А люди все равно смотрят видео. Люди не любят сложностей

KivApple

08.02.2018 11:24Тут скорее эффект зловещей долины. Графика в играх стала весьма хорошей за последние годы, но всё ещё недостаточно. Плюс помимо графики есть ещё и анимация движений персонажей, которая тоже может выглядеть неестественно.

Слишком высокие требования у потребителей такого контента (просто потому что главное воздействие оказывается на бессознательное, которое очень хорошо обучено находить зловещую долину), что пока дешевле и быстрее снять видео с настоящими людьми.

К тому же хорошая графика требует достаточно дорогого железа…

inferrna

07.02.2018 17:12Скажем, технически возможно такое: снимаем плохую 3d анимацию «лишь бы хоть что-то», а потом на наших болванчиков натягиваем лица голливудских актёров. Да и вообще, можно будет что угодно натянуть — дома, деревья, поля и реки, леса и горы, автомобили… Короче, снимать голливудское кино, натягивая на плохие рендеры объекты реального мира.

Hardcoin

08.02.2018 03:21В плохой анимации будет плохая физика и неуклюжие движения. Исправлять движения нейронки пока не умеют.

inferrna

08.02.2018 08:25плохая физика

прикрутить bullet

неуклюжие движения

ладно, уговорили, движения болванчиков тоже поручить нейронке — если такого ещё нет, то скоро сделают.

Alexey2005

07.02.2018 17:15+1Нет никаких этических проблем. Есть лишь непомерная жадность некоторых людей, которые почему-то искренне уверены, что всё, к чему они хоть раз приложили руку, отныне и навек принадлежит им, даже если они давным-давно это продали, а все остальные теперь обязаны на каждый чих получать нотариально заверенное разрешение.

SirEdvin

07.02.2018 17:21Справедливости рады — вы не правы.

Преположим, есть девушка А, которая недавно отказала парню в свидании. Озлобленный парень решил нагенерировать десятки порно с ее участием и разослать ее друзьям, родителям и коллегам.

В итоге жизнь девушки будет разрушена, так как далеко не все будут задумываться о том, фейк это или нет.

Ну и мне кажется, что делать порно с изображениями людей, которые против этого в целом немного нехорошо. Это пока есть шумиха и пока это знаменитости все над этим смеются. А как только явление станет немного более массовым, будет хуже.Alexey2005

07.02.2018 17:32+3Как только явление станет достаточно массовым, все к нему привыкнут и просто перестанут верить подобным видео. Даже наоборот, у человека, пойманного на горячем, всегда будет отмазка, что это сгенерированный фейк.

Кроме того, порно с изображениями любых людей научились делать сотни лет назад, для этого надо всего лишь уметь рисовать. Такая замена лица в общем-то мало отличается от рисования, просто основную работу делает машина. Вместо этой самой машины вы могли бы пойти к художнику, показать ему исходное изображение и новое лицо, которое там надо поставить — и за соответствующую плату он выполнил бы задание.

Но мне почему-то казалось, что это только в детском саду бросаются друг на друга с кулаками и криками, увидев в тетрадке кривую рожу с надписью «это Лена».

SirEdvin

07.02.2018 17:46Ну, тут как бы есть два момента:

1. Это будет довольно дорого, а значит обычный обыватель сделать так не может.

2. А для необычных обывателей есть проверка фактов и экспертиза.

Вы не учитываете, что большинство людей не будет заниматься проверкой фактов и вопросами «а так это или нет». Замечательный пример тому — мем про «первого русского я убил в 16 лет», которая приписывается человеку, который ее никогда не публику не говорил и записей с тем, что он ее говорит тоже нет.

TheShock

07.02.2018 23:431. Это будет довольно дорого, а значит обычный обыватель сделать так не может.

Сейчас в фотошопе можно пририсовать чужую голову к порно-телу практически бесплатно и невероятно качественно. И что — сильно люди покупаются на такие фотографии?

Hardcoin

08.02.2018 03:24Если жизнь девушки будет разрушена, потому что её близкие не будут заниматься проверкой фактов, это печально. Но почему-то кажется, что её жизнь рядом с такими близкими будет разрушена и без фейкового порно.

boootloader

08.02.2018 10:17Жизнь в таких ситуациях рушится скорее не из-за близких, а из-за коллектива и руководства на работе, в вузе и т.п. Многие ли люди смогут абстрагироваться от увиденного образа, особенно если происходящее в ролике далеко от общепризнанных норм (даже в весьма раскованных обществах)? У нас технологии развиваются намного быстрее мозга и интеллекта.

Даже если полностью отбросить довод о разрушении жизни. Далеко не все люди — высокопримативные экстравертивные мачо (или их женские аналоги), которым совершенно плевать (или даже будет приятно), если порно с ними, подлинное или поддельное, попадет в широкий доступ. Думаю, достаточно людей, достаточно брезгливых и не особо любящих секс, которым будет неприятно, да попросту очень противно видеть себя в такой роли, отвечать на бесконечные вопросы и т.д. Только не надо путать некую брезгливость и разные степени асексуальности с ханжеством и моралофажеством. Мир многогранен.

Hardcoin

08.02.2018 10:44Да, проблема, но она не сильно больше, чем с поддельными фото. С изначальным утверждением, что нет никаких этических проблем, я не согласен. Есть, но не очень большая. Наказание за обман в целом должно быть. И за фальшивое видео и за фото и за статью в газете с враньём. Но большинство людей считает, что враньё — нормально. Так что в среднем остаётся как есть. А случаи с видео будут так же редки, как и с фото.

firk

07.02.2018 20:39> все к нему привыкнут

Не надо к такому привыкать.KivApple

08.02.2018 11:36Надо. Иначе как такой шоковой терапией общество не отучится судить о людях по нерелеватным для поставленной задачи характеристикам. Сколько карьер было разрушено из-за того, что становилось известно, что человек имеет какие-то необычные сексуальные предпочтения? Хотя казалось бы, как это влияет на его интеллектуальные или организаторские способности?

Если в области подобных «компрометирующих» материалов будет хаос, то приватности только прибавится.

Cast_iron

07.02.2018 21:58Лично Вы готовы увидеть на любом порно- и не только сайте себя или близкую Вам женщину в видео, которое может подмочить репутацию, созданное умышленно?

Ниже некоторые ратуют за свободу в Интернете… По-моему свободу путают со вседозволенностью. Я против запретов в Сети, но за слова и поступки надо отвечать.

vintage

08.02.2018 09:14Я готов. Хотя бы в порно у меня будет близкая женщина :-)

Mikhail_dev

08.02.2018 13:50Угу, или близкий темнокожий мужчина.

P.S. пойду ка вконтакте почищу «немного»

TBox

09.02.2018 11:04>за поступки надо отвечать

Надо

>но за слова

Не надо. Слова это просто слова. Картинка в интернете это набор пикселей. А вот кулак в челюсть, это больно и за это надо отвечать.

И это, табу на секс просто огромная глупость. Обычное естественное занятие превратили в какой-то мистический греховный ритуал. На экране кровь, кишки, расколбасило, ничего, смотрим всей семьей. На экране начинаются поцелуи, всё, детишкам пора баиньки.

А потом удивляемся, откуда столько насилия.

Если что, порно со своим участием не боюсь. Как и фотожаб.

Впрочем, моего лица в сети практически и нет. Как говорится, береги личные данные смолоду.

Farxial2

08.02.2018 06:28Как только явление станет достаточно массовым, все к нему привыкнут и просто перестанут верить подобным видео. Даже наоборот, у человека, пойманного на горячем, всегда будет отмазка, что это сгенерированный фейк.

Перестанут верить те, кто знает о технологии. Но можно показывать такие видео тем, кто не знает о технологии (бабкам на скамейке etc.).

gohan

08.02.2018 07:40Но мне почему-то казалось, что это только в детском саду бросаются друг на друга с кулаками и криками, увидев в тетрадке кривую рожу с надписью «это Лена».

Ну например ещё лет 30-40 назад за кривую рожу в тетрадке с надписью «это Ленин» можно было огрести совсем не от детсадовцев, а от более опасных личностей. И не то чтоб в современном мире любые неприятные картинки вам сойдут с рук.

ToshiruWang

08.02.2018 10:55Проведите эксперимент — сделайте фотофейк с собой (даже корявый) и пошлите, например, родителям анонимно. Они, конечно, увидят что фейк (возможно, не сразу), но «осадочек останется». Если уж без всякого фото и видео люди верят очевидным фейкам и тельавизора, то уж картинке поверят точно.

Turic

07.02.2018 17:33+2В данном случае, порнография — это такая мелочь. Взрослых людей не должно волновать что и как другой взрослый делает в своей постели, выставляет ли это напоказ — это личное дело и поддельный ролик должен так же восприниматься, в духе «ну и что?».

Другой момент, что с современной истерией по некоторым поводам, даже ничего не значащим (например, высказывание личного мнения в твиттере и последующее увольнение), может получиться интересная коллизия, когда в ролике можно нафантазировать такого, от чего действительно не отмыться. Вспомним ту грязь, что лилась на того же Трампа пару месяцев назад, ну хотя бы ту же историю про проституток в номере. Придумываем историю, снимаем с похожими актерами на нужных ракурсах кадры (нейросеть не научилась пока что качественно менять лицо, если есть какой-то предмет на переднем плане или ракурс не совпадает), вываливаем в интернет — и все, тут уже будь это 100 раз неправдой — инфоповод будет работать.

Я не удивлюсь, что сейчас какой-нибудь политик, скажем, английский, заявит, что не сношался со свинями, как ему это приписывают, а стал жертвой подделки видео. И вся любовь.

DrZlodberg

08.02.2018 08:57Другой момент, что с современной истерией по некоторым поводам, даже ничего не значащим (например, высказывание личного мнения в твиттере и последующее увольнение)

Да ладно, даже делать ничего не нужно.

Кто не помнит — руководитель миссии Розетты и его рубашка.

Kwisatz

07.02.2018 22:44Я дико извиняюсь. А что такого особенного в съемках в порно, что жизнь будет разрушена? Нет я понимаю что так оно и будет, но не совсем понимаю почему.

SirEdvin

08.02.2018 00:26Мне лично — ничего. Но вот есть большое количество людей, для которых это повод затравить или перестать общаться с человеком. Можно погуглить по «травля за порно».

Почему? Ну, потому что это АМОРАЛЬНО, БОЖЕНЬКА ПОКАРАЕТ и прочее.

markmariner

08.02.2018 16:31Ну например, стали бы вы встречаться с девушкой, если бы знали, что она снималась? Смогли бы вы поверить, что прямо сейчас она не спит с кем-нибудь на камеру или за деньги? Быть может, она просто не рассказывает это вам. Даже если с моральной точки зрения вам всё равно, остаются ИППП и то, не будете ли вы воспитывать чужих детей.

Или положим, отдадите ли вы своих детей в школу к учительнице, которая снимается в порно? Не будете ли вы опасаться, что она сформирует положительное отношение к съёмкам у ваших детей?

Поддержите ли вы друга в его отношениях с девушкой, если найдёте порно с ней в интернете, а он об этом не будет ничего знать до этого?

Kwisatz

08.02.2018 17:361. Да. Для меня важнее честность и разумность. Мне вот дико смотреть как знакомые встречаются с девушками жрущими мозг совковыми лопатами.

2. Однозначно да, не буду. В вас не смущает что половина учителей в школе самоутверждается за счет детей? Я лично с начальной школы не перевариваю олимпиады, с тех же пор перестал прикладывать усилия к учебе, потому что был сеанс криков и унижения за какую то хрень вроде второго места вместо первого.

3. Поддержу. Не всем везет найти себе вторую половину, зачем это рушить? Тем более что у меня есть друг который уже вотнулся не раз в тот факт, что счастье все таки в неведении. К тому же порно может быть из категории «порно из мести». Говорить или нет это сложный вопрос на отдельную долгую и сложную дискуссию.

jrthwk

08.02.2018 13:091. Если жизнь человека в обществе можно разрушить написав на заборе «NNN — дура!» — то это значит что не патрули у заборов организовывать надо; это значит что надо лечить сумасшедшее общество, для которого настолько важны надписи на заборах.

2. Это хорошо что такие вещи появляются и это здорово что оно становится массовым. Всё что обесценивает цифровую слежку — хорошо и правильно.

neomedved

07.02.2018 17:27+1То есть, по-вашему, людям не должно принадлежать их собственное лицо?

Alexey2005

07.02.2018 17:37Собственное — должно. А копия-то лица с чего вдруг?

А уж конкретно тем, которые сейчас возмущаются, так и оригиналы лиц давно не принадлежат — ведь актёры давно продали все права на них соответствующим студиям, подписав многолетний контракт и получая деньги за съёмки. Так что по идее возмущаться должны бы правообладатели, но уж никак не те самые актёры.

SirEdvin

07.02.2018 18:16Вы так говорите, как будто лицо и копия лица отделяются, и если копия вашего лица в чем-то участвует, то оно никак на вас не повлияет. К сожалению, это далеко не так, как минимум, общество не готово так мыслить. Потому это и этическая проблема.

Veddary

07.02.2018 18:31Опушу в сторону этические проблемы, но позволю себе заметить, что лицо вполне себе отделяется. Если вы помните фильм «Терминатор: Да придёт спаситель», то там шварца вполне успешно играет его цифровая копия…

Welran

08.02.2018 07:21Вы же в курсе, что гонорар за это получила не цифровая копия, а сам Арнольд?

Veddary

08.02.2018 10:03Конечно. Тем не менее я запросто могу представить ситуацию, когда актер разрешает компании использовать свой цифровой образ для окончания съемок фильма по завещанию, а денежные средства за это получат его наследники или какой-нибудь фонд.

Welran

08.02.2018 16:25Видимо так и будет. А потомки Харрисона Форда будут продлевать срок использования образа всё больше и больше :).

dartraiden

07.02.2018 18:21+1Так оно уже не совсем принадлежит. Если я с согласия человека сделал его фото, то, по нынешнему законодательству, права на это фото у фотографа (меня), а не у изображённой персоны.

Я могу это фото передать в общественное достояние, после чего любой может из этого изображения извлекать даже коммерческую выгоду (допустим, печатая и продавая постеры).vassabi

07.02.2018 20:50а потом нельзя будет фотографировать на улице без того, чтобы копирасты не вчинили из за нелегальную копию чьего-то лица?

DrZlodberg

08.02.2018 09:02Право на фото — да Но есть вроде бы ещё право на распространение. Т.е. владеть можете, а вот распространять — нет. (не помню точно, как оно там формулируется).

Metus

08.02.2018 09:06Это что такое за «нынешнее законодательство»? Откуда вы это взяли? У нас есть закон о защите изображения человека.

1. Согласие на съёмку человека не нужно получать.

2. Такое «согласие» по получение изображение не даёт вам каких либо прав, т.к. оно изначально ничего не значит.

3. Текущий закон в РФ регламентирует использование изображения человека, а не получение. Об использовании Вам и стоит договариваться, а не о съёмке. Желательно в письменном виде.

DrZlodberg

08.02.2018 09:00Тут немного сложный вопрос. Как на счёт двойников? А как на счёт моделирования/рисования похожего (случайно?) лица? Сетка же не лепит туда фотографию, а рисует, на основе неё.

neomedved

08.02.2018 09:43Но в данном случае этой проблемы нет, никто, включая создателей видео, не пытается отрицать, что это именно лица актёров.

DrZlodberg

08.02.2018 09:54По факту даже тут это всё-таки «произведения на основе» лиц актёров, а не приставленная из другого видео голова. А подписать вообще что угодно можно. Собственно вроде и раньше подписывали порой известными именами похожих… хм… актрис :)

Ну а если станут действительно давить — будут просто подписывать по другому и всё. Ну или напишут, что видео на основе лица двойника. Всё-таки лицо (за крайне редкими исключениями) не уникально. Если оно «принадлежит» кому-то одному — это ещё не означает, что оно его не может иметь кто-то другой.

Owyn

07.02.2018 17:16+2Т.е. мультики тоже все оттуда удалят? Рисованные персонажи то не давали своё согласие чтоб их нарисовали…

ValdikSS

09.02.2018 01:51Я тут недавно узнал, что Pornhub — не порносайт, а сайт с порнографическими видео, в числе прочих. Такой youtube с порно.

Тут есть и детские телешоу, и мультики, и russian youtube poop с мемами, и рестлинг, и Barbie Girl в исполнении русских солдат, и корейские музыкальные видео.

Что интересно, через поиск найти не-порнуху очень сложно. Полная противоположность youtube, с интересными комментариями и адекватными комментаторами.

FluD

07.02.2018 17:21хотел бы увидеть приложение на основе этой нейросеточки, что превращает скриншоты из игр в реальные фото

DrZlodberg

08.02.2018 09:08Кстати такое уже было давно. Найти не смог.

Были какие-то новости про обученную нейронку, которая дорисовывала крупнопискельные картинки из игр. И про сетку, которая по схематичной картинке генерила фото. А для современных игр с их графоном это уже не так актуально.

edb

08.02.2018 19:57в кино Бегущий человек 1987 года можно посмотреть. Там Арнольда превращали в злодея.

crazyv

07.02.2018 17:21+1Как мне кажется, эта история — готовый сюжет для серии из следующего сезона сериала Black Mirror. И это только начало. Следуя логике, человека можно «утопить» в жизни совсем просто. И не только знаменитостей.

Ну конечно же обратный эффект гарантирован: зная что подделки стали на столько хороши, имея реальные прецеденты, можно будет с легкостью доказать, что на самом деле это не я избиваю человека на этом видео — меня подставили)

Да, есть определенная цифровая защита (которая возможно будет усовершенствована), которая позволяет идентифицировать источник съёмки и уникальный зашифрованный код конкретной камеры. Но качественную эмуляцию с учетом постоянного усовершенствования производительности никто не отменял.

Turic

07.02.2018 17:39Качественную фотографию никак не отличить от качественного фотомонтажа, можно только делать предположения и дополнять их другими фактами. Сейчас нейросеть не идеальна и ее косяки видны, но пройдет пару лет — и видео так же будет неотличимо. А записать защиту в видеокамеру — нереально. Все, что можно перезаписать — можно заменить, тут ничего не придумать.

А для Черного Зеркала можно другую историю придумать, поинтереснее — как возникают, скажем, беспорядки из-за очередного убийства чернокожего, которое показывают в прямом эфире. При этом в реальности поток стрима сразу же меняется на поддельное с помощью нейросети. Серия про синего медведя покажется детским садиком.

nidalee

08.02.2018 15:15А записать защиту в видеокамеру — нереально.

Почему? Просто сертификацию камер введут и все. Навскидку: сертифицированные будут писать файлы и отправлять хэши куда надо для последующих проверок. Возможность отдавать снятое «на лету» отключат, дадут только отдельные, уже записанные файлы смотреть.

masv

08.02.2018 15:34-1куда надо

Защита от коррупции там «где надо» тоже должна быть.

Лично я «им» не доверяю.

nidalee

08.02.2018 15:40-1Тех, кого можно обвинить в коррупции, в этой стране вы все равно не посадите, с защитой камер и без.

А вот в бытовых «он на меня наехал, и битой себя избил сам потом» — вполне поможет.

А запись видео с камер наблюдения мимо «них» вы и сейчас не получите, максимум — в реалтайме.

ArVaganov

07.02.2018 18:43+3Уже давно существует Photoshop. В нем пользователь даже с небольшим опытом может фотографию любой актрисы приделать к телу так, что отличит только профессионал. Почему никто в ужасе еще не паникует? Чем фальшивые фотографии/фотожабы отличаются от фальшивых видеозаписей? Кто ценит свою личность и безопасность — сохраняет анонимность и не выкладывает биометрику в интернет. А кто выкладывает о себе всю информацию в интернете, включая фотографии (сотни, тысячи фотографий?) и видео, пусть не удивляется найдя внезапно фотожабы и порноролики со своим участием.

Нужно понимать, что если будет принят регулирующий фейковые видео закон — это будет еще один шаг в сторону регулирования свободы в сети. Сначала видео, потом суды за комментарии, потом запрет анонимности, потом вход в интернет по паспорту, дальше «1984».

Garruz

07.02.2018 22:43А кто выкладывает о себе всю информацию в интернете, включая фотографии (сотни, тысячи фотографий?) и видео, пусть не удивляется найдя внезапно фотожабы и порноролики со своим участием.

Ну что ж теперь, всяким актёрам/актрисам и прочим фотомоделям – вообще не сниматься? А если сниматься – то как им сохранить репутацию после каких-то «особо острых» фейковых видео? Ладно бы ещё безобидное порно – но если их лица так же прилепят к съёмкам каких-либо преступлений?

И, с другой стороны… Если сейчас закрывать глаза на подобные «шалости» – то как в будущем вообще отличать настоящее видео от фейкового? Тогда любой виновный, заснятый на видео, всегда сможет сказать, что «это монтаж» – и попробуй докажи…

еще один шаг в сторону регулирования свободы в сети

Не надо путать свободу с безответственностью. Это разные вещи, всё же…

Hardcoin

08.02.2018 10:36Люди закрывают глаза на фейковые новости. Никакой уголовной ответственности, никаких запретов. При этом фейковую новость сделать — даже Фотошоп не нужен. После особо острых фейковых новостей они же умудряются сохранять репутацию? Видео, кроме своей необычности, ничем не отличается. Будут давать опровержения и судиться. Все как сейчас.

Garruz

08.02.2018 20:08Немного не соглашусь.

Видео, всё же, отличается от новостей – тем, что в него больше верят. И даже сейчас достаточно всего лишь «творческой» нарезки выдернутых из контекста кадров, чтобы сотни тысяч поверили в самую лютую хрень и самый лютый фейк.

Но то просто нарезка – на которую при желании всегда можно предоставить полную версию, «без купюр».

А вот в случае с наложением лиц и прочей крутотенью – это уже совсем другая песня. Уже даже не «творческая нарезка», а заведомая фальсификация. Согласен, пока ещё этот момент мало регулируется. Но со временем, уверен, и такое будет наказываться, ИМХО…

KivApple

08.02.2018 11:45Есть вариант производства особых сертифицированных видеокамер, которые подписывают все видео с таймстампами цифровой подписью. При этом, разумеется, конструкция предполагает невозможность извлечения ключей шифрования. Есть же всякие аппаратные криптотокены, которые ломай-не ломай, а ключи не вытащишь. Ну разве что каким-то очень дорогим оборудованием и высококвалифицированным персоналом. Но с такими условиями уже сейчас можно делать 100% натуральные фейки, так что ничего не изменится.

И именно такие девайсы использовать во всех ответственных местах.

Norno

08.02.2018 13:12А можно примеры указанного оборудования? Вот чтобы прямо совсем никак не подделать? Я знаю про Canon и фотографии, но у них не получилось (Canon Original Decision Data habrahabr.ru/post/109396 )

masv

08.02.2018 14:25Тогда просто «сертифицированными» фейками смогут заниматься властьимущие, для более лучшей пропаганды в СМИ.

Alexeyslav

08.02.2018 15:27И часы на камере не переведёшь… никак. Ибо если есть возможность сменить время то это открывает широкие перспективы для снятия роликов «из будущего» или «прошлого». И ведь честно подписаны будут. Или каждую минуту ключи менять путем обновления через интернет с авторизованных серверов?

masv

08.02.2018 14:12Не надо путать свободу с безответственностью. Это разные вещи, всё же…

Вот бы ещё законотворцы это осознали, а не как сейчас:

– У нас в стране свобода слова!!!

– Слово свободно, а вы пройдемте.

i8008

08.02.2018 07:40Полностью согласен. Просто о возможности легко подделать фото в Photoshop знают уже все, а о возможности также легко подделать видео – пока еще не все. Уверен, что скоро все будут относится к таким видео как к «фотожабам» и эта истерия пройдет

Кто ценит свою личность и безопасность — сохраняет анонимность и не выкладывает биометрику в интернет.

А вот здесь не согласен. Даже если вы не вкладываете свои фото – за вас это сделают другие (друзья, коллеги и т. д.)

Garruz

08.02.2018 20:17Уверен, что скоро все будут относится к таким видео как к «фотожабам» и эта истерия пройдет

Тут главная опасность не в «истерии» – а в том, что теперь вообще считать достоверными доказательствами. И как бороться с фальсификацией таких «лже-пруфов».

Поэтому не стал бы настолько спокойно относиться к этой теме. Это пока ещё на видео местами видно, что монтаж (по крайней мере, опытным взглядом). А пройдёт лет 5-10, алгоритмы усовершенствуются, и…

kartvladek

07.02.2018 19:01На видеокарте потребительского уровня обучение занимает несколько часов, на CPU может продолжаться несколько суток. Для работы нужна установленная среда CUDA 8.0. Обучение нейросетей уже давно стало доступной технологией, поиграться с которой может даже подросток.

Это сильно вряд-ли насчет поиграться да подросток… Запуск сопровождается необычными ошибками, да и время на обучение может затянуться на весьма продолжительный период. Ну и терпения автору побольше — нарезать клипы на кадры и добиться приемлемого результата после сборки тоже не каждому дано

humanelement

07.02.2018 20:40А на сайте всегда блокировались любые типы видеороликов, когда участник явно не согласен на происходящее.

Что?

Но ведь на сайте просто огромное количество настоящих voyeur роликов. Из душевых и прочее.

DracoL1ch

07.02.2018 20:43+1«Настоящих» как отечественные сыры по 100 рублей

humanelement

07.02.2018 20:47Спасибо за сарказм, но я именно про настоящие. Любитель вопроса понимает все нюансы. Вплоть до того, каким автором, и где это было снято. Есть же целые серии.

UJIb9I4AnJIbIrUH

07.02.2018 22:24Дайте угадаю, у вас как раз есть друг, являющийся любителем вопроса?

humanelement

07.02.2018 23:53+1Это я сам, и мне нечего стесняться. Это мой любимый жанр.

Кстати, в полной мере он раскрыт только на закрытых сайтах. А на порнхабы и порнолабы попадают обрывки.UJIb9I4AnJIbIrUH

08.02.2018 00:19Да вас никто и не осуждает, это же просто стандартная шутка для данного сабжа :)

Garruz

07.02.2018 22:27-1ИМХО, тут единственное спасение от такой напасти – со стороны разработчиков видеоформатов (и производителей техники, конечно же). Чтобы каждое видео непременно сопровождалось метками о том, что оно действительно оригинальное и не подвергалось сколь-либо серьёзной обработке.

Грубо говоря, нечто вроде покадрового хеширования видеоряда (можно даже с каким-то определённым шагом и приемлемым «упрощением», для снижения нагрузки) – что в сумме должно занимать не так уж много ресурсов и объёма, с учётом современных мощностей.

Для обычных обработанных видео это будет совершенно прозрачно (да и вообще несущественно), а вот для таких «типа компроматов» – можно будет сразу же обнаружить палево…

Kwisatz

07.02.2018 22:51Во первых после съемки сырой материал никто потребителю сразу не выкатывает. Все монтируется. Да и даже если бы вот прям с камеры ролики были, кто мешает воспроизвести все тоже самое, что делает камера? И самый важный вопрос: зачем?)

Garruz

07.02.2018 22:59-1Именно с учётом последующего монтажа и написал про хеширование не всего видео полностью, а покадрово (либо по каким-то ключевым кадрам).

А на вопрос «кто мешает воспроизвести все тоже самое, что делает камера» ответ уже есть. То самое хеширование (если вам, конечно, знакома сама суть этого слова).

Mogwaika

07.02.2018 23:01Вам и предлагают заново перехешировать после фотошопинга и компрессии.

Garruz

07.02.2018 23:36Но тогда не совпадёт с хешами исходного видео – которые должны быть вшиты «намертво». Что автоматически будет маркироваться как «фейк».

И тогда, чтобы «заново перехешировать» – вам надо будет как минимум знать алгоритмы хеширования конкретного производителя и/или конкретного устройства. А с учётом того, что информацию можно не только писать во всякие аналоги exif-ов, но и «подмешивать» в общий видеоряд (причём, практически незаметно) – думаю, это не будет настолько уж простой задачей, как кажется…

P.S. Разумеется, даже это вовсе не «абсолютная панацея». Теоретически можно обойти что угодно. Если кто-то действительно задался большой целью напакостить – он всё равно это сделает.

Но при таких мерах – как минимум, для этого потребуется на порядки больше усилий и стараний. Что сразу же отсеет большинство «тупо-шутников»…

TheShock

07.02.2018 23:56Но тогда не совпадёт с хешами исходного видео

Какого исходного видео? С камеры я его удалил, сама камера случайно под каток попала, но вот такая вот удача — видео где я и Галь Гадот в городки играем я скопировал на компьютер. Видите, все корректно хешировано — видео не поддельное.

Garruz

08.02.2018 00:11Какого исходного видео?

Того самого, на котором камера проставит свои метки о том, что снято именно на неё (модель X производителя Y, возможно даже серийный номер Z) и именно в такое-то время.

Причём, как уже говорил – метки возможно подмешивать даже в сам видеоряд, незаметно для глаза.

Будете сильно редактировать – метки неизбежно нарушатся, ни один плеер не сможет правильно их прочитать. Соответственно, в любом плеере, поддерживающем такой тип верификации – видео хоть и проиграется, но автоматически попадёт в разряд «сомнительных источников» (как минимум).

Попытаетесь «перехешировать» – новые метки всего лишь подмешаются к старым, читаться всё равно не будет. Опять «сомнительный источник».

Mogwaika

08.02.2018 00:16Вы наверное хотите ставить цифровую подпись, а не просто хэш. Но тогда никакого монтажа или перекодирования… Т.е. никакой обработки совсем.

Плюс никто не мешает сделать экранку ну или подмешать цифровой поток между сенсором и процессором, если сенсоры не начнут шифровать сырой поток, ну и так далее…

Garruz

08.02.2018 00:37-1Вы наверное хотите ставить цифровую подпись, а не просто хэш.

Тут, скорее, сочетание получится – сначала хешируется кадр в целом (по определённому алгоритму), потом этот же хеш со всеми необходимыми параметрами прописывается-«подмешивается» в сам кадр, только потом кадр непосредственно записывается.

Т.е. никакой обработки совсем.

Кодировать можно по массе параметров (см. «стеганография») – от яркости или оттенка отдельных пикселей и вплоть до какого-нибудь более сложного искусственного шума.

Глаз этого не заметит. И при обычном линейном монтаже всё сохранится на каждом настоящем кадре. Но вот при более серьёзном редактировании (то есть, при грубом нарушении хеша исходного кадра) – неизбежно потеряется.

hssergey

08.02.2018 09:03История защит DVD, блюреев и т.п. доказывает, что все можно подделать, ключи украсть или подобрать. Была бы потребность. А если дело будет стоить того, потребность будет.

Norno

08.02.2018 10:32Попытка реализовать подобное для фото(!) была предпринята Canon (продукт Canon Original Decision Data). Предполагалось что система сможет подтвердить оригинальность сделанного снимка (RAW). Но, даже если не учитывать возможность снять игровую сцену, макет, или переснять изображение, систему взломали, что позволило выдавать за оригинальные изображения любые.

Несколько подробнее habrahabr.ru/post/109396

Garruz

08.02.2018 19:35Справедливости ради, во всяких DVD и прочих блюреях защита была достаточно стандартная, без таких заморочек.

Но, в любом случае, даже если защита будет достаточно простой – даже это уже значительно изменит «порог вхождения» для основной массы «шутников»…

qw1

10.02.2018 01:58Пока очередной шутник не выложит в паблик программу-ломалку, распечатав её на футболке )))

TheShock

08.02.2018 01:46Попытаетесь «перехешировать» – новые метки всего лишь подмешаются к старым, читаться всё равно не будет. Опять «сомнительный источник»

Я беру гипотетическую китайскую камеру от Ксяоми, которая снимает несжатое видео на ССД диск без всяких меток. Снимаю на него милые посиделки с милой девушкой за 100 долларов в час.

Потом закидываю его в CoolHackerVideoEditor, подставляю в видео лицо Галь Гадот. После этого беру те же алгоритмы, которые использует iCamera от Apple и кодирую видео с Галей всякими метками, серийными номерами, добавляю метки даже в видеоряд.

И вот «источник подтвержденный лично компанией Эппл, а Галь Гадот, оказывается, та еще штучка»

Garruz

08.02.2018 19:30-1Так в том-то вся и фишка, что «штампы» могут (и должны) подмешиваться в самом процессе съёмки – генерируясь по огромному количеству как программных, так и аппаратных параметров. И тогда уже никак не удастся их «сфейковать» – просто физически не получится воспроизвести все вводные данные (которые априори неизвестны). А без аутентичных вводных данных – не пробьются итоговые хеши.

В качестве грубого примера из «смежной области» – вспомните, например, как работают «труъ-рандомайзеры» (аппаратные), на каком количестве случайных и невоспроизводимых данных там замешаны алгоритмы.

TheShock

08.02.2018 19:41Ваша «фишка» работает только в сферическом мире, в котором есть исключительно производители камер, которые вставляют шифрование. Вы понимаете, что для многих целей (ну, например, съемка фильма) это просто вредно. Всегда будут камеры, которые не вставляют такие метки, а значит можно работать с немеченым видео, а потом его метить и вся ваша «фишка» летит коту под хвост.

Garruz

08.02.2018 19:59-1Почему же?

«Немеченное» видео и не будет содержать в себе никаких вводных данных. А если вы будете пытаться генерить их искусственно – опять же, не пробьются хеши.

А видео совсем без меток и без хешей – так и вовсе можно по умолчанию помечать как «сомнительное».

Можно, конечно, искусственно генерить совсем левые данные, чтобы вышли совсем произвольные хеши – но это лишь в том случае, если вы точно знаете конкретную модель камеры и все её особенности.

А поскольку у разных моделей (и, тем более разных производителей) алгоритмы как генерации данных, так и шифрования будут отличаться – задача вовсе не из лёгких. Что, опять же, хотя бы снизит упоминаемый ранее «порог вхождения» в область фейковых видео, ИМХО…

P.S. С кино ситуация несколько другая. Там всегда найдётся целая команда свидетелей того, что исходное видео подлинно. Всё документируется, все исходники хранится. Так что там эти функции можно и вообще просто отключать.

TheShock

08.02.2018 20:12+1А если вы будете пытаться генерить их искусственно – опять же, не пробьются хеши.

Что значит «не пробьются хеши»? Вы какую-то пьяную фантазию рассказываете.

Ваша гипотетическая камера работает так:

сырые входные данные => алгоритмы подлинности => «верифицированное» видео

Если у меня есть сырые входные данные (а я уже выше описал, что они у меня есть). То я могу использовать алгоритмы камеры для того, чтобы создать «верифицированное» будто этой камерой видео. Там будет все пучком — и хеши и метки. Все будет указывать на то, что именно нужной камерой снималось это видео и оно было верифицированно.

Можно, конечно, искусственно генерить совсем левые данные, чтобы вышли совсем произвольные хеши

Какие левые данные? Какие произвольные хеши? Я буду брать алгоритмы камеры и генерировать ровно те же данные и хеши, которая сгенерировала бы камера.

Garruz

08.02.2018 20:30-1Объясняю на пальцах…

Камера генерит данные, на их основе выбиваются хеши кадров. Методы проверки достоверности (но не генерации) хешей занесены в базы всех легальных видеохостеров – проверка происходит уже сразу при добавлении.

Вы можете сколько угодно добавлять на видео нужные артефакты, да. Но достаточно добавить к вводным данным всего лишь показания какого-нибудь копеечного гироскопа или термометра камеры (то есть, данные, которые вам априори неизвестны) – либо «наложенные» артефакты у вас не совпадут с оригинальными, либо не пробьётся хеш, либо хеш не будет соответствовать артефактам.

И даже если снимете на собственную камеру «без подписей», даже если всё смонтируете, даже если потом что-то там наложите искусственно – всё равно может не пробиться «правильный» результат проверки. Просто потому, что вам неизвестны все вводные данные.

Тест на подлинность провален.

В этом-то и вся прелесть подобной методики – подлинность подтверждается не «после», а уже во время записи видео.

Я ведь уже говорил, что вводные данные могут генерироваться по множеству параметров – даже по тем, которых вы можете и просто не знать. И по ним будут генерироваться данные, вшиваемые прямо в сами кадры.

TheShock

08.02.2018 20:33+1Почему «данные неизвестны»? У меня ведь в руках камера, которая выдает эти данные, значит они известны!

И вот вы говорите о «то есть, данные, которые вам априори неизвестны». Так и проверяльщикам они неизвестны. Вот я напишу, что термометр камеры выдает мне +40 градусов. Как тот, кто проверяет видео может удостовериться, что в камере не было +40 градусов. Я могу подставить совершенно любые данные и они будут считаться валидными!

Garruz

08.02.2018 20:52-1У меня ведь в руках камера, которая выдает эти данные, значит они известны!

Но кодирует она, в том числе, и по самой картинке – как уже упоминал выше. После этого уж точно фиг выдерете с видео все её «подписи» – которые, напомню, вшиваются прямо в сам кадр и генерятся «на лету» по множеству параметров (то есть, никакого чёткого алгоритма их вычищения вы не получите).

Тут даже ваш вариант с нонейм-камерой, не «подписывающей» поток – и то был чуть более оптимистичнее. ))

Я могу подставить совершенно любые данные и они будут считаться валидными!

Только в том случае, если вы сам не только инженер-разработчик, но и главный программист софта для этой камеры. ))

Ну, и конечно, если ваша «левая» камера сама ничего не подмешивает.

TheShock

08.02.2018 21:10Мне не нужно вычищать. Я просто беру датчик камеры и пишу данные с него рядом с сырым видео на ССД диск, а потом использую эти данные для того, чтобы зашифровать это видео.

Только в том случае, если вы сам не только инженер-разработчик, но и главный программист софта для этой камеры. ))

Это почему вдруг? Такс, давайте закончим всякие «абстрактные» данные. Давайте настоящие примеры.

копеечного гироскопа или термометра камеры

Гироскоп? Окей, камера у меня на штативе/прикручена к стене, потому я просто пишу (х:180, у:177). Термометр? В комнате все двери закрыты, потому постоянно 20.5 — 20.6 градусов. Беру эти случайные данные и кодирую ими сырое видео, снятое на другую камеру. Все подписи и хеши становятся корректными.

Garruz

08.02.2018 21:48Вы не знаете, как именно шифруется видео. Для этого вам нужны данные софт-отдела каждого отдельно взятого производителя.

Вы не знаете, как именно и в каком виде параметры передаются с датчиков. Для этого вам нужны данные инженерного отдела каждого отдельно взятого производителя.

Ну что, всё ещё «запросто»? ))

P.S. Минусовать просто потому что вам возражают – достаточно низко, я считаю. Тем более низко, когда заранее знаете, что вам временно не могут ответить тем же. ;)

TheShock

08.02.2018 21:54P.S. Минусовать просто потому что вам возражают – достаточно низко, я считаю. Тем более низко, когда заранее знаете, что вам временно не могут ответить тем же. ;)

Очевидно, я не только вас минусую, но и сам себя плюсую, да? Минусы лишь указывают на то, что кто-то не согласен с вашими аргументами. Не в карму же ж пошли.

Вы не знаете, как именно шифруется видео. Для этого вам нужны данные софт-отдела каждого отдельно взятого производителя

Нет, только одного производителя — любого, который признается судом. И этот софт есть на камере, которую я могу купить.

Вы не знаете, как именно и в каком виде параметры передаются с датчиков. Для этого вам нужны данные инженерного отдела каждого отдельно взятого производителя.

Нет, только одного производителя. И у меня есть купленная камера, где есть датчики, которые посылают эти данные. Не телепатически ведь они в софт передаются?

Вы таки из приверженцев, что «Security through obscurity» — серебрянная пуля. Почитайте там про Скайп. Тоже у взломщика не было софта. Как-то ему помешал этот факт?

Garruz

08.02.2018 22:16Очевидно,...

Да, но только почему-то появляются каждый раз после моего ответа именно вам. Впрочем, можете списать просто на старческий маразм (и заранее прошу прощения, если вдруг это в самом деле действительно не вы, а просто какой-то ваш неадекватный фанат)…

Не телепатически ведь они в софт передаются?

Разумеется, не телепатически. ))

Но для этого вам надо знать про эти датчики вообще всё – как именно с них передаётся информация, в каком конкретно виде, как конкретно её читать. Это – к инженерному отделу.

Далее, вам надо ещё знать, как именно эти данные интерпретируются, какие именно учитываются в создании хешей и по каким именно алгоритмам – это уже к софт-отделу.

Таким образом, в ожидаемой вами утечке должны участвовать как минимум два отдела аж целой компании-производителя. И это даже не считая того, что таких компаний как минимум сотня по всему миру…

Почитайте там про Скайп.

Скайп – сам по себе софт. Он один, он централизован. Конечно, даже для его взлома надо сильно постараться – но там ступила всего лишь одна компания.

В нашем же случае речь идёт о рынке со множеством компаний, у каждой из которых минимум по паре-тройке моделей. И, в теории, у каждой могут быть свои особенности шифрования.

Вы же не будете снимать все свои фейковые видео на одну-единственную камеру одной-единственной компании – да и то, лишь ту камеру, данные по которой когда-то вам случайно попали в руки? Ну тогда вас просто спалят ещё быстрее…

Mogwaika

09.02.2018 00:15Тайным Сантой оказался я.

Вам уже несколько раз заметили, что для компрометации достаточно одной камеры.

Для возможности независимой проверки хэша/подписи нужно всем рассказать алгоритм проверки и например предоставить открытый ключ.

Вас просят как можно проще описать эксперимент, по опровержению подлинности видео, подписанного по вашей схеме, а Вы снова и снова кидаете умные слова смысла которых не понимаете, и логических связок, и постановки задачи тоже имхо не видите.

Garruz

09.02.2018 23:06Тайным Сантой оказался я.

Благодарю за честность. Уважаю. Искренне.

Для возможности независимой проверки хэша/подписи нужно всем рассказать алгоритм проверки и например предоставить открытый ключ.

Разумеется.

На алгоритм проверки – не синоним алгоритма шифрования. Взять хоть ту же ЭЦП – удостовериться в аутентичности может множество софта, но вот подделать уже на многие порядки сложнее. Поэтому заморачиваться подделкой уже не может кто угодно (поправьте, если вдруг ошибаюсь)…

Вновь повторю, что в теории, разумеется, взломать можно что угодно. Но повышенные меры безопасности резко отсекают всяких «шутников» и прочих идиотов (вроде этих вот из статьи-сабжа)) – что в данном случае и является главной целью. Ведь именно такие и являются основной массой «фейкоделателей».

TheShock

10.02.2018 10:15Вновь повторю, что в теории, разумеется, взломать можно что угодно. Но повышенные меры безопасности резко отсекают всяких «шутников» и прочих идиотов (вроде этих вот из статьи-сабжа)) – что в данном случае и является главной целью. Ведь именно такие и являются основной массой «фейкоделателей».

Еще раз — идея не сработает, если будет софт, который может ставить видео метку о том, что оно валидно. С этих пор фейковое видео будет иметь подпись и будет еще труднее доказать, что видео реально подделка. Эта идея создает не безопасность, а иллюзию безопасности, что еще хуже.

Более того, если начнут появлятся подписанные подделки — вся идея будет скомпрометирована и с этих пор даже реально корректно подписанные оригинальные видео не будут иметь доверия.

Ваша идея — это «давайте сделаем еще один формат, которому все-равно никто не будет доверять, авось что-то поможет»

И это не «в теории можно взломать что угодно». Это система, которая без сомнений будет взломана. Потому что богатым людям нужно будет кого-то подставить и они взломаюь и поставят подпись на видео, а из-за того, что уязвимость неизвестна — никто не усомнится в подлинности и суд признает, что убийца — дворецкий.

Или если кому-то нужно будет выгородить своего племянничка — поставят его лицо на видео, где он кошечек лечит во время пьяного вождения в другом штате — и снова же поставит подпись.

Все эти уязивмости будут активно эксплуатироваться в подполье и страдать от вашей идеи будут только хорошие люди

we1

08.02.2018 10:19Уже есть стандарты для «подмешивания» и есть реализации от энтузиастов, которые делают Magic Lantern.

Только пока не совсем понятно, как это докажет реальность съемки. Основная идея показать авторство материалов (цифровая подпись).

Garruz

08.02.2018 19:47Да, есть. Потому и пишу, в общем-то. )

Но конкретно по теме сабжа – авторство тут уже меньшее из зол, увы. Впрочем, одно другому не мешает – надеюсь, что оба направления взаимодополнят друг друга. А по каким общим принципам может строиться доказательство реальности – попытался описать выше.

Hardcoin

08.02.2018 10:53Но тогда не совпадёт с хешами исходного видео

Зачем ему совпадать исходным видео? Исходное видео (с другими лицами) вообще никому нельзя показывать, ни с хэшами, ни без. Иначе провал.

А сокрытие алгоритма — это глупость. На пару лет такой "защиты" хватит, как обычно.

Garruz

08.02.2018 19:41Вы немного не поняли. Тут вся фишка не просто в «совпадении» – а в том, что после любого сложного монтажа файл будет сразу терять «почётное звание» аутентичности оригиналу (и даже не нужен будет сам оригинал для сравнения). Это будет заметно уже по самому файлу.

TheShock

08.02.2018 19:43А если владелец заявляет, что это и есть корректно подписанный оригинал (и он правда имеет все корректные метки)?

Hardcoin

08.02.2018 19:50+2Нет оригинала — нет аутентичности. Файл будет записан на старую камеру, которая не делает никаких меток. И после редактирования у вас так же остаётся файл без меток. А потом накладываете метки по алгоритму, который утек в сеть.

Впрочем, если вы сделаете статью с proof-of-concept на любом языке программирования или с математическими выкладками, будет интересно почитать.

TheShock

08.02.2018 20:12+1Не ждите математических выкладок. Складывается впечатление, что автор не знает даже основ.

Garruz

08.02.2018 20:36-1«Автор» защищал дипломную именно по теме «Криптография». ))

И если раньше подобные методы были недоступны массово просто в силу нехватки мощности устройств – то уже сейчас все эти фишки вполне можно реализовать.

Впрочем, «подробно и со всеми выкладками» – сейчас уже действительно мало что вспомню, тут вы правы. Слишком уж давно это всё было.

TheShock

08.02.2018 20:39+1А я защищал дипломную по теме «Активы и пассивы в Укргазбанке». Сейчас даже сходу не вспомню чем отличаются активы от пассивов. Ви, видимо, тоже забыли какие-то важные части вашей дипломной, раз сейчас не можете понять, где в вашей идее архитектурная дырка.

Garruz

08.02.2018 21:00-1При всём уважении – я пока эту «дырку» так и не увидел. ))

Хеширование кадров и прочих параметров «на лету» – раз.

Подмешивание хешей прямо в сам кадр – два.

Общее хеширование всего видео – три.

Итого: после любого редактирования получаем на выходе «не оригинал». И если последний параметр тут не критичен, то обойти первые два будет крайне сложно. Даже при искусственном наложении чаще всего на выходе получится «не оригинал».

TheShock

08.02.2018 21:14Даже при искусственном наложении чаще всего на выходе получится «не оригинал».

Почему? Как раз на выходе получится «100% оригинал», потому что накладывается тем же алгоритмом, что и используется камерой. В этом и есть ваша огромная дыра. Вы почему-то думаете, что алгоритм, который использует камера почему-то не может использовать злоумышленник, который держит эту камеру в руках.

Возможно, вы рассчитываете на какой-то божественный и исключительный Security through obscurity, но уж такую глупую детскую ошибку, человек, писавший дипломную на тему «Криптография», врядли допустил бы

Garruz

08.02.2018 21:57Я тут в теме уже упоминал аппаратные рандомайзеры. Сможете добиться такого же уровня реально случайных чисел программными методами? ;)))

Если сможете – первым прокричу, что вы гений. Если не сможете – не пройдёте ни одну проверку на оригинальность.

Поскольку все эти данные также участвуют в создании хешей. И они уже сразу пишутся в кадр, да. И, как уже говорил – хрен вы их оттуда вычистите, не зная исходных алгоритмов.

Более того – вы их даже хрен запишете, не зная всех подробностей.

Понимаете, вы сейчас надеетесь исключительно на то, что «где-то скачаете готовые базы» (что, впрочем, само по себе гигантское допущение из серии «если бы у бабушки был...»)). Я же говорю вам о том, что даже эти самые скачанные базы порой могут совершенно не помочь. ))

Kwisatz

09.02.2018 00:02+1всю ветку прочел и в голове вертелась одна мысль: вы правда не понимаете что воспроизвести можно результат ЛЮБОГО алгоритма?

У вас два требования:

— верифицируемость источника

— возможность монтажа

Одно полностью исключает другое. Ну и допустим что прилетел волшебник и таки реализовал ваши мечты. Без проблем, выпаиваем сенсор камеры и вместо него подаем видеосигнал с нашего устройства.

Вопрос взлома ВСЕГДА только в цене.

Garruz

09.02.2018 22:54Без проблем, выпаиваем сенсор камеры и вместо него подаем видеосигнал с нашего устройства.

Вопрос взлома ВСЕГДА только в цене.

Вот именно об этом и речь. Именно об этом повышении «порога вхождения» и говорилось. ))

Тот, кто станет заморачиваться подобными «тонкостями» – вряд ли будет заниматься мелкими пакостями. И даже на средние пакости вряд ли будут тратить столько усилий.

А если уж кто-то решит устроить какую-либо подставу действительно «по-крупному» – тут уж всё равно ничем не остановить, всё равно своего добьются.

К слову, такое можно делать уже даже сегодня, даже обычными «ручными средствами» без нейросетей – вопрос только в огромной цене.

Поэтому главная проблема именно в том, что с появлением таких вот многом автоматизированных систем – и цена резко упадёт, сразу на порядки. Как это в своё время уже случилось с тем же фотомонтажом, например…

Garruz

09.02.2018 23:18Да, сорри, чуть не забыл…

Одно полностью исключает другое.

Не исключает.

Именно поэтому и говорил о «вшитых метках» на каждом кадре (или хотя бы через каждые N кадров). Тогда даже склейка отдельных эпизодов – не приведёт к потере «оригинальности».

Если образно – просто представьте себе пачку купюр. Каждая их них является оригинальной – что подтверждено всеми маркерами аутентичности (водяные знаки, магнитные полосы и т.д.). И любое количество этих купюр является оригинальным, как бы вы эту пачку ни делили на части.

Но если в эту пачку попадёт хотя бы одна фальшивая (а тем более, если несколько) – у вас уже будет разумный повод не доверять тому, кто вам эти деньги дал.

Надеюсь, аналогия понятна…

Kwisatz

10.02.2018 08:10То есть вы предлагаете верифицировать каждый кадр? Тут у меня целая пачка возражений:

— нереальная нагрузка на плееры

— пачка состоит из купюр но видеопоток не состоит из кадров

— ну и как пытались вам выше объяснить: изготовить поддельную купюру, неотличимую от настоящей, можно

qw1

10.02.2018 02:22У вас два требования:

Допустим, подпись встроена в сенсор, а ключ из чипа вытащить мы не можем. Тогда возможно следующее решение:

— верифицируемость источника

— возможность монтажа

Одно полностью исключает другое.

1. с камеры получаем подписанный поток.

2. видеоредактор генерирует отредактированное видео и помещает его в контейнер mkv, как primary video, а оригинальный подписанный поток как secondary.

3. при просмотре юзер не видит второй поток, но, если потребуется провести экспертизу, можно переключиться на нередактированное видео и понять, что же там было снято в оригинале, не подменили ли голову потом )))

qw1

10.02.2018 02:13Я тут в теме уже упоминал аппаратные рандомайзеры. Сможете добиться такого же уровня реально случайных чисел программными методами? ;)))

Конечно, смогу. Вот мой чёрный ящик:

Если сможете – первым прокричу, что вы гений

Беру ключ длиной 65536 бит, вам неизвестный.

Выдаю первые 256 бит на выход, и шифрую весь блок алгоритмом AES-256, используя выданные биты как ключ.

Выдаю следующие 256 бит, шифрую, и т.д.

После 256 итераций, когда смещение, по которому читается ключ, достигает конца блока, перехожу на начало блока, и так по кругу.

Внимание, вопрос: предложите способ отличить выход этого алгоритма от настоящего аппаратного рандома.

qw1

10.02.2018 02:36Нет, эта схема чуть-чуть дырявая.

Надо так:

Выдаю первые 256 бит на выход, и шифрую весь блок алгоритмом AES-256, используя следующие 256 бит как ключ. Т.е., когда на выход уходит 256 бит по смещению (i mod 256)*256, шифруем весь наш буфер на 65536 бит, ключом по смещению ((i+1) mod 256)*256.

Где i = 0,1,2,3,… (до бесконечности)

Garruz

10.02.2018 03:13И всё равно – есть общая логика. Значит, уже есть теоретическая возможность дешифровать.

Аппаратные рандомайзеры именно потому и «едят свой хлеб» (впрочем, в крайне узких сегментах)), что любая хоть как-то просчитываемая логика в их работе априори стремится к нулю. Поскольку на выходе получаются реально случайные значения – подверженные буквально "случайному стечению многих обстоятельств", а не просто многократным итерациям алгоритмов…

Garruz

10.02.2018 02:54Конечно, смогу.

Увы…

Эти результаты всё равно не будут реально случайными – даже псевдо-случайными не будут. Максимум будут дико-дико запутанными (что почему-то часто путают со случайностью). Но всё равно будут подчиняться некой «общей» логике.

Иначе говоря, в самой своей основе – весь ваш вариант основывается на одном и том же наборе постоянных (!) данных, пусть даже многократно искажённом и перетасованном в результате множества итераций. Но суть именно в том, что все итерации производились по одному алгоритму – что теоретически может позволить найти «ключик» ко всему «ларчику»…

предложите способ отличить выход этого алгоритма от настоящего аппаратного рандома

Если хотя бы теоретически поддаётся дешифровке без ключа (см. выше).

А в целом, на наш с вами невооружённый взгляд – да, выход обоих будет сущей абракадаброй… ))

qw1

10.02.2018 08:33Увы…

То есть, никакого способа различить предложенный поток от случайного у вас нет.

Иначе говоря, в самой своей основе – весь ваш вариант основывается на одном и том же наборе постоянных (!) данных, пусть даже многократно искажённом и перетасованном в результате множества итераций.

С периодом повторения порядка 265536, что больше времени жизни всех воображаемых вселенных.

TheShock

10.02.2018 10:26+1Вновь повторю, что в теории, разумеется, взломать можно что угодно. Но повышенные меры безопасности резко отсекают всяких «шутников» и прочих идиотов (вроде этих вот из статьи-сабжа)) – что в данном случае и является главной целью. Ведь именно такие и являются основной массой «фейкоделателей».

А зачем? Я буду подставлять туда всегда 42, а вы докажите,, что это не реально число, которое выдал супер-крутой генератор случайных чисел.

В этом одна из ваших проблем — вы почему-то думаете, что я эти числа получаю в центральном офисе КГБ под расписку и никак не могу на них повлиять, а суд всегда может обратиться к оригинальным значениям.

Я могу подставить ЛЮБЫЕ ЗНАЧЕНИЯ, мне не нужна истинная случайность — ведь никто не знает — я эти значения поставил в качестве «исходных данных» сам или их поставил ваш супер-пупер генератор.

Поскольку все эти данные также участвуют в создании хешей. И они уже сразу пишутся в кадр, да. И, как уже говорил – хрен вы их оттуда вычистите, не зная исходных алгоритмов.

Почему вы упорно игнорируете то, что вам говорят. Мне приходится орать капсом из-за вашей слепоты. МНЕ НЕ НУЖНО ВЫЧИЩАТЬ НИКАКИЕ ДАННЫЕ, у меня есть камера, которая записывает чистое видео и мне необходимо лишь подписать это видео алгоритмом из другой камеры, которая считается авторитетной.

Эти все ваши глупые идеи про каждый кадр — обычное любительство. Да хоть в каждый пиксель вставляйте по хешу. Абсолютно все-равно. У меня есть эти чистые пиксели и есть алгоритм, который подписывает эти пиксели. С этим алгоритмом справляется какая-то схема в камере, значит справится и мой комп.

Все ваши «входные данные» — точно такое же дилетанство. Потому что никто кроме меня не может сказать, в каких условиях я это записывал. Кроме меня. Что выдал случайный генератор, что выдал гироскоп, акселерометр, термометр. Под все эти значения я могу поставить любое число которое захочу — и никто не сможет их провалидировать, потому что никто и никак не может узнать, какие именно числа там должны быть.

Welran

08.02.2018 07:31Это скорее для камер слежения, что бы они подписывали снятое видео своим цифровым ключом, для исключения подделки. В суде тогда можно будет сразу доказать что видео было или не было подвергнуто обработке.

destroy

07.02.2018 23:56Не говоря уже о том, что одновременно используется тело другой актрисы тоже без её согласия.

Чего?

TheShock

07.02.2018 23:57+2Она актриса, она старалась, а ее лицо закрыли чем-то другим и теперь значительно меньше людей узнает о её таланте.

UJIb9I4AnJIbIrUH

08.02.2018 00:21По идее, можно будет в перспективе присобачить на видео с собой чьё-то другое тело. Или отдельные его части. И да, я понял, что в статье речь не об этом.

DrZlodberg

08.02.2018 09:13Так и представляется:

«Кого бы выбрать? У этой ножки красивые, у той — грудь, а у вон той — мордашка… Так, где там программа...»

Франкенштейна, версия 2.0

Zmiy666

08.02.2018 05:03Хех… джин выпущен из бутылки, теперь в сети больше нельзя верить глазам.

Порноролики это фигня.

Зато теперь абсолютно любой человек может сгенерировать тонны любых фейковых новостей с лицами чиновников, министров, солнцеликого… да вообще что угодно. Ну например выпустить в сеть «шок контент» где мизулина занимается сексом… и все… она никогда не докажет, что этого небыло, ибо плодить «реальные фото и видео» а так же «свидетелей» можно со скорость света, так что любые отговорки будут начисто похоронены под тоннами фейка и будут лишь подтверждать.

Наступает новая эра троллинга ))

Osnovjansky

08.02.2018 22:20Есть ещё одна сторона — любое реальное видео можно похоронить под тоннами фейка

irsick

08.02.2018 05:58Нужен достойный ответ создателям FakeApp — нейросеть, тренированная на мультфильмах.

3aicheg

08.02.2018 06:55Я вот прочитал это и чё-то вдруг подумал: а неужели не существует с древних, ещё может даже докомпьютерных, времён такого жанра, как порно с двойниками знаменитостей? Если да, то как к этому относится порноиндустрия, киноиндустрия, а также законодательное собрание и независимый суд? К примеру, пялит «Чак Норрис» «Анджелину Джоли» на камеру — что им предъявить? Они же в своём праве?

kanvas

08.02.2018 07:40«За насильственные действия с виртуальным образом человека без согласия этого человека, возможно, тоже введут ответственность».

— по идее, «порно со звездой» это фантазия (продукт независимого творчества) создателя этого порно. Виртуальные образы других людей мы представляем в своих мыслях, в своих снах. Предлагается запрещать свободу мысли? Вводить понятие «Мыслепреступление»?

Hardcoin

08.02.2018 10:58Свободу мысли — не предлагается. А свобода воплощения мысли в реальность и сейчас ограничивают.

we1

08.02.2018 11:20Просто введут виртуальное наказание за эксплуатацию виртуального образа.

Потом подумал и считаю нужным добавить. Это вполне реально, например отлучение от соцсетей, от поиска в интернете, то покупки любимых сериалов. К тому времени, когда доступ в интернет будет по паспорту (по крайней мере к таким «полезным» вещам типа стриминговых сервисов и магазинов приложений), вполне можно вводить виртуальные наказания.

А вообще, они там в этих америках уже совсем от реальной жизни далеки, их такие смешные проблемы волнуют (вот недавно возмущались, что голые модели не могут сниматься вместе, если они сестры).3aicheg

10.02.2018 07:02«Отлучение от соцсетей и поиска в интернете» — это не виртуальное, а вполне реальное наказание. Виртуальное — это если смоделировать образ мыслепреступника и заточить в 3д-тюрьму, например.

firk

10.02.2018 12:21Отлучение от соцсетей — это не наказание вообще, а скорее принудительное лечение.

Dioxin

08.02.2018 07:55До чего техника дошла, а вот перевести качественно на другой язык это все никак.

Zloy_starik

08.02.2018 13:37Ну да, значит когда такое пишу я, местные «анархисты-либералы» сливают мне карму, когда такое поддерживает их любимая помойка, то тут же набирается куча людей которые это поддерживают или хотя бы понимают.

fatronix

08.02.2018 17:34Мнения разделились, комментарии внимательней читайте. А карму вам сливают за хамство и вранье.

Ntobes

08.02.2018 14:12Теперь порнхабу нужна нейросеть для идентификации видео, созданных нейросетью.

qw1

10.02.2018 02:29Опасной дорогой идёте. Соревновательные генеративные сети — это типичный способ увеличить качество генерации.

Борьба между генерирующей и детектирующей сетью достигнет такого напряжения, что обычный человек не сможет отличить подделку от реальности, это сможет сделать только детектирующая сеть, обучавшаяся дольше генерирующей.

NoRegrets

08.02.2018 15:02Чем видео отличается от той-же карикатуры? Может карикатуры тоже запретим, хотя погодите-ка…

perfect_genius

08.02.2018 16:09Интересно, что распространителей подобных видео всё ещё можно привлечь к ответственности за распространения контента, защищённого авторским правом (всё, кроме пририсованного лица), не так ли?

axe_chita

08.02.2018 19:57Вообще данная проблема с faceswap, равнозначна проблеме «ножа на кухонном столе». Нож он изначально не хороший, и не плохой. Им можно нарезать хлеб, порезать колбаску, почистить картошку, все самые обычные действия. И только в руках асоциального человека он превращается в зло что может нанести вред здоровью, и даже смерти невинного человека.

А крокодиловые слезы представителей порноиндустрии в стиле «нас посчитали» выглядят как минимум двусмысленно, ведь они выполняют интимные действия, публично, на камеру, получив при этом деньги, более того осознавая что это видео будет доступно множеству заинтересованных людей. Или это испуг перед конкурентом, который сможет разрушить их песочницу? Ведь сейчас лицо, а потом возможно соберут тело, и окружающую обстановку, просто по сценарию.

MaxKorz

Если эту технологию продолжат развивать, видеофиксация может перестать быть доказательством в суде, т.к. видео можно будет легко подделать. Это сейчас ради шутки знаменитостей в порно вставляют. Найдутся те, кто будет использовать технологию не ради шутки. Самое интересное, что прежде чем видеофиксация перестанет быть доказательством (если такое случится), обязательно произойдет череда громких подделок, где какой-нибудь политик(не обязательно в СНГ) будет якобы принимать/давать взятку и будет за это осужден/смещен с поста.

agat000

Фото и видеоматериалы проходят экспертизу. Создать систему, способную сделать абсолютно реальную картинку дело далекого будущего, а тогда и экспертные программы подтянутся.

kAIST

Пока нейросеть не делает это лучше, чем это делают профессионалы. Сейчас так же можно подделывать фотографии и видео, причем человек это сделает гораздо лучше.

9660

После недавней публикации поглядел десяток роликов на redite. Не увидел ни одного достоверного ролика. Там и экспертиза не нужна, монтаж виден невооруженным взглядом.

Возможно дело в мастерстве создающего.

saboteur_kiev

В статье приведет весьма неплохой ролик с подменой погоды.

Качество видео с видеорегистратора и так не очень, а в таких случаях подделку очень сложно определить на глаз.

9660

Я говорил о роликах с людьми. Все те что я видел на reddit имели очень слабую реалистичность.

ЗЫ В ролике из статьи артефакты отлично видны, правый нижний угол.

saboteur_kiev

Сейчас экспертиза стоит недорого. Если будут массовые подделки, причем качество будет таково, что потребуется экспертиза крутого специалиста на каждый случай — вот тут будет плохо

RedCatX

Вы видите альтернативный путь? Очевидно, что технологию продолжат развивать, теми или иными путями.

firk

Ну тут вопрос только в соотношении сил. К сожалению, сейчас слишком много богатых «защитников» таких технологий. Но при наличии скоординированного международно-государственного желания, вполне можно было бы всё это прижать и запретить, оставив разрешение только для специальных государственных организаций этим заниматься, а всех остальных при обнаружении признаков наличия подобного софта надолго сажать. Есть же ограниченные к распространению вещества (думаю у всех первая ассоциация со всякой наркотой, но это не только она — плутоний там же, и некоторые даже угрожают военным вмешательством по этому поводу), почему бы на опасные алгоритмы это не распространить?

Stalker_RED

И часто участковый проверяет, каким софтом вы владеете? То есть да, на уровне выпуска очередной запретительной бумажки это легко организовать, в отличие от практики. Не говоря уж о том, что так можно дозапрещаться до возврата в каменный век.

firk

А я и не говорил "участковый проверяет". Два примера из не-ИТ, которые я привёл, они тоже не проверяют, но это не мешает с распространением вредных сущностей бороться.

Весьма однобокий взгляд на каменный век. В нём ещё было разрешено много того, что сейчас наоборот запрещено (а точнее, государственных запретов вообще не было по причине отсутствия государств).

cheburen

ничто не препятствует собирать статистику о установленном софте посредством ОС, и судя по всему скоро это будет не статистика, а именной список, есть конечно еще право на свободу от слежки, но это можно быстро поправить, оправдывая борьбой с террором и педофилами.

Alexeyslav

Ну да, будет светится установленный компилятор с питона или джавы… да у каждого 9 из 10 программистов они есть. А сам софт для подмены лиц будет распространяться в виде обфусцированных исходников, устанавливаться скриптом и 8 из 10 программистов будут доказывать что это скрипт для удобства а не для установки/запуска программы подмены лиц.

Смотрели фильм «Гений»? "… нажимаем на эту кнопочку на чемоданчике, весело мигает светодиод… и всё готово — плёнки-доказательства размагничены."

Hardcoin

Любите вы все "прижимать и запрещать". Запрещать использовать чужое изображение — понятно. А запрет на алгоритм — не будет такого. Да и глупо это, уже пытались.

oficsu

При наличии какого софта сажать? При наличии компилятора или интерпретатора на компьютере? Или, быть может, за библиотеки для разработки нейросетей? А сами программы и исходники вполне можно спрятать и на внешнем устройстве. Пока что это никто не делает, ибо не запрещено.

Знаете, что случится, будь введен запрет?

Кстати, знаете, почему государства могут контролировать, например, тот же плутоний?

Его трудно добыть, поскольку контролируются все поставщики, так же его невозможно использовать в кустарных условиях, вероятно, требует специфических условий хранения. Ну, и еще он не дешев. Знаете, к чему я? Всё это не про интернет и не про компьютеры. Они лишен этих трудностей.

DrZlodberg

Качественная подделка любой информации — вопрос лишь времени и никуда от этого не деться.

firk

Не передёргивайте. Оружие без спец. разрешения запрещено иметь, а вот промышленные станки, на которых его можно изготовить — не запрещено. И точно так же, можно сказать, что из-за запрета ношения оружия преступник будет его (улику) прятать после убийства.

Закон и правоохранительные органы это и есть способ, которым общество себя защищает от вредительства. Это, в общем-то, именно то, ради чего их придумали.

Не более невозможно, чем другое личное пространство.

У государства есть монополия на ряд действий, которые запрещены для граждан. Это необходимо для его исправной работы.

Это — плохо, да. С коррупцией надо бороться и не только тут а везде. Но это совсем другая история.

Не лишён. Написание (да и эксплуатация) сложного алгоритма в одиночку — весьма затруднительная и, обычно, не окупающая себя деятельность. А не в одиночку уже растёт вероятность столкновения с сознательными гражданами, которые сообщат куда следует.

oficsu

Да, есть, именно поэтому я понимаю, что не всякая государственная монополия одинаково хороша, особенно в контексте других существующих проблем.

Возможно, однако, это не мешает уже сейчас иметь целые готовые библиотеки машинного обучения. В интернете достаточно статей, где создают нейронную сеть из готовой библиотеки и 15 строк кода. Знаете, что произойдет в случае тотального контроля? Всё так же можно будет написать программу в 15 строк, только теперь инструкция к ней будет подробной и платной, равно как и библиотека.Да, так и есть, однако не все методы одинаково эффективны в разных вопросах. От киберпреступлений надежной защиты нет в принципе — внимательность позволит снизить риски. Государственные органы могут помочь, когда дело совсем уж плохо. Но помочь можно не всегда. А поймать преступника до преступления будет затруднительно, ибо тотальный контроль невозможен — полагаю, электронных устройств уже больше, чем население планеты. Тут вам и интернет вещей, и смартфоны(на которых при желании тоже можно написать противозаконный код), а не только компьютеры. Предлагаете извлекать и проверять данные из каждого чайника?

А ещё, промышленные станки, вероятно, немаленьких размеров и покупку каждого экземпляра можно контролировать, что отличается от ситуации с интернетом, где мы просто копируем данные.

Но знаете главную проблему? Пока все библиотеки и разработки публичны, каждый желающий может разрабатывать и средства защиты. Но, как только такие программы станут нелегальны — они станут закрыты и противодействие им будет значительно затруднено. А государство не всесильно и не способно проверить каждый исходный код, уж не говоря, о том, чтобы его найти.

firk

Повторю: не передёргивайте. Я нигде такого не предлагал и наоборот привёл пример того, как это уже боле сотни лет с удовлетворительным качеством делается в не-ит сфере без указанного вами тотального контроля.

Периметр доступности этих данных тоже можно контролировать. Если у кого-то они обнаружились за периметром — значит он виноват.

Ваши рассуждения один в один подходят и к ситуации с легальностью/нелегальностью оружия. Да, если загнать некоторую активность в подполье, то бороться с ней станет сложнее. Но это вроде бы очевидный факт — когда вы с чем то боретесь, вы обычно встречаете противодействие, имеющее своей целью отразить вашу атаку и заставить вас сдаться. По сути вы как раз предлагаете сдаться на том основании, что противник может воспротивиться.

Сила государства определяется его народом. Надо предполагать, что граждан, желающих порядка, заметно больше, чем граждан, желающих его нарушить, а значит первые сильнее.

oficsu

ToshiruWang

Ох уж эти прижатьизапретить, а на дыхание ваше разрешение не просрочено?

siziyman

Не бывает «опасных алгоритмов». Бывает опасное их применение. Притом любых алгоритмов. Включая сортировку пузырьком, прости господи. Что и как вы будете запрещать?

erwins22

Следующий шаг — мыслепреступление. Вдруг я что то такое представил?

Karakhan

Про мировую практику не знаю, но в России видеоматериалы могут быть доказательством только на усмотрение судьи. Не захочет — не примет, без объяснения причин.

Veddary

У вас уже частично устаревшая информация. В административном делопроизводстве неопределенный статус аудио и видеоматериалов устранен, согласно федеральному закону от 26 апреля 2016 г. № 114-ФЗ в ст.26 КоАП внесены изменения, которые прямо относят их к документам как разновидности доказательств и требуют анализа на общих основаниях.

В ГП а АП такой определенности пока нет, но и там судья не может ничего сделать на свое усмотрение — он принимает или отвергает доказательства с обязательной мотивировкой причин такого отказа. В уголовном процессе еще в начале двухтысячных при направлении дела в суд мы сами цифровали с кассет записи, выполненные в ходе следственных действий и прикладывали компакт-диски в качестве приложений (иные документы по терминологии УПК) к протоколам осмотра места происшествия, следственного эксперимента, и т.д.

betrachtung

perfect_genius

Значит будут принимать видео только с защищённых камер.