Валентина Евтюхина, автор канала Digital Eva, и специалисты проектной компании и R&D лаборатории Neurodata Lab специально для блога Нетологии подготовили статью о том, как развиваются технологии в сфере распознавания эмоций.

Наука об эмоциях стала популярной не так давно, и в основном благодаря Полу Экману — американскому психологу, автору книги «Психология лжи» и консультанту популярного сериала «Обмани меня», который основан на материалах книги.

Пол Экман и Тим Рот — исполнитель главной роли в сериале «Обмани меня», чей персонаж списан с самого Экмана

Сериал стартовал в 2009 году, и в то же время значительно вырос публичный интерес к теме распознавания эмоций. Бум в стартап-среде случился в 2015-2016 годах, когда сразу два технологических гиганта — корпорации Microsoft и Google — доступными для обычных пользователей свои пилотные проекты для работы с наукой эмоций.

Сервис для распознавания эмоций Emotion Recognition, запущенный Microsoft

в 2015 году

Это стало толчком к созданию самых разных приложений и алгоритмов на базе технологии распознавания эмоций. Например, Text Analytics API — один из сервисов пакета Microsoft Cognitive Services, которые позволяют разработчикам встраивать готовые «умные» алгоритмы в свои продукты. Среди других сервисов пакета: инструменты распознавания изображений, лиц, речи, и многие другие. Теперь эмоции можно определять по тексту, звуку голоса, фото и даже видео.

Он есть, но он молод, у него еще все впереди.

Так, по мнению влиятельного агентства MarketsandMarkets, глобальный объем рынка эмоций в 2016 г. составил $6,72 млрд, и предполагается, что к середине 2020-х гг. он увеличится до $36,07 млрд. Рынок эмоциональных технологий не монополизирован. Тут найдется место и для корпораций, и для лабораторий, и для стартапов. Более того, нормальная рыночная практика: корпорации интегрируют в свои решения наработки компаний поменьше.

Эмоциональные и поведенческие технологии востребованы в различных сферах, включая медицинскую.

Обращаясь к зарубежному опыту, вспомним, как компания Empatica под руководством Розалинд Пикард первой в мире получила несколько недель назад разрешение от надзорных органов США, ответственных за клинические испытания (FDA-клиринг), на использование их носимого браслета Embrace, который не только фиксирует физиологические данные о состоянии владельца, но и оценивает его эмоциональный фон и предсказывает вероятность наступления сложных для организма ситуаций. Это может помочь людям с расстройствами аутистического спектра, депрессией и в сложных случаях в неврологии и медицине.

Израильская компания Beyond Verbal совместно с Mayo Clinic ищет в голосе человека вокальные биомаркеры, по которым определяются не только эмоции, но и закладывается возможность прогнозирования аортокоронарных заболеваний, болезней Паркинсона и Альцгеймера, что уже подводит эмоциональную проблематику к теме геронтологии и поиску путей замедления старения.

Если говорить о применимости технологий, то тут преимущественно задействована B2B сфера в секторах вроде интеллектуального транспорта, ритейла, рекламы, HR, IoT, gaming.

Но и в B2C тоже есть спрос: EaaS (Emotion as a Service) или же облачное аналитическое решение (Human data analytics) позволит любому пользователю загружать видеофайл и получать по нему всю эмоциональную и поведенческую статистику для каждого фрагмента записи.

Если речь идет о предвыборных дебатах на пост президента (будь то России или США), то от алгоритма едва ли что-то скроется. Более того, через пару лет технология по распознаванию эмоций будет в каждом смартфоне.

Бум AI был предсказан на 2025-2027 годы.

Трендом станет создание умных интерфейсов распознавания человеческих эмоций — программное обеспечение позволит определять состояние пользователя в произвольный момент времени при помощи обычной веб-камеры.

Это перспективная ниша, так как определение эмоций человека может быть использовано в коммерческих целях: от анализа восприятия видео- и аудиоконтента до расследования криминальных дел.

С другой стороны, это безграничные возможности развлекательной индустрии. Например, в новом iPhone X встроена технология распознавания лица Face ID, которая не только разблокирует телефон, но и может создать эмодзи с вашей мимикой:

Основная масса новых продуктов в сфере эмоциональной науки строится на семи базовых эмоциях и микроэкспрессии лица, которая отражает наши эмоции на уровне, неподвластном контролю мозга. Сознательно мы можем сдержать улыбку, но легкие подергивания уголков губ останутся, и это будет сигнал для технологий распознавания эмоций.

Есть также блок технологий, специализирующихся на анализе речи, голоса и взгляда. Использование этих методов в психиатрии или уголовном делопроизводстве позволит узнать максимум об эмоциональном состоянии человека и его истинном настрое благодаря информации о мельчайших изменениях в мимике и телодвижениях.

Сейчас компании и отдельные команды могут использовать открытые научные данные о распознавании эмоций и использовать их в стеке с технологиями, формируя область эмоциональных вычислений (affective computing).

Колоссальный вклад в развитие рынка эмоциональных технологий внесла пятерка FAANG (Facebook, Apple, Amazon, Netflix, Google) и техногиганты вроде IBM.

Прямых законодательных барьеров для эмоциональных технологий нет, а сама индустрия регулируется достаточно слабо и точечно. Есть ожидаемые барьеры и опасения: прежде всего, это проблема privacy и защиты персональных данных.

Вместе с тем всеобщая диджитализация, распространение гаджетов и девайсов любого рода, повсеместное обращение к изображениям и видео (несколько миллиардов видео попадает в сеть ежедневно), публичность в соцсетях позволяют эффективно извлекать эмоциональные данные из общего потока и использовать их для анализа человека — как потребителя товаров и услуг, и как пользователя. И все это должно проходить в правовом поле, корректно и этично.

Новый европейский регламент по защите персональных данных (GDPR) предполагает ряд ограничений: данные для обучения и тренировки алгоритмов машинного обучения можно будет использовать свободно, если они:

Как будет разворачиваться история с нормативным регулированием в России, покажет время.

Индустрия здоровья активно внедряет самые современные методы сбора и анализа данных о пациентах или пользователях, так как машинные алгоритмы определяют симптомы, используя сотни и тысячи похожих случаев.

Уже существуют мобильные приложения, которые анализируют по фото и тексту психоэмоциональное состояние, и чем больше человек общается с программой, тем лучше она обучается, «понимает» его и дает точные прогнозы лечения.

Одно дело, когда устройство просто улавливает, «понимает» на своем уровне ваше настроение и в соответствии с ним включает музыку, регулирует свет или готовит кофе. Другое, когда оно по вашему внешнему виду оценивает степень усталости или определяет какие-то отклонения от нормы. Или заболевания. К примеру, болезнь Альцгеймера или Паркинсона.

Задолго до своего проявления болезнь начинает влиять на мышцы лица, на скорость движения глаз, на неощутимые, казалось бы, изменения в голосе и микродвижениях.

Сериал «Обмани меня» вышел на экраны в 2009 году и сразу же получил мировую популярность. Главный герой Доктор Лайтман умеет читать правду по микромимике лица. Это его «суперспособность», которая помогает найти убийцу и раскрыть сеть запутанных преступлений.

Нейроинтерфейсы могут все то же самое, только еще лучше, качественнее и быстрее. Можно снять человека в комнате для допроса и потом наложить на видео специальную программу, которая прогнозирует процент эмоций на его лице — злость, страх, горечь, обида и так далее. Эти данные помогут следствию понять, в какой момент человек мог обмануть или чего-то недоговорить.

Считается, что интернет не передает эмоции, но это не так. По серии твитов или постов в Фейсбуке можно с высокой точностью определить, в каком настроении и состоянии находился пользователь в тот момент, когда это писал.

Самый простой пример определения психоэмоционального состояния по стилистике текста — всем хорошо известная ситуация, когда человек начинает ставить точку в конце сообщения, а его собеседник воспринимает это как сигнал о том, что в разговоре что-то пошло не так.

В глобальных масштабах при помощи машинного обучения можно создать систему, которая будет отслеживать вспышки гнева, просьбы о помощи или страх в сообщениях и реагировать на них — например, отправлять сигнал в службы спасения.

Уже сейчас мировые ритейл-сети максимально интегрируют онлайн в офлайн, пытаясь узнать, что хочет покупатель и что он, вероятнее всего, купит. Когда нейроинтерфейсы достигнут уровня точного высокочувствительного распознавания эмоций, реклама в витрине торгового центра будет за доли секунд подстраиваться под настроение проходящих мимо людей. Подобная технология показана в фантастических фильмах, например, «Особое мнение» и «Бегущий по лезвию 2049».

Кадр из фильма «Бегущий по лезвию 2049», где голографический рекламный

гиноид реагирует на эмоции на лице главного героя.

Примерно год назад, в апреле 2017 года, исследовательская группа из Сан-Франциско научила нейронную сеть LSTM точнее распознавать эмоциональную составляющую текста. Теперь машина почти безошибочно опознает настроение в отзывах покупателей на Amazon и кинорецензиях на Rotten Tomatoes, что помогает улучшить сервис и предугадать популярность продукта у пользователей.

Когда вышла первая модель очков Google Glass, предполагалось, что управление жестами выйдет на новый уровень — для того, чтобы читать текст на внутренней стороне линзы, достаточно было провести глазами сверху вниз, чтобы система поняла, что вы уже прочитали этот абзац и можно показывать следующий. Несмотря на то, что сам гаджет не вышел за рамки прототипа, история с исследованием движений глаз переместилась в новое поле — игровое.

Разработчикам игр очень важно понимать, как и в какой момент игрок себя чувствует, как на него действуют спецэффекты и игровые препятствия. Компания-разработчик технологии распознавания эмоций Affectiva помогла создать игру Nevermind, в которой сложность зависит от уровня напряжения играющего, а сюжет подстраивается от состояния стресса или спокойствия игрока.

После того как в начале 2016 года команда фонда Envirtue Capital пришла к мысли, что во многих аспектах имеющийся венчурный рынок России в части технологий распознавания эмоций не отвечает ожиданиям инвесторов, было принято решение развивать проекты в рамках своей R&D лаборатории, полностью автономной и финансируемой из собственных источников. Так родилась компания Neurodata Lab LLC.

«С сентября 2016 года начал формироваться наш коллектив, включающий сегодня как научных сотрудников — специалистов по естественным и когнитивным наукам, так и технических экспертов с компетенциями и бэкграундом в области компьютерного зрения, машинного обучения, науки о данных. Междисциплинарный характер исследований эмоций предопределил наш выбор в пользу смешанной команды, что позволяет думать над решением задач с разных точек зрения, объединять в одном контуре как сугубо техническую часть, так и взгляды и идеи биологии, психофизиологии и нейролингвистики».

Георгий Плиев

Управляющий партнер Neurodata Lab

Neurodata Lab разрабатывает решения, которые охватывают широкий спектр направлений в области исследований эмоций и их распознавания по аудио и видео, в том числе технологии по разделению голосов, послойного анализа и идентификации голоса спикера в аудиопотоке, комплексного трекинга движений тела и рук, а также детекции и распознавания ключевых точек и движений мышц лица в видеопотоке в режиме реального времени.

Один из таких проектов — разработка прототипа софтового айтрекера EyeCatcher, позволяющего извлекать данные движений глаз и головы из видеофайлов, записанных на обычную камеру. Эта технология открывает новые горизонты в изучении движений глаз человека в естественных, а не лабораторных, условиях и ощутимо расширяет исследовательские возможности — теперь можно узнать, как человек рассматривает картины, реагирует на звук, цвет, вкус, каково движение глаз, когда он счастлив или удивлен. Эти данные будут использованы как база для создания более совершенной технологии распознавания человеческих эмоций.

«Наша цель — конструирование гибкой платформы и разработка технологий, которые будут востребованы частными и корпоративными клиентами из различных отраслей, включая нишевые. При детекции и распознавании эмоций важно учитывать, что человеческие эмоции — очень вариативная, «ускользающая» сущность, которая зачастую меняется от человека к человеку, от социума к социуму; есть этнические, возрастные, гендерные, социокультурные различия. Чтобы выявить закономерности, нужно обучать алгоритмы на очень больших выборках качественных данных. Это та фаза, на которой коллектив нашей лаборатории сейчас и сосредоточен».

Георгий Плиев

Управляющий партнер Neurodata Lab

Одна из основных сложностей, с которыми сталкиваются исследовательские группы при изучении эмоций, — ограниченность и «шумность» данных для работы с эмоциями в естественной обстановке или необходимость использовать неудобные носимые приборы для отслеживания эмоционального состояния участника эксперимента, которые искажают восприятие. Поэтому в качестве одного из своих первых проектов команда Neurodala Lab собрала русскоязычный мультимодальный датасет RAMAS (The Russian Acted Multimodal Affective Set) — комплексный набор данных об испытываемых эмоциях, включающий параллельную запись 12 каналов: аудио, видео, айтрекер, носимые датчики движения и пр. о каждой из ситуаций межличностного взаимодействия. В создании датасета приняли участие актеры из ВГИКа, воссоздающие различные ситуации повседневного общения. Сегодня доступ к мультимодальной базе данных RAMAS предоставляется бесплатно академическим институтам, университетам и лабораториям.

Наличие широкой базы данных — один из ключевых факторов качественной исследовательской работы с эмоциями, однако в лабораторных условиях и игровых симуляциях такую базу аккумулировать невозможно. Чтобы решить эту известную проблему, специалисты Neurodata Lab разработали и запустили собственную платформу Emotion Miner для сбора, разметки, анализа и процессинга эмоциональных данных, которая собрала более 20 тысяч участников-аннотаторов, размечающих данные, из более чем 30 стран. На сегодняшний день Emotion Miner Data Corpus — один из крупнейших в мире размеченных мультимодальных эмоциональных видеодатасетов.

С момента создания Neurodata Lab сотрудники лаборатории сотрудничают с академическими институтами, университетами, лабораториями и профильными центрами компетенций в США, Европе и России, и активно участвуют в крупных зарубежных конференциях, включая Interspeech и ECEM, публикуют академические статьи. Компания принимала участие в саммите по эмоциональному искусственному интеллекту, продвигаемому совместно MIT и компанией Affectiva, а в марте 2018 года организовала и провела совместно с НИУ ИТМО первую российскую конференцию «Emotion AI: новые вызовы для науки и образования, новые возможности для бизнеса». В планах — создать Российскую ассоциацию по Emotion AI, консолидировать сообщество научных экспертов, лабораторий и стартапов.

«Когда технология распознавания эмоций достигнет поры зрелости, она окажет значительное влияние на всю экосистему, на всю техносферу, позволит людям лучше, глубже и полнее общаться друг с другом при помощи гаджетов и с миром стремительно «умнеющих машин» с человеко-компьютерным интерфейсом. Технология несет в себе потенциал для развития взаимопонимания и эмпатии, позволит решить проблемы людей с ограниченными возможностями (например, с аутизмом) и найдет ключи к облегчению социально-критических заболеваний. Вместе c тем, важна не только технология, но и то, как ее используют люди. Мы полностью разделяем этический императив и исходим из того, что система сдержек и противовесов, в том числе законодательных, не превратит технологию распознавания эмоций в технологию тотального контроля. Ее миссия в том, чтобы помогать человеку, не ограничивая его свободу, его права, его личное пространство. Конечно, отдельные аберрации неизбежны, но устранимы».

Георгий Плиев

Управляющий партнер Neurodata Lab

Курсы «Нетологии» по теме:

Наука об эмоциях стала популярной не так давно, и в основном благодаря Полу Экману — американскому психологу, автору книги «Психология лжи» и консультанту популярного сериала «Обмани меня», который основан на материалах книги.

Пол Экман и Тим Рот — исполнитель главной роли в сериале «Обмани меня», чей персонаж списан с самого Экмана

Сериал стартовал в 2009 году, и в то же время значительно вырос публичный интерес к теме распознавания эмоций. Бум в стартап-среде случился в 2015-2016 годах, когда сразу два технологических гиганта — корпорации Microsoft и Google — доступными для обычных пользователей свои пилотные проекты для работы с наукой эмоций.

Сервис для распознавания эмоций Emotion Recognition, запущенный Microsoft

в 2015 году

Это стало толчком к созданию самых разных приложений и алгоритмов на базе технологии распознавания эмоций. Например, Text Analytics API — один из сервисов пакета Microsoft Cognitive Services, которые позволяют разработчикам встраивать готовые «умные» алгоритмы в свои продукты. Среди других сервисов пакета: инструменты распознавания изображений, лиц, речи, и многие другие. Теперь эмоции можно определять по тексту, звуку голоса, фото и даже видео.

Агентство Gartner утверждает, что наш смартфон в 2021-2022 годах будет знать нас лучше, чем наши же друзья и родственники, и взаимодействовать с нами на тонком эмоциональном уровне.

Рынок технологий распознавания эмоций — что с ним?

Он есть, но он молод, у него еще все впереди.

Сейчас рынок детекции эмоций переживает бум и по оценке западных специалистов к 2021 году он вырастет, по разным подсчетам, от $19 млрд до $37 млрд.

Так, по мнению влиятельного агентства MarketsandMarkets, глобальный объем рынка эмоций в 2016 г. составил $6,72 млрд, и предполагается, что к середине 2020-х гг. он увеличится до $36,07 млрд. Рынок эмоциональных технологий не монополизирован. Тут найдется место и для корпораций, и для лабораторий, и для стартапов. Более того, нормальная рыночная практика: корпорации интегрируют в свои решения наработки компаний поменьше.

Эмоциональные и поведенческие технологии востребованы в различных сферах, включая медицинскую.

Обращаясь к зарубежному опыту, вспомним, как компания Empatica под руководством Розалинд Пикард первой в мире получила несколько недель назад разрешение от надзорных органов США, ответственных за клинические испытания (FDA-клиринг), на использование их носимого браслета Embrace, который не только фиксирует физиологические данные о состоянии владельца, но и оценивает его эмоциональный фон и предсказывает вероятность наступления сложных для организма ситуаций. Это может помочь людям с расстройствами аутистического спектра, депрессией и в сложных случаях в неврологии и медицине.

Израильская компания Beyond Verbal совместно с Mayo Clinic ищет в голосе человека вокальные биомаркеры, по которым определяются не только эмоции, но и закладывается возможность прогнозирования аортокоронарных заболеваний, болезней Паркинсона и Альцгеймера, что уже подводит эмоциональную проблематику к теме геронтологии и поиску путей замедления старения.

Если говорить о применимости технологий, то тут преимущественно задействована B2B сфера в секторах вроде интеллектуального транспорта, ритейла, рекламы, HR, IoT, gaming.

Но и в B2C тоже есть спрос: EaaS (Emotion as a Service) или же облачное аналитическое решение (Human data analytics) позволит любому пользователю загружать видеофайл и получать по нему всю эмоциональную и поведенческую статистику для каждого фрагмента записи.

Если речь идет о предвыборных дебатах на пост президента (будь то России или США), то от алгоритма едва ли что-то скроется. Более того, через пару лет технология по распознаванию эмоций будет в каждом смартфоне.

Стек технологий и науки

Бум AI был предсказан на 2025-2027 годы.

Трендом станет создание умных интерфейсов распознавания человеческих эмоций — программное обеспечение позволит определять состояние пользователя в произвольный момент времени при помощи обычной веб-камеры.

Это перспективная ниша, так как определение эмоций человека может быть использовано в коммерческих целях: от анализа восприятия видео- и аудиоконтента до расследования криминальных дел.

С другой стороны, это безграничные возможности развлекательной индустрии. Например, в новом iPhone X встроена технология распознавания лица Face ID, которая не только разблокирует телефон, но и может создать эмодзи с вашей мимикой:

Основная масса новых продуктов в сфере эмоциональной науки строится на семи базовых эмоциях и микроэкспрессии лица, которая отражает наши эмоции на уровне, неподвластном контролю мозга. Сознательно мы можем сдержать улыбку, но легкие подергивания уголков губ останутся, и это будет сигнал для технологий распознавания эмоций.

Есть также блок технологий, специализирующихся на анализе речи, голоса и взгляда. Использование этих методов в психиатрии или уголовном делопроизводстве позволит узнать максимум об эмоциональном состоянии человека и его истинном настрое благодаря информации о мельчайших изменениях в мимике и телодвижениях.

Сейчас компании и отдельные команды могут использовать открытые научные данные о распознавании эмоций и использовать их в стеке с технологиями, формируя область эмоциональных вычислений (affective computing).

Колоссальный вклад в развитие рынка эмоциональных технологий внесла пятерка FAANG (Facebook, Apple, Amazon, Netflix, Google) и техногиганты вроде IBM.

Технологии распознавания эмоций и закон

Прямых законодательных барьеров для эмоциональных технологий нет, а сама индустрия регулируется достаточно слабо и точечно. Есть ожидаемые барьеры и опасения: прежде всего, это проблема privacy и защиты персональных данных.

Эмоции — это приватные, довольно личные данные о человеке, его состояниях, ощущениях, откликах на стимулы, людей и среду, о мыслях и намерениях, подчас не полностью осознаваемых рационально.

Вместе с тем всеобщая диджитализация, распространение гаджетов и девайсов любого рода, повсеместное обращение к изображениям и видео (несколько миллиардов видео попадает в сеть ежедневно), публичность в соцсетях позволяют эффективно извлекать эмоциональные данные из общего потока и использовать их для анализа человека — как потребителя товаров и услуг, и как пользователя. И все это должно проходить в правовом поле, корректно и этично.

Новый европейский регламент по защите персональных данных (GDPR) предполагает ряд ограничений: данные для обучения и тренировки алгоритмов машинного обучения можно будет использовать свободно, если они:

- они остаются деперсонализированными, то есть биосенсорные данные отделяются от биометрии (идентификация людей);

- если соблюдается групповой формат (анализ толпы, множества людей, а не единичных субъектов);

- если ведется съемка, человек должен знать об этом и быть с этим согласен, в противном случае это будет являться нарушением регламента и повлечет за собой ответственность.

Как будет разворачиваться история с нормативным регулированием в России, покажет время.

Где в ближайшие годы понадобится распознавание эмоций

Здоровье и Health tech

Индустрия здоровья активно внедряет самые современные методы сбора и анализа данных о пациентах или пользователях, так как машинные алгоритмы определяют симптомы, используя сотни и тысячи похожих случаев.

Уже существуют мобильные приложения, которые анализируют по фото и тексту психоэмоциональное состояние, и чем больше человек общается с программой, тем лучше она обучается, «понимает» его и дает точные прогнозы лечения.

Одно дело, когда устройство просто улавливает, «понимает» на своем уровне ваше настроение и в соответствии с ним включает музыку, регулирует свет или готовит кофе. Другое, когда оно по вашему внешнему виду оценивает степень усталости или определяет какие-то отклонения от нормы. Или заболевания. К примеру, болезнь Альцгеймера или Паркинсона.

Задолго до своего проявления болезнь начинает влиять на мышцы лица, на скорость движения глаз, на неощутимые, казалось бы, изменения в голосе и микродвижениях.

Криминалистика

Сериал «Обмани меня» вышел на экраны в 2009 году и сразу же получил мировую популярность. Главный герой Доктор Лайтман умеет читать правду по микромимике лица. Это его «суперспособность», которая помогает найти убийцу и раскрыть сеть запутанных преступлений.

Нейроинтерфейсы могут все то же самое, только еще лучше, качественнее и быстрее. Можно снять человека в комнате для допроса и потом наложить на видео специальную программу, которая прогнозирует процент эмоций на его лице — злость, страх, горечь, обида и так далее. Эти данные помогут следствию понять, в какой момент человек мог обмануть или чего-то недоговорить.

Мониторинг социальных активностей

Считается, что интернет не передает эмоции, но это не так. По серии твитов или постов в Фейсбуке можно с высокой точностью определить, в каком настроении и состоянии находился пользователь в тот момент, когда это писал.

Самый простой пример определения психоэмоционального состояния по стилистике текста — всем хорошо известная ситуация, когда человек начинает ставить точку в конце сообщения, а его собеседник воспринимает это как сигнал о том, что в разговоре что-то пошло не так.

В глобальных масштабах при помощи машинного обучения можно создать систему, которая будет отслеживать вспышки гнева, просьбы о помощи или страх в сообщениях и реагировать на них — например, отправлять сигнал в службы спасения.

Реклама

Уже сейчас мировые ритейл-сети максимально интегрируют онлайн в офлайн, пытаясь узнать, что хочет покупатель и что он, вероятнее всего, купит. Когда нейроинтерфейсы достигнут уровня точного высокочувствительного распознавания эмоций, реклама в витрине торгового центра будет за доли секунд подстраиваться под настроение проходящих мимо людей. Подобная технология показана в фантастических фильмах, например, «Особое мнение» и «Бегущий по лезвию 2049».

Кадр из фильма «Бегущий по лезвию 2049», где голографический рекламный

гиноид реагирует на эмоции на лице главного героя.

Примерно год назад, в апреле 2017 года, исследовательская группа из Сан-Франциско научила нейронную сеть LSTM точнее распознавать эмоциональную составляющую текста. Теперь машина почти безошибочно опознает настроение в отзывах покупателей на Amazon и кинорецензиях на Rotten Tomatoes, что помогает улучшить сервис и предугадать популярность продукта у пользователей.

Игровая индустрия

Когда вышла первая модель очков Google Glass, предполагалось, что управление жестами выйдет на новый уровень — для того, чтобы читать текст на внутренней стороне линзы, достаточно было провести глазами сверху вниз, чтобы система поняла, что вы уже прочитали этот абзац и можно показывать следующий. Несмотря на то, что сам гаджет не вышел за рамки прототипа, история с исследованием движений глаз переместилась в новое поле — игровое.

Разработчикам игр очень важно понимать, как и в какой момент игрок себя чувствует, как на него действуют спецэффекты и игровые препятствия. Компания-разработчик технологии распознавания эмоций Affectiva помогла создать игру Nevermind, в которой сложность зависит от уровня напряжения играющего, а сюжет подстраивается от состояния стресса или спокойствия игрока.

А что в России? Опыт Neurodata Lab

После того как в начале 2016 года команда фонда Envirtue Capital пришла к мысли, что во многих аспектах имеющийся венчурный рынок России в части технологий распознавания эмоций не отвечает ожиданиям инвесторов, было принято решение развивать проекты в рамках своей R&D лаборатории, полностью автономной и финансируемой из собственных источников. Так родилась компания Neurodata Lab LLC.

«С сентября 2016 года начал формироваться наш коллектив, включающий сегодня как научных сотрудников — специалистов по естественным и когнитивным наукам, так и технических экспертов с компетенциями и бэкграундом в области компьютерного зрения, машинного обучения, науки о данных. Междисциплинарный характер исследований эмоций предопределил наш выбор в пользу смешанной команды, что позволяет думать над решением задач с разных точек зрения, объединять в одном контуре как сугубо техническую часть, так и взгляды и идеи биологии, психофизиологии и нейролингвистики».

Георгий Плиев

Управляющий партнер Neurodata Lab

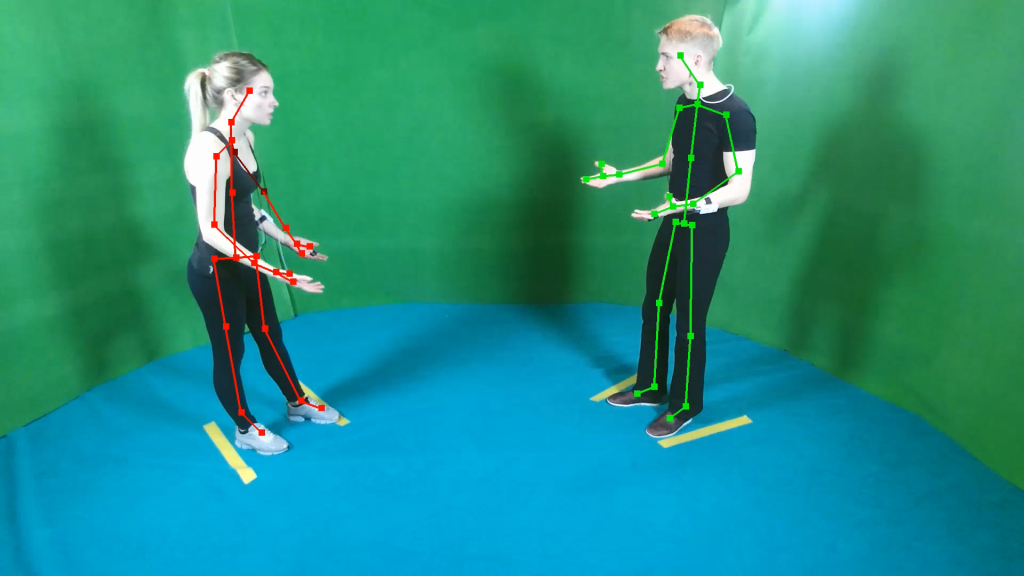

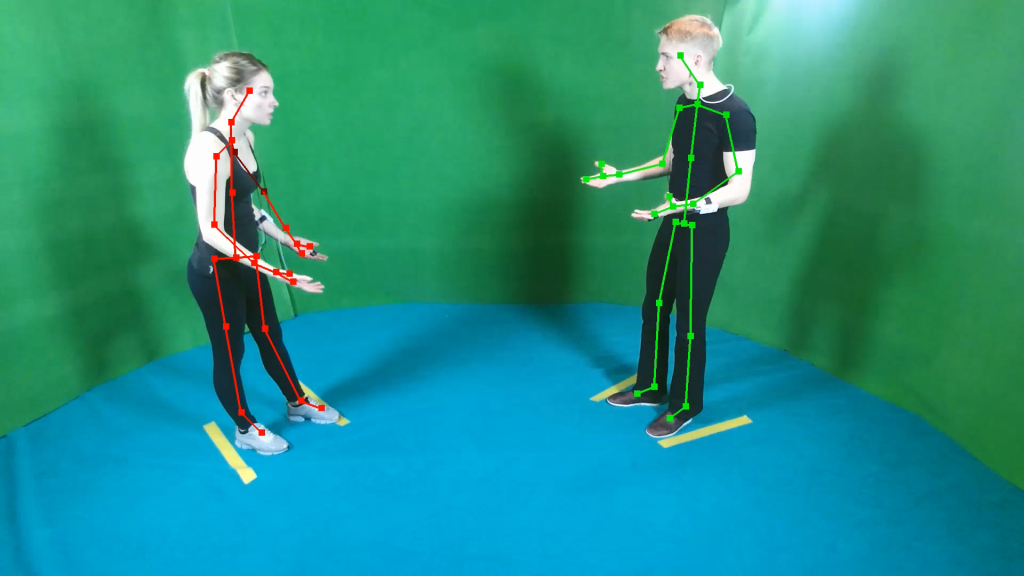

Neurodata Lab разрабатывает решения, которые охватывают широкий спектр направлений в области исследований эмоций и их распознавания по аудио и видео, в том числе технологии по разделению голосов, послойного анализа и идентификации голоса спикера в аудиопотоке, комплексного трекинга движений тела и рук, а также детекции и распознавания ключевых точек и движений мышц лица в видеопотоке в режиме реального времени.

Один из таких проектов — разработка прототипа софтового айтрекера EyeCatcher, позволяющего извлекать данные движений глаз и головы из видеофайлов, записанных на обычную камеру. Эта технология открывает новые горизонты в изучении движений глаз человека в естественных, а не лабораторных, условиях и ощутимо расширяет исследовательские возможности — теперь можно узнать, как человек рассматривает картины, реагирует на звук, цвет, вкус, каково движение глаз, когда он счастлив или удивлен. Эти данные будут использованы как база для создания более совершенной технологии распознавания человеческих эмоций.

«Наша цель — конструирование гибкой платформы и разработка технологий, которые будут востребованы частными и корпоративными клиентами из различных отраслей, включая нишевые. При детекции и распознавании эмоций важно учитывать, что человеческие эмоции — очень вариативная, «ускользающая» сущность, которая зачастую меняется от человека к человеку, от социума к социуму; есть этнические, возрастные, гендерные, социокультурные различия. Чтобы выявить закономерности, нужно обучать алгоритмы на очень больших выборках качественных данных. Это та фаза, на которой коллектив нашей лаборатории сейчас и сосредоточен».

Георгий Плиев

Управляющий партнер Neurodata Lab

Одна из основных сложностей, с которыми сталкиваются исследовательские группы при изучении эмоций, — ограниченность и «шумность» данных для работы с эмоциями в естественной обстановке или необходимость использовать неудобные носимые приборы для отслеживания эмоционального состояния участника эксперимента, которые искажают восприятие. Поэтому в качестве одного из своих первых проектов команда Neurodala Lab собрала русскоязычный мультимодальный датасет RAMAS (The Russian Acted Multimodal Affective Set) — комплексный набор данных об испытываемых эмоциях, включающий параллельную запись 12 каналов: аудио, видео, айтрекер, носимые датчики движения и пр. о каждой из ситуаций межличностного взаимодействия. В создании датасета приняли участие актеры из ВГИКа, воссоздающие различные ситуации повседневного общения. Сегодня доступ к мультимодальной базе данных RAMAS предоставляется бесплатно академическим институтам, университетам и лабораториям.

Наличие широкой базы данных — один из ключевых факторов качественной исследовательской работы с эмоциями, однако в лабораторных условиях и игровых симуляциях такую базу аккумулировать невозможно. Чтобы решить эту известную проблему, специалисты Neurodata Lab разработали и запустили собственную платформу Emotion Miner для сбора, разметки, анализа и процессинга эмоциональных данных, которая собрала более 20 тысяч участников-аннотаторов, размечающих данные, из более чем 30 стран. На сегодняшний день Emotion Miner Data Corpus — один из крупнейших в мире размеченных мультимодальных эмоциональных видеодатасетов.

С момента создания Neurodata Lab сотрудники лаборатории сотрудничают с академическими институтами, университетами, лабораториями и профильными центрами компетенций в США, Европе и России, и активно участвуют в крупных зарубежных конференциях, включая Interspeech и ECEM, публикуют академические статьи. Компания принимала участие в саммите по эмоциональному искусственному интеллекту, продвигаемому совместно MIT и компанией Affectiva, а в марте 2018 года организовала и провела совместно с НИУ ИТМО первую российскую конференцию «Emotion AI: новые вызовы для науки и образования, новые возможности для бизнеса». В планах — создать Российскую ассоциацию по Emotion AI, консолидировать сообщество научных экспертов, лабораторий и стартапов.

«Когда технология распознавания эмоций достигнет поры зрелости, она окажет значительное влияние на всю экосистему, на всю техносферу, позволит людям лучше, глубже и полнее общаться друг с другом при помощи гаджетов и с миром стремительно «умнеющих машин» с человеко-компьютерным интерфейсом. Технология несет в себе потенциал для развития взаимопонимания и эмпатии, позволит решить проблемы людей с ограниченными возможностями (например, с аутизмом) и найдет ключи к облегчению социально-критических заболеваний. Вместе c тем, важна не только технология, но и то, как ее используют люди. Мы полностью разделяем этический императив и исходим из того, что система сдержек и противовесов, в том числе законодательных, не превратит технологию распознавания эмоций в технологию тотального контроля. Ее миссия в том, чтобы помогать человеку, не ограничивая его свободу, его права, его личное пространство. Конечно, отдельные аберрации неизбежны, но устранимы».

Георгий Плиев

Управляющий партнер Neurodata Lab

От редакции

Курсы «Нетологии» по теме:

- очный курс «Data Scientist», Москва;

- очный курс «Аналитика для руководителей», Москва;

- онлайн-программа «Big Data: основы работы с большими массивами данных»;

- онлайн-профессия «Python-разработчик».

GeMir

Хороший был сериал. Жаль, что закрыли…