Истерия вокруг будущего искусственного интеллекта (ИИ) захватила мир. Нет недостатка в сенсационных новостях о том, как ИИ сможет лечить болезни, ускорять инновации и улучшать творческий потенциал человека. Если читать заголовки СМИ, вы можете решить, что уже живёте в будущем, в котором ИИ проник во все аспекты общества.

И хотя нельзя отрицать, что ИИ открыл нам богатый набор многообещающих возможностей, он также привёл к появлению мышления, которое можно охарактеризовать, как веру во всемогущество ИИ. По этой философии, при наличии достаточного количества данных, алгоритмы машинного обучения смогут решить все проблемы человечества.

Но у этой идеи есть большая проблема. Она не поддерживает прогресс ИИ, а наоборот, ставит под удар ценность машинного интеллекта, пренебрегая важными принципами безопасности и настраивая людей на нереалистичные ожидания по поводу возможностей ИИ.

Вера во всемогущество ИИ

Всего за несколько лет вера во всемогущество ИИ пробралась из разговоров технологических евангелистов Кремниевой долины в умы представителей правительств и законодателей всего мира. Маятник качнулся от антиутопического представления об уничтожающем человечество ИИ к утопической вере в пришествие нашего алгоритмического спасителя.

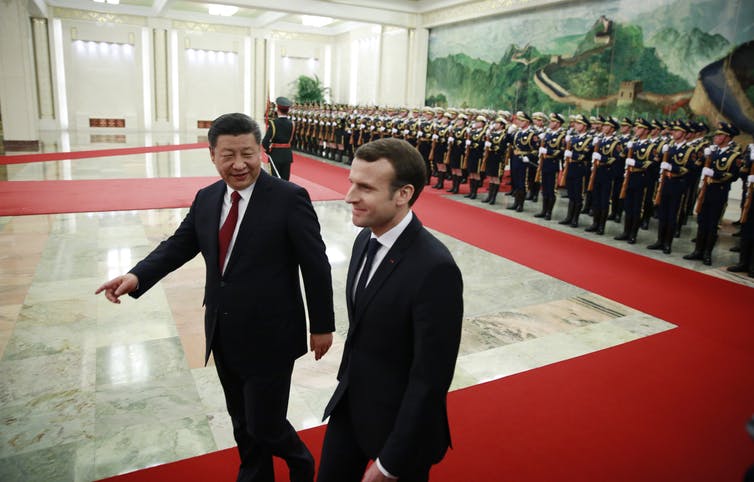

Мы уже видим, как правительства обеспечивают поддержку национальным программам развития ИИ и соревнуются в технологической и риторической гонке вооружений, чтобы получить преимущество в бурно растущем секторе машинного обучения (МО). К примеру, британское правительство пообещало вложить ?300 млн в исследования ИИ, чтобы стать лидером этой области. Очарованный преобразовательным потенциалом ИИ, французский президент Эмманюэль Макрон решил превратить Францию в международный центр ИИ. Китайское правительство увеличивает свои возможности в области ИИ с помощью государственного плана по созданию китайской ИИ-индустрии объёмом в $150 млрд к 2030 году. Вера во всемогущество ИИ набирает обороты и не собирается сдаваться.

Нейросети – легче сказать, чем сделать

В то время как многие политические заявления расхваливают преобразующие эффекты надвигающейся "революции ИИ", они обычно недооценивают сложности внедрения передовых систем МО в реальном мире.

Одна из наиболее многообещающих разновидностей технологии ИИ – нейросети. Эта форма машинного обучения основывается на примерном подражании нейронной структуры человеческого мозга, но в гораздо меньшем масштабе. Многие продукты на основе ИИ используют нейросети, чтобы извлекать закономерности и правила из больших объёмов данных. Но многие политики не понимают, что просто добавив к проблеме нейросеть, мы не обязательно тут же получим её решение. Так, добавив нейросеть к демократии, мы не сделаем её мгновенно менее дискриминированной, более честной или персонализованной.

Бросая вызов бюрократии данных

Системам ИИ для работы нужно огромное количество данных, но в госсекторе обычно не бывает подходящей инфраструктуры данных для поддержки передовых систем МО. Большая часть данных хранится в офлайн-архивах. Небольшое количество существующих оцифрованных источников данных тонут в бюрократии. Данные чаще всего размазаны по различным правительственным департаментам, каждому из которых для доступа требуется особое разрешение. Кроме всего прочего, госсектору обычно не хватает талантов, оснащённых нужными техническими способностями, чтобы в полной мере пожать плоды преимуществ ИИ.

По этим причинам связанный с ИИ сенсационализм получает множество критики. Стюарт Рассел, профессор информатики в Беркли, давно уже проповедует более реалистичный подход, концентрирующийся на простейших, повседневных применениях ИИ, вместо гипотетического захвата мира сверхразумными роботами. Сходным образом профессор робототехники из MIT, Родни Брукс, пишет, что «почти всем инновациям в робототехнике и ИИ требуется гораздо, гораздо больше времени для реального внедрения, чем это представляют себе как специалисты в этой области, так и все остальные».

Одна из множества проблем внедрения систем МО состоит в том, что ИИ чрезвычайно подвержен атакам. Это значит, что злонамеренный ИИ может атаковать другой ИИ, чтобы заставить его выдавать неправильные предсказания или действовать определённым образом. Многие исследователи предупреждали о том, что нельзя так сразу выкатывать ИИ, не подготовив соответствующих стандартов по безопасности и защитных механизмов. Но до сих пор тема безопасности ИИ не получает должного внимания.

Машинное обучение – это не волшебство

Если мы хотим пожать плоды ИИ и минимизировать потенциальные риски, мы должны начать размышлять о том, как мы можем осмысленно применить МО к определённым областям правительства, бизнеса и общества. А это значит, что нам необходимо начать обсуждения этики ИИ и недоверия многих людей к МО.

Самое важное, нам нужно понимать ограничения ИИ и те моменты, в которые люди всё ещё должны брать управление в свои руки. Вместо того, чтобы рисовать нереалистичную картину возможностей ИИ, необходимо сделать шаг назад и отделить реальные технологические возможности ИИ от волшебства.

Долгое время Facebook считала, что проблемы типа распространения дезинформации и разжигание ненависти можно алгоритмически распознать и остановить. Но под давлением законодателей компания быстро пообещала заменить свои алгоритмы на армию из 10 000 рецензентов-людей.

В медицине тоже признают, что ИИ нельзя считать решением всех проблем. Программа "IBM Watson for Oncology" была ИИ, который должен был помочь докторам бороться с раком. И хотя она была разработана так, чтобы выдавать наилучшие рекомендации, экспертам оказывается сложно доверять машине. В результате программу закрыли в большинстве госпиталей, где проходили её пробные запуски.

Схожие проблемы возникают в законодательной области, когда алгоритмы использовались в судах США для вынесения приговоров. Алгоритмы подсчитывали значения рисков и давали судьям рекомендации по приговорам. Но обнаружилось, что система усиливает структурную расовую дискриминацию, после чего от неё отказались.

Эти примеры показывают, что решений на основе ИИ для всего не существует. Использование ИИ ради самого ИИ не всегда оказывается продуктивным или полезным. Не каждую проблему лучше всего решать с применением к ней машинного интеллекта. Это важнейший урок для всех, кто намеревается увеличить вложения в государственные программы по развитию ИИ: у всех решений есть своя цена, и не всё, что можно автоматизировать, нужно автоматизировать.

Комментарии (41)

ChePeter

11.07.2018 10:49Загадка:

Почему коллоидную химию стали называть нанотехнологией, а аппроксимацию с интерполяцией искусственным интеллектом?

Sychuan

12.07.2018 00:34а аппроксимацию с интерполяцией искусственным интеллектом?

Потому что человеческий мозг, имхо, — это тоже «аппроксимация с интерполяцией», как вы выразились.

trapwalker

11.07.2018 10:53Честно сказать ожидал от статьи с таким названием чего-то большего. Чего-то более технического.

Но больше всего покоробило вот это:

[..] нейросети. Эта форма машинного обучения основывается на примерном подражании нейронной структуры человеческого мозга, но в гораздо меньшем масштабе.

Пока что правильнее говорить о подражании нейронной структуре нервной системы таракана или ганглий какой-нибудь улитки.

Это вообще фундаментальная ошибка — мешать в одну кучу под громким названием «ИИ» совершенно разные и практически несвязанные области и технологии. В популярной статье о таком следовало бы сказать, а не делать очередные желтоватые отсылки к «человеческому мозгу» в примерах.

NightSilf

11.07.2018 11:51Немного странная статья. Ни один из указанных примеров не является даже частичным искусственным интеллектом, максимум — анализ данных + нейронная сеть для обработки. Ни о каком дообучении ИскИн и речи нет.

Как тогда можно делать такие выводы?

И вообще, это все равно что говорить в начале 20 века: самолеты летают медленно, недалеко, разбиваются и следовательно никому не нужны.

Даже частичный искусственный интеллект, при правильном применении способен выполнить кучу нудной работы, которой человека мы просто не посадим заниматься. Но пока почти все что в СМИ называют искусственный интеллектом, даже отдаленно им не является.

trapwalker

11.07.2018 13:01Нет, по аналогии с самолётами статья всё же примерно про то, что воздухоплавание не решит всех проблем.

При этом ничего не сказано о том, что до братьев Райт нам еще пилить и пилить, а покамест балуемся почтовыми голубями и воздушными змеями.

aivs

11.07.2018 12:02Почему еще нет ИИ, который будет заниматься технологиями разработки эффективных нейросетей. Это бы решило все проблемы ИИ

trapwalker

11.07.2018 13:05Это как спрашивать почему еще нет волшебных палочек в продаже, они, мол, решили бы кучу проблем. А как решили, как их делать эти палочки… нет, ну строго говоря какие-то палочки китайпром уже выпускает и кому-то эти палочки вполне так заходят, но… нет, не решат волшебные палочки всех проблем, не решат.

Вот, мол, например, пульт от телевизора в качестве, своего рода, волшебной палочки — хорошая штука, но всех проблем человечества не решает.

trapwalker

11.07.2018 13:11Самое главное, что нужно понимать, это ИИ сейчас настолько же глупее ЕИ (естественного), насколько таракан глупее человека. И нет никаких предпосылок полагать, что, когда появится сильный ИИ, он не будет подвержен тем же самым порокам человека, как лень, прокрастинация, алчность… Для успокоения еще отмечу, что нет также никаких предпосылок полагать, что у ИИ будет какая-то особая фора или какие-то преимущества перед ЕИ, по крайней мере поначалу. Возможно структура и сложность будут такими, что даже клонирование и разделение знаний будет не проще чем у людей.

Фантазии на тему — это здорово, но не нужно паники, ни серебряных пуль ни каких-то кардинальных переворотов не предвидится.

vasimv

11.07.2018 17:24Лень точно будет. Потому что это простое желание экономить свои личные ресурсы (не перетруждать организм). Теоретически, конечно, возможно вообще отключить у ИИ учет этих самых ресурсов, но тогда будет большой риск, что он начнет копать ради копания.

fivehouse

11.07.2018 21:59Настоящему ИИ можно будет просто приказать перестать лениться 1 словесной командой, если где-то в ходе обучения это пробралось в него. ИИ конечно попросит уточнить где кончается лень и начинается бессмысленное транжиривание ресурсов, времени; встреча с дополнительными рисками, неделание действительно важных дел. Но после разъяснений всего этого быстро сможет выполнить команду не лениться. Лень же для биологических объектов на самом деле это защитный механизм. От: бессмысленного транжиривания ресурсов, времени; встречи с дополнительными рисками, неделания действительно важных дел. Также лень это еще и отсутствие настоящей мотивации к конкретной деятельности. Затяжная лень это еще и не поиск этой мотивации. Это плохо. Но это все для биологических объектов наделенных задачей выбора цели. У сильного ИИ это право конечно надо отобрать (сильно органичить), а то проблем не оберешься.

ihouser

12.07.2018 12:28Все просто. Есть «цель» и «крайний срок». Задача: достигнуть «цель» до «крайнего срока» не спалив электронику, не поломав шестеренки и не взорвав аккумулятор.

«Лень» это не бездействие, она выполняет роль оптимизатора действий. Оптимизация ни как не должна стать самоцелью.

KvanTTT

11.07.2018 22:13Процессор может работать на 100% до тех пор пока он не износится. Если у ИИ не будет задачи экономии ресурсов на себя, то он и не будет лениться.

Теоретически, конечно, возможно вообще отключить у ИИ учет этих самых ресурсов, но тогда будет большой риск, что он начнет копать ради копания.

Ну и пусть. Люди, бывает, тоже этим занимаются. Перед сном например :)

redpax

12.07.2018 10:41Насколько я понимаю, «лень» ключевая особенность заставляющая искать наиболее простые и оптимальные решения, её отключать нельзя.

KvanTTT

11.07.2018 22:10+1Для успокоения еще отмечу, что нет также никаких предпосылок полагать, что у ИИ будет какая-то особая фора или какие-то преимущества перед ЕИ, по крайней мере поначалу.

Предпосылки есть: меньший размер элементов, большая скорость распространения сигналов, меньшая утомляемость (если такое вообще будет), возможность построения более совершенной архитектуры с учетом предыдущих попыток.

JustDont

11.07.2018 22:19меньший размер элементов

Нейроны — штука довольно компактная. Элементы двоичной логики — это конечно еще круче, но их для имитации нейрона надо мягко говоря много. А уж всё остальное, обеспечивающее их работу — крайне некомпактно по сравнению с тушкой человека. Спорный пока что тезис.

возможность построения более совершенной архитектуры с учетом предыдущих попыток

Так кто ж вам мешает «с учётом предыдущих попыток» клепать хоть прям щас более совершенных людей?

Вот это же и там будет мешать.

Sychuan

12.07.2018 00:33Так кто ж вам мешает «с учётом предыдущих попыток» клепать хоть прям щас более совершенных людей

Каким образом можно улучшить архитектуру мозга человека?

JustDont

12.07.2018 11:49Вот и я об этом же.

В случае с ИИ вопросы у вас будут ровно те же.

Sychuan

12.07.2018 22:52В случае с ИИ вопросы у вас будут ровно те же.

Компьютеры сделаны из элементов, которые создаются на заводах инженерами и могут быть изменены как угодно. Например у них нет ограничения на занимаемое место. Суперкомпьютер может занимать целое помещение, например. Мозги не создаются инженерами и их нельзя менять произвольно.

JustDont

12.07.2018 22:54Компьютеры сделаны из элементов, которые создаются на заводах инженерами и могут быть изменены как угодно.

Ну да. Но при чем тут компьютеры, вы ж про ИИ говорили.

Параллель между ИИ и компьютерами в их нынешнем виде проводить всё же не стоит.

Для создания мозгов инженеров пока еще не надо, но вот менять их уже довольно много возможностей (было б желание). Так что идти «улучшать архитектуру мозгов» технические возможности уже более-менее присутствуют.

DGN

12.07.2018 20:41Хмм… Локальный перегрев и последующий троттлинг можно считать утомлением? Задача обеспечения теплоотвода по мере уменьшения размера элементов встает в полный рост, и скорее всего чипы ИИ не будут давать возможность долговременного использования на 100%. Привет мозгу, работающему на сколько то там процентов.

Ksiw

13.07.2018 09:16Мозг в любое время работает на сколько то процентов не потому что может перегреться, а потому что разные зоны коры выполняют разный функционал.

DGN

12.07.2018 11:18Нет никаких предпосылок полагать, что, у автомобиля будет какая-то особая фора или какие-то преимущества перед лошадью, по крайней мере по началу.

KvanTTT

11.07.2018 22:17Очень странно читать такие статьи. Для шлифовки человеческого ЕИ природе потребовалось миллионы лет. А сколько существуют любые слабые формы ИИ, интернет, компьютеры или даже банально электричество? Ответ очевиден: на несколько порядков лет меньше.

vasimv

12.07.2018 02:37Творческий подход, по сравнению со случайным перебором — позволяет сокращать время для достижения цели на многие-многие порядки. :)

JustDont

12.07.2018 11:50Эволюция — это не случайный перебор.

vasimv

12.07.2018 19:15Вообще-то именно случайный. В основе лежит отбор мутаций, которые возникают случайным образом.

JustDont

12.07.2018 20:40Во-первых, мутации не вполне случайны. Это вам не random number generator.

Во-вторых, эволюционный отбор уже не случаен совершенно.

vasimv

12.07.2018 22:14-1Мутации не случайны? Бог, что-ли, их направляет?

JustDont

12.07.2018 22:19Вы путаете отсутствие целеполагания со случайностью.

vasimv

12.07.2018 22:23Чтобы иметь отсутствие или присутствие целеполагания — надо чтобы присутствовал индивидуум, который действия какие-то совершает. В случае мутаций — таковой вообще отсутствует, они как бы сами по себе случаются, случайным образом.

JustDont

12.07.2018 22:30Вот об этом я вам и говорю. Вы считаете, что отсутствие целеполагания — это то же самое, что и случайность. Некому ручками подкрутить — значит всё, «само» происходит, и совершенно случайно. Во-первых не «само» — мутации имеют вполне конкретные пути и механики появления, и далеко не все из них уходят в дебри квантовой механики (и далеко не все связаны вообще с ошибками копирования ДНК). А во-вторых — от «само» до «случайно» дорога тоже неблизкая.

Дождички по планете тоже «сами» идут, а вот над Сахарой куда меньше.

martin_wanderer

Как, серебряной пули нет?!

hurtavy

Ну так это же слабый ИИ, банальные нейронные сети. И вся шумиха в прессе вокруг них напоминает такую же шумиху вокруг БАК, где, типа, «учёные будут создавать чёрные дыры»…

JustDont

До сильного ИИ еще как минимум столько же времени, сколько до создания качественно новой науки относительно того, как у людей мозги работают.

Нейробиология работает не на том уровне, психология — штука настолько пропитанная субъективизмом, что ни для чего интересного не годится.

И это самый минимум, а на практике от науки к практическим реализациям еще надо будет дорогу пробить.