Команда Adobe рассказала о новом проекте, который ведет совместно с Калифорнийским университетом — создании искусственного интеллекта, способного выявлять контент, отредактированный при помощи продуктов компании. Первая разработка в серии, нейросеть под названием CNN, различает изображения, к которым применялся один из популярных фильтров Adobe Photoshop, почти в два раза успешнее, чем средний человек.

Как поясняют в посте представители компании, идея проекта во многом продиктована этическими соображениями. Разработчики Adobe приложили немало усилий, чтобы совершенствовать и популяризировать инструменты для редактирования изображений, аудиоклипов и других типов файлов. Однако одним из последствий их работы стало засилье поддельного контента. Нейросеть CNN — это попытка дать пользователям что-то вроде лакмусовой бумажки для интернет-браузинга.

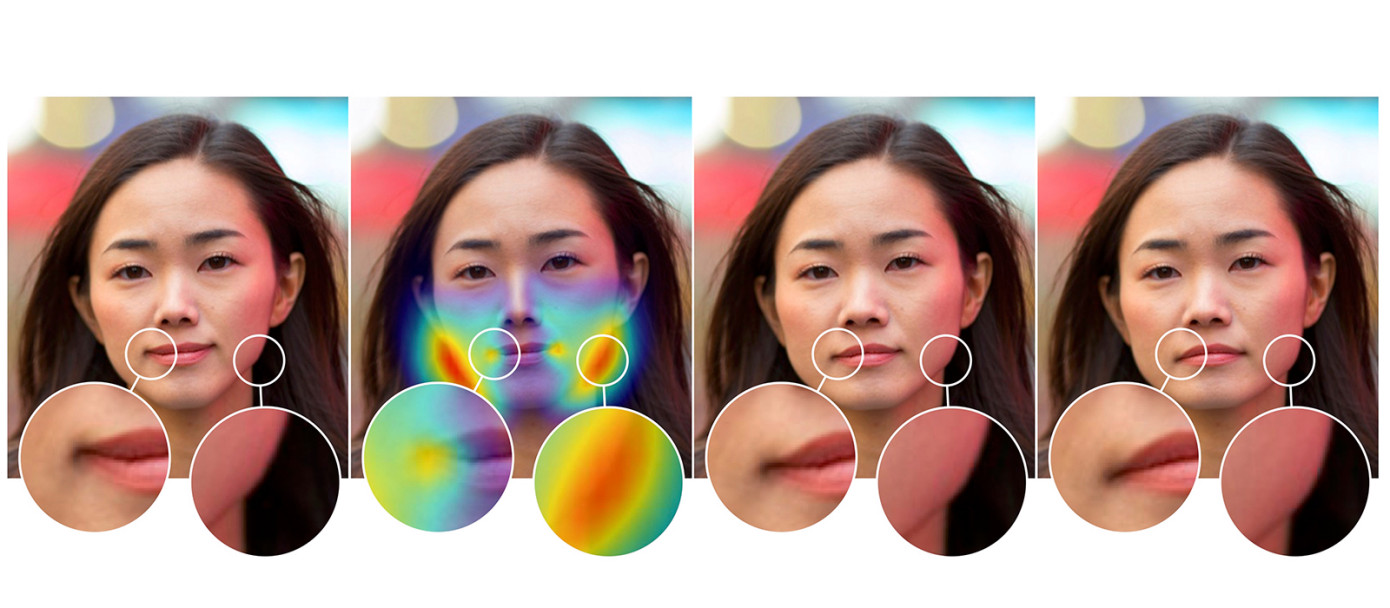

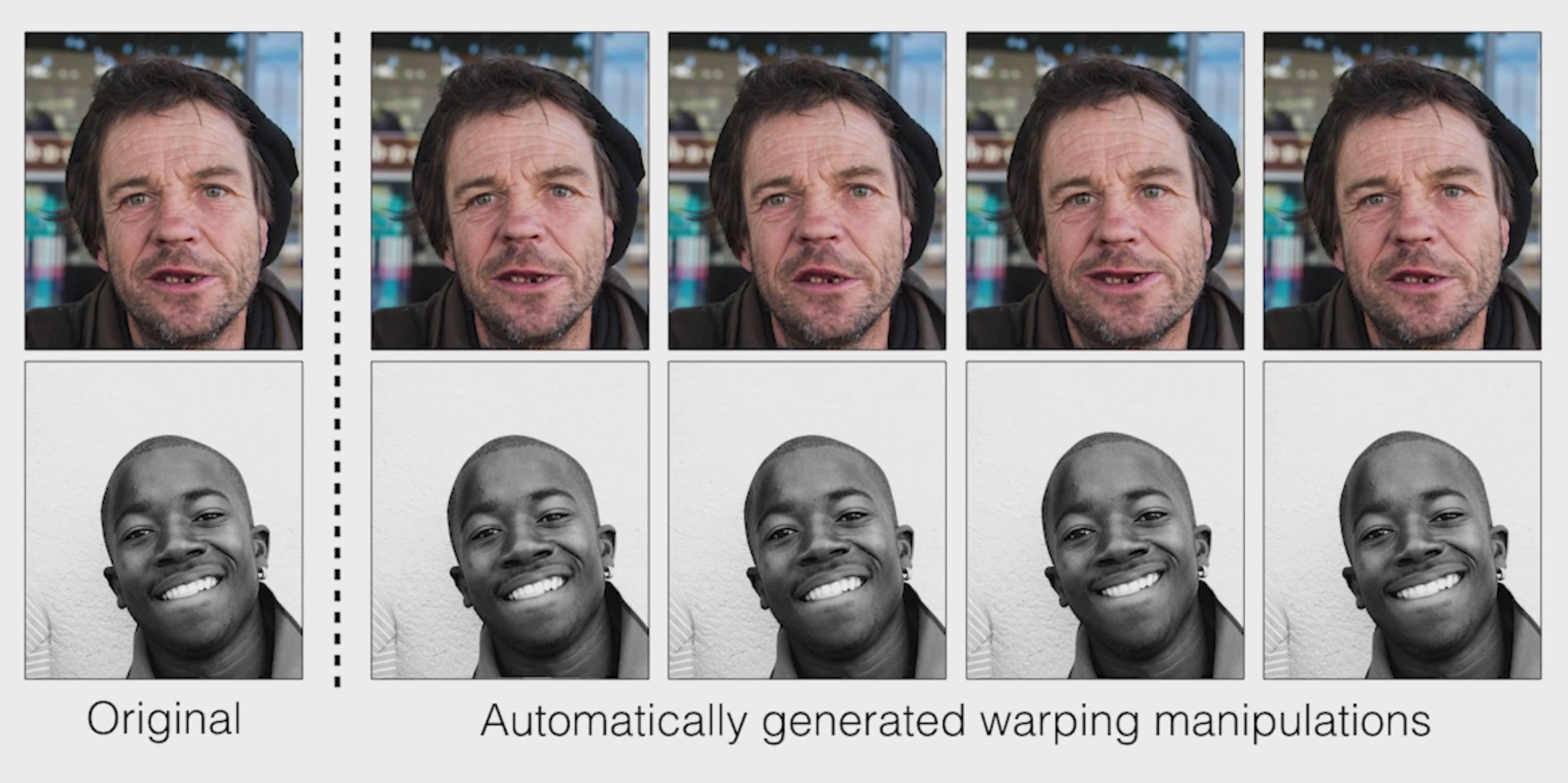

В представленной разработке реализована малая часть того диапазона возможностей, который Adobe намерена обеспечить в будущем. Нейросеть CNN работает только с изображениями людей и распознает только применение фильтра «Пластика». Данный инструмент был выбран для первой итерации по двум причинам: он пользуется большой популярностью для обработки портретных изображений и вносит в них очень тонкие, точечные изменения, которые человеческому глазу сложно уловить. В частности, фильтр может в значительной степени искажать не только черты, но и выражение лица.

Очерчивая функциональность технологии, авторы перечисляют следующие требования:

- Способность выявлять отредактированные лица с большей точностью, чем люди;

- Способность определять, какие именно изменения были внесены;

- Способность возвращать изображение к его исходному виду.

В процессе составления выборки разработчики отобрали несколько тысяч изображений из Сети и при помощи скрипта обработали каждое из них в Adobe Photoshop. Также был приглашен профессиональный художник, который внес на некоторые фотографии дополнительные коррективы. Искажения были разнообразными: изменялось положение глаз, нос или щеки делались тоньше, шире раздвигались в улыбке губы.

После завершения обучения случайным образом был выбраны пары изображений (оригинал — измененная версия) для тестирования. Параллельно с моделью тест проходила также группа людей, которых предварительно предупредили, что в каждой паре фотографий одна отредактирована. Исследователи хотели выяснить, насколько им удалось выполнить первое из заявленных требований — создать автоматизированную систему выявления подделок, более эффективную, чем человеческое зрение.

Итоги тестирования показали, что цель достигнута: люди давали правильные ответы только в 53% случаев, в то время как CNN определяла исходник с точностью, доходящей до 99%. В прочих отношениях нейросеть также показала «впечатляющие результаты»: она указывала на области, подвергнувшиеся воздействию фильтра, называла примененные инструменты и даже с приемлемой точностью восстанавливала оригинал.

Исследователи признают, что до универсальной волшебной кнопки отмены пока еще далеко — даже при самом оптимистичном сценарии они смогут обеспечить встроенную валидацию такого рода только для контента, который обрабатывался в Photoshop. Тем не менее, они рассчитывают и дальше развивать фотоэкспертизу средствами искусственного интеллекта. «Это важный шаг для выявления визуальных изменений определенного типа, и функция восстановления исходника работает на удивление хорошо, — говорит глава команды разработчиков Гэйвин Миллер. — Помимо таких технологий лучшая защита — просвещенные люди, которые понимают, что фотографии могут представать перед ними в искаженном виде — часто, чтобы их порадовать, но иногда и чтобы обмануть».

Комментарии (12)

DistortNeo

19.06.2019 20:09+1А потом создадут вторую нейросеть, которую научат обманывать первую, внося в картинку минимальные искажения.

amarao

19.06.2019 22:10Уже. GAN называется, вполне себе техника обучения нейронных сетей.

DistortNeo

19.06.2019 22:55GAN, всё-таки, предполагает попеременное обучение двух сетей, чтобы добиться наилучших результатов в этом деле.

shamaner

19.06.2019 20:59+1Вообще-то думаю всё прагматичнее:

- Проходят по проиндексированным фоткам.

- Определяют владельца.

- Смотрят есть ли лицензия у объекта и можно ли взять с него бабло.

raamid

22.06.2019 01:44А вот как эту систему можно взломать:

1. Редактируем изображение в фотошопе и сохраняем растр

2. Отрываем растр в Paint и изменяем пару пискселей. Сохраняем.

freeExec

22.06.2019 07:39Наивные, не прокатит. Они же аами пишут, что нужно другой инструмент модификации изображения применять.

PAE

19.06.2019 21:20Первая разработка в серии, нейросеть под названием CNN

Интересно, совпадение это или действительно pun intended?

S0mbre

19.06.2019 21:51+1Вряд ли вообще речь идёт о названии сети, скорее это принятая в западных источниках аббревиатура Convolutional Neural Network, т.е. сверточная нейросеть.

old_bear

20.06.2019 08:04Так и есть — в оригинальном тексте в явном виде написано:

By training a Convolutional Neural Network (CNN), a form of deep learning, the research project is able to recognize altered images of faces.

Так что тут банальное незнание предметной области переводчиком.

Barbaresk

19.06.2019 22:23+2Опять журналиста покусал учёный:

«Первая разработка в серии, нейросеть под названием CNN, различает изображения, к которым применялся один из популярных фильтров Adobe Photoshop, почти в два раза успешнее, чем средний человек.»

и

«Итоги тестирования показали, что цель достигнута: люди давали правильные ответы только в 53% случаев, в то время как CNN определяла исходник с точностью, доходящей до 99%. „

Если учесть, что выбор осуществлялся между 1 исходним и 1 отредактированным, то 53% — это по факту обычный рандом. А 99% — это угадывание поти всегда. Но да, “в два раза успешнее», лол.

edogs

21.06.2019 20:17«Может ли фотошоп применить фильтр настолько качественно, что бы его определитель фильтров не мог фильтр определить»©

AWSVladimir

Странно все это, распил бабла, что ли?

Я думал, что фотошоп давно уже «водяные знаки» вставляет в фотографии.

А оно вона чо Михалыч (с)