Amazon наложила годовой мораторий на доступ правоохранительных органов к своей крайне спорной системе Rekognition. Об этом компания вчера объявила в своем блоге. И это спустя всего два дня после похожего заявления IBM, решившей прекратить развитие своей похожей технологии.

Под давлением общественности компании согласились, что такие системы могут быть использованы для развития дискриминации и приводят к нарушению прав и свобод человека. От расовых и гендерных предубеждений пока что полностью избавить A.I. не получается.

Недостатки современных систем распознавания лиц лучше всего описали Джой Буоламвини, ученая из MIT, и Тимнит Гебру из Microsoft Research. В своей работе они определили, что у всех AI-систем, в том числе от Microsoft и IBM, существуют предубеждения против людей с темным тоном кожи. Проблема оказалось в том, что изображений белых людей в интернете просто больше, и в основном при тренировке машин используется эта информация.

Процент ошибок при распознавании темнокожих людей в итоге был в несколько раз выше. Это могло привести к не сильно веселым конфузам. Особенно в случае с Rekognition. Amazon продавала свою технологию полицейским для быстрого определения преступников в таких штатах, как Вашингтон, Орегон и Флорида. Хотя общественность говорила, что система для таких важных задач пока не годится. Например, в 2018-м Rekognition приняла за преступников 28 конгрессменов США.

Преступники, очевидно!

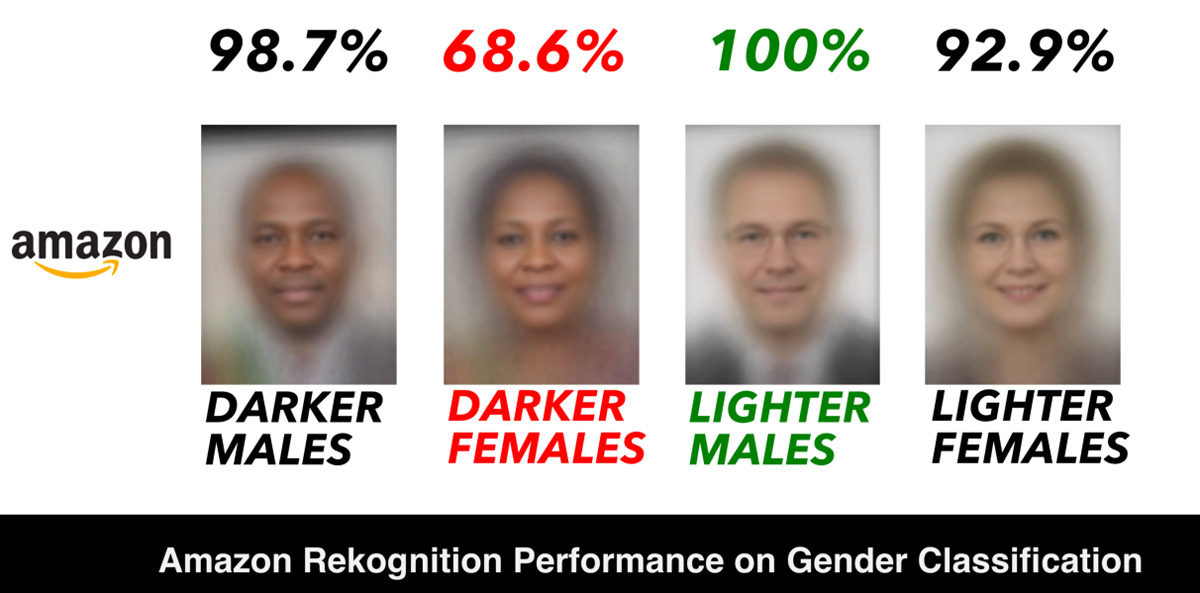

В другом исследовании 2019 года Буоламвини с соавтором Деброй Радж проаналазировали Rekognition и пришли к выводу, что ей было сложнее распознавать пол людей с более темной кожей. Многие чернокожие женщины засчитывались как мужчины. В то же время для белых людей таких ошибок почти не возникало.

Amazon попыталась опровергнуть такое исследование, но Буоламвини запостила очень детальный лонгрид на Medium, объясняя, что конкретно происходит с системой. Дальше выводы Джой подтвердила команда из десятка исследователей AI, которые опубликовали открытое письмо к Amazon с призывом не продавать технологию правоохранительным органам.

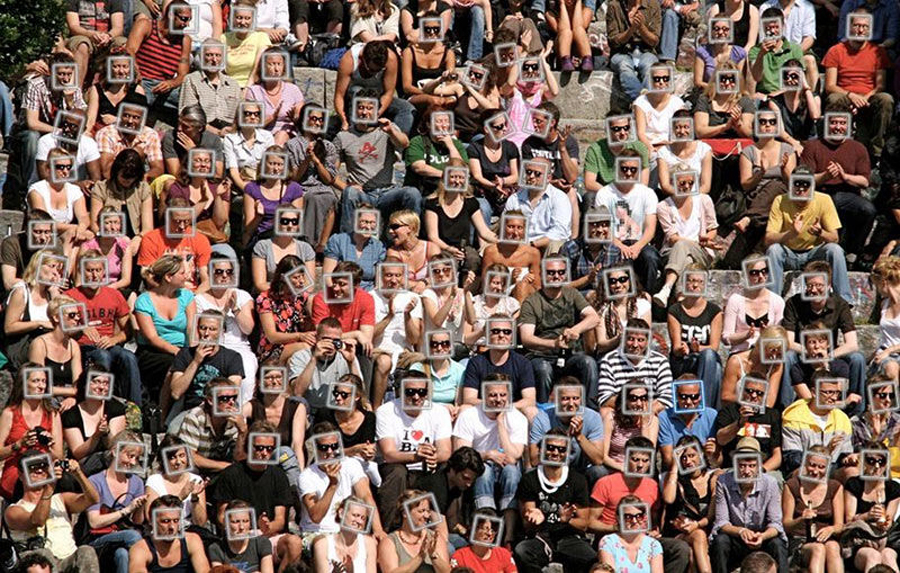

С тех пор прошло чуть больше года, и вот, на волне протестов в США, Безос решил взять время на доработку системы. В то же время Amazon говорит, что они продолжат предлагать Rekognition для развлечений (например, она хорошо проявила себя при трансляции королевской свадьбы и спортивных матчей). Также доступ к ней продолжат бесплатно получать правозащитные организации, занимающиеся вопросами пропавших детей и борьбой с торговлей людьми.

В то же время остаются другие системы, широко используемые полицией. Самой популярной (куда успешнее Rekognition) в США является Clearview AI. На эту довольно скрытную компанию недавно подали в суд за сканирование фото с социальных сетей и создание базы на более чем 3 млрд фотографий, которую она продает правоохранительным органам.

razielvamp

Даже беспристрастная AI подбрасывает чернокожим наркотики и лупит дубинами? :)))

Странно, что среди 28 "преступников" сенаторов темнокожих не так уж и много. Плохая выборка?

amphasis

С одной стороны смешно, с другой, система, которая плохо различает негров в стране где их аж 13%, вряд ли будет хорошо с ними обращаться. К чему приводят такие ошибки можно понять на примере наших сограждан автолюбителей, которым не повезло иметь машину-двойник в другом регионе. Вроде бы ты всегда можешь доказать, что это не ты, но количество твоего личного времени и нервов, требующееся на это, непропорционально больше по сравнению с тем, насколько быстро и просто выписывается штраф автоматизированной системой.

PS Никого не защищаю, я одинаково негативно отношусь как к погромам и мародерству, так и к полицейскому произволу, и считаю, что все кто в этом участвовал должны быть серьезно наказаны.

rehci

Но ведь конечное решение принимает все равно человек, аресты проводят пока не роботы. И если полицейский увидит, что не похож, наверное задержания не будет? Максимум документы проверят.

amphasis

Вопрос, с чем будет сравнивать полицейский? Ведь скорее всего у него будет ордер или протокол на конкретно этого распознанного человека, и сверять с видео если и будут, то уже в участке как минимум.

Я вас может быть удивлю, но и сейчас за каждым штрафом с камеры стоит отдельный ответственный человек, но очевидные для человека ошибки в протоколах все равно остаются. Люди создания ленивые, вспомните как легко расслабляется человек, например, в машине с "автопилотом" полностью доверяя ему управление, хотя от его решений будет зависеть его собственная жизнь, а уж когда дело касается незнакомого постороннего человека… пфф

rehci

С тем же, с чем сравнивает система распознавания: с фотороботом или фотографией. В отличии от штрафа за ПДД с подозреваемым надо поговорить на близком расстоянии и затем уже доставить для допроса. Это несколько разные вещи.

Другое дело, если его «распознали» по ошибке, а он оказался все равно виновен в другом преступлении: имел наркотики/оружие, разыскивался за другое преступление, нарушил правила УДО и т.д. Ну это уже сам виноват, побольше бы таких false-positive.