После двух статей начинающего «3D-печатника», я не планировал больше писать об этом хобби: совсем уж «начинающим» я перестал быть, да и материал этот из тех, что лучше всего усваиваются и осваиваются лишь на собственном опыте. Но определенная проблема, возникшая естественным путем, заставила меня написать эту статью и поделиться новым опытом (оцените мое упорство, учитывая то, что первая редакция данной статьи канула в небытие, почив «в бозе», а, точнее, в «недрах» глючного онлайн-редактора «хабра» ????).

Так вот, проблема заключается вот в чём: спустя определенное время, после освоения начал печати на 3D принтере, вы сталкиваетесь с вопросом – а что бы такого вам еще распечатать? Вы распечатали кучу простых 3D фигурок и осчастливили ваших родственников, знакомых и их детей. Вы, наконец-то, «взялись за ум», и «отбили» свой «бесполезный» 3D принтер, распечатав несколько полезных «гаджетов» для дома. Также, освоив один из 3D редакторов, вы ухитрились даже распечатать красивые обтекаемые коробочки для DIY-поделок (правда, к сожалению, они не видны вероятным «восторженным посетителям» ????, но «чувство гордости» у вас никто не отберет!). Вы даже попробовали (только немного) себя в 3D-моделизме: а ведь это действительно огромная и заслуживающая особого внимания область творчества; именно та область, где начинающий владелец 3D принтера может превратиться в абсолютного фаната 3D печати, и где ваша начальная «инвестиция» в $200-300 и несколько дней, посвященных увлечению, могут превратиться в тысячи долларов и сотен часов вашего времени, вложенные в оборудование, обучение, печать и раскраску моделей! Существуют сайты, продающие за весьма существенные деньги, отличнейшие 3D модели для печати; есть онлайн и оффлайн курсы, для обучения качественной раскраске (а это чрезвычайно важный момент) моделей – в общем, если вам данное хобби «зайдет», я искренне вам буду завидовать.

Мне, к сожалению, модельная печать не «зашла» (хотя я лично попробовал распечатать пару моделей, и даже подписался на пару групп в FB – их, вообще-то, множество – где люди печатают и раскрашивают чудеса в буквальном смысле слова, вроде моделей героев из Star Wars или Alien в «полный рост», или больших (50-60 см в высоту), фотореалистично раскрашенных фигур, либо созданием полнометражных «диорам» (тоже великолепно раскрашенных), распечатанных на 3D принтере (или, скорее, принтерах, ибо у каждого уважающего себя любителя моделизма, есть несколько различных 3D принтеров, и далеко не «стартовых» моделей).

Вот несколько фотографий из FB-группы «для затравки» (авось кому-то да зайдет). Впрочем, подобным хобби нужно заниматься всерьёз и долго!

Но что же тогда распечатать еще владельцу 3D принтера, который не хочет погружаться в высокое искусство печати и раскраски фотореалистичных моделей? «Вам хочется песен – их есть у меня!» Самая первая мысль, которая пришла мне в голову, была такой: было-бы здорово сделать 3D модели членов семьи. Я о подобном давно задумывался, только вот «велосипеда у меня не было». Теперь «велосипед» появился, и, значит, наступило время реализовать «хотелки».

Сначала я решил «пошоппаться» – а существуют ли сервисы, которые могут предоставить качественное 3D сканирование за приемлемые деньги? Оказалось, что, несмотря на все «хайповые» «виртуальные реальности», «3D миры и вселенные» и прочий маркетинговый булшит, который обожают интернет-«искперты» и блоггеры, подобных компаний фактически нет, а те, что были когда-то, практически полностью «вышли» (обанкротились). Я не буду постить ссылки на эти обанкротившиеся компании; единственно, могу лишь заметить, что в районе Большого Бостона (а это не самый маленький городок в США, особенно в IT бизнесе!) таких компаний просто не оказалось. Выяснилось, что даже у тех микро-компаний, которые врут на своих сайтах, что, дескать, они «владеют профессиональным 3D сканнером», правда заключается в том, что они давным-давно его продали или вернули производителю – потому, что не окупилось от слова «совсем». Впрочем, вру: из одной такой «конторы» мне прислали estimate на… $2500 ???? Так и видишь, как инженер этой компании, без перекуров и ланчей, все 8 или даже 10 часов подряд, каждый день, сканирует объекты, выставляя многотысячные счета клиентам! ???? (если кто не понял – это была ирония).

Когда «свободный капиталистический рынок» отпал за «отсутствием предложения», я занялся поисками «доморощенного решения». И, к своему удивлению, нашел его достаточно быстро. В моем случае это оказался… старый добрый «сенсор» Kinect от Xbox 360! Давным-давно, я экспериментировал («игрался») с Кинектом на PC, благо, и Микрософт, и энтузиасты предлагали весьма широкий спектр API и демок для этого. Для текущей моей задачи (то бишь 3D сканирования членов семьи) это оказался чуть-ли не единственный (а, вероятно, так и есть – если меня в комментах не поправят!) выбор. Перепробовав кучу рекомендованных интернетом программок, я остановился… на единственно работающей, Skanect. Сразу хочу сказать: бесплатная демо-версия, которую предоставляет компания, практически не функциональна (хотя работает, да), а платная – сильно overpriced; так, что для экспериментальных целей ее проще украсть, нежели купить (цена в $129, imho, сильно завышена; $30-40 было-бы более реалистичной ценой).

Использование Skanect-а тоже не так просто, как они описывают на сайте: мне потребовалось установить драйвера для Kinect-а версии 1.8, а также полный SDK с сайта Microsoft. Правда, я веду речь о Kinect-е от Xbox 360; возможно, с Kinect-ом от Xbox One инсталляция будет «гладкой».

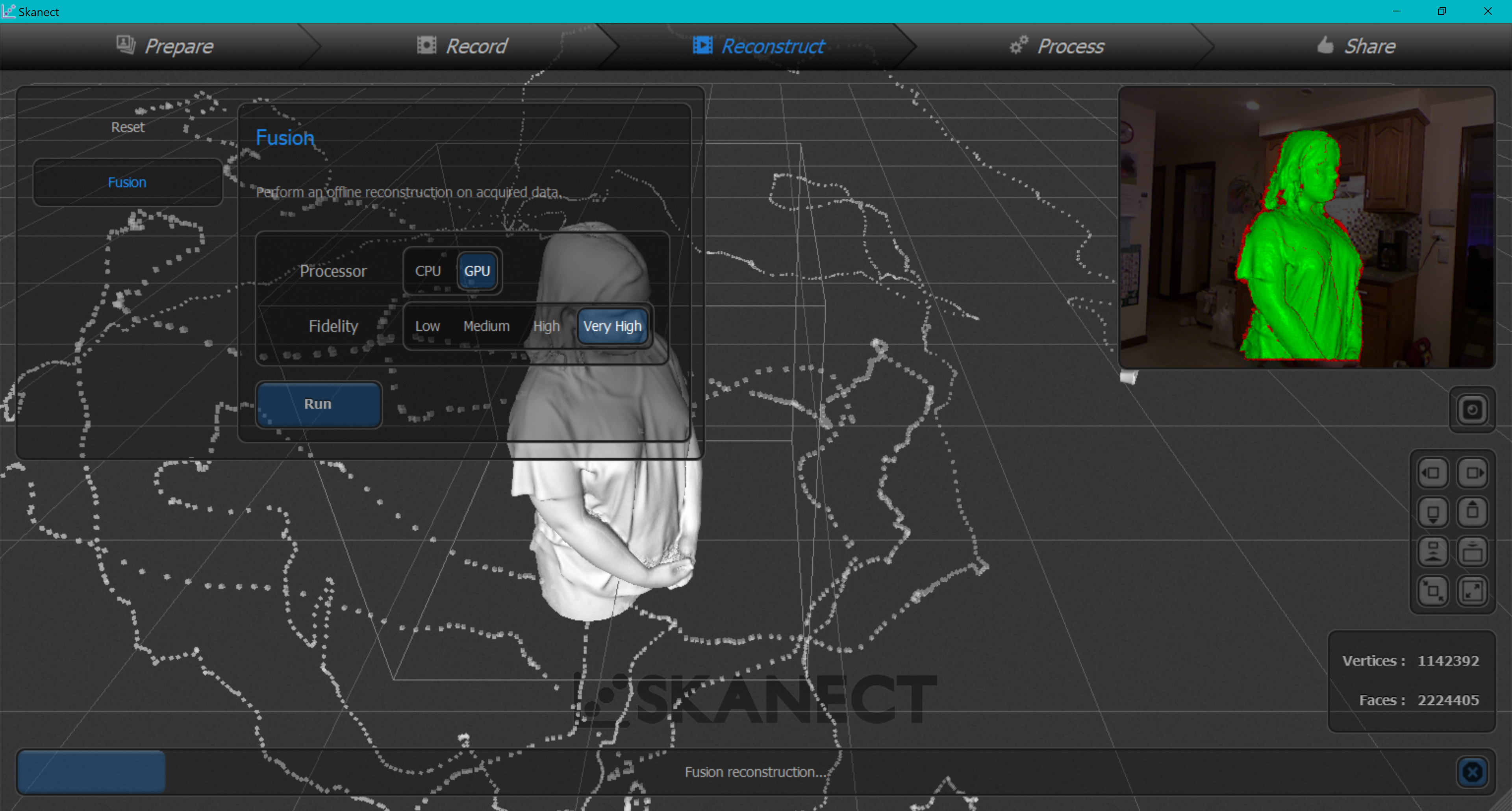

После запуска, программа должна «распознать» ваш Kinect, подключенный к компьютеру (если не распознает – ставьте полный SDK!). Настройки программы достаточно минималистичны (даже, чтобы разобрать не программисту), впрочем, они предоставляют определенный выбор «на поиграться» (я рекомендую вам поэкспериментировать с размерами bounding box). Процесс сканирования объекта чрезвычайно прост: начав сканирование, вы обходите модель вокруг, стараясь сделать «как можно больше зелёного». Отсканированные вертексы модели накапливаются, вы можете сканировать, пока не добьетесь «полной зелени», то бишь полностью отсканированного объекта. Небольшой совет: в данном случае «Машу каслом не испортишь», и, чем больше точек вы захватите – тем лучше. Сканируйте тщательно, глядя на экран ноутбука (чтобы не потерять объект из трекинга), сканируйте и вверху, и внизу – в общем, со всех возможных точек!

После завершения сканирования, программа воссоздаст 3D модель, которую вы сможете экспортировать в 3D формате (например, .stl). Дальше можно обработать/подправить модель в вашем любимом 3D редакторе (для печати не забудьте сделать модель solid!).

Программа Skanect спроектирована достаточно user friendly; без сомнения, вам придется не раз поэкспериментировать, чтобы добиться приемлемого результата, но это достаточно весело и просто. Правда, с мощным GPU (да, Skanect умеет использовать GPU для расчетов) дело пойдет значительно быстрее.

Минусы Skanect естественны: вам не стоит рассчитывать на «профессиональное качество сканирования», что бы они не писали на своем сайте ☹ К сожалению, качество оставляет желать лучшего (а где его взять-то?!) – модели, даже при небольшом bounding box, получаются весьма «примерные». Т.е. вполне узнаваемые, но, в сравнении с профессиональными сканами, не выдерживающие никакой критики. Но, к сожалению, похоже, что это, на данный момент, единственно доступный вариант. Правда, я работал только с Kinect от Xbox 360; Kinect для Xbox One, по идее, должен давать немного улучшенный вариант (там камеры получше), но я пока не хочу тратиться, не зная результата. Но если кто попробовал/попробует с «новым» сенсором от Xbox One – пожалуйста, дайте мне знать!

By the way, результаты, полученные с моим «оборудованием», чрезвычайно впечатлили как мою супругу, так и детей, и близких друзей. На мой взгляд, это очень интересное направление – возможность сохранить «3D фотографии» своих близких в виде скульптур. Плюс в том, что это – достаточно дешевое решение, не требующее от вас каких-то «инвестиций». Сканируй, печатай (и раскрашивай, если есть талант) – and enjoy!

В завершение статьи, хочу дать еще несколько советов начинающим владельцам FDM 3D принтеров:

-

в отличие от обыкновенных (струйных или лазерных) принтеров, ваш принтер содержит «расходуемые материалы» by design. Говорят, что «вода камень точит»… Я не в курсе взаимоотношений воды и камней, но могу однозначно сказать, что за 3-4 месяца подающая шестеренка экструдера, изготовленная из непонятного китайского сплава, однозначно истирается (хотя, по идее, имеет дело лишь с пластиком!).

Истирание этой шестеренки ведет к драматическому ухудшению качества печати, так, что будьте готовы к регулярной замене этой детали. Благо, цена вопроса – буквально копейки!

существует еще один источник возможных проблем: это печатающая головка, hot end. Ее желательно время от времени прочищать, идущей в комплекте иглой, а иногда и просто менять. За 5 месяцев владения принтером от Creality, с другими проблемами я (knock-knock on a wood!), слава Богу, не сталкивался. Но extruder и hotend прикупил новые (благо, цена вопроса всего $20). Еще пришлось докупить покрытие печатного стола (купил сразу пару магнитных, благо были на сейле), и еще одно стекло.

Дата-центр ITSOFT — размещение и аренда серверов и стоек в двух дата-центрах в Москве. За последние годы UPTIME 100%. Размещение GPU-ферм и ASIC-майнеров, аренда GPU-серверов, лицензии связи, SSL-сертификаты, администрирование серверов и поддержка сайтов.

Комментарии (28)

ivpetrov386

15.02.2022 13:15Какой принтер порекомендуете начинающему? Нет никаких пока конкретных целец, просто хочу 3д печать попробовать в домашних условиях.

usa_habro_user Автор

15.02.2022 13:19Читайте мои статьи о 3D печати. Но это рекомендации, скорее, для США, нежели для России.

usa_habro_user Автор

15.02.2022 13:41-3Прикол! :) Только что зашел странный "хейтер": последовательно "минусонул" статью, мою "карму", и каждый мой комментарий...

Убогенький, что ты сказать-то хотел? Поделиться с миром, видимо, тебе просто нечем - но откуда столько ненависти?!

Я поражаюсь все-таки хабровской публике (сколько раз зарекался сюда писать...) - ну, если вы хотите быть, ну, или считать себя "европейцами" - так начинайте, млин, с себя, прежде всего!

ramil_trinion

15.02.2022 15:30+8Прикол! :) Только что зашел странный "хейтер": последовательно "минусонул" статью, мою "карму", и каждый мой комментарий...

Я не тот самый "хейтер", но вашему посту поставил минус и вам в карму тоже. Объясню почему и постараюсь ответить на ваши вопросы к аудитории.

Минус статье за то что статья плохо структурирована и содержит недостаточно технической информации.

Убогенький, что ты сказать-то хотел? Поделиться с миром, видимо, тебе просто нечем - но откуда столько ненависти?!

А вот за это минус в карму. Человек всего лишь поставил вам минус, а вы его уже убогеньким назвали. Хотя это мог быть и не один человек, представьте себе.

Я поражаюсь все-таки хабровской публике (сколько раз зарекался сюда писать...) - ну, если вы хотите быть, ну, или считать себя "европейцами" - так начинайте, млин, с себя, прежде всего!

Ну не пишите значит если зарекались. И не надо всех одним миром мазать. Кстати, не понял чем вам европейцы не угодили.

usa_habro_user Автор

15.02.2022 20:21-5Минус статье за то что статья плохо структурирована и содержит недостаточно технической информации.

Какого рода "технической информации" вам не хватает? Снимков вставления штекера в USB разъем, или скриншотов стандартной процедуры установки драйвера? Или кучи скриншотов описанной программки? Дык, не стоит оно того: настроек там немного, и особым опытом не поделишься. Намного лучше самому попробовать, ибо "результат - на лицо" :)

Я описал реально существующую проблему (и не только у меня), и один из способов ее решения (временного, конечно). Любой владелец 3D принтера запросто сможет воспроизвести мой опыт.

Ну не пишите значит если зарекались.

Ну, а это, слава Богу, не вам решать.

Кстати, не понял чем вам европейцы не угодили.

К "европецам" у меня нет вопросов и претензий - только к "дорогим россиянам". Откуда у вас столько ненависти и злобы берется? Проглядите, смеха ради, мои статьи - вы серьезно считаете, что мне нужно заткнуть рот и запретить писать, дабы не расстраивать вас, хейтеров? Или, все-таки, кому-то мои статьи будут полезными, но вам начхать на этих "кому-то", потому, что это не вы? BTW, я заглянул в ваш profile и посмотрел статьи, что вы опубликовали: ни одна не вызвала желания ее прочесть (впрочем, не только у меня, судя по рейтингам), но это же не повод "затыкать вам рот"? Пишите на здоровье, но, главное, комментируйте по делу!

ramil_trinion

15.02.2022 22:37+1Какого рода "технической информации" вам не хватает? Снимков вставления штекера в USB разъем, или скриншотов стандартной процедуры установки драйвера? Или кучи скриншотов описанной программки? Дык, не стоит оно того: настроек там немного, и особым опытом не поделишься. Намного лучше самому попробовать, ибо "результат - на лицо" :)

Числовых данных, точных. Объективных, а не в духе сочинения "как я провел лето".

К "европецам" у меня нет вопросов и претензий - только к "дорогим россиянам". Откуда у вас столько ненависти и злобы берется? Проглядите, смеха ради, мои статьи - вы серьезно считаете, что мне нужно заткнуть рот и запретить писать, дабы не расстраивать вас, хейтеров? Или, все-таки, кому-то мои статьи будут полезными, но вам начхать на этих "кому-то", потому, что это не вы? BTW, я заглянул в ваш profile и посмотрел статьи, что вы опубликовали: ни одна не вызвала желания ее прочесть (впрочем, не только у меня, судя по рейтингам), но это же не повод "затыкать вам рот"? Пишите на здоровье, но, главное, комментируйте по делу!

Я вас не затыкаю и как раз таки дискутирую с вами.

usa_habro_user Автор

15.02.2022 22:52"Минусуя" карму, вы таки "затыкаете рот" - странно, что вы этого не знаете.

Какого рода "числовые данные" вам нужны? Я не писал эту программу (это достаточно сложное коммерческое software); пользователю совершенно не нужно вникать, как это работает "внутри" - к слову сказать, Kinect проделывает "львиную долю" работы, в силу своего оригинального предназначения. Потому я с таким скепсисом и отнесся к комментарию юзера @mad_s - из видео или серии изображений просто невозможно извлечь информацию о "глубине", и, соответственно, построить правильную сетку.

Рамиль, вот, если честно: вы пишете лишь потому, что "в интернете кто-то не прав", или же вам реально интересн мой пост? Просто у меня есть ощущение, что я "мечу бисер"... впустую, так сказать... У меня нет ни малейшего побуждения доказать вам, что вы не правы - да это и теоретически невозможно, а уж тем более тут!

P.S. Вообще, чрезвычайно странные комментарии под этим постом: вместо обсуждения технологии (довольно интересной, по моему мнению) обсуждается и "осуждается" мой пост! В конце-концов, вас кто-то заставляет читать мои статьи? Ну, не нравлюсь я вам по какой-то причине - дык, просто не читайте! Я вот ваши статьи и за $100 кэшем читать не буду - там одних названий хватает :)

JimyJimy

17.02.2022 09:19+1из видео или серии изображений просто невозможно извлечь информацию о "глубине", и, соответственно, построить правильную сетку.

Тем не менее живем мы в стерео мире, смотрим глазами и этого хватает для того, чтобы правильно разместить руку в нашем 3д пространстве и слепить скульптуру.

В Kinect 1 поколения(XBox360), который тут рассматривается далеко в этом плане не ушел - проекция IR точек, а затем измерение угла полученного относительно камеры и проектора - это все та же стереометрия.

Kinnect 2 поколения(XBox One) - это уже интереснее(ToF камера), но у 3д построителей мешей не прижилось, шумный датчик для этого(он интереснее для захвата движения).

А человек вам предложил Meshroom - т.к. это самая юзерфрендли, продвинутая, бесплатная программа для работы с фотограмметрией(не без недостатков Nvidia CUDA - могем, OpenCL - не могем).

Что касается меня, я пробовал фотограмметрией "слепить" 3д лицо(тело), но на тот момент результат меня не устроил и анализируя проделанную работу, я понимаю, что были ошибки и по освещению и по настройкам фотоаппарата.

usa_habro_user Автор

17.02.2022 09:28-1Модель, полученную лично вами путем использования Meshroom, с кратким how to, сможете выложить? Иначе это все "разговоры для бедных", как говорится. Ведь дел-то на пару минут (ну, выложить модель). Впрочем, подозреваю, что нет - вы сами пишете, что у вас ничего хорошего не получилось.

P.S. Если вам интересно, то я могу модели (в stl) моих детей для вас выложить, и кинуть ссылку в "личку".

JimyJimy

18.02.2022 08:10Kinect замечательная вещь, и сам бы ее прикупил (если бы время на нее было). Есть много замечательных проектов связанных с ним... но фокусировка точек, к сожалению не позволяет получить приемлемое(для меня) качество полученного материла.

Пробовал Agisoft PhotoScan, Regard3D, MeshLab и другие, до чего мог дотянуться в 2019 году. Все они давали примерно одинаковую модель, но без допиливания blender'ом я бы в продакшен, это не пустил.

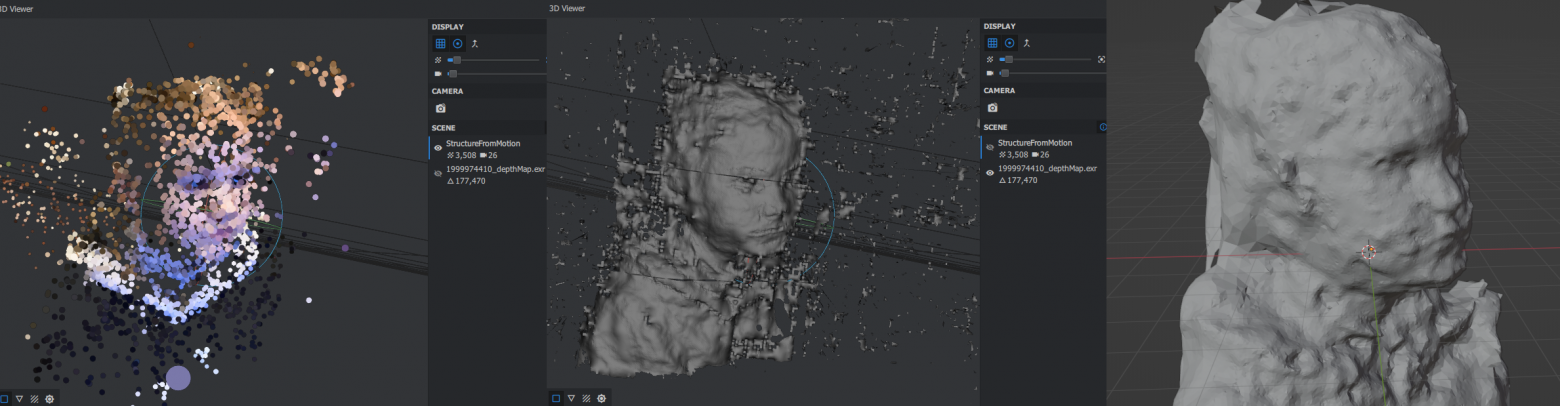

Накидал тест в Meshroom, 26 из 37 фото задействованы, что говорит о плохой подготовке материала. Фотограмметрия она очень привередливая штука, но это не говорит, что нельзя добиться качества.

Meshroom -> Blender

usa_habro_user Автор

18.02.2022 08:31-1Во-о-от, и я о том-же: ведь перед тем, как писать комментарий, я кратко прогуглил "Meshroom human scan", и увидел лишь "уродцев", что и у вас получились - сравните, для примера, с моделями, что я сделал за 5 минут. Молодые люди на рекламных клипах могут сканировать бревна сколько угодно, и, не буду исключать вероятность, возможно, для каких-то применений это как-то и работает. Но совершенно не для того, о чем я написал в статье!

Жалко, что эта тема не заинтересовала людей, увлекающихся 3D печатью, а лишь "хейтеров", которым важно доказать, что в "интернете кто-то не прав" :(

Я искренне надеялся, что найдется человек, который попробует описанную мной программку с Kinect-ом 2.0 (от Xbox One) - если там качество будет хотя-бы в полтора-два раза выше, чем у моего Kinect-а (Xbox 360), то вполне можно за $50-60 взять с eBay-я (их там, "как грязи" по приемлемым ценам).

P.S. Еще, пишут, родная MS-овская утилита (под Windows 10) умеет работать с Kinect-ом в целях 3D сканирования. Но они убрали оттуда поддержку первого кинекта, так, что проверить не могу. Все-таки надеюсь, что кто-то попробует, и покажет результат!

ramil_trinion

16.02.2022 10:03+1"Минусуя" карму, вы таки "затыкаете рот" - странно, что вы этого не знаете.

Да да, а хабр это гулаг. Механизм кармы не для того чтобы затыкать, а для того чтобы оценивать. Вы все равно можете размещать посты и комментарии, никто вам не запрещает.

Какого рода "числовые данные" вам нужны? Я не писал эту программу (это достаточно сложное коммерческое software); пользователю совершенно не нужно вникать, как это работает "внутри" - к слову сказать, Kinect проделывает "львиную долю" работы, в силу своего оригинального предназначения. Потому я с таким скепсисом и отнесся к комментарию юзера @mad_s - из видео или серии изображений просто невозможно извлечь информацию о "глубине", и, соответственно, построить правильную сетку.

Рамиль, вот, если честно: вы пишете лишь потому, что "в интернете кто-то не прав", или же вам реально интересн мой пост? Просто у меня есть ощущение, что я "мечу бисер"... впустую, так сказать... У меня нет ни малейшего побуждения доказать вам, что вы не правы - да это и теоретически невозможно, а уж тем более тут!

Я просто даю обратную связь по статье.

P.S. Вообще, чрезвычайно странные комментарии под этим постом: вместо обсуждения технологии (довольно интересной, по моему мнению) обсуждается и "осуждается" мой пост! В конце-концов, вас кто-то заставляет читать мои статьи? Ну, не нравлюсь я вам по какой-то причине - дык, просто не читайте! Я вот ваши статьи и за $100 кэшем читать не буду - там одних названий хватает :)

Меня никто не заставлял прочесть вашу статью, меня заголовок привлек.

usa_habro_user Автор

16.02.2022 18:55-1"Дискутировать", одновременно пытаясь заткнуть рот, немного странно, вы не находите? А "гулагом", по вашему выражению, хабр делают люди, хотя и вина администрации в потакании подлым человеческим инстинктам, безусловно, существует.

У вас нет 3D принтера, и вы явно не заинтересованы в теме, но "заминусовали" статью, и, следовательно, уменьшили шансы людей, кому было-бы реально интересно это попробовать, просто прочесть о такой возможности! Притом вы привели смехотворные "аргументы" про какие-то отсутствующие "числовые данные" (sic!) Я понимаю, что вам, вероятно, и читать-то было лень, скользнули взглядом сверху вниз, но я лично вас уверяю - в статье есть вся необходимая информация, чтобы опробовать эту технологию.

Galperin_Mark

16.02.2022 10:17-1На 3D-принтерах уже печатают кузова гиперкаров. Но думаю, придет время и будут печатать обычные автомобили. Да и всю остальную технику тоже.

usa_habro_user Автор

16.02.2022 18:47Даже дома уже печатают, и космические ракеты. Правда, в домашних технологиях 3D печати особого прогресса, особенно в плане убыстрения, пока не наблюдается (хотя качество, особенно достигнутое resign 3D принтерами, уже потрясающее).

Ringenium

17.02.2022 12:05Дайте ссылку на группы откуда фотки моделей брали, особенно дроид интересует)

usa_habro_user Автор

17.02.2022 12:15Это не группы, а магазин Gambody (нужно покупать, да). Но при желании и старании можно найти "пиратские", украденные архивы с моделями оттуда.

P.S. Дроид не сильно и дорогой, кстати.

mad_s

А чем не устроил пайплайн на базе того-же опенсорсного AliceVision Meshroom? Там имхо качество воссоздания модели должно быть выше - по крайней мере если впихнуть больше исходных кадров.

usa_habro_user Автор

Первый раз слышу. Покажите ваши модели, созданные с этим "пайплайном", если не сложно.

P.S. Или это "диванное imho": "я свидетель! а что случилось?!"

mad_s

Под руками сейчас ничего нет, но... Для понимания что и как: снимаем объект на видео , просто обходя вокруг него (хоть на мобильник, к примеру). Сгоняем ролик на комп и конвертим его в серию JPG (от размера картинки и частоты преобразования зависит качество конечной модели, ну и время воссоздания, естественно). Кучку полученных картинок закидываем в Meshroom, там воссоздаем по ним модель (с текстурами, кстати), затем ее в любой 3D редактор (хоть в блендер) где чистим и готовим к печати. Вот первый попавшийся ролик "от и до", там все просто, на самом деле.

Очень много 3D сканов на sketchfab.com делали именно там, советую поискать по слову "meshroom", попадаются крайне занимательные.

PS: Таки нет, мнение именно свое, полученное опытным путем :) Для пары-тройки своих проектов нужен был 3D-скан (не под печать, под VFX) - юзал именно Мешрум. Хотя снимал не на мобильник а на камеру.

usa_habro_user Автор

Извините, но из вашего описания это звучит... ну, как "удаление гланд через заднепроходное отверстие автогеном" ;)

Я описал в этой статье (естественно, отнюдь не мое "изобретение") самый простой и естественный путь получения 3D модели. То, что вы описали, звучит... ну, если честно, то я просто "забил" на подобную "методу".

P.S. И словом "пайплайн" (по-русски, кстати, означает просто "конвеер") пользуйтесь чуть осторожнее - ведь вы же не менеджер по продажам? ;)

mad_s

Дело вкуса, однако. Но решение, про которое я говорю, имееет массу плюсов. Главных два: модель мы получаем по сути из видео (ну пусть из секвенции статичных картинок). А то самое видео мы можем снять на что угодно и где угодно. Это раз. И два, качество полученной в итоге модели зависит только от нашего желания, т.е. разрешения исходника и процессорных ресурсов, затраченных на востановление из стиллов итогового облака точек.

Как мне кажется большинство контор 3D сканирования закрылись именно из-за появления доступных (бесплатных) и качественных решений наподобии Meshroom.

PS: Востановить в том-же Мешрум модельку наподобии вот этой - дело максимум одного дня (отснять/согнать/посчитать/почистить/отослать заказчику). И это по стремящейся к нулю цене. А вот альтернатиыные решения или не дадут нужного качества, или выйдут по деньгам как крыло от Боинга.

usa_habro_user Автор

Сергей, я готов поверить вам на слово, но по предъявлению простейшего "how to" и пруфов! Давайте обойдемся без отвлеченных понятий "получаем по сути через пайплайн" - вы, это, "на пальцах" мне расскажите и продемонстрируйте! А лучше - напишите простую статью "Вот так я отсканировал в 3D, в высоком качестве, свою дочь".

Ту технологию, что я описал выше (правда, сорри, без скриншотов типа "как подключить в USB" и "как проинсталлировать драйвер" - imho, здешняя аудитория осилит это и без скриншотов), любой может воспроизвести прямо хоть сейчас дома. А вы лишь дали ссылку на бесполезный сайт бесполезного стартапа (который спит и видит - "кто бы меня купил?!" - там только баннера не хватает!)

P.S. Прогуглите, фана ради, что такое есть "сенсор Кинект", чисто для "прикола". И чем он отличается от "левых" стартапов с "пайплайнами"...

mad_s

Ну при чем здесь сайт/стартап? Meshroom давным давно на гитхабе, проект поддерживается сообществом и время от времени обновляется, готовые сборки есть практически под любые актуальные платформы.

PS Я вовсе не против кинектовского сенсора, у него есть свои плюсы. Но есть и огромный минус - это по своей сути стационарное решение. Строить на его основе что-то типа бюджетной рилтаймовой системы захвата движений для площадки - безусловно да. Но устаивать сессию 3D скана в поле - представляю с трудом.

usa_habro_user Автор

Я не про сайт, стартап или еще что - а про чистую "конкретику". Дайте свою модель в формате .stl, полученную конкретно вами в результате "обработки видео или последовательностей фотографий в jpeg" (не забыв поделиться, каким образом вы получили такую последовательность). Вот тогда и посмотрим, "какой это Сухов".

usa_habro_user Автор

Сорри,@mad_s,вот этой фразы совсем не понял, извините. О какой "сессии 3D скана в поле" вы говорите (или с кем вы разговариваете)? Если вам интересны детали, то я в столовой посадил детей на табуретку, и просто обвел Kinect-ом вокруг, добиваясь "всего зеленого" (ноутбук стоял на обеденном столе). "Поля" у нас в столовой нет, к сожалению, вся "сессия" заняла минуты три (понятно, что обсчет модели, обработка и печать заняли время).

Я знаю качество, которое дают стационарные 3D сканеры, пригодные для бизнеса: и Kinect-у, конечно, и Meshroom-у (какие бы результаты эта программка не давала - ибо я ничего конкретного от вас не увидел) до этого чрезвычайно далеко.

И, кстати, я думаю, что большинство подобных контор (если не все) закрылись не из-за конкуренции с бесплатным software, а просто из-за того, что людям не нужны их фотореалистичные модели, будь-то в полноцветной 3D печати, или в 3-х мерной модели, годной для виртуальной реальности или игр. Там они предпочитают быть красавцами, супергероями, или жуткими (но могучими!) монстрами, но отнюдь не сами собой ;)