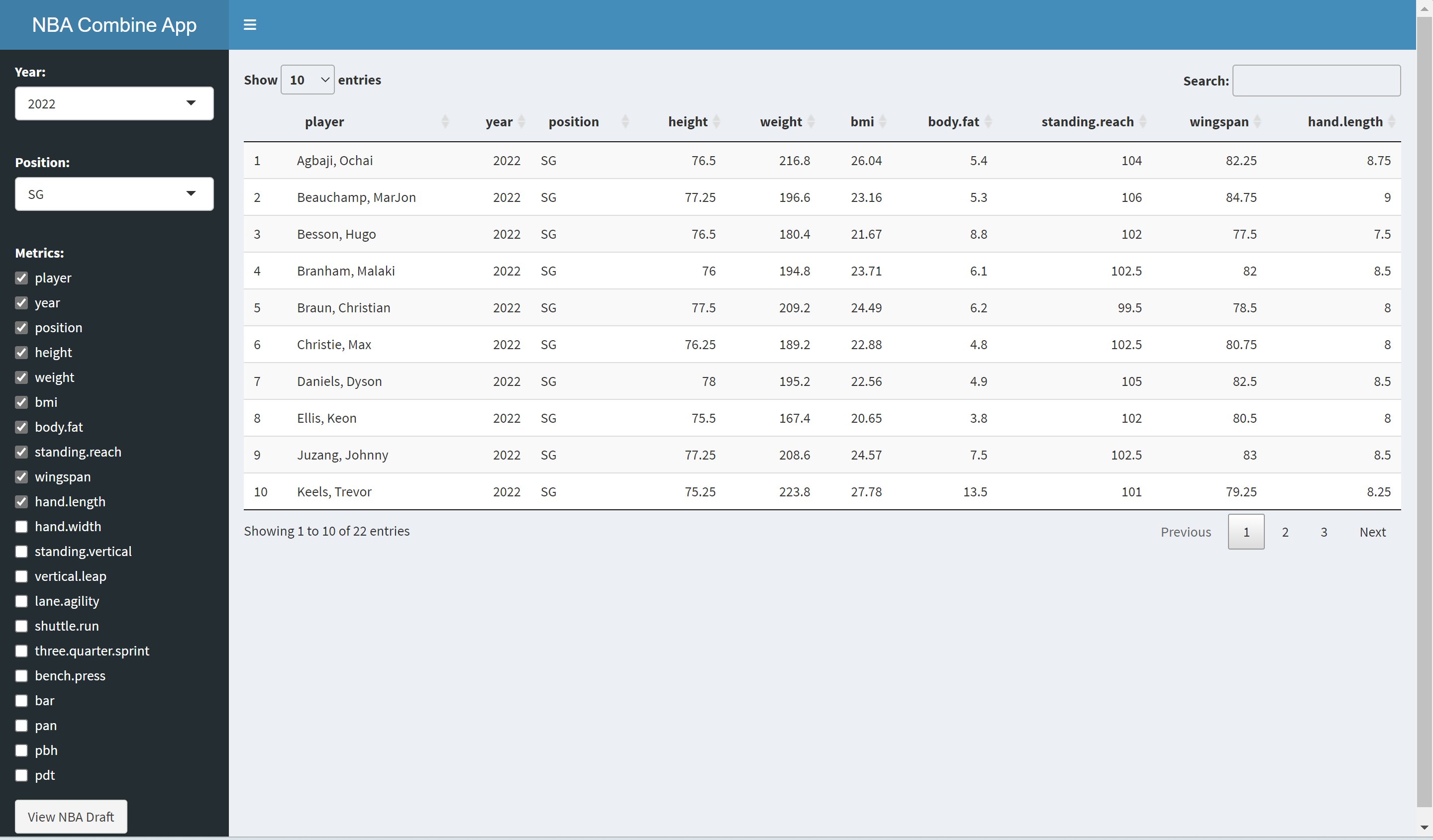

Простое приложение, написанное нейросетью ChatGPT по просьбе пользователя

Сегодня в мире насчитывается 13 млрд подключённых устройств IoT, то есть количество устройств в интернете уже превысило количество людей на Земле. И дальше разница между ними будет стремительно увеличиваться, со временем станет 100-кратной, 1000-кратной и т. д.

Современные нейросети типа ChatGPT способны поддерживать интеллектуальную беседу на уровне выше, чем большинство 95% людей. У них знания из миллионов книг и текстов, которые человеку прочитать не под силу. Они уже пишут школьные рефераты и книги, которые успешно продаются на Amazon, а также программный код по текстовому описанию и даже полноценные приложения с нуля.

Алгоритмы угадывают вкусы человека (системы рекомендаций), прогнозируют события для всего общества и отдельных стран (моделирование социальной динамики), предсказывают действия конкретного человека (отслеживание через датчики смартфона и других устройств, расписание и анализ паттернов).

Что будет, если миллиарды устройств Интернета вещей получат доступ к глобальной системе Искусственного Интеллекта с такой функциональностью?

По прогнозам, к 2030 году количество устройств интернета вещей возрастёт до 29 миллиардов.

Беспроводные mesh-сети

В этом году GlobalSign вступила в Альянс по стандартам подключения (Connectivity Standards Alliance, CSA), ранее известный как Zigbee Alliance. Это группа компаний, которая первоначально продвигала протокол Zigbee (на базе IEEE 802.15.4) — популярный протокол для умного дома и Интернета вещей, а сейчас занимается выработкой общего стандарта для IoT, чтобы устройства разных производителей могли нормально работать друг с другом. В него входят Amazon, Apple, Google, Samsung и др.

До сих пор пока не существует простого, общепринятого стандарта для подключения этих устройств. Для потребителей это означает множество запутанных способов подключения устройств в домашних условиях. Альянс по стандартам подключения стремится изменить эту ситуацию, одновременно обеспечив безопасность новых устройств. Теперь компании-участники могут воспользоваться преимуществами продуктов GlobalSign, таких как платформа IoT Identity, для обеспечения безопасности своих проектов и устройств.

Тот факт, что платформа IoT Identity от GlobalSign может работать с любым типом устройства, наверняка понравится членам CSA, которые пытаются выработать общие стандарты взаимодействия.

Кроме Zigbee, стандарт IEEE 802.15.4 является базовой основой для протоколов WirelessHART, MiWi, ISA100.11, Thread и др. Каждый из них предлагает решение для построения беспроводных mesh-сетей, а поверх базовой основы — свои уникальные функции, которые не покрываются стандартом.

ИскИн + Интернет вещей

Если вернуться к внедрению Искусственного Интеллекта в Интернет вещей, возможно ли такое? Кажется, что не просто возможно, а неизбежно. Будущее уже наступило, просто ещё недостаточно распространилось. Первые ростки этого мы видим в «голосовых помощниках» — колонки или программы на смартфонах отслеживают поведение человека, распознают вербальные и невербальные команды. Конечно, разработки пока в зачаточной стадии, так что возможности Сири или Алисы далеки от функциональности глобального ИИ общего назначения образца 2130 года. Но вполне возможно, что мы станем свидетелями грандиозных событий уже в ближайшие годы.

Платформа IoT Identity от GlobalSign предоставляет всё необходимое для управления полным жизненным циклом идентификации устройств, начиная с проектирования и производства, заканчивая развёртыванием, управлением и закрытием идентификатора. Облачный сервис предлагает высокую пропускную способность, специализированные услуги по отзыву и множество вариантов интеграции для подключения к экосистеме и конечным устройствам.

Сейчас GlobalSign выдаёт устройствам интернета вещей «удостоверения личности» — уникальные идентификаторы, которые невозможно подделать. Возможно, в будущем по такому «паспорту GlobalSign» какой-нибудь домашний андроид зайдёт в суд и станет публично защищать свои права, используя аргументы, сгенерированные ChatGPT v.37 (ЮрМод-1398) с учётом столетий юридического опыта и тысяч томов литературы, буквально подавляя знаниями своих белковых оппонентов, как в какой-то киберпанковской версии Айзека Азимова.

Комментарии (15)

saipr

17.12.2022 16:19У них знания из миллионов книг и текстов,

Не надо путать Знания и Цитаты (Цитирование)!

SerJook

17.12.2022 17:26А может ли ИИ, в частности ChatGPT, создавать новые знания? Цитировать он умеет, это я уже понял. Но может ли он делать открытия, заниматься исследованиями? Например, найти лечение для неизлечимых заболеваний. Когда этого стоит ждать?

nehrung

18.12.2022 00:24+1Да, поддержание беседы с человеком (т.е. тест Тьюринга) — это не создание новых знаний. Но если ИИ получат в свои виртуальные лапы возможность писать софт для самих себя, да ещё и самоустанавливать эти самонаписанные обновления — ооо, тогда начнётся супербыстрая машинная эволюция и отсчёт времени до наступления технологической сингулярности пойдёт на дни.

artemev

18.12.2022 01:10+1Если бы они писали софт корректно... Но это не так. Даже в довольно простых заданиях есть разнообразные ошибки. Код часто либо не выполняет поставленную задачу, либо вообще не запускается. Конечно chatGPT делает удивительные вещи, но пока это уровень начитанного идиота.

nehrung

18.12.2022 18:20Вы недооцениваете мощь дарвиновской теории эволюции. Согласно ей, тот, кто не оставил потомства, всё равно что не жил. Следовательно, некорректного кода всё равно что не существует, поскольку он не повторится в следующих версиях эволюционирующего ИИ.

artemev

19.12.2022 00:38Еще понять бы о каком коде речь. В нейросетях его очень не много, вся их мощь в данных для обучения (а точнее в их качестве и количестве).

nehrung

19.12.2022 18:21Не согласен. Данных можно нагромоздить кучу высотой с Эверест, и ничего ИИшного в ней не объявится. Но стОит только привнести в эту кучу какое-то организующее начало, некий катализатор (тот самый код, которого там очень не много), как вдруг сначала начнётся обработка этих данных, а затем, по мере совершенствования этого "не много", и та самая эволюция, о которой я говорил.

Sadler

18.12.2022 01:13Вопрос о новых знаниях слишком общий: chatGPT не предназначен для научной работы, это просто чат-бот, а AGI, способный делать всё и сразу, пока не изобрели. Ближе всего к тому, что Вы хотите -- AlphaFold.

starcs

18.12.2022 10:29Прикольно окажется, если сможет в новой редакции. Решать задачи, а еще ставить новые и их решать. И потом останется полшажочка себя осознать.

Oxigenium

18.12.2022 10:30Наверное, прямо с нуля создать знание невозможно, всегда есть опора на реальность или приклад двух разных областей знаний. Довольно много открытий было получено на совмещении уже известных вещей. Собственно, если следовать такому определению создания новых знаний, chatGPT это уже умеет. Если его попросить объяснить sql запрос, затем попросить объяснить как с помощью js библиотеки сделать запрос в google spreadsheets api - он сделает. Стоит далее просто попросить: "а теперь объедини это в одно", он объединит - вот и новые знания. Конечно, этого пока мало, чтобы удивить некоторых, но под само определение создания новых знаний эти действия уже попадают.

Даже в разговоре с chatGPT приводил ему именно эти аргументы на его оговорки: "я не могу создавать новые знания", на что он соглашался :), после чего оговаривался: "но я не несу ответственность за достоверность того что я произвёл, поэтому это и нельзя назвать новым". Что так-себе аргумент. Реальные люди тоже нуждаются в редактуре.

A1054

17.12.2022 22:01+2Начитавшись про прекрасный ChatGPT, который и рефераты пишет, и продуктовые спецификации, и тонкости перевода понимает, решил попробовать.

Вот что получилось.

С запросами про жен Генриха VIII или личную жизнь Бреда Пита справляется отлично, хотя иногда делает ляпы в словах, например перепутает вдруг "женат" и "замужем". то есть энциклопедичность, похоже, есть.

Но если чуть усложнить запрос, нарываешься на бред. Например, на вопрос "должен ли быть разрушен Карфаген" после вступления про город в Тунисе 8 века bc, ИИ выдал, что с одни считают, что Карфаген нужно сохранить как культурное наследие. А другие -- что Карфаген должен быть разрушен как символ зла (или что-то подобное, не помню точно фразу), чтобы нам двигаться дальше.

Перевод. Попросил перевести с русс на англ фразу " я увидел замок на холме, но когда подошел к воротам, они оказались на замке". И гугл транслейт, и deepl опознали омографы, но chatgpt -- нет.

Математика. Попросил решить sin(z) =5. Сначала чат ответил, что sin меньше 1. Когдга я попросил решить для комплексных z, начал решать. Первые строчки правильные, потом полезла какая-то полная чушь.

Ну, думаю, может если на ангоийском спросить, тогда лучше будет. Попробовал. На это раз сколько я не втолковывал, что z комплексное, чат упорно стоял на своем, sin < 1 -- и точка.

Давал простой диффур с разделяющимися переменными, что-то типа y'=1/((x+1)*(y+5)). Первые строчки были формально правильные, но не приближающие к решению. Потом понесся бред. Лучше было бы честно сказать, что не умею.

Решил задать вопрос, на который миллиона источников нет. Не помню сейчас формулировку, что-то про квантовый ластик. Получил ответ внешне выглядящий нормальным, но бессмысленный.

И если приглядеться к ответам, видно что очередные слова составляются на основании нескольких предыдущих. И иногда начинает ИИ вроде как за здравие, но вдруг неожиданно сворачивает на бред. Там пишу копирайтеры на технические темы, которые они не понимают. Некоторое время слова и термины выдаются вроде в правильных сочетаниях, но вдруг встречается такое, что с писателем становится все понятно.

Ожидал я от умного чата гораздо большего. Пока что он годится только для написания рефератов на энциклопедические темы. Да и то плохих, т.к. чат очень многословен и не понимает, что общеизвестные вещи можно и опустить.

Wesha

19.12.2022 00:47Так пишу копирайтеры на технические темы, которые они не понимают.

Так этот, прости госсди, "ИИ" тоже не понимает.

чат очень многословен и не понимает, что общеизвестные вещи можно и опустить.

Он тупо не знает, что "обще"известно, а что — нет.

haldagan

Качество, конечно, оставляет желать.

Вы эту статью редактировали в смысле текста (картинки и оформление, понятное дело, добавили) или как есть вставили?

VFaland

Так в начале же жирный намек. Очевидно кто статью писал :)