В статье не будет универсальных рецептов и объективной логики — скорее, будет постановка проблемы, которую нам всем скоро придётся решать.

▍ Доверие

Когда в 2020 все сели на удалёнку, я не радовался: к тому моменту моя удалённая работа уже длилась 8 лет. Когда все блогеры, журналисты, HR и прочие «держащие нос по ветру» радовались преимуществам удалёнки и писали статьи про дивный новый мир, я грустил: было понятно, чем всё закончится и никакого позитива в ситуации не будет. Да, мир действительно не будет прежним, но не потому что всем правила удалёнка, а потому что в корпоративной среде складывается полномасштабный кризис доверия. То и дело в новостях появляется информация о том, что крупные компании активно возвращают сотрудников в офис, предлагая 1–2 дня работы из дома как исключительную возможность и бонус; внутри компаний, оказавшихся в условиях работы с релоцированными сотрудниками, зреет недоверие и непонимание как между коллегами, так и между сотрудниками и руководством. «Дивный новый мир» превращается в яблоко раздора, разрушая сложившиеся отношения и провоцируя завинчивание гаек даже там, где это не нужно.

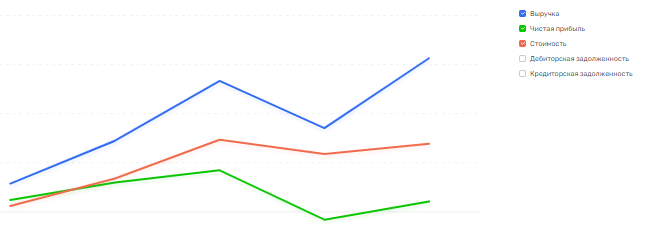

Да что говорить, давайте посмотрим: я взял данные о финансах четырёх популярных в России систем контроля рабочего процесса и персонала (следилок, bossware) и посмотрел, как они менялись с 2019 года (некоторые появились позже, так сказать, под волну). Смотрите сами (картинки анонимны по понятным причинам). Первые пики — это 2020, вторые — 2022, когда удалёнка перестала романтизироваться и стала казаться проблемой. По графику выручки ясно, что программы явно пользуются спросом.

Моя позиция по использованию такого софта однозначна: его используют трусливые и беспомощные компании, которые не готовы оценивать работу по результату. Именно они любят поминутные отчёты, ежедневные списки задач и прочие способы формального контроля. Если вы используете что-то такое, спешу вам сообщить две новости. Новость первая: все поминутные и ежедневные отчёты сильно демотивируют сотрудников и не содержат почти никакой правды, поскольку все тайминги и формулировки являются фикцией. Новость вторая: системы контроля активности сотрудников — идеальное «попа-прикрытие» для бездельников, готовых мотать мышкой по нужным приложениям от звонка до звонка и огромный фактор уничтожения и инструмент выдавливания проактивных сотрудников, которые готовы работать быстро и продуктивно, но не долбаных 8 часов подряд (и это не лень или подработки, а биология и физиология мозга, который не способен долго и эффективно работать без отдыха и переключения).

Если вы хотите измерять работу сотрудников, их продуктивность и эффективность, оценивайте по достигнутым результатам. И доверяйте — скоро доверие станет мотиватором с удельным весом значительно большим, чем у ДМС, корпоративов и внутренних наград вместе взятых. С ним смогут конкурировать только деньги.

▍ Трудоспособность

По-настоящему многозадачных людей в природе критически мало — это особая работа мозга, которая обеспечивается на уровне биохимии. Большинство могут работать в обычном режиме: один тип деятельность с перерывами в один момент времени. Это нужно учитывать.

Есть поговорка: нужно работать не 8 часов, а головой. Она точно отражает положение дел — каждый человек может хорошо и качественно выполнять только определённый объём работы. Более того, в одном отделе могут одновременно работать сотрудники, которые одну и ту же задачу (например, написание обработки исключений в одном приложении) могут решить за разное время из-за некоторых причин (от стиля мышления до уровня личного перфекционизма). Не нужно требовать одинаковых скоростей от всех и при этом также не стоит «премировать» скоростных сотрудников непосильными объёмами — дело в том, что их активность неравномерна и также сильно зависит от характера задач (то есть в чём-то они могут оказаться, наоборот, аутсайдерами).

Сотрудникам в компании должно быть комфортно работать на результат: привычными инструментами и в привычном темпе, неважно, из дома или в офисном кресле. Только вне стресса они смогут помогать вам достигать целей. Стресс от гонок и горящих дедлайнов сделает только хуже. Кстати, о дедлайнах — если хотите, чтобы они не срывались, ставьте реальные, точно сформулированные задачи в разумные сроки. В противном случае, вам удастся в режиме реального эксперимента наблюдать, как гормон кортизол наводит суету и тормозит умственную деятельность. Вы получите активных, изворотливых, хитрых, но не очень умных в моменте сотрудников. А длительное воздействие кортизола (хронический стресс) приводит к когнитивным нарушениям, меньшим злом из которых будет прокрастинация. Такова природа.

▍ Нервы и здоровье

Кстати, о природе. Никто не имеет права истреблять здоровье другого человека, даже если благая цель — корпоративные ценности и выручка по итогам года. Опять же, у каждого из нас свой порог чувствительности и одно и то же событие (скандал у руководителя) может иметь разное воздействие на человека. И это не значит, что все хрупкие снежинки, это значит, что нужно оставаться вежливым, уважительным человеком с коллегами и подчинёнными. Есть минимальные правила вежливого общения, которые, кажется, придумывались обществом на протяжении многих лет не зря: не грубить, не оскорблять, не кричать. Неадекватное поведение вызывает страх, а страх порождает ложь. Если не верите, просто вспомните, как врут дети родителям, когда боятся их порицания, осуждения и скандалов. У взрослых просто маски аккуратнее.

В ходе спокойного общения можно выяснить детали, понять аргументы, обсудить ситуацию, найти возможные выходы. Подумайте о том, что ваша работа — это созидательная деятельность, которая приносит людям что-то полезное, нужное, и лучше её выполнять на трезвую и адекватную голову, а не перегорая от эмоций. Сотрудники в стрессе могут просто уставать и выгорать от страха перед очередной выволочкой, а это уже повод осмотреться в поисках нового работодателя.

▍ ИИ — ну и?

На Хабре недавно выходила дикая и странная статья про то, как сократили сотрудников и заменили их на ChatGPT. И ладно бы это был единственный фрик или тролль — нет, тема замены человеческого интеллекта на искусственный сидит в головах некоторых руководителей, но главное, несётся на знамёнах всё теми же журналистами, блогерами, HR. В общем, всё как с удалёнкой. Только новый кумир бесполезен и глуп, поскольку способен только компилировать информацию из ранее созданной человеком. Причём порой с трудно обнаруживаемыми ошибками, что ещё сильнее усугубляет ситуацию. Однако это интересная, привлекающая внимание тема, сочетающая технологии, научную фантастику и близкие мечты о будущем, а значит, ей суждено греметь ещё какое-то время. Что будет дальше, покажет динамика развития нейронок и искусственного интеллекта. Но пока увольнения под предлогом замены человека на AI — скорее, выходки чёрного пиара. Эффективностью там и не пахнет, картинки, не обработанные кожаными дизайнерами, откровенно плохи, а тексты и вовсе читать невозможно (если у вас есть мозг). Если вы вдруг собрались манипулировать сотрудниками с помощью баек про нейросети, задумайтесь, остановитесь и не будьте клоуном.

▍ Человек человеку — кто?

Отношения между сотрудниками тоже попали в кризис: коллеги стали холоднее и злее друг к другу из-за зависти (к удалёнке или к офисной работе — сейчас и то, и то может выглядеть привилегией), ревности (кто физически ближе к руководителю, тому больше внимания), конкуренции и соревнований (до жжёной психики), стремления удержаться любой ценой, выстроить карьеру, а иногда просто выжить в корпоративной среде. Я не мизантроп, напротив, открытый и общительный человек, но тем не менее вынужден признать несколько правил корпоративных коммуникаций.

- Друзей на работе не бывает. Даже если вам кажется, что Вася/Таня уж точно друг и никаким образом не подведёт, вы ошибаетесь: хорошо, если это будет не первый, кто бросит в вас камень. Корпоративная среда — зона выживания, парадоксальным и прямым образом увязанная со сценариями выживания человека (тут чуть ли не вся пирамида потребностей), поэтому у каждого есть планка, за которой наступает исключительно свой интерес. Просто те, у кого планка ниже, предают раньше, причём чаще всего тех, у кого планка самая высокая.

- Все врут. Тут можно сослаться на доктора Хауса, или просто вывести этот пункт самостоятельно. Недоговаривают нюансы работы, скрывают секреты мастерства, разводят за спиной интриги, спокойно ведут непринуждённую борьбу на 2–3 фронта, имитируя понимание и поддержку. Верных людей на работе почти нет, но в отличие от друзей, они всё же встречаются (ну те, с высокой планкой).

- Если вы о чём-то договорились «всей конторой», дело не выгорит. Допустим, вы задумали итальянскую забастовку или бойкот выполнению KPI, обсудили, рьяно взялись за реализацию. Помните: скорее всего, ваш сосед по столу уже заполнил матрицу коэффициентов, а отдел поддержки решил перевыполнить план. Да и вообще любые групповые акты сопротивления — почти всегда дохлое дело, иногда договориться один на один с боссом проще.

- Доносы существуют. Как вам такие: «стучал по клавишам с несвойственной рабочим задачей скоростью», «выбрал отпуск в августе по религиозным причинам», «выходил на обед в течение 70, а не 60 минут»? Реальные истории, которые я наблюдал в IT-компании в 2015 году (она жива и по сей день).

К слову, существование этих пунктов никак не отменяет существование довольно дружной и сплочённой рабочей команды, дающей результат. Просто до первого серьёзного кризиса, который затрагивает большинство (как, например, ковид).

Как бы то ни было, людьми сейчас разбрасываться нельзя. Ужесточать и управлять — это не одно и то же, в условиях современного рынка добиваться нужного можно только переговорами, компромиссами и взаимопониманием. Да, это отдельный труд, но это и прибыльная инвестиция — инвестиция в человечность.

Если статья «срезонировала» у вас, то поставьте плюсик — пусть вылезет повыше, пусть её увидит как можно больше директоров; глядишь, задумаются. Или вы уже проецировали на себя ситуацию, в которой бездушный ИИ вытесняет вас с привычного места работы (которое ещё вчера казалось островком стабильности) и оказалось, что он очень даже неплохо справляется?

С наступившим!

Помоги спутнику бороться с космическим мусором в нашей новой игре! ????

Комментарии (47)

FlyingDutchman2

02.01.2024 14:48«выбрал отпуск в августе по религиозным причинам»

А что за религиозная причина брать отпуск в августе (спрашиваю из чистого интереса)?

ru_vds Автор

02.01.2024 14:48+3Там рядом два православных праздника: Преображение (яблочный Спас) и Успение Богородицы. Некоторые православные предпочитают выбирать этот период для спокойного коротенького поста.

pashigorev

02.01.2024 14:48+4Нормальная статья, не обсуждаю отдельные пункты, но заставляет задуматься о человечности, о взаимодействии между людьми.

И хочется, чтобы в мире было больше добра.

Neom1an

02.01.2024 14:48+4А еще ИИ - это сейчас модно. Большие Ит менеджеры в компаниях только о нем и вещают. Хотят его везде повнедрять. Без разбора.

Хотя возможно им лично это каким-то образом выгодно - внедрить продукты от какой-то определенной компании.

hssergey

02.01.2024 14:48+4ИИ для разработчика - весьма плохой советчик. Да, он может выдавать решение если оно стандартное и где-то уже было, но он не умеет сказать "нет, так сделать невозможно": всегда будет говорить, что да, пожалуйста, вот решение, выдумывать для этого несуществующие вызовы API, несуществующие функции и объекты, выдавать правдоподобные красиво выглядящие запросы, которые на самом деле не работают, и так далее. В итоге за ним надо все непрерывно проверять, и обычный гуглинг оказвается эффективнее.

MartinMiles

02.01.2024 14:48.. но он не умеет сказать "нет, так сделать невозможно": всегда будет говорить, что да, пожалуйста" ..

Случайно напомнило о жителях одной южной страны, омываемой одноименным океаном и славящейся своей вовлеченостью в написание ПО

appet1te

02.01.2024 14:48"Человеческий капитал" словосочетание которое вывели капиталисты. Ребята весьма не глупые. Они увидели потенциал человека и что именно человек сегодня является той сферой в которую можно и разумно инвестировать. Оборудование, здания, по все это обновляется. Люди тоже обновляются. Здание не вечно для того чтобы оно стояло его нужно поддерживать. Люди же могут сами себя поддерживать и потенциал у них в бесчисленное количество раз выше

vibondarenko

02.01.2024 14:48Но пока увольнения под предлогом замены человека на AI — скорее, выходки чёрного пиара. Эффективностью там и не пахнет, картинки, не обработанные кожаными дизайнерами, откровенно плохи, а тексты и вовсе читать невозможно (если у вас есть мозг).

Согласен, AI ещё далек от совершенства. Но не соглашусь, что картинки плохи, взгляните на Midjourney или Leonardo AI — они уже создают потрясающие картинки, некоторые из них сложно отличить от реальных фото! И да, иногда тексты AI такие убедительные, что сложно отличить от человеческих. Технологии быстро развиваются, и кто знает, что будет дальше?

Следующие 2 года будут очень интересными...

Nurked

Если честно, я ожидал большего от статьи с таким заголовком.

ИИ не умеет принимать решения. Это всего-лишь отличная штука, которая может очень хорошо шерстить гигантские объемы информации. Но я как с 2019 года писал, так и продолжаю писать о том, что при всём желании, чисто физически невозможно сделать так, чтобы ИИ воспринял данные и принял ответственное решение на основе этих данных.

Если у тебя нет человека, который будет отвечать за свои действия - у тебя не может сущетсвовать ответственности. И сколько ты не бейся над установкой ещё одного программного продукта - ты эту войну не выиграешь.

Kanut

А чем "ответственное" решение отличается от не "ответственного"? Ну вот кто-то бросил монетку и на основании этого принял решение. Это "ответственное" решение?

Ответственность уже давно можно возложить и на организации или какие-то другие "юридические структуры". То есть человек тут давно уже совсем не обязателен.

Nurked

И вот в этот момент всё рушится.

Это очень простой вопрос, но говорить о нём не хотят.

Прикол в том, что организации и бизнесы (как и проекты) ростут, когда в них есть люди, которые готовы взять на себя ответственность (а не вину).

Под отвественностью я подразумеваю такую вот страшную вещь - это когда тебе абсолютно пофигу, что произойдёт. Вирус-ли, гром и молния-ли, или пусть сам боженька Бог спустится на землю, и скажет тебе "Нет", но работа будет выполнена. Когда у тебя есть человек, который работает прям так, как написано в Послании к Гарсии.

Когда у вас есть судья, который отвественно относится к своему делу, он будет выносить правильные и отвественные решения. Если мы видим, что маму с грудным ребёнком нужно посадить на 15 лет за жестокое убийство отца этого ребёнка, то её не будут просто так сажать. Будет вынесен отвественный приговор. Да, мать убила человека. Ей с ребёнком больше не положено. Ей надо в колонию, такую мы терпеть не будем. В то же время, отвественный судья проверит связи этой женщины и скажет в приговоре несколько слов о том, что сделать с ребёнком. Не в колонию его же?

Существует миллион вариаций подобного сценария. К каждой из них надо подходить обдуманно и отвественно. Твоя задача - сделать так, чтобы человек, совершивший преступление получил соотвествующее наказание. Но при этом, надо убедиться, чтобы люди, которые не совершали преступления, не страдали от твоих решений. И при этом вам надо будет отвественно подходить к решению таких вот моральных диллем.

Это - сложно. Очень сложно. Нереально сложно. На самом деле, как человек, засидавший в суде присяжных, могу сказать, что правильное и честно разобранное дело - это сложно. Можно всегда просто "сорваться" на подсудимого, и обвинить его во всех смертных. Но нужно сделать так, чтобы ему в котелок дошло сообщение "то что ты наделал - настолько ужасно, что другие люди не хотят тебя здесь видеть. Посиди, подумай над тем, что ты натворил, и сделай правильно."

В таких случаях проку от ГПТ - ноль.

Но, в нём есть прок, если загрузить в него все подобные дела, и заставить его прошерстить инциденты, и выдать ссылки на уже существующие подобные дела. Тут он ещё как помощник.

А вот выносить решение - это уже к судье.

Kanut

Я не вижу чтобы вокруг меня всё рушилось или было разрушено. Хотя этот принцип работал ещё задолго до моего рождения и работает до сих пор.

Тогда у вас подавляющее большинство людей не способны на такую ответственность. Тем более чтобы постоянно.

От ГПТ может и ноль. От ИИ как такового совсем не обязательно. Более того я бы сказал что как раз таки ИИ способен выполнять такие задачи гораздо объективнее людей. Уж точно лучше чем средний человек или даже средний судья.

Lexicon

Я вам как специалист по ML скажу, что профильно натренированный GPT гораздо эффективней человека на этой должности. Даже больше скажу, в суд района, где я жил поступило 12 000 гражданских исков, которые суду предстоит разбирать.

Судья просто будет растягивать каждое дело на год-два, потому, что физически не в силах погружаться и разбираться с каждым делом, а цена ошибки судьи в гражданском процессе, - переход дела в вышестоящую инстанцию.

В таком случае, машина смогла бы разобрать 12 тысяч дел на предмет недостатка документов, позволить сторонам выступить на предварительном слушании и запросить доказательства и в конечном итоге вынести приговор в точности по букве закона. Затем могла бы принять во внимание матерей/детей/обстоятельства при необходимости и изменить приговор, причем, будучи консистентной в своей "морали" и соотнося "мораль" с законом.

Модель не могла бы пропустить мимо ушей замечания истца или защиты, для запроса/обработки новых документов тратила бы часы, а не месяцы. Модель могла бы принимать возражения и тратить время на самопроверку независимыми слоями.

К слову, вы пробовали вообще пользоваться ЧатЖПТ? Он, вопреки тому, что говорите вы крайне эмоционален, склонен отклоняться от инструкций ради прощения, доброты, толерантности. Модель, предназначенная для суда была бы намного жестче имела бы несколько слоев само-проверки и могла бы вовсе заниматься вещами, которые не способен судья, например - находить участников процесса, не выполняющих свои роли (защиты/обвинения/свидетельства).

Я с вами в общем сильно не согласен

Neom1an

а сможет ли ии следовать не только букве, но и духу закона?

Kanut

Почему нет? Это же просто вопрос того как его натренируют.

Ну и как бы проверку человеком, как минимум на первых порах, никто не отменял. И даже такой вариант был бы лучше и экономил кучу времени и ресурсов. Как это например уже сейчас происходит в радиологии.

Lexicon

Вы же не всерьез спрашиваете, конечно может, в добавок еще и консистентно, основываясь на логике или решениях других судов, и даже учитывая сходство обстоятельств

rg_software

Эту тему уже миллион раз обсасывали. Разница не в качестве, а в ответственности. Примерно такая же, как между "участием" с дивана в игре "Кто хочет стать миллионером" и реальным риском в студии на деньги.

Судья, политик, бизнесмен или менеджер проекта может быть хуже AI. Но у него есть представление о профессиональной этике, совесть, в конце концов, возможные репутационные и карьерные последствия.

ИИ-агенту ничего из перечисленного не грозит. Даже его авторам не грозит, потому что те из них, кто вменяемый, всегда скажет, что решение, предложенное ИИ, должно критически осмысляться, и уже потом применяться.

Мир, в котором правит ИИ -- это вот как условный Гугл, где вас может забанить алгоритм, за то, что какая-то "метрика жулика" показала 0.754 при пороге 0.753, и писать будете на деревню дедушке. При этом, возможно, ИИ будет чаще прав, чем модератор-человек, но жить в мире, где нет ответственных, удовольствие спорное.

Lexicon

Да бросьте, я привел конкретный пример, 12 тысяч гражданско-правовых исков, которые займут годы и в ходе которых судье не придется принять ни одного судьбоносного решения, неотвратимого другими инстанциями. И более того, утверждаю, что судья не способен физически работать с 12 тысячами дел "ответственно".

Люди могут сколько угодно обсасывать мечты, но одно дело, полемика в стиле "нами будут править машины и они умнее", другое дело, - реальная применимость ИИ как инструмента.

Вы заблуждаетесь, считая, что ИИ не способен учитывать этику/совесть/репутацию, напротив, alignment, то есть предрасположенность ИИ к X, например "морали" является одной из проблем LLM. Если судьи в обучающей выборке поступали осознанно вопреки закону, здравому смыслу или морали, то модель не подвергавшаяся unalignment'у унаследует эти качества судей. Иными словами, наиболее вероятно, вердикт ИИ будет абсолютно не отличим от судей и лишь будет быстрее.

Аргумент про гугл это буквально ярчайший пример отсутствия ответственности компании за эти баны, как у судьи, для гугла есть "компании с которыми лучше не пересекаться" и "все остальные". Гугл не могут "посадить" за бан, но могут за нарушение копирайта или отказ от передачи данных, с чего его решения внезапно основывались бы на несуществующем риске? Они даже людей не выделяют, чтобы перепроверить баны.

Так же у судий, если судья знает, что его "не посадят" за нарушение прав человека, но "посадят" за противостояние компании/человеку/приказу, то судья переобуется также быстро, как гугл перед GDPR. И вопрос в том, что ИИ тоже так умеет, но также умеет этого не делать, если цель обучения была судить, а не имитировать судей.

rg_software

Дело не в том, что ИИ "не способен" что-то там учитывать, а в том, что ему всё равно. Он поступает вероятностно, и для него "правильно" -- это то же самое, что близко к выборке. Наша мораль устроена сложнее, чем alignment, что показывают всякие задачи о вагонетках, в которых самые минимальные изменения условий приводят к довольно большим разбросам в моральной оценке происходящего. И даже если случай похож на 100500 других (объективно), мы субъективно можем решить, что он всё-таки не таков.

Гугл именно что ярчайший пример этой гадости, которую мы (общество) пока терпим ровно потому что это частная контора со своим уставом, и она ведёт бизнес как хочет, а кому не нравится, может с ними не работать. Но если так же будет поступать государство, это уже совсем другая ситуация.

Пусть AI проверяет документы, выносит предварительные оценки и так далее, кто ж против. Если это хороший инструмент, пусть судья пользуется. Главное -- чтобы на итоговом документе была подпись человека, и он бы за эту подпись отвечал, а уж какой инструмент ему помогал -- его дело, не проблема.

Kanut

Как и большинству судей в большинстве случаев. Какова вероятность что судью действительно привлекут к ответственности за неправильно принятое решение?

Вон недавно в США выяснили что человек десятилетия невиновным в тюрьме сидел. Судью как-то за это наказали?

А если вспомнить про коррупцию и всякие предубеждения со стороны судей....

И при этом совсем не обязательно это решение будет правильным. И я бы даже сказал что такие вот "субъективные" решения суда чаще неправильные чем правильные.

rg_software

Если вероятность привлечь судью больше нуля, это уже выше, чем у AI, не так ли?

Смотрите, тут вот какая история. У нас есть задача, которую точно решить невозможно (гарантированно доказать, обвиняемый виновен или нет), значит, нашей целью является ступенька ниже: провести процесс по всем правилам, и что он покажет, то покажет.

Если соблюдены все процедуры, рассмотрены все доводы, факты и т.п., мы знаем, что больше ничего сделать нельзя. Если же есть пространство для оспаривания, то можно биться дальше.

Предположим, AI говорит, что вот с вероятностью 99% этот товарищ виновен. Хорошо, что дальше? А дальше просто все эти дела автоматически пойдут на апелляцию, где обвиняемый будет говорить, что то или это не учли.

Тут в каждом втором тексте про Chat-GPT пишут, как легко его можно попытаться в чём-либо переубедить. Ну вот и будет ровно то же, что и сейчас -- прокурор будет убеждать в своём, адвокат в своём. А стоит ввести "чёрный ящик" на любом этапе -- ну так обвиняемый будет его оспаривать, потому что кто смирится с тем, что его считают виновным просто из-за какой-то численной корреляции внутри нейросети.

Kanut

И точно так же можно назначить кого-то ответственным за решения AИ. И он уже может решать когда использовать AI, а когда нет. И если использовать, то какой.

Ну так проблема то в том что средний судья в среднем процессе этого не делает. Или как минимум делает не на 100%.

Плюс предвзятость или там коррупция. Или то что разные судьи могут принять разное решение в одном и том же случае. Даже один и тот же судья может принять разное решение в зависимости от его настроения или там даже времени суток.

Абсолютно верно. Точно так же как и сейчас. Но при этом запрос об апелляции могут отклонить. Например другой ИИ. Или несколько разных ИИ. Или человек. Или комбинация из людей и ИИ.

В чём разница по сравнению с человеческим судьёй?

А обычный судья у нас не "чёрный ящик"? Его решения абсолютно прозрачны и он всегда их объясняет?

rg_software

Разумеется, к этому, я думаю, и придём. Сейчас судья тоже может, условно, в чатике спросить, что делать. Неважно, пользуется он гуглом, википедией или LLM -- поставил фамилию и подпись, значит, это уже твоя ответственность.

Да, и дело пойдёт на второй круг. И там, как я понимаю, могут не просто не согласиться, но и дать дисциплинарную оценку предыдущему судье.

Ну да, это называется "мотивировочная часть", разве нет?

Впрочем, не суть. Мне кажется, весь этот разговор примерно того же уровня, что и "программист вместо себя использует chat-gpt / нанимает индусов". Применительно к программистам средневзвешенное мнение -- пусть нанимает кого хочет и использует что хочет, если качество не страдает, и он за свой код отвечает.

Вряд ли кто-то (не я точно) будет запрещать судье пользоваться любым современным инструментом повышения продуктивности.

Kanut

Ну да. Как я уже писал выше скорее всего будет как в радиологии: ИИ даёт предварительное решение, которое проверяет человек. В результате во первых экономится куча времени и ресурсов, а во вторых реже случаются ошибки.

Вон из недавнего. Glynn Simmons 48 лет просидел в тюрьме хотя не был виноват. При этом у него было алиби, а все "улики" это свидетельские показания 18-летней девушки которая получила ранение в голову. Думаете он апелляции не подавал?

Это бумажка для "чтобы было". Туда судья может что угодно написать.

И при желании ИИ вам тоже может её писать. Это вас устроит?

rg_software

Ну, понимаете, это такой anecdotal evidence, который всегда можно вытащить. Дескать, сосед пьёт и курит как паровоз, а ему уже 90 лет, а у другого сердце в 40 отказало. Всё бывает.

Пусть бумажка будет для "чтобы было", и пусть судья знает, что бумажка лежит. Сегодня ветер дует в одну сторону, завтра в другую. Пусть AI пишет, если судье самому лень. Главное -- это чья подпись под документом, а кто сочиняет -- для меня дело десятое.

Kanut

Нет. Это яркий пример того что нынешняя система даже близко не идеальна.

То есть будет ли ИИ ошибаться? Будет. Обязательно будет.

Но вопрос не в этом. Вопрос в том будет ли он ошибаться чаще чем это делают люди. И вот тут ответ уже не так однозначен. Мягко говоря.

Ну вот знает он. И что это нам даёт в реальности?

AI может и без судьи написать.

rg_software

Ну так пусть AI и без судьи пишет, лишь бы подпись судьи стояла. Потому что судье за это может прилететь. Может, не сегодня, а через 20 лет. И пусть об этом знает. Думаю, на этом мы можем прийти к согласию -- как говорится, и вашим, и нашим.

Kanut

А точно может? Быстрый гуглёж говорит что:

Кроме того создателям ИИ или тем даст разрешение на использование ИИ в теории тоже может прилететь. А вот на практике....

rg_software

Я думаю, что вполне справедливо, если судья не сошёлся во взглядах с начальством, и ему за это ничего не сделали. У судьи нет хрустального шара, где он видит истину -- всё, что он может сделать, это честно соблюсти процедуру и вынести решение, которое вышестоящая инстанция признает имеющим право на жизнь (даже если не согласится).

Создателям AI, как мне кажется, не может и не должно прилетать. Тем, кто даёт разрешение -- уже вопрос спорный. Но так или иначе, если вам нет дела, есть подпись под документом или нет, она же вам не повредит, не так ли? А мне будет приятно :)

Kanut

Так а за что его тогда могут наказать то? За умышленное принятие неверного решения? Так ИИ на такое просто не способно. Что ещё остаётся?

rg_software

Судья может нарушить процедуру, не учесть важный фактор, проигнорировать свидетеля и т.п. То есть халтурно выполнить свою работу (это если исключить намеренные злоупотребления). ИИ эти проблемы не решает, это не его функция. Опять же, мы говорим о текущих технологиях, а не об абстрактном будущем, где AI на уровне человека во всех отношениях.

Kanut

А ИИ это может?

Насколько я вижу это не наказуемо.

rg_software

Конечно, может. Вы сейчас чат-gpt говорите, мол, ты неправ, вася, и он соглашается, что да, неправ. Значит, он может иметь две противоположные точки зрения на предмет, и очевидно, что одна из них ошибочна.

Наказуемо, вот примеры. Но в любом случае, пусть документ будет. Если нарушены правила и есть жалоба, это уже хорошо. Пусть жалоба не удовлетворена, но она лежит, и кто знает, когда и где придёт в движение? Я не знаю, и судья не знает. Может, на хорошее место попадёт другой судья, а не тот, на которого жалобы. А может, и нет, но вот пусть судья и думает на эту тему хоть немного перед решением.

Kanut

Ну давайте я переформулирую: вы же понимаете что мы даже сейчас можем создать ИИ, который будет придерживаться процедуры? Точно так же как мы можем создать ИИ, который будет проверять придерживается кто-то процедуры или нет?

Ну вот цитата из вашего источника:

То есть наказуемо только "преступное злоупотребление" и "вынесении заведомо неправосудного судебного акта". И на мой взгляд эти два пункта в общем-то к ИИ неприменимы. Ну или точнее как минимум можно без особых проблем создать ИИ для которого это так.

rg_software

Не знаю, если бы так было всё просто, процедуру бы никто не нарушал, зачем? Обычно это отдельное рассмотрение, чтобы понять, нарушил или нет, заведомо или не заведомо. А в той статье довольно интересные примеры того, что по факту было сочтено злоупотреблением.

Kanut

Из чисто человеческих слабостей: коррупция, устал и было лень, голова была занята другими делами и так далее и тому подобное.

В моём понимание "злоупотребление" подразумевает наличие намерения. И похоже не только в моём:

https://www.consultant.ru/document/cons_doc_LAW_10699/2da8d7a9884839c44d98466e0b1a63101b298844/

То есть если ошибся случайно, то это уже не злоупотребление.

ИИ может нарушать из корыстной или иной личной заинтересованности?

rg_software

Тут ещё такой момент: если судья постоянно косячит, пусть и не из злого умысла, его не накажут, но и вряд ли куда-то продвинут. Это просто плохой работник, не преступление.

Насчёт AI -- ну, мы опять обсуждаем какой-то достаточно далёкий AGI. Нынешние модели вообще "могут" что-либо условно. Если систему убеждать в том, что чёрное это белое, а белое это чёрное, и так десять раз по кругу, то вряд ли ей можно приписывать что-то высокоуровневое.

Lexicon

Вы по сути говорите, что человеческая мораль непредсказуема.

Я не могу понять, в чем вообще ваш аргумент в защиту людей?

Закон де юре должен быть полностью предсказуем и если не по букве, то по духу. Правосудие должно быть слепо.

rg_software

У судьи есть довольно большое пространство для манёвра при назначении конкретного наказания, например. То есть, допустим, виновен, наказание от сих до сих, но внутри уже на усмотрение человека. И это же тоже часть системы закона, фича, а не баг.

Тут нет защиты людей, тут неавтоматизируемая часть системы.

Lexicon

Ещё раз, что мешает llm основываясь на решениях судей или даже систематизированного понятия морали точно также подстраивать решение?

rg_software

Если вы говорите абстрактно о некоем AGI, который умеет не хуже человека всё это делать -- ну да, разницы никакой. А если конкретно о нынешних моделях -- думаю, это не того уровня технология, чтобы "обобщать мораль".

Lexicon

Вы подменяете понятие "не хуже человека", подразумевая, что машина должна повторять его.

В реальности, конкретно для судебного процесса все, чтобы выполнять его эффективней человека уже есть.

Уменьшение или увеличение наказания должно быть обосновано, у судьи нет права уменьшать наказание за "красивые глаза". То есть мораль, которой должны следовать судьи можно систематизировать

rg_software

Ну, я бы вот с какой стороны зашёл. Компьютер говорит: вот Вася тут своровал, но у него малолетние дети. Значит, базовая "ставка" 5 лет, скостим до трёх. Хорошо, но дальше любой адвокат скажет: давай подадим апелляцию, попробуем скостить до двух, может, прокатит.

И тут неважно, что говорит компьютер, потому что у него нет субъектности, если угодно. Если он скажет, что да, пусть будет 2 года, получается, что первый компьютер был неправ, и это уже прецедент. Если же он скажет, что нет, оставляем три, тот же адвокат может легко нарыть примеры, где снижали и до года, и никто на эту тему не возмущался.

Ну или, как вы говорите, "должно быть обосновано". Так вы даёте задание Chat-GPT, и он вам что угодно обоснует -- и почему надо дать год, и почему десятку.

Lexicon

Апелляция это процесс обработки дела в вышестоящей инстанции. Компетентность, допустимые время затраты и трактовка "духа закона" увеличивается, к ним из 12000 дел приходит 1200, в суд выше 120 и тд.

Если первая инстанция будет гораздо эффективнее, следующие будут не нужны, апелляцию вы будете подавать сразу в верховные суды. Получив суд, в котором у вас остаются только вопросы морали и корректности буквы закона, которые мы, как общество оставляем за собой, вы можете хоть референдумом судить

Резюмируя, ваш пример упускает то, зачем вообще нужна апелляция.

rg_software

Если у вас, скажем, гражданское дело, то там спорят двое. Они судятся потому, что не могут решить вопрос между собой сами, и каждый думает, что он прав. Суд становится на сторону одного из них, второй автоматически недоволен и считает, что дело несправедливо. Если решал AI, то ощущение несправедливости только растёт, потому что решение принято неизвестно кем и неизвестно почему, так что далеко не факт, что будет меньше апелляций. Ну так или иначе, поживём-увидим, чего уж там

vagon333

Спорное утверждение.

C 2005 года занимаюсь проверкой данных на соответствие законам. Не просто rule-based systems, хотя таких тоже масса.

На моей памяти масса компаний (крупных и стартапов) за эти годы появлялись и пробовали свои идеи. Все успешно failed.

Только с появлением LLM задача стала решаемой.