Проект Google Magneta, состоящий из небольшой группы исследователей искусственного интеллекта внутри гигантских компьютерных систем, представил музыкантам новый набор инструментов для создания музыки — NSynth.

Magneta — часть подразделения Google Brain, центральной лаборатории искусственного интеллекта в компании. В лаборатории исследователи изучают границы возможностей нейронных сетей и других форм машинного обучения. Нейронные сети, представляющие собой сложные математические системы, изучающие задачи и анализирующие большие объемы данных, в последние годы вышли на передний план в задачах распознавания объектов и лиц на изображениях и переводах с одного языка на другой.

Теперь команда Magneta переворачивает эту идею с ног на голову, используя нейронные сети как способ обучения машин новым видам музыки и других искусств. На первом этапе NSynth работает с большой базой данных звуков. Джесси Энгель (Jesse Engle), один из сотрудников Magneta, и его команда собрали широкий диапазон нот примерно из тысячи разных инструментов, от скрипки до балафона, а затем предоставили свои наработки нейронной сети.

В отличие от традиционного синтезатора, который генерирует звук из осцилляторов и таблиц сэмплов, NSynth использует глубокую нейронную сеть для генерации звуков на уровне отдельных образцов. Инструмент предоставляет музыкантам интуитивный контроль тембра, динамики, а также возможность изучать и исследовать новые звуки, которые трудно или невозможно извлечь из обычного синтезатора.

Анализируя ноты, нейронная сеть изучила звуковые характеристики каждого инструмента, а затем создала математический «вектор» для каждого из них. Используя эти векторы, машина может имитировать звучание каждого инструмента, например, органа Хаммонда или клавикорда, и при этом может сочетать звуки этих двух инструментов.

Это не похоже на игру двух инструментов одновременно: машина и ее программное обеспечение не наслаивают звуки клавикорда на орган Хаммонда. Они производят совершенно новые звуки, используя математические характеристики нот, которые появляются из двух инструментов. Исследователи могут повторить это со всеми остальными инструментами, создавая бесчисленное количество новых звуков из тех, что у нас уже есть, благодаря искусственному интеллекту.

NSynth позволяет исследователям явно факторизировать генерацию музыки в ноты другие музыкальные качества. Они могли бы и далее факторизировать эти качества, но для простоты этого не сделали и получили следующее:

Целью является модель P (audio | note), известная как тембр, и предполагается, что P (note) получается из высокого уровня «языковой модели» музыки, такой как последовательность нейронов в рекурентной нейронной сети (RNN). И хотя разработчики признают, что схема не является идеальной, факторизация основана на том, как работают инструменты, и на удивление эффективна. Действительно, многие современные музыкальные произведения реализуют такую факторизацию, используя MIDI для последовательности нот и программные синтезаторы для тембра.

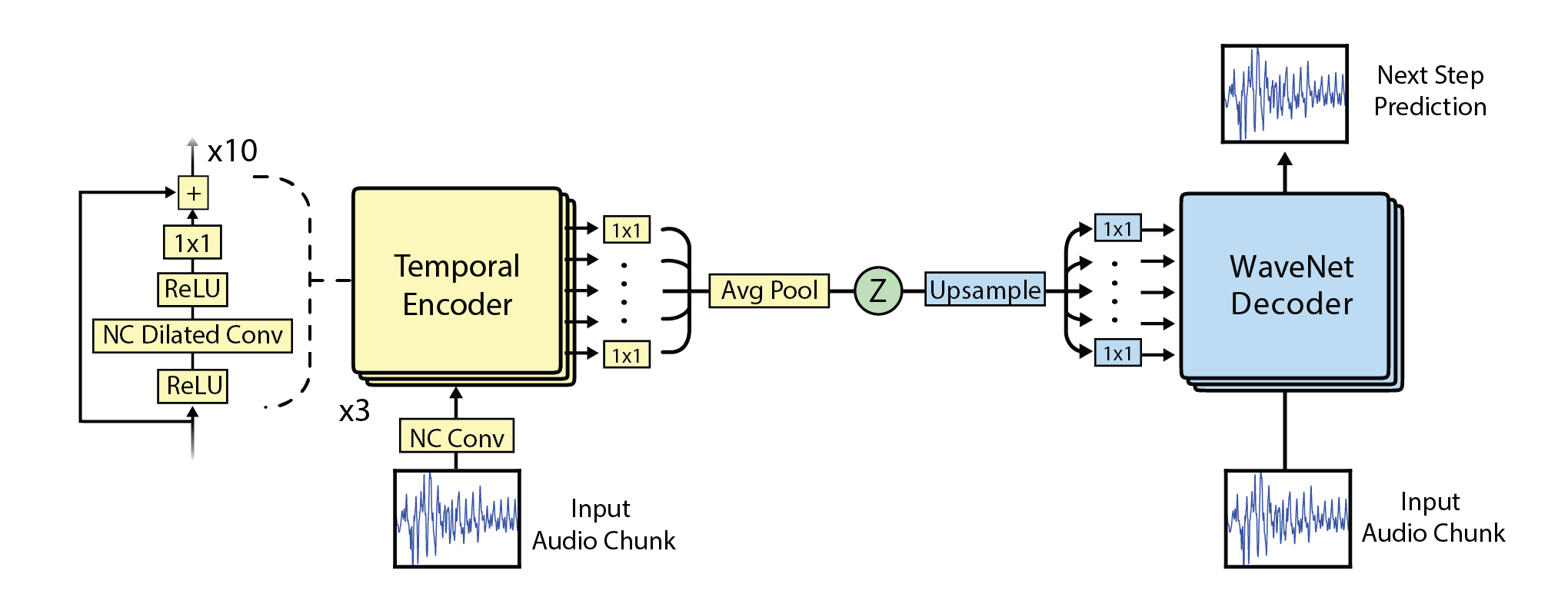

В создании инструмента команда Google использовала разработку своего автономного подразделения DeepMind — WaveNet. Эта система представляет собой авторегрессионную сеть расширенных сверток, которая моделирует звук по одному образцу за один раз, подобно нелинейному бесконечному импульсному фильтру.

Поскольку контекст этого фильтра в настоящее время органичен несколькими тысячами выборок (около половины секунды), долгосрочная структура требует направляющего внешнего сигнала. В своей работе команда Magneta устранила необходимость в обработке внешних сигналов с помощью автокодировщика, основанного на WaveNet.

Критик Марк Вейденбаум (Marc Weidenbaum) отмечает, что подход не очень далек от того, что делали оркестровые дирижеры на протяжении веков: смешение инструментов не является чем-то новым. Но он считает, что технология Google может дать вторую жизнь многовековой практике и подтолкнуть ее в новом направлении развития. «В искусстве это может принести некоторые интересные вещи, и поскольку это Google, люди последуют за ней», — говорит Вейденбаум.

Джесси Энгель продемонстрировал работу машины: «играл» на инструменте, который находится между клавикордом и органом Хаммонда. Затем он перетаскивал ползунок на экране своего ноутбука. И если в первом случае можно было услышать только 15% от клавикорда, то теперь он был ближе к 75%. Затем Энгель перетаскивал ползунок туда-обратно так быстро, как только мог, «перемешивая» звуки двух совершенно разных инструментов.

В дополнение к слайдеру NSynth, который демонстрировал Энгель, команда также создала двумерный интерфейс, который позволяет одновременно исследовать звуковое пространство между четырьмя различными инструментами. Исследователи намерены продолжить работу над этой идеей, исследуя границы художественного творчества. Например, вторая нейронная сеть могла бы изучить новые способы имитации и комбинирования звуков со всех этих инструментов — ИИ мог бы работать в тандеме с еще одним ИИ.

В Google Magneta также создала новую площадку для исследователей ИИ и других компьютерных специалистов. Уже опубликована исследовательская работа, описывающая алгоритмы NSynth, и каждый может загрузить и использовать свою базу данных звуков. Дуглас Эк (Douglas Eck), курирующий команду Magneta, надеется, что исследователи смогут создать гораздо более широкий набор инструментов для любых артистов, не только для музыкантов.

doi: arXiv:1704.01279 [cs.LG]

Поделиться с друзьями

Комментарии (5)

DjSens

16.05.2017 23:04+3Новый вид синтезатора. Кстати могу научить два звука объединять ртом, а не компом — надо издавать жужжание буквы Ж и одновременно свистеть, эффект будет как в этой статье описано.

agentapple

17.05.2017 11:22Забавно, что эти опыты представляются интересными с исследовательской точки зрения, но вероятность обретения привычной музыкальной ценности, читай эмоциональной, им не видать, пока ими не заинтересуется талантливый музыкант, способный творить на этом абстрактном уровне. Может лучше сразу натравливать алгоритм не на инструменты, а на произведения. Вот интересный пример:

iat

вскоре они поймут что это называется синтезом звука, и может быть даже изобретут 303 заново.

ваааааааау