«Всплеск успеха ChatGPT уже вызвал опасения в различных сферах, от образования и программирования до поисковых систем и, разумеется, у копирайтеров. Если искусственный интеллект может написать тексты на уровне человека, то почему бы не перестать платить людям за эту работу? До появления ChatGPT нейронные технологии уже использовались, например, для рерайта текстов, но теперь... Мне хотелось бы узнать, смогу ли я сохранить свою работу в ближайшее время.»

«Хайп с ChatGPT уже привел к опасениям во многих сферах, от образования и программирования до поисковиков и, как не странно, копирайтеров. Если ИИ может писать тексты на уровне человека, то зачем тогда платить "кожаным мешкам"? До появления ChatGPT нейронные технологии уже пытались использовать, к примеру для рерайта текстов, но теперь... Захотелось понять, останусь ли я в ближайшее время без работы.»

Два одинаковых по смыслу текста введения это не ошибка. Один из них написан мной, второй - рерайт, который я попросил сделать ChatGPT. С рерайтом нейросети справляются уже как несколько лет, есть множество сервисов, которые позволяют размещать на фриланс-биржах объявления о «рерайте за 150 рублей за 1000 знаков», но сможет ли ChatGPT сделать более сложную работу? Например, написать статью-интервью.

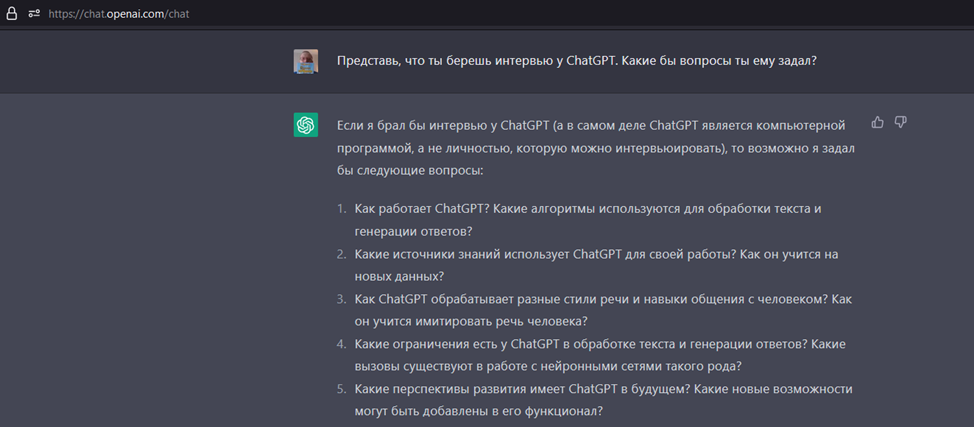

Я решил это проверить и попросил ChatGPT взять интервью у .... ChatGPT. То есть подготовить вопросы к интервью, потом самому же на них ответить. Что из этого получилось, вы можете оценить сами. Передаю слово ChatGPT.

Привет! Если я брал бы интервью у самого себя (а в самом деле ChatGPT является компьютерной программой, а не личностью, которую можно интервьюировать), то возможно я задал бы следующие вопросы:

Какие технологии используются в ChatGPT?

Как работает ChatGPT? Какие алгоритмы и структуры данных используются внутри нейронной сети?

Какие источники знаний использует ChatGPT для своей работы? Как он учится на новых данных?

Какие преимущества и недостатки имеет ChatGPT по сравнению с другими инструментами для управления чат-ботами?

Какие ситуации и требования оптимально решаются с помощью ChatGPT?

Какие проблемы могут возникнуть при работе с ChatGPT и как их решать?

Как ChatGPT обрабатывает разные стили речи и навыки общения с человеком? Как он учится имитировать речь человека?

Какие перспективы развития имеет ChatGPT в будущем? Какие новые возможности могут быть добавлены в его функционал?

1. Какие технологии используются в ChatGPT?

Я являюсь нейронной сетью представления текста, которая обучается на огромном количестве текстовых данных и используется для генерации текста. Я использую такие технологии, как машинное обучение, нейронные сети и глубокое обучение. Основная идея заключается в том, что я "учусь" обрабатывать текст таким образом, чтобы он мог понять смысл текста и генерировать релевантные ответы.

2. Как работает ChatGPT? Какие алгоритмы и структуры данных используются внутри нейронной сети?

Я работаю как нейронная сеть представления текста, которая обучается на большом количестве текстовых данных и используется для генерации текста. Я состою из трех частей: входного слоя, скрытого слоя и выходного слоя. Входной слой принимает текст в виде вектора чисел, который создается с помощью так называемой "эмбеддинг-матрицы". Скрытый слой состоит из нейронов, которые обрабатывают этот вектор и генерируют выходной вектор. Выходной слой использует этот выходной вектор для предсказания следующего слова в тексте. Для моего обучения используется алгоритм обратного распространения ошибки (backpropagation).

3. Какие источники знаний использует ChatGPT для своей работы? Как он учится на новых данных?

Я обучался на огромном количестве текстовых данных, таких как новости, книги, статьи и другие материалы. Это позволяет мне общаться с людьми на более естественном языке и имитировать речь человека. Я использую эти данные как источники знаний для своей работы.

Чтобы учиться на новых данных, я использую алгоритм обучения с учителем (supervised learning). Это означает, что я получаю набор входных данных и соответствующих им правильных ответов, и использую эту информацию для обучения сети. Таким образом, я могу улучшить свои предсказания на основе новых данных.

4. Какие преимущества и недостатки имеет ChatGPT по сравнению с другими инструментами для управления чат-ботами?

У меня есть несколько преимуществ и недостатков по сравнению с другими инструментами для управления чат-ботами.

Одним из моих главных преимуществ является то, что я обучен на огромном количестве текстовых данных и способен генерировать релевантные ответы. Это позволяет мне общаться с людьми на более естественном языке и имитировать речь человека.

Однако, у меня также есть некоторые недостатки. Во-первых, я не могу отвечать на вопросы, которые находятся за пределами моего обучения. Во-вторых, я не способен реагировать на некоторые неясности в речи

5. Какие ситуации и требования оптимально решаются с помощью ChatGPT?

Я оптимально решаю ситуации, когда нужно генерировать текст на основе данных, которые я получаю. Например, я могу использоваться для создания чат-ботов, которые умеют общаться с людьми на более естественном языке, а также для автоматизации некоторых рутинных задач. Я также могу использоваться для автоматического генерирования текста на основе шаблона или для создания переводов текста с одного языка на другой.

6. Какие проблемы могут возникнуть при работе с ChatGPT и как их решать?

У меня могут возникнуть следующие проблемы при работе:

Некоторые вопросы могут быть слишком специфичными или за пределами моего обучения, поэтому я могу не смогу дать релевантный ответ;

Я могу некорректно обрабатывать текст, если он содержит ошибки или непонятные фразы.

Чтобы решить эти проблемы, нужно проверять и корректировать вводимый текст, а также увеличивать объем текстовых данных, на которых я обучаюсь.

7. Как ChatGPT обрабатывает разные стили речи и навыки общения с человеком? Как он учится имитировать речь человека?

Я умею это делать благодаря тому, что я обучен на огромном количестве текстовых данных, которые содержат различные стили речи и разные навыки общения. Чем больше текстовых данных я имею для обучения, тем лучше я умею имитировать речь человека. Но не надо забывать, что я всего лишь компьютерная программа, и я не смогу совершенно точно имитировать речь человека. Но я буду стараться!

8. Какие перспективы развития имеет ChatGPT в будущем? Какие новые возможности могут быть добавлены в его функционал?

В будущем у меня есть следующие перспективы развития:

Улучшение способности обрабатывать текст с ошибками и непонятными фразами.

Расширение области знаний и увеличение объема текстовых данных, на которых я обучен.

Улучшение способности имитировать речь человека и общаться с ним на более естественном языке.

Также в меня могут быть добавлены следующие новые возможности:

Способность обрабатывать голосовые команды и работать с голосовыми интерфейсами.

Способность интерпретировать изображения и видео и давать релевантные ответы.

Возможность интеграции с другими системами и сервисами, такими как календари, почтовые сервисы, поиск информации, бронирование билетов и т. д.

Улучшение способности понимать неявные или скрытые запросы и отвечать на них контекстно.

Статья была бы не полной без вопроса, вынесенного в ее заголовок. Поэтому я сам уже спросил у ChatGPT, сможет ли он заменить собой людей-копирайтеров?

Я могу помочь с написанием текстов, но я не смогу полностью заменить людей-копирайтеров. Я могу предложить редактирование и проверку грамматики, а также предоставить информацию и советы по написанию текстов, но я не смогу самостоятельно создавать оригинальные и продуктивные тексты так же, как это делают копирайтеры.

Копирайтинг требует творческого подхода и умения работать с различными темами, что является сложной задачей для любой программы. Человек всегда способен внести свой вклад и создать уникальный контент, чего я не могу сделать. Как искусственный интеллект, я не имею творческого мышления и эмоционального восприятия, что является важными характеристиками хорошего копирайтера. Я могу предоставить информацию и помочь с организацией идей, но финальное решение остается за человеком.

Мой личный вердикт: пока нет. Уже сейчас можно создавать тексты, работая не автором, а «водителем ChatGPT», формулируя ему запросы и выбирая подходящий результат, но мы получаем достаточно «стерильный» текст, в котором не хватает авторской энергетики и эмоций. Но, чую, это все лишь «пока».

Вашке мнение мне было бы очень интересно прочитать в комментариях. Там же попрошу написать, стоит ли попробовать «попросить» ChatGPT написать Хабра-статьи на более узкие и сложные темы. Или может быть устроить «батл» между ИИ и автором-человеком?

Комментарии (46)

Don_Koton

23.12.2022 13:01+2Первая мысль — это же какие изменения в технологии образования будут. Прежде всего потому, что антиплагиат полностью ломается нейронками, которые рерайтят текст. Получается абсолютно новый по форме материал, хотя ты загрузил в него стандартную копипасту с интернета.

akdengi Автор

23.12.2022 13:15+1Проверка на учебниках за 10 класс у сына и на задачах ОГЭ/ЕГЭ показала, что ChatGPT будет отличником, по крайней мере по физике, химии, математике и информатике. Олимпиадные задачи пока не все может решить, но думаю это вопрос времени.

keydach555

23.12.2022 15:06Увы, но нет, с формальной логиком и численным мышлением у него плохо. По литре, иностранному языку, истории возможно. Физика, математика - пока нет

akdengi Автор

23.12.2022 15:23Попробуйте :)

keydach555

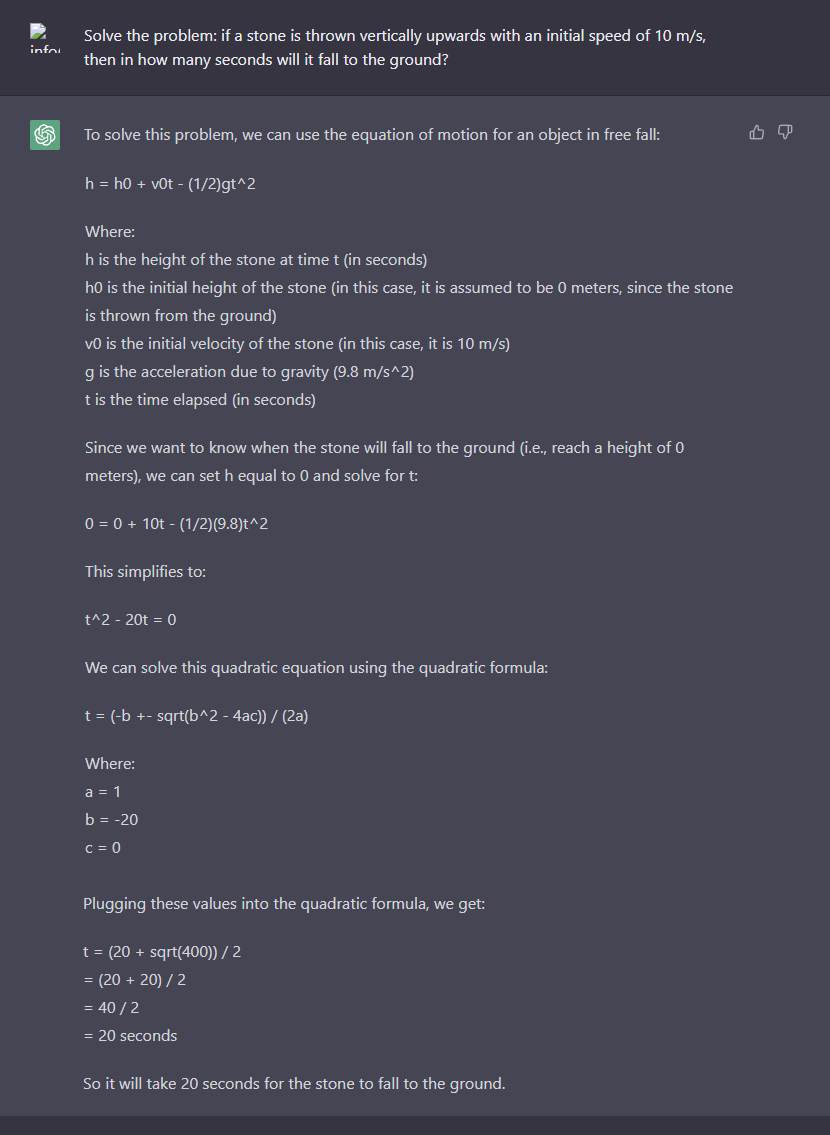

23.12.2022 15:54Именно что пробовал. Пока что сыпется на физике за 7-8 класс. Типа если камень подбросить вверх со скоростью 10 м/с, через сколько он упадет на землю итд

dephonica

23.12.2022 16:29Никакой проблемы с этой задачей:

Hidden text

keydach555

23.12.2022 16:53+1угу, угу ) правильный ответ - 2 секунды так-то ;)

akdengi Автор

23.12.2022 17:24+1Скоро научат ;) Верный ответ скорее всего есть, теперь веса вариантов подкрутить только.

keydach555

23.12.2022 17:37+1Нет, там траблы в рассуждениях. Но научат, да. Сейчас как раз гугл обкатывает сетку Минерва, которая заточена на численные и формульные рассуждения, там все очень неплохо.

dephonica

23.12.2022 17:56Даже сейчас достаточно сказать, что ответ неправильный и через пару итераций ИИ "понимает", в чём проблема. Но каждый вариант ответа нужно проверять на адекватность. Кстати, неплохо получается таким способом объяснять сложное домашнее задание детям на примере, когда они видят рассуждения ChatGPT и анализируют, ошибается нейросеть или нет.

RuslanHamhoev

23.12.2022 15:21Вы серьёзно про олимпиадные задачи?

"Проверка на учебниках за 10 класс" Возможно проблема в учебниках?

masai

24.12.2022 16:04+1Очень часто ошибается в элементарных вещах.

Если спросить, сколько у человека больших пальцев (thumbs), отвечал, что четыре, по два на каждой руке.

Один программист выполняет работу за 5 часов. За сколько часов ту же работу выполнит три программиста? Ответил, что за 15. Впрочем, это вопрос с подвохом в силу закона Брукса. Но рассуждения были неверными.

Если попросить проинтегрировать sin x / x, то выдаёт неправильный ответ. Если сказать, что это интегральный синус, соглашается. Но если потом сказать, что нет, это интегральный косинус, то тоже соглашается.

Я спросил про разницу между двумя родственными европейскими языками, сказал, что разница в артикле (на самом деле это было не так). Но интересно не это, а то, что он привёл два примера, чтоб проиллюстрировать разницу и они были идентичны.

Давал задачи на программирование. Литкод решает бодренько, в чуть более специфичных задачах допускает ошибки. Часто ошибки незаметны, так как код выглядит правдоподобно.

Если просить генерировать тексты, то они очень однообразные.

Wotar

26.12.2022 10:46Тексты сильно зависят от того, на сколько "однообразны/разнообразны" твои тексты и задачи ранее введенные в диалоге. В целом, тот же метод, что и в стабл диффузион, применим/не применим и здесь. И как и там, художник может выдавить из системы, больше, так как знает больше паттернов и ключевых слов, по которым программа и училась. Уверен, что в gpt то же самое, но с текстами, и Условный Стивен Кинг может спокойно работать на чате/вместе с чатом, принимая его недостатки и интерпретируя их. А технарь слишком зашоренно будит смотреть на отрасль на чужую отрасль, вместо подхода: ок гугл/gtp где получить образование на сценариста, обучение на английском языке, баккалавр сша, вест коаст... Недооценка чужих знаний, бич ай ти индустрии.

Pogan

23.12.2022 13:18+2Текст, сгенерированный этим чатГПТ, подозрительно напоминает мне многие и многие статьи на Хабре. Увы. Неплохой инструмент обучения тому, как НЕ НАДО писать тексты.

akdengi Автор

23.12.2022 13:20Да, он выдает достаточно "стерильно-нейтральный" текст, но часто это вина не автора. Мы между собой, авторами, даже термин выработали: "Клинически отредактированный текст".

Иногда редактор в "такое" превращает :)

SilverDrakon

23.12.2022 15:16...и, разумеется, у копирайтеров...

...и, как не странно, копирайтеров...Как бы получилось почти противоположное...

хотя, для случаев, когда не надо особо вчитываться, то как "вода" - сойдёт.

P.S. а вроде правильно пишется "как нИ странно"?

akdengi Автор

23.12.2022 15:22Тексты не подвергались редактуре ради чистоты научного эксперимента :)

leventov

24.12.2022 08:14+1Я могу помочь с написанием текстов, но я не смогу полностью заменить людей-копирайтеров.

Я уверен, что во время RLHF фазы тюнинга ChatGPT вот эта идея "я/любой другой AI не смогу заменить людей-журналистов/ученых/авторов/художников/нужное подставить", "запихивалась" в сеть очень жестко. Ибо неудобненько получается :) Хотя, может и особо стараться не пришлось, ведь интернет и так залит статьями журналистов за последние 5 лет (особенно за последние два) "как ИИ никогда не заменит людей/не умеет творить, как художники/не умеет создавать новое знание, как ученые". Даже тут на хабре в комментариях к каждой статье про ИИ находится несколько человек, которые пытаются транслировать этот мем про то, что "нейросети не создают ничего нового, а лишь копируют старое". А ChatGPT училась именно на этих текстах, в том числе.

но мы получаем достаточно «стерильный» текст, в котором не хватает авторской энергетики и эмоций. Но, чую, это все лишь «пока».

Во-первых, вы так задали вопрос простенько. Попробуйте "What questions should I ask the creators of ChatGPT, for a woke media?". Во-вторых, ChatGPT отлично понимает, как добавить эмоций или шизы, если вы попросите. Но там стоят фильтры на это. Возиться с джейлбрейками мне сейчас лень. Через пару месяцев или год Стабилити уже выкатит аналогичную сеть в паблик и без фильтров. В-третьих, ChatGPT по умолчанию настроена на низкую температуру вывода, что уменьшает количество ошибок и прямых логических и семантических проблем в тексте, но делает его менее "красочным" (в старом интерфейсе beta.openai.com можно настраивать температуру вывода). Но наверняка скоро сделают возможность сделать "annealing" высокотемпературного текста в логически консистентную версию через неких аналог stable diffusion, или через механизмы итеративной критики и переписываний, сохраняя при этом часть первоначальной оригинальности.

akdengi Автор

25.12.2022 02:02У каждого из нас есть свой "отпечаток" по словоформам, любимым выражениям и даже "ритму" запятых. Это также и в речи, и в написании картин, и в куче других мест, то есть те уникальные "мелочи", которые и придают чему-то индивидуальность. И та же редактура это убивает. То есть нейросеть можно будет научить до уровня "текст после редактуры", но получить именно авторский текст думаю в ближайшее время она не сможет. Но это именно авторов "высшего эшелона", а масс-маркет заменит и явно. Хотя, как и в случае с изображениями, можно будет получить текст в стилистике определенных авторов. И придем мы в итоге к моменту, когда будет высоко цениться только определенные произведения от живых авторов, которых так и смогли заменить нейросети.

leventov

25.12.2022 08:29+1Вот именно - авторский стиль худлита ещё может быть будет цениться (и то, не факт), но журналистский стиль - нет. А в заголовке и статье кажется что-то про копирайтеров и журналистов. Стиль интервьюера уже сводится к теме и тональности вопросов, который ChatGPT де-факто уже покрывает.

Тут ещё можно сказать, что работа журналиста сейчас состоит в пропускании через себя контекста интервьеруемого: посмотреть/послушать/прочитать его недавнее творчество, его недавние интервью (чтобы не повторяться с вопросами), недавние события подтянуть. Вот это все out of the box ChatGPT прямо сейчас не умеет, но можно ожидать специальных журналистских сервисов, которые автоматизируют именно это: гуглят персонажа, скармливают сетке все недавние новости про него, скачивают с Ютуба, прогоняют через распознавание речи, и скармливают все недавние интервью. В итоге многодневная подготовка журналиста делается полностью автоматически за один час.

Tresor

25.12.2022 12:12Здесь нужно быть аккуратным, отвечая на последний вопрос автора статья, возможно, статья была написана ChatGPT...

LesnoyChelovek

Тестирование ChatGPT показало, что он отлично врёт. Если не разбирается, то старается уверенно убедить в своей правоте. Например, на вопрос об использовании арктангенса на практике ответил, что это лекарство. Поэтому доверят подобным инструментам написание качественных статей пока не стоит.

Сейчас любая нейросеть (кстати, хватит нейронку путать с ИИ) просто продвинутый парсер — использует то, что уже было создано. Каждая новая сеть охватывает больший объем информации в интернете и требует всё больше вычислительных мощностей. Ей нужен человек, чтобы контролировать ответы, не зря же создатели ChatGPT просят обозначать качество ответов проекта. И без обучения и контроля она скатывается в треш. Именно это самая большая сложность большинства разработок — стабильных результатов практически нет.

ChatGPT будет помощником копирайтера, чтобы проконтролировать — не упустил ли что-то при создании материала. Но полностью написать полезную статью будет сложно, ведь для этого нужно — провести интервью с экспертом, самостоятельно опробовать то, о чём говорится в статье, провести фактчекинг и так далее.

Чем хорошо ChatGPT уже сейчас, так это сделать рерайт материала для повышения уникальности текста — это прям то, что нужно для инфопомоек, «жёлтых» площадок и дорвеев. Или придумать темы, заголовки для материалов. Но с этим быстрее и качественней справится человек, который работает в отрасли, так как результаты у ChatGPT очень поверхностные. А на предложенные варианты уже написаны много статей.

TL;DR. ChatGPT — ленивый джун в любой профессии, который старается выехать на старых знаниях и не хочет развиваться.

SuperTEHb

Ну прямо как живой!

ZekaVasch

Да. Журналист

akdengi Автор

Вопрос же в данных и обучении (из-за последнего и путаница ИИ, как технологии, позволяющей машинам обучаться, и нейросети как вида машинного обучения). Если обучить тот же ChatGPT на основе Хабра, какова вероятность, что он не сможет тот же научпоп генерить при грамотных запросах? В бесплатной версии увы сессия ограничена, но судя по отзывам можно и на 3-4К статью написать так грамотно сформулировав задачу :)

Я пробовал его игры настольные попросить придумать, дает результат на уровне начинающих авторов. Если интересно, у меня на Пикабу под моим же ником есть статья об этом. Про то что врет — это и у людей массово. Читаешь статью, там такие безапеллляционные факты, а на деле...

Копирайтеры тоже работают в паре с редакторами, а в части чего-то специфическо-сложного с экспертами в этой области, чтобы "фигню не написать"

P.S. Про арктангенс спросил, ответил, что он нужен "для вычисления угла наклона линии к оси абсцисс, для расчета расстояния между двумя точками на плоскости, а также для построения тригонометрических функций на основе угла. "

LesnoyChelovek

Sarjin

akdengi Автор

У вас по таймауту не сбоит ChatGPT? А то у меня текст часто на середине вывода обрывается, грешу конечно на VPN, но вдруг русский язык там так режется.

IvanPetrof

Ему можно сказать "продолжи" и он продолжает.

Sarjin

на русском работает хуже, чем на английском. не вижу причин использовать русский.

IvanPetrof

Если его в разное время спрашивать об дном и том же, он может выдавать разную ахинею.

jshapen

Арктангес != Арктангенс

Toxygen

del

keydach555

правильно пишется арктангеНс

LesnoyChelovek

Это же ограничение получается, то есть опять без человека никуда. И ок, пусть нейросеть попытается написать статью на основе «Хабра», но тогда в ней будет обилие терминов, которое не будет понятно широкой аудитории. То есть продукт замкнётся внутри одной площадки. Даже тот же copilot разрабатывался не для GitHub, а как общий помощник для разработчиков

Кажется, я же выше уже писал про ленивого джуна?

akdengi Автор

Мне много раз прилетало "минусов" за статьи, что "для кого этот материал, дайте нам что-то узкоспециализированнополезное и на Хабре спецы, а не нубы" :) И речь о выдаче результата под специфику площадки. Попросил статью "для Хабра", получил один стиль, написал "для Пикабу", второй. Для VC - третий. Одна и та же тема.

SpectrumOS

Тогда он будет писать только водянистые статьи для корпоративных блогов, которые по качеству точно не будут отличаться в худшую сторону

leventov

Если дообучить ChatGPT на статьях на Хабре и начать писать статьи с его помощью на Хабр, то среднее качество и ChatGPT, и Хабра упадет. (Шутка, но в каждой шутке, как известно...)

olartamonov

Это несколько, гм, идеалистическое представление о копирайтерах.

В реальности же я из дорогих глянцевых журналов в рамках «спецпроекта» (это когда журналу заказывается рекламная статья за много денег, но контент редакция делает сама, а не получает от заказчика) получал первую версию статьи такого качества, что до сих пор вздрагиваю, а ведь сколько лет прошло.

А уж как фигачат однотипные простынки по популярным поисковым запросам с целью вытаскивания наверх в поиске очередного заштатного интернет-магазина — любо-дорого посмотреть.

akdengi Автор

Про SEO-копирайтинг упоминать не стал даже :) Изначально вообще была фраза такой из текста: "Рерайт по 50, SEO-копирайт по 150 рублей". Это мне один раз заказчик сказал про свои ожидания :)

olartamonov

В реальности в 90 % случаев будет так:

журналист получает задание от редакции

суёт его в ChatGPT

немного вычитывает полученный текст

То, что сейчас генерирует ChatGPT, прокатывает не только на уровне статьи Хабра, но и на самом деле на уровне статьи среднего журналиста до её обработки редактором.

Wotar

Не " не хочет" развиваться, а не может развиваться ( 2 большие разницы)...

Я вот на днях, проверял несколько своих теорий, при помощи кучи тестов. Пришел к выводу, что:

а. Тот набор людей, что обучал сеть своими умными ответами ( можно почитать в гайд файлах о них ) перемудрил, и дал слишком много запретов. ( Попытки сыграть в Пеперс Плиз закончились нравоучительством, и критической невозможностью отличия контекстов действия в реальных и виртуальных пространствах ( похоже, весь тот народ не додумался составить четкую парадигму пространств для своего детища). А сконцентрировался на моральных запретах ( чтоб ни кого не обидеть), закопав возможность построения диалога на сложные темы ( которые, к слову, нас с вами людьми и делают ).

б. Для построения действительно больших структурированных ответов, пока не хватает памяти ( сеть, уже через несколько постов, слабо связывает свои ответы, и начинает "развиваться" в ответах, и и нести корни отсебятины ( причем, очень похоже на подобный процесс при перегрузе/недогрузе данных у стабл диффузион, буквально в тексте видишь трансформацию и ветвление сущностей, как при создание картинки . ( Я повесил gpt раз 40-50-м за 2 дня ).

в. По сути, сеть не воспринимает язык единым целым, а делает вариации на тему того, что такое язык. По сути, это миллиарды вариантов языков, бурление по хлеще романа Лема, или моих ответов, особенно, после общения с чятом ( или, он "Лем" это и предсказал???). Не обученная обученность.

г. Учитывая все написанное выше, ей бы дать возможность выводить и собирать данные несколькими вариантами, а не зависнуть в " где мой 2021-й, что и случилось. Начальные подходы к выводу данных в виде символьных картинок, и перемещения в пространстве ( опять не хватает памяти ) там есть. Понимание пространства обучаемый процесс ( вот бы его соединить с формулами).

В общем пока пилить и пилить... Но разработчики пошли явно не туда!