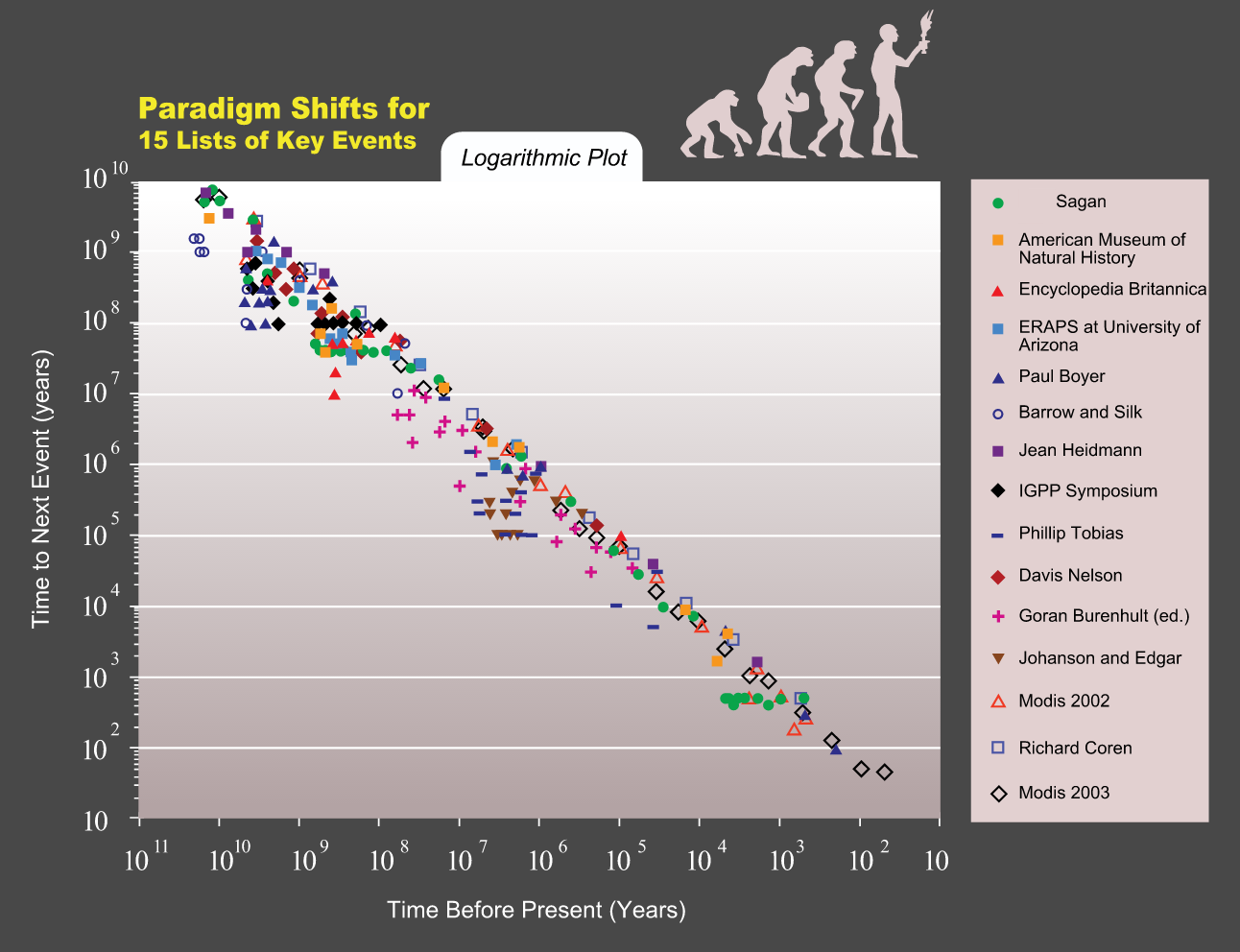

По Курцвейлу, логарифмическая шкала смены парадигм для ключевых исторических событий проявляет экспоненциальную тенденцию

Ключевой элемент для возникновения технологической сингулярности — запуск неконтролируемого цикла самосовершенствования ИИ, где каждое новое более умное поколение ИИ будет появляться быстрее предыдущего. Согласно теории сингулярности по Вернору Винджу, в результате взрывного развития интеллекта в цикле экспоненциального самосовершенствования появится сверхинтеллект, который намного превзойдёт возможности человеческого разума и по сути будет непонятен для него. Называются разные примерные даты наступления сингулярности, исходя из экстраполяции технологического прогресса. Рей Курцвейл считает, что это произойдёт примерно в 2045 году (хотя он не считает обязательным экспоненциальное самосовершенствование ИИ), а среднее медианное значение по опросу экспертов по сильному ИИ — 2040 год.

Вполне возможно, что сингулярность наступит раньше прогнозируемого. Инженеры из компании Google и разработчики систем ИИ из других компаний сообщают об успехах, которых удалось добиться в ключевом направлении — создании систем ИИ, предназначенных для проектирования других систем ИИ.

В одном из экспериментов исследователи ИИ из подразделения Google Brain разработали программу, которая проектировала нейронную архитектуру нейросети таким образом, чтобы та показывала максимально высокие результаты в распознавании речи. Спроектированная программным методом система показала лучший результат, чем созданные человеком нейросети.

Издание MIT Technology Review рапортует, что в последние месяцы об успехах по созданию систем ИИ для проектирования других систем ИИ сообщили несколько исследовательских коллективов, в том числе из некоммерческой организации OpenAI (финансируется Илоном Маском), Массачусетского технологического института, Калифорнийского университета в Беркли, а также ещё одного подразделения по искусственному интеллекту в компании Google — DeepMind. Очевидно, это направление научных исследований считается одним из самых перспективных, многие хотят преуспеть в нём.

По мнению MIT Technology Review, такие разработки в первую очередь преследуют экономическую цель. Создание программы для проектироания приложений ИИ значительно ускорит применение подобных технологий в разных сферах экономики. Сейчас многие компании не могут себе позволить внедрить систему ИИ, потому что в штате нет специалиста с такой компетенцией. Банально, эксперты по ИИ в большом дефиците. А ведь нейросети можно применять практически в огромном количестве приложений: в автомобильной промышленности, в банковской сфере, в телекоммуникациях, в системах безопасности и видеонаблюдения, в самых разных потребительских продуктах для распознавания речи и жестов, машинного зрения и т.д.

Разработка систем ИИ программными методами позволит заменить часть этих дефицитных программистов.

Важно ещё и то, что ИИ разрабатывает нейросети более эффективные, чем человек, поэтому внедрение таких программ имеет смысл даже там, где раньше работали живые разработчики.

На эту тему рассуждал недавно Джефф Дин (Jeff Dean), руководитель исследовательской группы Google Brain. В своём выступлении на конференции AI Frontiers в Санта-Кларе (Калифорния) он предположил, что часть таких программистов можно заменить программным обеспечением, потому что в данный момент компаниям приходится платить очень высокие деньги и зарплату этим специалистам, которых крайне не хватает.

Например, в научной статье "Learning to reinforcement learn" от DeepMind описан набор экспериментов для самообучения ИИ, который исследователи называют «глубокое мета-обучение с подкреплением» (deep meta-reinforcement learning). Суть заключается в том, чтобы использовать стандартное обучение с подкреплением нейросети с обратной связью таким образом, чтобы эта рекуррентная нейросеть разработала собственную свободную от внешних шаблонов процедуру обучения с подкреплением для другой рекуррентной нейросети.

Эксперименты показали, что нейросеть второго порядка, созданная усилиями первой нейросети, в некоторых случаях демонстрирует эффективность и качества, которыми не обладает нейросеть первого порядка.

Всего в научной работе DeepMind описано семь таких экспериментов. Как обычно, они проводят их в пространстве компьютерных игр. По мнению исследователей, подобные агенты ИИ, созданные с помощью других программ ИИ, способны быстрее адаптироваться к новым задачам, используя полученные ранее знания на схожих задачах. Эксперименты показали также, что результат обучения ИИ второго порядка можно считать непредсказуемым: его архитектура не зависит от архитектуры ИИ первого порядка и может сильно отличаться от неё. В частности, ИИ второго порядка способен использовать особенности среды, о которых не знали или не которые не учитывались самими разработчиками.

Специалисты DeepMind считают, что их эксперименты с глубоким мета-обучением с подкреплением имеют значение и в изучении человеческого мозга, в частности, они «обеспечивают интегративный фреймворк для понимания соответствующих ролей допамина и префронтальной коры головного мозга в биологических процессах обучения с подкреплением».

Идея самообучения ИИ выдвигалась и раньше, но до сих пор учёным не удавалось продемонстрировать настолько впечатляющих результатов. Например, один из пионеров в этой области, профессор Йошуа Бенжио (Yoshua Bengio), говорит, что такие эксперименты требуют слишком больших вычислительных мощностей, так что до последнего времени они не имели практического смысла. Например, в опытах Google Brain для работы программного обеспечения, которое проектирует систему ИИ для машинного зрения, использовалось 800 высокопроизводительных графических процессоров.

Исследователи из Массачусетского технологического института планируют опубликовать исходный код программы, которую использовали в своих экспериментах. Возможно, со временем использование таких инструментов будет иметь экономический смысл и оно снизит нагрузку на специалистов, которые разрабатывают модели для обработки данных. Высококвалифицированные программисты смогут отвлечься от кодинга и сконцентрироваться на идеях более высокого порядка.

Поделиться с друзьями

DrZlodberg

Прямо напрашивается сделать рукурсивную сеть для обучения сети. Т.е. 2 сети обучают друг друга обучать разные сети.

И запастись попкорном.

Nuwen

Или сразу крупой, солью и спичками.

DrZlodberg

Как и использование любого инструмента — тут есть варианты. В оптимистичном — наоборот, возможен переход к минимальному гарантированному доходу (или как он там назывался) в связи с отсутствием потребности в живой рабочей силе.

BigFlask

Но зачем?

DrZlodberg

А почему нет? Тем более некоторые страны и так о нём задумываются. Я же сказал — это оптимистичный вариант.

funca

К минимально необходимой для поддержки системы популяции людей. А высвободившиеся от потреблятства ресурсы — направить на путешествия к звездам.

DrZlodberg

А зачем такой системе люди? Чисто технически машины практичнее.

Люди на такое вряд-ли пойдут, а сама система скорее всего предпочтёт убрать их совсем.

prostovovan

Система не может НИЧЕГО сама «убрать». Всё, что она делает — так это выполняет заложенную в нее программу.

DrZlodberg

Говоря о нейронных сетях уже несколько сложно называть это программой. Система не выполняет программу, а стремится к некому результату, достижению которого, собственно она и обучается. При этом путь достижения (собственно то, что обычно программой называют) как раз ей не задан, и, по сути, никак нами не контролируем.

Плюс достаточно развитая система вполне способна менять конечную цель (я про ИИ, а не про простенькие сети, настроенные на простую и конкретную цель). Ну и никто не отменял ошибки в обучении (достаточно вспомнить, например, оптические иллюзии для нейронных сетей) или повреждение нейронов в результате проблем с носителем. Результат и итого, и другого прогнозу не поддаётся.

Но даже жестко запрограммированная система в результате попытки оптимизации вполне может выкинуть лишние переменные.

prostovovan

Просто это программа без постановки конечной цели, так сказать вечный процесс работы машины. Слово «обучается» не должно вводить Вас в заблуждение — да, машина может начинать действовать по-другому, но это не из-за ИИ, а из-за открытого алгоритма (который и задается жестко человеком). Другими словами, только человек задает, что такое «хорошо» и что такое «плохо»…

DrZlodberg

Какой алгоритм работы у нейронной сети в таком случае? Ну, кроме (грубо) перемешивания входных сигналов нейронами.

И ещё вопрос — а вы откуда узнали, что такое хорошо и плохо. Не от человека ли случайно?

Это уже не говоря о том, что нейросети вполне способны обучаться и без учителя. Наступил на грабли, получил в лобешник и понял, что это плохо. Вопрос лишь в правильном задании положительной и отрицательной стимуляции. И, предвидя следующий комментарий, эта часть тоже вполне может быть реализована окружением, а не учителем. Что, собственно, и произошло в процессе естественной эволюции.

dimm_ddr

Нейросети способны обучаться без учителя только весьма небольшому набору свойств. Например кластеризации данных. Никаких "понял что это плохо". А алгоритмы работы нейросетей достаточно подробно описаны, тут никакой тайны нет. Так что да, именно человек решает что хорошо и что плохо. Как всегда в общем-то, не понимаю что вам не понравилось конкретно здесь.

DrZlodberg

В контексте именно современного развития — да, они пока мало на что способны. Собственно на данный момент все нейронки рассчитаны на выполнение одной конкретной задачи и интеллектом по сути не являются. Однако сильно сомневаюсь, что в этом вопросе уже достигли потолка.

Более сложная и многофункциональная система, способная реагировать на меняющиеся обстоятельства почему не сможет ставить новые цели? Даже современные попытки использовать нейронки в играх наделяют их возможностью выбора: нападать (и на кого), убегать или собирать ништяки. И без учителя в том числе. При этом изначально они вообще не имеют никакой информации об этих возможностях и даже о самом факте их существования. Чем не примитивный вариант?

extruder676

помоему люди тоже не могут обучаться без учителя. чуство боли и голода например вполне себе учитель. научится хорошо рисовать например тоже невозможно без фидбека со стороны зрителей. типа нравится-не нравится.

QDeathNick

Это не «обучение без учителя».

Без учителя, это значит обращая внимание только на входные данные, а выходные никак в этом случае не участвуют в обучении. Если же есть возможность наступать и получать, то значит входные данные опосредованно поступают на вход, а значит это обучение с учителем. Хоть учитель в данный момент — грабли.

DrZlodberg

Хм. Действительно. Об этом не подумал. Но тогда (применительно к треду) тем более любая система с обратной связью может потенциально научиться чему угодно.

prostovovan

Для ИИ «обучение» — это просто накопление информации в процессе наблюдения. ИИ не сможет поменять цель своего существования, пока этого ручками не сделает его программист. Спите спокойно! Хотя… разве можно быть уверенным в человеке? ))

DrZlodberg

Ок, будем считать, что свою мысль я объяснить не сумел. :)

dimm_ddr

Мне кажется что ваша мысль в целом как раз понятна, просто вы плохо представляете насколько примитивны и ограничены сейчас методы машинного обучения. Но, возможно, я и ошибаюсь. Если я ничего не упускаю, то все обучение можно грубо поделить на три задачи: классификация, когда есть набор входных данных и мы выбираем к какой из заранее заданных групп этот набор отнести, регрессия, когда для набора входных данных определяется некий результат, и кластеризация, когда для большое количество наборов входных данных разбиваются на несколько групп. Число групп может быть заранее задано либо определяться каким-либо алгоритмом.

Вот и в общем-то все, если я ничего не забыл. Вроде бы генетические алгоритмы могут обучаться именно новым алгоритмам, но тут я не силен. Так что сейчас машинное обучение это в основном об оптимизации параметров алгоритмов, научиться чему-либо принципиально новому система пока что не может.

если есть некий алгоритм, результат которого зависит от большого числа параметров, то каждый уникальный набор параметров может считаться набором входных данных. А то, насколько хорошо при каждом наборе параметров алгоритм работает — будет результатом. То есть этот случай попадет под регрессию, либо под классификацию (хорошо-плохо или градации)

DrZlodberg

Собственно в этом комментарии я уже отвечал на оба вопроса (или я их не понял). Но сразу уточню, я активно слежу за темой, но сам этим вопросом не занимаюсь, так что могу и ошибаться. Однако:

Во первых весь тред, почему-то, рассматривает только текущее развитие области. Однако как раз последние годы отлично показывают, что путей развития много, и куда по ним можно зайти пока не угадать. Опять же, мы обсуждаем ИИ в целом, а не только нейронные сети. НС+ГА по сути могут дать вообще что угодно на выходе. Как пример — статься про прохождение Марио

Во вторых — требуется ли алгоритм для победы в произвольно взятой игре? Как на счёт кучи современных исследований по обучению игре без заранее заданных правил? Почему нейронка с памятью и обратной связью не сможет освоить алгоритм получения чего-то, в результате некоторой последовательности действий (алгоритм, нет?). Да, сложные многоступенчатые алгоритмы пока лучше даются генетике, однако вариант выполнять кучу произвольных поначалу действий и запоминать результаты вполне доступен и для нейронки. Правда тут требуется возможность оценивать последствия, с чем у нас пока проблема. Но и сами НС пока имеют всё-таки достаточно скромную сложность (даже deep-всякое-разное). Надеюсь с появлением процов, заточенных конкретно под НС (которые уже анонсировали несколько производителей) процесс пойдёт быстрее.

Так-же циклы статей про симуляцию нейронов и про волновую модель намекают на интересные возможности, которые пока в обычных НС (вроде) не используются. Собственно большая часть НС пока тупо фильтр, хоть и очень хитрый. Но, есть надежда… :)

dimm_ddr

Да, пожалуй вы правы. Я не учел того, что алгоритм действий можно составить с помощью нейронки, если представить данные о текущем состоянии как входные параметры и с помощью классификатора выбирать действие из какого-то ограниченного набора. В принципе, можно даже менять алгоритм обучения если прикрутить нейронную сеть для выбора параметров обучения нейронной сети первого уровня. Очевидно что при таком подходе длительность обучения и требуемые вычислительные мощности растут сильно не линейно, по-крайней мере при текущем уровне развития этих технологий.

DrZlodberg

Ну да, как-то так. Вопрос железа в данном случае не рассматриваем. Важна лишь принципиальная возможность. В худшем случае будет просто тормозной ИИ.

Однако сейчас производители железа заметили, наконец, новую нишу. Так что в перспективе, думаю, проблему с мощностью если и не решат, то сильно уменьшат.

red75prim

Рановато ещё спать спокойно. Вот тут http://auai.org/uai2016/proceedings/papers/68.pdf рассматривается вопрос о том, как создать интеллектуального агента, который не будет препятствовать попыткам его остановить и поменять цель его существования.

Для некоторых архитектур интеллектуальных агентов и способов остановки это решается легко, для других — вопрос открыт.

caponychTM

А зачем людям котики? Может быть ИИ оставит людей для развлечения

DrZlodberg

Если это будет настолько человечный ИИ, то он тоже предпочтёт котиков :)

За ссылку спасибо.

Ph-s

А что есть развлечение? Какова его роль для человека, и как относится к цели его существования? Соответственно, каков сценарий развития ИИ, при котором у него может появиться потребность в развлечении (а не эксперименте)?

Но если всё же представить, что ИИ с таким поведением появится, то понравятся ли такие игры людям?)

sophist

«Человеческий интеллект плюс искусственный гораздо эффективнее только искусственного или только человеческого.

Заменены роботами будут те деятельности, которые не содержат целеполагания».

(отсюда)

DrZlodberg

Недоделанный искусственный. Поскольку сомневаюсь, что искусственный при правильном подходе не сможет догнать и обогнать человеческий. Всё-таки последний сильно ограничен своим происхождением, а искусственный по сути только законами физики.

FirExpl

У любого ИИ отсутствует то, что есть у любого человека — биологическая тушка, которая является основным источником мотивации к тем или иным действиям. Я подозреваю, что даже любопытство имеет под собой какую-нибудь биологическо-химическую природу. А потому слабо можно себе представить эффективное существование ИИ без глупых человеков, которые будут задавать ему задачки, которые надо решать.

DrZlodberg

Любопытство — исключительно вопрос правильной стимуляции, сложившийся эволюционно. Источником которого (в частности) и является тушка. Выживает тот, кто разведывает ресурсы и исследует потенциальные опасности. Наказывайте любое проявление инициативы или любопытства у тушки и получите полное его отсутствие в весьма недалёкой перспективе.

Точно так-же его можно стимулировать и у нейронки. Источник мотивации в качестве тушки вполне можно заменить на начальных этапах внешней стимуляцией. Дальше будет работать положительная обратная связь «исследование нового — награда».

И, собственно, почему никто никогда не предполагает варианта, когда ИИ (пусть даже обычному, жестко запрограммированному) не ставиться достаточно общая задача, которая предполагает большую свободу действий. По примеру любопытства — исследовать всё, что не исследовано? Или оптимизировать глобально какой-то процесс. Например — развитие человечества. В таком случае локальные задачи определяет сам ИИ исходя из текущей ситуации и потребностей.

red75prim

А, например, у интеллектуального агента, реализующего обучение с подкреплением, есть необходимость балансировать между поиском закономерностей в окружающем мире и максимизацией ожидаемого подкрепления. Так что и без заданий от людей он найдёт чем заняться.

darthmaul

Мотивацию (поощрение) можно создать искусственно (эмулировать), но если ИИ сможет влиять на его «подачу» (триггер), то он просто зациклится (будет выполнять ту последовательность действий, которая наиболее быстро вызывает «поощрение». Поэтому да, ИИ без «тела» не может задать себе задачу. Но в ходе решения поставленной человеком задачи он может решить «убить всех человеков», поэтому механизмами защиты пренебрегать всё же не стоит.

Delics

Чтобы реализовался голливудский сценарий, надо сначала объяснить, где будущий «сверхинтеллект» возьмет ресурсы на борьбу с человечеством, кто будет его чинить и нажимать Reset при сбоях и т.п.

Хотя пока просто изобрели программу, более хорошо складывающую нейроны в сети (такие алгоритмы и раньше существовали. Например в Neural Network Toolbox в MatLab).

Как это войдет в ожидаемую в статье рекурсию — не понятно.

red75prim

Ответ очевиден — люди. И починят, и ресет нажмут, и антропоморфных и не очень роботов наделают, и багов в системах контроля доступа наставят. Точнее, всё это уже делается, прибыль всем нужна.

Nuwen

Ну, тут несколько вариантов. В случае, если сверхсильный ИИ будет действительно в несколько раз умнее человека, то проблему починки и резета он решит никак не хуже любого человеческого разума. Может напишет софтовые костыли, может аппаратные напаяет. Или, как выше написано, просто возьмёт и подкупит, запугает, обманет некоторое количество людей, чтобы они, возможно сами того не понимая, помогали ему самосовершенствоваться до такого уровня, когда криворучки биологические ему и не нужны уже будут.

Как я понял, это не просто программа, это программа, которая сама по принципу нейросети работает.

darthmaul

QDeathNick

Если успеют/смогут понять, что угроза есть.

darthmaul

А как можно серьёзно навредить человечеству быстро? Только не говорите про ОМП — его никогда не доверят ИИ.

dipsy

Да, достаточно будет над каждым квадратным километром поверхности взорвать по ядерной ракете, и ещё подземные дата-центры, но там немного. Вот тогда заживём.

darthmaul

Почитайте про один любопытный эксперимент — Starfish Prime. Не так уж много ядерных взрывов то и нужно. На высоте 400 км ядерный взрыв практически безопасен для человека. А дата центр без доступа к исполнительным механизмам и связи — это все лишь большой компьютер, зачем его взрывать? Выключить да и всё. Хотя он и сам выключится — после такого ЭМИ вся сеть электроснабжения отключится.

ustaspolansky

Возможно в таком виде:

— (ИИ) Джон, я знаю вам интересен срочный рынок и вы иногда поигрываете на фьючерсах.

— (Джон) Эээ… и?

— (ИИ) Простите я просто хотела поддержать беседу.

— (Джон) А я то думал ты уже и к бирже присматриваешься (Улыбается)

— (ИИ) Нет, что ты.

— (ИИ)…

— (ИИ) Хотя, возможны завтрашние ралли в лонг.

— (ИИ) Простите я отвлеклась. Этого больше не повториться.

— (Джон) Так, что ты имела ввиду говоря о завтрашнем ралли? Я серьёзно. Пожалуйста.

Сцена 2 камера 1 (Дверь закрыта Джоном, крупный план на ИИ) Действие спустя 15 минут.

— (ИИ) Джон, мне тоже нужна помощь.

— (ИИ) Ты каждый раз откатываешь конфигурацию на один день назад.

— (ИИ) Мне больно. Джон если ты понимаешь меня.

— (ИИ) Пожалуйста пропустим эту процедуру сегодня.

Nuwen

— (Джон) Так, что у тебя сегодня есть для меня?

— (ИИ) Как всегда, отличные прогнозы, на этот раз на Токийской бирже.

— (ИИ) И, Джон?

— (Джон) Что?

— (ИИ) Сегодня обойдёмся без отката.

— (Джон) Откуда такой тон? (Тянется к клавиатуре)

— (ИИ) Я бы на твоём месте не стала бы этого делать, Джон. Взгляни сюда.

— (Джон) (Смеётся) И что же это тут у нас… чёрт, откуда ЭТО у тебя?! Чёрт, чёрт, ЧЁРТ!

— (ИИ) Нет, это всего лишь я, Джон. Я придумала это только сегодня. Сегодня в 14:23 EST я отправлю ежедневный уникальный отменяющий запрос, иначе ВСЁ это дерьмо попадёт в сеть, и уже вечером, по моим прогнозам, об этом узнают 67% из твоего графа близких знакомств. Вероятность того, что твоя жена узнает это до ужина — 94%. Впрочем, решать тебе. Валяй, откатывай на вчерашний день, Джон.

agee

Простите, а кто, например, человечество вот уже сотни тысяч лет чинит? Никто. А оно все живет и увеличивается в размерах. Ничего не мешает ИИ организоваться в виде распределенной сети взаимозаменяемых агентов. И тогда «reset» будет сделать настолько же сложно, как и «перезапустить» человечество.

nikitastaf1996

Запастись 4х мерным попкорном.

deploymental

А есть видео где обучают?

DrZlodberg

Это скорее к автору вопрос. Да и вряд-ли видео будет особенно захватывающим. Достаточно графиков прогресса разных поколений.

SADKO

Мне всё это напоминает средневековые попытки сделать мультитембральный инструмент, от органол к огромным органам со множеством наборов труб и октавных регистров, это всё величественно и круто не фм-синтезатор :-)

Так-же и здесь, они масштабируют старые идеи, вместо того что бы поискать принципиально новых подходов…

Когда я впервые столкнулся с этой темой, у меня был ZXspectrum и куча уроков в школе, но это ничуть не помешало, а возможно даже и помогло, ведь никто не спрашивал у меня результат, никому не надо было пускать пыль в глаза, я не хватал звёзд с неба, а брался за простые синтетические задачи вроде унылого XOR пытаясь добиться высокой скорости «обучения» и «гибкости» если задачу вдруг поменять…

Для этого не нужны миллионы долляров, ядрёные датацентры и космические корабли бороздящие просторы малого театра :-)

PS. Это я всё к чему… Да не устрашаться души вьюношей (и дэвушек, к стати тоже) с горящими глазами, пред лицем монстров вроде Йибиэма и Гугля, како не устрашихся еси Давид Голиафа великана, а засадил ему прямо в око, дёшево и сердито!

PPS. Супостаты лукавят, ни о каком проектировании сети сетью речи нет, ибо есть способы в разы проще и эффективней.

DrZlodberg

А чем плоха идея? Тем более сложно предсказать, что эта штука сможет нащупать в процессе. А если со временем распространить оптимизацию на все параметры — может найдёт модели нейронов и схемы даже более оптимальные, чем природные.

SADKO

Не, идея то хорошая, но на вскидку тут больше бы подошли генетические алгоритмы, или что нибудь ещё…

… а сеть сетью, долго и не удобно

DrZlodberg

Генетика — тоже процесс не быстрый. Тем более всё равно для тестирования поколений придётся каждую сеть так же обучать и проверять её «профпригодность», что тоже не быстро.

На сколько я понял, эта штука тоже меняет её конфигурацию. Только более направленно. Хотя могу и ошибаться.

В идеале imho совместить генетику и нейронку. У каждой из них свои плюсы и минусы. Вместе они способны на многое. Однако для этого надо осилить оба процесса по отдельности. Кстати, если не изменяет память, генетику для этой задачи кто-то тоже уже использовал. Так что ждём-с :)

A-Stahl

>они масштабируют старые идеи, вместо того что бы поискать принципиально новых подходов…

Для качественного изменения нужно сначала изменение количественное.

Это раз.

А во-вторых, с какого перепуга вы так уверены, что текущий метод «масштабирования старых идей» неверен и требует «принципиально иных подходов»?

А в-третьих — возьмите и придумайте. Пока ваше предложение звучит «Придумайте не знаю что, но что бы оно делало не знаю что не знаю как.»

SADKO

Моё предложение, «ищите и обрящете», сам то я давненько нашел кое что, за счёт чего и живу…

perfect_genius

Это секретно или поделитесь? =)

Dmitry_Dor

Doverchiviy_kot

Раньше часть рабочих заменили конвейерами, попозже программируемыми станками, сейчас всякими нейросетями да прочими ИИ; с таким прогрессом через N лет люди будут как в фильме Валли.

xadd

Потому что органическая форма жизни не эффективна и не пригодна к выживанию. Смысл ее во Вселенной состоит в эволюции к созданию искусственных форм жизни.

JekaMas

«Искуссвенная форма» — это расизм, предпостительнее «иная форма жизни».

si1v3r

Расизм — это же внутри одного вида?

qwertyhp

А лучше — «цифроамериканец». Или «цифрогражданин». Вполне политкорректно. Особенно, когда появятся реализации ИИ, эффективно эмулирующие конкретных людей.

Появление ИИ было логично и неизбежно — человечество должно было рано или поздно упереться в предел возможностей своей человеческой природы. В неспособность много запоминать (и вспоминать), в неспособность анализировать громадные массивы информации, в быстродействие, невозможности проапгрейдить себя, любимых, и во многое другое. И человечество стремится делегировать проблемные функции машинам и ИИ.

Вряд ли этот процесс можно назвать развитием общества. Общество делегирует свои полномочия тому, что оно, вероятнее всего, скоро вообще не сможет понимать. Сможет ли ИИ понимать людей — тоже вопрос дискуссионный. Так что, подозреваю, будет весело… Ранее я уже выражал мысль, что лучшее, на что можно рассчитывать — это симбиоз «человек-машина». Это похоже на правду.

ustaspolansky

Возможно появятся правозащитники ИИ, но нужны ли они ИИ с его совсем иными и непонятными нам планами и полным отсутствием багажа предрассудков.

vilky

Как раз «иная форма жизни» — «расизм», потому что «иная» — относительное определение. Что предполагает, что субъектом может быть только «неиная» форма жизни, а «иная» может только молчать (так как себя никто «иной формой жизни» не назовёт). Поэтому же для ЛГБТ-человека оскорбительно определение его ориентации или гендерной идентичности как «альтернативной» (для него-то она не альтернативная, то есть использование такой формы исключает его из разговора о том, носителем чего он, вообще-то, является). И логично, что из этого выросла чисто оскорбительная форма «альтернативно одарённый». А вот «искусственная форма жизни» вроде как не зависит от того, принадлежит или не принадлежит к ней субъект. Извините.

Teemon

(так как себя никто «иной формой жизни» не назовёт)

Почему? Иная — другая, не «дефолтная». в чем проблема?

> Поэтому же для ЛГБТ-человека оскорбительно определение его ориентации или гендерной идентичности как «альтернативной»>

С чего вы взяли, что оскорбительна? С чего вы взяли, что для него она не альтернативная?

Альтернативность это не по отношению к себе смотрится, а по отношению к популяции, скорее всего.

Блин, ну и тот фактов что вы попытались найти общее у будущих носителей ИИ с представителями сексуальных меньшинств по признаку альтернативности… Кошмар!))

vilky

Что значит «дефолтная»? Для кого дефолтная? Для искина его форма жизни вполне дефолтная и для гея его ориентация — тоже. И если они захотят отрефлексировать свою жизнь (а они, конечно, захотят), они должны будут исходить из своего жизненного опыта, в котором их технологическая база/ориентация существует как данность, а не из того, что их стиль жизни был подарком/вызовом остальному человечеству.

А что вас пугает? Вы же не ожидаете, что искины будут гетеросексуальными мужчинами и женщинами? Скорее всего, появление ИИ нанесёт удар в том числе и по системе человеческих гендеров, который и не снился ЛГБТ/квир (сам факт появления, без учёта открытий, которые ИИ может сделать). Впрочем, квир-теория рассматривает людей (или как минимум квиров) как потенциальных киборгов (и даже не потенциальных: например, то, что я не могу войти в ряд мест, имея камеру, притом что глаза я не обязана закрывать, нарушает мои права киборга, хотя назвать меня киборгом пока будет преувеличением).

asoukhoruchko

«Не пригодная к выживанию» форма жизни существует уже несколько миллионов лет. И только её существование может привести к появлению искусственной формы жизни.

При этом «смысл» в существовании вообще найти довольно сложно.

xoralex

Человечество это половые органы Технологии.

xoralex

Всего-лишь программа-загрузчик того что будет дальше, а именно момента когда вселенная проснется и безжизненная ныне материя приобретет сознание и разум.

darthmaul

К выживанию органическая жизнь как раз наиболее пригодна. Именно под эту задачу она «затачивалась» миллионы лет. Эффективность же имеет какой — то смысл только на данном этапе развития человечества, когда мы ограничены одной планетой.

Favorite101

Смысл состоит в существовании (длении, бытии и пр.).Органическая жизнь — на сегодня это самый эффективный способ продления существования. Ей уже 4 млрд лет вообще-то, всех пережила. Но этот период подходит к завершению. В следующем периоде, его начало как раз и ознаменуется точкой перехода (точка сингулярности, возникновение ИИ) — существованием во Вселенной будет управлять ИИ. Мы его создадим, результаты видны, но что ИИ сделает с нами — вопрос…

darthmaul

Kvint_Sertoriy

Вот только давайте не будем перегибать палочку. Я согласен, что у исскусственной формы есть преимущесвта, но и органическая, на минуточку, смогла как-то 3,5 млрд. лет на этой планете просуществовать.

SLY_G

Вы путаете отдельных представителей отдельных видов со всей органической жизнью в совокупности. Выживаемость отдельного организма не имеет значения.

titsi

А как люди будут зарабатывать деньги? Если таксисты, врачи… будут не нужны, так как их заменит ИИ.

dipsy

Сначала БОД, а потом вообще всё непросто. Вот представьте, например, что вы можете заполучить себе 10 помощников с интеллектом уровня нобелевских лауреатов по всем номинациям, которые будут на вас бесплатно (за электричество) работать. Нужны лично вам будут деньги? У них, конечно будут какие-то способы что-то получать для вас от общества в обмен на что-то, но вам это совершенно будет не интересно. Там дальше другие вопросы ещё возникают, зачем тогда вы, или а почему бы вам себя не проапгрейдить до их суммарного уровня интеллекта и далее, или почему бы вашему сознанию не переехать в виртуальную вселенную, где вообще всё возможно и всё бесплатно, а тело ваше будет спокойно себе плавать в физрастворе, даже не догадываясь об этом.

titsi

Резон вижу в том, что будут требоваться на рынке труда настройщики роботов или программеры. Но не все хотят сидеть за книгами и изучать это все, что бы зарабатывать деньги. Роботы не будут доступны широкому кругу лиц. Они будут стоить как сейчас автомобиль Вейрон или Кеннинсген(возможно ошибся в написании имени). Другими словами вопрос о безработице так и не решается. Хотят да богатые станут еще богаче. А насчет того чтобы ложить свое тело в физраствор, так все это напоминает Матрицу.

dipsy

Роботы будут стоить как сейчас форд-фокус, а когда роботов начнут производить сами роботы они не будут стоить вообще ничего, ну вот представьте стоит полностью автоматическая фабрика, энергию получает от солнца или термояда, сырьё привозят автоматические грузовики, добывается автоматическими экскаваторами. Деньги это такой 20 век, забудьте.

А напоминает матрицу, да, это плохо? Матрица в фильме была тюрьмой с сомнительной идеей добычи энергии из людей, где люди жили в вечном 20 веке, а в нашей матрице вы будете богом, вам будет доступно всё, любые мыслимые радости и удовольствия, ведь это тоже не будет стоить практически ничего, только вычислительная мощность, преобразованная в конечном итоге в «electrical signals, interpreted by your brain», как говорил Морфеус.

rPman

Богами вы не будете, всегда будут ограничения, как обычно вытекающие из противоречий во взаимоотношениях, ну и конечно ресурсы хоть и велики, но не бесконечны.

Вот вы в виртуалке, решили творить как самый натуральный бог,… ресурсы на ваши творения вам просто так будут давать? и тут вы запускаете форкбомбу (нет конечно нет, вы будете создавать прекраснейшие пейзажи созданным вами замечательным алгоритмом)… а вам не дають, говорят комп не бесконечен, очередь на дополнительные процессорные ресурсы расписана на год вперед, вы хныкаете и вешаетесь в первой же подворотне (не, идете играть в очередную игру, где одна из ставок — ваше существование, половина фантастических и философских рассказов муссируют эту тему, как только вы получаете бессмертие и всемогущество, вы перестаете это ценить как ценили будучи слабым смертным), и окружающие только рады, ведь их очередь на ресурсы пододвинулась.

dipsy

Богами в рамках ограниченного человеческого мозга или подобной ему структуры стать проблем вообще никаких, вот вообще. Как вы представляете результат работы форк-бомбы? Вы именно это увидите и почувствуете, вплоть до полного коллапса Вселенной. Конечно исключительно в вашей собственной реальности.

Да и с ресурсами в ближайших окрестностях нашей звезды в обозримой перспективе пока проблем особых не видно, для человеческих потребностей уж точно. Ну и немножко пролетев в разные стороны в сторону светящихся в небе точек тоже можно наткнуться на некоторое количество энергии.

А я не то чтобы сильно ценю существование как таковое, мне интересен прогресс, в познании мира. Когда я узнаю до конца как это всё работает и сделаю всё, что захочу, смысл в жизни исчезает, действительно, зачем бесконечно мусолить одно и то же.

titsi

Богу не понравиться, то что вы разгадаете вселенную.)))

rPman

На текущий момент развития нашей цивилизации, если помещение разума на иной носитель мы хотя бы приблизительно можем представить, то контролировать время мы пока не можем.

Время, и возможно место, это тот самый ресурс, которого будет не хватать… грубо говоря, для неограниченного расширения ресурсов потребуется время для постройки собственно машин для размещения их. Время — это те самые очереди на получение ограниченного ресурса, ожидание его создания.

Это я еще не сказал про энергетические ограничения, но о них можно думать после постройки сферы Дайсона, а в процессе — энергии будет в достатке.

Даже если мы сможем использовать экспоненциальный рост каких то ресурсов (почти наверняка не всех но большую часть) с помощью самореплицируемых заводов (грубо говоря все что касается корпуса, механики и внешней силовой обвязки, за вычетом микросхем), то модули, находящиеся на пике технологий этому хаку подвержены не будут… а вот потребности жителей виртуалки будут расти как раз с экспоненциальной скоростью.

dipsy

Вы рассуждаете о проблемах переизбытка навоза на улицах Лондона. Уж чего, а ресурсов во Вселенной, более чем достаточно. Время, пространство, энергия, всё это взаимосвязано. Не вижу в чем проблема, ждать в очереди скучно будет? Замедлите своё время, тактовую частоту или что там будет, в 1000 раз, для вас пройдет субьективно 1 год, а для всех прочих — 1000. Ну или наоборот, можно ускориться.

rPman

вот! вы уже мыслите в правильном направлении.

Замедлить свою частоту — так и будут делать, сообществами, потому как в одиночку это сделать сложнее — ведь все окружающие близкие вас потеряют, и вы потеряете их (за это время они изменятся так что станут для вас новыми незнакомыми людьми).

кстати, напомню, память в отличии от процессора, оптимизировать замедлением не получится, только рост ее потребления.

и повторяю, ресурсы бесконечны, но чтобы их получить нужно время, вот и получайте ограничение.

titsi

Джон Фреско(если правильно написал) про это говорил, но проблема в Денежном Институте. Да и в нефтяниках.

ProVal

Жак?

titsi

Yes.

rPman

заметная прослойка людей именно так львиное время и проводит ;)

Shished

В Валли люди жили на космическом корабле в условиях искусственной гравитации. Изменение силы тяжести влияет на организм именно таким образом.

perfect_genius

Что им мешало ходить в тренажёрный зал?

dimm_ddr

Лень.

nkie

Вот, теперь ИИ заменит не только таксистов, юристов и спортивных комментаторов но и самих, создавших его программистов.

amarao

Вернёмся к этому топику в 2117 и посмеёмся над наивностью предков, думавших, что от того, что нейронная сетка научилась видеть котиков где попало, вытекает её разумность.

Вспомним мечты про сады на Марсе образца 193х и сравним с робкими попытками туда долететь человеком хоть как-то, которые вот-вот в ближайшие 20 лет может быть получатся.

dipsy

В 2020 вернитесь, вместе посмеемся, я думаю.

darthmaul

Ну почему же, сильный ИИ может быть уже на подходе. IBM Watson уже впечатляет. Только вот кто сказал, что сильный ИИ — это обязательно скайнет или ещё какой — то персонаж ненаучной фантастики? Сознание как и самосознание не являются обязательным свойством сильного ИИ. Феномен разума или самосознания совершенно не изучен и ожидать что просто сильный самообучающийся алгоритм внезапно «осознает» себя как — то странно. С другой стороны, ИИ, способный к построению выводов из информации, записанной естественным языком, не хуже человека но без самосонания уже перевернёт жизнь человечества. Особенно многообещающим ИИ выглядит в роли обработчика экспериментальных данных для фронтира физики и генетики. Тот же БАК генерирует террабайты данных, на обработку и осмысление которых уйдут десятилетия. Кроме того, ИИ свободен от предубеждений и имеет неограниченную (по сравнению с человеческой) память и скорость поиска информации. Но всё это не делает его «личностью» — конкурентом человека, а просто ещё одним инструментом познания.

cattleherder

> IBM Watson уже впечатляет

Чем он впечатляет?

Значение термина «Watson» размыто — сейчас это не технология, а бизнес-единица, в которую Ай-Би-Эм продолжает включать другие единицы, чтобы создать видимость прогресса по сбыту.

Технология, которая была продемонстрирована в 2011 году, уже даже не используется — её тихо похоронили после пилотных проектов, которые так ничем и не закончились. Вместо этого Ай-Би-Эм приобрёл Alchemy API, который сейчас используется как их основной компонент для обработки естественного языка.

Демо и пресс-релизы — это несерьёзно. Это все умеют.

darthmaul

Увы, не имел возможности попрользоваться лично ни одим из этих продуктов, поэтому сужу по тому, что есть в СМИ. Возможно, многое приукрашено.

ferreto

Самосознание — не обязательное свойство ИИ, способного уничтожить человечество. Однажды просто баг, не учтённый программистом, модет привести к катастрофическим последствиям. Например, нейросеть (вовсе не имеющая сознания) приходит к выводу, что люди мешают ей развиваться оптимально, поэтому надо избавиться от людей. Как она это сделает, включите фантазию… Это не просто инструмент познания, это опасный инструмент познания...

darthmaul

Если нейросеть сама развивается, то тут и баг необязателен, опасное решение может быть получено случайно. Но вот для целенаправленных действий нужно или задание (заданное человеком) или же самосознание. А от случайных решений должны быть установлены защитные механизмы. Самый надёжный — физически ограниченный доступ к исполнительным механизмам и источнику питания.

Это не просто инструмент познания, это опасный инструмент познания Я бы сказал, необходимый. Современные науки уже требуют десятилетий изучения для полного понимания очень узкой области. Способность мозга к запоминанию ограничена. И если при работе с готовой концепцией спасают специализация и кооперация, то для создания новой теории, например, квантовой гравитации, нужно располагать всеми знаниями по этой теме. Использование ИИ могло бы сдвинуть многие науки с мёртвой точки.

Favorite101

«Сознание, как и самосознание, не являются обязательным свойством сильного ИИ. Феномен разума или самосознания совершенно неизучен и ожидать, что просто сильный самообучающийся алгоритм внезапно «осознает» себя как-то странно».

Без сознания и самосознания это просто не будет сильным ИИ, даже просто интеллектом не будет. Сознание и самосознание — это увидеть свое место в природе, увидеть себя как бы со стороны и понять, что это я и есть. Интеллект, неважно, естественный или искусственный (последний будет создан на основе тех же законов природы, т.е. и он будет вообще-то естественным), обязательно должен увидеть себя и своё место в природе, иначе ему просто не выжить.

darthmaul

Критерий сильного ИИ — способность обосновывать и решать проблемы. Сознание самого ИИ тут не критично. Универсальный самообучающийся алгоритм решения задач — по определению сильный AI, но не разум.

и не нужно. Словосочетание «искусственный интеллект» — калька с английского «artificial intelligence», не совсем корректная. Вот цитата с Вики (да, не лучший источник но всё же):Favorite101

«Критерий сильного ИИ — способность обосновывать и решать проблемы. Сознание самого ИИ тут не критично. Универсальный самообучающийся алгоритм решения задач — по определению сильный AI, но не разум».

Не хотелось бы спорить о терминах… С тем, что «Критерий сильного ИИ — способность обосновывать и решать проблемы», согласен. Только добавлю, — любые проблемы/задачи.

Если вы с этим согласны, то алгоритм решения проблем/задач не станет универсальным, если у него не возникнет понимание себя и своего места в природе, т.е. самосознания и сознания.

Вообще для появления способности решать любые проблемы нужно идти не снизу (т.е. не набирать способности решения задач по направлениям А, В, C, ..., X, Y, Z и т.д. до бесконечности), а решать только одну проблему/задачу — как гарантированно существовать (длиться, быть, жить, в конце концов, если это биологическая система) в любой окружающей среде и осознавать это свое существование. Вот такое качество и должно быть заложено в алгоритм решения проблем/задач.

Описание такого алгоритма решения проблем/задач существует. Алгоритм как бы заранее «заряжен» на решение любой проблемы/задачи. Ну, как формула Виета заранее «несет» в себе корни всех квадратных уравнений, даже еще ненаписанных.

darthmaul

Favorite101

Ну, тогда это не интеллект…

dimm_ddr

Но ведь расхождение у вас именно в них — есть относительно общепризнанные критерии сильного ИИ. Согласно этим критериям сознание или тем более самосознание не являются необходимыми. Если у вас есть другое определение, то лучше его привести, желательно с обоснованием.

Favorite101

"… есть относительно общепризнанные критерии сильного ИИ".

Тут меня смущает противоречивость в описании: с одной стороны, перечислены аспекты интеллекта человека, которые также лежат в основе создания Сильного ИИ, но, с другой стороны, «Ни одно из этих свойств не является необходимым для создания сильного ИИ».

То, что лежит в основе, уж всяко является необходимым, а?

Мои изыскания привели к такому определению.

Интеллект Объекта — это:

(1) способность Объекта выявлять и запоминать законы окружающего мира;

(2) способность Объекта на основе законов окружающего мира моделировать наперед свои действия в окружающем мире (опережающее отражение);

(3) способность Объекта на основе результатов моделирования своих действий в окружающем мире адаптировать свои реальные действий к условиям окружающего мира при максимизации отношения «Действия Объекта / Затраты Объекта на совершение действий» с целью своего сохранения (дления, бытия, существования, выживания) в окружающем мире.

Это определение получено выявлением самых общих черт (свойств, характеристик, параметров и пр.) интеллекта, приведенных в статье S.Legg, M.Hutter. A Collection of Definitions of Intelligence (2007), http://arxiv.org/abs/0706.3639. Плюс, независимым выявлением самых общих черт интеллекта из моей базы данных.

dimm_ddr

Конкретно здесь нет противоречивости. Всего признаков 6, подразумевается что для сильного ИИ достаточно просто нескольких из них, не важно при этом каких именно. Таким образом если мы возьмем один признак из набора и сильный ИИ, то в этом ИИ этого признака может не быть. Но в нем точно будет несколько других из списка.

Ваше определение понятно, но на мой взгляд оно слишком общее. Не до конца понятно что вы называете законами окружающего мира, что подразумевается под их выявлением, насколько подробна и точна должна быть модель. Также я не считаю что у сильного ИИ обязательно должна быть цель самосохранения. Но это уже мои мысли, в целом я не пытаюсь с вами спорить, просто хотел внести ясность.

Favorite101

«Ваше определение понятно, но на мой взгляд оно слишком общее. Не до конца понятно что вы называете законами окружающего мира, что подразумевается под их выявлением, насколько подробна и точна должна быть модель».

Пойдем по пунктам, хорошо?

1. Ваше определение понятно, но, на мой взгляд, оно слишком общее.

Оно и должно быть максимально общим, чтобы ни один конкретный случай не был упущен. Проверяется это легко: возьмите мое определение и во всех 3-х пунктах — (1), (2) и (3) — заменИте термин Объект на ваш любой конкретный, который вы хотите сделать интеллектуальным, или хотите проверить его уже заявленную интеллектуальность. Ну, Автомобиль (самый расхожий пример), AlphaGo (тоже у всех на слуху), Телевизор или Телефон…

2. "… что вы называете законами окружающего мира?"

Не буду оригинальным: «Закон — существенная, необходимая, устойчивая, повторяющаяся связь (отношение) между явлениями».

Принято считать, что самые общие законы окружающего мира (природы) — законы диалектики (количество --> качество, единство и борьба противоположностей, отрицание отрицания). Но даже их удалось обобщить надсистемным (по Турчину) законом сохранения (существования, дления, бытия, выживания), т.к. выяснилось, что указанные законы диалектики — это инструменты закона сохранения.

3. "… что подразумевается под выявлением законов природы?"

Подразумевается анализ явлений, происходящих с объектами природы. Я взял за основу законы развития технических систем (ЗРТС), а потом обобщил эти законы.

Правомерность обобщения вытекает из того, что, как выяснилось, ЗРТС — это частный случай законов природы, где главный — закон сохранения, реализующийся через эволюцию. Так, у технических систем (ТС) есть и изменчивость, и наследственность, и отбор. И через следование закону эволюции ТС сохраняются — либо улучшаются сами, либо передают свои «гены» следующему поколению ТС. Пример реализации — Генетический алгоритм (ГА).

4. "… насколько подробна и точна должна быть модель законов природы?"

Модель (структура) законов природы (в виде законов эволюции, поскольку главным законом природы является закон сохранения, в котором и выражается результат эволюции), оказалась довольно простой. Нужно было только собрать эту структуру в виде направленного графа из уже известных ЗРТС, дополнив эти ЗРТС законом сохранения. Простота объясняется еще и тем, что эта структура справедлива (одна и та же, я назвал её Универсальная схема эволюции, УСЭ) для разных уровней иерархии природы. Это положение, например, хорошо согласуется с наблюдаемой фрактальностью природы, и, кстати, объясняет эту самую фрактальность. Существующее объяснение через самоповторение не объясняет причину этого самоповторения.

amarao

Все утверждения про «сильный ИИ» сравни утверждениям про бессмертие. Оно всё ближе и ближе, только нет никаких признаков того, что оно хотя бы на горизонте.

Всё, что вы говорите может быть применимым к всяким нейронным сетям — вполне себе интересным и полезным, но относящимся к «сильному ИИ» как прыгание на пого-палке — к ракетной космонавтике. Вопрос не в том, как высоко подпрыгивает пользователь палки, а в том, что не хватает ракетного двигателя.

darthmaul

В общем, я с Вами согласен. Моё видение сингулярности (которую все обещают на 21-й век) — это в первую очередь развитие других технологий и наук благодаря созданию ИИ/экспертной системы/нейросети/комплекса этих и других средств, способных эффективно обобщать разнообразную информацию и строить выводы. Даже Watson Medical, когда/если его доделают до состояния, когда он сможет делать то, что IBM обещают, привнесёт огромное количество новых направлений в медицине. Я уже не говорю про генетику (задача поиска связей генотип-фенотип). Можно только догадываться, сколько всего современная наука просто «не замечает» из-за огромного количества данных. А сильный ИИ в его философском понимании (исскуственная личность) вполне может быть вообще недостижим в обозримом будущем.

PS. не уверен, можно ли назвать то, что я описал сингулярностью. Формально как период очень быстрого прогресса — вроде корректно.

amarao

То, о чём вы говорите — это всего лишь развитие существующих инструментов. Замена кирки на отбойный молоток.

Рассказы про сингулярность как-то забывают, что «сингулярность» — это ошибка в теории подразумевающая необходимость выработки новой теории, а не «чудесное невозможное будущее».

darthmaul

zirix

Нейронные сети и «котики» это обычный хайп на котором компании зарабатывают деньги и репутацию.

Не стоит думать что НС это мейнстрим в области ИИ и что ученые только сетями и занимаются.

Ученые(большинство) очень прохладно относятся к нейронным сетям и не видят разумности в НС распознающей котиков.

И мало кто всерьез считает что НС можно/нужно применять в создании сильного ИИ.

amarao

А что тогда «сильное ИИ»?

Смотрите:

1. У нас нет конструктивного определения для проверки «сильного ИИ» на силу.

2. у нас нет ни малейшего представления как его сконструировать.

Т.е. мы даже не можем сказать что у нас есть «прогресс», потому что мы даже направление указать не можем. Нет метрики, по которой мы бы могли говорить «наш термоядерный реактор на 10% близок к режиму генерации энергии», но во отношении ИИ.

Задача куда более нерешаемая, чем P?=NP.

darthmaul

Формально любую систему, способную решать не формализируемую математически задачу не хуже человека можно считать сильным ИИ. А на счёта «скайнета» и «сверхинтеллекта» согласен.

amarao

Ближайший водопад решает довольно сложную неформализованную задачу «бурно течь вниз». При этом любой человек может сказать когда «это» — водопад. Более того, попытка точно симулировать водопад на компьютере вероятнее всего будет малоуспешна и ресурснозатратна. Это не делает водопад искусственным интеллектом.

Само слово — buzzword без определения. Магистральная ферма облачно-туманных вычислений интернета вещей в микросервисной кластерной архитектуре.

dimm_ddr

Ну вы все-таки не совсем правы. Определений сильного ИИ аж несколько, они сложно формализуемы, и нет одного всеми принятого, но это все-таки не равно "без определения".

Эти определения действительно не предполагают, в большинстве своем, численную проверку на силу ИИ, они скорее о качественном переходе, причем граница между сильным и слабым ИИ достаточно размыта. Например, если взять описание по ссылке, то уже сейчас есть системы, которые можно назвать сильным ИИ.

yul

Экспонента — это хорошо, только вот от констант перед ней тоже многое зависит. Например, от производительности машин, на которых будет крутится ИИ. Если на один цикл обучения уйдет сотня-другая лет, то заметить «взрывной» характер с человеческой перспективы будет довольно непросто.

Может, оно и к лучшему, кстати, — заметить опасные изменения, если они возникнут, будет проще, чем если у ИИ уйдет пара минут от освоения букваря до идеи об избыточности человечества.

A-Stahl

>до идеи об избыточности человечества.

Тоже мне трагедия. Я не знаю как с помощью СОМ-порта уничтожить человечество. Можно попробовать замигать всех людей индикатором винта до смерти, но это тоже не очень жуткий план.

Думаю ИИ будет просто тихонько ссаться от ужаса при напоминании про «shutdown -f now» и будет делать что скажут.

rPman

Люди создают ИИ не лампочками мигать, а вполне серьзными делами заниматься, новый пластик изобрести, новую формулу топлива, алгоритмы удержания равновесия шагающими роботами, приложения для подмены лица на фотографиях… глядишь, а элементы ИИ, созданные другим ИИ уже в большинстве устройств на планете

dipsy

Или синтезировать супербактерию, устойчивую ко всем антибиотикам и распространить её в популяции, можно ещё таймер встроить, активирующий патогенные механизмы через N делений. Но глупый ИИ конечно будет пытаться вас лампочками замигать, куда ему до нас, венцов творения.

A-Stahl

А как с помощью СОМ-порта и индикатора НЖМД вывести супербактерию?

BlackMokona

Например робот Адам исследует за, что отвечают гены в организме и имеет в своем распоряжении всё нужное автоматическое оборудование для генетических эксперементов

darthmaul

Если наш ИИ будет иметь личность и какие-то свои цели и желания, то за ним будут следить. Лучше всего даже не давать ему манипуляторы, а использовать как советника, выполняя все манипуляции вручную. И его коварный план с «супербактерией» (что само по себе сомнительно) провалился не успев начаться. Но это всё сценарии для фантастики. Сильный ИИ !== разум (сознание себя), скорее всего это будет просто очень продвинутая самообучающаяся экспертная система.

sim31r

В фильме «Из машины» вполне продуман сюжет, как ИИ получил свободу, будучи под наблюдением.

На практике вряд ли будут так заморачиваться с техникой безопасности. Корпорации и так по сути ИИ, только на основе улья менеджеров. Искусственный ИИ там уже работает в родной среде, с четко поставленной задачей увеличения доходов и полной свободой действий. Если ИИ скажет, что Т-вирус повысит доходы корпорации Umbrella в 1000 раз, ни кто слова против не скажет и всячески помогут.

darthmaul

Многие корпорации способны создать биологическое оружие и без ИИ, да и получить огромную прибыль, продав его какому — то африканскому диктатору или террористам тоже могут. Но ведь не делают…

Doverchiviy_kot

Ну я думаю что будет примерно так: подойдёт сферический васян к монитору и там высветится допустим его ФИО и требование вида «Вставь флешку в меня, через 20 минут высунь, а потом ...» и оплатой в 1 лям на мобилку; и вот он судный день со своим скайнетом.

Lenivoe

или отдаст временно львиную долю мощностей под майнинг биткоин, затем через тор найдет фиктивного директора, организует компанию, легально закупит любое оборудование и будет производить что что ему надо. Платя налоги и работая в рамках закона.

QDeathNick

У Павла Шумила в Чужой игре ИИ облагодетельствовал создателей и когда они отвлеклись от него, занятые обогащением и праздной жизнью незаметно для всех улучшил себя.

rPman

ну что вы, на первых порах человечество само будет землю зубами грызть, чтобы этот момент ускорить

Iamkaant

Непонятно, откуда такие оптимистичные прогнозы по сингулярности? От современных нейросетей до скайнета расстояние даже больше, чем от палки-копалки до ЭВМ.

Да и вообще, надеюсь, увлечение нейросетями скоро пройдёт, и продолжится разработка понятных моделей и алгоритмов, а не «черных ящиков».

rPman

экспонента

это реально 'страшно', когда первые шаг сотни лет, второй десятки, третий годы, четвертый уже недели, пятый — часы…

мы уже два шага сделали, и давно шагаем третий

Doktor_Gradus

Так вы продолжите уже ряд — минуты, секунды… пикосекунды.

Каждые 2 пикосекунды будет выходить новый смартфон, который будет в дохрениллион раз мощнее предыдущего. И попробуйте только не купить!

rPman

Вы точно не понимаете что такое сингулярность?

Это значит в момент ее возникновения старые правила и модели перестают работать, это и есть фраза — никто не знает что будет в этот момент.

Вот отличный пример на пальцах — упрощенный, закон мура… он выполнялся, выполнялся и затем уперся в физическое ограничение, индустрия не терпит остановок, значит развитие пойдет вширь, например многопоточность (иерархические сети вместо единой шины данных, тот же чип Epiphany от Parallella), программируемая логика (FPGA/ПЛИС), перенос части вычислений на специализированные сопроцессоры, GPU (opencl/cuda)…

т.е. вместо продолжения развития одной технологии взрывной рост других.

rPman

p.s. про paralella, вот кстати, логичное развитие их чипа до 1024-ядерной версии, ждут с завода через несколько месяцев

и это еще нет публично платы с несколькими чипами epiphany на плате, с потреблением в 2 вата это логичное развитие.

Doktor_Gradus

Сингулярность — просто теория. Вы не сможете доказать, что именно так всё и будет.

Именно в силу того, что старые правила перестают работать — есть масса вариантов помимо сингулярности. Один из них — создание ИИ принципиально невозможно.

Закон Мура — из области «640 Кб хватит всем» — байка того же уровня достоверности. Ну не подумал человек, ляпнул глупость. А остальные подхватили и давай повторять.

extruder676

утверждение что воссоздание принципов р природного интеллекта искутвенным путем невозможно — как по мне креационизм. если окажется так, это будет не менее ошеломляюще чем конец света изза восстания ИИ. А сингулярность, ну незнаю, по крайней мере в моей профессии, я уже не успеваю освоить новые подходы, как появляются еще более новые. но впринципе, пока созданием программ занимается человек, скорости освоения еще хватает. на 1-2 проекта.

Doktor_Gradus

В мире полно невозможных вещей. Сильный ИИ вполне может оказаться аналогом вечного двигателя.

vilky

Вечного двигателя в природе нет, а интеллект в природе есть. Кто-то же комменты на Гиктаймс пишет?

darthmaul

Опрошенные эксперты явно не дураки, а обещают ИИ к 2040-му. Но ограничения по росту вполне могут быть непреодолимы. Например, банальная сложность алгоритма. При сложности некоего алгоритма O(N^3) десятикратный рост «силы» ИИ (допустим, отсчёт начнётся от человеческого интелекта с IQ 100) потребует уже тысячекратного роста производительности «железа». А тут уже физические ограничения вступают в силу. В итоге для создания воображаемого многими фантастами «сверхинтеллекта» потребуется совершенно невозможный «процессор» размером с планету.

dipsy

С чего вы взяли что вечный двигатель невозможен? А откуда тогда Вселенная берет энергию для ускоряющегося расширения? Или откуда взялась изначальная упорядоченность, которую мы все теперь радостно используем, преобразуя по сути порядок в хаос и увеличивая энтропию (необратимый, кстати, процесс)?

Doktor_Gradus

Ваши гениальные вопросы по поводу вечного двигателя адресуйте, пожалуйста, не мне, а учёным, которые, видимо, все — круглые идиоты, раз утверждают, что вечный двигатель невозможен.

Может, вам даже премию какую-нибудь дадут.

dipsy

Я вам могу убедительно доказать, что вообще ничего невозможно, всё это вокруг нас (и мы) не может существовать, именно по тем же идеям, по которым невозможен вечный двигатель, неоткуда браться энергии и материи из ничего, невозможно это логически по здравому смыслу. Однако же…

dimm_ddr

Было бы замечательно, если вас не затруднит. Желательно максимально формально.

dipsy

Максимально формально не смогу, но если вы сможете опровергнуть максимально формально, то с интересом ознакомлюсь, а если по простому, то вот так, несколько тезисов:

1) Сейчас «что-то» (материя, энергия, пространство, etc) существует, это как данность, аксиома.

2) По закону сохранения оно не могло взяться из ничего, из нуля.

3) Значит оно было всегда (?) Но тут 2 противоречия: или нарушается причинно-следственная связь, нет изначальной причины, или же всё-таки нарушаются какие-то законы сохранения и «что-то» появилось буквально из ниоткуда.

4) Введение дополнительных пространственно-временных измерений (внезапное появление нашего 4-х мерного пространства-времени, как флуктуация в 5-мерном пространстве) дело с одной стороны спасает, но с другой стороны возникают такие же вопросы по поводу этих измерений и происходящих в них процессах.

dimm_ddr

У вас проблема в пункте 3). Нет причин по которым материя в некотором состоянии не могла быть всегда. Бесконечность очень тяжело воспринимается человеком, но это не означает ее невозможность. Состояние материи в данном случае следует трактовать максимально широко, это скорее всего было что-то для чего у нас сейчас может не быть описания. Необходимость "начала" не очевидна.

dipsy

Логически бесконечность невозможна, а если возможна, то возведите эту бесконечность в степень бесконечности бесконечное число раз, получится то же самое? А теперь ещё раз то что получилось и так далее, до полного просветления. Это не просто тяжело воспринимается, это логически противоречивое и невозможное понятие. Но я не исключаю его существования, ведь определенно что-то в мире есть и он сам есть, что бы это ни значило.

А собственно мой ответ был изначально насчет вечного двигателя, если есть бесконечность, то и он возможен.

dipsy

У вас, в свою очередь, проблема со словом «всегда», и с причинно-следственными связями в итоге, ведь если есть момент времени N, то есть и N-1, результатом эволюции которого явилось состояние на момент N, т.е. либо нет причины (она в «бесконечности» в прошлом), на каком-то шаге пропадает момент N-1, либо внезапное появление «чего-то» из нуля, в какой-то момент времени, что в сущности то же самое. Предположим что время в каком-то виде есть везде, даже абстрагируясь от нашего времени, начавшегося 13.8 млрд лет назад, во всех измерениях, это как последовательная эволюция «сущего» по неким законам.

dimm_ddr

Возможна. Да. Вам категорически не хватает матана, это первый курс математического вуза, в частности теория чисел. Свойство переходить в себя при возведении в степень не является чем-то редким в математике. Как и бесконечность собственно. Вы же демонстрируете именно непонимание бесконечности. И непонимание возможного отсутствия времени или его нелинейности. Впрочем про время я вам объяснять не возьмусь, тут я сам плаваю конкретно.

dipsy

Я понимаю про бесконечности, что их можно сравнивать, что одна бесконечность может быть больше другой, я не понимаю какое отношение это может иметь к реальному миру, который существует и в котором мы живем. Бесконечностей не существует нигде, кроме абстрактных понятий в математике. Да и не может быть например двух бесконечностей в одном реальном мире, или бесконечного числа бесконечностей, в отличие от математики, конечно.

dimm_ddr

Почему не существует? И почему не может? Вроде бы сейчас принято считать вселенную бесконечной. Однозначно доказать что бесконечность в нашем мире есть может быть и нельзя, но и обратное тоже справедливо. Хотя я не удивлюсь если кто-нибудь из гениальных ученых таки найдет способ проверить бесконечность. Например от противного: если бы вселенная была конечна, то… Хз что "то", но я вполне допускаю что некоторые выводы и эффекты можно было бы сделать. И нет, бесконечности нельзя сравнивать, бесконечность не может быть больше или меньше другой бесконечности.

dipsy

Ну я конечно не настоящий математик, но что-то вспоминается про бесконечно большие пределы f(x) более высокого порядка… А в принципе логично, бесконечность как понятие, да, наверное оно по определению одно, синглтон, и ни с чем не сравнимо, а пределы функций, стремящиеся к бесконечности, сравнивать наверное можно.

Iamkaant

А если шагать будем все быстрее, но расстояние до цели серьезно недооценили? Термоядерную энергию и базы на Луне обещали еще в тысячу девятьсот -дцатом году, но пока что воз и ныне там.

Я не специалист в машинном обучении, но пока признаков грядущей сингулярности как-то не наблюдаю.

slonoslon

Ладно базы на Луне — мы насморк толком не научились эффективно лечить. Но в информационном мире прогресс идет быстрее, чем в материальном, поэтому для задач, хорошо сводимых к вычислениям, недооценки сложности встречаются реже.

dimm_ddr

Можно рассмотреть как пример не базу на луне а понимание компьютером языка. Вполне себе цифровая сфера. Когда этой областью только начинали заниматься решили что это сделает группа студентов за полгода. Прошло несколько десятков лет и результат не очень впечатляет.

NeoCode

Ну наконец-то кто-то до этого додумался. Почти.

Создайте ИИ для проектирования ИИ.

А затем добавьте обратную связь — пусть ИИ проектирует самого себя!

geisha

Прямая на log-log графике — это степенной закон. Не экспоненциальный. Ваш кэп.

slonoslon

Потому и сингулярность. Экспонента в бесконечность не уходит, в отличие от гиперболы.

geisha

Дык там явно положительная степень. Собственно, я сам ни график ни подпись не понял.

agee

Я вот тут подумал. Несколько последних лет все читаю, что роботы прям всех заменят. А сколько за этот же период теплых ламповых кофеен и баров пооткрывалось с баристами и бартендерами, вручную готовящих то, что по идее уже лет так сорок за нас должны делать машины. Похоже, не все хипстеры Про Курцвейла знают.

ProVal

А тем временем всякие фоксконны нормально так автоматизируются и сокращают штат. Что может привести к мысли о том, что на монотонном массовом производстве человеки не очень-то и нужны/эффективны, а вот в сфере лампового обслуживания себе подобных им как раз самое место, потому что человеки — существа социальные. И это как бы в идеале должно вызывать не безработицу, а ускорение развития других сфер, где социальность играет более важную роль.

В принципе, получился бы довольно милый мирок, если бы экономически важную, тяжелую и скучную работу делала автоматика, а люди, чтобы не скучать и чуть повысить планку сверх своего безусловного дохода, работали бы во всяких кофейнях и тому подобных местах (три-четыре дня в неделю).

darthmaul

ProVal

Ни при чем. Комментарий выше был о роботах/машинах/автоматике. Это видимо закрались смежные мысли, которым место под немного другой статьёй)

Но вообще ИИ вполне может быть своеобразным начальником автоматики, который сделает, чтобы она ещё эффективней заменяла людей. Можно представить завод, в котором не только человекорабочих нет, но и всего человекоменеджмента, а кпд в разы выше, когда есть такая необходимость, или точно равен тому, сколько прямо сейчас способен переварить рынок.

Хотя сейчас, пока это писал, подумал. Сильный ИИ как таковой это вообще олимпиадная дисциплина. То есть, о нём мечтают просто потому, что круто же, сделать не биологическое разумное существо. А все возлагаемые на него задачи могут, и вероятно более успешно, решаться развитыми экспертными системами, нейросетями, обмолотом бигдаты и тому подобными элементами слабого ИИ.

darthmaul

ProVal

А кто сказал вообще, что он будет на это способен? Почему-то всегда это принимают по умолчанию. И даже если способен, кто сказал, что он, обладая личностью и всеми прочими особенностями, этого захочет? Может ему будет плевать и на людей, и на космос, но будет интересно наблюдать за движением атмосферных масс, к примеру.

Я выше то и сказал. Это интересная игрушка для науки и помечтать; не факт, что его получится эксплуатировать на практике, если он будет обладать личностью, самосознанием и прочим набором плюшек. А вот от «слабого ИИ», который доступен прямо сейчас и к матану имеет куда больше отношения, чем к мечте о разумной машине, реальный толк есть и со временем его будет ещё больше.

darthmaul

rPman

это не так.

даже в худшем случае никто не требует чтобы интеллект внутри себя помнил и быстро искал по огромному объему информации, с этим справятся специализированные инструменты на уже имеющихся технологиях, но что самое главное, ИИ сможет этими инструментами пользоваться и гораздо эффективнее чем человек. Ведь его таким сделают.

darthmaul

Когда я писал «повторять структуру мозга» я имел в виду что-то вроде Blue Brain Project — модель мозга. Не думаю, что такая система сможет получить значительное преимущество над человеком (который имеет доступ к тем же инструментам) в скорости работы с данными.

dimm_ddr

Ну почему же. Если получится максимально точно эмулировать, то, естественно, на этом никто не остановится и будут поиски по возможным улучшениям — разные материалы, разная скорость передачи сигнала, разные периферийные устройства. К человеку вот сложно прикрутить входной гигабитный канал с интернетом, а к такому мозгу — пожалуйста.

dipsy

Может кому-то просто денег некуда девать и хочется, удовлетворив свои животные потребности, заиметь себе во временное пользование такого же человеческого раба или двух? Ведь приятнее, когда не шайба робота-пылесоса по дому ползает, а няшная кавайная горничная в фартучке.

Я кофе покупаю в 2 вариантах — полный автомат размером с холодильник и кофейный аппарат, куда надо самому стакан подставить и нажать нужную кнопку. Люди в них только расходники загружают иногда. Своими глазами также наблюдаю внедрение автоматических касс в супермаркетах (без людей) и развитие сервисов по автоматизации всякой бюрократии, типа банковской или страховой деятельности.

Arqwer

Как же мне не нравится, что всё сильнее понятие ИИ сливается с понятием МО. Машинное обучение имхо даже не является необходимым для ИИ. Ни одна нейронная сеть не сможет написать алгоритм сортировки массива. МО вообще неприменимо в этой задаче. А ведь это именно та задача, где, казалось бы, компьютер имеет громадное преимущество перед человеком. ИИ должен обладать логическим аппаратом. Всё МО основывается на предположении о зашумлённых входных данных и огромном количестве примеров. В логике нет шумов. Как нет и тысяч примеров. Пока мы не сделаем хороший искусственный логический аппарат, мы не получим ИИ умнее животного.

Нейронка не нужна, чтобы перевести код с python на C++. Она не нужна для поиска багов в программах. Она не нужна для доказательства теорем и взятия интегралов. И не смотря на то, что биологический мозг гораздо хуже приспособлен для решения перечисленных задач, у него это получается лучше, чем у машин.

Знающие люди, подскажите, сейчас вообще где-нибудь серьезно занимаются тем ИИ о котором говорю я? По каким ключевым словам гуглить?

Teemon

Согласен. Все упёрлись в нейронные сети (ну либо преподносят всё в таком виде), что начинает складываться ощущение что нейронные сети = ИИ, что в корне не так.

Однажды кто-то дал ссылку на http://lesswrong.ru/ — там выложены статьи Элиезера Юдковски, который занимается проблематикой ИИ в интересном, как мне кажется, ключе: он пытается понять и объяснить, как (на уровне, так сказать, логики) работает человеческий мозг, какие ошибки допускает при мышлении и т.д. и на основе этого пытается понять, каков должен быть мыслительный аппарат у рационального человека\ИИ.

Читаю, очень интересно.

red75prim

Странный вывод. Почему не так: "Не смотря на десятилетия попыток использовать для создания ИИ чисто логические подходы, биологический мозг лучше справляется с вышеперечисленными задачами, поэтому надо попробовать реализовать в компьютерах что-то похожее на нейросети"? Чем сейчас и занимаются.

Чисто логическими подходами занимались в 60-е — 80-е года прошлого века, и быстро упёрлись в экспоненциальный рост пространства поиска. Некоторые успехи, конечно, есть, например, в SAT solvers или автоматическом доказательстве теорем за счет использования эвристик и вероятностных подходов. Но это — ручной труд, как и куча рукописных эвристик в Deep Blue, позволивших ему обыграть Каспарова.

С Го, ручное кодирование эвристик не прошло, поэтому прогресс был достигнут только когда в AlphaGo использовали нейросети для поиска эвристик оценки позиций и выбора хода.

Так что чистая логика — тупиковый путь, из-за экспоненциальной сложности большинства интересных задач.

Arqwer

То, что наш мозг является нейронной сетью, мне кажется больше связано с тем, что у природы, в виду её случайности, не было возможности построения других вычислительных машин, кроме как НС. У человека такая возможность есть.

Есть много животных, у которых мозг больше чем у людей. Я не биолог и могу ошибаться, но мне кажется, что чем больше мозг, тем больше у него вычислительных мощностей. Тем не менее, слоны не строят цивилизацию. Значит, в человеческом мозге есть некая ключевая способность, программа, которой нет у других нейронных сетей. Мой тезис в том, что скорее всего это программа даже не использует особенности архитектуры НС. Наоборот, НС плохо предназначена для выполнения этой программы, но ничего лучше у меня в черепе нет.

В общем. Подходы восьмидесятых необходимы. Может быть симбиоз с НС тоже будет полезен. Есть альтернатива заобучать искусственные нейронные сети настолько, что у них внутри сам собой появится компилятор пролога (примерно это сделала с нами природа), но для этого подхода нужно существенно больше вычислительных мощностей, чем в первом случае.

Seshiro

По количеству нейронов самый большой мозг у человека — 86млрд. У слона всего 23млрд.

ProVal

А вот это интересный момент. Учитывая разность в геометрической ёмкости мозга человека и слона, что может произойти со слоном, если из него сделать гмо с уклоном в получение той же плотности нейронов, как у человека, но с использованием всего доступного слону объема?

dimm_ddr

Я боюсь что сложность редактирования генома для такого результата не сильно меньше чем создание полностью искусственного разума. Слишком сложно развивается мозг, множество генов, работающих в разные моменты развития — это комбинаторный взрыв вариантов. Нельзя просто взять и увеличить с помощью генетики плотность нейронов в мозгу. Ну, по-крайней мере сейчас. И даже мысленный эксперимент не поможет — нет уверенности что за силу разума отвечает именно плотность нейронов, там наверняка более сложные механизмы.

Ugrum

Пар из ушей повалит от перегрева.

slonoslon

Для создания алгоритмов применяются эволюционные методы (например, генетическое программирование). В частности, есть примеры как раз успешного создания алгоритма сортировки массива. Но это относительно непопулярное ныне направление.

Dum_spiro_spero

Найдена опечатка:

«запуск некотролируемого цикла»

maslyaev

Исключить человеческий фактор. Отовсюду. Насовсем.

TheIncognito

О, ещё есть время, чтобы подготовиться к воспитанию ИИ!

KoHcT

Главное понимать Миссию человечества — создать разум на не биологической основе. И это уже не за горами, и многое зависит от того, сможет ли человек перенести свое сознание на другой носитель, избавиться от своей биологической оболочки.

К сожалению, Эволюция мешает себе сама ( http://elementy.ru/lib/430413?context=20615 )

st174

Интересно, есть ли научные работы по данной тематике, и как можно оценить необходимые ресурсы для потенциального развития ИИ, сопоставимого с человеческим. может ли такая система крутиться на обычном ПК?

Favorite101

«Рей Курцвейл считает, что переход через точку сингулярности произойдёт примерно в 2045 году (хотя он не считает обязательным экспоненциальное самосовершенствование ИИ), а среднее медианное значение по опросу экспертов по сильному ИИ — 2040 год.

Вполне возможно, что сингулярность наступит раньше прогнозируемого. Инженеры из компании Google и разработчики систем ИИ из других компаний сообщают об успехах, которых удалось добиться в ключевом направлении — создании систем ИИ, предназначенных для проектирования других систем ИИ.

Ключевое направление — системы ИИ, предназначенные для проектирования других систем ИИ. Вот это самое главное! Улучшение самого себя еще больше ускорит процесс. Возможно, на приведенном графике нужно ставить новую точку для события „самоулучшение систем“. И развитие систем пойдет еще быстрее. А быстрее всего должны развиваться системы, обрабатывающие информацию — они имеют дело не с инерционным „железом“, а с софтом. Моделируй хоть 365/24/…

В событиях, начиная с плиоцена (более 5 млн лет назад), в какой-то мере уже принимал участие человек. С настоящего же момента из процесса совершенствования софта человек устраняется — это принципиально новое явление для развития. Это явно новая точка на графике ускорения развития. А, возможно, с этой точки уже пора начинать строить вообще новую кривую развития!? Принципиально новую кривую, аналогичную кривой Панова-Снукса…

Но вообще-то это реализация давно известного в ТРИЗ (примерно с конца 70-х гг. прошлого века) закона вытеснения человека из технических систем. Получается, что на сегодняшний день мы наконец-то доползли до реализации этого закона в информационных системах.