Некоторые люди полагаются на зрение для распознавания личности собеседника. Это крайне ненадёжный подход, если можно подделать картинку на экране. В эпоху цифровой видеосвязи внешность, голос и поведение человека перестали выполнять функцию надёжной идентификации.

За последние годы разработано несколько эффективных инструментов для подделки видеопотока, в том числе Avatarify Desktop и Deepfake Offensive Toolkit. Таким образом, у злоумышленников появились все возможности, чтобы подделать лицо и голос произвольного человека во время звонка. Специалисты по безопасности и пользователи должны понимать, насколько элементарно выполняется такая операция.

Avatarify Desktop

Одним из первых опенсорсных инструментов для видеоспуфинга стала программа Avatarify Desktop в 2020 году. Для работы требуется Windows 10, рекомендуется видеокарта GeForce 1070 или выше и веб-камера (текущая версия программы 0.10, 897 МБ).

После установки программы её нужно настроить, подключив веб-камеру и расположив своё лицо в центре кадра, а потом выбрав подходящий аватар из набора внизу: Эйнштейн, Стив Джобс, Мона Лиза и т. д.

Спуфинг конференцсвязи выполняется через виртуальную камеру. В настройках Zoom или другой программы для видеокнференций в качестве источника видеосигнала следует указать Avatarify Camera.

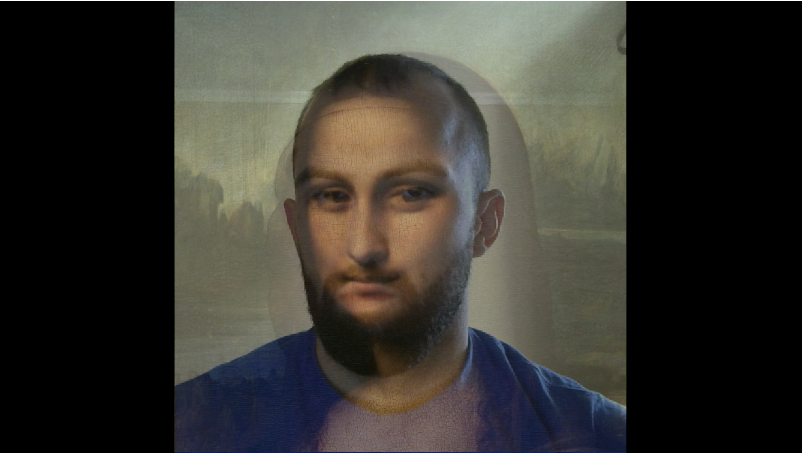

В программу можно загрузить произвольный аватар, то есть фотографию любого человека. Разработчик поясняет, что спуфинг выглядит наиболее реалистично, если поза на фотографии совпадает с реальной. Для совмещения источника с аватаром предназначен слайдер Overlay, регулирующий прозрачность накладываемых слоёв (на КДПВ).

Deepfake Offensive Toolkit

В июне 2022 года на Github опубликован более продвинутый инструмент Deepfake Offensive Toolkit (DOT), разработанный компанией Sensity, которая специализируется на пентестинге видеосистем KYC.

Программа тоже работает через виртуальную камеру, которая генерирует интегрированный видеопоток, получая вход с веб-камеры и вставляя туда результат генерации дипфейков.

Нейросеть уже обучена. Дополнительное обучение не требуется. Результат генерируется на лету по фотографии объекта.

В данный момент поддерживается несколько методов генерации: OpenCV (низкое качество), FOMM (First Order Motion Model), а также SimSwap, в том числе с опцией повышенного разрешения (через GPEN).

Для работы программы под Windows требуется OBS Studio с плагином VirtualCam. Сначала виртуальная камера настраивается в OBS Studio, а затем уже в Zoom или другой программе для видеоконференцсвязи появляется новый источник сигнала

OBS-Camera.Идентификация по видео — ненадёжный вариант

Главная проблема заключается не в самом факте разработки доступных опенсорсных инструментов, которыми легко пользоваться. Это было вполне предсказуемо.

На самом деле корень проблемы в чрезмерном доверии к видеосвязи. Недавнее исследование Deepfakes vs Biometric KYC Verification от компании Sensity выявило уязвимости для спуфинга в десятках современных систем проверки личности по видеосвязи (KYC).

Вышеупомянутый DOT разработан именно для тестирования таких систем, чтобы выявить уязвимости в процессе проверки ID. В рамках эксперимента разработчики проверили пять систем KYC. Инструмент обманул пять тестов active liveness (проверка живого человека в кадре), пять тестов на проверку ID, а также четыре из пяти тестов passive liveness и четыре системы полной проверки личности (KYC).

Различные научные группы последовательно предлагают методы детектирования дипфейков на видео. Вот задача для анализа с конкурса Deepfake Detection Challenge:

Но эти методы распознавания включаются в обучение моделей для генерации дипфейков следующего поколения, так что подобный подход нельзя считать кардинальным решением проблемы.

Спуфинг видеосвязи уже используют в реальных преступлениях. Предположительно, с помощью сложных дипфейков в 2021 году была взломана государственная система распознавания лиц в Китае. Украденные биометрические данные использовались для подписи поддельных налоговых деклараций на 500 млн юаней ($76,2 млн).

Недавно в США тоже зарегистрирован случай социальной инженерии с использованием высокотехнологичных дипфейков.

Авторы отчёта Deepfakes vs Biometric KYC Verification оставляют открытым вопрос, насколько распространён этот метод атаки и насколько легко использовать дипфейки в режиме реального времени. Но следует чётко понимать, что сейчас спуфинг видеосвязи — элементарный приём, доступный каждому.

Чтобы гарантировать аутентичность картинки, вероятно, придётся внедрить дополнительные меры защиты. Например, это может быть цифровая подпись фреймов сертификатом конкретной видеокамеры.

Комментарии (19)

GennPen

07.07.2022 23:18А как же DeepFaceLive? Довольно неплохо работает. Впрочем, все зависит от качества натренированной модели под конкретное лицо, универсальные не очень хорошо работают.

Doman

08.07.2022 09:34+1А что по поводу голоса? Пока нет тулкитов? В последний раз, какое-то приложение, при регистрации, попросило на видео повертеть головой и голосом прочитать цифры с экрана.

maslyaev

10.07.2022 13:04+1Надо сделать двухфакторную авторизацию при звонках. Типа такого:

-- Привет, дорогая, как дела?

-- Никак, пока ты не сказал 6 циферок из Authy

Soukhinov

10.07.2022 13:43Скоро уже и при личной встрече нельзя будет быть ни в чём уверенным.

Приходит к тебе в гости знакомый, просит денег взаймы. А ты ему говоришь «Подожди секунду», и звонишь ему на мобильник (а лучше в какой-нить криптографически-стойкий мессенджер). У него раздаётся звонок телефона в кармане. Он говорит «Да всё нормально, это я». А ты ему «Нет, ты трубочку всё же возьми»…

Где граница паранойи?

Soukhinov

10.07.2022 18:03Скоро: познакомился с девушкой, женился, но дети никак не получаются. Повёл её к врачу, врач смотрит её УЗИ и говорит «Да вы же женились на рекламном боте! Она просто кажется человеком потому, что это спуфинг, adversarial-аттака на ваши органы чувств. А последние версии уже и на УЗИ не отличить».

lxsmkv

Главное, чтобы сертификат камеры не был фейком :)

Для конференций могу себе такое представить. Для записаных - не понятно, как это будет работать. Потому что тогда видео нельзя будет отредактировать, ведь любое изменение кадра автоматически сменит хеш-сумму.

Да и вопрос доверия это все как бы не решает. Я должен верить сертификату какой-то дешевой китайской видеокамеры? Да можно производить миллион разновидностей фейковых "видеоустройств" чтобы их фейковыми сертификатами шифровать фейковый видеопоток. Если ты не контролируешь источник, то и доверия быть не может.

me21

Ну будет блокчейн, цепочка подписей для кадра - подпись камеры, подпись конкретного экземпляра видеоредактора на конкретном компьютере...

Godlux

Блокчейн. Для каждого кадра. Даже для 60 fps это кажется страшным.

vikarti

Требования редактора к максимально огороженному компьютеру (Надо ж защищать подпись) — что похоже значит наличие сложного и конфликтного античита + НЕ работу под линуксом в общем случае.

А также — возможность тех у кого есть доступ к отзыву сертификатов — объявить конкретные записи(или все с данной камеры) фальшивыми.

Да, а что со сроками действия сертификатов? Если они относительно короткие — надо еще и сервер временных меток иметь для камеры а значит у камеры должен быть доступ в интернет

up40k

Не очень понял ваш посыл относительно доверия. Как я понял, предлагается создать что-то общее между HDCP и TLS (то есть доверие должны обеспечивать CA, подписывающие сертификаты камер).

Тут вопрос в другом, между камерой и пользователем есть air gap, в который можно вмешаться. Без лидара (и канала глубины в видеопотоке) не обойтись. А это усложняет эксплуатацию. Впрочем, на рынке уже есть куча решений типа Windows Hello и FaceID, осталось добавить в них уровень доверия. Делов-то =)

lxsmkv

Да какое там доверие, CA от человеческих ошибок не застрахованы. Как в той истории из 2001 года, когда чувак получил два сертификата выдавая себя за работника Майкрософт.

Или ssl сертификаты подтвержденные доменом. Этим сертификатом проверяется по факту, что заявитель физически контролирует домен. Например ему посылают емейл на почту домена, или просят положить определенный файл на сервер. Личность заявителя при этом никак не проверяется. Т.е. мы доверяем тому кто контролирует домен. Еще раз: тому кто контролирует домен. Это все равно что кто-то бы выдал лицензию магазину попросив во вторник в 12 часов выставить клубничное варенье пирамидкой в шестом ряду справа от касс. Это ничего не говорит о том стоит ли покупателю доверять этому магазину. И можно ли верить тому, что если на консервах написано "Тушенка новгородская", то она действительно сделана в г. Новгород. Или что сроки годности не перебиты. Про владельца магазина покупатель не знает ничего кроме того, что он имеет способ в некотором смысле этим магазином управлять.

up40k

Снова не понял, особенно про доверие покупателя магазину =)

В любом (нормальном) магазине есть уголок потребителя, там помимо прочего указан ИНН владельца магазина, CA в данном случае является ФНС. На этом этапе аутентификация окончена. Если владелец магазина перебил сроки годности на тушёнке, и вы это обнаружили - вы знаете, на кого писать заявление. Вон, ИНН пробивается в интернете.

Доверие - штука многоуровневая. Никто не может вас обязать доверять в приказном порядке магазину или "защищенному" устройству в плане срока годности тушёнки или неизменности потока информации. На этом уровне доверием управляете вы сами.

Сертификат (TLS, ИНН) в данном случае обеспечивают базовое доверие на уровне аутентичности источника. Что делать с этим знанием - решать вам.

В конкретном примере из статьи, вы можете ограничить систему KYC доверием определенному набору производителей видеокамер, с которыми у вас даже могут быть договорные отношения. При этом CA у них может быть общий, а может быть у каждого свой, главное, что вы заранее доверяете этим CA. Он может быть даже ваш собственный, и вы даже можете требовать от производителя проверки и сертификации оборудования на своей стороне, перед тем, как организовывать цепочку доверия!

lxsmkv

"Quis custodiet ipsos custodes?" - "Кто наблюдает за самими наблюдателями?"

От этой проблемы не избавиться.

Почему мы должны верить фирме только потому что она самая большая?

Ведь в примере выше, налоговая инспекция это государственный орган, а где государство, там и уголовный кодекс. Совсем другая ситуация. А сертификаты - это частный бизнес.

И вся пирамида доверия по своей сути просто машина для печатания денег. Она не заинтересована в том чтобы что-то улучшать, она заинтересована в том чтобы получать деньги. Все попытки этой системы себя улучшить будут подразумевать сохранение своей структуры. Значит никакого принципиально нового решения эти организации предложить не смогут, по определению. Может это и не их забота.

Я считаю, что нужно искать новые способы защиты от подделки. Мы серьезно говорим в блокчейне об "атаке 51%", но пирамидам фирм про которые нам ничего неизвестно, мы слепо доверяем. А почему мы им доверяем? Потому что у нас нет другого выхода.

vikarti

Есть OV/EV сертификаты. Точнее были. Просто вопрос там ведь — или мы имеем TLS везде и массово и тогда проверка должна быть максимально автоматической (даже не почта, ее скриптовать сложно а "положите файл в определенный каталог/положите определенную запись в DNS" или мы проверяем документы тщательно но имеем кучу сервисов где TLS нету и не можем требовать шифрование канала в любой ситуации. Оказалось что документы не так важны. Тем более что, как выяснилось, EV-сертификаты делают именно то для чего созданы — проверяют что есть фирма с таким именем… но вот только названия фирм внезапно не уникальны и получаются фокусы вроде https://arstechnica.com/information-technology/2017/12/nope-this-isnt-the-https-validated-stripe-website-you-think-it-is/

Didimus

Например, вам звонят по видеосвязи и всплывает предупреждение, в прошлый раз у абонента была другая камера.

Предполагаю, скоро будет много шарлатанов и мошенников, обещающих общение с умершими родственниками.

event1

Во-первых, доверие нужно не всегда. Видеоконференция, на самом деле не бог весть какая проблема. А вот если идентифицироваться по телефону для открытия банковского счёта, то это уже другая история. Технологически это может быть реализовано следующим образом: камера отдаёт подписанные кадры, телефон посылает их без изменений в агентство подтверждения, а те, в свою очередь, сверяют сертификаты. Если доверенный, то ок. Примерно так HDCP по-моему работает. Там же есть глобальная организация, выдающая ключи.

Soukhinov

А если криптографически-стойкая видеокамера направляется при этом не на человека, а на монитор, на котором показано нужное изображение?

event1

Можно лидар к камере прикрутить. Можно выдавать на экране задания, типа "наклоните голову", "моргните два раза" и таким образом защититься от этих атак.

Soukhinov

Ну, приходим к тому, что чем богаче данные, тем сложнее их подделать (хотя бы потому, что для столь богатых данных может не быть обучающих выборок).

Камеру делаем мультиспектральной и времяпролётной (для 3D). Просим человека намочить лицо солёной водой (чтобы проверить инфракрасное изображение), просим провести перед лицом рукой с растопыренными пальцами (чтобы проверить, как лицо выглядит через пальцы, включая изображение глубины).

Можно ещё требовать две веб-камеры на заданном расстоянии, и смотреть изображение в стерео-очках, чтобы лучше были видны попытки подтасовок.