Правило, согласно которому количество транзисторов, размещаемых на кристалле интегральной схемы, удваивается каждые 18 месяцев, больше неверно. Но действует новый закон, который назван в честь генерального директора Nvidia, компании, которая сейчас является самой передовой в ??области коммерческого ИИ.

Закон Хуанга — это наблюдение в области компьютерных наук и инженерии, согласно которому прогресс в области графических процессоров (GPU) растет гораздо быстрее, по сравнению с центральными процессорами (CPU). Это наблюдение противоречит закону Мура.

Это наблюдение было сделано Дженсеном Хуангом, главным исполнительным директором Nvidia, на конференции по технологиям графических процессоров (GTC) 2018 года, проходившей в Сан-Хосе, Калифорния. Он заметил, что графические процессоры Nvidia были «в 25 раз быстрее, чем пять лет назад», тогда как закон Мура ожидал только десятикратного увеличения.

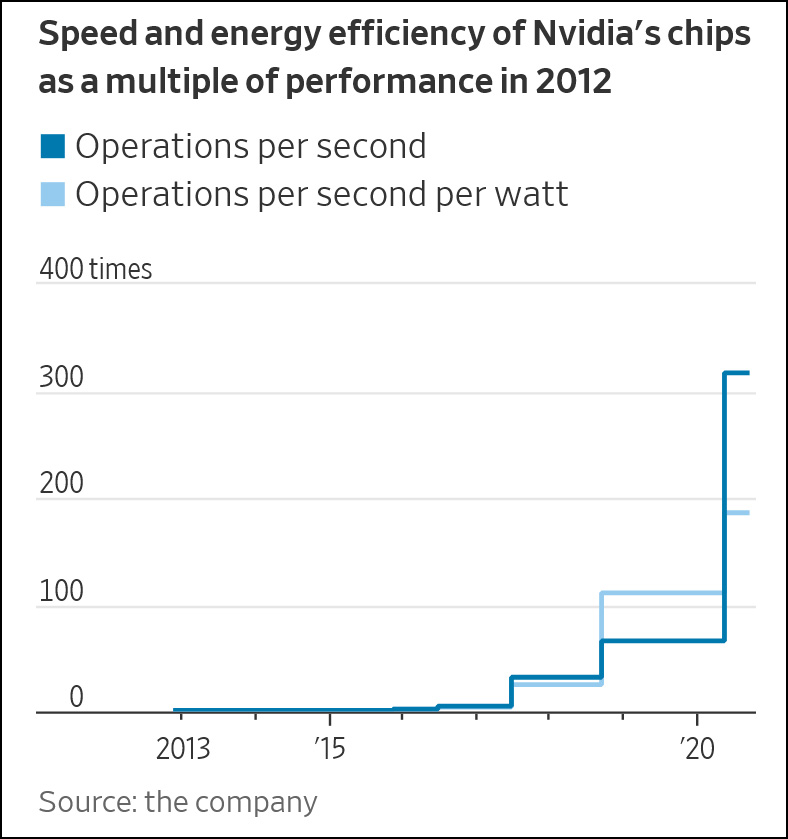

По словам Хуанга, для задач искусственного интеллекта AlexNet потребовалось шесть дней на двух процессорах Nvidia GTX 580, чтобы завершить процесс обучения, но только 18 минут на современном сервере DGX-2 AI, что привело к ускорению в 500 раз. По сравнению с законом Мура, который фокусируется исключительно на транзисторах ЦП, Закон Хуанга охватывает сочетание достижений в архитектуре, межсоединениях, технологии памяти и алгоритмах.

В нем описывается, как производительность кремниевых чипов, обеспечивающих искусственный интеллект, более чем удваивается каждые два года. Хотя рост можно отнести как к аппаратному, так и к программному обеспечению, его устойчивый прогресс делает его уникальным инструментом для всего, от автономных автомобилей, грузовиков и кораблей до распознавания лиц, голоса и объектов в наших личных гаджетах. С ноября 2012 года по май 2020 года производительность чипов Nvidia увеличилась в 317 раз для важного класса вычислений AI, говорит Билл Далли, главный научный сотрудник и старший вице-президент по исследованиям в Nvidia. Другими словами, в среднем производительность этих чипов ежегодно увеличивается более чем вдвое, и по сравнению с этим закон Мура бледнеет.

Специализацией Nvidia уже давно являются графические процессоры, которые эффективно справляются со множеством независимых задач одновременно. С другой стороны, центральные процессоры, подобные тем, на которых специализируется Intel, гораздо менее эффективны, но лучше справляются с быстрым выполнением одной задачи. Intel была основной движущей силой закона Мура, но далеко не единственной. Для его сохранения потребовались десятки тысяч инженеров и миллиарды долларов инвестиций в сотни компаний по всему миру. Точно так же Nvidia не единственная, кто руководствуется законом Хуанга.

Традиционный ЦП сам по себе обычно неэффективен для обработки всех задач, встречающихся при работе ИИ. И графические процессоры лучше подходят для таких ИИ-емких задач. Это достигается благодаря наличию значительно большего количества ядер и способности обрабатывать небольшие пакеты заданий параллельно. Однако даже у графических процессоров есть свои ограничения, особенно в отношении энергопотребления.

По словам участников рынка, покупка Arm позволит NVIDIA ускорить развитие искусственного интеллекта за счет периферийных вычислений: некоторые операции, критичные для производительности системы, будут выполняться непосредственно терминалом, а не передаваться на сервер. В тандеме с развитой серверной экосистемой это позволит NVIDIA добиться значительного прогресса в создании новых областей искусственного интеллекта.

Балансировка вычислительных ресурсов также важна для NVIDIA, потому что если графические процессоры значительно превосходят процессоры мэйнфреймов по скорости, то «слабое звено» задержит разработку всей системы. Покупка Arm позволит ей приобрести ценный актив в разработке центральных процессоров. Вице-президент по маркетингу Стив Родди ожидает, что так называемый «закон Хуанга» будет исчерпан через десять лет, но за это время отрасль добьется значительных успехов в разработке искусственного интеллекта.

Источник: The WSJ

beduin01

Я еще лет 10 назад слышал прогноз сильного ИИ к 2025 году. Такими темпами может что-то и получится

armodim

некоторые ученые полагают, что сильный ИИ (с сознанием) невозможен в принципе.

ne_kotin

другие некоторые ученые полагают, что для ИИ с сознанием нужна сложность, аналогичная сложности головного мозга человека, т.е. порядка 1012 нейронов с количеством связей порядка 1015 — типа, при таком объеме возникновение сознания как качественного эффекта от сложности системы неизбежно.

Только вот на существующей кремниевой элементной базе — да, невозможно.

Mad__Max

Чем элементная база не угодила?

Чисто количественно она нужные параметры со временем сможет обеспечить. Знать бы только какие конкретные архитектуры нужны и какими данными их «наполнять».

P.S.

По 1 порядку в параметрах мозга человека лишние.

ne_kotin

Не-а. Мы уже уперлись в технологический предел. И при этом весьма примитивные нейросети требуют специализированных ускорителей, и жрут сотни ватт энергии. А надо еще 6+ порядков.

Так что нужен альтернативный подход — чтобы и плотность повысить, и энергопотребление снизить.

Mad__Max

Я про «уперлись» и «кремний уже умер» слышу уже лет 10 как каждый год, а количество транзисторов в кремниевых чипах и их производительность в задачах которые хорошо распараллеливаются при обработке (нейросети в их числе), что позволяют все эти транзисторы пустить в полезную работу все это время росли прежними темпами пока «кремний умирал». О чем собственно эта статья про «закон Хуанга» (переименнованный маркетолагами старый добрый закон Мура). В традиционных CPU был застой, а в GPU и нейрочипах прогресс шел прежними темпами с использованием того же самого кремния.

И еще как минимум лет на 10 вперед у компаний занимающихся производством чипов планы УЖЕ расписаны — фундаментально уже ясно как и куда двигаться дальше в кремниевых полупроводниках.

Откуда опять же 6 порядков?

Действительно специализированные (нейроморфные) чипы еще лет 5 назад уже могли в реальном времени эмулировать работу нейросетей с порядка миллиона нейронов и сотнями миллионов синапсов, укладываясь при этом потреблением в единицы Вт или даже меньше 1 Вт на чип.

Современный уровень, уже где-то на 1 порядок выше — 1 нейроморфный чип при условии использовании передового из уже освоенных для серийного производства кремниевых технологий (7-8 нм) можно сделать под эмуляцию в реальном времени на ~10 млн нейронов с миллиардами синапсов на одном чипе.

Таких пока правда на практике еще никто не делал, т.к. в отличии от универсальных CPU и GPU такие чипы годятся только для одной единственной задачи (эмуляции нейросетей одной определенной архитектуры) и не ясны коммерческие перспективы которые могли бы оправдать необходимые вложения в проектирование и запуск производства подобного чипа — для современных сложных чипов это уже минимум десятки миллионов долларов еще до выхода первых годных к использованию чипов с конвейера. Но технологии уже такое позволяют.

Мозг человека полностью это порядка 100 млрд. (на ~4 порядка осталось), неокортекс отвечающий за все все высшие нервные функции, почти в 10 раз меньше, где-то 10-15 млрд. (~3 порядка осталось).

Kopilov

Была бы дешёвая альтернатива кремнию — умер бы по-настоящему

devlind

Вы что, издеваетесь? Куда уже дешевле кремния? Он же по сути под ногами лежит.

Kopilov

Вот поэтому и не умер)

Т. е. кремний, который «лет 10 как каждый год» «умирал», продолжает лежать под ногами, а дешёвых альтернатив не нашли

devlind

Штука в том что мы практически упёрлись уже в физические ограничения кремния. Если делать затвор тоньше — электроны будут просто туннелировать через него и транзистор больше не будет транзистором. Там конечно ещё лет 10 можно будет поиграться с разными архитектурами кремниевых транзисторов но уже сейчас видно что прогресс начинает двигаться в сторону колличественного нежели качественного. Т.е. чипы становятся больше, тепловыделение тоже — 3090, например, выделяет до ~360Вт тепла на пике. Кремнию осталось реально недолго.

nikolayv81

Не только кремния, у нас есть ещё фундаментальная проблема со скоростью распространения эм волн, она уже влияет на время доступа к памяти находящейся за пределами чипа...

dragonnur

Будет больше многоуровневых кэшей и, скорей всего, «внос» памяти в чиплеты. Ваш К.О.

nikolayv81

Про много уровней кэша и его размеры, вроде как проблема в том что для большинства текущих задач быстродействие заметно не повысится, а с hbm появляется проблема отвода энергии...

arheops

Ну отвод энергии тоже еще не на пределе, просто он не выгоден.

Задумкам по водяному охлаждению ВНУТРИ чипа уже лет 10, если не больше.

Многослойные бутерброды с трубками в средине тоже уже были.

cepera_ang

И наоборот — отказ от кешей для задач, где мы знаем паттерн доступа к памяти и/или он слишком случайный (читай нейронки и графы). В такой ситуации кеш зря греет воздух, всё равно упираемся в пропускную способность памяти.

Но выходы тоже есть — параллелить шины к памяти, приносить память прям к ядру и т.д.

cepera_ang

Почти упёрлись, да не совсем ещё упёрлись. Ещё раза в два по всем осям планируется уменьшение, а потом все эти gate-all-around, 3d и прочие приключения. Ещё раз в сто обещают плотность нарастить.

nikolayv81 тут тоже много ещё чего можно сделать — кто сказал, что память обязательно должна быть так далеко от чипа? Можно и рядом (весь этот HBM), можно стопкой наращивать. Есть и третий вариант — делать память умнее, добавлять к ней способностей к вычислениям на месте (in-memory computing), начиная от битовых операций над отдельными строками, продолжая локальными вычислительными ядрами, которые прямо в чипе памяти будут делать несложные вычисления. В зависимости от того, насколько сильно привычную модель (отдельно процессор, отдельно память) перерабатывать, от 2х до двух порядков ускорение возможно.

nikolayv81

Проблема распределённых вычислений она не столько в сложности компонентов сколько в отсутствии алгоритмов, ведь тот же мозг работает за счёт изменчивости связей в т.ч. на кремниевой основе этого добиться очень сложно (коммуникационные ключи не могут переплывать между чипами :)), про hbm тут напрямую стоит вопрос теплоотвода, и он, вроде, так просто, пока не решается, таже проблема возникает при уплотнении элементов, про раза 2 в каждом измерении это очень оптимистично на мой взгляд, хотелось бы чтобы было так...

arheops

Блоки программного кода то УЖЕ переплывают.

Алгоритмы тоже вроде никуда еще не уткнулися.

nikolayv81

Я так понимаю что помимо кода должны ещё и данные "приехать" на один узел

arheops

Ну NUMA вроде есть же, не?

cepera_ang

Всё решается, основная проблема — до недавнего времени (что такое 10 лет в масштабе истории?) было выгоднее и реалистично повышать производительность generic вычислений, однопотока произвольного содержания.

И было проще подождать пару лет, чем городить специализированный ускоритель (кроме графики разве что). Сейчас же однопоток (даже мало-паралелльный однопоток) упёрся (растёт, но очень медленно), а в специализированных ускорителях для отдельных задач — конь не валялся, возможны ускорения в сотни раз.

Kopilov

Это будет переход от «монолита» к «микроядрам/микросервисам» на аппаратном уровне, как бы? Свой PU (уже не C) на каждый кодек/шифратор/ect?

cepera_ang

Да этот процесс уже полным ходом идёт — взгляните на современный телефон, там кроме процессора (несколько видов ядер, для скорости/экономии энергии) есть ещё GPU для графики/3д, DSP для обработки картинок/видео с камеры, аппаратный видео кодек/декодер, secure анклавы, ускорение нейросеток в NPU, отдельный чип для обработки движения/гироскопа, распознавание голосовых команда на отдельной железке.

Поэтому да, скорее всего специализация будет расти, постепенно отдельные задачи будут из процессора выноситься. Но при этом вероятно продолжат консолидироваться на одном физическом чипе, потому что выносить сигнал за пределы кремния — часто дороже в плане энергии и времени, чем тысячу раз пересчитать локально.

ne_kotin

Оттуда. Что современное оборудование способно поддерживать порядка миллионов эквивалентных нейронов. А надо триллионы.

Если вы про TrueNorth — да, но. Там развесовка шла однобитная, spiking neurons. Маловато будет, не для всех задач подойдет. Даже при потреблении 0.1 Вт на чип таких чипов потребуется миллион, и потребление составит соответственно сотни киловатт. Ок, это был 28 нм процесс, сейчас 5 нм, предположим потребление упадет раз в 5 — ок, десятки. Все равно много, и все равно существенный объем.

Cerebras WSE сам по себе жрет 20 кВт, сколько там эквивалентных нейронов — наверное сотни тысяч.

Говорю же — на кремниевой элементной базе такие вещи невозможны.

Закапывайте.

cepera_ang

А можно мы ещё потрепыхаемся? Это хорошо конечно строить экстраполяции в неизвестное будущее, видеть, что они не приводят к каким-то вашим наперёд заданным «идеалам» и призывать закопать работающее и перестать в него вкладываться. Чтобы что? Чтобы вытащить из воздуха работающее решение на порядки лучше? Так это только в мечтах такое случается, во всех остальных случая прогресс инкрементальный, сложный и медленный, но идёт и идёт и за десятилетия накапливается невероятный результат.

Поэтому прошу, пусть с нами пока (лет 10-15) останется «бесперспективный» кремний. Даже если бы нам чудом явилась инопланетная технология с компьютерами мощностью как мозг, мы всё равно пока не знаем как её задействовать толком, а так, будет развиваться постепенно и железо и софт и наше понимание того, что мы делаем. Куда особо торопиться-то? Потенциал даже существующих решений ещё по сути не начал распространяться по реальному миру.

ne_kotin

Чтобы исследовать более подходящие для задач сильного ИИ технологии и элементную базу, и не тратить ресурсы, пытаясь прыгнуть выше головы.

А зачем тогда вообще над ней работать? Разработка технологии подразумевает закрытие определенных потребностей.

Ага, при том, что в каждом пятом проекте ИИ на ИИ и ИИ погоняет. Приходит зокащег с выпученными глазами — МНЕ НАДО ML СРОЧНО И ЧТОБЫ ОН САМ ДЕНЬГИ ДЕЛАЛ.

Ну, и делаем. Не то, чтобы сам деньги делает, но прикладные задачи решает, да.

adictive_max

ne_kotin

у нас уже есть работающий референс на мясной основе. почему внезапно то? давайте смотреть в сторону биологических и молекулярных механизмов.

nikolayv81

С ними проблема с предсказуемостью… Работать может (история говорит что даже в космос может летать) но вот работать как сказали не всегда (то деталь к верху ногами в разъём забъёт то ещё что-то)

cepera_ang

> Чтобы исследовать более подходящие для задач сильного ИИ технологии и элементную базу, и не тратить ресурсы, пытаясь прыгнуть выше головы.

Прыгнуть выше головы — это сказать «вот мясной референс, давайте сделаем такой же», а потом на вопрос «как именно?» ответить — «моё дело стратегия».

Рынок полупроводников просто гигантский и направлений работы в нём — невероятное количество, на всех уровнях стека, начиная от прикладных задач в которых идёт экспоненциальный прогресс алгоритмов (те же самые нейросети Хуанга не зря в 500 раз быстрее для тех же задач стали тренироваться и работать), продолжая фреймворками, оптимизаторами, компиляторами всего этого добра, через системную архитектуру (отходить от привычного «это компьютер, в нём есть цпу, память, постоянное хранилище и ввод-вывод» — очень тяжело и медленно, даже в мелочах, потому что нужно в процессе сохранить то, что уже работает), к железу — у нас сейчас есть относительно быстрые процессоры, которые застопорились, растущие ГПУ, разные видеоускорители, на пороге целый зоопарк железа для МЛ, геномики и графовых вычислений, там ещё лет на 10-20 работы и выжать только на специализации под задачи можно два-три порядка ускорения; и ниже по стеку — прогресс в чипах, упаковке в одно целое, интерконнектах, многослойнойности и т.д. и ещё ниже — все эти новые рентгеновские лазеры, фоторезисты и способы обработки.

Во всех этих областях есть куча задач на разных стадиях близости к массовому потребителю:

И вы предлагаете что? Пусть все эти специалисты остановятся, бросят свои дела, в которых они понимают и знают как принести улучшения, пойдут все, переучатся на несуществующие специальности «разработчиков биомозгов» на несуществующих курсах несуществующих университетов. Потом несуществующая индустрия «биокомпьютинга» построит им биолаборатории, подождёт неизвестное количество лет, получит неизвестные продукты в качестве результата и выпустит на рынок, в котором потребители сидят и жаждут купить непонятные им «биопродукты» с сильным ИИ в комплекте, а в промежутке пересидят на своих железках 2020 года выпуска (кому повезло уже купить такие, у подавляющего большинства более старое железо, а все заводы-то мы остановили, ведь кремний безперспективный).

Вопрос «давайте смотреть» не стоит — люди смотрят, просто вы об этом ничего не знаете, потому что выбрали тусоваться в области «бесперспективного» кремния и завязанного на него айти, а не идти поднимать биологический эквивалент с его текущего (никакого) состояния.

ne_kotin

А чего б нет? Который раз повторяю — мы уже упираемся в ограничения, накладываемые физическими законами. Сделать чипы (неважно какой архитектуры) компактнее и экономичнее на несколько порядков — уже невозможно. До коллапса — лет 5. И даже рентгеновские лазеры рояль не сыграют — потому что размеры кристаллической решетки, туннелирование, и т.п. То есть неизбежно менять материал, неизбежно менять подход.

Так почему не сейчас?

Да почему. Пусть занимаются. Только не надо шапкозакидательства, надо понимать, что все это ограничится киберолигофренией уровня на порядок-два ниже человеческого мозга и с запредельным энергопотреблением. Про киберсознание в таких условиях говорить не приходится.

Вы не знаете, что я знаю, чего не знаю, каковы мои источники, и т.п. Так что говорите, пожалуйста, за себя.

А что ты сделал в свои годы

для хип-хопа? Вы как-то скатились в ad hominem, дорогой оппонент.Там пока нечего поднимать, там такая terra incognita, что обходятся небольшим количеством высоколобых визионеров, осторожно тропящих тропки по очень тонкому в современных политических и экономических условиях льду.

cepera_ang

Поставлю напоминалку на 10 лет. Вот мой контр-прогноз: кремний ближайшие 10-15 лет будет продолжать быть топовым, а то и единственным материалом. Покажет прогресс 10х в плотности, 100х-1000х производительности в отдельных задачах. Да и чем плохо экстенсивное развитие? В энергии тоже продолжим шагать — домашний компьютер на пару киловатт? Возможен, автомобили на полмегаватта же есть. Надеюсь увидеть датацентр на гигаватт, вместо текущих десятков мегаватт.

Альтернативный же подход — хм, надеюсь в лучшем случае у нас будут хотя бы какие-то прототипы био/днк/whatever компьютеров хотя бы лабах. Если будет коммерческий образец пусть даже самый тормозной, но доступный просто пойти купить в магазине — снимаю шляпу прозорливости.

Короче, ставлю на реальный прогресс против фантазий о киберсознании.

PS Впрочем посмотрел начало треда, а он и начался с фантазий о киберсознании. Ну что ж, может и не достигнем непонятных «сознаний» в машине, но «тупого», бессознательного узкоспециализированного интеллекта на кремнии будет хоть отбавляй.

ne_kotin

да ничем не плохо, кроме физических ограничений )

тактовая частота уже лет 10 как не поднимается.

техпроцесс почти выбран.

надо бы новый материал, с большей подвижностью электронов, с меньшим периодом решетки, желательно такой же распространенный (нет, кремний — самый распространенный) и дешевый.

дык, все эти нейроморфные технологии — они зачем? ) они же в первую очередь сделать компьютер сознательным и осознанным. человекоподобным, но более совершенным. и бесправным.

а примитивные перцептрончики, если не путаю, еще в 1960-х были на почтах.

а бессознательного «интеллекта» и так сейчас хоть отбавляй, но толку? YOLOv3 поверх TF на RTX2080 Ti протаскивает максимум 10 FHD кадров в параллель, если мы говорим о времени отклика не более 300 мс. и как уже говорилось выше — мы все равно упираемся в фундаментальные ограничения материала. из которого вытекают и ограничения на производительность.

cepera_ang

Это полгода назад: Perceive Ergo — The chip can run the equivalent of 4 TOPS, with impressive power consumption of 55 TOPS/W, and according to the company, achieves data-center class inference in under 20mW (YOLOv3 at 30fps).

Это сегодня: Achieving record-high energy efficiency up to 2,900 TOPS/W, the accelerator is a key enabler for inference-on-the-edge for low-power devices. … These promising results encourage us to further develop this technology, with the ambition to evolve towards 10,000 TOPS/W

Всё ещё кремний, да ещё и аж 22нм, далеко не SoTA.

Через 10 лет? Распознаём всё (условный GrokNet), локально, в реальном времени и с расходом энергии на уровне ~ приходящей в камеру с фотонами :) А потом GPT-x даёт советы и озвучивает локальным же TTS.

ne_kotin

У вас там по ссылочкам маркетинговый буллшит без подробностей. На это я имею сказать, что Transmeta тоже была многообещающим стартапом в свое время, и даже продавалась. Но быстро сколлапсировала.

Так что единичные опытные образцы — не аргумент. Датасатанисты пока вынуждены покупать и использовать те самые RTX.

Я это лет 50 уже слышу. Примерно как про термояд. А воз и ныне там.

cepera_ang

Не знаю, что там 50 лет назад обещали, но лично я вижу какой прогресс произошёл всего за 5 лет в этой области — от диковинки, работающей на 300ваттной карте 0.1фпс до реалтайма на пятиваттных чипах в моём телефоне (включая как минимум зрение, распознавание речи и генерацию речи).

И это при том, что никаких массовых инвестиций в железо не было до тех пор, пока гугл невзначай не рассказал про свой TPU в 2016. А железо делать долго, дорого и сложно, поэтому вполне ожидаемо, что 4 года спустя мы видим продукты в основном в пресс-релизах. Это не потому, что их нет, а потому что они узкоспециализированные и могут быть очень успешными на узком рынке, никак не пересекающемся с «мамкиными» датасайнтистами. Чтобы такой девайс попал в руки среднему ресерчеру наравне с джифорсами — нужны многомиллиардные продажи, а что если они «всего лишь» многомиллионные? :) Даже АМД, имея и железо и какой-никакой софтварный стек, всё равно практически не участвует в обсуждениях и никто их не покупает, потому что не хочет возиться с потенциальными проблемами.

Что уж говорить про менее известные продукты? Такой чип от imec будет стоять в вашем телефоне, а вы даже не будете знать — никто же не пишет полный BOM со всеми чипами, а люди и не интересуются.

Или будет успешно продаваться на рынке, с которым вы не пересекаетесь (как какой-нибудь Cerebras или Groq) или просто будет чуть дороже, чем массовые решения и всё, можно смело говорить «бу, прогресса нет, всё так и сидим на RTX 3080»

ne_kotin

А где там реалтайм? Mi 9 SE, 712-й снап, PoseNet поверх TFLite дает слайдшоу. Нейробьютифаеры в тех же сяомитских камерах тоже работают оффлайн.

Из реалтайма разве что наложение масочек в настограме, и то, при неудачном повороте головы может съехать.

Распознавание речи (Алиса, Гуглоассистент) афаик на стороне сервера делается. А генерации уже лет 20 (привет Microsoft Agent и MSTTS), но она все так же убога и режет слух.

Дык, кто бы поставлял? Так то за сопоставимую цену народ бы покупал.

Маловероятно. Основа — всегда единичный SoC, указанный в ТТХ. Какое-нибудь маркетинговое преимущество типа выделенного ЦАПа — указано отдельно. Вон, у меня был Lenovo Phab 2 Pro с аппаратной поддержкой AR в виде Project Tango — так у него на спинке лого этого самого Tango было написано.

Cerebras как раз в том рынке, с которым я пересекаюсь. От того и говорю, что прогресс в нейроморфических технологиях если не застопорился, то явно вышел на плато.

cepera_ang

Далеко не самый мощный девайс чтобы показать как всё плохо :) На топовых девайсах даже Deeplabv3+ работает 15мс (66фпс, при разрешении 512*512, сеточка далеко не оптимизированная под мобилки).

Распознавание речи гугл точно делает на телефоне (но не на всех), и разница заметная и кардинальная. А, ещё и произвольные видео субтитрами в реалтайме снабжают.

Не знаю, чего там режет слух, но качество современных генераторов речи несравнимо выше, чем 20 лет назад. Блин, да иногда реальные голоса на видео кажутся более механическими, чем ассистент в телефоне.

ne_kotin

Во-первых, семисотая серия — далеко не самая дохлая.

Во-вторых — Если продукт приемлемо работает только на топовом железе — значит всё действительно плохо.

На рынке достаточно обширный спектр устройств, и если мы хотим, чтобы продуктом пользовались — мы должны ориентироваться на бюджетный сегмент.

Да прям. Что MS TTS, что гуглоассистент, что Алиса — одинаково косячный и неестественный прононс.

cepera_ang

Какой продукт? Мы о прогрессе в железе говорим. У вас то кремний на помойку, то «раз нет в бюджетном телефоне того же, что пару лет назад только на 300ваттном десктопе работало — то всё плохо».

Зато биокибермозги когда появятся — сразу будут стоить 3 цента за пучок.

ne_kotin

Ну, вы же апеллируете к «реалтайму на пятиваттных дровах» — я вам говорю, что реалтайм там настолько не везде, что про него в целом говорить не приходится. То, что работает на 300-ваттном ускорителе — так только на нем и работает. И к слову об ускорителях.

2014-й. GTX980, 165 Вт, 4.981 TFlops FP32

2018-й. RTX2080Ti, 250 Вт, 13.45 TFlops FP32

Это — прогресс? За 6 лет в 3 раза, а если на ватт — и того меньше.

По-моему замечательная демонстрация плато и предстоящей стагнации.

Ну, не прям сразу — но очень быстро, как оно произошло с появлением ПК и потом — смартфонов, как бытовых устройств, кардинально изменивших стиль жизнь человека.

А то, что за 15 лет смартфоны стали на порядки мощнее — принципиально ничего не изменило.

cepera_ang

Классно, что вы приводите в пример почти такие же цифры, как я в соседнем комментарии =)

Поздравляю, вы победили, прогресс действительно остановился, всего в разы за несколько лет, разве это прогресс? И порядки за 15 лет в другом случае — полная фигня, ничего такого, что не могла бы сделать нокия 5500.

Я поставлю напоминалку на 15 лет, про этот разговор и надеюсь, что у _биомозга_, который будет вашим ассистентом тогда, найдутся посерьёзнее аргументы =)

ne_kotin

Вы удивитесь — но да. Что 15 лет назад, что сейчас — разницы (и прогресса) нет. Потому что собственно юзерам не нужно от смартфонов что-то принципиально иное.

Вот их появление, как класса носимой техники — поменяло многое, включая образ жизни. Это был прогресс.

А я разве постулировал, что через 15 лет появятся какие-то «биомозги»? Ну разве что в виде студентов.

Я постулировал, что текущая технология скоро упрется в физические ограничения, которые не позволят ей выйти на уровень производительности человеческого мозга и на уровень энергопотребления, приемлемый для бытового и повседневного использования.

И что альтернативные подходы либо медленно развиваются, либо вообще заброшены.

Поэтому ничего полезного кроме очередных масочек и AR-поигрушек нам не грозит.

cepera_ang

Я вижу где у нас с вами ключевое разногласие: для вас прогресс — это когда «производительность человеческого мозга для бытового применения» вот прямо в руках (и бюджетно), без лишних вопросов, зачем именно такая производительность нужна. А всё остальное — игрушки, масочки, ерунда какая-то.

А для меня прогресс — это прогресс. Улучшается характеристика в десять раз — значит прогресс был, это улучшение принесло нам масочки — что ж, так тому и быть, может быть улучшение ещё в сто раз принесёт что-то полезное. Хотя на самом деле и сейчас есть бесконечное множество применений, которые просто лично вам не нужны, а куче людей приносят пользу. А зачем мне для повседневного использования сама по себе производительность человеческого мозга — хз, с другой стороны, у меня и сейчас есть доступ к каким-то диким мощностям — любой запрос в гугл на долю секунды задействует десятки, сотни тысяч серверов (а ещё миллионы в фоне круглосуточно готовят данные для этих тысяч) — никакой локальный «аналог мозга» с этим не сравнится в ближайшие десятилетия.

cepera_ang

А это забавно конечно, 15 лет назад был 2005 год, я как раз школу закончил и «топовый смартфон» того времени мог… ну мог делать фоточки 0.25мпикс (до сих пор зачем-то храню, дороги как память), эм, слушать десять mp3 песенок и даже имел локальную записную книжку, не в памяти симки. Перечислять всё, что может делать мой текущий смартфон думаю не имеет смысла, не говоря уже о том, что он потенциально может делать (т.е. делает для тех, у кого есть другие потребности, чем у меня)

ne_kotin

А я ее закончил сильно пораньше, и поэтому прекрасно помню, что тогда, что сейчас было и есть по сути одно и то же:

— фоточки

— музыка (на 128 Мб miniSD влезал приличный такой альбом)

— мессенджер (jimm или нативная ICQ в случае WM/Symbian)

— браузер и мобильные веб-сайты

— почта/адреска/календарь/органайзер (опять же Outlook в случае WM).

— игрушечки.

сильно это отличается от того, чем вы пользуетесь сегодня? думаю, вряд ли.

так и где тут прогресс? кроме того, что экраны выросли и стилус необязателен.

cepera_ang

Вы случаем не продажник? Номинально всё тоже самое, да, если пройтись по галочкам «функций» и никогда в жизни не видеть их в реальной жизни.

«музыка есть? Есть, целый альбом влазит» vs «любая музыка в мире, прямо сейчас»

«фоточки есть? Есть, мутное зернистое месиво пикселей без автофокуса под ярким солнцем» vs «фотки класса ‘выкинь зеркалку’»

«видео есть? Есть, шикарные 176*144 30 секунд» vs «что такое видеокамера, у меня телефон есть»

браузер — вообще смешно, конечно в случае крайней необходимости узнать что-то он спасал, но с учётом размера экрана и скорости интернета (wap’a) было проще дождаться возвращения к большому брату и оттуда загуглить(помните, да? Тогда смартфону нужен был большой брат, а сейчас?). Сейчас же я не раздумывая просто голосом спрашиваю миллион вещей в день у своего телефона.

И т.д. В общем это такое сравнение, как если карету с деревянными колесами сравнивать с современным авто — «колёса есть? Есть. Источник тяги есть? Есть. Сиденье есть? Есть.». Или наскальную живопись с фотографией — вот, тоже самое, тут изображение, там изображение.

ne_kotin

Случаем нет.

«Любая музыка в мире прямо сейчас» — это конечно звучит соблазнительно, но слушать все равно нечего ) а только на выбор уйдут годы жизни. Поэтому в принципиальном плане — есть оно, или нет не сильно играет рояль — потребитель будет слушать то, что ему известно и нравится.

Нет, я знаю людей, у которых в плейлисте винампа были тысячи треков — они их так никогда все не выслушали. А на повседневочку вот этой самой сотни мегабайт по уши хватало. И хватает. У меня лично в ЯМузыке — два десятка треков в трех плейлистах, и в тележном VKMBot — десяток.

Сценарии же использования как были 15 лет назад, так и остались — эрго, прогресс в мобильной технике отсутствует.

Только для бэкапов/синхро. Он и сейчас нужен, просто раньше это был ваш большой брат, а теперь — от Гугла или Эппла.

cepera_ang

Всё понятно. «Я не пользуюсь, значит прогресса нет». Мнение имеет право на существование.

ne_kotin

Я бы с интересом послушал про что-то выходящее за перечисленные сценарии. Только не «один раз попробовал, прикольно» а «пользуюсь каждый день для того-то и того-то».

Но обычно на этом оппоненты и сливаются.

cepera_ang

Все вышеперечисленные сценарии и использую: бесконечная разнообразная музыка в отличие от одного альбома на телефоне 2005 года (тогда носил с собой отдельно плеер), ладно музыка, аудиокниги/подкасты — возможность налету выбрать и начать слушать что-то из бесконечной базы информации это качественное изменение по сравнению с заливанием трёх песен на флешку раз в месяц; качественные фотки в отличие тех времён (в тот переходный период между плёнкой и нормальной цифрой осталось меньше всего фоток), про видео вообще молчу (сейчас люди натурально фильмы на айфон снимают, я бы тоже снимал, если бы был фильммейкером, а так только для памяти), просмотр видео — тогда можно было закачать парочку 3гп роликов, сейчас — без ютуба не представляю жизнь, опять же скайп/фейстайм — не помню такого в 2005, может видеозвонки в теории и существовали, но в реальности нет, а сейчас каждый день звоню, браузер — постоянно (тогда никогда, разве что в каком-то крайнем случае, когда обязательно нужно прочитать то, что влазит в три строчки на экране), вот и сейчас вам отвечаю с телефона (благо есть свайп vs Т9), карты — каждый день в миллионе разных юзкейсов, от заказа такси, прогулок по городу, до трекинга пробежек и подобного (включая например поиск максимально тёмных мест для астрофото — мог кто-то себе представить такое использование телефона в 2005 году?) или общественный транспорт, который едет у меня на экране в реальном времени — такое было возможно в 2005?; всякие мелочи типа разговора с телефоном «включи свет дома, поставь таймер» и прочее — даже не стоит упоминать, это просто невозможные тогда, но такие незаметные сейчас вещи; банк-клиент (а последнее время и кошелёк целиком, не помню, чтобы я платил телефоном в 2005 году), переводчик (ладно просто переводчик, но с распознаванием чужого голоса и текста налету и перевод тут же на картинке? Магия, не иначе); вспомнился шагомер — банальная сейчас функция, но невозможная тогда, потому что не было ни сенсоров нужных в комплекте, ни доступной мощности, чтобы обрабатывать, ни алгоритмов, чтобы найти в шуме акселерометра шаги; учебный софт — анки, дуолингво, edx и подобное; про игрушки тоже смешно сравнивать условную змейку 2005 vs fortnite какой-нибудь, но лично я не играю, поэтому не буду тут приводить как пример.

Всякие служебные штуки, типа генератора токенов (раньше отдельный девайс), то, что телефон узнает меня в лицо, впн в домашнюю сеть, терминал до домашнего сервера, автоматический бэкап на небеса, сортировка фоток по тому что (кто) на них изображено и где снято.

В общем, если меня сейчас высадить в незнакомой стране со смартфоном, то я смогу делать 90% того, что в принципе делаю с компьютерами. Найду общий язык с аборигенами, транспорт, жильё, расплачусь в кафе, сниму и выложу видеоблог о стране и куплю билеты обратно домой и акции Нвидии заодно.

Со смартфоном 2005 года? Ха-ха, смогу послушать один альбом музыки и поиграть в змейку. Ну, ладно-ладно, в аську ещё зайду.

ne_kotin

Итак, суммируем разницу:

— видео

— видеозвонки

— перевод

— геопозиционирование/трекинг/педометрия

— бесконтактная оплата (да, это существенный прогресс, согласен)

— учебный софт

Я только еще раз уточню — это действительно повседневное использование? Если еще видеозвонки (ну, по работе, например), залипание в ютуб, и оплату гуглопеем можно понять, то наличие в повседневном списке геосервисов, переводчика и дуолинго у меня лично вызывает удивление — зачем оно взрослому человеку каждый день? Нене, эпизодически я этими вещами тоже пользуюсь. Кроме дуолинго. Ну не верю я в эффективность «учебного» софта кроме их способности приносить деньги владельцам.

Игры в 2005 не ограничивались змейкой, что интересно. Был даже AR. Вот сетевых не было, да.

Но по большому счету, что сейчас, что тогда — играть не во что было.

А SSH до домашнего сервера у меня был еще тогда, по GPRS.

Итого: это вот — прогресс? Действительно? За 15 лет — ну такое себе. По мелочи.

cepera_ang

Итого суммируем разницу как нам понравилось, преуменьшаем значение оставшегося до нуля и вуаля, прогресса как бы и не было.

Геосервисы каждый день — нужно ездить на работу, загород на выходных и т.д., да, думаю я каждый день открываю навигатор/пробки/я.транспорт/такси и т.д.

Кроме такого повседневного использования, от которого в принципе можно отказаться/заменить на что-то другое, ещё несколько раз (иногда и десятки раз в год) бывают путешествия, когда смартфон совершенно незаменим как источник карты/транспорта/перевода.

Дуолингво/анки/переводчик — некоторые люди учат язык(и) и я среди их числа, и это действительно ежедневный процесс для лучшего результата, не знаю что тут удивительного.

Можно пользоваться современным смартфоном как звонилкой и говорить, что ничего не поменялось со времён телеграфа, но это показывает лишь личные предпочтения/ограничения. Прогресс не только создаёт принципиально новые возможности, но и изменяет «стоимость» (временную, когнитивную и финансовую) использования этих и старых возможностей.

Это всё равно что сравнивать светодиодную лампочку и свечу — и то и другое принципиально даёт свет и можно смело говорить, что прогресса в области освещения не было за последние 150 лет. Да что уж там, сам экран смартфона по сути тоже самое, что костёр — светится разными цветами, мигает, ничего нового за 50 тысяч лет.

Такое отношение это или редукционизм, доходящий до потери связи с реальностью или просто нежелание признать очевидное по каким-то причинам (да хотя бы чтобы не признавать неправоту в онлайн споре).

ne_kotin

По памяти — не? На работу и за город по крайней мере.

Да. Но это опять же не повседневка, и к смартфонному прогрессу этот кейс отнести сложно. Тем более, что и 15 лет назад ровно так же можно было все нарыть через сеть по GPRS. Вот то, что соответствующих ресурсов в сети могло не быть — это да. Но это про другой прогресс.

Удивительно пользоваться безликой аппой и надеяться улучшить свои языковые навыки. Все же платные занятия с носителем языка дадут вам лучшие результаты. Ну, только если не «ландон из э кэпитал оф грейт бритн».

Еще раз: смартфон за 15 лет не дает принципиально новых возможностей. Соответственно о каком прогрессе говорим?

cepera_ang

Я думаю, что наш разговор зашёл в тупик, потому что вы читаете его со смартфона 2005 года выпуска, а у меня длинные сообщения получаются и поэтому много экранов пролистывать приходится, контекст успевает забыться, поэтому простительно.

beeruser

Подтасовочка :) Эти GPU имеют разный функционал.

К тому же между 2018 и 2014 разница 4 года.

2080ti могли бы 20TFlops сделать изи, только вот тогда бы не было RT/Тензорных ядер. Остальные GPU блоки чипа так же увеличились.

Почему вы не хотите сравнить их на ИИ задачах?

Давайте сравним топ Интел 2010г и 2020г:

Core i7-980X 6 ядер 3,33 ГГц

Core i9-10900К 10 ядер 5.3ГГц

Нет.

Не пойму что вас не устраивает.

Прогресс сейчас идёт бешеными темпами.

ne_kotin

Чего это вдруг? GPU он и в африке GPU — картиночки рендерить и числа дробить. Последнее, кстати, его опциональная возможность. Поэтому и давайте сравнивать по наименьшему общему, такссзть.

Нет, сравнивать мы будем с Core i7 10700KF, и по базовым частотам, потому что Max Turbo Frequency — это запас мощности, а не типичный режим работы. У него 8 ядер.

А базовая частота для 10700KF — 3.8 ГГц, тогда как для 980Х — 3.33 ГГц. Для 10900, кстати — 3.7.

Так себе разница за 10 лет. AMD, кстати, на этом временном отрезке получше смотрится.

Ну как нет. 5 нм норма, уже скоро в одиночные атомные слои упремся, и тут уже ойвсе.

И, собственно, по приведенным цифрам — это не прогресс, это вяленькое расширение уже давно освоенной технологии по нескольку процентов или десятков процентов каждый год. Плато.

А дальше — стенка. Фундаментальный барьер.

beeruser

Только вот современные игры умеют в рейтрейсинг (аппаратный) и используют DLSS.

На старых чипах этого функционала нет.

Так а почему на задачах ИИ вы не хотите сравнить?

К примеру Nvidia A100 именно для них и предназначен.

Ну начинается. 980X (Extreme Edition) это был самый топ 2010г.

С чего бы брать более бюджетное решение для сравнения? Так не пойдёт.

В однопотоке это типичный режим работы (и не только в однопотоке). До базовой десктопный процессор редко когда опускается.

Более того есть чипы с частотой 5GHz на все ядра.

Так что мимо опять.

В общем ясно, понятно. То процессор не «тот», а когда надо сравнить предел частоты, то сравниваем по нижней границе частотного диапазона :D

Вам самому не смешно?

— Ferrari против Porsсhe — кто быстрее?

— Ничья, т.к. в городе ограничение 60км/ч.

Ну как нет. 5 нм норма, уже скоро в одиночные атомные слои упремся, и тут уже ойвсе.

Когда скоро? 30 лет «уже скоро». В ближайшие 10 лет классический техпроцесс будет стабильно улучшаться. Также 3D интеграцию никто не отменял.

ne_kotin

Есть мнение, что кроме RTX-ремастеров от Nvidia, этот самый аппаратный рейтрейсинг никому больше не сдался. Как и DLSS, поэтому этим опять же можно пренебречь.

Не более бюджетное, а то же семейство. i7 сравниваем с i7, иначе это передергивание.

В каком однопотоке? Вы загрузили систему — у вас работают все ядра. И, нет, частота будет сильно плавать. На максимум она выйдет, если вы загрузили процессор длительной интенсивной нагрузкой, что происходит не всегда. Или у вас 24х7 монеро майнится?

Поэтому и сравниваем по нижней границе — где по дефолту частота процессора болтается.

Не 30 а 10.

Ага-ага, ASML свой EUV 20 лет пилила, а тут вдруг будет стабильно улучшаться? Да и куда, если материаловедческий предел на носу?

Её никто и не вводил, начнем с этого. Потому что это безумно увеличивает сложность и процент брака.

cepera_ang

20 лет пилила и запилила, теперь с этого места можно по-второму кругу применять все трюки, накопленные в обычной литографии за 20 лет (мультипатернинг и всё прочее).

Кроме того, High NA на носу от той же ASML, ещё один шажок.

То, что 3д никто не вводил — вовсе не значит, что не введут. Сложность, сложностью, но так и существующая технология 20 лет назад показалась бы космической, и ничего, пользуемся, хоть и сложность. В ближайшие годы отрасль до триллиона баксов вырастет, неужто не хватит мозгов и инвестиций на то, чтобы сложность побороть?

Ладно бы это были какие-то принципиальные сложности, немыслимый скачок через пропасть непонимания, которую непонятно как пересекать (как например с реальным мозгом — никто не знает как он работает и как его повторить даже примерно), а тут проблемы исключительно инженерно-экономические — и в лаборатории прототипы есть, и принципиально понятно как их делать, только пока нет смысла, потому что видно куда текущим способом расти в ближайшее время.

ne_kotin

Я с интересом ознакомлюсь с роадмапом как побеждать принципиальные физические ограничения — которые вот уже, рядышком: период кристаллической решетки, радиус атома, туннельный эффект (напрямую влияющий на утечки).

20 лет назад, кстати, было очевидно, что за эти 20 лет технология дойдет до этого самого технологического предела в единицы нанометров в экстенсивном порядке. И уже тогда стоял вопрос — а дальше то что?

За эти годы никто так ничего и не придумал, не анонсировал, не показал.

И что самое удивительное — пытаются воспроизвести. Причем технология соотносится с оригиналом примерно как каток времен Египта с современной Теслой.

А про мультипаттернинг можете забыть — двойной (как пишут в источниках) уже достаточно сложен и ведет к неоправданному росту цены, а тройной — нежизнеспособен. Так что — да, еще один шажок. А там — пропасть.

cepera_ang

Пока мы не конструируем произвольный 3д тетрис значительной толщины из любых атомов — значит предел ещё не достигнут. Если просто посветить рентгеном два-три раза кажется слишком сложной технологией, то что уж говорить о том, что мы достигли каких-то там принципиальных пределов? Вот тогда будут чипы в виде кубика собранного по отдельным атомам, вот тогда и поговорим о том, что дальше некуда расти (уменьшать техпроцесс)

ne_kotin

Не будут. Когда речь про отдельные атомные слои — элементы перестают работать. Начинается туннелирование, растут токи утечки, катастрофически вырастает процент брака. То есть жизнеспособная технология заканчивается задолго до.

Paskin

> YOLOv3 поверх TF на RTX2080 Ti

Вы пробовали TensorRT версию YOLO, а также batching и streaming? Иногда получается ускорить выполнение раз в 100 по сравнению с TF…

Еще — сильно зависит от того, откуда берутся кадры и что является результатом. К сожалению, производительность GPU в задачах AI часто лимитирована именно графической архитектурой — для действительного прорыва нужны новые решения с прямым доступом AI-процессора в память и к интерфейсам ввода-вывода (подозреваю, что покупка ARM имеет к этому непосредственное отношение)

ne_kotin

Нет, не успели. Батчинг и стриминг по условиям был невозможен — входное изображение приезжает из HTTP-запроса в единичном количестве. Результат — индекс категории.

В рамках единичного запроса бОльшая часть времени тратилась на поднятие CUDA-рантайма, пришлось его во время запуска сервиса поднимать предварительно.

Paskin

Надо было рантайм в отдельный сервис вынести — или просто использовать TRITON от самой Nvidia.

ne_kotin

А зачем? это в данном случае сильно усложнило бы решение, так мы обошлись flask + keras + tf-gpu внутри одного питоновского процесса. разве что что-то типа тритона нам не хватало чтобы меньше заморачиваться с инфраструктурной частью.

Paskin

Ну так Тритон это и есть Web-сервер и рантаймы для TF и других поддерживаемых фреймворков. Из-за того, что он вынесен в отдельный процесс — жизненный цикл модели не зависит от жизненного цикла клиентов и не приходится ее загружать в GPU по новой для каждого вызова.

vlad_egrv

а чем планируется заменяться образование новых нейронных связей, благодаря которым у нас происходит обучение?

Paskin

Возможный выход — в моделировании нейронов не математическими функциями, а непосредственно транзисторами. Аналоговый сумматор плюс ключ, коэффициенты передачи — резисторы и так далее. Я уверен, что при современном уровне полупроводниковой техники можно будет добиться стабильных характеристик и достаточного разрешения.

tnenergy

Нейросети плохо распараллеливаются в том смысле, что вычисления в одном узле сети зависимы от вычислений в других (в отличии от отдельных кадров в рендеренге, например, или хэшей в блокчейне).

Поэтому появляются вот такие монстры

Разумеется, поскольку развитие нейропроцессоров началось не так давно — будут еще и качественные и количественные скачки, но от самой большой НС на сегодня GPT-3 (которая обучалась несколько тысяч "V100-дней") до параметров мозга еще 3 порядка и есть сомнения, что они будут пройдены железом так же быстро, как предыдущие 3 порядка (~15 лет).

deseven

У вас инфа из 90-х кажется, почитайте про SpiNNaker, который часть HBP. Если мы говорим о сложности, сопоставимой с человеческим мозгом, то порядков осталось где-то три, в новой версии которую сейчас разрабатывают скорее всего останется два. Собственно, сейчас теория не поспевает за железом, а не наоборот.

ne_kotin

Нет, инфа актуальная.

Почитал. Зал со стоечками декларируется миллионом ARM968 ядер и 100 кВт энергопотребления. Ну, да, если каждое ядро держит до 100 эквивалентных нейронов — остается 3-4 порядка. И как минимум рост потребления на порядок.

Очень смелое утверждение, учитывая, что до сих пор связь нейрофизиологических процессов и сознания — terra incognita.

deseven

То вы говорите, что порядков надо 6+, то признаете, что осталось «3-4», но инфа у вас все равно актуальная? Честно, даже не знаю что на это сказать.

Под «теория не поспевает за железом» я имел в виду как раз то, что мы не знаем как именно создать это самое сознание, хотя по ресурсам мы уже подбираемся к емкости человеческого мозга и дойдем до нее в ближайшие годы.

И нет, следующая версия SpiNNaker не будет потреблять на порядок больше, они работают в рамках той же самой платформы с тем же энергопотреблением и форматом (10 стоек). Вы почему-то считаете, что прогресс полностью остановлен и за 10+ лет (первая версия построена на железе образца 2010 года) невозможно на порядок повысить производительность, оставив энергопотрбление таким же.

ne_kotin

Следить за контекстом, не? SpiNNaker-у (и возможно специализированным нейроморфам типа Cerebras) — да, осталось 3-4 порядка взять, массовым решениям — 6 и более.

Ну, значит, он не выйдет на масштаб производительности, сопоставимой с человеческим мозгом.

Опять же, зал стоек жрущий десятки киловатт — совершенно не то же самое, что костяная коробка с плотью, обходящаяся единицами или десятками ватт.

И в этом критерии кремний бесполезен. Он не позволит создать настолько плотный и экономичный аналог.

unclejocker

А зачем нам экономичный и плотный аналог естественного мозга? Понять как работает — можно и на модели, пусть она хоть дом занимает. Тиражировать? Так их и так 8 млрд. есть уже естественных, если вам нужен электронный раб с интеллектом среднего человека — проще и дешевле живого нанять.

Какой-нибудь супер интеллект для решения сложных задач? Тоже переносимый не нужен, достаточно удаленного доступа. Что бы что?

ne_kotin

А зачем вам мобильный смартфон? Звоните по домашнему.

Да, тиражировать. Ставить в каждую свистульку.

Ну, тут уже правовые и моральные аспекты. Живой имеет права. А железяка, созданная моими (вашими, нашими) руками — по определению бесправный раб, устройство, машина.

deseven

Какой контекст? Откуда он вдруг появился? Вы прямым текстом написали «мы уже уперлись в технологический предел».

Я бы мог привести в пример компьютеры 70-х, занимающие комнату, но, кажется, делать это абсолютно бессмысленно, с вашим радикальным убеждением будто бы прогресса в этой сфере больше не существует.

ne_kotin

Так мы в него и уперлись. Ну 5 нм, ну 3, ну 2. Сколько еще лет, прежде чем фабы скажут «сорян, ребят, кремний всё, мы не сможем больше выжать — туннелирование, квантовые эффекты, физика, бессердечная сука»?

Мое мнение — лет 5.

Графен до сих пор из лабораторий не вылез AIII-BV полупроводники (арсенид галлия, например) не готов к производству сложных микросхем.

Контекст был — массово доступное оборудование, позволяющее запускать нейронные сети. Это GPU. Исследовательское в лице помянутых TrueNorth и Cerebras — да, помощнее и попроизводительнее, но зайдя в любой компьютерный лабаз вы их не купите.

… но аналогия ложная. мы уже проговорили, что дальнейшая микроминиатюризация ограничена структурой материала и квантовыми эффектами.

Deerenaros

Всё таки не единицами, да и десятков много. Около 30 Вт, причём вилка довольно большая, плюс подсчёт вёлся довольно грубо, в основном — по тепловыделению. Я склоняюсь к пиковому энергопотреблению в сотню, а то и больше Вт, правда длительность таких периодов крайне не продложительна и характеризуется огромным стрессом.

tnenergy

Спиннакер и в принципе повторение спайковых нейронов упирается в то, что нужно иметь очень высокую пропускную способность, что бы передать из А в Б собственно спайки. Если вы посмотрите внимательно, сейчас Спиннакер реализован как 10% идеи (1 стойка) и это не случайно — для 10 стоечного варианта, который потянет 1 миллиард нейронов, если правильно помню нужна межстоечная магистраль в 10 терабит, что довольно нетривиально. А для 100 миллиардов эквивалента человеческого мозга для схемы трехмерного тора, которая там принята нужно будет аж 100 петабит, что далеко за техническими возможностями.

Можно упаковывать нейросети в более щадящие полосу топологии, но вроде как это нетривиальная задача уже со стороны нейронауки, хотя тут неуверен.

swelf

Если можно запрограммировать сильный ИИ с сознанием, означает ли что человеческое сознание детерменированно и судьба предопределена?

SadOcean

ИИ тут поможет разве что с демонстрацией (что его схема детерминирована)

В остальном — кажется, что независимо от того, можно ли создать сильный ИИ, человеческое сознание детерменировано. Другое дело, что у него высокая сложность и оно завязано на множество факторов окружающей среды, включая биохимию собственной тушки. Все эти штуки не получится воспроизвести идеально, чтобы проверить, действительно ли оно детерменировано.

Romanguro

Не количеством единым. Есть так же мнение, что сознание, дуальность сознания, абстрактное мышление, появились прежде всего, как несовершенство мозга. Мы не в состоянии осозновать бол. кол. информации одновременно, нам приходится интерпритировать и абстрагировать информацию. Вспоминая что-то, мы не можем достать инфу с нужного места, а по сути воссоздаем воспоминание заново на основе абстрактных ощущений из разных мест мозга.

Всех этих биологических недостатков ИИ лишен. Возможно, если там и будет что-то похожее на сознание, то нечто совсем нечеловеческое.

Конечно, тут для начала надо бы договорится, что такое сознание вообще.

ne_kotin

Конечно. И впереди масса этических и философских проблем после этого.

beeruser

А почему именно человека? Может хотя бы с мышей начать?

Zifix

А что это даст, в практическом плане? На звание ИИ мышь как-то не тянет.

beeruser

Сравнительно компактная модель мозга? Не?

Хотите сказать что у животных нет интеллекта?

www.youtube.com/watch?v=0eKyvC9pTwM

Разумеется, я неспроста упомянул мышей.

newatlas.com/spinnaker-neuromorphic-supercomputer-mouse-brain-simulation/57101

Xu4

Я начал писать ответ на ваш комментарий, немного увлёкся, и он получился даже объёмнее этой статьи. Я нечаянно даже чуть не оформил его в виде отдельной статьи — типа, может, люди захотят подискутировать на эту тему. В итоге я всё стёр и оставил только эту мысль:

У собак, кошек, мышей и так далее, намного меньше нейронов (в случае с мышами — в 1100 раз меньше), но они всё равно обладают сознанием. Дело, скорее всего, не в количестве, а в компоновке — в какой-то основе, которая позволяет существовать сознанию. Типа, углерод может принимать форму графита, а может быть и алмазом — в зависимости от «компоновки» (a.k.a. аллотропии). Просто в случае с нейронами тоже могут существовать, условно, «аллотропы», одним из признаков которых будет сознание, и, скорее всего, так много нейронов, как в мозге человека, для этого не требуется. Так что, с большой вероятностью, задачу создания ИИ можно решить с помощью комбинаторики.

Я вообще считаю, что ИИ до сих пор не создали только потому что, нет математически точного определения, что такое ИИ. Есть образы со стороны маркетологов, есть философские рассуждения, но нет чётких критериев оценки. Нельзя назвать вещь искусственным интеллектом, если ты сам до конца не понимаешь, что это такое.

dragonnur

В отличие от млеков, у некоторых врановых и, особенно, у крупных попугаев интеллект и уровень самосоосознания (а у последних ещё и речь) — на уровне трёх-пятилетнего человечьего детёныша, причём на во много раз более примитивном мозге. И норм.

nikolayv81

Про 3-5 лет ребёнка боюсь вы ошибаетесь, хотелось бы понять откуда берутся такие утверждения (часто их слышу про собак) на мой "вкус и цвет" до 3х летнего ребёнка ни один из представителей мира животных (кроме, возможно некоторых обезьян) не дотягивает...

dragonnur

Простейший набор примеров, в т.ч. с хабра же:

нумер 1-й;

нумер 2-й;

нумер 3-й

Примерно так. Оценка интеллекта обученных горилл и шимпов сильно превышает названные цифры, там, ЕМНИМС, эквивалентом развитие в районе 10-12 лет, но по другому организовывался процесс общения — через язык жестов, например (голосовые связки обезьян плохо приспособлены для чего-то похожего на отчётливую речь).

nikolayv81

В первой статье не нашёл ни слова о сравнении с детьми, во второй 1 тест и конкретно написано про "некоторые когнитивные способности" в третьей же "Ученые полагают, что эти попугаи могут достичь интеллекта 5ти-летнего ребенка"

Это не серьёзно, некоторые могут полагать да, некоторые и другие "странные мысли" высказывают, но 5 летний ребёнок это не 150 слов а сильно больше (в виде понимания) способность играть в шахматы вполне осознанно, как пример, весьма распространено (у меня ребёнок играл, и это без ежедневных дрессировок) а есть семьи в которых заморачиваться чтением и другими вещами. Мне кажется ваши ссылки как раз подтверждают что в некоторых "тестах" некоторые представители могут, но это далеко не оценка "интеллект на уровне" на мой взгляд :)

Rutel_Nsk

Для начала нужно понять как устроена вычислительная система функционирующая на нейронах. Если проводить параллели с кремниевой электроникой, то изобрели логический элемент (И-НЕ). И решили что если соединить миллиард таких элементов, то получится процессор. А вопросом как соединять, не озаботились.

Это я к тому что никто не озаботился пониманием того как должна работать вычислительная система базирующаяся на нейронах. Может после появления этого знания и интеллект не будет казаться фантастикой, станет просто высокоуровневой функцией обычной вычислительной системы.

adictive_max

Rutel_Nsk

И это тоже (про сложность), но работ по вычислительным системам на базе нейронных сетей практически нет, именно вычислений. Например самый примитивный текстовый редактор на базе нейронных сетей — в идеале обучающийся и постоянно подстраивающийся под конкретного пользователя. Если не согласны, то прошу ссылку на такую работу (другой вариант не принимается).

Абсолютное большинство это различные виды «обучения» нейронных сетей.

В настоящее время нейронная сеть это адаптивный фильтр и ничего более.

adictive_max

Ну да, «никто не решил бессмысленную задачу» == «темой никто не занимается».

Rutel_Nsk

Как пример — выполняется типовая работа по обработке текста. Два три раза сделана руками, на четвертый раз редактор говорит: Я понимаю как это сделать и делает на автомате. Далее задает вопрос: Создать инструмент для типовой обработки текста?

adictive_max

Нафиг-нафиг… Это НИКОГДА не будет работать нормально, потому что даже с «эталонными» мясными секретарями это никогда не работало на 100% правильно.

А для нормальной формализуемой обработки текста инструментов и так хватает.

beeruser

Нейроморфные вычисления

Rutel_Nsk

Не путайте вычислить выходное значение нейронной сети и исполнение сложного алгоритма на нейро-процессоре.

Думаю показателем того что цель достигнута будет появление универсального компилятора с языка СИ++ (например) в готовую нейронную сеть (без необходимости «обучения»).

Только после этого человеческий мозг можно рассматривать как биологическую вычислительную машину (мое мнение что мозг это именно машина на которой и исполняется личность человека)

beeruser

WAT? Если у вас есть программа, написанная на С++, зачем нужна нейросеть?

Rutel_Nsk

Программа на С++ сама себя не исполнит, она должна быть компилирована в данные конкретной вычислительной системы.

Нейронная сеть пишущая программы на С++ это следующий шаг.