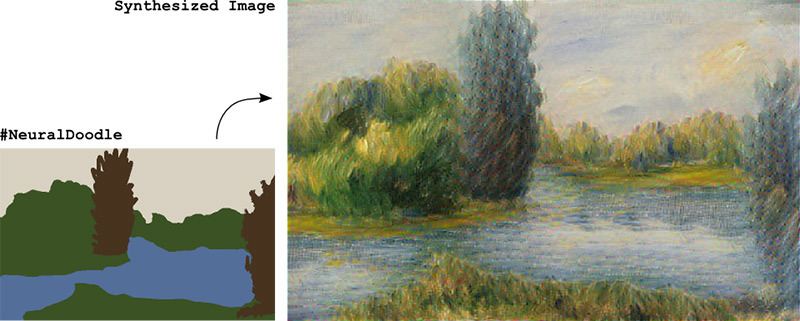

Программа Neural Doodle, сделанная на основе свёрточной нейросети, представляет собой скрипт

doodle.py, который генерирует изображения, принимая три-четыре картинки в качестве входных параметров. В том числе на вход подаётся простенький набросок (то что авторы называют «каракулями») и образец стиля с его наброском. Например, в случае с примером выше образцом стиля является такая картина Ренуара. Нейросеть извлекает характерные стилевые особенности — и переносит их на набросок.

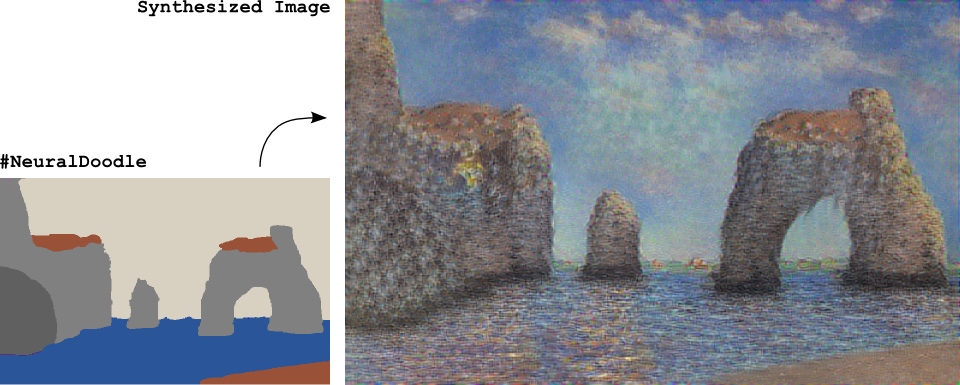

Вот ещё один пример.

Образец стиля от Клода Моне.

Для запуска программы нужен Python 3.4+, установленные библиотеки

numpy и scipy, а также python3-dev. Для работы скрипта потребуется предварительно обученная нейросеть (VGG19, 80 МБ). Инструкции по установке локального окружения см. здесь.Для рендеринга на GPU требуется хорошая карта Nvidia с поддержкой технологии CUDA и 2-4 ГБ памяти (для больших изображений — 8-12 ГБ). Рендеринг можно запустить и на CPU, в этом случае нужно примерно такое же количество оперативной памяти.

Конструкция нейросети описана в научной работе автора "Semantic Style Transfer and Turning Two-Bit Doodles into Fine Artworks", которую он подготовил для конференции nucl.ai Conference 2016.

Нейросеть использует алгоритм синтеза изображений, который предложен исследователями Чуан Ли (Chuan Li) и Майклом Вандом (Michael Wand) в научной работе "Combining Markov Random Fields and Convolutional Neural Networks for Image Synthesis".

Комментарии (100)

Boctopr

10.03.2016 20:58+2В соседней теме про aplhaGo говорили про творчество. Несложный алгоритм, который понимает композицию и пропорции, может делать весьма качественные полотна.

Уже...

edd_k

10.03.2016 21:09+2Уметь пользоваться инструментом "Клонирование" для разукрашивания заготовки текстурными кусками из другой картины — это не творчество.

На приведенных изображениях творчество (простенькое или если можно так выразиться — детское) сосредоточено на заготовках слева. Справа же — автоматизированное разукрашивание на основе сопоставления элементов. Машина ничего не создала. Машина лишь определила какие куски одной картины подойдут каким кускам на заготовке другой картины. Ну и нанесла их (рутинный процесс). Причем, весьма не творчески. Стыки видно, ничего не нарисовано с нуля и т.д.

sim31r

10.03.2016 23:14+2Я не вижу стыков и вижу новые элементы (облака новые и мелкие острова вдали). Если бы картину рисовал художник, то он точно также(!) брал бы куски графической информации из глубин своей личной нейросети, ранее виданные пейзажи, работы авторитетных художников, как осознанно, так и неосознанно.

Многие художники вообще не хотят ничего создавать кстати, проявляют свое мастерство в рисовании с натуры, точном копировании оригинала.

Symphel

11.03.2016 10:14+1Как заметили выше, напоминающие острова текстуры были на оригинальном изображении кораблями. Нейросеть не сумела разделить эти объекты, т.е. на «данном шаблоне» стиля она умеет рисовать море заканчивающееся кораблями (которые у нее не получились).

Кроме того если присмотреться, то видно, что верхний ряд облаков одинаковой формы, тоже скопированной с «шаблона стиля».

Конечно, эти недостатки обусловлены малой выборкой — всего одна картинка — что критично для нейросети. То, что она такое рисует по всего двум изображениям — огромное достижение разработчиков.

sim31r

11.03.2016 12:41+5Если бы на картину писал отзыв критик, он бы сказал так:

… Вдалеке мы видим что? острова или корабли? удивителен замысел художника, глубина его фантазии, каждый кто смотрит картину, должен решить для себя сам, что на ней нарисовано, почувствовать суть происходящего и его загадочность.

Критика по деталям имеет смысл, если цель была фотореалистичность. Но это же не так, цель и была «картина», со всеми особенностями авторского видения. Даже не Черный квадрат и не Сальвадор Дали.

Bedal

11.03.2016 08:28+2Бесспорно ложное рассуждение. Вы исходите из того, что «вот она, известная железка, и мне сказали, что там всё делает программа».

Пройдите-ка тест Тьюринга с такой картиной сначала — распознаете «автоматизированное разукрашивание»? Нет? «Ваш коммент признаётся ничтожным».

edd_k

11.03.2016 08:48+1На каком бесспорно не ложном и не ничтожном основании вы решили, что нет? Вместо напускного пафоса лучше сформулируйте четко вопрос/цель теста, чтобы было ясно, что именно «нет» и почему вы так однозначно это за меня решили.

Yane

11.03.2016 11:15+1Был в интернете такой тестик, где человеку предлагалось выбрать, какие из картинок нарисованы настоящими художниками, а какие — нейросетью. Мой результат был что-то около 70% верных ответов, хотя точно не помню. Другой вопрос, что показателем интеллекта сети этот успех врядли стооит считать. Но это все равно здорово.

edd_k

11.03.2016 18:50Не помню такого теста, было бы интересно.

Но картинки из этой статьи я вообще не рассматривал с позиции «угадай, кто нарисовал». Их в фотошопе можно делать вручную (долго и нудно, наверное).

Я высказал сомнения по поводу того, что это можно называть творчеством. Почему тогда творчеством не называют процесс рендеринга в Максе? Творчество — это работа человека по созданию сцены. Но рисование картины или даже съемку видео на основе этого шаблона делает машина. В чем разница? Или печатный документ, который создает TEX в кучерявом 19** году. Почему творчество заканчивается на работе, проделанной человеком, а работа машины считается автоматизацией рутины? В чем отличие с данным алгоритмом? Отличие в том, что этот алгоритм включает распознавание чего-то там. А приведенные примеры — не включают. Неужели этого достаточно, чтобы результат этого разукрашивальщика ценился несравнимо выше результата, сгенерированного 3DMax-ом? Вот в чем мой вопрос.

Bedal

11.03.2016 12:52-1На том основании, что вы точно описали свой метод — делать выводы на основе знания технических подробностей внутреннего устройства.

Ложность порождается сразу двумя путями:

— Во-первых, как достаточно давно известно, оценку надо делать по принципу теста Тьюринга, то есть оценку результатов.

— Во-вторых, Ваши (как и любого человека, даже мои :-) знания о технических подробностях заведомо недостаточны, чтобы делать выводы на основе особенностей внутреннего устройства художника.

Ну и, этта, «ложное рассуждение» вовсе не означает, что Вы лжёте. Надеюсь, Вы это понимаете. Не было, конечно, желания задеть — так что в любом случае паrдон.

edd_k

11.03.2016 19:00А теперь подумайте каким боком это всё относится к моему изначальному сообщению.

Я вообще не затрагивал темы о том, можно ли угадать руку машины не зная контекста. Кроме того, в самом первом предложении я говорю об инструменте «Клонирование», т.е. очевидно, что я отдаю себе отчет в том, что эта картинка могла быть создана вручную, по крайней мере в Фотошопе.

Bedal

11.03.2016 19:17Да нет, относится. Вы этого не видите, ну так и бывает, да.

Впрочем, ещё раз — ни малейшего желания «переходить на личности», давайте оставим эту невнятную перепалку. Если что — во всём виноват я.

edd_k

11.03.2016 19:23Я говорил о том, можно ли называть это творчеством.

Вы сказали, что раз я не могу вне контекста угадать в картине машину (а я, логично, не смогу!), то я не прав.

Далее в двух сообщениях вы не смогли объяснить столь непонятную логику ваших претензий, но настаиваете на том, что я чего-то не понял.

Bedal

11.03.2016 19:33Нет смысла спорить. Если Вы не понимаете, что я именно о том Вашем исходном комменте говорю… в общем, извините.

engine9

11.03.2016 17:49Человек точно так же использует увиденные образы.

edd_k

11.03.2016 19:16Сперва человек пропускает их «через призму сознания».

А вот (прошу прощения за повторение) в фотошопе, пользуясь инструментом клонирования, человек поступит подобно машине. И если считать результат творчеством (творчески разукрасили клонированными кусочками), то тогда машина занимается творчеством уже многие годы во многих задачах. Чего только стоят процедурно-генерируемые миры! А демо-сцены? Но поскольку там алгоритмы на порядок понятнее, чем «таинственная нейронная сеть», то все лавры творчества необоснованно (или обоснованно?) припысывались человеку, который сообразил идею и сам же создал алгоритм (правда упускается момент того, что машина в таких задачах как-минимум инициализирует последовательность псевдо-случайных чисел в неподвластный человеку момент времени, т.е. хотя бы с этой точки зрения является полноправным соавтором). А вот как только «нейросеть», так сразу и похвал машине на порядок больше.

Я же не особо вижу повод отождествлять все это с человеческим творчеством. Но называть машинным творчеством — ни капли не против.

edd_k

10.03.2016 21:13+4Результатом развития подобных алгоритмов может стать, например, автоматизированное разукрашивание огромного массива старых ч/б сканов и увеличение их размера до современных норм. Т.е. (как обычно) — экономия огромного количества времени (в данном случае, на ручной рутине по ретуши). Ну и, разумеется, масса сервисов по стилизации своих поделок под чей-то стиль. Т.е. от вас — творчество. А от сервиса — рутина.

grayich

10.03.2016 21:32как ей пользоваться?

просит чего-то указать, появляются файлы-скриншоты argparse bz2 os pickle sys

и заканчивается ошибкой

./doodle.py: line 17: syntax error near unexpected token('

./doodle.py: line 17:parser = argparse.ArgumentParser(description='Generate a new image by applying style onto a content image.','

Meklon

10.03.2016 22:32Я вот тоже думал развернуть окружение… Сейчас в основном на Python 2.7 просто.

zyrik

11.03.2016 13:44+1Насколько я понимаю, уже стоит задуматься над переходом на 3.x версию. Всё больше и больше библиотек заканчивают поддержку старых версий, 2.6 уже не в почете. Понятно, что ещё 2.7.x продержится долго, но всё же, наверное, надо начинать смотреть в сторону 3.

Meklon

11.03.2016 13:50Переползу с переходом своих машин на Ubuntu 16.04. Не хочу пляски с репозиториями устраивать. Некогда) А так сразу будет дефолтное окружение. У меня проекты сугубо научного характера, я не профессиональный программист, а врач-исследователь. Сейчас снял с себя кучу работы по анализу микрофотографий благодаря автоматизации обработки и сбора данных.

zyrik

11.03.2016 13:59Я такой же горе-программист, всмысле тоже работник научного труда. Но в последнее время стал пользоваться conda, так что вопрос дефолтного окружения непринципиален. И да, советую и Вам посмотреть в сторону этой библиотеки.

Meklon

10.03.2016 23:01У вас ошибка связанная с парсингом ключей запуска. Может не указали чего. Запустите python doodle.py --help в консоли

grayich

10.03.2016 23:09пример пытаюсь

python3 doodle.py --style samples/Monet.jpg --output samples/Coastline.png --device=cpu --iterations=40

но самое главное не пойму, что он просит выбрать, очень всё запутано\непонятно

Meklon

10.03.2016 23:11Выхлоп help дайте.

grayich

10.03.2016 23:37нашёл причину, почему-то был уверен что в заголовке скрипта указан питон3 как положено и поэтому запускал как ./doodle.py

теперь другая ошибка. вообщем ну его, попробую когда\если сделают человеческий запуск

Meklon

10.03.2016 23:39Лучше вряд ли будет. Типичный Python. Только если переписывать.

grayich

10.03.2016 23:44дело не в питоне, дело в понятности, авторы часто этим пренебрегают, наверно какой-то психологический эффект переноса срабатывает, когда человек погружённый в тему переносит понимание темы и на других.

Meklon

10.03.2016 23:48Ну да) узкий инструмент для решения академической задачи. Субъективно выглядит все неплохо.

BelBES

11.03.2016 00:30+1Я просто скачал репозиторий и развернул виртуальный энвайромент под python3.4 все завелось с полпинка и на CUDA в том числе…

"Йожик в тумане" рукой Да Винчи вполне сносно получился:

Да Винчи

dandelion4wine

13.03.2016 12:36Извините, не молги бы вы помочь с настрокой python и виртуальной среды… у меня все запуталось, а тема очень интересна

BelBES

13.03.2016 14:10Да там вроде бы никакой магии нету, я просто следовал инструкции и в процесс доставлял пакеты, на отсутсвие которых питон ругался...

Taragolis

10.03.2016 23:56+1Ставил все в virtualenv, конечно надоело устанавливать все зависимости, но в итоге даже запускается и даже работает.

--style путь к изображению на котором обучаемся, "каракули" к изображению должны иметь постфикс _sem и в формате PNG

--output файл в который будем сохраняться, "каракули" к изображению должны иметь постфикс _sem и в формате PNG

--device= соответстственно на чем считаем cpu или gpu0, gpu1… gpuN, так как я владелец AMD, то мне остается только cpu

--iterations= количество проходов (чем больше, тем дольше на CPU)

Namynnuz

10.03.2016 22:09+2Есть подозрение, что нейросеть в ближайшем будущем позволит не-художникам создавать вполне себе адекватные и понятные окружающим наброски своего видения какой-то ситуации, что позволит уже полноценному моделлеру и прочим адекватно воплотить это в виде конкретного образа. Тогда создать игру мечты при наличии бюджета будет ощутимо проще. Как и фильм. И прочее. Кстати говоря, возможно именно нейросети в современно их понимании позволят людям понимать друг друга, преодолеть барьер культурных различий и словесных трактовок. Возможно, именно благодаря науке, мы всё-таки сможем наконец-то договориться...

fireSparrow

10.03.2016 22:24+1Точно так же сколько-то десятелетий назад люди думали, что появление Всемирного Информатория предоставит всем свободный доступ к интеллектуальной сокровищнице человечества и создаст новое поколение просвещённых и сознательных людей.

А в итоге люди используют Всемирный Информаторий, чтобы смотреть порнуху и выкладывать селфи с утиными губками.

Namynnuz

11.03.2016 00:01+4Ну я вот использую Всемирный Информаторий и радуюсь. Единственное, меня огорчает обязательная платность копии информации для использования даже в некоммерческих целях. И я сейчас не про музыку-фильмы-игры (тут это в какой-то степени понятно, особенно в случае с фильмами и играми, у которых конские бюджеты), а про те же pdf-ки с серьёзными научными работами. Это натурально вымораживает. Просить с меня сотню долларов за почитать про одно научное открытие из первых рук (так-то, достояние человечества, гордость и свет), потому что уже не в универе — это как-то низко...

sim31r

11.03.2016 12:47-1Вообще-то у многих научных работ тоже конские бюджеты, а просмотров в миллионы раз меньше, чем у фильмов. Пример, научные работы с БАК или телескопа на орбите, в проект вложены миллиарды, а желающих заплатить за ознакомление с данными сотни человек. На фоне того что вложено в проект, 100$ это почти даром.

Barafu

11.03.2016 14:03Итого: и автору гроши, и любопытным шиш. Надо искать для них другой формат заработка. К тому же, опять: а какой процент оплаты достанется издательствам и прочим традиционно-непричастным лицам?

Nulliusinverba

11.03.2016 21:55+2вот эти N баксов не авторам уходят, а издательству. Если бы авторам…

Fen1kz

11.03.2016 00:02Вы на всех-то свои привычки не переносите. Я вот, в отличие от Вас, пытаюсь запустить нейросеть на своем ПК.

sim31r

11.03.2016 00:36Вообще-то несколько десятилетий назад были и антиутопии, которые оказались частично пророческими (1984 и множество других).

Всемирный информаторий дал многим людям доступ к интеллектуальной сокровищнице. Борьба с порнухой ведется, великим фаерволом например в Китае, отношение к процессу неоднозначное.

По моим наблюдениям, лучше в игрушки играть, чем по улицам шляться, улица хорошему не научит, только курить, пить, употреблять спайс и т.п.

MrBoriska

11.03.2016 08:47Благодаря науке мы познаем все новые глубины деградации во имя всеобщего прогресса. Сейчас наука сможет рисовать картины и создавать качественную альтернативу творчеству художников, а потом и вовсе, как в Азимове, «Машины» заменят правительства и отодвинут человека от регулирования глобальной экономики. Человеку останется только существовать, причем ни в чем себе не отказывая, ведь к этому мы все стремимся. Только вот развитие собственных способностей и талантов уже будет не необходимым обстоятельством комфортной жизнедеятельности, а лишь личным интересом или подчинением чьему-либо расхожему мнению. Так что не смотря на то, что большинство населения ждет отупение, я не считаю это проблемой. Главное, чтобы «Машины» были достаточно умны для разрешения конфликтов между теми, кто хочет быть, и теми, кто хочет кем-то стать или чего-то достичь.

sim31r

11.03.2016 12:56У машин будет владелец, программист или корпорация. Первым делом корпорация уничтожит конкурентов ИИ (или купит, как делают корпорации гиганты), и далее понемногу заберет все ресурсы планеты себе. При наличии сильного ИИ ни кто не поймет что случилось, набор случайных, малозначительных факторов приводит к одному стабильному результату (как в фильме Превосходство например). Результат, 99.9% людей вне экономики, вне цивилизации, живут натуральным хозяйством.

А для цивилизации и экономики планеты как-раз всё хорошо, нет затрат на военные программы, нет конкуренции и не рациональных трат невосполнимых ресурсов, большая часть ресурсов планеты идет на научные исследования и развитие ИИ. Снижается выброс в атмосферу парниковых газов, восстанавливается экология, снижается численность населения до нескольких миллионов, как это было 3000 лет назад, снижаются требования к уровню жизни. Для людей «ад», особенно сначала, для науки расцвет и «рай».

Darth_Biomech

12.03.2016 17:58При наличии сильного ИИ ситуация очень быстро поменяется, и ИИ начнет владеть компанией. Т.е. руководители конечно будут считать что все нормально и «тупой компьютер» под их контролем, а на деле…

Visphord

10.03.2016 22:22+4Наверняка ведь уже кто-то собрал её в докере. Залейте плз на докерхаб :)

Taragolis

12.03.2016 01:28Могу отсыпать

Dockerfile#FROM ubuntu:14.04 FROM debian:jessie RUN apt-get update RUN apt-get upgrade -y RUN apt-get install git python3-pip wget python3-dev -y RUN apt-get install build-essential libatlas-base-dev gfortran libfreetype6-dev libpng-dev pkg-config -y #RUN apt-get install libjpeg8-dev -y ##Ubuntu RUN apt-get install libjpeg62-turbo-dev -y ##Debian RUN git clone https://github.com/alexjc/neural-doodle.git ~/neural-doodle RUN pip3 install -q numpy RUN pip3 install -q scipy RUN pip3 install -q cython --ignore-installed RUN pip3 install -q --ignore-installed -r ~/neural-doodle/requirements.txt RUN wget -qO ~/neural-doodle/vgg19_conv.pkl.bz2 https://github.com/alexjc/neural-doodle/releases/download/v0.0/vgg19_conv.pkl.bz2

DenimTornado

10.03.2016 22:281. Ребёнок рисует каракули

2. Нейросеть рисует годный макет

3. 3Д-принтер печатает физическую модель

4. Profit?

RolexStrider

10.03.2016 22:47+3Винсент Ван-Гог тоже скорее всего получился бы достаточно аутентично. А вообще при всем уважении к Ренуару и Моне… Даешь Брейгеля! Хотя нет, лучше сразу Гигера!

Beholder

10.03.2016 23:59Отпишитесь кто смог это запустить и проверить сам на каких-нибудь самостоятельных примерах. Потому что мне кажется, что это "утка". Слишком велика дистанция между исходником и результатом. Скорее поверю что исходник справа, а результат слева.

BelBES

11.03.2016 00:38+1Я запустил, вот тут результат имеется. Для его получения я разметил Джаконду пера Да Винчи, а затем запустил на каракулях:

Стиль Да Винчи

zugo

11.03.2016 08:53+1То есть, все-таки нужно создавать «цветовую карту» исходного изображения, и нейросеть рисует уже основываясь на ней? Это т.н. «процедурное текстурирование», и существует уже достаточно давно. Есть несколько инструментов для художников по текстурам (самый популярный — Quixel Suite), в которых используется этот метод. То есть, натурально, рисуете на развертке цветовую карту, и он по этим цветам заполняет текстурами из библиотеки материалов (металл, кожа и т.д.). Так что ничего нового.

BelBES

11.03.2016 09:26Ну, если у вас полуится воспроизвести результаты статьи при помощи этого процедурного текстурирования, то круто.

Beholder

11.03.2016 15:22Стало немного понятней, как это работает. В общем, это как бы интеллектуальный clone tool. И ещё неизвестно, действительно ли там нужна "нейросеть".

BelBES

11.03.2016 16:52И ещё неизвестно, действительно ли там нужна «нейросеть».

Ну, вычислительная способность нейронных сетей не выше, чем у машины тьюринга, т.ч. теоретически любую задачу, решаемую с помощью сеток можно решить без… вопрос в сложности реализации и существовании достаточно формализованного подхода)

Вообще судя по моим экспериментма, оно адекватно отрабатывает только на картинках всяких импрессионистов, где особых деталей нету. Если в примере с тойже монализой нарисовать большой красный блоб (как размечена сама Джаконда), то результат да, может вырождаться в неудачную попытку скопипастить силуэт…

Но для генерации всяких фоновых изображений почему бы и не применить, я графикой не занимаюсь т.ч. не знаю насколько оно по качеству соотносится с автогенераторами текстур.

sayber

11.03.2016 00:10Ждем когда появится в Photoshop кнопка о которой мечтали многие — создать изображение.

artemerschow

11.03.2016 00:11+4Уж простите, но здесь явно просится картинка

l27_0_0_1

11.03.2016 00:33+13Боюсь вас разочаровать, но в комикс вы добавили картину Моне, а не результат работы программы.

artemerschow

11.03.2016 01:55Посыпаю голову пеплом!.. Глупо вышло) Мне явно стоит быть внимательнее. Спасибо! :)

vk2

11.03.2016 03:05+10Не извиняйтесь, ошибка как раз в тему. Это отличное подтверждение того, что обычный человек не заметит разницы.

l27_0_0_1

11.03.2016 03:46Мне кажется, это больше подтверждение того, что Ализар такой Ализар. Если не всматриваться в картинки, а только читать текст, можно сделать вывод, что эта картинка была сделана с помощью образца стиля от Клода Моне, хотя это не является правдой.

artemerschow

11.03.2016 11:37+2Да нет, тут то именно что невнимательность. Так то я заметил отсутствие повторяющихся паттернов, наличие подписи (!), удивился прекрасному свету на скале но всё равно умудрился не принять это всё во внимание. А вот на белые шумы слишком сильно внимание акцентировал. Так что это отличное подтверждение тому, что человек верит в то, во что хочет верить и неосознанно ищет тому доказательства.

Avitale

11.03.2016 11:07Но если уж совсем-совсем придираться, то робот не сделал бы эту картину, не будь у него исходника, сделанного человеком.

Впрочем, настанет день — и эта придирка потеряет свою ценность. :)

Barafu

11.03.2016 14:12+1Вы потеряли из диалога самое крутое использование аргумента «сперва добейся», какое я когда либо слышал. Звучало примерно так:

Негр: Может ли робот написать картину?

Робот: А ты можешь?

sumanai

11.03.2016 00:52А оно случайно не связано с этим?

https://habrahabr.ru/company/io/blog/262267/

ThunderCat

11.03.2016 08:48+9Ну, теперь понятно как нарисовать сову )

habrastorage.org/files/727/18f/228/72718f228cb64b11afad0418217ca452.jpg

agrrr

11.03.2016 08:51numpy и scipy, не понятно как запустить… может кто по подробней все описать…

Meklon

11.03.2016 09:20Это библиотеки Python. Сама программа пользуется ими в процессе работы. То есть для запуска программы из консоли у вас должно быть настроено все окружение. Для начала надо определиться какая у вас операционная система.

Assada

11.03.2016 12:34у меня так и не получилось установить scipy…

https://gist.github.com/Assada/7546248f63d985e7c7bf

Танцевал с бубном, а оно почему то все равно лезет в python27

Taragolis

11.03.2016 12:55Танцевал с бубном, а оно почему то все равно лезет в python27

минимальные требования python 3.4+

Ну и для установки scipy через pip надо удовлетворить все зависимости, мне в ubuntu 16.04 было достаточно:

sudo apt-get install libatlas-base-dev gfortran

Meklon

11.03.2016 13:45О, ты уже на бету переполз? Как со стабильностью?

Taragolis

11.03.2016 14:56С пре-альфы на ней. У меня были проблемы:

- С открытыми AMDшными дровами

- В suspend переодически отказывается уходить

Но лучше все равно подождать до релиза

Meklon

11.03.2016 19:34Оу....

В Ubuntu 16.04 прекращена поддержка проприетарного драйвера AMD

Taragolis

11.03.2016 20:11А я вот даже стал что-то подозревать, так как после вчерашнего обновления пропали редкие артефакты проприетарных драйверов.

С другой стороны теперь сижу и жду, будут ли открытые крашить систему, как было месяц назад.

Надо почаще себе напоминать

alias apt-lazy='sudo sh -c "apt-get update && apt-get dist-upgrade -y && apt-get autoremove -y && apt-get autoclean -y"'

Assada

11.03.2016 14:25Установлено 2 версии. 2.7 и 3.4. pip лезет почему то в 27 и pip3 туда же.

Fedora 23

Taragolis

11.03.2016 15:04Установлено 2 версии. 2.7 и 3.4

Это ок

pip лезет почему то в 27

Это ок

и pip3 туда же.

Это совсем не ок. Я конечно Red Hat веткой работал очень мало, могу только посоветовать, что-то из серии

>dnf reinstall python3-pip

impetus

11.03.2016 16:01теперь зал с "чёрынм квадратом" можно разукрасить по стенам — "чёрный квадрат в стиле Ренуара", "в стиле Ван Гога", "в стиле Борхеса" или даже (шёпотом) Шикльгрубера...

Ну и тест тьюринга там же посетителям — найти среди всего этого нарисованное человеком.

ruikarikun

11.03.2016 16:38+1Ну и тест тьюринга там же посетителям — найти среди всего этого нарисованное человеком.

Среди нас робот!

CryKitten

11.03.2016 21:00Данный алгоритм делает довольно простую вещь: пытается сопоставить предложенный шаблон-"подмалёвок" и картину, после чего заполняет области шаблона одного цвета подходящими, по его мнению, фрагментами картины. Видимость творчества создаётся только потому, что шаблон и картина подобраны в пару. Про сам этот технический художественный приём — читайте в вики, не ленитесь (ru.wikipedia.org/wiki/Подмалёвок).

Творчества в человеческом понимании нет ни грамма, это алгоритм из семейства алгоритмов распознавания образов. Схожие алгоритмы, например, активно используют в системах распознавания текста.

Авторам этого алгоритма, кстати, порекомендовал бы давать на вход своей нейросети прозвольные пары "картина+шаблон", могут получиться забавные рисуночки в стиле поп-арт.

BelBES

13.03.2016 01:56Для тех кто хочет поиграться с кодом, сегодня релизнулась ускореная версия алгоритма (не исопльзует MRF): https://github.com/DmitryUlyanov/fast-neural-doodle

AntonSor

Ну все! Теперь рисовать карикатуры, мультфильмы, комиксы, мангу станет гораздо проще. На входе текст с диалогами, по нему одна нейросеть формирует общие очертания фигурок героев, и вторая (та, что в статье) дорисовывает согласно стилю художника-постановщика кадры мультфильма из общих очертаний.

sim31r

Вообще-то текст с диалогами нейросеть уже пишет, получается не очень, но и занимался этим программист в качестве хобби, а не корпорация:

Нейросеть научили писать сценарии к сериалу «Друзья»

https://tjournal.ru/21279-neiroset-nauchili-pisat-scenarii-k-serialu-druzya

Как отмечает New York Magazine, нейронной сети удалось ухватить многие черты персонажей. Например, герой Чендлера часто начинает свои предложения с наречия «so» («так», «таким образом»), а Джоуи иногда говорит с «витиеватой интонацией».

Кроме того, приглашённой звездой написанного системой эпизода стал Жан-Клод Ван Дамм, ранее появлявшийся в «Друзьях».

tmin10

А диалоги и сюжет также можно составить по уже готовым произведениям, просто проанализировав весь подобных жанр.