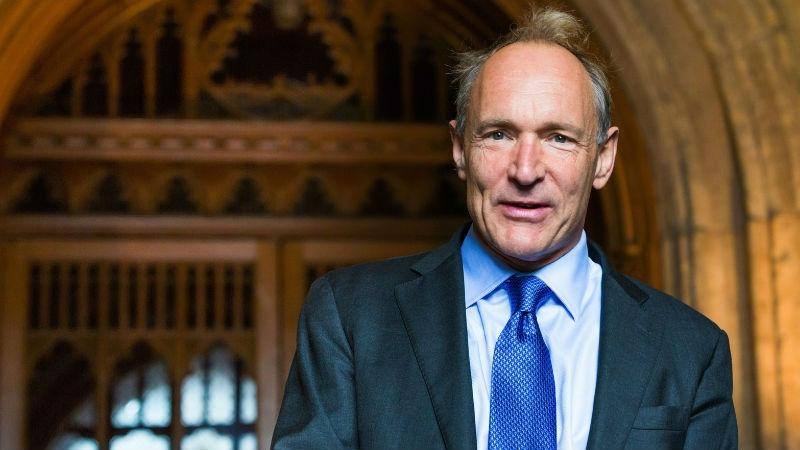

Сэр Тим Бернерс-Ли, один из изобретателей WWW и гипертекстового протокола, профессор Массачусетского технологического института и Саутгемптонского университета, является одновременно и советником правительства Великобритании. Поэтому он должен трезво смотреть на мир и оценивать, что происходит вокруг и к чему это может привести.

Рассуждая об Искусственном интеллекте, многие эксперты думают о возникновении сильного ИИ и технологической сингулярности, но если рассуждать здраво, то какая польза людям от сильного ИИ, зачем вкладывать миллиарды долларов в его разработку? Выгоды от наличия сильного ИИ туманны, а риски слишком велики.

Гораздо логичнее предположить, что сначала появятся слабые версии ИИ, которые лучше людей будут выполнять узкоспециализированные задачи. За счёт этих версий ИИ люди будут пытаться получить конкурентное преимущество над другими людьми ради главной цели, которая движет человечеством — ради денег*.

Некоторые признаки наступающего будущего видны уже сегодня. Самые талантливые программисты и гениальные математики идут работать куда? Правильно, в инвестиционные фонды. Там они создают инновационные математические модели, новые трейдинговые стратегии, экзотические хитроумные деривативы по неординарным формулам — и ищут ту самую альфу, то есть прибыль выше рынка. У кого выше интеллект — тот получает альфу. Середнякам достаётся бета, а неудачники терпят убыток. Финансовый рынок, избавленный от всяких материальных товаров, подковёрных интриг — это борьба интеллектов в чистом виде, по чётко установленным правилам. Борьба за деньги. Это единственная в мире область человеческой деятельности, где гениальный математик может стабильно зарабатывать сотни тысяч долларов в месяц, особенно если он получает процент от альфы, которую принёс своему фонду.

Разумным шагом будет внедрить компьютерные системы принятия решений — самые продвинутые версии ИИ — в первую очередь в финансовом мире. Примерно об этом говорил и сэр Тим Бернерс Ли в своём выступлении 10 апреля 2017 года на Глобальном саммите по финансовым инновациям.

Системы слабого ИИ от IBM и других компаний уже сейчас внедряются в банках и инвестиционных фондах. Что будет дальше? Тим Бернерс-Ли считает, что переломным моментом станет, когда ИИ начнёт принимать важные решения. Например, оценивать выгоду инвестиций и решать, какую компанию выгоднее приобрести. Оценивать кредитную историю людей — и решать, кому выдать ипотечную ссуду, а кому нельзя. Современные компьютерные системы уже близки к такой функциональности.

Тим Бернерс-Ли говорит, что следующим логическим этапом развитии финансового ИИ после принятия решений о покупке самых выгодных компаний будет управление компаниями, создание холдингов и генерация дочерних копий собственной программы для управления этими новыми компаниями.

Это будет естественный процесс, потому что в конкурентной борьбе на рынке компании под управлением ИИ будут иметь преимущество перед компаниями, которыми управляют люди. В конце концов, на рынке останутся только компании под управлением ИИ, которые будут конкурировать между собой. Людям будет тяжело понять и убедиться, что соблюдается честная конкуренция: «Да и как объяснить понятие честности компьютеру, в любом случае?», — задаётся вопросом Тим Бернерс-Ли. Здесь возникает вопрос соблюдения этики и морали — правил поведения, которые люди и сами не понимают до конца (и расходятся во мнениях друг с другом), как же объяснить это компьютеру?

Опять же, есть риски, что ограниченная версия ИИ начнёт развиваться в неправильном направлении. Созданная изначально для узкой задачи, в итоге она может посчитать, что вся окружающая действительность описывается условиями этой задачи. Такое мнение Бернерса-Ли напоминает опасения, которые высказывал Илон Маск в интервью Vanity Fair:

«Предположим, вы создали самосовершенствующийся ИИ для сбора клубники и он становится всё лучше и лучше в сборе клубники, и собирает всё больше и больше, и улучшается, и всё, что он хочет — собирать клубнику. Так что в конце концов весь мир превратится в клубничные поля. Клубничные поля навсегда [Strawberry fields forever]».

В общем, есть над чем подумать. Если программа может самообучаться, то слабый ИИ с узкой специализацией может оказаться даже опаснее, чем полноценный сильный ИИ с нормальным самосознанием. Возможно, моральные принципы — это неотъемлемое качество любого разумного существа, обладающего интеллектом и самосознанием.

* В западной цивилизации наличие легально заработанных денег означает наличие власти, в иных обществах это не всегда тождественные понятия.

В качестве небольшой рекламы: Пользователь ZiingRR сообщил нам, что в конце мая на базе НИУ ВШЭ в ИТ-лектории пройдёт первая в России относительно большая лекция по теме безопасности ИИ (AI Safety, язык выступления — английский). Также планируется провести подобную лекцию в «Архэ». ZiingRR обещает, что с обеих лекций будет опубликовано видео.

Комментарии (11)

ideological

13.04.2017 06:51Системы слабого ИИ от IBM и других компаний уже сейчас внедряются в банках и инвестиционных фондах.

Вот, имеется ввиду обычные алгоритмы, вот это Термин «искусственный интеллект» потерял всякий смысл

Что будет дальше? Тим Бернерс-Ли считает, что переломным моментом станет, когда ИИ начнёт принимать важные решения.

Или не начнет.

Последнее время столько беспокойств по поводу безопасности сильного ИИ, хотя даже ничего подобного из разработок и близко нету.

Конечно возможно несколько опасных вариантов, например, когда маркетологи впарят слабый ИИ под видом сильного и военные или политики доверят этой штуке запуск ракет или управление национальным благосостоянием.

Camrad_RIP

13.04.2017 09:15>>зачем вкладывать миллиарды долларов в его разработку? Выгоды от наличия сильного ИИ туманны, а риски слишком велики.

Рано или поздно «цена» снизиться настолько, что кто-то запилит ИИ просто что бы было.

ideological

13.04.2017 09:33+1Ага, создается такое впечатление у многих, только одна проблема — что в реале это не так.

Vjatcheslav3345

13.04.2017 10:09+1Скорее всего даже слабый ИИ может убить весь малый бизнес — ведь тогда большая организация под его неустанным управлением в сочетании с применением им роботов — не будет отставать в эффективности от малой — эпоха больших корпораций вернётся, как будь то и не уходила...

ilansk

13.04.2017 11:24+1Если программа может самообучаться, то слабый ИИ с узкой специализацией может оказаться даже опаснее, чем полноценный сильный ИИ с нормальным самосознанием.

В кино видел схожий сюжет: хакер договорился с ИИ, управлявшим цивилизацией машин, что деактивирует вышедший из под контроля узкоспециализированный ИИ в обмен на свободу людей из виртуальной тюрьмы.

mdaemon

13.04.2017 17:17>ради главной цели, которая движет человечеством — ради денег

Вот кто то уже и нашел ответ на вопросы жизни и смерти и все такое, и для него это не 42…

Если это будет целевой функцией ИИ то человечеству конец.

Вряд ли в ИИ будет замкнутая модель всего мира, скорее чисто финансовая модель, а с ее точки существенная часть человечества — излишняя.

MTonly

click0

Нет, ИИ перестанет учиться и будет, например, забывать события, произошедшие вчера.

Примерно как у людей со старческим склерозом.

Я не думаю, что вы захотите общаться с ИИ с такой забывчивостью.

Sadler

Зачем Вам общаться со слабым ИИ? В продакшене действительно часто отрубают возможность обучения, чтобы получать стабильные результаты, хотя для финансовых рынков это никак не подходит.