Что можно назвать ИИ, а что нельзя – в некотором смысле зависит от определения. Нельзя отрицать, что AlphaGo – ИИ, играющий в го, разработанный командой Google DeepMind и обыгравший чемпиона мира – а также похожие системы с глубинным обучением за последние несколько лет смогли решить довольно сложные вычислительные проблемы. Но приведут ли они нас к настоящему, полному ИИ, к обобщённому интеллекту, или ОИ? Вряд ли – и вот, почему.

Одна из ключевых особенностей ОИ, с которой приходится иметь дело при его создании – он должен быть способен самостоятельно разобраться с окружающим миром и разработать своё, внутреннее понимание всего, с чем он встретится, что услышит, скажет или сделает. Иначе у вас на руках окажутся современные ИИ-программы, смысл которых был заложен разработчиком приложения. ИИ, по сути, не понимает, что происходит и его область специализации очень узка.

Проблема смысла – возможно, самая фундаментальная из задач ИИ, и она до сих пор не решена. Одним из первых выразивших её людей стал когнитивист Стеван Харнад, написавший в 1990 году работу «Задача сопоставления символов». Даже если вы не верите в то, что мы манипулируем именно символами, задача всё равно остаётся: сопоставление представления, существующего внутри системы, с реальным миром.

Для конкретики заметим, что задача осмысления приводит нас к четырём подзадачам:

1. Как структурировать информацию, которую личность (человек или ИИ) получает из окружающего мира?

2. Как связывать эту структурированную информацию с миром, то есть, как построить понимание мира личностью?

3. Как синхронизировать это осмысление с другими личностями? (В противном случае общение окажется невозможным, и интеллект получится необъяснимым и обособленным).

4. Почему личность что-то делает? Как запустить всё это движение?

Первая проблема, структурирование, хорошо решается через глубинное обучение и подобные обучающие алгоритмы, не требующие надзора – оно, к примеру, используется в AlphaGo. В этой области мы достигли значительных успехов, в частности благодаря недавнему росту вычислительных мощностей и использованию GPU, которые особенно хорошо распараллеливают обработку информации. Эти системы работают, принимая на вход чрезмерно избыточный сигнал, выраженный в многомерном пространстве, и сводят его к сигналам меньших измерений, минимизируя при этом потерю информации. Иначе говоря, они захватывают важную часть сигнала с точки зрения обработки информации.

Вторая проблема, проблема связи информации с реальным миром, то есть, создание «осмысления», непосредственно связана с роботизацией. Для взаимодействия с миром вам необходимо тело, а для построения этой связи вам необходимо взаимодействовать с миром. Поэтому я часто утверждаю, что без роботизации нет и ИИ (хотя бывают отличные роботы без ИИ, но это уже другая история). Это часто называют «проблемой воплощения», и большинство исследователей ИИ соглашаются, что интеллект и воплощение тесно связаны. В разных телах существуют разные формы интеллекта, что легко можно видеть по животным.

Всё начинается с таких простых вещей, как поиск смысла в ваших собственных частях тела и том, как их контролировать для достижения нужного эффекта в обозримом мире, как строится ощущение пространства, расстояния, цвета, и т.д. В этой области подробные исследования проводил такой учёный, как Дж. Кевин О'Реган, известный своей «сенсомоторной теорией сознания». Но это лишь первый шаг, поскольку затем необходимо будет строить всё больше и больше абстрактных концепций на базе этих приземлённых сенсомоторных структур. Мы пока ещё не добрались до этого, но исследования на эту тему уже ведутся.

Третья проблема – вопрос происхождения культуры. У некоторых животных прослеживаются простейшие формы культуры и даже передаваемые через поколения способности, но в очень ограниченном объёме, и лишь люди достигли того порога экспоненциального роста приобретённого знания, который мы зовём культурой. Культура – катализатор интеллекта, и ИИ, не обладающий возможностью культурного взаимодействия, будет представлять лишь академический интерес.

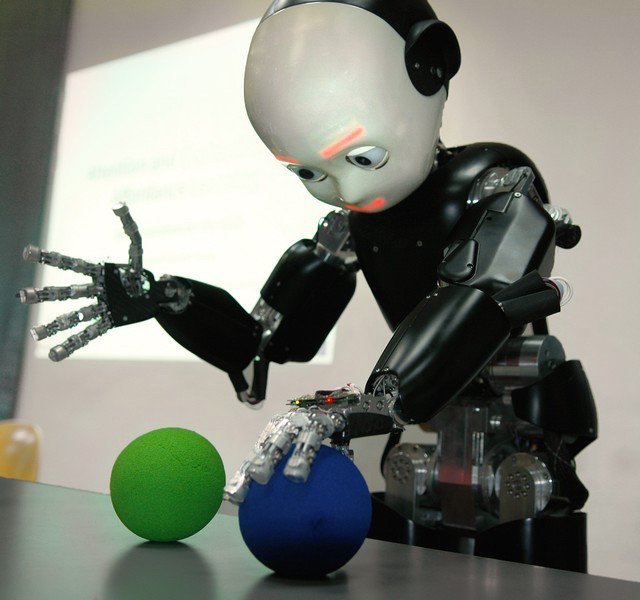

Но культуру нельзя вручную ввести в машину в виде кода. Она должна стать результатом процесса обучения. Лучший способ искать пути к пониманию этого процесса – психология развития. Работу на эту тему проделали Жан Пьяже [Jean Piaget] и Майкл Томасело [Michael Tomasello], изучавшие процесс приобретения культурологических знаний детьми. Этот подход породил новую дисциплину робототехники, «робототехническое развитие», берущую ребёнка в качестве модели (как в случае с роботом iCub на иллюстрации).

Также этот вопрос тесно связан с исследованием процесса обучения языку, а это одна из тем, которые изучаю и лично я. Работы таких людей, как Люк Стилс [Luc Steels] и др. показали, что процесс приобретения языка можно сравнить с эволюцией: личность создаёт новые понятия, взаимодействуя с миром, используя их для общения с другими личностями, и выбирает структуры, помогающие общаться успешнее других (в основном для достижения совместных целей). После сотен проб и ошибок, как и в случае биологической эволюции, система порождает наилучшее понятие и его синтаксический/грамматический перевод.

Этот процесс проверяли экспериментально, и он удивительно похож на то, как эволюционируют и растут естественные языки. Также он отвечает за мгновенное обучение, когда личность воспринимает концепцию сразу – такие вещи не способны объяснить такие основанные на статистике модели, как глубинное обучение. Сейчас несколько исследовательских лабораторий при помощи этого подхода пытаются пройти дальше по пути восприятия грамматики, жестов и более сложных культурных явлений. Конкретно это AI Lab, основанная мною во французской компании, занимающейся робототехникой Aldebaran. Сейчас она стала частью группы SoftBank Group – именно они создали роботов Nao, Romeo и Pepper (внизу).

И, наконец, четвёртая проблема сталкивается с «внутренней мотивацией». Почему личность вообще что-то делает, а не просто находится в покое. Требований к выживанию недостаточно для объяснения человеческого поведения. Даже если накормить и обеспечить безопасность человека, он не сидит в ожидании возвращения голода. Люди изучают окружения, пытаются что-то сделать, и движет ими какая-то форма присущего им любопытства. Исследователь Пьер-Ив Удейер [Pierre-Yves Oudeyer] показал, что простейшего математического выражения любопытства в виде стремления личности к максимизации скорости обучения достаточно для появления удивительно сложного и неожиданного поведения (см., к примеру, эксперимент с «игровой площадкой», проведённый в Sony CSL).

Судя по всему, нечто подобное необходимо системе, чтобы побудить в ней желание пройти через три предыдущих шага: структурировать информацию о мире, объединить её со своим телом и создать осмысленные понятия, а затем выбрать из них наиболее эффективные с точки зрения коммуникации, чтобы создать совместную культуру, в которой возможна кооперация. Именно это, с моей точки зрения, и есть программа ОИ.

Повторюсь, что быстрое развитие глубинного обучения и недавние успехи таких ИИ в играх типа го – это очень хорошие новости, поскольку такой ИИ найдёт много точек приложения в медицинских исследованиях, индустрии, сохранении окружающей среды и в других областях. Но это только одна часть проблемы, что я и пытался здесь объяснить. Я не верю, что глубинное обучение – это панацея, которая приведёт нас к настоящему ИИ, в смысле машины, способной научиться жить в мире, взаимодействовать с нами естественным образом, понимать сложность наших эмоций и культурных искажений и в итоге помочь нам сделать мир лучше.

Комментарии (43)

arandomic

26.04.2017 15:39-1Ну вот опять. «Почему прикладной ИИ — не ИИ»

В философии сознания (если я не ошибаюсь), есть целый пласт вопросов, ответов на них, вопросов к ответам, итд.

Что такое разум?

Что такое смысл?

Что такое сознание…

Что такое мышление

Каждый раз, когда заходит разговор про AI, кто-то воспринимает термин AI, как «интеллект, аналогичный человеческому» и начинает задвигать те же(банальные по сути) вопросы по отношению уже к искусственному мышлению.

Кто-то начинает давать ответы

Кто-то задавать вопросы к ответам.

И в комментариях/репостах начинается диспут по философским проблемам, которые обсасываются со времен Декарта (если не Платона)

И всё это на фоне практической задачи и практического же решения этой задачи, к которым, кто-то имел неосторожность применить термин AI.

Sadler

26.04.2017 16:17Каждый раз, когда заходит разговор про AI, кто-то воспринимает термин AI, как «интеллект, аналогичный человеческому»

Это они расширяют терминологию, чтобы кто-нибудь мог вклинить гениальную мысль «Они нас поработят!»

Bedal

26.04.2017 16:18+4Обычные игрища философов, бла-бла. Искусственного разума не может существовать по определению, потому что то, что удалось решить искусственно — автоматически объявляется не входящим в понятие разума.

И эту мысль философы уже полста лет продолжают облекать в миллионы слов. Кушать-то надо, и реноме поддерживать…

zloddey

26.04.2017 16:32Видимо, нужна специальная свёрточная сеть, которая будет специализироваться на создании философских эссе. Улучшаясь, она постепенно лишит работы белковых философов, и проблема решится сама собой.

cepera_ang

26.04.2017 16:53Нет, конечно же не лишит. Ведь любая философская работа должна обязательно начинаться от Платона и заканчиваться самим автором, включая всех остальных (и нейронку тоже придётся включать). Так принято, и без этого философия — не философия.

impetus

27.04.2017 15:12Да там в большинстве случаев простого «корчевателя» достаточно.

cepera_ang

27.04.2017 17:08О, а сейчас и технические статьи можно генерировать (отсюда: http://karpathy.github.io/2015/05/21/rnn-effectiveness/)

edd_k

26.04.2017 17:48Что значит "решить искусственно"? Сеть учится и прогрессирует, а программист даже охватить в голове это не может. Это уже совсем не то, что "программирую 2+2 и ожидаю получить 4". Речь идет о чем-то сродни "смастерить и воспитать Буратино".

taujavarob

26.04.2017 17:19-41. Как структурировать информацию, которую личность (человек или ИИ) получает из окружающего мира?

2. Как связывать эту структурированную информацию с миром, то есть, как построить понимание мира личностью?

3. Как синхронизировать это осмысление с другими личностями? (В противном случае общение окажется невозможным, и интеллект получится необъяснимым и обособленным).

4. Почему личность что-то делает? Как запустить всё это движение?

Религию забыли. (С)

Без религии человек не человек, а не пойми кто. Обезьяна, не более того.

u010602

26.04.2017 17:21+3А с религией — обезьяна с религией.

taujavarob

27.04.2017 17:26-1А с религией — обезьяна с религией.

Обезьяна с религией и есть человек. (С)

Обезьяна без религии — есть просто обезьяна (или «атеист» — это синоним).

Да, есть попытки найти в поведении обезьян некоторые религиозные моменты — но эти попытки (и примеры) не убедительны — типа где-то (в глубине Африки) кто-то видел (довольно давно) стаю обезьян которая довольно часто кидала камни в расщелину дерева. — На основании этого делать вывод что обезьяны исповедуют какую-то религию довольно опрометчиво.

Обезьяны, как и атеисты — не исповедуют никакой Религии. (С)

Отличие обезьян от атеистов в том, что атеисты были взращены фактически людьми (то есть обезьянами исповедующими Религию), но потом отринувшие религию и вернувшиеся практически к обезьянам.

А проводить опыты, ориентироваться по сторонам света и даже считать — это и птицы умеют, не то что обезьяны.

Так что главное чем отличаются животные от людей — это не устный счёт и не предметы охоты (видео как птица ловит рыбу на приманку из кусочка дерева доступно в инете всем), а религия и только религия. — Про это отличие один учёный-биолог уже и книгу написал.

P.S.

realbtrСмысл, это когда есть некая ясность понимания.

А ясность понимания происходит тогда и только тогда когда есть некий смысл? Я вас правильно понял?

realbtrВ сочетании символов «МАМА» мы обнаруживаем смысл, а в сочетании «ФХЩЫ» нет (если исключить извращения, остаться в чисто бытовых, повседневных рамках).

В сочетании "Мааа мааа раау" есть смыл или нет? Не улавливаете?

Хорошо, а в сочетании: «Чао нам паааааат пааать сааал фаааы?»

realbtrПонимание — это определенность соответствия признаков чему-то уже знакомому. То есть мы обобщаем признаки и понимаем, что ранее их уже обобщали.

Это верно. Но разве Религиозный опыт не есть обобщение, наследование и применение ранее случившегося реального события?

realbtrСистемы выявления и обобщения признаков — это хорошее, годное направление исследований ИИ.

Эдак и к Библии можно прийти. (С)

realbtrРазумеется, многие исследователи по своему могут видеть проблему сознания и понимания, проблему рассудка и рассудочной деятельности, саму проблему поведения (осознанного поведения, т.е. поведения выводящего новые способы действия, в отличие от автоматического повторения уже сложившихся шаблонов)

Если компьютерная программа выводит новые способы действия разве она от этого станет разумной? ©

Вывод? — Разум спрятан только в Религии. Без религиозного сознания и сознания нет. (С)

Религия же есть Традиция. (С) То есть быть религиозным это означает следование традиции, которая сама возникла как реальное действие приводившее к цели в прошлом.

Не путать Религию и высосанного из пальца «Макаронного монстра».

Фактически — религиозное поведение — есть поведение аналогичное поведению «эгоистичных генов».

Но "эгоистичный ген" — он тупой ген (по крайней мере так считает Ри?чард До?кинз).

Но несмотря на его «тупизну» — он двигается всё время к успеху.

Религиозное поведение аналогично. Оно просто и очень просто. Никакой отсебятины и гипотез. Только опора на традиции порождённые реальными событиями в прошлом.

Но ведь копирование копий (симулякр), следование традициям которым тысячи лет, может приводить к… сбою, к искажению, к… «мутациям»? — Всё верно. Так и происходит. Аналогично… генетическому алгоритму!

Аналогии, аналогии — они ничего не доказывают, но они постоянно применяются с целью… понять смысл. — То есть получить религиозный (мистический) опыт (вспышку, озарение) — который и называется смыслом.

Имхо, конечно, имхо. (С)

u010602

27.04.2017 18:55Все вы верно пишите, принципиальных отличий между человеком и обезьяной нет. Т.к. человек и есть обезьяна. А отличие между религиозным человеком и не религиозным — да только религия. Банальщина собственно. Но только не нужно переназначать термины. Человек это такой вид обезьян, и генетический анализ определяет кто человек, а кто нет. Коматозное тело без мозга — то-же человек.

u010602

26.04.2017 17:20-1Мне иногда кажется, что скайнет будет топтать наши черепа, и все равно будут «философы» рассуждающие есть ли у скайнета интеллект или нет. Как будто у них есть материальная заинтересованность, не признавать современные когнитивные системы искусственным интеллектом, получать гранты и продолжать искать божественное начало в ИИ.

Hellsy22

26.04.2017 17:27Конечно же есть. Это продолжение древнейшей темы — есть ли душа у женщин, негров, иноверцев и т.д.

Если нет, то значит их можно смело уничтожать или порабощать. Мысль о человекоподобном ИИ многим не дает покоя — ведь с ним в итоге придется (о ужас!) договариваться, выделять ему какие-то там права. А вот если это «не полноценный» ИИ, то можно делать все.

red75prim

26.04.2017 17:39+1Также он отвечает за мгновенное обучение, когда личность воспринимает концепцию сразу – такие вещи не способны объяснить такие основанные на статистике модели, как глубинное обучение.

Интересно, как такая позиция согласуется с тем, что в нейросети, занимающейся предсказанием следующей буквы в текстах отзывов о товарах, обнаружился нейрон реагирующий на эмоциональную окраску текста. Чем не мгновенное обучение? Показываешь этой сети — вот хороший отзыв, вот плохой отзыв, а она тут же — "о! у меня уже есть для этого специальный нейрон".

https://arxiv.org/abs/1704.01444

Естественно, структура сети пока слишком примитивна, чтобы сеть могла заметить и отреагировать на такой "момент озарения", но истинность приведённой цитаты уже достаточно сомнительна.

nikitastaf1996

26.04.2017 19:15+1Все проще чем кажется.Просто сделайте дырку в свёрточной нейронной сети и получите пончиковую нейронную сеть.

mtivkov

27.04.2017 00:21+1Почему никогда на Хабре и ГТ, рассказывая про нейросети, не упоминают ключевое отличие процессов их обучения и функционирования от таковых в "органическом" мозге?

В мозге не только веса входов нейронов изменяются, там ещё и образуются новые связи между нейронами, и исчезают старые — перестраивается сама конфигурация сети.

Без такой фичи нейросеть будет получаться заточенная только на 1 задачу. Либо игра го, либо распознавание образов. Вместе — никак. И никакого AI не получить из набора "решателей узких задач".

Sadler

27.04.2017 06:26образуются новые связи между нейронами и исчезают старые — перестраивается сама конфигурация сети

Используйте полносвязные слои. Нулевой вес эквивалентен разрыву связи. Сети с переменной топологией тоже используются, но значительно реже, вероятно, в связи с неэффективным использованием памяти на больших сетях и несколько более сложным обучением на GPU.

mtivkov

27.04.2017 12:41У человека порядка 10^10 нейронов.

Если хотим делать AI умнее человека, то придется примерно столько нейронов и брать, а лучше — еще больше.

Железо пока не тянет такие полносвязные слои.

Специализация участков сети (как и у человека) несколько ослабит проблему. Т.е. можно делать несколько специализированных сетей + полносвязный слой с интеллектом, который их объединяет и использует.

Предположим, на полносвязный слой пойдет 1/10 часть — т.е. 10^9 нейронов, это 10^18 связей (примерно 2^60).

Все равно много. AI пока недостижим.

Если на каждую связь по 1 байту памяти выделить, то 1 ТБ памяти хватит на полносвязную сеть из миллиона нейронов. На таком жалком количестве AI не получить.

Может все же лучше думать в сторону реализации механизма изменения конфигурации сети?

Sadler

27.04.2017 13:06Может все же лучше думать в сторону реализации механизма изменения конфигурации сети?

Сэкономите в памяти (не забываем о том, что список связей тоже придётся где-то хранить), на порядки проиграете в скорости вычислений, т.к. вместо обычного умножения матриц придётся вычислять все значения отдельно. Это может быть более или менее оправданным, если архитектура вычислителя будет соответствовать архитектуре сети. Скажем, с использованием ASIC.

mtivkov

27.04.2017 13:17Нет такой альтернативы — экономить на памяти или не экономить.

Можно лишь рассматривать разные варианты экономии. Таки придется уменьшать связность и т.п.

А когда сэкономим в триллион раз на памяти (по сравнению с полносвязной сетью), то и общее быстродействие от этого только возрастет.

Sadler

27.04.2017 13:20Вы пытаетесь переспорить сами себя? Практический опыт у Вас есть, или только идеи?

mtivkov

03.05.2017 11:54Не заметил у себя ничего самопротиворечивого.

Полносвязная сеть сейчас практически нереализуема для количества нейронов более 1 млн.

Для того, чтобы это понять, не нужно никакого практического опыта, достаточно знать арифметику и типичные объемы памяти современных устройств.

1 млн нейронов слишком мало для AI.

Поэтому ваше предложение "Используйте полносвязные слои. Нулевой вес эквивалентен разрыву связи." не проходит.

Sadler

03.05.2017 12:46Полносвязная сеть сейчас практически нереализуема для количества нейронов более 1 млн.

Поэтому на практике используют различные топологии, более эффективные в решении конкретной задачи.

1 млн нейронов слишком мало для AI.

Раньше Вы утверждали, что есть некое ключевое отличие, а теперь всё свелось лишь к недостаточности числа нейронов. Все это знают, проблему решают по-разному, в т.ч. и снижением связности. У нас с Вами, вероятно, разные требования к AI, у меня нет желания «делать AI умнее человека», мне нужно, чтобы алгоритм успешно решал мои практические задачи, а не рефлексировал относительно собственного бытия.

mtivkov

03.05.2017 14:37Мы пишем комментарии к статье с определенной темой. Статья — о том, что есть хорошие наработки решения узких задач, но...

приведут ли они нас к настоящему, полному ИИ, к обобщённому интеллекту, или ОИ? Вряд ли – и вот, почему.

Лично я согласен с автором статьи, что набор решенных узких задач — это не предел наших пожеланий к AI.

От AI хочется большего, чтобы он как минимум мог учиться (intelligence = the ability to acquire and apply knowledge and skills) в произвольной области, не ограниченной наперед небольшим набором правил. Т.е. чтобы AI мог воспринимать новые правила и факты без помощи человека, мог самостоятельно сформировать себе под эти правила внутреннюю вспомогательную нейросеть.

И в своем первом комменте я указал, что человек умеет это делать, а текущие реализации узких AI — нет.

Раньше Вы утверждали, что есть некое ключевое отличие, а теперь всё свелось лишь к недостаточности числа нейронов.

Ключевое отличие — в том, что мозг умеет перестраивать связи между нейронами, а железные нейросети — нет.

Далее вы сказали, что полносвязная сеть решает проблему, а я возразил, что практически — таки нет, из-за появляющегося жесткого ограничения на количество нейронов, которое нам доступно при имеющихся объемах памяти.

У нас с Вами, вероятно, разные требования к AI, у меня нет желания «делать AI умнее человека», мне нужно, чтобы алгоритм успешно решал мои практические задачи, а не рефлексировал относительно собственного бытия.

Исходная статья и мои комменты относятся к теме выхода AI за пределы узких предопределенных задач.

Sadler

03.05.2017 14:49Есть идеи, по какому принципу генерировать новые связи, за исключением случайного подключения с сохранением критичных для решения задачи связей?

mtivkov

03.05.2017 16:08Я бы попробовал так.

Основа — сеть с уже хорошей связностью.

К ней — дополнительные связи, которые могут создаваться и разрушаться, в количестве сравнимом с фиксированными связями.

Нужна будет функция, определяющая важность (вес) связи.

Связь уничтожаем, когда её вес мал.

Сложнее будет решить, где создавать новые связи.

Все же, если их все создавать полностью случайным образом, то прогресс обучения может оказаться слишком медленным.

Хорошо бы определить правило поиска ключевых нейронов (или их групп), от которых пойдут новые связи. Концы для новой связи можно уже пробовать выбирать случайно.

Если такого правила нет, то периодически можно "равномерно" разбрасывать по сети немного случайных связей.

Если новые связи приобрели большой вес, то докидываем рядом к ним еще — соединяем соседние нейроны.

Sadler

03.05.2017 17:12Все же, если их все создавать полностью случайным образом, то прогресс обучения может оказаться слишком медленным.

Можно подключать только нейрон с максимальными значениями ошибки в слое (получаем при backprop).

На самом деле лично мне сложнее придумать, как уничтожать ненужные связи (кроме откровенно нулевых, что бывает не так часто): для этого в худшем случае придётся сохранять состояние сети, обрывать связь, дообучать без связи, тестировать результат, и только в этот момент мы узнаем, стоило ли разрывать эту связь. Ооочень медленно.

mtivkov

03.05.2017 18:40Для специализированных сетей обрывы ведут к ухудшению, это понятно.

Но если это механизм для "сознания" AI, которое будет подключать в работу другие нейросети, которое исходно обладает большой собственной (неразрушаемой) связностью, то может небольшое временное ухудшение даже ни на чем и не скажется?

По-моему не надо тестировать результат и откатывать к предыдущему состоянию этот блок AI.

Для него нормально постоянно быть в изменении, он же не должен идти к стабильному наилучшему состоянию, как AlphaGo или сеть распознавания породы котиков на картинках.

cepera_ang

27.04.2017 12:40Ключевое различие в этом и только? Да в нейронных сетях от нейронов мозга — одно название и очень-очень далёкое влияние на общую идею. Если бы называли их как есть — вычислительные графы, то давно бы уже перестали с мозгом сравнивать в плане устройства.

А мозг — это и есть вычислитель, заточенный на одну задачу. Просто много разных кусочков решают разные задачи и часть из них решает узкую задачу «как обеспечить совместное решение узких задач для достижения более широкой»

mtivkov

27.04.2017 12:46Отличие весьма существенное для процессов обучения.

Можно не называть его ключевым, какая разница.

realbtr

27.04.2017 13:18Вопросы поднимаемые вполне традиционно. Можно ли называть слабый интеллект — интеллектом? Достаточно лишь когнитивных функций?

Однако, эти вопросы действительно необходимо задавать. И то, что отвечать на эти вопросы сложно и неудобно, не значит, что от них можно отмахнуться.

Что такое смысл? Можно долго рассуждать и приводить рассуждения других людей прошлого и настоящего.

Но каждый человек вполне отличает смысл от бессмыслицы. Смысл, это когда есть некая ясность понимания. Что-то является определенным. В сочетании символов «МАМА» мы обнаруживаем смысл, а в сочетании «ФХЩЫ» нет (если исключить извращения, остаться в чисто бытовых, повседневных рамках).

Понимание — это определенность соответствия признаков чему-то уже знакомому. То есть мы обобщаем признаки и понимаем, что ранее их уже обобщали.

Системы выявления и обобщения признаков — это хорошее, годное направление исследований ИИ.

Семантический разрыв, это конечно же не только проблема масштаба. Сейчас нет полной академической определенности, достаточно ли уже существующих методов выявления признаков и их обобщения для преодоления семантического разрыва простым накоплением уровней обобщения или нет.

Но, есть надежда, что принципиально новых методов не потребуется. Технические решения — да.

Но само определение понимания как двух функций выявления признаков и их обобщения вряд ли претерпит существенные изменения.

Можно вполне заявить — функциональные требования определены. Необходимы подходу к их технической реализации.

Разумеется, многие исследователи по своему могут видеть проблему сознания и понимания, проблему рассудка и рассудочной деятельности, саму проблему поведения (осознанного поведения, т.е. поведения выводящего новые способы действия, в отличие от автоматического повторения уже сложившихся шаблонов)

Условно говоря, пока мы видим исследования уровня шагохода-гексапода (и размышления об эмерджентности сознания или хотя бы некоторого набора феноменов, обычно связываемых с сознанием).

То есть сегодня исследователи проблематики общего (автономного) ИИ занимаются интеллектом масштаба таракана/мухи.

Но по мере вылизывания принципов и способов их реализации, можно предположить, что на подходе котики. Маленькие. Слепые. Но уже с поведением, развивающимся и адаптирующимся и с отражением некой воспринимаемой объективно и субъективно картины окружающего мира.

Hellsy22

С таким подходом и у людей интеллекта нет.

geisha

А откуда у кучки белков, клетчатки и другой органики возьмется интеллект? Вопрос к автору оригинального текста, конечно.

charypopper

Здравствуйте. Не могли бы пояснить? наука вроде этим и занимается, описывает явления физического мира, и открытые вопросы конечно интересные, но многое и объяснено, проделан путь в несколько тысяч лет и тд

qw1