Всем привет! Ниже вас ждет история о том, как покупка лампы обернулась приездом одной из самых долгожданных новинок в сфере СХД — массива Pure Storage. Осторожно, много фото!

Эта история началась с того, что наша милая PR-менеджер Галя заказала на AliExpress ночник. Ну, знаете, такую небольшую лампу, призванную создавать ощущение уюта по ночам.

Через месяц ей доставили вот такую коробку:

Галя даже поднять её не смогла — пришлось звать нас с тележкой:

Открыв коробку, мы немало удивились — это же первая в России демо-система СХД Pure Storage FlashArray, модель //m20 с 38 Тб Flash (почему – читайте здесь)!

Как говорится, шутки в сторону, давайте рассмотрим полученный аппарат. Массив состоит из двух контроллеров в одном шасси высотой 3U. Модули SSD устанавливаются в контроллерное шасси pack’ами по 10 модулей. Дополнительные дисковые полки тоже состоят из двух pack'ов. m20 расширяется до 40 SSD-модулей, ниже мы подробно расскажем о них.

При объёме SSD-модуля в 7 Tб и при включенной дедупликации с компрессией можно получить на почти базовой модели более 250 TБ эффективной емкости. Неплохо.

Массив Pure Storage m20 без передней панели:

Конкретно в наш массив установлен один capacity pack из 10 модулей SSD по 3,8 Tб каждый. Это дает чуть меньше 21 Тб места для уникальных данных, или 63—100 Тб с учетом технологий дедупликации и сжатия.

Коробку при транспортировке немного помяли, на производительность массива это не повлияло. Почта России с AliExpress — что поделать. Хорошо еще, что в почтовый ящик не засунули :)

И вот, наконец, мы приступили к «вскрытию». Массив упакован качественно, на фото видно подробную инструкцию по установке.

Посередине лежит коробка с лицевой панелью, справа — с кабелями питания и KVM.

Распаковываем коробки, достаём лицевую панель и монтажные рельсы:

«Ну и лампа! — недоумевает Галя. — Куда же я такую поставлю?»

m20 R2 упакован в полиэтилен, для дополнительной защиты лицевая часть массива защищена картоном.

На лицевой стороне, помимо SSD-модулей, расположены модули NVRAM. В m20 R2 устанавливается два NVRAM по 8 Гб каждый. NVRAM и SSD закручиваются винтами со шлицем torx, что предотвращает возможность случайно достать не тот модуль.

Ребята даже отвертку специально для этого приложили!

Выдвижная бирка с серийным номером — удобное решение. К сожалению, встречается не на каждом сервере или СХД.

Откручиваем винты и достаём NVRAM и SSD-модули.

NVRAM-модуль отдельно. Как видно, много места в контроллерном шасси он не занимает.

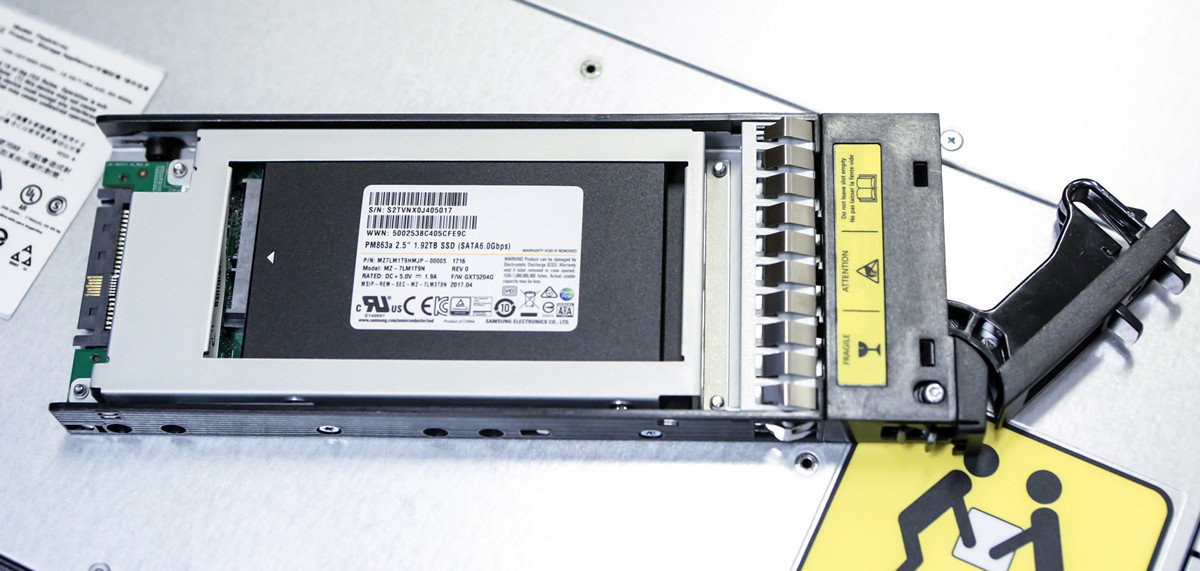

Обещанный SSD-модуль объёмом 3,8 Тб вблизи. На самом деле он состоит из двух SSD-дисков Samsung PM863a, каждый объёмом 1,92 TБ. Диски выполнены по технологии V-NAND.

Производителем Pure Storage заявлен выпуск новых моделей СХД с дисками NVMe. После выхода новых моделей можно произвести обновление имеющейся m20 R2 до NVMe без потери данных. Отвечает за такой апгрейд технология Pure EverGreen, позволяющая «на ходу» модернизировать любой контроллер в старшую модель.

А вот так выглядит массив сзади:

Слева видны два блока питания, остальное пространство занимают два контроллера m20 R2.

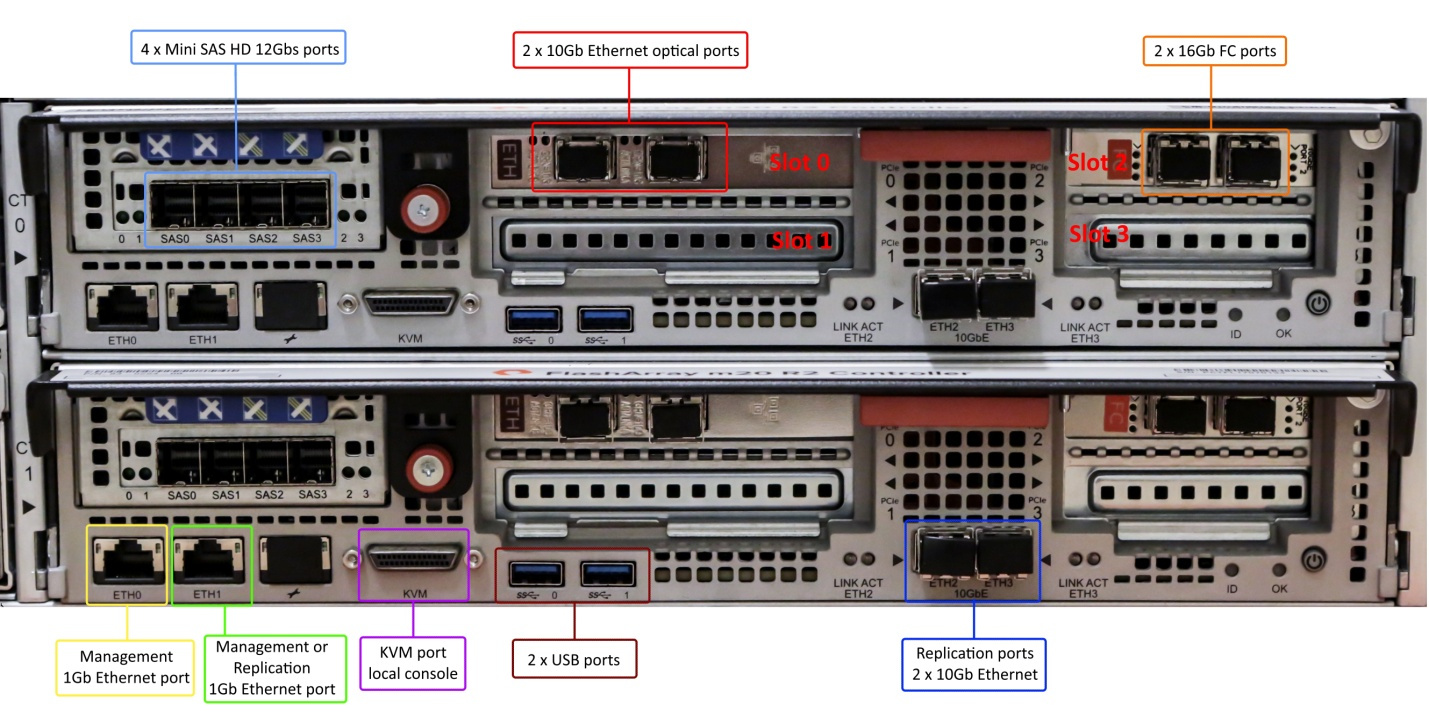

Давайте подробно рассмотрим порты массива:

Для подключения дисковых полок используются порты Mini SAS HD, работающие на скорости 12 Гбит/с.

Для управления массивом предназначены порты 1 Гбит Ethernet ETH0. Порт 1 Гбит Ethernet ETH1 можно использовать как для управления, так и для репликации.

Порты ETH2 и ETH3 (10 Гбит Ethernet optical) — только для репликации. В массивах Pure Storage доступна асинхронная репликация, а также построение катастрофоустойчивого хранилища — ActiveCluster. ActiveCluster реализует синхронную репликацию логических томов массивов в режиме Active/Active, то есть операции чтения/записи можно производить на реплицируемые логические тома обоих массивов одновременно.

Порты FC работают на максимальной скорости 16 Гбит/с. Для портов Ethernet (iSCSI) доступна скорость в 40 Гбит/с — таким образом, порты ввода/вывода больше не будут узким местом массива.

Тем временем Галя пытается понять, как же включить эту чертову лампу:

Достаём контроллер из шасси:

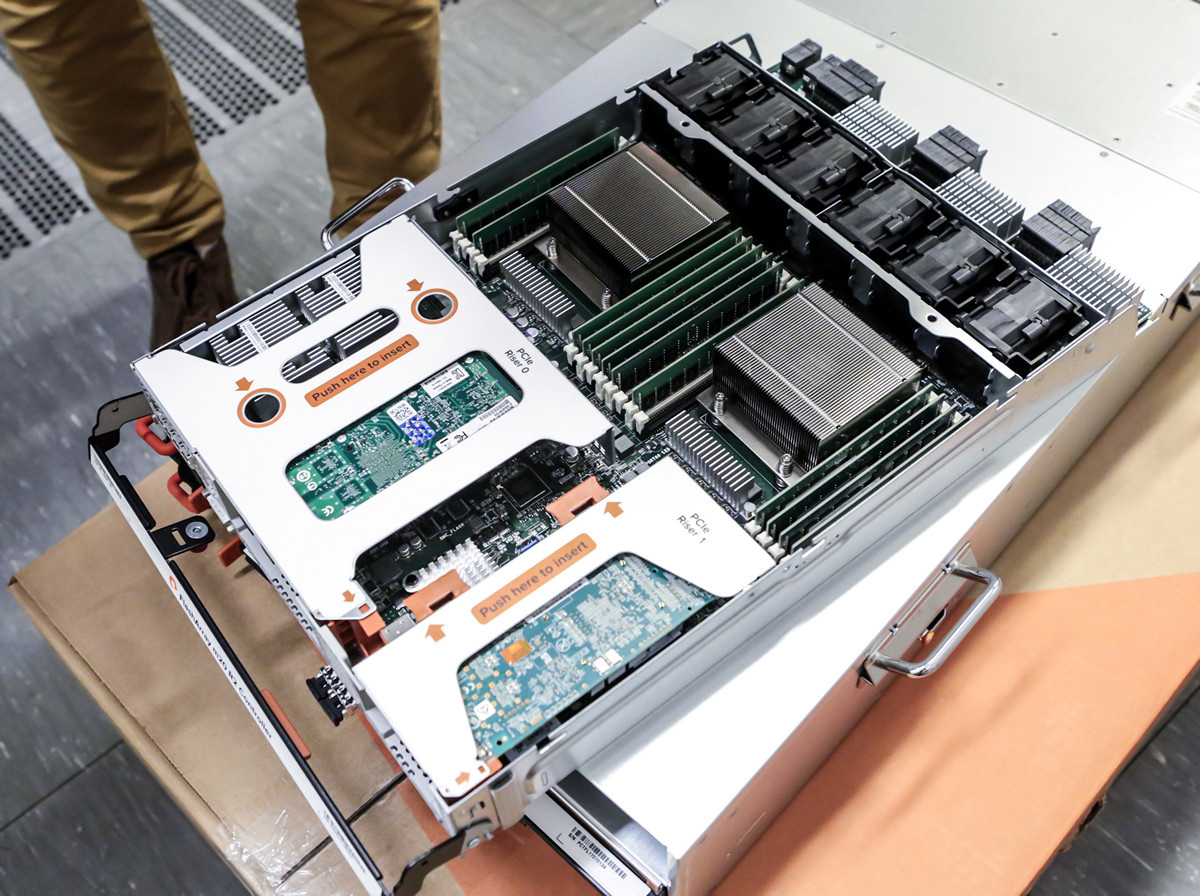

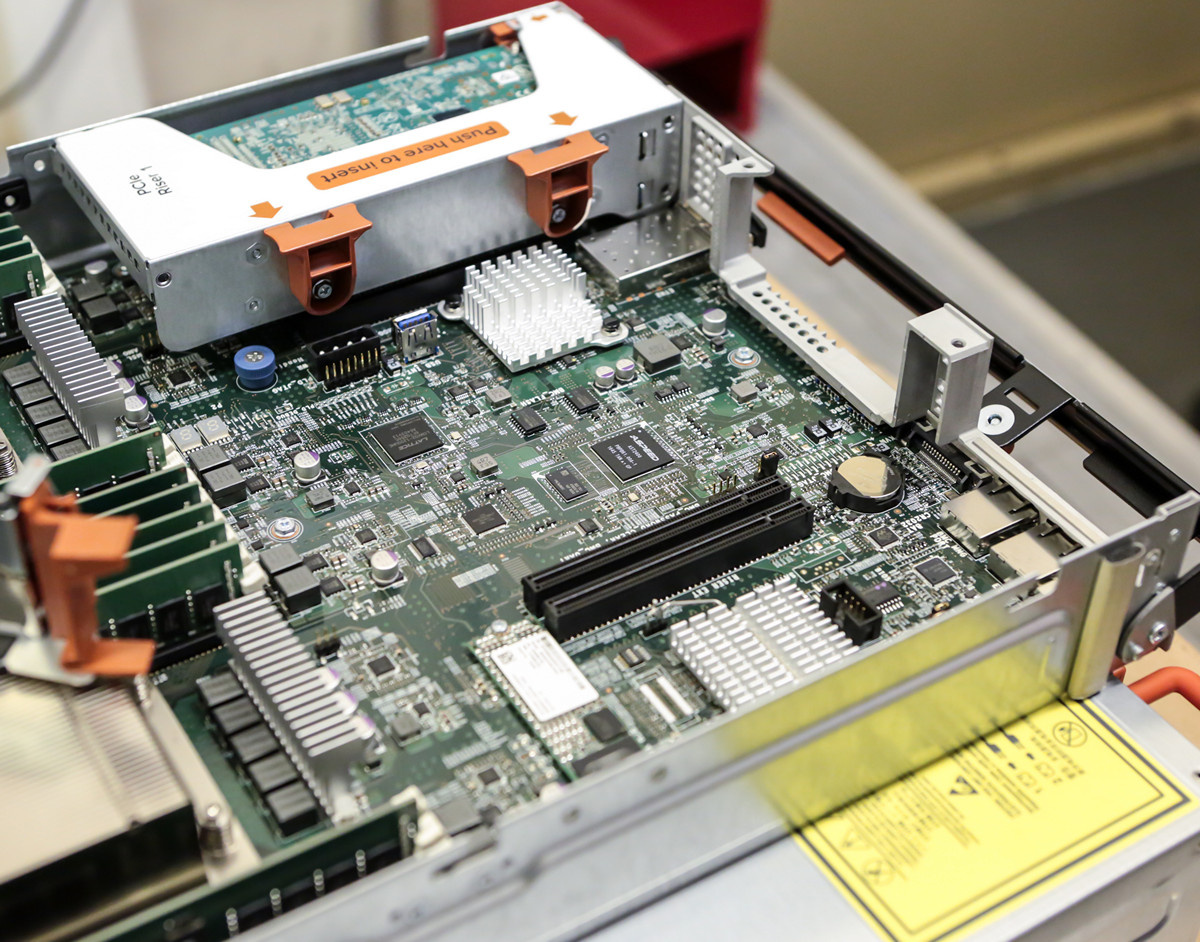

Контроллер m20 R2 без крышки выглядит вот так:

В каждом контроллере установлено по два CPU Intel Xeon. Далеко не каждый All-Flash массив (особенно младших моделей) может похвастаться двумя процессорами на контроллер.

Справа видны back-end порты подключения контроллера к общей шине, рядом установлена система охлаждения (занимает всю ширину контроллера), слева — карты портов ввода/вывода. Далее мы рассмотрим всё это подробнее.

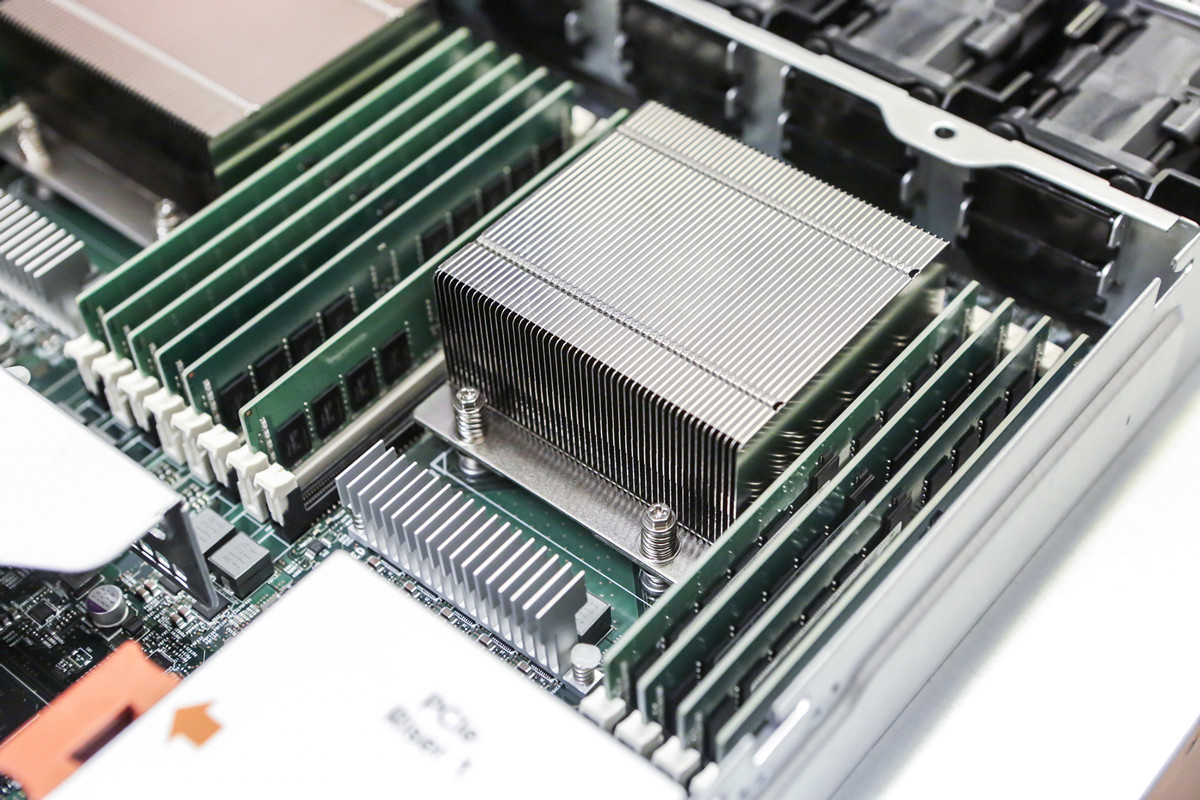

Процессор и RAM контроллера крупным планом:

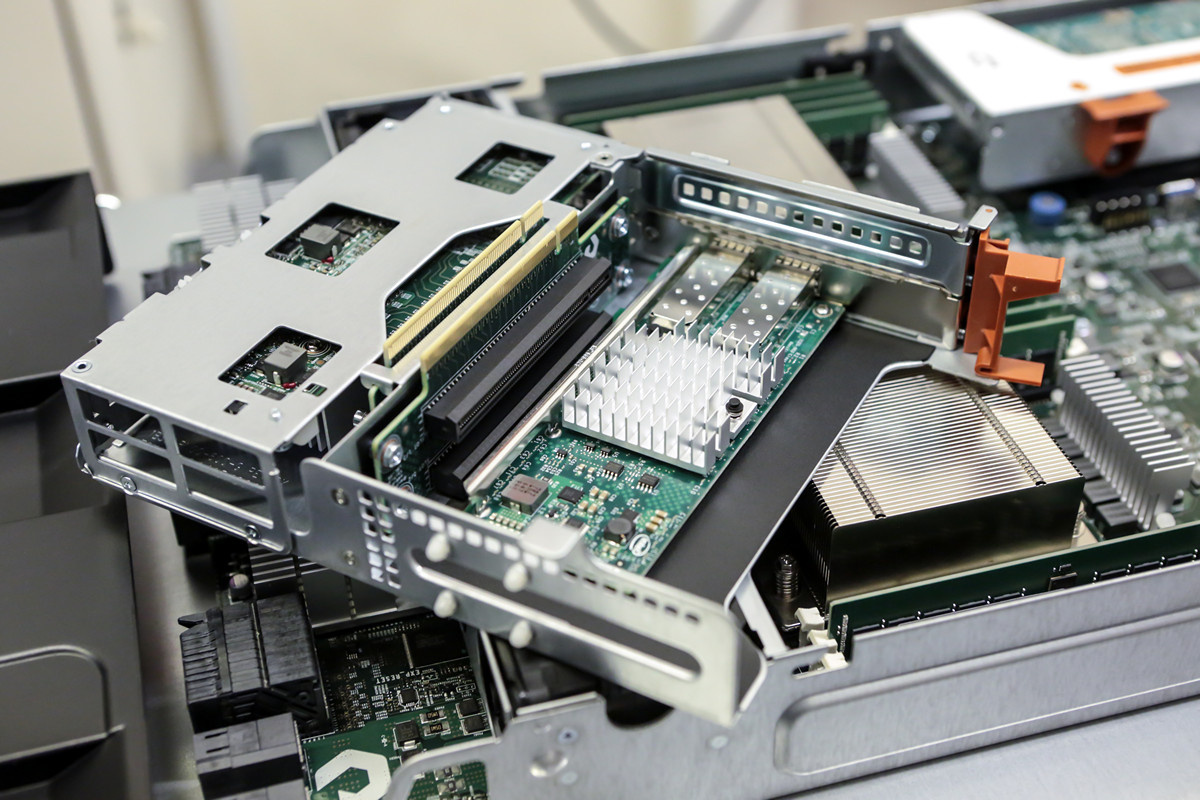

Снимаем карту с портами ввода/вывода 10 Гбит Ethernet. Компоненты монтируются/демонтируются удобно, ничего не мешает.

Посадочное место карты ввода/вывода и её разъём подключения:

А вот сама карта ввода/вывода с портами 10 Гбит Ethernet:

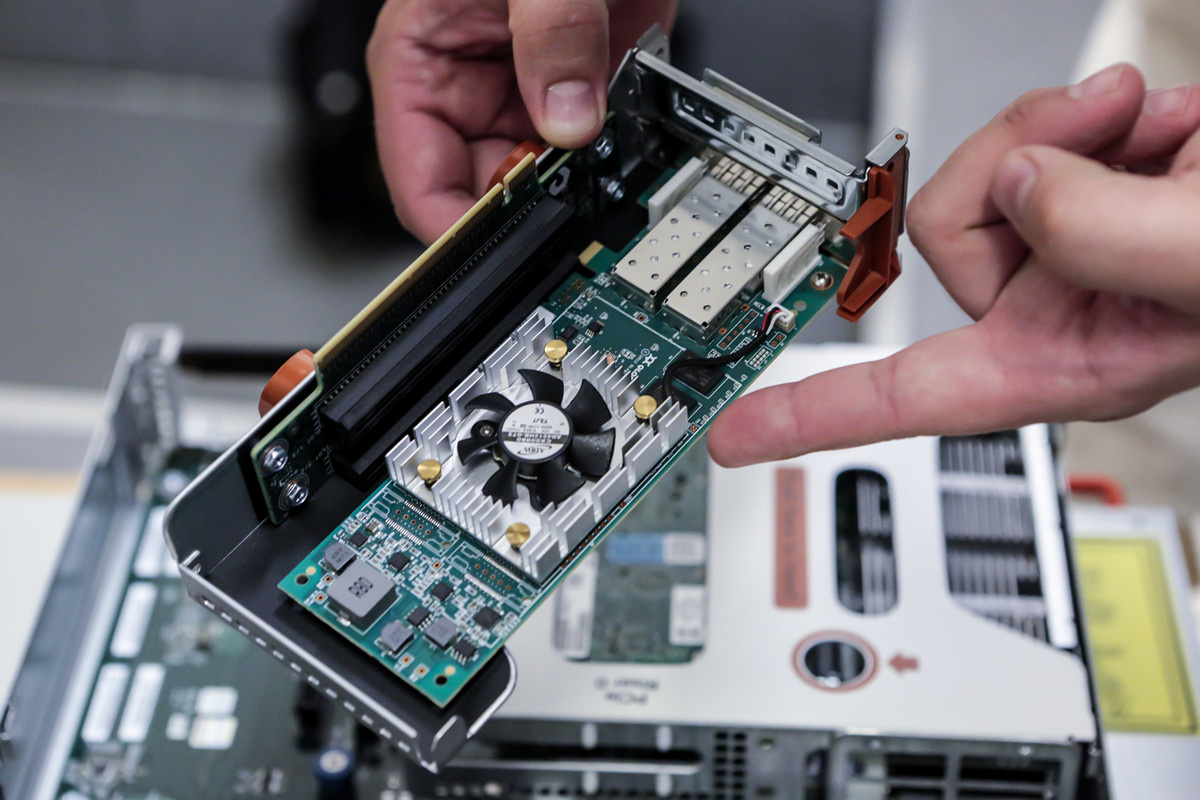

Обратите внимание, карта FC 16 Гбит/с имеет собственную систему охлаждения:

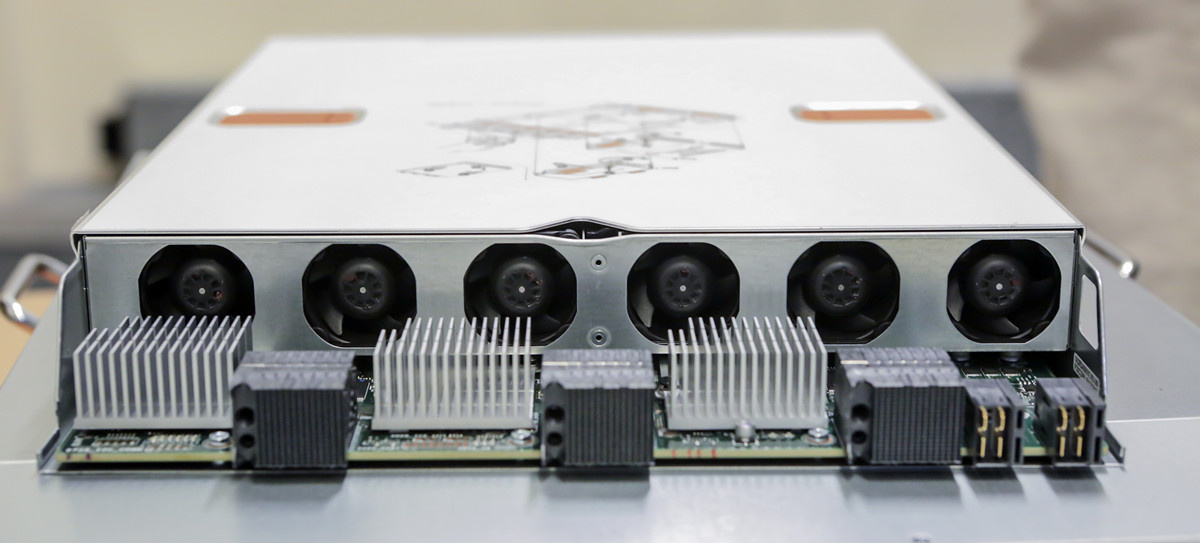

Back-end порты контроллера с системой охлаждения:

Устанавливаем контроллер на рабочее место:

Блоки питания мощностью 1200 Вт совмещены с вентиляторами. Недлинные, много полезного места в контроллерном шасси не занимают.

Блок питания крупным планом:

Консольный (KVM) кабель имеет множество портов для подключения:

Перейдём непосредственно к монтажу. Pure Storage использует оригинальные ручки для переноски массива. В процессе монтажа они отстёгиваются (главное — потом их не потерять).

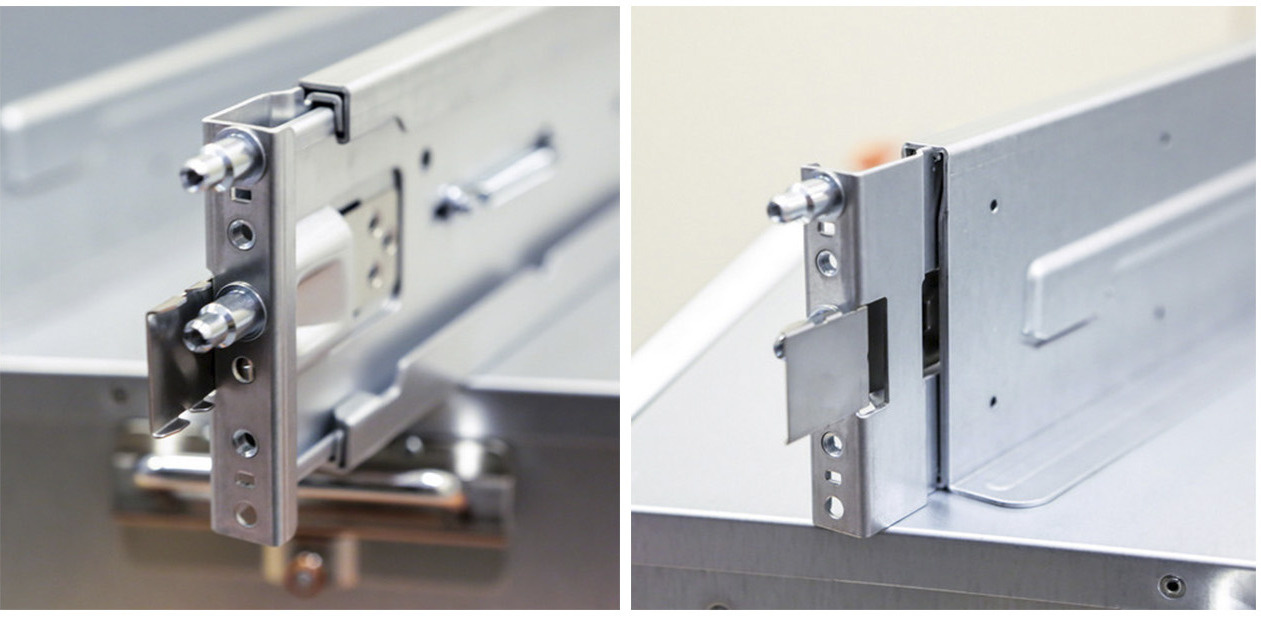

Крепления монтажных рельс выполнены новаторским способом:

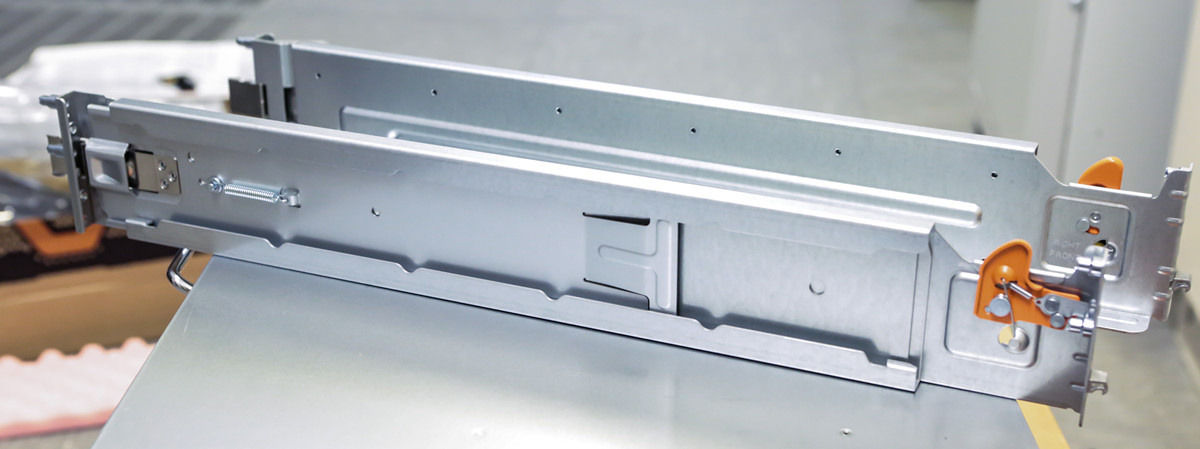

Монтажные рельсы целиком:

Удобнейшие защёлки на монтажных рельсах, весь монтаж не займёт больше 2 минут.

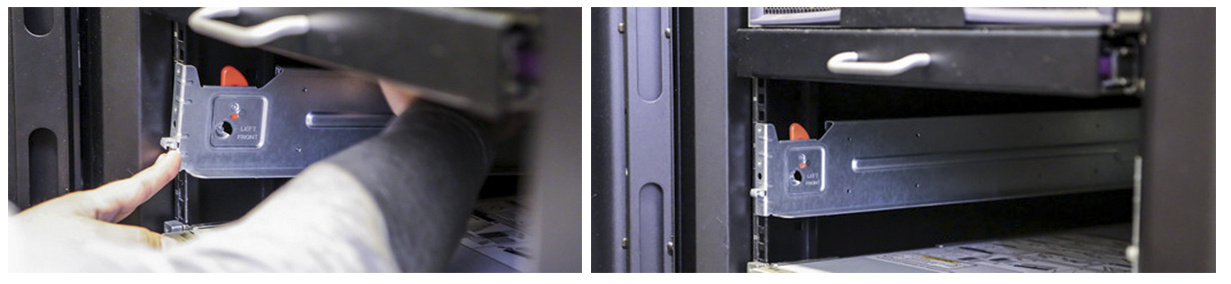

Устанавливаем массив в стоечный шкаф вдвоём, всё строго по инструкции :)

Pure m20 R2 в стоечном шкафу без лицевой панели…

… устанавливаем лицевую панель — массив готов к включению!

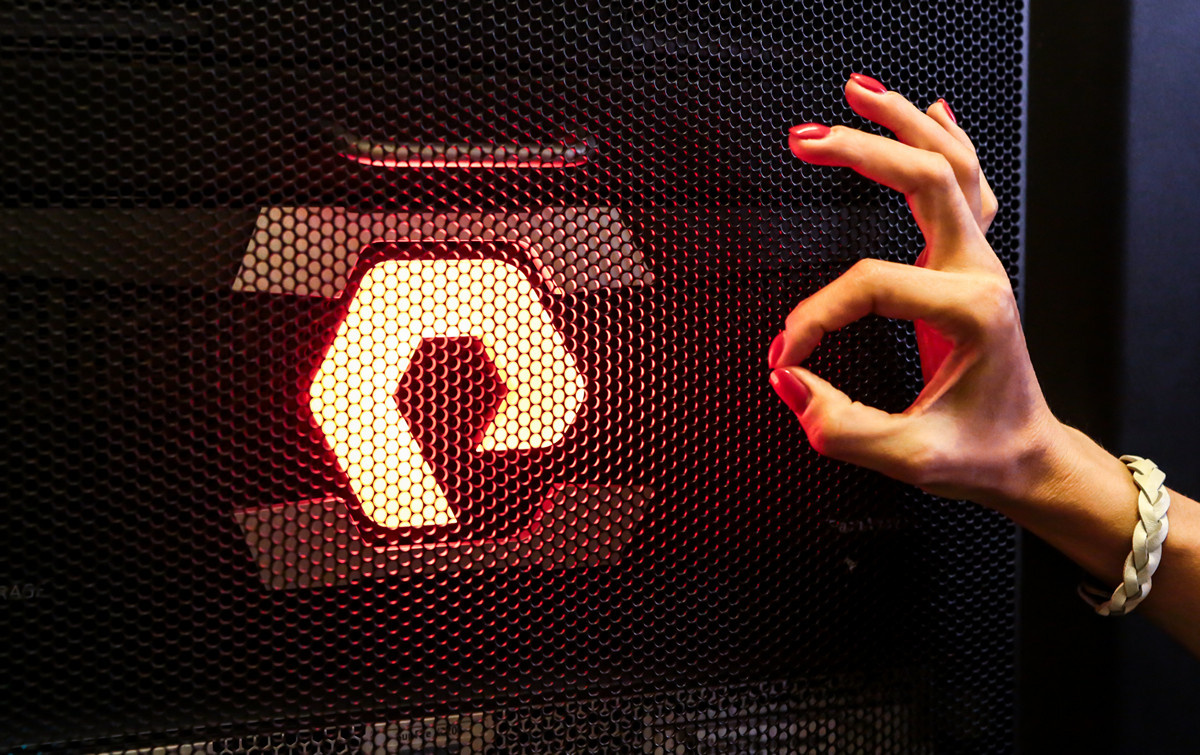

Первый в России массив Pure Storage включен!

Дизайн и подсветка лицевой панели яркие, очень выделяются в ряду шкафов. Сразу видно, что вы владелец Pure Storage.

С закрытыми дверьми выглядит еще лучше:

«Шумноват ночник. Но светит хорошо!» ;)

Кажется, Галя довольна!

Специалисты по системам хранения данных, компания «Инфосистемы Джет»

UPD. Коллеги, сейчас система проходит функциональное и нагрузочное тестирование. Следующая статья будет с техническими результатами, графиками и цифрами.

Комментарии (35)

helpik94

05.09.2017 12:09+2Вот бы и мне вместо очередной ерунды с Aliexpress привезли что-нибудь подобное

KorP

05.09.2017 12:22Даже не знаю, мне больше Галя или Pure Storage понравилась… надо больше фоток Гали, точно!

AlexxSys

05.09.2017 14:27+1+++ Рядом с Галей, даже Pure Storage становиться серой невзрачной жестянкой…

AntonVirtual

05.09.2017 14:58+3Пиар пиарщицы Гали затмил пиар Pure Storage, который пиарщица Галя, по идее, и должна была пиарить…

AntonVirtual

05.09.2017 12:25+221TB форматированного пространства = 63-100 TB с компрессией?

Это означает, что Pure гарантирует 3-5x компрессию или это творчество Jet?

Simplivity обещает 10x компресиию*

* При условии, что вы будете хранить пачку снапшотов и бэкапы на той же системе, и каждый из них считать за полный объем данных, и при этом измененных данных не более, чем 3% в день.

У Pure тоже есть такие условия для красивых цифр?

Pinkkoff Автор

05.09.2017 12:44+1средний коэффициент эффективности на всей базе массивов Pure около 5:1. Посмотреть его можно здесь.

Насчет гарантий происходит следующим образом: на этапе предложения заказчик говорит, какие данные будет хранить на массиве (например, VMware 30ТБ, Oracle 15ТБ). Затем Pure высчитывает коэффициент (например, для VMware 5:1, для Oracle 3:1, общий 4:1). В этом случае Pure Storage обещает юридически его гарантировать. Никаких снепшотов и бэкапов с нас не требовал.

Но на нашей тестовой системе мы ничего определенного не храним, поэтому к нам гарантии не применимы) Пробовали на vdbench лить данные с коэффициентом дупликации 6:1 и сжатия 2:1, массив корректно все пожал до 12:1.

Скоро будем пробовать на реальных данных.

Taciturn

05.09.2017 14:30+2Что вообще значит «VMware»? Например если сделать виртуальную машину на все 30 терабайт и занять всё место неповторяющимся сжатым видео это «VMware» или уже нет?

Pinkkoff Автор

05.09.2017 15:00Вы правы, зашифрованные и уже сжатые данные не учитываются, иначе так бы все покупали маленькую железку и бесплатно её расширяли=)

MMik

05.09.2017 15:07-1Это средние коэффициенты, которые Pure собирают с клиентов, для разных типов нагрузок (workload'ов). В случае с 30TB неповторяющегося сжатого видео коэффициент конкретно для этого куска данных будет 1:1, что ухудшит показатель коэффициента эффективности всего фрейма.

Alexeyslav

05.09.2017 13:44+1Купи ночник за 10000$ и получи Storage в подарок…

Iliya_karin

05.09.2017 14:32Не знаю как насчёт первый в России, первый с FC возможно, я уже 3 недели гоняю в хвост и гриву наш Pure на iscsi. В моем случае дедуп составил 1.4, но моя фска уже была задедуплена с помощью ms deduplication, а раздедупить уже не так просто.

Pinkkoff Автор

05.09.2017 14:40+1Да, прошу прощения, в статье была ошибка. Это первая и пока единственная демо-система в России, одному из заказчиков (видимо, вам) система пришла чуть раньше.

В статье исправили.

Iliya_karin

05.09.2017 14:48+2Мы начали проработку проекта перехода на Pure когда был ещё жив ныне покойный (в России) Violin, так что да путь к Pure был тернист и очень долог, нашу железяку мы получили еще 3 августа.

Железякя конечно потрясающая, очень простая, но очень эффективная. Кстати возможно увидимся 19 числа ;), могу поделиться опытом про iscsi.

Pinkkoff Автор

05.09.2017 14:58+1Супер, с удовольствием послушаю про опыт!

Меня можно будет найти рядом с этой системой, мы предоставляем её на мероприятие=)

amarao

05.09.2017 16:07+2Монтаж — это важно. Чтобы потребители СХД делали без компании, которая умеет прикручивать винтики в стойку?

(hint: это хабр. Рассказываете по СХД, рассказывайте. А так — unboxing 19" фигни. Ну фигня, и что?).

CherryPah

05.09.2017 16:19+1поставили бы коробку с ним посреди офиса и кидали в нее данные в надежде что они запишутся и дедуплицируются

netwatcher

05.09.2017 16:25а можно ссылочку на Ali, где такие ночники продают? ;) я бы взял парочку домой.

nokogerra

05.09.2017 19:46Про массив не узнал ничего, кроме того, что он, вроде, архитектурно неглупо выполнен. Как, собственно, и у любого приличного вендора. Ни фич, ни цен с лицензированием, ни описания менеджмент интерфейса. Зато есть упоминание про какой-то дедуп рэйт (который часто воображаемый, т.е. маркетинговый). В продуктивной схд дедуп, кажется, не самая популярная вещь, по крайней мере для плебеев вроде меня, которым кажется что i/o потенциал важнее дедупликации. Импакт же все таки должен быть? Хотя я, конечно, не специалист, а просто наблюдатель. Однако, когда видишь статью про первое xxx в Россиии, хочется прочитать про что-то, кроме монтажа.

Зато на девушку посмотрел и на лисов в комментариях. Как будто имэдж борду какую-то посетил.

MMik

06.09.2017 01:43+1All-flash массивы практически все с дедупликацией и компрессией, и плюс ещё с переподпиской (overallocation/overprovisioning, достигаемой за счёт thin provisioning'а на стороне СХД). На практике фактический коэффициент дедупликации + компрессии (k) плавает от 3:1 до 10:1 (изменяется прямо в процессе работы, в зависимости от типа хранимых данных), типичная переподписка (для VMware workload'а) – от 5 до 10-кратной.

Из-за такой вариативности требуется:

а) постоянно следить за свободным местом

б) быть готовым вовремя купить и подключить новую дисковую полку, или поменять модули flash дисков на более объёмные

в) иметь резерв объёма

г) анализировать архивные данные и прогнозировать уменьшение свободного места на СХД

В фрейме (шасси) есть два active/active контроллера и встроенный сторадж в двух секциях. Минимальная конфигурация – 5TB RAW (умножьте на k), и до 2x76TB RAW. К контроллёрам фрейма по 12Gbit/s SAS подключается до 4х дисковых полок, в каждой из которых две секции с объёмом от 11 до 90TB RAW.

Максимальная ёмкость массива – 2x76+4x2x90 = 872TB RAW, что при среднем k=5 даст вам ~4.3PB в одном массиве в 11U, но почему-то в спецификациях пока подтверждают max RAW 512TB.

Внутри прошивки есть GPL/BSD/Apache и прочий Open Source код.

Цены – в хорошем случае $1.5/GB (с учётом k, и без переподписки) для all-flash СХД для разных массивов энтерпрайз класса. Сильно зависят от скидок, объёмов поставок, подписок, включенных фич (напр. репликация сразу удвоит цену), и пр. пр. По-этому о цене сходу сложно говорить, и сравнивать «в лоб» два ценника на два решения без детализации поставляемого решения тоже сходу не получается.

Наценка реселлера, например, может быть 15% на железо и 10% на контракты техподдержки. Скидки могут быть тоже самыми разными: и 13%, и 40%. Посмотрите на вот этот прайс-лист, например.

Менеджмент интерфейсы – Web (демо), RESTful API, CLI, PowerShell, Python SDK (напр. для работы в бэкэнде OpenStack Cinder). I/O интерфейсы – 10 и вроде 40Gbit/s iSCSI (для клиентов и для репликации), 8 и 16Gbit/s FC.

I/O потенциал не страдает от дедупликации и компрессии, так как в случае с Pure эти задачи выполняются на одном контроллере, а production I/O на другом.

В целом, по характеристикам all-flash массивов посмотрите этот документ. Он не сильно устарел.

MMik

06.09.2017 14:48Два дополнительных бонуса:

1) при правильно сделанном мониторинге и резерве вы можете больше не заниматься ручной группировкой данных одного типа на одном фрейме ради повышения k, а спокойно писать что попало куда попало

2) можете забыть про RAID вообще, и про RAID group, RAID set, disk group, parity set в частности, как про страшный сон

charypopper

05.09.2017 20:18Не понимаю. Только я люблю сводные таблицы, ссылки на производителя и подобный "сахар" в статьях...

Pinkkoff Автор

05.09.2017 23:26-1amarao nokogerracharypopper

Коллеги, аудитория Хабра очень разная. Кому-то нравится копаться в конфигах vdbench, кому-то смотреть на unboxing интересной коробки с дисками.

Сейчас система тестируется, следующая статья будет с цифрами, графиками, интерфейсом и прочим. Все сделаем.

master65

Pult это ты?

Pinkkoff Автор