Сегодня об искусственном интеллекте не пишет только ленивый. Например, в Autodesk считают, что искусственный интеллект может учитывать гораздо больше факторов, чем человек, и, таким образом, давать более точные, логичные и даже более креативные решения сложных проблем. В Оксфордском университете вообще высказывают предположения о том, что искусственный интеллект в недалеком будущем может заменить штатных журналистов и писать за них обзоры и статьи (и того и гляди выиграет Пулитцеровскую премию).

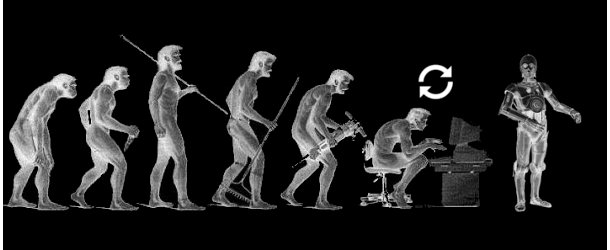

Общее увлечение темой искусственного интеллекта давно вышло за рамки научных конференций и будоражит умы писателей, кинематографистов и широкой общественности. Кажется, что от будущего, в котором роботы (или Скайнет) правят миром или, как минимум, решают большую часть повседневных задач, рукой подать. Но что по этому поводу думают сами ученые?

Для начала стоит разобраться с термином «искусственный интеллект»: слишком много существует на эту тему домыслов и художественных преувеличений. В этом вопросе лучше всего обратиться к автору этого термина (и по совместительству создателю языка Лисп и лауреату множества премий) – Джону Маккарти. В статье с одноименным названием («Что такое искусственный интеллект?») Маккарти приводил следующее определение:

Это наука и технология создания интеллектуальных машин, в особенности – интеллектуальных компьютерных программ. Искусственный интеллект связан с задачей использования компьютеров для понимания работы человеческого интеллекта, но не ограничивается использованием методов, наблюдаемых в биологии.

Получается, что искусственный интеллект и интеллект «человеческий» тесно связаны? Не совсем так – сам Маккарти подчеркивал: если интеллект «вообще» – это «вычислительная» составляющая того, что помогает субъекту достигать заданных целей, тогда интеллект человека, животных и машин будет работать по-разному.

Выходит, что искусственный интеллект – это не подобие человеческого, хотя многим футуристам, писателям и даже ученым хочется верить в то, что это не так. Об этом часто повторяет Майкл Джордан, почетный профессор Калифорнийского Университета в Беркли. Он считает, что недостаточное понимание того, что же представляет из себя искусственный интеллект, приводит не просто к созданию «красивых образов», не связанных с реальной наукой, а к самой настоящей дезинформации и разного рода мифам, процветающим в этой области.

Миф первый: для создания или усовершенствования искусственного интеллекта надо разобраться с тем, как работает человеческий мозг

Джордан утверждает, что это вовсе не так. Работа искусственного интеллекта, как правило, не имеет ничего общего с тем, как устроен интеллект человека. Этот «миф» глубоко укоренился из-за пристрастия общественности к «красивым идеям»: авторам научно-популярных статей об искусственном интеллекте пришлись очень по душе метафоры, взятые из нейробиологии.

На самом деле нейробиология имеет очень опосредованное отношение (или вообще не имеет никакого отношения) к работе искусственного интеллекта. Для Майкла Джордана идея о том, что «для глубинного обучения нужно понимание того, как обрабатывает информацию и учится человеческий мозг», звучит как откровенная ложь.

«Нейроны», задействованные в глубинном обучении – это метафора (или, выражаясь языком Джордана, вообще «карикатура» на работу мозга), которая применяется только для краткости и удобства. В действительности же работа механизмов того же глубинного обучения гораздо ближе к процедуре построения статистической модели логистической регрессии, чем к работе настоящих нейронов. При этом, никому не приходит в голову для «краткости и удобства» использовать метафору «нейрона» в статистике и эконометрике.

Миф второй: искусственный интеллект и глубинное обучение – последние достижения современной науки

Мнение о том, что «думающие как человек» компьютеры будут сопровождать нас в недалеком будущем, напрямую связано с идеей, согласно которой искусственный интеллект, нейронные сети, глубинное обучение являются достоянием исключительно современной науки. Ведь если допустить мысль о том, что все это было придумано десятилетия назад (а роботы к сегодняшнему дню так и не захватили мир), «порог ожиданий» от научных достижений вообще и скорости их развития в частности придется серьезно снизить.

К сожалению, СМИ стараются сделать все возможное, чтобы подогреть интерес к своим материалам, и очень избирательно относятся к выбору тематик, которые, по мнению редакторов, вызовут интерес у читателей. В итоге описываемые ими достижения и их перспективы оказываются гораздо более внушительными, чем реальные открытия, а часть информации просто «аккуратно опускается», чтобы не снижать накала страстей.

Многое из того, что сейчас преподносят «под соусом» искусственного интеллекта, является просто переработанной информацией о нейронных сетях, которые известны человечеству с 80-х годов.

А в восьмидесятые все повторяли то, что было известно в 1960е годы. Такое чувство, что каждые 20 лет проходит волна интереса к одним и тем же темам. В нынешней волне главной идеей является сверточная нейронная сеть, о которой уже говорили лет двадцать назад

– Майкл Джордан

Миф третий: искусственная нейронная сеть состоит из тех же элементов, что и «реальная»

На самом деле специалисты, занятые вопросами разработки вычислительных систем, оперируют нейробиологическими терминами и формулировками гораздо смелее, чем многие нейробиологи. Интерес к работе мозга и устройству интеллекта человека стал питательной средой для развития такой теории как «невральный реализм».

В системах искусственного интеллекта нет ни спайков, ни дендритов, более того, принципы их работы далеки не только от работы головного мозга, но и от пресловутого «неврального реализма». Фактически, в нейронных сетях ничего «нейронного» нет.

Более того, идея «неврального реализма», основанная на уподоблении работы систем искусственного интеллекта работе мозга, по мнению Джордана, не выдерживает критики. По его словам, к прогрессу в сфере искусственного интеллекта привел не «невральный реализм», а использование принципов, совершенно не согласующихся с тем, как работает мозг человека.

В качестве примера Джордан приводит популярный алгоритм глубинного обучения, основанный на «обратной передаче ошибки обучения». Его принцип работы (а именно передача сигнала в обратном направлении) явно противоречит тому, как работает человеческий мозг.

Миф четвертый: ученые хорошо понимают, как работает «человеческий» интеллект

И это снова далеко от истины. Как утверждает все тот же Майкл Джордан, глубинные принципы работы мозга не просто остаются нерешенной проблемой нейробиологии – в этой области ученых отделяют от решения вопроса десятки лет. А попытки создать работающую имитацию мозга так же не приближают исследователей к пониманию того, как устроен человеческий интеллект.

Это просто архитектура, созданная в надежде, что когда-нибудь люди создадут подходящие для нее алгоритмы. Но нет ничего, что подкрепляло бы эту надежду. Думаю, что надежда основана на вере в то, что если вы построите что-то вроде мозга, то сразу станет понятно, что он может делать

– Майкл Джордан

Джон Маккарти, в свою очередь, подчеркивал: проблема не только в том, чтобы создать систему по образу и подобию человеческого интеллекта, а в том, что сами ученые не придерживаются единого мнения по поводу того, что он (интеллект) из себя представляет и за какие конкретно процессы отвечает.

На этот вопрос ученые пытаются ответить по-разному. В своей книге «Нейронные сети и глубинное обучение» Майкл Нилсен приводит несколько точек зрения. Например, с позиции коннектомики наш интеллект и его работа объясняются тем, сколько нейронов и глиальных клеток содержит наш мозг, и сколько соединений наблюдается между ними.

Учитывая, что в нашем мозге насчитывается порядка 100 млрд нейронов, 100 млрд глиальных клеток и 100 трлн соединений между нейронами, говорить о том, что мы можем «в точности воссоздать» эту архитектуру и заставить ее работать, в ближайшем будущем крайне маловероятно.

А вот молекулярные биологи, изучающие геном человека и его отличия от близких родственников людей по эволюционной цепочке, дают более обнадеживающие прогнозы: оказывается, геном человека отличается от генома шимпанзе на 125 миллионов пар оснований. Цифра большая, но не бесконечно огромная, что дает Нилсену повод надеяться, что на основании этих данных группа ученых сможет составить если не «работающий прототип», то как минимум сколь бы то ни было адекватное «генетическое описание» человеческого мозга или скорее базовые принципы, лежащие в основе его работы.

Стоит сказать, что Нилсен придерживается «общепринятого человеческого шовинизма» и полагает, что значимые принципы, определяющие работу человеческого интеллекта, лежат в тех самых 125 миллионах пар оснований, а не в остальных 96% генома, которые у человека и шимпанзе совпадают.

Так сможем ли мы создать искусственный интеллект, равный по возможностям человеческому? Получится ли у нас в обозримом будущем понять, как именно работает наш собственный мозг? Майкл Нилсен, считает, что это вполне возможно – если вооружиться верой в светлое будущее и в то, что многие вещи в природе работают по более простым законам, чем это кажется на первый взгляд.

А вот Майкл Джордан дает более близкий к практической работе исследователей совет: не поддаваться на провокации журналистов и не искать «революционные» решения. По его мнению, привязываясь к человеческому интеллекту как отправной точке и конечной цели своих исследований, ученые, работающие над проблемой искусственного интеллекта, излишне ограничивают себя: интересные решения в этой области могут лежать в направлениях, никак не связанных с тем, как устроен наш мозг (и как нам представляется его устройство).

P.S. Мы в 1cloud рассматриваем самые разные темы в нашем блоге на Хабре – пара примеров:

- Пятничный формат: Как работает Netflix

- Простыми словами: Разбираемся с «облачными» услугами

- Как облачные технологии влияют на работу дата-центров

- Немного о 2FA: Двухфакторная аутентификация

И рассказываем о собственном облачном сервисе:

Комментарии (12)

Mixim333

12.04.2016 18:28Разработка ИИ — очень интересная и перспективная задача, но у этой задачи есть две стороны — «черная» и «белая». Представьте: человечество разработало систему, которая на основе дедукции\«не систематизированной» логики может помогать человеку — Хорошо ли это? — Безусловно! Теперь представим, что «алгоритм» этой системы («алгоритм» взял в кавычки, т.к. иначе какой это ИИ) дал сбой и вместо помощи человеку, он начал ему вредить (SkyNet, привет) — машина не способна к состраданию, поэтому открыть «черный чемоданчик» и нажать «красную кнопку» в нем ей ничего не будет стоить. Нужна ли нам такая система, в безопасности которой мы можем быть уверены не более чем на 50%? — По-моему, нет. И именно поэтому такую систему еще не изобрели

mediagenia

12.04.2016 21:57+2Вы так говорите, словно человечество это некий субъект. Будто бы оно, как некий метачеловек, что-то делает и принимает решения в свою пользу.

Dobryak88

13.04.2016 13:15+3Возможно это только моё мнение, но какая разница, кто нажмёт на заветную красную точку: сбредивший правитель или сбойный алгоритм/ИИ? У искусственной логики нет не только сострадания, но и большинства человеческих пороков тоже

scifix

12.04.2016 20:38«Работа искусственного интеллекта, как правило, не имеет ничего общего с тем, как устроен интеллект человека.»

Ну допустим, что не имеет ничего общего с мозгом.А с чем тогда имеет общее — с работой двигателя внутреннего сгорания чтоли?

Если современные нейросети имеют мало общего с реальными нейронами это не значит что такой способ создания ИИ сохранится и дальше.

ilmirus

12.04.2016 21:42Как говорил Юдковский " Вы можете сделать игру привлекательней, если добавите в нее возможность явного проигрыша! Разве психология не интересна? Вот почему нет никого, кто на самом деле разбирается в чудесной сложности человеческого интеллекта и хочет при этом разработать ИИ похожий на человека."

scifix

13.04.2016 07:49Вот вы пишете «Миф четвертый: ученые хорошо понимают, как работает «человеческий» интеллект»

То, что пока не ясно как работает мозг — с этим никто и не спорит, какой смысл об этом писать.Конечно генетика важна в понимании формирования мозга, но еще более важна протеомика — взаимодействие белков.

Favorite101

13.04.2016 13:15-1Д.Маккарти подчеркивал: если интеллект «вообще» – это «вычислительная» составляющая того, что помогает субъекту достигать заданных целей.

О, вот что-то в нужном направлении — это что-то, что помогает достигать целей.

Майкл Джордан утверждает, что глубинные принципы работы мозга не просто остаются нерешенной проблемой нейробиологии – в этой области ученых отделяют от решения вопроса десятки лет.

Вот это разочаровывает… Ведь направление к пониманию задано уже в определении Маккарти: интеллект помогает достигать целей. Неужели, чтобы закончить это определение, нужны десятки лет?

masai

13.04.2016 15:33+1В качестве примера Джордан приводит популярный алгоритм глубинного обучения, основанный на «обратной передаче ошибки обучения». Его принцип работы (а именно передача сигнала в обратном направлении) явно противоречит тому, как работает человеческий мозг.

Если речь о методе обратного распространения ошибки в многослойном персептроне, то там сигнал обратно не распространяется. Просто метод вычисления ошибок на выходах нейронов находит их от выхода к входам, что похоже на обратное распространение сигнала. Когда сеть обучена и работает, то обратно и вовсе ничего не идёт.

С Джорданом я согласен, но пример не очень удачный всё же.

sim-dev

По-моему, Станислав Лем по поводу искусственного интеллекта написал гораздо больше дельного, чем упомянутые «ученые». И интереснее, кстати.

sasha1024

При всём уважении к Станиславу Лему и прочим писателям-фантастам, но то представление об ИИ, которое они развивают у читателей, очень далеко от реальности.

И именно для того, чтобы развенчать подобные misconceptions и пишут подобные статьи.

(P.S.: Хотя, скажу честно, к своему стыду Лема я не читал, читал Азимова, Уэлса, Кларка и многих других; возможно, я ошибаюсь и у Лема всё гораздо серьёзней.)

masai

Лем не только писатель, но и философ. Почитайте, например, «Сумму технологии», это не фантастика, а футурология.