Ниже представлен перевод статьи, опубликованной в EDN.

Интернет вещей (IoT) - это не одноколейный конь, он воплощает в себе широкий спектр вариантов использования. Одно из ответвлений, Audio of Things или AoT, охватывает аудиотехнологии, такие как голосовое управление, связь, воспроизведение и восприятие, а также их развивающиеся взаимосвязи с интеллектуальными устройствами и машинами.

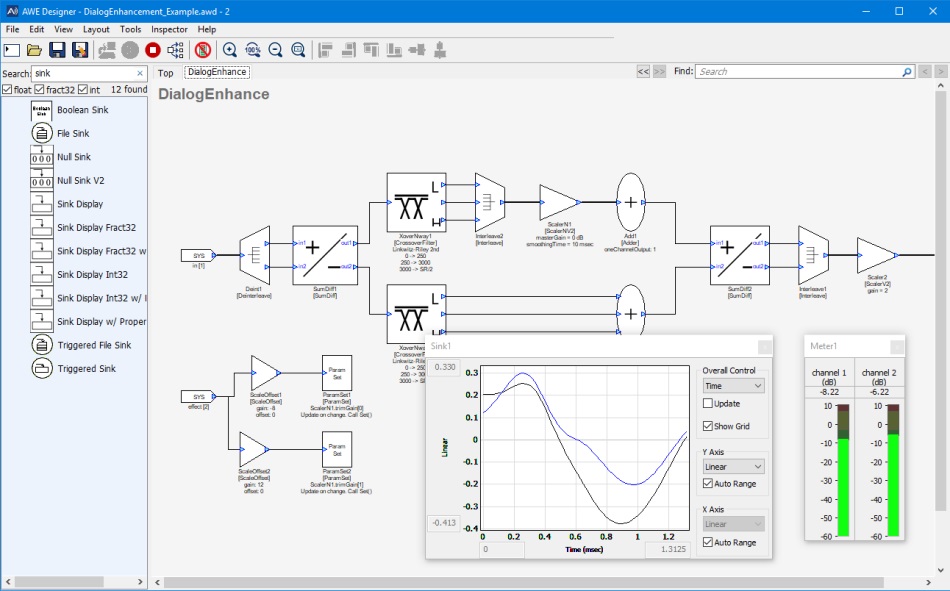

Этот термин был придуман DSP Concepts, дизайн-центром, который предоставляет производителям микросхем и OEM-производителям рабочие процессы в режиме реального времени для встраивания звуковых и голосовых функций в проекты с поддержкой звука. Компания утверждает, что ее строительные блоки AoT не зависят от процессора и полностью настраиваются.

По словам Саймона Форреста, главного технологического аналитика Futuresource Consulting, Audio of Things в настоящее время является постоянно расширяющейся предпосылкой из-за глобального спроса на продукты, ориентированные на аудио. “Адресный рынок аудиопродукции в 2021 году составит чуть менее 3,5 миллиардов устройств, из которых 2,1 миллиарда интегрированы в обработку голоса”.

Источник: DSP Concept. В то время как люди взаимодействуют с машинами, вставляя сложную серию нажатий кнопок, понятных машине, более умные устройства теперь используют человеко-машинные интерфейсы на основе речи (HMI), используя возможности обработки звука, доступные на периферийных устройствах. Ниже приводится краткое изложение ключевых тенденций в дизайне, которые помогают разработчикам преодолевать уникальные проблемы, связанные со звуковым интерфейсом и дизайном намерений.

От облака на передний край

Интеллектуальные устройства или машины с голосовыми интерфейсами используют двусторонний подход для определения цели. Модуль автоматического распознавания речи (ASR) используется для преобразования речи в текст, а затем действие определяется путем анализа этого текста с помощью механизма понимания естественного языка (NLU). Как правило, в этих процессах используются платформы облачных вычислений, такие как Amazon Voice Services и Google Assistant, которые используют искусственный интеллект (ИИ) и машинное обучение для обработки чрезвычайно широкого набора запросов и команд и генерирования столь же широкого набора ответов и действий.

Однако, несмотря на постоянное совершенствование облачных технологий, таких как ASR и NLU, в основном это были “пограничные” проекты, которые снизили барьеры для распространения голосовых HMI. На переднем крае новое поколение встроенных движков преобразования речи в намерения полностью работают на самом устройстве, хотя и с ограниченным словарным запасом и набором практических намерений.

Ускорение обработки звука

Инженеры по разработке аудио традиционно добавляли автономный DSP на плату в качестве звукового сопроцессора, главным образом потому, что микроконтроллеры не обладали требуемой мощностью. Теперь встроенные процессоры используют усовершенствования набора команд, такие как Neon от Arm для Cortex-A и Helium для Cortex-M, для поддержки операций с плавающей запятой и SIMD, необходимых для эффективной обработки звука.

Это обеспечивает вычислительную мощность, необходимую для интеграции голосового управления в дизайн. Более того, в отличие от DSP с частотой 200 МГц, потребляющего 7000 мкВт / МГц, оптимизированный по мощности микроконтроллер с возможностями обработки звука может работать со скоростью около 20 мкВт / МГц.

Появление микрофонных решеток

Массив из нескольких микрофонов вместо одного микрофона выигрывает от большего количества вычислительных циклов для звукового дизайна. Однако проектирование массива, состоящего из двух-семи микрофонов, требует специальных знаний в области акустики, электротехники и механики. Инженеры-проектировщики должны выбрать подходящие микрофоны, определить оптимальное количество и геометрию массива, а также убедиться, что они правильно установлены и закреплены. Кроме того, инженеры должны спроектировать общее акустическое шасси и шасси продукта без механической связи между микрофонами и динамиками.

Программный AFE (Аудио фронт-энд)

Еще одним препятствием на пути широкого внедрения голосовых пользовательских интерфейсов стала низкая производительность распознавания речи, и именно здесь в игру вступают дизайнерские инновации в области аудио интерфейса (AFE). AFE — функциональный блок, расположенный между микрофонами устройства и остальной частью системы обработки голоса, — берет необработанный звук с микрофонов и пытается создать единый выходной аудиопоток из голосовых команд пользователя.

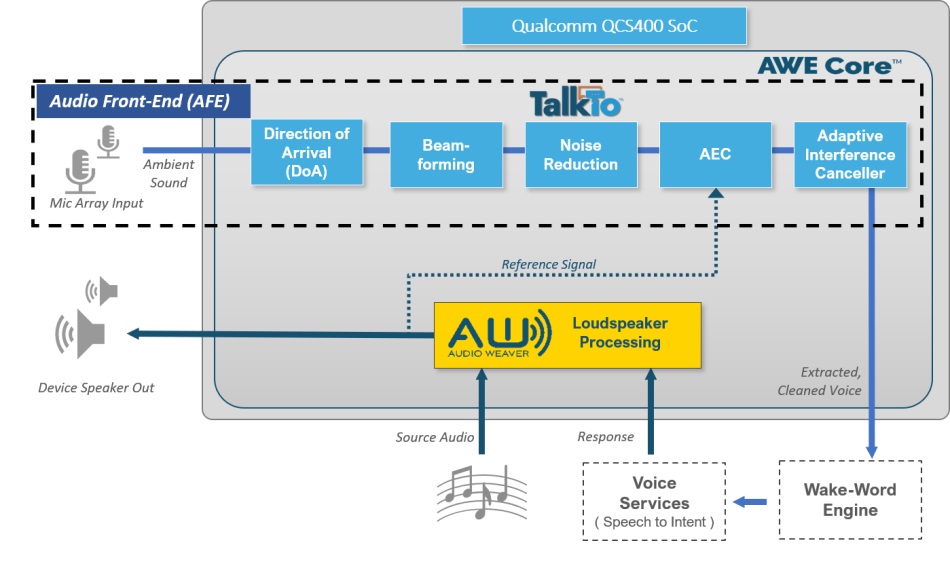

Здесь аппаратные AFE с фиксированной функцией трудно интегрировать в небольшие форм-факторы, и их производительность в основном не впечатляет. Но теперь доступность программных AFE, таких как TalkTo, позволяет машинам соответствовать способности человека понимать речь в шумной среде.

Источник: Qualcomm.

В TalkTo многоканальный акустический эхоподавитель (AEC) отменяет “известные” звуки, издаваемые собственными динамиками устройства. Далее, технология адаптивного подавления помех (AIC) использует машинное обучение и передовые технологии обработки микрофонов для непрерывного отображения и характеристики окружающего звукового поля.

Автор: Маджид Ахмад, главный редактор EDN и Planet Analog, занимается разработкой электроники более двух десятилетий.

nick-for-habr

Мешанина слов...

Гугл конечно старался как мог (т.е. "как всегда"), но есть ощущение, что и оригинал примерно такого же качества: маркетинговая инфоцыганщина из серии "покупайте наши цифровые помидоры".

Prohard Автор

Вы правы. Практически все непрофессиональные переводы так и выполнены. Переводим сначала гуглом, потом яндексом, смотрим, что лучше и редактируем. У меня вызвала трудности идиома автора "одноколейный конь". Видимо она чисто американская, да еще имеет узкое хождение, а что-то из нашего подобрать затруднился. Да, обзор скорее маркетинговый.