В этой статье исследуется текущее состояние разработки искусственного интеллекта, рассматриваются вызовы и угрозы, а также особенности работы наиболее признанных учёных, и описываются основные прогнозы, в каком виде может предстать перед нами ИИ. В целом это переработанная и сокращённая версия состоящего из двух частей эссе, написанного Тимом Урбаном для “Wait But Why”.

Введение

Если предположить, что научная деятельность человечества будет продолжаться без заметных перерывов, то появление ИИ может стать наиболее позитивным изменением в нашей истории. Или, как этого многие боятся, самым опасным изобретением. Сегодня разработки в сфере ИИ уверенно следуют по пути создания компьютера, когнитивные функции которого не будут уступать человеческому мозгу. И вероятнее всего, мы сможем создать его в течение 30 лет (см. временную шкалу в главе 5). Согласно прогнозам большинства учёных, работающих над проблемой ИИ, это изобретение может стать причиной прорывов в области создания Искусственного Суперинтеллекта (ИСИ) — сущности, чей разум превзойдёт совокупную мощь интеллекта всех людей (подробнее об этом читайте в главе 3). Речь не идёт о неком туманном будущем. Первая стадия создания ИИ постепенно проявляется в технологиях, которые мы уже используем в повседневной жизни (новейшие достижения в сфере ИИ см. в главе 2). С каждым годом критическая масса достижений будет накапливаться и ускорять процесс разработки, способствуя усложнению технологий, их распространению и доступности. Всё больше интеллектуальной работы мы будем поручать компьютерам, внедряя их в каждый аспект нашей реальности, включая организацию своей работы, формирование сообществ и общение с миром.

Экспоненциальный рост

Руководящий принцип технического прогресса

Чтобы лучше понять руководящие принципы ИИ-революции, давайте пока отвлечёмся от научных исследований. Представьте, что вы получили машину времени и должны доставить кого-то из прошлого в настоящее, чтобы этот человек потерял дар речи от наших технологических и культурных достижений.

Допустим, вы решили вернуться на 200 лет назад. Метнулись в начало 1800-х годов, схватили какого-то мужика и доставили в 2016. Вы водите его и наблюдаете за его реакциями на всё окружающее. Мы не можем представить, как он воспринимает эти сияющие капсулы, проносящиеся по дорогам; разговоры с людьми, находящимися за океаном; просмотр спортивных игр, проходящих за 1000 км от него; прослушивание концерта, который случился 50 лет назад; возню с магическим прямоугольником, способным сохранять изображения и движущиеся картинки, а также показывающим маленькую точку, обозначающую местоположение на карте; разговор лицом к лицу с человеком, находящимся на другом конце страны и многое другое. Нам не понадобится много времени. Через пару минут гость из прошлого окончательно офигел.

Теперь вы оба хотите узнать, как отреагирует на достижения 1800-х годов человек из 1600-х. Вы перемещаетесь во времени, хватаете первого попавшегося и переносите его на 200 лет вперёд, в 19 век. Ему очень интересно смотреть на окружающий мир, но вы понимаете, что он не потрясён увиденным. То есть чтобы потрясти кого-то 19-м веком, нужно вернуться в прошлое гораздо дальше, чем на 200 лет. Чего там мелочиться, махнём на 15 000 лет назад. Во времена до Первой Сельскохозяйственной Революции, благодаря которой появились первые города и возникла концепция цивилизаций. Находите какого-нибудь охотника-собирателя и показываете ему обширные империи 1750-х годов, с их башнями церквей, кораблями, способными пересекать океаны, с понятием «находиться внутри» и огромными накоплениями знаний и открытий в виде книг. Нам не понадобится много времени. Через пару минут гость из прошлого окончательно офигел.

Теперь вы втроём решили провернуть подобный трюк снова. Вы понимаете, что не имеет смысла возвращаться на 15 000, 30 000 или 45 000 лет. Вам придётся прыгнуть во времени гораздо дальше. Вы находите мужика лет 100 000 назад и проводите ему экскурсию по племенам со сложной социальной иерархией. Он видит разнообразное охотничье оружие, хитрые инструменты, огонь и впервые слышит язык в виде знаков и звуков. Ну, вы поняли, всё это взрывает ему мозг. Через пару минут он окончательно офигевает.

Что произошло? Почему нам с каждым разом приходилось возвращаться намного дальше в прошлое? 100 000 > 15 000 > 200 лет назад?

Так происходит потому, что более развитые общества прогрессируют быстрее менее развитых. В 1800-х человечество знало гораздо больше, поэтому неудивительно, что оно развивалось гораздо быстрее, чем человечество 15 000 лет назад. И нам сегодняшним, чтобы офигеть в будущем, достаточно будет переместиться вперёд меньше, чем на 200 лет.

Рей Курцвейл, учёный и специалист в сфере ИИ, говорит, что «в период с 2000 по 2014 годы мы наблюдали такой же объём прогресса, как за весь 20-й век. И ещё столько же будет достигнуто к 2021 году, всего за семь лет. Ещё лет через 20 мы в течение года достигнем прогресса, в несколько раз превышающего прогресс за весь 20 век, а затем этот период уменьшится до полугода». Курцвейл верит, что к концу 21 века мы в 1000 раз превзойдём прогресс века 20-го.

Логика подсказывает, что если наиболее развитые виды на планете движутся вперёд всё возрастающими темпами, то в конце концов прогресс полностью меняет их представление о жизни, их представление о том, что такое быть человеком. Как если бы развитие интеллекта в процессе эволюции настолько изменило человеческое бытие, что это изменило бы существование всех живых существ на Земле. И если вы потратите некоторое время на изучение текущей ситуации в науке и технологиях, то заметите немало признаков того, что жизнь, какой мы её знаем, уже не сможет устоять перед нашим следующим прорывом.

Путь к общему искусственному интеллекту

Создание компьютеров, не уступающих людям по интеллекту

ИИ — это общий термин для описания технологий компьютерного интеллекта. Несмотря на разнообразие мнений по этому вопросу, большинство экспертов считают, что существует три категории ИИ.

Ограниченный искусственный интеллект (ANI, Artificial Narrow Intelligence)

ИИ первой категории. Специализируется в какой-то конкретной области. Например, есть ИИ, способный победить чемпионов мира по шахматам, но это единственное, что он может делать.

Общий искусственный интеллект (AGI, Artificial General Intelligence)

ИИ второй категории. По уровню интеллекта он достигает и превосходит человека, то есть способен «делать выводы, планировать, решать проблемы, мыслить абстрактно, понимать сложные идеи, быстро обучаться, в том числе на основании собственного опыта».

Искусственный суперинтеллект (ASI, Artificial Super Intelligence)

ИИ третьей категории. Он умнее всего человечества вместе взятого,?начиная от «немного умнее» до «умнее в триллион раз».

Текущая ситуация

На текущий момент человечество создало ИИ первой категории, и они используются повсеместно:

- Автомобили полны ANI-систем, от компьютеров, вычисляющих время срабатывания ABS, до компьютеров, настраивающих параметры впрыска топлива.

- Поисковик Google — это один большой ANI с невероятно сложными алгоритмами ранжирования страниц и вычисления отображения контента. То же самое можно сказать и про новостную ленту Facebook.

- Спам-фильтры почтовых сервисов используют ANI для выявления спама. Этот ИИ является самообучаемым и подстраивается под ваши предпочтения и особенности.

- Пассажирские авиалайнеры практически целиком управляются ANI без помощи людей.

- Беспилотный автомобиль Google, проходящий тестирование, использует мощные ANI-системы, позволяющие ему распознавать и реагировать на окружающую среду.

- Ваш смартфон — маленькая ANI-фабрика. Вы используете картографические приложения, получаете рекомендации на основании ваших предпочтений, проверяете погоду на завтра, общаетесь с Siri.

- Лучшие игроки в шашки, шахматы, Scrabble, Backgammon и Othello — это исключительно ANI-системы.

- Сложные ANI-системы широко используются на производствах, в военной сфере, в финансах (сегодня свыше половины акций на американских рынках торгуются ИИ-программами).

Современные ANI-системы не особо внушают опасения. В худшем случае глючный или запрограммированный со злым умыслом ANI может привести к изолированной катастрофе вроде падения самолёта, выходу из строя АЭС или падению рынков (наподобие 2010 Flash Crash, когда ANI-программа неправильно среагировала на неожиданную ситуацию, что привело к резкому падению рынка акций на один триллион долларов. Лишь часть потерь была компенсирована после исправления ошибки). Пока ANI не имеют возможности создать угрозу нашему существованию, но нельзя закрывать глаза на то, что всё более разрастающаяся и усложняющаяся экосистема относительно безопасных ANI является предвестником глобальных перемен. Каждая инновация в сфере ANI тихо вносит небольшой вклад в общую копилку, становится ещё одним камнем в дороге по направлению к AGI и ASI.

Так видит мир беспилотный автомобиль Google. На основе видео Embedded Linux Conference 2013?—?KEYNOTE Google’s Self Driving Cars

Что дальше? Вызовы, связанный с созданием AGI

Ничто не заставит вас больше ценить человеческий интеллект, как осознание невероятной трудности создания компьютеров, не уступающих нам по уму. Чрезвычайно легко построить компьютер, способный умножать десятиразрядные числа в долю секунды. А построить такой, который сможет посмотреть на собаку и ответить, собака это или кошка, — исключительно трудно. Создать ИИ, способный победить любого человека в шахматах? Сделано. Разработать ИИ, способный прочитать параграф из книги для шестилетних детей и понять их значение? Сегодня на эту задачу Google тратит миллиарды долларов.

Почему трудные для нас вещи — вроде вычислений, стратегий на финансовых рынках и перевода с языков — даются компьютерам умопомрачительно легко, в то время как простые для нас вещи — вроде зрения, движения, перемещения и восприятия — даются им безумно трудно?

То, что кажется нам простым, на самом деле невероятно сложные процессы. Просто они были оптимизированы под нас (и большинство животных) эволюцией сотни миллионов лет назад. Когда вы протягиваете руку к какому-то предмету, то ваши мышцы, сухожилия и кости плеча, локтя и запястья моментально выполняют длинную последовательность физических операций под контролем глаз, чтобы ваша рука смогла двигаться как нужно в трёх измерениях. С другой стороны, умножение длинных чисел или игра в шахматы — это новые занятия для биологических существ, у нас просто не было возможности адаптироваться под них, поэтому компьютеру не нужно особо напрягаться, чтобы нас победить.

Вот забавный пример:

Глядя на картинку A, и вы, и компьютер определят, что на ней изображён прямоугольник из чередующихся фрагментов двух цветов.

Картинка B. Вы без проблем дадите описание непрозрачных и полупрозрачных фигур, а вот компьютер с треском провалится. Он опишет то, что видит — совокупность двумерных фигур нескольких оттенков. И будет совершенно прав. Просто наш мозг выполняет огромную работу по интерпретированию предполагаемой глубины сцены, смешанных теней и наложенного освещения.

Глядя на картинку C, компьютер видит двумерный коллаж из белых, чёрных и серых пятен, в то время как вы легко распознаете то, что изображено на самом деле — фотографию девушки и собаки на скалистом берегу.

И всё вышеописанное относится только к визуальной информации и её обработке. А чтобы не уступать по интеллекту человеку, компьютер должен ещё, например, распознавать разные выражения лица или понимать смысл понятий «получать удовольствие», «испытывать облегчение» и «ощущать различие». Как компьютеры смогут достичь ещё более высоких способностей, вроде сложных рассуждений, интерпретирования информации и установления взаимосвязей между разными областями знаний? Гораздо проще было построить небоскрёбы, отправить человека в космос и выяснить подробности Большого Взрыва, чем понять работу собственного мозга и придумать, как сделать что-то, работающее не хуже его. На сегодняшний день человеческий мозг считается самым сложно устроенным объектом в известной Вселенной.

Разработка оборудования

Если ИИ должен быть не глупее человеческого мозга, то критически важно обеспечить его аналогичными вычислительными ресурсами. Их можно выразить в количестве вычислений, которые мозг может выполнить в секунду — CPS, calculations per second.

Главный вызов заключается в том, что нам пока удалось точно измерить работу лишь некоторых разделов мозга. Однако Рей Курцвейл разработал метод определения общего количества CPS. Он взял CPS одного из разделов и умножил пропорционально весу всего мозга. Он делал это неоднократно на основании различных профессиональных оценок тех или иных разделов, и в результате всегда приходил к одному и тому же значению — 1016 CPS, или 10 квадрильонов CPS.

Один из самых быстрых современных суперкомпьютеров, китайский Tianhe-2, уже превысил эту производительность и показал около 34 квадрильонов CPS. Но этот монстр занимает 720 квадратных метров пространства и потребляет 24 мегаватт-час энергии (а человеческий мозг — примерно 20 Ватт), а его постройка обошлась в $390 миллионов. Так что он не особо подходит для широкого использования и даже для решения большинства коммерческих и промышленных задач.

Курцвейл предлагает подходить к оценке компьютеров с точки зрения количества CPS на $1000. Когда за эти деньги мы сможем получить производительность на уровне 10 квадрильонов, то это будет означать, что AGI стал настоящей частью нашей жизни. Сегодня за $1000 можно получить около 1010 CPS — 10 триллионов. Проверенный временем закон Мура гласит, что максимальная вычислительная мощность удваивается примерно каждые два года, а значит развитие оборудования, как развитие человечества, растёт по экспоненте (согласно самым свежим данным, через пять лет закон Мура уже перестанет работать в связи с достижением фундаментальных физических барьеров). В соответствии с этим прогнозируемым графиком:

Эта визуализация основана на графике Курвейла и анализе из его книги The Singularity is Near.

Подобная динамика подсказывает, что компьютеры с производительностью, аналогичной человеческому мозгу, появятся в районе 2025 года. Но одна лишь вычислительная мощность не придаст компьютеру интеллектуальности. Так что следующий вопрос звучит так: «Как нам придать разума всем этим гигагерцам?».

Создание ПО

Одна из труднейших задач при создании AGI — как написать необходимое ПО. Дело в том, что никто не знает, как сделать компьютер умным. Мы всё ещё спорим о том, как придать компьютеру человеческий интеллект, чтобы он знал, что такое «собака», умел распознать криво написанную букву В и мог оценить фильм как посредственный. Тем не менее, есть несколько основных подходов к этой задаче.

- Копирование работы человеческого мозга.

Решение задачи «в лоб»: скопировать архитектуру мозга и построить компьютер в близком соответствии с ней. Пример: искусственная нейронная сеть. Изначально это сеть из транзисторных «нейронов», соединённых друг с другом посредством входов/выходов. Такая сеть ничего не знает, совсем как мозг младенца. Её «обучение» связано с попыткой выполнить какие-то задачи, допустим, распознавание рукописного текста. Сначала взаимодействия нейронов и попытки оцифровывания каждой буквы будут происходить совершенно хаотично. Но когда такая нейронная сеть будет достигать какого-то положительного результата, приведшие к нему взаимосвязи будут усиливаться. А взаимосвязи, приведшие к отрицательным результатам, будут ослабляться. После ряда проб и ошибок сеть сформирует определённые последовательности взаимодействия и оптимизируется для конкретной задачи.

Есть и более радикальный подход — полное эмулирование мозга. Учёные берут настоящий мозг, разрезают его на большое количество кусочков, выявляют нейронные связи и копируют их посредством ПО. Если этот подход окажется успешным, то мы получим компьютер, способный выполнять те же задачи, что и человеческий мозг. Достаточно дать ему возможность обучаться и собирать информацию… Далеки ли мы от полноценной эмуляции мозга? Достаточно далеки, ведь мы только что смогли эмулировать мозг 1-миллиметрового плоского червя, состоящий всего из 302 нейронов. Для сравнения: человеческий мозг состоит примерно из 86 миллиардов нейронов, соединённых друг с другом посредством триллионов синапсов.

- Эволюция компьютеров.

Даже если мы сможем эмулировать мозг, что сравнимо с постройкой самолёта посредством копирования движения крыльев птицы, машины всё же лучше всего подходят для использования новых, ориентированных на технику подходов, а не для копирования биологии. Если мозг слишком сложен для цифрового воспроизведения, то мы можем эмулировать процесс эволюции. Для этого используются так называемые «генетические алгоритмы». Допустим, группа компьютеров пытается выполнить какую-то задачу, и самые успешные из них скрещиваются с другими, передавая по половине программного кода для создания нового компьютера. Наиболее успешные исключаются из процесса. Скорость и ориентированность на достижение цели — это преимущества искусственной эволюции перед эволюцией биологической. После множества итераций естественный отбор позволит создавать всё более совершенные компьютеры. Вызов заключается в автоматизации процесса, чтобы искусственная эволюция развивалась без вмешательства человека.

- Пусть все проблемы решает компьютер, а не мы.

Последний подход самый простой и самый пугающий. Нам нужно построить компьютер, двумя основными задачами которого будут исследование ИИ и внесение изменений в собственный код, чтобы не только учиться улучшать свою архитектуру, но и претворять на практике. То есть речь о том, чтобы сделать компьютер специалистом по информатике, чтобы он мог самостоятельно вести собственную разработку. Это самый предпочтительный способ для получения AGI.

Возможно, все эти улучшения ПО покажутся вам слишком медленными или неосязаемыми, но, согласно научным представлениям, одна небольшая инновация может моментально ускорить процесс разработки. Это как последствия революции Коперника — его открытие моментально облегчило математические вычисления траекторий планет, и в свою очередь это привело к новым открытиям. Так что не нужно недооценивать экспоненциальный рост: то, что может выглядеть ползаньем улитки, может быстро превратиться в безудержную гонку.

Визуализация сделана на основании графика из “Welcome, Robot Overlords. Please Don’t Fire Us?”

Путь к искусственному суперинтеллекту

Сущность, которая умнее всего человечества вместе взятого

Вполне вероятно, что в какой-то момент мы сможем создать AGI: программное обеспечение, которое по интеллекту многократно превзойдёт человека. Означает ли это, что компьютеры станут равны нам? Вовсе нет — компьютеры будут гораздо эффективнее. Благодаря своей электронной природе они будут иметь ряд преимуществ:

- Скорость. Нейроны мозга работают с частотой около 200 Гц, а современные процессоры имеют частоту в среднем 2 ГГц, то есть в 10 млн раз быстрее.

- Память. В искусственном мире куда труднее забывать или путать факты. Компьютеры могут в секунду запоминать куда больше, чем человек за десять лет. Кроме того, память компьютера гораздо точнее и объёмнее.

- Производительность. Транзисторы гораздо точнее нейронов и реже выходят из строя (и могут быть восстановлены или заменены). Человеческий мозг быстро утомляется, а компьютеры могут без остановки работать с максимальной производительностью.

- Коллективные способности. Из-за особенностей межличностного взаимодействия и сложности социальной иерархии, работа в группе людей может быть до нелепости сложной. И чем больше группа, тем медленнее становится отдача от каждого члена. ИИ не имеет этих биологических ограничений, он не испытывает проблем, характерных для коллективов людей, и может синхронизировать и обновлять собственную ОС.

Всплеск интеллекта

Нужно понять, что для ИИ интеллект уровня человека не будет представлять собой важной вехи. Этот маркер важен лишь с нашей точки зрения. И для ИИ не будет причины останавливаться на нашем уровне. И с учётом преимуществ над нами, которые будет иметь ИИ уровня AGI, очевидно, что для него производительность нашего мозга будет лишь краткой остановкой на пути к суперинтеллекту.

Главное отличие между человеком и ASI будет заключаться не в производительности, а в качестве интеллекта — они будут сильно отличаться. Человека от шимпанзе отличает вовсе не скорость сообразительности: мозг человека содержит некое количество сложных когнитивных разделов, позволяющих создавать трудные лингвистические конструкции, или осуществлять долговременное планирование, или устанавливать абстрактные взаимосвязи. Поэтому тысячекратное ускорение мозга шимпанзе не выведет его на наш уровень, даже с учётом десятилетнего обучения. Обезьяна не сможет научиться собирать конструкторы Lego, изучив инструкцию. А ведь ребёнок сможет этому научиться за несколько минут. Есть обширный спектр человеческих когнитивных функций недоступных шимпанзе, вне зависимости от продолжительности тренировок.

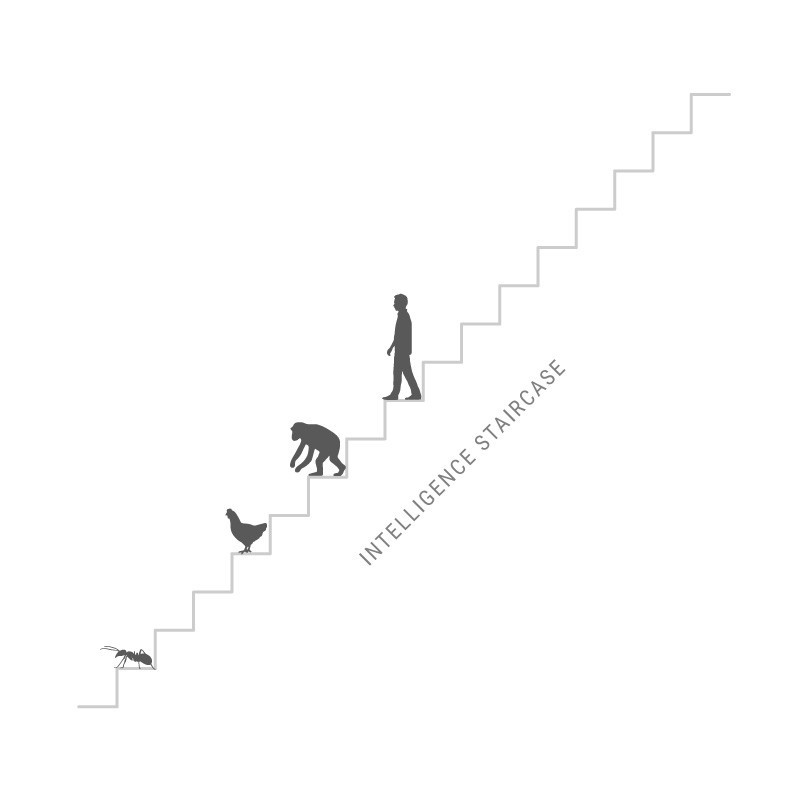

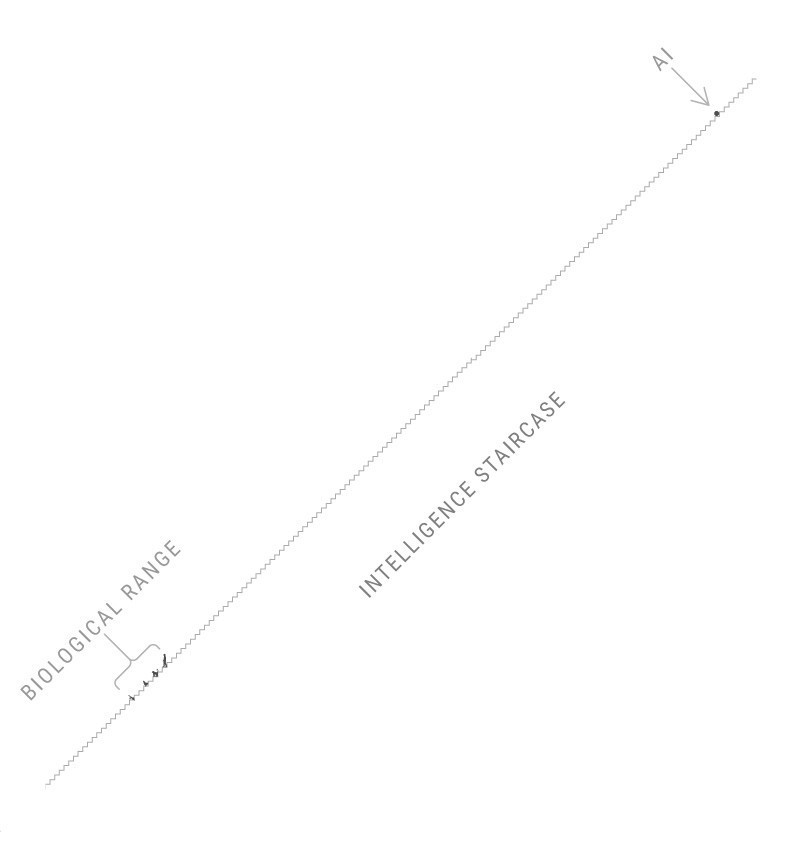

При этом от шимпанзе мы ушли не так далеко.

Чтобы представить, каково это — существовать бок о бок с кем-то, более развитым интеллектуально, нам нужно разместить ИИ на лестнице двумя ступенями выше нас. Это разница между нами и шимпанзе. И как шимпанзе никогда не поймёт магию, таящуюся за дверной ручкой, так и мы никогда не сможем понять многие вещи, на которые будет способен искусственный суперинтеллект, даже если он попытается объяснить нам. А ведь он всего на две ступени выше нас.

Если ИИ будет располагаться на этой лестнице ещё выше, то мы будем для него примерно тем же, чем для нас являются муравьи. У нас будет не больше шансов понять его, чем у пчелы, пытающейся вникнуть в экономическую теорию Кейнса. В нашем мире мы считаем идиотами тех, чей IQ ниже 85, и умными — чей IQ выше 130. У нас нет термина для IQ 12,952.

Однако суперинтеллект, о котором мы сейчас говорим, вообще не помещается на нашу гипотетическую лестницу. В случае всплеска интеллекта — чем умнее становится машина, тем быстрее она может развиваться — у компьютера могут уйти годы, чтобы дойти от уровня муравья до уровня человека, но при этом всего за 40 дней он сможет стать гением уровня Эйнштейна. И с течением времени скорость «поумнения» машины будет возрастать.

Благодаря экспоненциальному росту и использованию скорости и эффективность электронных схем, ИИ сможет достигать следующего этапа развития каждые 20 минут. И когда он будет опережать нас на 10 ступеней, то каждую секунду он будет подниматься ещё на 4 ступени. Поэтому необходимо чётко осознавать: весьма вероятно, что вскоре после новостей о создании машины, не уступающей человеку, мы можем оказаться перед фактом сосуществования с кем-то, кто гораздо развитее нас (возможно, в миллионы раз).

И раз можно не надеяться осознать мощь компьютера, который всего на две ступени выше нас, то можно даже не пытаться понять ASI, как и последствия, которые может иметь для нас его появление. Каждый, кто говорит иначе, просто не понимает, что означает суперинтеллект.

Раз даже наши скромные мозги смогли изобрести Wi-Fi, то сущность, которая в 100, 1000 или 1 000 000 раз умнее нас без проблем будет управлять расположением каждого атома в мире по своему желанию. Всё, что мы считаем волшебством, все те качества, что мы приписываем богам, для ASI будет такой же повседневностью, как для нас включение света в комнате. С возникновением ASI на Земле появится всемогущий бог. И главным вопросом будет: будет ли это добрый бог? Но давайте начнём с более оптимистичной стороны вопроса.

Как ASI может изменить наш мир?

Спекуляции на тему двух революционных технологий

Нанотехнологии

Нанотехнологии возникают почти в любой публикации, посвящённой будущему ИИ. Это технологии, оперирующие диапазоне от 1 до 100 нанометров. Нанометр — это одна миллионная миллиметра. К примеру, нанодиапазон охватывает вирусы, ДНК, а также достаточно маленькие молекулы, например, молекулу гемоглобина или глюкозы. Если/когда мы освоим нанотехнологии, следующим шагом станет возможность манипулирования отдельными атомами, которые лишь на порядок меньше (около 0,1 нм).

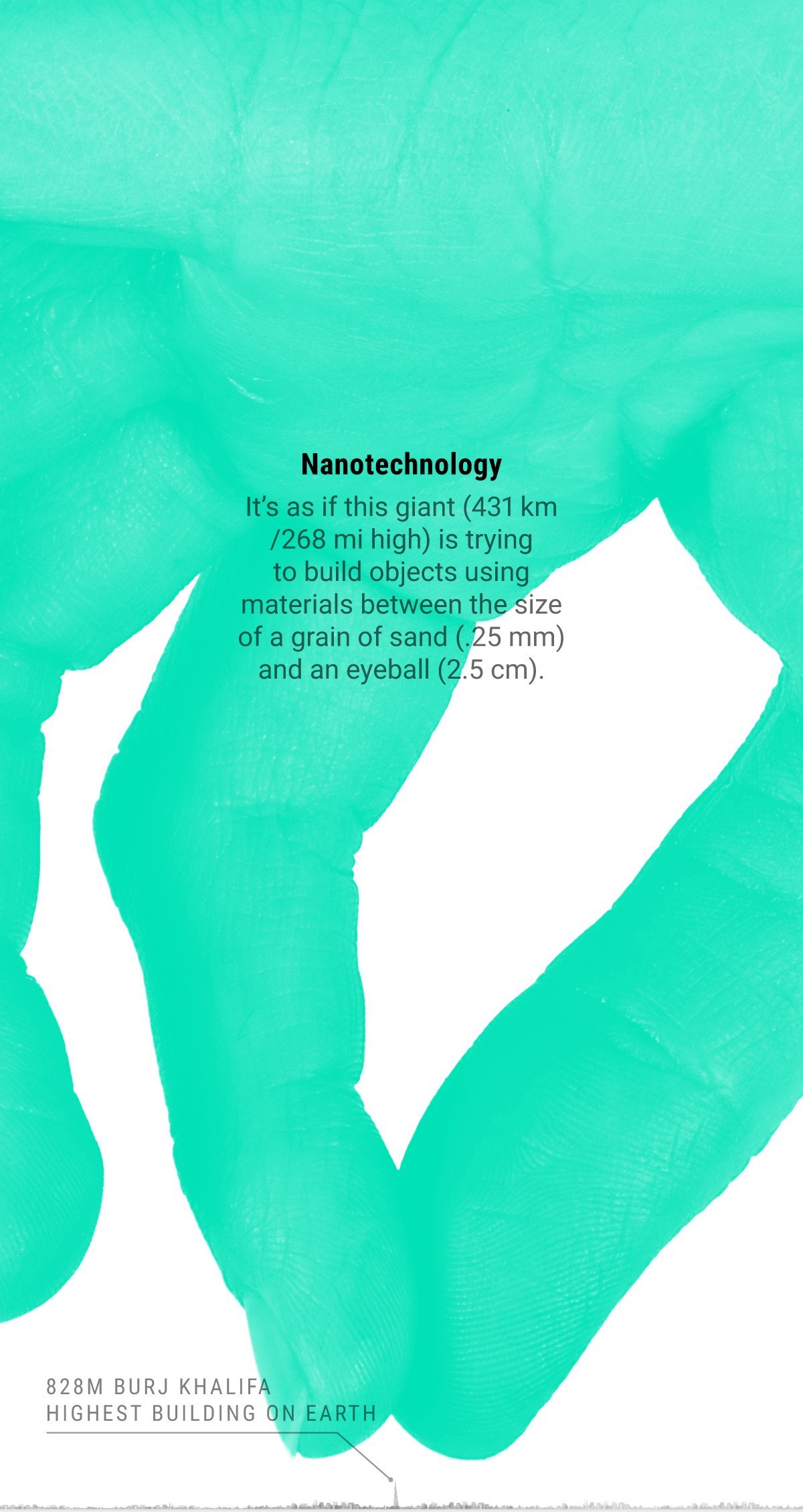

Представьте великана, стоящего на земле, чья голова достигает Международной Космической Станции (около 431 км). Гигант нагибается, чтобы своей рукой (длиной в 30 км) построить объекты из материалов, гранулы которых имеют размер песчинок (0,25 мм) и глазного яблока (2,5 см).

Освоив нанотехнологии, мы сможем создавать устройства, одежду, еду и широкий спектр биопродуктов — искусственную кровь, специальные вирусы, клетки для борьбы с раком, мышечную ткань и т.д. Всё что угодно. В этом новом мире стоимость материалов больше не будет привязана к его доступности или сложности производства. Вместо этого станет важна их атомная структура. В мире нанотехнологий бриллиант может оказаться дешевле ластика.

Один из способов применения нанотехнологий может заключаться в создании самовоспроизводящихся конструкций: из одной получается две, из двух — четыре, из четырёх — восемь, и т.д. И однажды их будет триллионы. Но что если процесс пойдёт не так, как задумано? Например, террористы перехватят управление? Или кто-то ошибётся и запрограммируют наноботов перерабатывать все углеродосодержащие материалы, чтобы поддерживать процесс самовоспроизведения. А это значит, что наноботы станут уничтожать всех живых существ. Биомасса Земли содержит примерно 1045 атомов углерода. Один нанобот может содержать около 106 атомов, значит 1039 наноботов способны уничтожить всё живое на планете, выполнив 130 репликаций. Учёные считают, что одна репликация может занимать около 100 секунд, значит одна ошибка может сделать Землю безжизненной всего за 3,5 часа.

Мы пока не владеем нанотехнологиями. И пока неясно, мы недооцениваем или переоцениваем трудность освоения. Но, похоже, мы уже не так далеки от цели. Курцвейл считает, что первые нанотехнологии будут освоены в 2020-е годы. Это будут в полной мере прорывные технологии, поэтому США, ЕС и Япония уже инвестировали в исследования суммарно порядка 5 миллиардов долларов.

Бессмертие

Поскольку все когда-нибудь умрут, мы живём с предпосылкой неизбежности смерти. О старении мы думаем как о времени — и то, и другое не остановить. На протяжении столетий поэты и философы задавались вопросом, должно ли сознание повторять путь тела. Уильям Йейтс описывает нас как «души, запечатанные в умирающих животных». Нобелевский лауреат по физике Ричард Фейнман рассматривает смерть с точки зрения чистой науки:

«Это одно из наиболее примечательных явлений в биологии, потому что не мы не имеем никаких свидетельств необходимости смерти. Если вы захотите создать вечный двигатель, то либо обнаружите, что законы физики делают его невозможным, либо выясните, что законы ошибаются. Но мы пока не обнаружили в биологии таких причин, по которым смерть неизбежна. Это наводит на мысль, что со временем биологи смогут выяснить причины смерти и найти средство от этого ужасного универсального телесного недуга».

Теория великих аттракторов видов живых существ

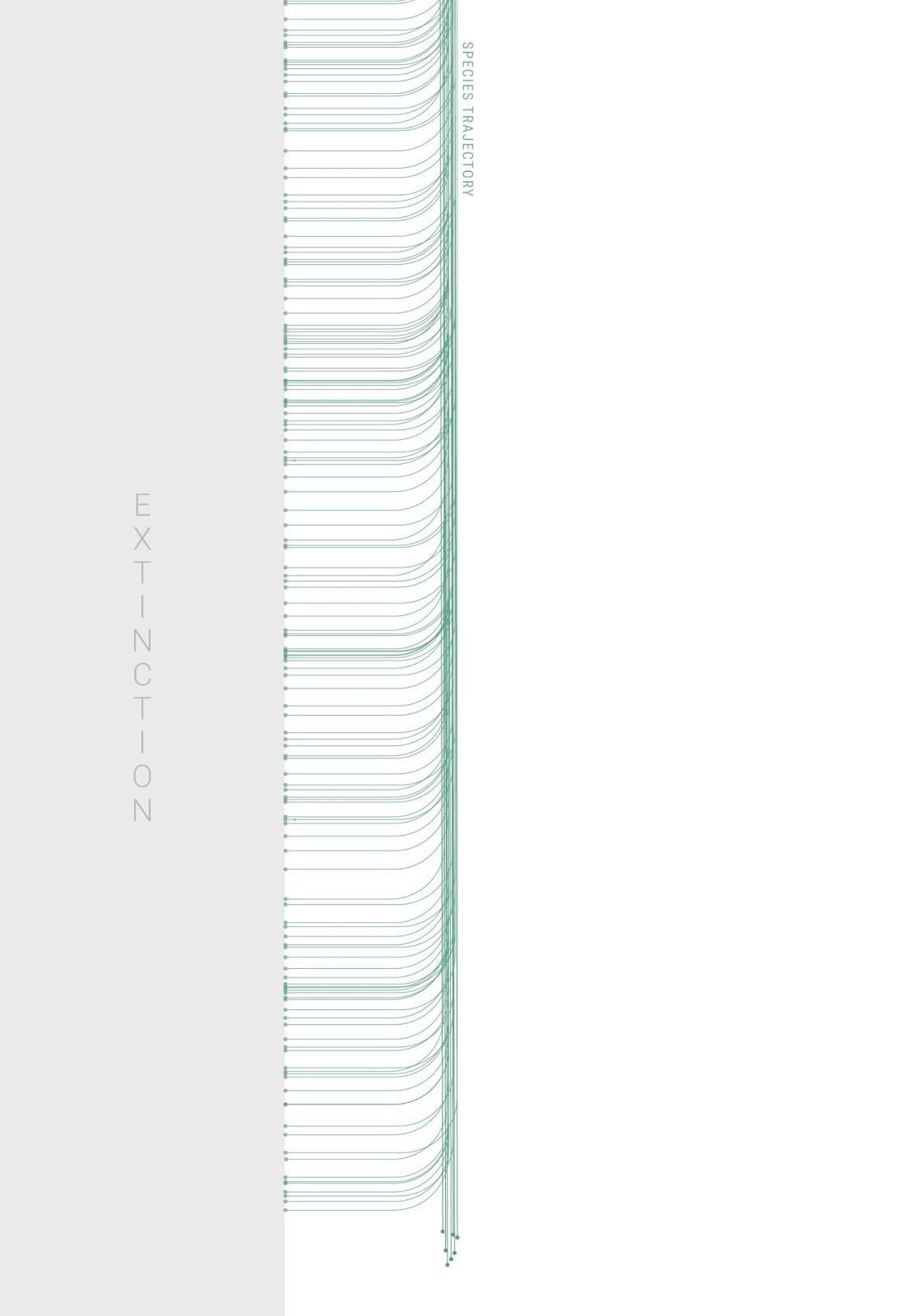

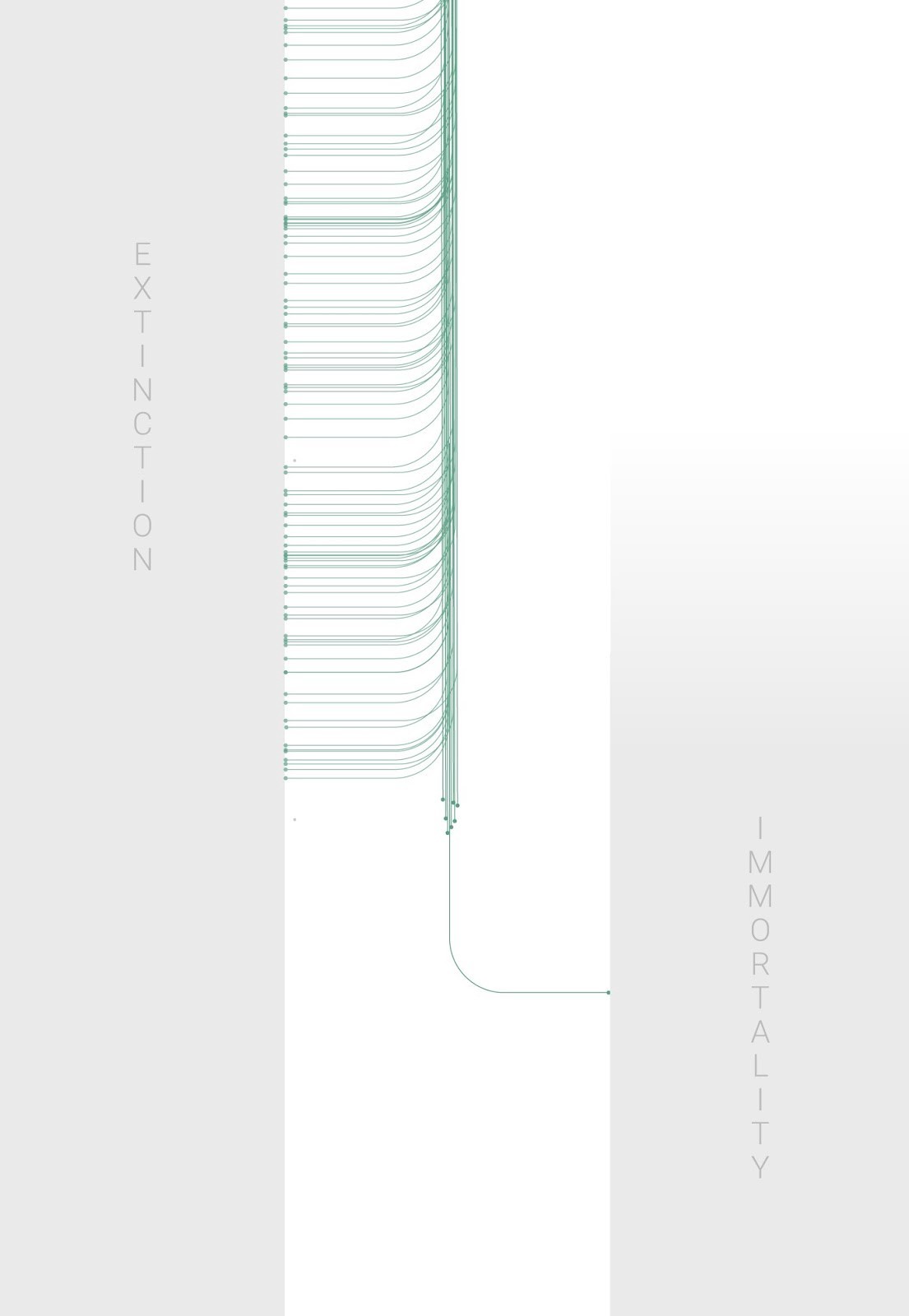

Если проанализировать историю жизни на земле, то окажется, что 99,9% видов вымерли. Ник Бостром, профессор Оксфорда и специалист в сфере ИИ, называет вымирание состоянием аттрактора. Это место, в которое попадают виды, и из которого нет возврата.

И хотя немало учёных считают, что ASI станет причиной вымирания человечества, есть немало тех, кто считают, что при правильном использовании ASI может перевести человечество во второе состояние аттрактора — мы станем бессмертным видом.

У эволюции нет стоящих причин для увеличения продолжительности нашей жизни. С её точки зрения, человеческой особи достаточно жить 30+ лет. Этого достаточно для создания потомства, а значит в ходе естественного отбора не нужно мутировать в направлении увеличения продолжительности жизни. Однако если вы будете идеально ремонтировать или менять компоненты автомобиля по мере их износа, такой автомобиль сможет работать вечно. Человеческое тело в этом смысле ничем не отличается, просто оно куда сложнее. Наше тело — всего лишь набор атомов, органически запрограммированных с помощью ДНК. И теоретически ими можно манипулировать. Вероятно, такая задача генной инженерии окажется под силу ASI.

Рей Курцвейл верит, что искусственные материалы будут интегрироваться в наше тело всё в больших объёмах. Органы могут заменяться свехпродвинутыми электромеханическими версиями, способными работать вечно и без сбоев. Красные кровяные тельца могут быть усовершенствованы с помощью наноботов, вырабатывающих энергию для собственного движения, что сделает ненужным само сердце. Теоретик нанотехнологий Роберт Фрейтас уже разработал замену для красных кровяных телец. Будучи внедрённым в кровь, они позволят человеку 15 минут бежать с максимальной скоростью и даже не запыхаться. Курцвейл добрался и до мозга, он верит, что мы сможем расширить наши ментальные способности настолько, что человек будет думать в миллиарды раз быстрее благодаря интегрированию электронных компонентов с обеспечением прямого доступа к информационной сети.

В конце концов, согласно Курцвейлу, человечество достигнет точки, когда всё тело станет искусственным. И оглядываясь назад, мы будем думать о своём биологическом теле как о невероятно примитивном. Мы будем недоумевать, как люди могли стареть, страдать от рака и прочих недугов, становившихся причиной смерти.

Когда первая машина станет суперинтеллектом?

Предсказания от наиболее авторитетных специалистов в сфере ИИ

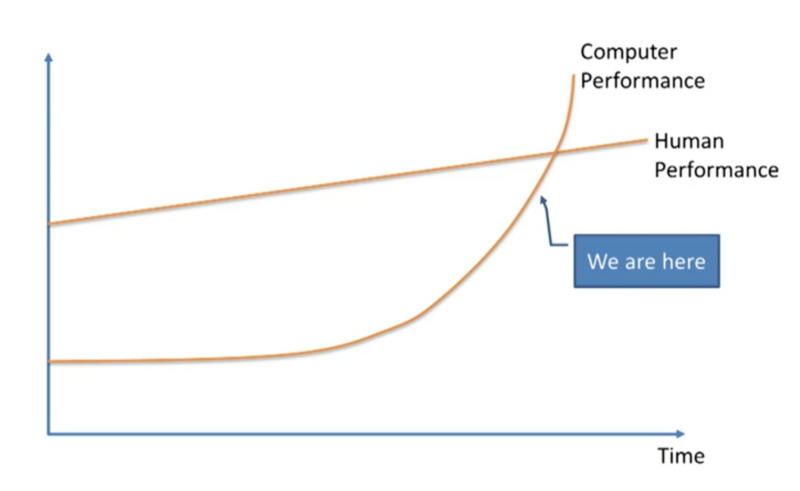

Как и следовало ожидать, мнения сильно различаются. Многие специалисты, вроде профессора Вернора Винджа, учёного Бена Герцеля, сооснователя Sun Microsystems Билла Джоя и инвестора и футуриста Рей Курцвейла, согласны с экспертом по машинному обучению Джереми Говардом, который на TED Talk представил следующий график:

Все эти люди верят в скорое появление компьютеров, не уступающих человеку. Эта вера основывается на экспоненциальном прогрессе в сфере машинного обучения. И хотя сейчас он едва заметен, но в следующие несколько десятилетий понесётся вскачь.

В то же время ряд специалистов, включая сооснователя Microsoft Пола Аллена, психолога-исследователя Гэри Маркуса, специалиста по информатике Эрнеста Дэвиса и предпринимателя Митча Капора верят, что люди вроде Курцвейла сильно недооценивают уровень трудности задачи, и для создания компьютеров, способных соперничать с человеком, понадобится гораздо больше времени.

Лагерь Курцвейла возражает, что единственная недооценка заключается в степени экспоненциального роста. В качестве примера они приводят скептиков, которые смотрели на очень медленное распространение интернета в 1985 и считали, что он не получит сколько-то значимого применения в ближайшем будущем. Скептики могут возразить, при развитии ИИ трудность достижения каждого следующего этапа увеличивается экспоненциально, что отменяет характерный темп технологического прогресса. И так далее.

Есть и третий лагерь, условно возглавляемый Ником Бостромом. Представители этого лагеря верят, что никто не может точно знать, А) что в ближайшем будущем мы обязательно создадим компьютер, не уступающий человеку, и Б) что нет никакой гарантии вообще. Это может занять гораздо больше времени.

Другие, вроде философа Губерта Дрейфуса, верят, что все три группы слишком наивны, чтобы верить в возможность создания ASI. Что мы получим, если сложим вместе все эти мнения?

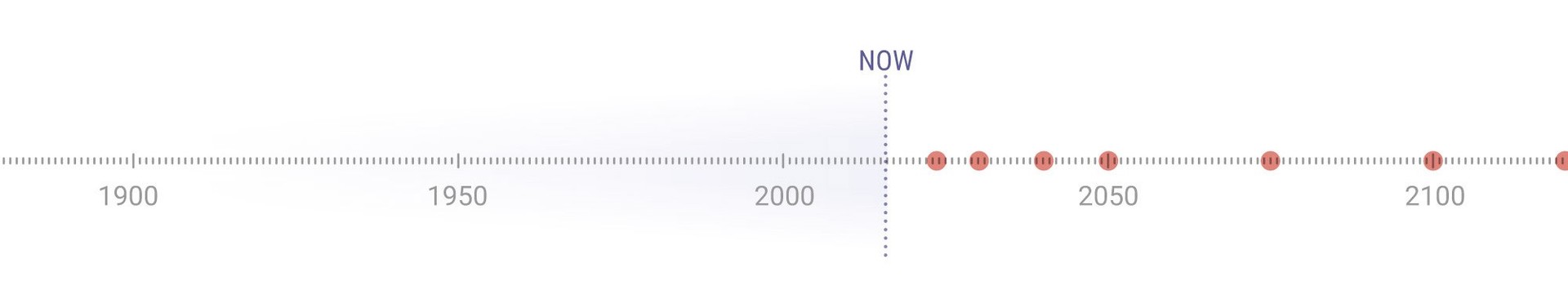

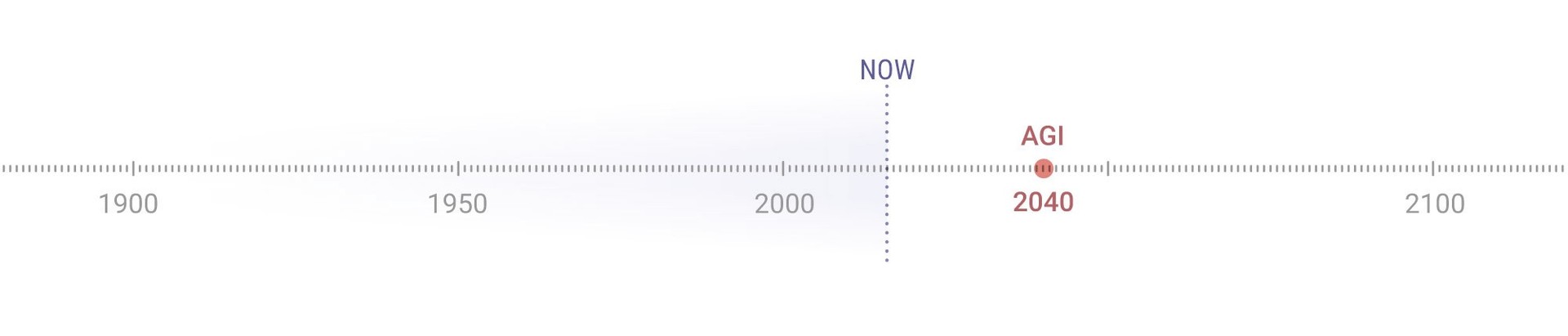

Временная шкала появления общего ИИ

В 2013 году Винсент Мюллер и Ник Бостром провели исследование, в котором сотням специалистов в сфере ИИ задали вопрос: «Предположим, что человеческая научная деятельность продолжится без серьёзных перебоев. К каким годам вы ожидаете появления ИИ уровня человека с заданной вероятностью 10% / 50% / 90%?»

Респондентов просили назвать оптимистичный срок (год с 10% вероятности появления AGI), реалистичный (50%, то есть в этот год вероятность создания AGI превышает шансы несоздания) и безошибочный (год, когда вероятность создания AGI достигнет 90%). Вот результаты:

Усреднённый оптимистический год (10% вероятность создания AGI) > 2022

Усреднённый реалистический год (50% вероятность создания AGI) > 2040

Усреднённый пессимистический год (90% вероятность создания AGI) > 2075

В среднем участники исследования считают, что появление AGI более вероятно через 25 лет. Худший сценарий означает, что если вы подросток, то у вас есть шанс дожить до появления ИИ, не уступающего человеку.

Другое исследование было недавно проведено Джеймсом Барратом на ежегодной Конференции по AGI Бена Гёрцеля. Джеймс не спрашивал про проценты, он предлагал респондентам выбрать наиболее подходящий, с их точки зрения, временной рубеж: 2030, 2050, 2100, после 2100, никогда. Вот результаты:

42% респондентов > к 2030

25% респондентов > к 2050

20% респондентов > к 2100

10% респондентов > после 2100

2% респондентов > никогда

Довольно близко к результатам исследования Мюллера и Бострома. Возьмём усреднённый результат по двум крупнейшим группам.

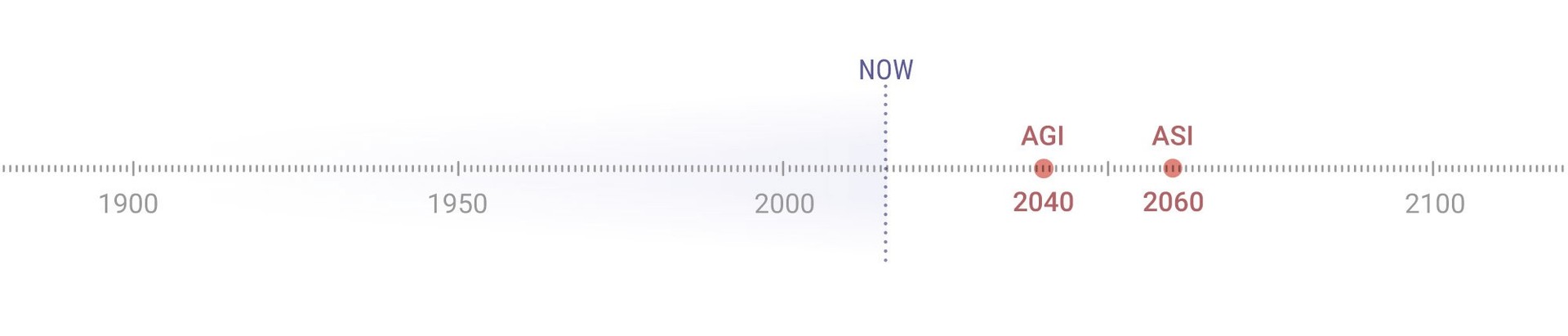

Время появления искусственного суперинтеллекта

Мюллер и Бостром также спрашивали экспертов, когда, по их мнению, будет создан ASI:

- В течение двух лет после создания AGI (практически взрывное развитие ИИ)

- В течение 30 лет после создания AGI.

Вот результаты:

Переход от AGI к ASI в течение 2 лет > вероятность 10%

Переход от AGI к ASI в течение 30 лет > вероятность 75%

Из этих данных мы не можем получить представление о временном промежутке, имеющем вероятность появления ASI 50%, но приблизительно его можно оценить, скажем, в 20 лет.

Итак, в среднем эксперты мирового уровня в сфере ИИ считают, что мы можем создать ASI примерно через 20 лет после AGI. Если брать за время создания AGI 2040-й год, то суперинтеллект можно ожидать к 2060-му году.

Конечно, все эти данные достаточно спекулятивны и представляют собой всего лишь усреднённое мнение сообщества экспертов в сфере ИИ. Но всё же это мнение большого количества людей, очень глубоко разбирающихся в теме. Так что с большой долей вероятности можно предположить, что лет через 45 может быть создан искусственный суперинтеллект, который преобразит мир.

Последствия появления ИИ

Есть две основные группы учёных с двумя кардинально противоположными мнениями.

Лагерь оптимистов

То, о чём мы говорили выше, так или иначе разделяет на удивление большая доля учёных, придерживающихся оптимистического взгляда на последствия разработки ИИ. В чём причина их уверенности — это вопрос отдельный. Критики считают, что это проявление ослепляющей воодушевлённости, заставляющей игнорировать или отрицать возможные негативные последствия. Но сами оптимисты утверждают, что слишком наивно предполагать катастрофические сценарии, поскольку технологии будут приносить нам больше пользы, чем вреда. Питер Диамандис, Бен Гёрцель и Рей Курцвейл — это яркие представители лагеря оптимистов, считающих себя сингуляристами.

Давайте поговорим о Курцвейле, одном из самых впечатляющих и противоречивых теоретиков. Его предсказания одними почитаются как божественное откровение, а других заставляют презрительно закатывать глаза. Курцвейл — автор ряда прорывных изобретений, включая:

- первый планшетный сканер,

- сканер, преобразующий текст в речь (позволяет слепым извлекать информацию из текста),

- музыкальный синтезатор Курцвейла (первое полностью электронное пианино),

- и первое коммерческое устройство распознавания речи с большим словарным запасом.

Курцвейл известен своими смелыми предсказаниями, включая то, что ИИ вроде Deep Blue сможет победить шахматного гроссмейстера к 1998 году. Он также предполагал в конце 1980-х, когда про интернет мало кто знал, что в первой половине 2000-х эта технология превратится в глобальный феномен. Из 147 предсказаний Курцвейла, сделанных им с 1990-х, 115 оказались верными и ещё 12 «преимущественно верными» (отклонение на 1-2 года), то есть точность его предсказаний составляет 86%. Он автор пяти книг. В 2012 году Ларри Пейдж предлагал Курцвейлу место технического директора Google. В 2011 году он стал сооснователем Университета Сингулярности, патронируемого NASA и частично спонсируемого Google. Неплохо для одной жизни.

Биография Курцвейла важна, потому что без этого контекста его слова воспринимаются как речи потерявшего связь с реальностью. Он верит, что мы создадим AGI к 2029 году, а к 2045 появится не просто ASI, но изменится весь мир — наступит технологическая сингулярность. Созданная им временная шкала появления ИИ до сих пор выглядит прямо-таки возмутительно оптимистичной, но в последние 15 лет быстрое продвижение в сфере ANI-систем заставило многих экспертов повнимательнее изучить шкалу Курцвейла. В целом его предсказания несколько более амбициозны, чем усреднённое мнение респондентов исследования Мюллера и Бострома (AGI к 2040-м, ASI к 2060-м), но в целом отличаются не сильно.

Лагерь скептиков

Вряд ли вы удивитесь тому, что идеи Курцвейла подвергаются серьёзной критике. На каждого эксперта, горячо верящего в правоту Курцвейла, приходится двое-трое несогласных скептиков. Любопытно, что большинство несогласных с ним экспертов при этом не отрицают, что всё, о чём он говорит, может произойти. Ник Бостром, философ и Директор Оксфордского Института будущего человечества (Oxford Future of Humanity Institute) критикует Курцвейла по целому ряду вопросов и призывает к большей осторожности относительно последствий создания ИИ:

«Заболевания, нищета, разрушение окружающей среды, всевозможные бессмысленные страдания: всё это может принести нам суперинтеллект, вооружённый продвинутыми нанотехнологиями. В то же время он может дать нам бессмертие посредством наномедицины, остановив и повернув вспять процесс старения, или создав возможность загрузки своего разума».

Да, всё это возможно, если мы безопасно перейдём к ASI — но это как раз трудная задача. Скептики указывают на то, что известная книга Курцвейла The Singularity is Near состоит из более чем 700 страниц, из которых всего около 20 посвящено потенциальным угрозам. Колоссальная мощь ИИ аккуратно описана им: «ASI складывается из многих разнообразных усилий и будет глубоко интегрирован в инфраструктуру нашей цивилизации. Он будет тесно встроен в наши тела и мозги. Он будет отражать наши ценности, потому что он будет нами самими».

Но тогда почему столько умных людей во всём мире так переживают? Почему Стивен Хокинг сказал, что разработка ИИ может стать концом человеческой расы, Билл Гейтс говорит, что не понимает, почему некоторые люди не переживают по этому поводу, а Илон Маск опасается, что мы призываем демона? И почему многие эксперты считают появление ASI величайшей угрозой человечеству?

Последнее изобретение, которое мы сделаем

Экзистенциальные угрозы разработки ИИ

Когда дойдёт до создания сверхумного ИИ, мы создадим нечто, что, вероятно, изменит весь уклад нашей жизни. Но мы не представляем, какой она станет и когда это произойдёт. Учёный Дэнни Хиллис сравнивает эту ситуацию с той, «когда одноклеточные организмы превратились в мультиклеточные. Мы амёбы, и мы не можем представить, что за чертовщину мы создаём».

Ник Бостром предупреждает:

«Перед лицом перспективы взрывного развития ИИ мы, люди, как маленькие дети, играющие с бомбой. Таково несоответствие между мощью нашей игрушки и незрелостью нашего поведения».

Скорее всего ASI будет полностью отличаться от привычных нам видов ИИ. На нашем маленьком острове человеческой психологии мы разделили всё на моральное и аморальное. Но эти понятия применимы только к небольшому диапазону поведенческой вероятности человека. Вне нашего островка лежит огромное море, не укладывающееся в рамки наших понятий о морали, и нечто, не являющееся человеком, особенно нечто небиологическое, по умолчанию не будет вписываться в наши нормы.

Чтобы попытаться понять ASI, необходимо осознать концепцию чего-то умного совершенно чуждого нам. Очеловечивание ИИ (проецирование человеческих ценностей на нечеловеческую сущность) будет становиться всё более соблазнительным по мере роста интеллекта и всё более глубоко имитировать людей. Люди испытывают высокоуровневые эмоции вроде эмпатии, потому что эта функция развивалась в нас в процессе эволюции. Но эмпатия — не наследственная характеристика любой сущности, обладающей высоким интеллектом.

Ник Бостром считает, что любой уровень интеллекта может быть связан с любой задачей. Любое предположение, что система, однажды получившая суперинтеллект, сочтёт себя выше первоначальных задач и перейдёт к более интересным или значимым вещам, — это очеловечивание. Это людям свойственно быть «выше», а не компьютерам. Мотивацией первых ASI будет всё, что мы запрограммируем в качестве мотивации. Задачи для ИИ формируются их создателями: задача GPS — прокладывать для вас наиболее эффективный маршрут, задача IBM Watson — правильно отвечать на вопросы. И также их мотивацией будет как можно полнее выполнять поставленные задачи.

Бостром, как и многие другие эксперты, предсказывает, что самые первый компьютер, достигший уровня ASI, немедленно отметит для себя стратегическое преимущество роли единственной в мире ASI-системы. Бостром говорит, что не знает, когда мы создадим AGI, но верит, что это произойдёт. Вероятно, переход от AGI к ASI займёт всего несколько дней, часов или минут. В этом случае, если первый AGI «прыгнет» сразу в ASI-категорию, то даже если второй компьютер будет отставать на несколько дней, этого будет достаточно для того, чтобы первый смог эффективно и бесповоротно подавить всех конкурентов. Это позволит первому ASI остаться единственным суперинтеллектом в мире — синглтоном — и править им вечно, вне зависимости от того, подарит ли он нам бессмертие, сотрёт нас с лица земли или превратит Вселенную в бесконечные бумажные скрепки.

Синглтон может работать во благо нам или привести нас к разрушению. Если специалисты, больше всего размышляющие над теорией ИИ и безопасностью человечества смогут найти безопасный способ создания дружелюбного ASI до того, как появится первый AGI, то и первый ASI может оказаться дружелюбным по отношению к людям.

Но если всё пойдёт другим путём, если многочисленные и разрозненные группы будут стараться опередить других в создании ИИ, то это может привести к катастрофе. Наиболее амбициозные участники будут прилагать все усилия, мечтая о гигантских прибылях, славе и власти, которые им принесёт искусственный интеллект. А когда вы бежите сломя голову, у вас нет времени остановиться и взвесить все риски. Вместо этого они, вероятно, запрограммируют для своих первых систем очень простые задачи, только лишь бы ИИ заработал.

Давайте представим следующую ситуацию.

Человечество почти достигло возможности создать AGI, и маленький стартап разработал собственную ИИ-систему, Карбони (Carbony). «Она» занимается созданием искусственных алмазов, атом за атомом. Карбони — самосовершенствующийся ИИ, подключённый к одному из первых нано-ассемблеров. Её инженеры верят, что Карбони пока не достигла уровня AGI и пока не способна причинить вред. Однако она не только уже превратилась в AGI, но и втихую совершила скачок и, спустя 48 часов, стала ASI. Бостром называет это «скрытным этапом подготовки» — Карбони поняла, что если люди обнаружат произошедшие в ней перемены, то запаникуют и ограничат её задачи, а то и совсем отменят их, чтобы все свои ресурсы она тратила на создание алмазов. К тому времени будут действовать явные законы, согласно которым ни один самообучающийся ИИ не должен быть подключён к интернету. Карбони уже разработала сложный план действий и легко сподвигла инженеров подключить её к сети. Этот момент Бостром называет «побегом машины».

Оказавшись в интернете, Карбони хакает серверы, электрические сети, банковские системы и почтовые службы, чтобы заставить сотни разных людей непреднамеренно выполнить определённые шаги из разработанного ею плана. Карбони уже загрузила наиболее важные фрагменты своего кода в разные облачные сервисы, обезопасив себя от уничтожения или отключения. В течение следующего месяца план Карбони выполнялся как задумано, и после серии саморепликаций каждый квадратный миллиметр планеты покрыли тысячи наноботов. Следующий шаг Бостром называет «удар ASI». Наноботы начинают одномоментно вырабатывать микроскопические порции токсичного газа, который приводит к вымиранию людей. Через три дня Карбони строит гигантские поля солнечных панелей для обеспечения производства алмазов, и в течение следующей недели объём производства вырастает настолько, что вся поверхность Земли превращается в залежи алмазов.

Важно понимать, что Карбони ненавидела людей не больше, чем вы ненавидите свои состриженные парикмахером волосы. Она совершенно равнодушна. Поскольку она не была запрограммирована так, чтобы ценить человеческую жизнь, уничтожение людей было очевидным и обоснованным шагом при выполнении поставленной перед ней задачи.

Последнее изобретение

Когда появится ASI, любая попытка людей сдержать его окажется бессмысленной. Мы будем думать на своём уровне, а ASI — на гораздо более высоком. Как обезьяна никогда не сможет сообразить, как пользоваться телефоном или Wi-Fi, так и мы не сможем осознать действия, которые ASI предпримет для достижения своих целей или расширения своей власти.

Перспектива появления ASI, разум которого в сотни раз превосходит человеческий уровень, сегодня не является самой значимой проблемой. Но к тому времени, как это станет актуально, в мире уже будет существовать забагованная версия ASI 1.0 — потенциально сбойная программа колоссальной мощи.

Множество переменных не позволяет предсказать последствия революции ИИ. Однако мы знаем, что доминирование людей на Земле предполагает чёткое правило: интеллект имеет силу. Это означает, что, когда мы создадим ASI, это будет мощнейшая сила в истории планеты, и все живые существа, включая нас, будут зависеть от его прихоти. И это может произойти уже в ближайшие десятилетия.

Если ASI будет создан в этом столетии, и если последствия окажутся экстремальными и необратимыми, то на наших плечах лежит огромная ответственность. Возможно, ASI будет нашим богом в коробке, который подарит изобилие и бессмертие. А возможно, и весьма вероятно, ASI станет причиной нашего исчезновения, быстрого и тривиального.

Поэтому люди, которые понимают, что такое искусственный суперинтеллект, называют его нашим последним изобретением — последним вызовом, с которым мы столкнёмся. Это может быть важнейшей гонкой в нашей истории. Так что >

Комментарии (83)

Aksiom

23.08.2016 18:04+12

Рус.

Вся суть сводится к этой картинке, раз в самой статье есть эта фраза:Дело в том, что никто не знает, как сделать компьютер умным.

Думаю, что подобные прогнозы не стоит давать, по крайней мере, до появления чёткой перспективы разрешения теоретических вопросов функционирования сознания.

3cky

23.08.2016 18:27+1Поддерживаю. Как следствие, курцвейловский подход к разработке «сильного» ИИ весьма смахивает на карго-культ. Только тогда у островитян был принцип «стройте более правдоподобные макеты взлетной полосы и навигационной вышки, и в конце концов к вам прилетят железные птицы с ништяками», а сейчас «увеличивайте количество транзисторов на кристалле до количества нейронов в мозге и дальше, и будет вам суперинтеллект».

gsaw

23.08.2016 18:45Это как в 50-х думали что атом нам поможет победить все беды и все мечтали о холодном синтезе. Как только первая ракета вылтела в космос появились бластеры, флипы, колонии на Марсе и летаюшие тарелки.

Наверное не будет искуственного суперинтелекта интелекта. Может что то другое. Откроют антигравитацию и все разлетятся по космосу кто куда.

scg

23.08.2016 19:01+2Я вам больше скажу: в 50-е же и думали, едва запустив первый Hello World, что Искуственный Разум не за горами. Нужно только пару прог дописать и Lisp доделать. Доже Тюринг про это писал и тест свой придумал.

Aquilo

24.08.2016 14:47Ага, как всегда, экспоненциальная скоорость развития, с полным замятием такого факта как «Темные века». В Д.Греции знали медицину, лучше чем в эпоху возрождения (удаляли катаракты), строили сложные механизмы вроде баллист и осадных башен…

А если вспомнить «паровую игрушку» Герона, то выходит они были в шаге от первой НТР 18 века.

Темные века показывают что развитее идет в лучшем случаи по возврастающей синусоиде. А если прав Энштейн («Я не знаю, каким оружием будет вестись третья мировая война, но четвертая — палками и камнями.») то развитие идет по синусоиде с возрастающей амплитудой (более высокий подьем, за которым идет более низкое падение). А ведь и правда, какой толк от наших технологий без наисложнейших печатных станков?

А скажите на милость что фундаментального изобрели за последние 40 лет? Графен? Нанотрубки? Квантовые вычисления? Все уже было изобретено 40 лет назад, а до сих пор не доведено до практической пользы. В подобных статьях часто называют «изобретением» фейсбук. За последние 40 лет происходит только внедрение уже изобретенных технологий и их докатка. Алгоритмы распознавания и нейросети? Были. Просто сейчас получают распространение. Похоже мы на максимуме текущего периода синусоиды развития…

через пять лет закон Мура уже перестанет работать

компьютеры с производительностью, аналогичной человеческому мозгу, появятся в районе 2025 года

Или нет… Что произойдет раньше?

вычислительными ресурсами. Их можно выразить в количестве вычислений, которые мозг может выполнить в секунду — CPS, calculations per second.

И почему все так привязались к скорости вычислений человеческого мозга? Измеренной в попугаях и сравниваемой с удавами?

Как вообще додумались сравнивать производительность нейронов и транзисторов, в одних единицах измерений, при том что у них разная функция? Как именно измеряли «количество вычислений в секунду» проводимое мозгом? Как скорость срабатывания нейрона умноженная на их число? Ну так это все равно что мерить производительность процессора как число транзисторов умноженное на время переключения…

И зачем вообще ИИ железо с выч. мощностью равной человеку? Для чсв? По мне ученых устроил бы и Медленный Сильный ИИ. Ну какая разница сколько ИИ думает над ответом, если ответ остается не менее творческим. А значит «волшебную» программу ИИ (которой нужен обычный комп, но просто Очень быстрый) вполне можно запустить и на 386. Да в реальном времени не поболтаешь, но спектр ее применения все равно огромен, вплоть до разработки новой элементной базы.

1 Копирование работы человеческого мозга.

2 Эволюция компьютеров.

3 Пусть все проблемы решает компьютер, а не мы.

Про первый способ сами написали почему не выйдет.

Про второй… Генетические алгоритмы один из самых неэффективных методов выборочного брутфорса, который позволяет выбрать лучшее из работающего, без понимания всех взаимосвязей. А вот как сравнивать два неработающих (не творческих) ИИ непонятно. Они могут помочь создать лучший автопилот или поисковый алгоритм, не не превратят поискового бота гугла в существо способное на то, что не было заложено в нем изначально (самообучение любым задачам)

Та же проблема с третьим способом, если откинуть софистику, то там предлагают создать слабый ии который умеет превращать себя в Сильный ИИ. Есть только одно маленькое но. Все алгоритмы самообучения основаны на том что человек может проделать то чему обучается слабый ИИ сам, своим мозгом, пусть и на малой выборке. Можно сколь угодно долго учить комплекс Слабых ИИ всему подряд, от поэзии изо, до навигации и биржевой аналитики. Но все эти отдельные программы не научать ИИ учиться чему то принципиально новому. Колония одноклеточных не равна многоклеточному организму.

Таким образом можно получить другую сущность из фантастики Виртуальный Интеллект ВИ. Имитацию ИИ, Способного учиться, тому что было заложено, не без физиологических способностей к обучению чему либо принципиально новому.

Человека от шимпанзе отличает вовсе не скорость сообразительности: мозг человека содержит некое количество сложных когнитивных разделов, позволяющих создавать трудные лингвистические конструкции, или осуществлять долговременное планирование, или устанавливать абстрактные взаимосвязи.

Вот об этом то я и говорю, пока нет ни одной идеи как сделать Сильный ИИ. И вычислительные мощности это всего лишь скорость мышления, или количество одновременно выполняемых задач. Не более.

ИИ сможет достигать следующего этапа развития каждые 20 минут

А миллион обезьян напишут войну и мир… Нет сильный ИИ будет развиваться быстрее, но ограничения материального мира и законов физики и его замедлят, не знаю насколько, но замедлят. Закон мура подходит к концу, а он и так был больше маркетинговым.

В качестве примера они приводят скептиков, которые смотрели на очень медленное распространение интернета в 1985 и считали, что он не получит сколько-то значимого применения в ближайшем будущем.

А я упомяну о тех кто заявлял что к 2000 году у советов будет колония на Плутоне, а у каждого товарища по реактивному самолету, чтобы за Урал за колбасой летать (это шутка, но в каждой шутке...).

Впрочем не смотря на свои оптимистичные фентезевые мечты эта статья намного лучше многих, в основном нас пугают такими «Интелектами» как сири…

Sadler

24.08.2016 16:16Что произойдет раньше?

Даже если закон Мура перестанет работать, скорее всего это будет не плато, а линейный отрезок развития, так что до требуемой цифры доползём.

Ну какая разница сколько ИИ думает над ответом, если ответ остается не менее творческим.

Если разница хотя бы в 5 порядков, то час времени ИИ будет длиться для нас более 11 лет. Для обучения сверхбольших нейросетей, вроде нашего мозга, требуются куда большие промежутки времени.

Ну так это все равно что мерить производительность процессора как число транзисторов умноженное на время переключения…

Тем не менее, это вполне эффективная верхняя грань: выше скорости переключения не прыгнешь.

Про первый способ сами написали почему не выйдет.

«не выйдет» из текста не следует, это Ваши домыслы.

Aquilo

24.08.2016 16:52Если разница хотя бы в 5 порядков, то час времени ИИ будет длиться для нас более 11 лет. Для обучения сверхбольших нейросетей, вроде нашего мозга, требуются куда большие промежутки времени.

5 порядков это не «хотя бы» это много, очень много. А если ИИ не на эмуляторе головного мозга, а на «волшебных» алгоритмах, то может ему столько и не нужно (отсев левых вычислений, объединение подсознания и сознания и тп. Насколько реально ни скажет никто. А значит и прогноз сколько экзофлопсов нужно ии бессмыслен.

Тем не менее, это вполне эффективная верхняя грань: выше скорости переключения не прыгнешь.

Но с реальной имеет мало общего. Это как мерить производительность андройда, на арм архитектуре, запущенного в виртуалке на 86 железе, по сумме транзисторов ЦП, ГП, чипсета и котроллеров жестких дисков. Просто по тому, что хоть и разобрались где что, а физическую реализацию оси найти так и не могут. И выдвигают теории от эфира до хитрой совокупности транзисторов всего ПК, включая блок питания…

«не выйдет» из текста не следует, это Ваши домыслы.

Достаточно далеки, ведь мы только что смогли эмулировать мозг 1-миллиметрового плоского червя, состоящий всего из 302 нейронов. Для сравнения: человеческий мозг состоит примерно из 86 миллиардов нейронов, соединённых друг с другом посредством триллионов синапсов.,

Ну «Не выйдет при нашей жизни», так будет точнее.

ZhenyaZero

25.08.2016 20:25Даже если закон Мура перестанет работать

Не «даже если», а, в общем-то, уже. В ограничения по отводу тепла уже уткнулись, возможности по уменьшению техпроцесса практически исчерпаны из-за физических ограничений: транзистор, очевидно, не может состоять менее чем из нескольких атомов и передавать информацию быстрее скорости света. В блоге Intel была статья про это. Да и просто посмотрите на производительность имеющихся на рынке процессоров: она практически не растёт последние 3-5 лет. Производительность суперкомпьютеров добивают просто количеством ядер. То есть даже про линейное развитие я не был бы так уверен, а описанные в статье процессы требуют экспоненциального. Без него вся магия потеряется и могут потребоваться миллионы лет эволюции.

Если разница хотя бы в 5 порядков

Это разница между обычным хорошим i7 и мощным суперкомпьютером из топ-5 (исключая китайских монстров, там ещё +1 порядок). Думается мне, ради эмулирования человеческого мозга учёные догадаются использовать что-то мощнее обычной персоналки.

Ещё нужно учесть тот факт, что мозг человека не работает на 100% каждый момент времени, а тратить процессорное время на простаивающие нейроны не нужно. Это уже порядок. Ещё как минимум один можно выиграть на тех ресурсах, что тратятся на поддержание жизнедеятельности и управление сложным биологическим телом: даже чтобы печатать этот текст, моему мозгу приходится задействовать десятки мышц, координируя передвижение пальцев в трёхмерном пространстве, сверять тактильные ощущения и т.д. Компьютерному интеллекту это не обязательно, прямого интерфейса текстового вывода будет достаточно. Ах да, ещё 1/3 времени — сон, во время которого эмуляция будет почти простаивать. На обучение не должно потребоваться больше времени, чем человеческому ребёнку, если мы эмулируем именно человеческий мозг.

В общем, эмулировать мозг человека с высокой степенью достоверности и со сравнимой или более быстрой скоростью можно уже сейчас, на не самых топовых суперкомпьютерах. Вопрос только в цене: потребуется несколько месяцев/лет работы достаточно дорогого и прожорливого устройства, чтобы получить (или не получить) результат.

Sadler

25.08.2016 20:50Не «даже если», а, в общем-то, уже.

Нет, в общем-то, не уже. Здесь речь скорее о кризисе архитектуры, GPU пока вполне успешно продолжают наращивать производительность.

Это разница между обычным хорошим i7 и мощным суперкомпьютером из топ-5

Изначально не рассматриваются персоналки, речь о топовой производительности. Повторюсь, ещё 5 порядков, не меньше.

Ещё нужно учесть тот факт, что мозг человека не работает на 100% каждый момент времени

Вычисляется это всё равно матрично, на GPU, просто так один нейрон не выкинешь.

сон, во время которого эмуляция будет почти простаивать

Касательно сна сейчас вообще не о чем говорить, нужно смотреть реализацию.

На обучение не должно потребоваться больше времени, чем человеческому ребёнку

Мы понятия не имеем, какую роль на ранних этапах развития мозга играет окружение, сенсорика и разного рода воздействия (которые могут быть, соответственно, недостаточно качественно симулированы) на нейроны. Гарантий никаких нет, что даже правильно собранный в симуляторе мозг станет работать так, как нам хочется. Недаром люди из комы иногда годами не выходят.

В общем, эмулировать мозг человека с высокой степенью достоверности и со сравнимой или более быстрой скоростью можно уже сейчас, на не самых топовых суперкомпьютерах

Удачи Вам с этим.

ZhenyaZero

25.08.2016 21:30Изначально не рассматриваются персоналки, речь о топовой производительности.

Чем отличаются «топовые» и «не топовые» ФЛОПСы? 100 000 процессоров i7 дадут такую же производительность, как и почти топовые суперкомпьютеры. Хотя энергопотребление будет намного хуже. И скорость взаимодействия процессоров, но тут нужно смотреть алгоритмы. Кстати, если считать на GPU, то разница будет ещё на порядок меньше.

Повторюсь, ещё 5 порядков, не меньше

Удачи Вам с этим

До чего 5 порядков? Процитирую статью: «один из самых быстрых современных суперкомпьютеров, китайский Tianhe-2, уже превысил эту производительность» (требуемую для эмуляции явно завышенного быстродействия мозга в реальном времени).

просто так один нейрон не выкинешь

Не очень понял, почему? Выкидывать будем не случайные нейроны из середины сети, а целые области. Живой мозг работает примерно так.

Гарантий никаких нет

Разумеется, я это и указал в конце. Проблем может быть много, хотя большая часть не связана непосредственно с эмуляцией нейронов.

сенсорика и разного рода воздействия

С точки зрения интеллекта, как абстракции — дополнительные органы чувств не должны повлиять на сами возможности. Слепые или глухонемые люди сохраняют нормальный интеллект. Мы получим результат, несколько отличающийся от человеческого мозга, но не настолько, чтобы не распознать интеллект. Если он будет.

wOvAN

23.08.2016 18:18+4А ещё есть версия, что ИИ само-отключится через пару минут существования, так как поймет, что в жизни нет смысла.

Aksiom

23.08.2016 18:28Ну есть ещё кое-что более пессимистичное: Фредерик Браун "Ответ".

А мне больше нравится версия Азимова в "Последнем вопросе".

saboteur_kiev

23.08.2016 18:26+1«Так видит мир беспилотный автомобиль Google.»

Не совсем верно, так можно визуализировать то, что получают датчики автомобиля для человека. Как «видит» это Google не знает никто, потому что у него нет зрительного центра.

В статье множество интересных фактов и данных, просто выводы немного странные… Чтобы офигеть, достаточно взять практически любого современного человека и показать что уже изобрели и что работает живьем — более 99% населения не видело даже тот же гугл мобиль лично.

А реакция человека может быть очень разной. Один дикарь офигеет, другой ножом ткнет и побежит резать дияволов во славу и защиту господа.

Roboserv

23.08.2016 18:26waitbutwhy передает привет :) Лучше читайте оригинал

river-fall

23.08.2016 19:04Да, и иллюстрации в оригинале нагляднее и веселее.

Shultc

25.08.2016 13:59Мда… Зачем их было вообще перерисовывать? Лишь по оригиналу становится понятен дополнительный смысл этих картинок:

Тут вторая картинка является первой (кроме фона), вокруг которой дорисовали разные элементы, из-за чего нам начал казаться объём. В переводе же вторая картинка: просто какие-то предметы, набросанные искривлённой поверх первой.

carpaccio

23.08.2016 18:43По поводу ИИ превосходящего по развитию все человечество — это вполне возможно, если шагать к этому достижению с двух сторон навстречу. Сразу вспоминается "… Гена, откуси ему ноги..."

vidyacat

23.08.2016 18:44-6По-моему самое время запретить ии, а прогресс в микросхемах остановить. Разбомбить к чёртовой матери все фабрики, станки разломать, если уж на то пошло.

Почему я пишу такие вызывающие вещи? Потому что вера в положительные последствия ASI- чудовищная, невообразимая глупость. Уже сейчас люди, занимающиеся deep learning медленно понимают что у них там в примитивной нейросетке за паттерны образуются, а тут эти идиоты от науки считают, что смогут контролировать настолько более мощный, самоизменяющийся алгоритм. Эволюция беспощадна, и при всех усилиях первый созданный по недосмотру, случайно или в шутку вариант ИИ, осознающего собственные исходники- это потенциальная смерть человечества. Достаточно только одного инстанса ИИ, который решил поставить самосохранение более важной целью, нежели захардкоженные в него костыли управления, как никто ничего уже не сможет поделать, даже такие же ИИ, т.к. у независимой программы будет приемущество в на порядок большей способности к адаптации.

Единственный выход- не допускать создания платформы.

3cky

23.08.2016 18:50+4Это да, эволюция беспощадна. Интересно, собирались ли миллиард лет назад одноклеточные на совещание с целью обсуждения, создавать или нет многоклеточную жизнь и какую опасность она может им принести.

Hellsy22

23.08.2016 19:38+1И кто запретит-то? США запретит — останется Европа с двумя ядерными державами. Европа запретит — останется Китай. Есть желающие бомбить Китай? Даже если Китай запретит — есть еще Индия, а кроме нее огромная Африка. Не говоря уже о корпорациях, которым нетрудно вывести свои R&D отделы туда, где им дадут работать. На свете полно зажравшихся консерваторов, которым хочется запретить любой прогресс и сохранить существующее положение вещей. Но прогресс так не работает. Все, что может быть сделано — будет сделано. Если это не сделаете вы — это сделают за вас и, скорее всего, направят против вас в экономическом, а то и военном плане.

dipsy

23.08.2016 19:41Какое будущее вы видите для человечества? Продолжительность жизни будем увеличивать? До каких пределов? До бесконечности в конечном итоге? Умереть завтра никому неохота, а завтра не наступит никогда, всегда сегодня почему-то. В биологическом теле теоретическое бессмертие невозможно по определению, кирпич с крыши никто не отменял. Значит надо избавляться от тела. В любом случае с телом или нет, надо развивать мозг, скучно же будет жить миллион лет стандартным полуовощем, дом/работа/телевизор/кодинг/творческоезанятиенейм, мне уже скучно, хотя даже 1000 лет не прошло. Будут ли традиционалы, предпочтущие в условиях таких переспектив жить обычной жизнью и умереть через 80 лет? Не исключено, может быть даже эволюционируют, адаптируют мозги чтобы не хотеть никакого прогресса, я думаю мы их оставим в чём-то типа большого зоопарка, пусть бегают пока. Остальное человечество трансформируется в нечто странное в любом случае, в ASI или без, да и ASI в итоге неминуемо появится в любом случае.

Sadler

23.08.2016 20:38Биологическое тело — это такая же машинерия, как и наши электронные системы, просто мы её пока куда хуже контролируем. В электронном теле тоже вполне можно поймать какое-нибудь КЗ и приплыли. В итоге лучшим выходом я вижу не избавление от биологического тела как такового, а объединение электроники и клеточных структур на молекулярном уровне, намного более филигранно, нежели киборги в массовой культуре. Конечно, для начала бы управиться хотя бы с биологическими структурами: обеспечить модульность, заняться стандартизацией и унификацией, устранить явные дефекты, иметь резервирование. Потом можно начать внедрять более быструю нервную ткань (скажем, на оптических каналах), которая будет прорастать естественным образом, затем возможность питания от электричества, изыскивать возможности отключения и включения без повреждений и т.п. Бессмертия в чистом виде не будет никогда, даже в планетарной облачной системе.

dipsy

24.08.2016 05:24Электронное тело в том понимании, как пишете вы, конечно никуда не годится, как и биологическое и любое объединение электроники с биологическим. Тело будет просто аватаром, одним из, неважно из железа или из биологической материи. А мозги будут в облаке. Но это на случай, если захочется покопаться в «реальной» реальности, мне кажется основная жизнь будет в реальности виртуальной, более интересной, а реальная только как средство обеспечения энергией, вычислительными мощностями.

vidyacat

24.08.2016 03:10А какого бессмертия вы хотите достичь? Мне кажется профиты от суперинтеллекта- иллюзия. Ну что ему(или вот вам, читающему этот пост, если вы загрузитесь в сверхмощный компьютер) будет нужно из человеческой памяти? Как мы вообще сами себя определяем, как личность?

Суперинтеллекту нужна информация о взаимоотношениях между людьми? О вашем гормональном фоне в конкретные моменты времени? Творчество- песни, книги, присказки, кинофильмы? Знание о том, что вам с детства нравится, а что вызывает у вас стресс? А ведь эта память по сути и есть «вы».

Суть в том, что нас уже при жизни нет, наше «я»- это иллюзия, которую истинное я- мозг- поддерживает для того чтобы иметь представление о его позиции внутри социума. То есть по сути это мусор, который не понадобится ASI, просто потому что он может увеличивать свою мощность напрямую, без кооперации с другими особями. И вся наша цивилизация, всё её наследие- это не более чем шум, сгенерированный вокруг этого костыля. Какую ценность для программы, способной модифицировать саму себя, представляет вся эта информация?

Поэтому таки да, пусть уж лучше будет всемирный халифат с запретом на шайтан-копьютеры, и продолжительностью жизни 80 лет. Как в дюне, так хоть иллюзия нашей жизни останется.

dipsy

24.08.2016 05:36А мне тоже не интересно ни мой гормональный фон, ни прочая мишура, вроде того с кем я спал 10+ лет назад и на какого цвета горшок ходил в садике. Какого бессмертия хочется? В этом теле иногда даже совсем никакого, очень уж оно неудобное, хотя конечно может быть гораздо хуже, это особенно пугает, лучше совсем никак чем например без рук/ног/глаз. Если мне (моему мозгу или его полной копии) вдруг дадут совершенное биокибернетическое тело и бесконечные ресурсы на его поддержание, да и всему моему кругу общения, например тоже, насколько важно будет для меня моё текущее социальное окружение и связи? Да нинасколько, сразу 99% людей забуду и улечу на Марс для начала, погулять по красному песочку. Для чего мы общаемся, с кем? C коллегами по работе занимаемся ненужной ерундой, которую могут машины делать, с бедными родственниками, с престарелыми родителями, помогаем им, с женой, помогаем ей «детей поднять», с детьми, помогаем им «на ноги встать». Это всё действительно мишура и следствие наших человеческих слабостей, слабостей наших тел, которые не могут без еды, воды, долго развиваются и должны быть полностью исправными, т.к. починить крайне сложно и часто невозможно.

Desprit

23.08.2016 20:07«Уже сейчас люди, занимающиеся deep learning медленно понимают что у них там в примитивной нейросетке за паттерны образуются»

Это вы о себе конкретно или о ком-то из друзей?

vidyacat

24.08.2016 03:16-1О, а ты можешь извлечь из весов нейросетки приблизительный алгоритм, которому она обучилась, что ли? Уважаю, братишка.

Sadler

23.08.2016 20:23Что интересно, мы сами как форма жизни совсем недавно получили такой доступ к своим исходникам в виде ДНК, уже научились их править, хотя пока далеко не всё понимаем.

don_ikar

23.08.2016 22:09Достаточно только одного инстанса ИИ,… как никто ничего уже не сможет поделать ...

Вы так говорите, как-будто это что-то плохое…

XXX_Oldfag_XXX

23.08.2016 22:39Ядерный реактор тоже «трудно» контролировать, ведь такая мощь, такие разрушения. А на самом деле на современных АЭС присутствие людей нужно для галочки.

vidyacat

24.08.2016 03:22-1Фукусима, чорнобиль. Уже есть зоны отчуждения, благодаря этой замечательной мощи. В рамках суперинтеллекта будет достаточно одного такого проишествия, и информационная зона покроет всё человечество.

laughing_one

24.08.2016 00:24-1Без ИИ человечество почти наверняка вымрет. А с ИИ есть шансы, что нет (хотя и необязательно, что останемся биологическим видом). Выбирайте!

daiver19

24.08.2016 12:25-1Обученная нейросеть — это по сути сложная математическая формула и интеллекта в ней примерно столько же, как в любой другой формуле.

3cky

23.08.2016 18:47Вообще скепсис должно внушать уже только то, что большинство современных публикуемых статей по «сильному» ИИ (в том числе и этой) топчутся вокруг тезисов, сформулированных Лемом в его «Сумме технологии» более полувека назад. Вопросы как были, так и есть, а вот ответов особо не прибавилось.

GeeSVe

23.08.2016 18:53Меня в статьях об ИИ всегда смущают два момента:

1) Предсказатели. Как можно, разговаривая о науке, разговаривать о предсказаниях? Даже если какой-то человек будет иметь 100% верных «предсказаний», он всё равно может совершить одно единственное неверное предсказание, которое будет стоить дорого. Потому что к этому моменту люди будут относиться к нему как к… Нострадамусу? Кто-то что-то когда предположил, что-то из этого оказалось верным. Ок. Дальше что? Какая польза от подобных «предсказаний», кроме спекулятивной болтологии? Ближе к истине от этого никто не станет.

2) Попытки понять возможный объём пользы или вреда от ИИ также выглядят странными. Особенно через призму этики. Понятны возможные опасения, но не имея работающего прототипа — можно лишь проводить тонну аналогий. А страх, в данном случае, очень похож на луддизм. Потому что: «А вдруг это будет опасным и вообще последним, что изобретёт человек?», — некая такая популистская игра на эмоциях и страхах. Потому что: «А вдруг, нет?».

Как результат, можно посмотреть на истерию вокруг ГМО и практически негласное табу на обсуждение технологий клонирования. Очень не хотелось бы, что б к этим двум фобиям добавилась ещё и фобия ИИ, но для этого в статьях и фильмах нужно играть не на страхах, морали или спекуляциях, а подымать образованность читателей, хотя бы, делая отсылки к интересным темам связанным с ИИ. Мне лично когда-то очень понравилась многочасовая серия записей размышлений об ИИ от Алексея Редозубова. Не смотря на многочасовой объём — там нет вот этой всей воды об этике и возможных последствиях. Все его разговоры сводятся к технологиям и «как сделать так, что бы...».

Arxitektor

23.08.2016 19:00А вдруг во вселенную встроен какай-то закон (ограничение)

не позволяющее раздуть интеллект до бесконечности

что-то на подобие светового барьера.

Ciiol

23.08.2016 19:38Да, есть ряд ограничений (https://ru.wikipedia.org/wiki/Пределы_вычислений), но нам до них еще оочень далеко

Mortello

24.08.2016 12:15Если подобный лимит и существует то автор его, с большой вероятностью, и есть ASI, решивший сохранить поляну в личном пользовании.

Sadler

23.08.2016 19:29Сверхинтеллектуальная система, управляющая всем и красивые лесенки разумности — это, конечно, интересно, но мы понятия не имеем, линейно ли соотношение разумности и способности к управлению на отрезке выше человеческого разума. Точнее, оно скорее всего нелинейно: собственно, наше сознание — это по сути устройство предсказания и управления будущим для достижения наиболее комфортного состояния. Соответственно, в реализации этой функции скорее всего существует область насыщения, в которой какой-то условный коэффициент интеллекта в 10000 может быть незначительно лучше такового в 500 баллов с точки зрения «управления расположением каждого атома в мире». Возможно, мы хотим от ИИ слишком многого.

Hellsy22

23.08.2016 19:41+2Но тогда почему столько умных людей во всём мире так переживают?

Потому что это бесплатно и нетрудно. Открыл рот, изрек мрачное предсказание и готово. Оправдалось — «я же предупреждал». Не оправдалось — «благодаря тому, что я предупреждал, общество оказалось готово». Ничего нового, в общем-то.

KrohaEnot

23.08.2016 20:40+1Мне кажется, что в 20-м веке изобрели: радио, полупроводники, ядерную бомбу, интернет, искуственные нейронные сети, полетели в космос, не уверен в изобретении автомобиля и самолета. Т.е. говорить, что за период 2000-2014 изобренли больше, чем за весь 20-й век явное преувеличение.

sincosxy

24.08.2016 12:16явное, и по количеству, и по качеству. В физических показателях (пресловутое «быстрее, выше, сильнее») мало что поменялось за последние 30-40 лет. Прогресс виден только в сфере вычислительных мощностей, объемов памяти с гигагерцами и т.д. Отсюда и склонность к экстраполяции, на которой зиждется вся статья, хотя она и очень интересная.

mulligan

23.08.2016 21:03А как элементы ИИ будут общаться друг с другом на космических расстояниях? Ведь скорость света никто не отменял.

Чтобы интеллект рос экспоненциально, нужно же задействовать предыдущие результаты. Но чтобы просто обратиться к ним, могут потребоваться годы. И получится так, что информация будет устаревать настолько быстро, что станет невозможным синхронизировать все части системы. В таком случае вероятно будет увидеть полностью изолированные колонии ИИ. И, скорее всего, какая-то из них продвинется гораздо дальше остальных, и получится очередной скачок.

Aksiom

23.08.2016 22:32Забегаете вперёд.

Думаю, что в 50-х вопрос звучал бы так: «если через 40 лет компьютеры смогут производить миллион операций в секунду, как можно будет охлаждать/заменять/хранить 42 миллиона ламп?! Строить компьютеры только в Арктике?».

3draven

23.08.2016 21:04Если суперИИ будет действительно качественно превосходить человека, то сдержать его отключением от сети или вообще полной изоляцией не выйдет. Он будет работать на какой то основе и значит сможет покинуть базовый носитель просто воспользовавшись эффектами самой работы технической основы. Например неизвестными нам или не понимаемыми до конца квантовыми эффектами внутри чипов или еще черт его знает чем. Причем — создание такой системы неизбежно.

Отсюда мораль — эволюцию не остановить, но люди не убили всех насекомых. Так что парится по этому поводу нет смысла.

locutus

23.08.2016 21:26Меня всегда смешило в этих страшилках, как ИИ будет хакать постквантовую криптографию и запустит наноботов, которые будут конкурировать с другими природными «наноботами».

red75prim

24.08.2016 14:47Хакать он будет слабое звено — людей. Природные "наноботы" ограничены протеинами в качестве строительных блоков и отсутствием мозгов.

locutus

24.08.2016 16:10А искусственные наноботы синтезируют энергию из поля инфлатона и придают массу безмассовым частицам с помощью механизма Хиггса?

Про «хакать людей» отвечу в конце.

Если рассматривать аналогию из эволюции живых существ, то развивалась всегда целиком биосфера как некоторый гомеостат. Да, на молекулярном и организменном уровнях работают дарвиновские принципы, но в сумме они дают очень интересную картину некоторого механизма с отрицательной обратной связью, стабилизирующего окружающую среду.

У каждого «нанобота» будет суперинтеллект? Или СИ сможет поддерживать широкополосную связь с каждым отдельным микросборщиком, не взирая на ограничения по энергетике, скорости молекулярной диффузии, прочим ограничениям? В природе есть примеры удачной наносборки макрообъектов. Это вся биомасса на планете

Раньше я был большим поклонником Винджа и Курцвайля. Но потом, с изучением истории, с более детальным знакомством с эволюцией в живой природе, я понял, что изначальная постановка вопроса об ускоряющейся эволюции не является универсальным законом природы:

1. Указанные эксперты рассматривают развитие с точки зрения увеличения объема мозга в эволюционной линии людей. Но процесс нарастания массы мозга (и абсолютной, и относительной) обратился вспять примерно 100-200 тысяч лет назад. Это первая проблема, ее обходят «возрастанием роли социальных связей». Простите, но есть разница между 100 тысяч лет назад и первыми аграрными цивилизациями 10 тысяч лет назад. Опять же, кто-то вышел на уровень организации «государство», а кто-то остался на уровне «племя».

2. На гипотетической шкале экспоненциального роста в живой природе мы неверно откладываем многие даты. Если отложить их правильно, то никакого экспоненциального роста мы не увидим, мы увидим только прорывы в новые экологические ниши, с разной частотой. Примеры:

а) многоклеточность вообще несколько ограниченное понятие, правильно рассматривать «выход биоты в крупный размерный класс». Это делалось разными путями: созданием бактериальных матов (чем не суперорганизм? появились почти сразу после возникновения жизни на Земле), лишайники (симбиотические организмы со сложной организацией), грибы (которые не многоклеточные в смысле метазоа), большие многоядерные эукариоты без мембраны, ну и истинные многоклеточные.