Американская компания Movidius известна как разработчик аппаратного ускорителя нейросетей Myriad 2 VPU и поставщик микросхем для системы искусственного интеллекта GoogleNet.

После оптимизации и подготовки бинарника в фирменном фреймворке Fathom Deep Learning Software Framework нейросеть эффективно работает на ускорителе Myriad 2 с энергопотреблением менее 1 Вт. Такие микросхемы идеально подходят для роботов, мультикоптеров, смартфонов, видеокамер наблюдения, шлемов дополненной реальности — любых гаджетов, где пригодится распознавание объектов, распознавание речи, трекинг объектов, навигация и т.д.

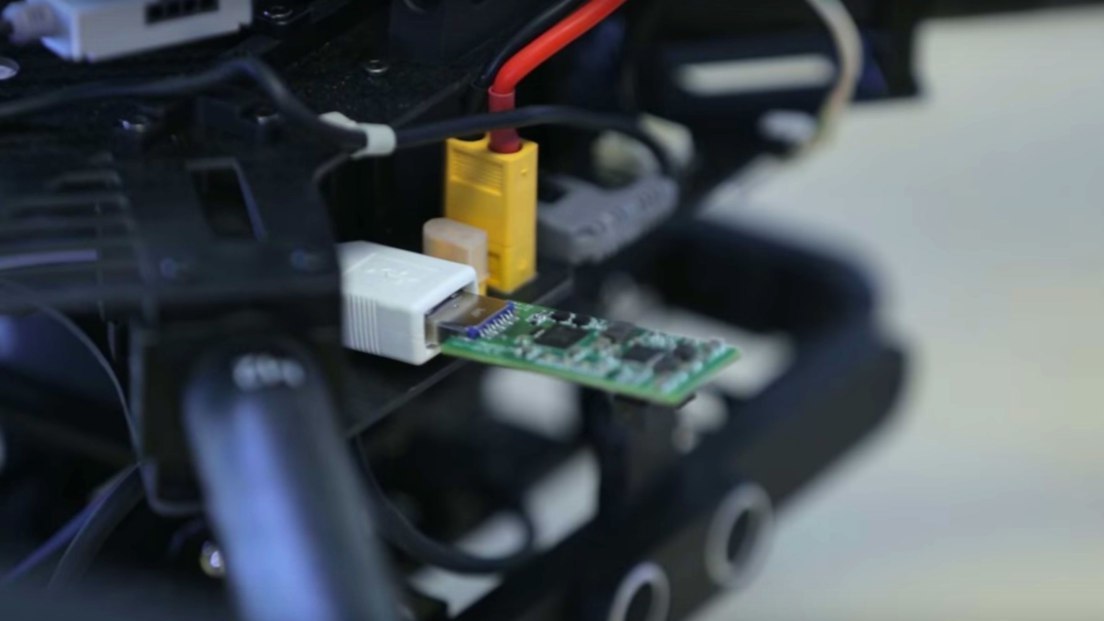

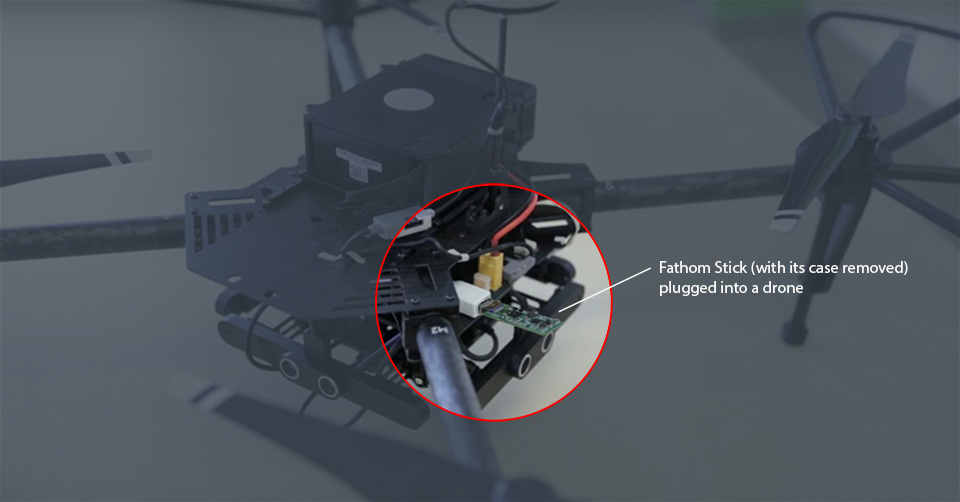

Одновременно с фреймворком Fathom компания Movidius сегодня на саммите Embedded Vision Summit в Калифорнии впервые показала публике ускоритель-на-флешке Fathom Neural Compute Stick — первый в мире прибор такого рода. Здесь вообще всё сразу готово к применению. Флэшка со встроенным ускорителем Myriad 2 просто вставляется в любое устройство с USB-портом.

Таким образом, теперь разработчики могут нативно испытывать нейросети сразу на целевых устройствах, для которых те разрабатываются.

При подключении к компьютеру флешка Fathom Neural Compute Stick выполняет роль инструмента профилирования и оценки, ускоряя прототипирование и обучение нейросети. Fathom поддерживает основные фреймворки глубинного обучения, в том числе Caffe и TensorFlow.

«Как участник экосистемы глубинного обучения, я давно надеялся на появление чего-нибудь вроде Fathom, — говорит д-р Ян Лекун (Yann LeCun), основатель и директор научного центра данных Нью-Йоркского университета, известный специалист в области машинного обучения, компьютерного зрения, мобильной робототехники и вычислительной нейробиологии, один из создателей технологии сжатия изображений DjVu и языка программирования Lush. — Fathom Neural Compute Stick — это компактный, маломощный ускоритель свёрточных сетей для встроенных приложений, который уникален сам по себе. Как разработчик и создатель различных роботов и беспилотных аппаратов, я давно мечтал получить в свои руки нечто такое. С Fathom каждый робот, большой или маленький, сразу получает наилучшее компьютерное зрение».

Компания Movidius уже получила заказов более чем на 1 млн ускорителей Myriad 2. Компания рассчитывает, что скоро ускориители нейросетей внедрят в смартфоны и другие гаджеты. Это приведёт к распространению множества новых уникальных приложений, которых сейчас так не хватает. Например, мы сможем наконец-то мгновенно распознать девушку в метро, запустив нейросеть с локальной копией профилей «Вконтакте» на собственном смартфоне.

Один из 1000 экземпляров Fathom Neural Compute Stick можно заказать бесплатно для тестирования. Начало продаж ожидается в IV кв. 2016 года по цене менее $100.

Комментарии (13)

rPman

02.05.2016 19:04+1Есть какие то численные характеристики этого ускорителя, в сравнении с сетями той же размерности на классических CPU/GPU?

Maxmaxmaximus

02.05.2016 19:54-1Надо встроить в процессоры, аппаратное ускорение графики, квантовых вычислений, и нейросетей ^_^

Idot

03.05.2016 14:28А насколько трудно запустить нейросеть на GPU?

(напомнило историю с отдельным физическим процессором PhysX, который более-менее эмулируется на GPU через CUDA/OpenCL)

BelBES

03.05.2016 23:20+1Смотря что понимать под "трудно". Большинство алгоритмов, основанных на глубоких нейронных сетях, сейчас в реалтайме способны работать только на топовых десктопных GPU… а всем хочется сетки считать на телефонах.

Idot

04.05.2016 13:18А простенькую нейронную сеть для AI в компьютерной игре GPU ведь потянет?

PS если Вы в теме (а я по Вашему ответу подозреваю, что Вы и есть тот самый человек, кто в теме), то было бы крайне интересно почитать статью про реализацию нейронной сети на GPU. (возможно, на Хабре, но и Гиктайме — тоже было бы интересно)

barmaley_exe

04.05.2016 14:41+1Все операции с нейросетью сводятся к простым операциям линейной алгебры, поэтому сами по себе не очень трудоёмки. Однако, при обучении нужно перелопатить огромное множество данных, причём не один раз, поэтому процесс обучения хочется ускорить настолько, насколько это вообще возможно. Соответственно, для того, чтобы сказать «потянет» или «не потянет», нужно определиться с деталями: насколько большой вход у нейросети, насколько большая (в ширину и глубину) эта сеть, сколько раз в секунду её нужно вызывать.

Вообще же, мне кажется, в игровом ИИ нейросети используются редко, ведь есть более простые и прозрачные методы.

Что касается реализации на GPU, то, как правило, никто не пишет GPU-ориентированный сишный код, люди описывают нейросеть на каком-нибудь высокоуровневом языке (python или lua, например) с использованием специального символьного пакета, а потом из этого высокоуровневого описания генерируется сишный код (рассчитанный, как правило, на CUDA – технологию программирования под GPU от nVidia). Он же потом компилируется нужным компилятором, запускается, а результаты можно обрабатывать в том же высокоуровневом языке.

Ocelot

Началось.

Bot_0002

На таком уровне к сожалению еще нет.

GadPetrovich

Не волнуйтесь, скоро все будет.

Bot_0002

Надеюсь. А то очень уж хочется, в Друмир попасть.

MiksanDr

Что-то мне кажется, что когда будет на таком уровне долго радоваться мы не будем.

Bot_0002

Ааа пофиг. Главное успеть сорваться, а там хоть трава не расти.